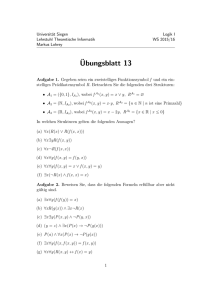

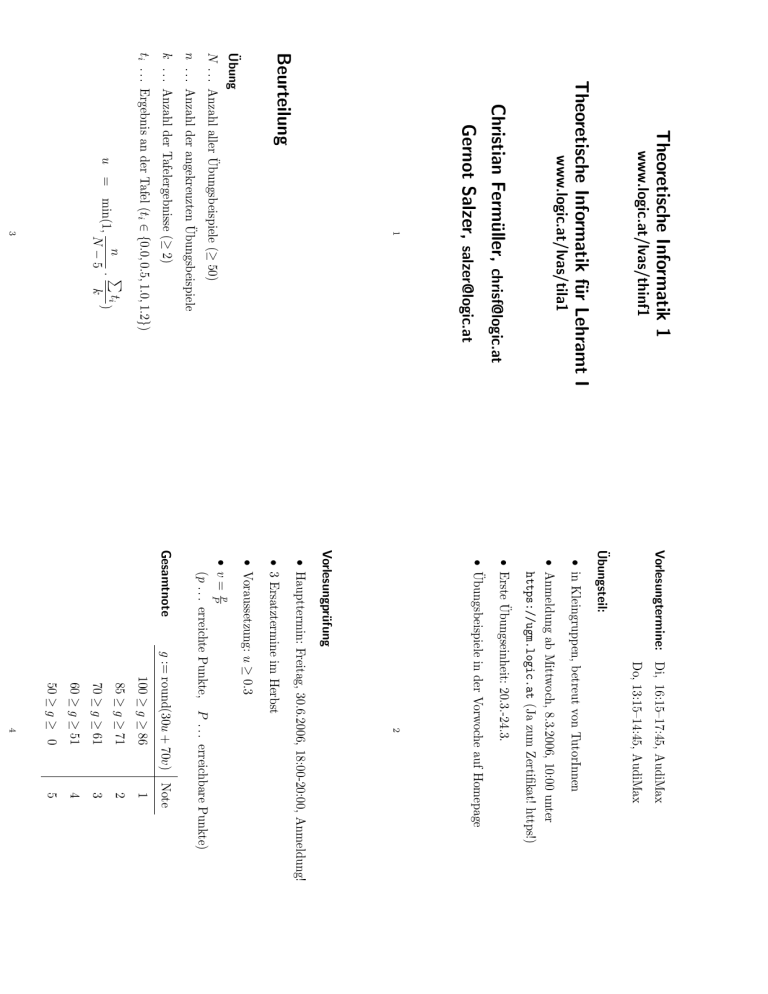

T h eoretisch e In form atik 1 T h eoretisch e In form atik fu r L eh ram

Werbung