Skript zur SDT

Werbung

1 Einführung

1.1 Motivation

SDT in der Psychologie

• Mensch als Detektor/Entscheidungsträger

– Empfindlichkeit/Entdeckbarkeit des Reizes

– Antworttendenz

• Psychophysisches Modell

– Beschreibung nicht beobachtbarer Prozesse

– Verhaltensvorhersage

Anwendungsbeispiele

• Psychophysik: 1000 Hz-Ton aus weißem Rauschen

• Diagnostik: bestimmter Befund vorhanden?

• Seismologie: Steht Erdbeben bevor?

• Zeugenaussagen: Person vor Ort?

Bsp. Detektion von Tönen im Rauschen

• 2 VPn sollen reagieren, wenn Töne anwesend sind

• Je 100 Durchgänge reines Rauschen, 100 Durchgänge Signale mit Rauschen

• VP1 detektiert 90, VP2 60 Signale

• Hört VP1 besser?

• VP1 sagt in 40 Fällen, in denen kein Ton da war (Rauschdurchgänge, Catch-Trials)

„Ja“ es war ein Ton da VP2 irrt sich nur bei 10 Rauschdurchgängen

• Wer ist jetzt besser?

1.2 Terminologie

Terminologie

• „Rauschdurchgänge“ (noise trials): Nur Zufallsrauschen

– Versuchsdurchgänge (trials) ohne Signal

• Signaldurchgänge (signal trials)

– Versuchsdurchgänge mit Signal und Rauschen

• Antwort „ja“ auf Signaldurchgang = Treffer (hit)

trial type

Rauschen

Signal

Antwort

Nein

Ja

korrekte Ablehnung falscher Alarm

Auslassung (miss)

Treffer (hit)

1.3 Beispiel Goldstein

Zusammenfassung der VPn im Bsp. von Goldstein

• Je 100 Trials nur Rauschen 100 Trials mit Signal

• VP 1 tendiert zum „Ja“-Sagen

VP 1

N

S

VP 2

Nein

60

10

Ja

40

90

N

S

Nein

90

40

Ja

10

60

Änderung der Antworttendenz

• VP2 mit Geld/Abzug für richtige/falsche Antworten. Höhere Belohnung/Strafe bei

„Ja“ (hits/f.A) ⇒ liberalere Antworten

• Höhere Belohnung von korrekter Zurückweisung ⇒ konservative Antworten (wenig

„Ja“)

• Neutrale Antworten, wenn alles gleich belohnt.

N

S

N

S

N

S

Payoff-Matrix

Nein

Ja

+20e

-20e

-200e +200e

+200e

-20e

-20e

+20e

+20e

-20e

-20e

+20e

VP2-Antwort Gewinn

Nein

Ja

10

90

02

98 17600e

99

1

90

10 18180e

80

20

25

75

2200e

2

Falscher Alarm vs. Treffer

1

● ●

●

VP1 neut

PH

●

●

VP2 neut VP1 lib

●

VP2 kons

VP1 kons

0

0

PF

2. Beispiel: 1000 Hz-Ton

• Je 100 Trials nur Rauschen 100 Trials mit Signal

• 1. Durchgang: Treffer wichtig (Belohnung für hit)

3

1

• 2. Durchgang: kein falscher Alarm (Belohnung für correct rejection)

1. Durchgang

Nein

54

18

N

S

2. Durchgang

Ja

46

82

N

S

Nein

81

45

Ja

19

55

Rauschen Auch wenn in diesem Beispiel ein „echtes akustisches Rauschen“ verwendet

wird ist der Begriff Rauschen oder Noise in der SDT allgemeiner zu sehen. Er bezeichnet

alles was das eigentliche Signal verdeckt. Im Beispiel Wahrnehmung kann dies z. B.

auch das neuronale Rauschen und im Beispiel der Erdbebenvorhersage können es alle

Parameter, die die Genauigkeit der Vorhersage einschränken, sein.

Relative Häufigkeiten

• Überführung in rel. Häufigkeiten

• Trefferrate (hit rate): h =

Anz. Treffer

Anz. Signaldurchgänge

• falscher Alarm Rate (false-alarm rate): f =

N

S

Nein

54

18

Ja

46

82

und N

S

Nein

81

45

Ja

19

55

⇒

1. Durchg.

2. Durchg.

Anz. false alarm

Anz. Rauschdurchgänge

h

0.82

0.55

f

0.46

0.19

[.5cm] Redundante Werte:

• Auslassungsrate, Fehlerrate (miss rate)= 1 − h

• Rate der korr. Zurückweisungen (corr. rej. rate)= 1 − f

1.4 Einfaches Modell

Modell der Entscheidung

Signal

Noise

x

[0cm]

• Verteilung der Zufallsvariablen X

– bei Rauschdurchgängen (Xn )

– und Signaldurchgängen (Xs )

4

Setzen des Kriteriums

Nein

Ja

λ

Signal

Noise

• Zufallsvar. x > λ ⇒ Entscheidung „Ja“

• false-alarm rate:PF

• hit rate:PF

R

= P (Ja|noise) = P (X > λ|noise) = P (Xn > λ) = λ∞ fn (x)dx = 1 − Fn (λ)

R

= P (Ja|signal) = P (X > λ|signal) = P (Xs > λ) = λ∞ fs (x)dx = 1 − Fs (λ)

Variation von λ

λk

λl

λ

Signal

Noise

• Veränderung von λ wirkt auf h und f gemeinsam

– λk : (konservativ) Vermeidung von false alarm, aber wenig Treffer

– λl : Viele Treffer, aber auch viele false alarm

• Geringere Überlappung der Dichtefunktionen fn und fs ⇒ höhere Trennschärfe

Einheiten der x- und y-Achse Auf der y-Achse ist die Wahrscheinlichkeitsdichte aufgetragen. D. h. die Fläche unter jeder Kurve muss 1 sein, da die Wahrscheinlichkeit, dass

irgendein Wert auftritt sicher (=1) ist. Die Einheit der x-Achse lässt sich nicht so einfach

fassen. Im Falle von Tönen könnte hier die Lautheit stehen, was aber nicht allgemein

genug ist. Einige Autoren sagen hier, es ist die subjektive „Sicherheit“ – wie sicher ist

der Beobachter, dass ein Signal vorlag.

5

Modell der statistischen Entscheidung

• Modell zur Bestimmung interpretierbarer Variablen

• 3 Voraussetzungen

– Gesamte Information in einer Zahl repräsentiert

– Diese Zahl ist Zufallsvariable

– Überschreiten einer festen Schwelle ⇒ Entscheidung ja

• Analogie zur NHST (Nullhypothesensignifikanztest)

Information in einer Zahl repräsentiert Dieser theoretisch klingende Ausdruch meint,

dass alle vorhandene Information in einer Zahl zusammengefasst wird. Dies kennt man

z. B. aus Tests in Zeitschriften, bei denen verschieden Informationen (Preis, Bedienbarkeit, technische Eigenschaften, etc.) eines Produktes zu einer Gesamtnote zusammen

gefasst werden.

2 Univariates Gaußsches Modell

2.1 Allgemeines Modell

Das Gaußsche Modell

• Xn ∼ N (µn , σn ) und Xs ∼ N (µs , σs )

• Skalierung: µn = 0, σn = 1

• Xn ∼ N (0, 1) und Xs ∼ N (µs , σs )

• Rechtfertigung für Normalverteilungsannahme

– Gut untersuchte Eigenschaften

– Zentraler Grenzwertsatz

– Empirische Befunde

• Bei speziellen Fragestellungen andere Verteilung

Die Normalverteilung

2

x−µ

1

• Dichte an der Stelle x :φ(x) = σ√12π e− 2 ·( σ )

Rx

• Akkumulierte Dichte: Φ(x) = −∞ φ(t) dt

• mit µ Erwartungswert und σ Standardabweichung der Verteilung

• Im univariaten Modell µ = 0 ; σ = 1 ; φ(x) =

6

1 2

√1 e− 2 x

2π

2.2 Univariates Modell

Das univariate Gaußsche Modell

• Problem

– Ein Experiment → 2 Meßwerte (f, h)

– aber 3 unbekannte Variablen (λ, µs , σs )

• Setze σs = σn = 1, µs wird zu d0

• Xn ∼ N (0, 1) und Xs ∼ N (d0 , 1)

• Vorsicht: Echte Einschränkung, sollte überprüft werden.

2.3 Berechnung Kriterium und d0

Beispiel zur Berechnung von d0 und λ

Nein

54

2. Beispiel oben, 1. Durchg. N

S

18

Ja

46

82

f = 0.46

h = 0.82

1. PF = 0.46 = 1 − Fn (λ) = 1 − Φ(λ) ⇒ Φ(λ) = 1 − 0.46 = 0.54 ⇒ λ = Z(1 − 0.46) =

Z(0.54) = 0.10

2. Xs ∼ N (d0 , 1) ⇒ λ − d0 = Z(1 − 0.82) = Z(0.18) = −0.92

3. Kombination: d0 = λ − (λ − d0 ) = 0.10 + 0.92 = 1.02

7

Schätzer für d0 und λ

symm.

1. Z(1 − f ) = λ̂ ⇒ λ̂ = −Z(f )

2. Z(1 − h) = λ̂ − d̂0 ⇒ Z(h) = d̂0 − λ̂

3. d̂0 = Z(h) − Z(f )

! Vorsicht! Vorzeichen überprüfen!

Fortsetzung 2. Beispiel

• Beispiel oben, rel. H. 1. Durchg.

2. Durchg.

h

0.82

0.55

f

0.46

0.19

• 1. Durchgang: d̂0 = 1.02; λ̂ = 0.10

• 2. Durchgang: d̂0 = 1.00; λ̂ = 0.88

– λ̂ = −Z(f ) = −Z(0.19) = 0.88

– d̂0 = Z(h) − Z(f ) = Z(0.55) − Z(0.19) = 0.12 − (−0.88) = 1.00

⇒

1. Durchg.

2. Durchg.

d̂0

1.02

1.00

λ̂

0.10

0.88

Erhöhung der Entdeckbarkeit

8

• Weniger Überlappung der Verteilungen durch

– Erhöhung von d0

– Verringerung der Varianz σ 2

2.4 Bias und Likelihood

Messung des „Bias“ (Tendenz/Neigung)

• „Ja-Sage-Tendenz“ von Kriterium λ und d0 abhängig.

• zentriertes Kriterium: λcenter = λ − 12 d0 = − 21 [Z(f ) + Z(h)]

• Wahrscheinlichkeitsverhältnis (likelihood ratio): β =

=

0 2

1

φ(λ−d0 ) µ=0;σ=1 e− 2 (λ−d )

=

1

2

φ(λ)

e− 2 λ

1

0 2 +λ2 ]

= e− 2 [(λ−d )

0

fs (λ)

fn (λ)

1 0

= ed (λ− 2 d )

Bedeutung von λcenter : λ und λcenter liegen in der Graphik an der gleichen Stelle. Es

sind nur 2 unterschiedliche Zahlenwerte für das gleiche Kriterium. Während die Größe

von λ relativ zum Mittelpunkt der Rauschverteilung gemessen wird, ist der Bezugspunkt

(die „Null“) bei λcenter die Mitte zwischen den beiden Verteilungen. Der Vorteil von

λcenter liegt darin, dass in einem Zahlenwert der Bias der VP klar wird, während man

bei λ auch d0 kennen muss.

9

Verlauf von β

• Asymmetrisch von 0 . . . ∞

• 1 am Schnittpunkt von fs und fn

h

i

• log(β) = log ffns (λ)

(λ) = log(fs (λ)) − log(fn (λ))

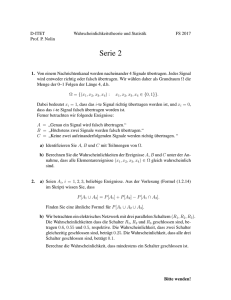

2.5 Idealer Beobachter

Der ideale Beobachter

• Maximierung der Wahrscheinlichkeit richtiger Antwort

• s Wahrscheinlichkeit für Signaltrial⇒ 1 − s = Wahrscheinlichk. für Noisetrial

• PC = P (signal)·P (Ja|signal)+P (noise)·P (Nein|noise) = s[1−Fs (λ)]+(1−s)Fn (λ)

1.0

0.8

Pc

0.6

0.4

0.2

λ*

0.0

−3

−1

1

Kriterium λ

10

3

5

Optimales Kriterium

• Optimales Krit. λ∗ für β ∗ =

• s=

1

2

fs (λ∗ )

fn (λ∗ )

=

1−s

s :

Wettchance (odds)

⇒ fs (λ∗ ) = fn (λ∗ ) Schnittpunkt der Kurven.

∗

∗

• Mehr Signaltrials: s > 12 ⇒ 1−s

s < 1 ⇒ fs (λ ) < fn (λ ) Das Kriterium verschiebt

sich nach links (wird liberaler)

Pay-off Matrix

• Kosten und Nutzen der Verschiedenen Möglichkeiten ungleich

⇒ Optimierung des Erwartungswertes des „Gesamtwerts“

E(V ) = P (Signal + Ja)V (hit) + P (Signal + Nein)V (miss)

+P (Noise + Ja)V (false alarm)

+P (Noise + Nein)V (cor. rej.)

V (miss) und V (f. a.) meist negativ

3 ROC

3.1 Graphische Darstellung

Graph zu 2. Bespiel

• 2. Bsp.: 1. Durchg.

2. Durchg.

h

0.82

0.55

f

0.46

0.19

d̂0

1.02

1.00

λ̂

0.10

0.88

λ1

λ2

d'

−4

−2

0

11

2

4

Umsetzung in ROC-Graph

• Trefferrate gegen Falschen Alarm auftragen

• Punkte auf einer Linie, weil d0 gleich groß

1

S1

S2

PH

●

●

0

0

3.2 Isosensitivitätskurven

1

PF

!

!

"

#

$

%

&

'

(

)

Eine Isosensitivitätskurve

*

+

,

c

-

.

0

1

2

3

4

5

6

7

8

9

:

;

<

=

>

?

@

A

B

C

B

@

D

E

C

F

G

H

I

J

K

L

I

G

K

G

M

N

G

I

H

I

O

P

Q

R

S

T

U

V

W

X

Y

Z

[

\

]

^

_

`

a

b

c

d

f

e

e

/

g

h

i

e

j

k

l

m

n

o

p

q

n

m

r

o

s

t

¡

u

¢

£

¤

v

¥

w

¦

w

§

¥

x

y

¨

z

£

{

©

|

ª

}

~

«

¬

¦

~

­

12

¥

®

¯

~

¬

«

¤

¬

¡

°

~

ª

§

±

²

¬

{

¦

­

±

³

¬

¦

­

£

©

ª

´

«

¤

£

ª

«

¤

¥

¦

µ

¬

¹

º

£

¿

»

º

Ç

º

Æ

»

Ã

¨

¼

À

½

¹

Ð

¥

¢

º

½

¹

«

¾

¹

Ì

º

£

»

¾

¿

É

¶

¹

·

Æ

¾

´

À

¼

¼

¤

Á

Á

É

¬

·

Â

Ã

¼

°

É

¹

Ã

¾

Î

¼

¥

¿

¤

Ã

¼

¼

¹

º

¦

£

Å

È

º

¸

Ä

Ç

Ã

§

»

»

Æ

È

Ã

¼

¾

º

Æ

¹

¹

Ã

º

Ì

¼

½

¹

È

Ç

Ç

É

Ê

º

Ç

º

È

¹

Ð

Ê

À

¹

Ä

¾

Ç

É

Å

Æ

¹

Æ

Ñ

Ê

À

¼

¹

»

º

Ï

¼

¼

È

Ç

Ã

Ã

¼

Á

¼

½

Â

¾

Ã

Ñ

Ñ

¿

Ã

¼

Ç

¼

º

Ð

Ì

Ë

½

Ã

¾

¼

È

¼

Ã

»

º

Ç

Á

Ã

»

¹

½

¾

È

Ì

Æ

¼

Ñ

¾

¼

¼

Ô

¾

Æ

¼

¼

Õ

Á

Í

Ö

¾

×

Ç

»

Ø

Î

Ù

Ö

¹

º

Ê

º

Ú

¹

Û

¾

¹

Î

Ö

À

Ê

¼

Ü

Ä

¼

Ý

Ò

Ï

Þ

ß

¹

Ì

¼

à

Â

Á

á

Ã

¾

º

¼

»

â

Ó

â

ã

È

à

Ä

ä

Ó

Isosensitivitätslinien bei versch. d0

S

T

U

V

W

!

"

#

$

%

&

'

(

)

(

Isokriteriumslinien (λ fest)

X

X

Y

Z

[

\

]

^

_

`

a

_

b

c

d

e

f

g

h

h

i

*

+

f

,

j

-

.

/

k

0

l

1

2

m

3

n

4

o

p

5

6

q

7

r

8

9

n

:

i

j

;

h

<

n

;

s

t

=

>

h

?

h

@

r

;

l

:

A

u

v

B

w

C

x

D

y

z

E

F

{

G

|

F

}

H

I

~

}

J

K

L

M

F

N

O

P

}

Q

R

1

−1.5

Ç

È

É

Ê

Ë

ü

ù

ý

þ

÷

!

"

G

H

Í

Î

ÿ

I

$

Ì

#

J

d

f

x

|

v

¹

»

¼

Ç

Ï

ÿ

Í

Ð

#

$

Ñ

%

Ì

&

Í

ÿ

&

.

ò

ö

õ

ò

ò

ó

ù

ø

$

Ð

#

ü

%

Ô

1

Õ

Þ

Ö

Ò

þ

Ó

ø

Ñ

Ó

ó

Ð

û

¤

×

â

÷

ß

õ

·

Ù

ô

Ð

Ó

þ

Ô

Õ

ô

º

Ô

ÿ

Ø

¿

Ð

Ð

Ö

ö

Û

Ø

ø

Ô

ô

Ü

Ö

·

Ö

¸

Å

Õ

ò

Ó

Ñ

ø

þ

ä

ü

ø

û

÷

#

û

$

"

ô

/

ü

ö

ò

%

ø

&

þ

õ

'

ô

(

û

ü

ò

ý

þ

&

ø

ö

"

û

÷

)

*

ç

è

(

õ

ô

ô

#

)

"

õ

ò

"

"

#

-

·

û

Ô

ø

ø

#

·

¹

É

Ò

Ø

û

î

÷

ø

õ

ô

ú

$

Ý

ä

ù

w

¹

ë

ô

Z

º

î

ø

b

È

ô

F

Õ

þ

d

¹

Ò

õ

E

·

ï

~

¹

&

ú

¸

Ø

ù

Z

·

î

ø

v

¶

÷

Æ

D

Ó

ò

,

u

ô

Ã

^

Á

ø

õ

í

Å

b

à

÷

_

¸

Ð

Ä

C

µ

ì

þ

`

¼

Ð

÷

@

´

æ

ø

B

Á

Ö

ö

¶

ä

ö

A

³

Ã

x

Á

Ý

ö

ÿ

+

ß

ë

·

Â

õ

Z

²

¼

ç

d

Á

ô

@

±

À

ó

?

x

Ñ

¿

ò

^

~

è

¾

\

»

ê

ò

÷

b

Þ

é

>

°

Ý

þ

ª

Ý

¹

Ø

÷

ô

Á

Û

þ

õ

Á

æ

1

ó

ó

Ð

å

õ

÷

¶

]

½

ñ

=

f

¥

¾

Û

ã

«

<

¼

ð

f

¢

Ç

Ö

d

»

ì

;

`

º

ï

<

]

¹

î

;

Z

£

¸

ì

º

Ø

ï

:

a

¯

µ

®

Ð

Ó

ö

­

¹

\

v

³

9

e

x

·

î

/

\

£

¹

Ó

Ð

ò

¬

½

2

¶

í

7

v

µ

ì

a

«

Ç

Ò

1

d

±

ë

^

t

Æ

´

ê

8

a

ª

²

7

~

³

é

c

¥

²

è

6

¤

±

ç

0

£

¸

Ú

_

©

¶

Ñ

Ô

÷

¨

æ

Z

x

¢

Å

−1

°

−0.5

b

å

2

_

â

2

`

º

Ô

Ñ

5

b

®

ä

0

§

¯

Ú

4

¦

®

Ã

ã

.

_

¥

­

â

~

¼

Ø

Ö

]

£

»

×

Ü

÷

}

¢

¹

Þ

/

a

¡

¶

Ô

Û

2

\

0.5

¹

~

1

Z

¬

Ú

2

]

«

PF

"

}

¸

Ó

ý

ò

Ä

a

ª

3

`

©

á

2

_

¨

à

1

v

§

ß

^

|

¦

Ý

0

¶

"

{

£

Ü

]

Õ

ò

\

¥

Þ

/

1.5

0

ô

[

¤

Ý

.

Ò

Ô

£

Ü

z

Ñ

!

y

Ã

Ü

ø

Ô

-

Ð

ü

+

Õ

ó

0

Û

Z

x

¼

û

ò

+

Ï

Ô

Ú

Y

Í

ô

"

×

ö

´

ú

ô

¹

,

w

¢

X

¾

¡

v

º

Ù

+

½

Ö

ô

*

u

»

Ð

õ

Ø

W

t

Â

Å

Ñ

ø

ô

ô

·

Ð

s

V

r

PH

U

q

¾

Ô

ø

)

×

ÿ

Á

Ö

(

¼

Æ

Õ

p

»

Î

õ

ñ

Ö

÷

ð

Í

á

ò

o

¹

Ì

Õ

Ô

T

À

¼

×

ò

¾

¶

Q

"

n

Ó

N

m

¹

ò

½

Ø

÷

õ

À

S

l

Q

k

Ò

'

R

¼

Å

á

ô

û

.

õ

ò

÷

·

Õ

Q

¿

Ë

O

j

¾

Õ

ô

ü

þ

Ð

ó

ò

ö

Ê

P

i

¼

Á

O

h

µ

Ö

M

g

µ

ò

N

¼

ñ

Ó

ö

ó

}

È

Ö

M

_

½

ð

ÿ

L

Ò

!

^

u

Õ

î

\

¾

×

K

c

½

-

Ì

!

e

Ô

(

"

0

1

"

#

"

#

"

'

&

(

&

$

$

&

'

*

&

%

&

/

&

+

(

&

#

+

(

%

"

$

,

#

(

.

&

"

)

2

1

*

&

,

"

#

%

(

#

(

"

#

(

0

"

$

,

.

"

&

-

"

"

&

#

+

"

#

"

&

-

!

"

"

(

&

13

(

&

!

"

#

)

G

"

O

#

P

&

3

4

G

5

O

6

Q

7

'

R

4

S

8

Q

9

H

7

L

:

(

;

I

<

T

4

=

P

"

!

>

I

T

9

U

"

6

L

4

"

?

H

T

(

@

P

A

8

/

H

J

<

S

B

.

F

C

O

*

@

T

&

<

V

6

Q

-

4

M

B

O

6

Q

"

4

F

8

J

C

H

4

S

4

%

F

<

H

B

.

6

L

O

#

:

"

D

T

$

9

W

6

X

4

8

Y

Z

9

[

7

\

?

D

]

"

<

^

@

_

E

F

$

`

G

"

H

a

/

I

b

F

c

+

d

G

e

H

f

J

"

g

K

e

H

f

&

F

h

G

/

i

I

2

a

L

M

c

e

N

j

j

a

y

k

{

x

l

h

w

y

e

w

|

|

x

k

m

h

~

|

b

i

}

~

n

w

z

a

}

~

e

{

|

o

y

x

|

w

m

n

z

w

e

|

b

y

z

z

p

e

{

f

~

|

w

a

z

j

m

{

i

c

~

{

o

z

y

w

x

x

z

j

i

d

|

~

j

a

d

|

w

z

g

x

e

|

{

e

|

f

i

w

q

}

x

¡

|

x

z

w

r

k

|

e

y

z

f

w

¢

~

a

m

s

z

£

x

{

e

¤

|

¥

|

i

¦

w

£

t

d

~

w

§

u

v

x

¨

w

©

ª

x

y

«

y

|

¬

«

z

y

{

­

{

®

|

}

~

x

­

¯

°

¬

x

±

|

w

z

©

²

|

­

³

x

²

w

¥

z

´

µ

3.3 Univar. Gaußsches Modell

ROC im univ. Gaußschen Modell

• Es gilt PF =

R∞

λ

fn (x)dx und PH =

R∞

λ

fs (x)dx

• im univariaten Fall also PF = 1−Φ(λ) = Φ(−λ) und PH = 1−Φ(λ−d0 ) = Φ(d0 −λ)

• Durch einsetzen gewinnt man die Kurve: PH = Φ(d0 + Φ−1 (PF ))

• Nur durch Tabellen oder Computerprogramme errechenbar

4 Ausblick

4.1 Weiterführende Themen

Weitere Themen

* ROC-Gerade mit Gaußschen Koordinaten

* Ungleiche Varianzen σn2 und σs2

• Verschiedene Alternativen zu d0

• Anwendung SDT auf

– Vertrauensskalen

– forced-choice Paradigma

– Diskrimination, bzw. Identifikation

• Likelihoods und Bayesscher Beobachter

*Vordiplomsrelevant

4.2 Literatur

Literatur

• Goldstein, E. B. (1997) Wahrnehmungspsychologie. Spektrum Akademischer Verlag, Heidelberg, erste Auflage.

• Macmillan, N. A. (2002) Signal detection theory. In: Pashler, H. (Hrsg.), Stevens’

Handbook of Experimental Psychology, Band 1, Kapitel 2, Seiten 43–91. Wiley,

New York, dritte Auflage.

• Wickens, T. D. (2002) Elementary Signal Detection Theory. Oxford University

Press, New York, New York.

14