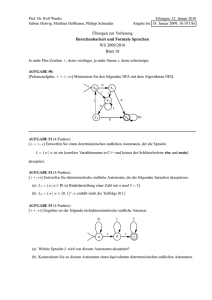

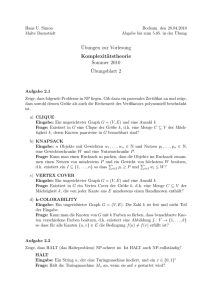

Skript zur Vorlesung Theoretische Informatik 2

Werbung