RN1 V55.fm - Informatik an der TU Clausthal

Werbung

Vorlesung Rechnernetze I

Prof. Dr. Harald Richter

Die Vervielfältigung oder Weitergabe des Skripts ist nur mit Genehmigung des Verfassers gestattet.

Alle Rechte liegen beim Verfasser.

1

1 Entwicklung der Kommunikationstechnik

Ursprünge:

Informationstyp:

Transportmedium:

Übertragungstechnik:

Fortschritt:

Protokoll:

Zukunft:

TV (Fernsehen)

Telex (Fernschreiber =

Vorläufer zu FAX)

Video

Funkwellen:

terrestrisch/

Satellit + Koaxkabel

Antennen:

Parabol,

Stab, ...

Analog-TV

-> Digital

TV

Zeichen/Daten

Koax- und

verdrilltes

Kupferkabel

LANs:

Ethernet,

TokenRing, ...

1G-> 40G

Ethernet

Sprache

Glasfaser

MANs:

FDDI,

DQDB,

...

Telefon

verdrilltes

Kupferkabel +

Glasfaser

WAN:

SONET/

SDH

S-ISDN

B-ISDN

DVB-T/DAB

IP

ATM-Protokoll

IBCN (Integrated Broadband Communication Network):

weltweites Mobil-/Festnetz + Internet + Multimedia + TV

2

2 Ziele von Rechnernetzen

Datenverbund

• = Zugriff auf entfernte Dateien über Middleware wie z.B. das Network File System (NFS)

Funktionsverbund

• = Zugriff auf besondere Rechner wie z.B. Web-Server, Video-Server, Datenbank-Server, ...

Lastverbund

• = Gleichmäßige Verteilung der Rechnerlast über Middleware wie z.B. beim Grid/Cloud

Computing

Verfügbarkeitsverbund

• = Fehlertoleranz

Speziell für das Internet gilt zusätzlich:

• Informationsverbund = riesiges Lexikon weltweit verteilter Informationen

• Kommunikationsverbund = soziale Medien (Facebook, Twitter,...)

• Infrastruktur für Handel und Dienstleistungen = eCommerce

3

Klassifikation von Netzen nach der Distanz

keine

Rechnernetze

GrößenordProzessororte

nungen der

Entfernungen

(ca.-Werte)

Bezeichnung

0,1 m-10 m

Multiprocessor, Multicomputer, Parallelrechner

Platine

Rechnersystem

10 m-10 km

Raum

Gebäude

Local Area Network (LAN), Beispiel

Ethernet

Campus, Fabrik

Rechnernetze

10 km-100km Stadt, Region

Metropolitan Area Network (MAN), Beispiel FDDI

100 km100000 km

Wide Area Network (WAN), Beispiel

Internet

Land

Kontinent

Planet

Man unterscheidet zwischen lokalen Netzen (LAN = Local Area Network), Stadtnetzen

(Metropolitan Area Network) und Weitverkehrsnetzen (WAN = Wide Area Network)

4

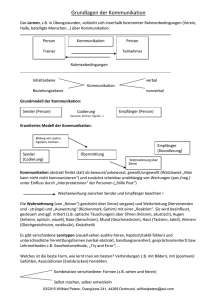

3 Standardmodell der Kommunikation:

Das ISO-7-Schichtenmodell für Offene Systeme

Wurde Anfang 1970er Jahre von der OSI entworfen. OSI = OPEN SYSTEMS INTERCONNECTION = Untergruppe der ISO

Einführung von neuen Grundbegriffen (= Terminologie)

Einführung eines verbindlichen Modells für geschichtete Kommunikation

Das ISO-7-Schichten-Modell schlägt sieben Schichten und deren Funktionalität vor.

Jede Schicht hat bei der Datenübertragung einen eigenen Satz von Aufgaben zu übernehmen.

Datenaustausch ist nur zwischen benachbarten Schichten möglich, nicht kreuz und

quer

Im Internet wurden vom ISO-7-Schichten-Modell nur Schicht 1-4 und Schicht 7 implementiert

5

3.1

Blockschaltbild der Kommunikation im ISO-7-Schichtenmodell

Rechnersystem i

Anwendungs

Prozess X1

===

Rechnersystem j

Anwendungs

Prozess Xn

Anwendungs

Prozess Y

Bsp.: BSDSocket Schnittstelle

Bsp.: WinSocket Schnittstelle

Kommunikationssystem nach

OSI-Standard

Kommunikationssystem nach

OSI-Standard

physikalisches

Medium

Verbundene Systeme

6

3.2

Grober Aufbau des ISO-7-Schichtenmodells

Schicht 1 - 4

• Bit-und Nachrichtentransfer durch Datenrahmen (frames) bzw. Pakete (packets); keine höheren Funktionen

• Inhalt der Daten ist ohne Bedeutung für die transportorientierten Schichten. Kein Bezug auf die Kooperationsbeziehung der Teilnehmer.

Schicht 5 - 7

Transportorientierte Schichten = Schichten 1-4: Technische Erbringung von Übertragungen durch:

Anwendungsorientierte Schichten = Schichten 5-7: Anwendungsbezogene Kommunikationsdienstleistungen

Kooperation der Teilnehmer wird berücksichtigt durch:

•

•

•

•

•

Steuerung des Ablaufs (Sitzungssteuerung)

Informationsdarstellung (verschiedene Zeichensätze und Datenformate)

Kompensation von Fehlverhalten (Neustart eines Downloads bei Fehler)

Datenverschlüsselung (Kryptographie)

Datenkompression (JPEG, MPEG, MP3)

7

3.3

Feiner Aufbau des ISO-7-Schichtenmodells

ist anders aufgebaut

als System A

heterogenes Rechnernetz

Endsystem A

beliebige räumliche Entfernung

Teil des Betriebssystems in

Form von Bibliotheken

Teil der Rechner-Hardware

3.4

Endsystem B

Anwendungsschicht

Anwendungsspezifische Programme

7

Darstellungsschicht

Datenformatierung und -darstellung

6

Sitzungsschicht

Dialogsteuerung

5

Transportschicht

Ende-zu-Ende-Datenaustausch

4

Vermittlungsschicht

Ende-zu-Ende-Vermittlung

3

Sicherungsschicht

Nur zwischen benachbarten Rechnern

2

Physikalische Schicht

Physikalische Übertragung

1

Aufgaben der Schichten des ISO-Modells

1.) Die Bitübertragungsschicht ermöglicht die transparente Übertragung eines Stroms

8

binärer Informationen über ein Kabel aus Kupfer oder Glasfaser oder über Funk (=

ungesicherter Bitstrom + mech. u. el. Spezifikation der Strecke)

2.) Die Sicherungsschicht regelt den Zugang zur Schicht 1, entdeckt Übertragungsfehler

und bremst zu schnelle Sender (= gesicherte Bits + Zugang + Flusssteuerung) jeweils

zwischen benachbarten Rechner

3.) Die Vermittlungsschicht wählt eine Netz-Route von Rechner zu Rechner über Zwischenknoten aus (= Wegewahl)

4.) Die Transportschicht übermittelt die Daten von Sendeprozess zu Empfangsprozess,

d.h. von Ende-zu-Ende. Sie entlastet den Benutzer von den Details der Datenübertragung, z.B. durch Sicherstellung der Paketreihenfolge.

5.) Die Kommunikationssteuerungsschicht vereinfacht die Zusammenarbeit zwischen

den kommunizierenden Anwendungsprozessen z.B. durch Wiederanlauf (Neustart,

recovery); legt full-/halfduplex Übertragungsmodus fest.

6.) Die Darstellungsschicht transformiert u.a. die Daten in eine Form, die von beiden

Anwendungsprozessen verstanden wird und komprimiert und verschlüsselt optional

(= Datenformate + Kompression + Verschlüsselung)

7.) Die Anwendungsschicht enthält Benutzeranwendungen. Sie ist sehr groß (Bsp.: >106

apps)

9

3.5

Terminologie und grundlegende Prinzipien im ISO-Modell

Offenes System für die Kommunikationsteilnehmer

• jedes Rechnersystem aus Hardware, Software und Peripherie, das sich an die OSI-Standards hält, kann kommunizieren.

N-Schicht (1N 7):

• wird aus sämtlichen Programmen der Schicht N in allen offenen Systemen gebildet.

Analogie: dieselben Stockwerke Nr. N aller Gebäude der Welt bilden die N-Schicht.

N-Instanz (N-Entity):

• Ganz bestimmte Implementierung einer Funktion der Schicht N auf einem System

• Es kann auf demselben Rechner mehrere N-Instanzen geben, die unterschiedliche Protokolle implementieren; Bsp. TCP u. UDP

Partnerinstanzen (Peer-Entities):

• Instanzen derselben Schicht auf verschiedenen Rechnern. Peer-Entities erfüllen die Funktionen einer Schicht durch Datenaustausch von peer zu peer

Hinweis: peer = Gleichgestellter, d. h. einer, der der gleichen (Adels)schicht angehört

3.6

Was macht eine Schicht im ISO-Modell?

Hauptaufgabe jeder Schicht ist es, der darüber liegenden Schicht Dienste (= Funktionen) anzubieten. Diese Dienste setzen sich zusammen aus:

• Dienstleistungen, die innerhalb dieser Schicht erbracht werden und

10

• der Summe der Dienstleistungen aller darunter liegenden Schichten

Schichten sind über Dienste miteinander verknüpft. Sie bilden die Schnittstelle zwischen den Schichten. In der Software-Entwicklung heißt diese Schnittstelle application

programming interface, API

Dienste bestehen wiederum aus Dienstelementen (= Unterprogrammaufrufen)

Da Schichten jeweils aufeinander aufbauen, ergibt sich eine Hierarchie von Diensten,

deren Umfang mit der Schichthöhe zunimmt

11

3.7

Hierarchie von Diensten im ISO-Modell

Benutzer A

Benutzer B

Anwendungsdienste

Darstellungsdienste

Kommunikationssteuerung

Transportdienste

Wegewahldienst

Gesicherte Bit-Ströme

Kabel, Stecker, Spannungspegel

Übertragungsleitung

Jede Schicht benutzt die Funktionen (= Dienste) der darunter liegenden Schicht

Daten werden physikalisch nur auf der untersten Ebene zwischen den Rechnern übertragen, d. h. der Übertragungsstrecke

Auf allen n-Schichten mit n>1 werden Daten nur innerhalb desselben Rechners „hin

und her geschoben“ (im Form von Aufrufparameter und Resultatwerten)

12

3.8

Indirekte Kommunikation im ISO-Modell (Partnerprotokolle)

Partnerprotokoll

= peer protocol

indirekte (virtuelle)

Kommunikation

Application

direkte

Kommunikation

Presentation

Session

Transport

Network

Data Link

Physical

Physikalisches Übertragungsmedium

• Daten werden innerhalb eines Rechners von Schicht zu Schicht transportiert

• Zwischen 2 Rechnern können Daten nur auf der Schicht 1 transportiert werden

• Kommunikation zwischen Instanzen höher als Schicht 1 werden indirekt (virtuell) abgewikkelt

13

• Indirekte Kommunikation wird mittels eines Protokolls zwischen Partnerinstanzen so

durchgeführt, dass beide Partnerinstanzen „sich verstehen“ (Protokoll = gemeinsame

„Sprache“)

3.8.1

Direkte und indirekte Kommunikation

Dienstelement

obere Schnittstelle

N-Schicht

untere Schnittstelle

c

c

d

Instanz

a

Protokoll

= indirekt

c

c

Instanz

a

a = gleichgestellte N-Instanzen

(Peer Entities)

b = Dienst besteht aus einer

Menge von Dienstelementen

c = Dienstelement

(Service Primitives)

d = Protokoll zwischen Gleichgestellten (Peer Protocol)

} b Dienst

c

c

Rechner A

= direkt

= direkt

c

c

Rechner B

Direkter Datenaustausch erfolgt mit Hilfe von Dienstelementen (= Unterprogrammaufrufen) eines Dienstes (= einer API) zwischen benachbarten Schichten desselben Rechners

14

Indirekter Datenaustausch erfolgt mit Hilfe eines Protokolls zwischen Partnerinstanzen

auf verschiedenen Rechnern

Eine direkte Kommunikation der Schicht N (1<N<7) erfolgt nur mit den Schichten (N+1)

und (N-1)

Indirekte Kommunikation (Protokoll) mit Partnerinstanzen (Peer Entities)

3.8.1.1

Schicht

7

Implementierung der direkten und indirekten Kommunikation im Internet

Quelle

Layer 7-Protokoll

M

M

Ziel

Anwendung

Layer 4-Protokoll

H4

H4 M

4

Segmentierung

H3 H4 M1

3

2

Fragmentierung

Layer 3 Protokoll

H3 H4 M2

Reassemblierung

H3 H4 M2

...

...

Layer 2-Protokoll

H2 H3 H4 M1 T2 H‘2 H‘3 H‘4 M‘2 T‘2

M

H3 H4 M1

Network

Reassemblierung

H2 H3 H4 M1 T2 H‘2 H‘3 H‘4 M‘1 T‘2

1

Transport

Data Link

Physical

physikalische Verbindung

Hinweis: M = Message (Nachricht), H = Header (Vorspann = Nachrichtenkopf), T = Trailer (Nachspann)

15

Nachricht M wird von „oben nach unten“ und dann von „unten nach oben“ durchgereicht = direkte Kommunikation

Beim Durchreichen nach unten wird M in zwei Schritten zerkleinert: zuerst „segmentiert“ dann „fragmentiert“

M wird bei jedem Übergang zwischen 2 Schichten um jeweils einen neuen Vorspann

(Header) und ggf. auch um einen Nachspann (Trailer) verlängert

Am Ziel werden Trailer und Header schrittweise wieder entfernt und die Nachricht zusammengebaut (= Reassemblierung in 2 Schritten)

Die Header sind notwendig, um zum Ziel zu finden

Die Trailer sind notwendig, um eine sog. Prüfsumme (CRC) zu speichern

Zwischen Schicht 4 und Schicht 3 findet eine „Segmentierung“ zur Zerkleinerung der

Pakete statt

Zwischen Schicht 3 und Schicht 2 findet eine „Fragmentierung“ zur Zerkleinerung der

Pakete statt

Hinweis: Protokoll = Menge der Regeln für den indirekten Datenaustausch zwischen Entities derselben

Schicht (peer-to-peer communication

16

3.8.2

Definition Dienst, Dienstzugangspunkt, Dienstelemente )

Rechner A

Anwendungsprozess A

Protocol Stack

Dienstelement

Rechner B

Datenaustausch

Anwendungsprozess B

Dienst

Dienstzugangspunkt

entity A

entity B

Peer Entity

der Schicht

(N)

physikalisches Medium

Die Schichten werden in ihrer Implementierung auch als Protocol Stack bezeichnet

Def.: N-Schnittstelle: Menge von Dienstelementen (Unterprogrammaufrufen) der Schicht

N. Dienstzugangspunkt: Name des Unterprogrammaufrufs mit Art und Typ der Übergabe- und Resultatparameter (= Signatur der Prozedur).

17

3.9

Die 4 Arten von ISO-Dienstelementen

Rechner A

Rechner B

Prozess a

1.

Request

Prozess b

4.

Confirmation

3.

Response

2.

Indication

Datenübertragung

Es gibt für jeden Dienst einer Schicht i (1<i<7) 4 Dienstelemente, die gemeinsam den

Dienst in Form eines 4-Phasen Handshakes bilden:

1.) Anforderung (Request) = Aktivieren eines Dienstes der Schicht durch den Dienstnehmer

2.) Anzeige (Indication) = Dem Diensterbringer anzeigen, dass vom Dienstnehmer ein

Dienst angefordert wurde

3.) Antwort (Response) = Quittieren einer vorherigen Anzeige oder Erbringung des angeforderten Dienstes durch den Diensterbringer

18

4.) Bestätigung (Confirmation) = Quittieren einer vorherigen Anforderung beim Dienstnehmer

3.10

Die 3 Phasen der ISO-Kommunikation

Darüberhinaus heißt jede Kommunikation, die in folgenden 3 Phasen abläuft, verbindungsorientierte Kommunikation:

• Verbindungsaufbau (Connect), Datentransfer (Data Transfer) und Verbindungsabbau (Disconnect)

Für jede der 3 Phasen gibt es einen Dienst, der diese Phase implementiert

Eine verbindungsorientierte Kommunikation steht im Gegensatz zur sog. verbindungslosen Kommunikation, bei der sofort gesendet werden kann (kein Verbindungsaufbauund -abbau)

Request, Indication, Response und Confirmation sind die 4 Typen von Dienstelementen, die es bei jedem verbindungsorientierten Protokoll im Prinzip jedenfalls in jeder

Schicht i (1 < i < 7) gibt

Die Zahl der Kombination aus Dienste, Dienstelemente und Phasen einer Schicht berechnet sich zu: dN Dienste der Schicht N * 4 Dienstelemente pro Dienst * 3 Phasen =

dN*12 Kombination (im Prinzip)

19

3.10.1

Beispiel: Presentation.Connect = Verbindungsaufbaudienst der Schicht 6

Rechner B

Rechner A

Schicht 6

ConnectDienst der

Schicht 6

5 darunterliegende

Schichten

Presentation Layer B

Presentation Layer A

1.) Presentation. Connect.

Request-Dienstelement

4.) Presentation. Connect.

ConfirmationDienstelement

3.) Presentation. Connect.

ResponseDienstelement

2.) Presentation.

Connect. Indication-Dienstelement

Protocol Stack

Protocol Stack

20

3.11

Zusammenfassung ISO-7-Schichten-Modell

1.) Die ISO-Bitübertragungsschicht ermöglicht die Übertragung von Informationen über

ein Kabel aus Kupfer oder Glasfaser oder per Funk = ungesicherter Bitstrom +

mechanische + elektrische + funktionale + prozedurale Spezifikation der Strecke

2.) Die ISO-Sicherungsschicht regelt den Zugang zum Übertragungsmedium, entdeckt

Übertragungsfehler jeweils zwischen benachbarten Rechnern, macht ggf. eine Rahmenwiederholung und bremst zu schnelle Sender durch Flusssteuerung =Zugang +

gesicherte Bits + Flusssteuerung

3.) Die ISO-Vermittlungsschicht macht einen Verbindungsaufbau und -abbau, wählt

einen Weg vom Quellrechner zum Zielrechner durch das Netz. Im Allgemeinfall verläuft dieser über mehrere Zwischenknoten. Sie zerkleinert zu große Schicht 3-Pakete

in kleinere Schicht 3-Pakete (=“Fragmente“), die anschließend von Schicht 2 übertragen werden können, und setzt diese beim Empfänger wieder in der richtigen Reihenfolge zu einem Paket zusammen = Fragmentierung und Reassemblierung. Sie

erkennt, welches Schicht 3-Fragment zu welchem Schicht 3-Paket gehört.

4.) Die ISO-Transportschicht macht ebenfalls einen Verbindungsaufbau und -abbau,

übermittelt die Daten gesichert von Sendeprozess zu Empfangsprozess, d.h. von

Ende-zu-Ende. Sie stellt die Paketreihenfolge sicher, löscht Duplikate und macht im

Fehlerfall eine Ende-zu-Ende Paketwiederholung. Sie erlaubt eine Pufferverwaltung

21

bei Sender und Empfänger und stellt Prioritäten bei der Übertragung zur Verfügung.

Sie sorgt schließlich dafür, dass das Netz nicht überlastet wird = idealer Kanal

5.) Die ISO-Kommunikationssteuerungsschicht vereinfacht die Zusammenarbeit zwischen den kommunizierenden Anwendungsprozessen z.B. durch Rücksetzen und

Wiederanlauf einer unterbrochenen Verbindung (recovery). Sie legt full-/halfduplex

fest und erlaubt das Multiplexen mehrerer logischer Kanäle auf einen physikalischen

Kanal = Dialogsteuerung, Recovery, Multiplexen

6.) Die ISO-Darstellungsschicht transformiert die Daten in eine Form, die von beiden

Anwendungsprozessen verstanden wird und komprimiert und verschlüsselt optional

(= Datenformate + Kompression + Verschlüsselung).

7.) Die Anwendungsschicht enthält Middleware und Benutzeranwendungen = Millionen

von Diensten, Anwendungen und Apps

Das Internet implementiert den größten Teil der ersten vier Schichten des ISO-Modells

22

Anwendung

Dateitransfer (ftp, Port 20, 21), Telnet (Port 23), E-Mail (smtp, Port 25),

DNS (Port 53), NFS, www (http, Port 80), ...

Transport

Transmission Control Protocol TCP, User Datagram Protocol UDP

Vermittlung

Sicherung 2b (Logical Link

Control

Sicherung 2a (Medienzugangssteuerung)

Bitübertragung

Internet Protokolle IPv4, IPv6

Internet Control Message Protocol ICMP

speziell für

SONET

/SDH

SONET

/SDH

speziell

für E1/

T1

speziell für

FDDI

speziell für

DQDB

ISO

Logical

Link

Control

(theoretisch)

Speziell

für

WLAN

Point

to

Point

Protocol

(PPP)

E1/T1

FDDI

DQDB

Ethernet

WLAN

DSL

4 Bitübertragungsschicht (ISO-Schicht 1)

ISO-Definition: „Die Bitübertragungsschicht definiert die mechanischen, elektrischen,

funktionalen und prozeduralen Eigenschaften, um physikalische Verbindungen zwischen Datenendeinrichtungen und Datenübertragungseinrichtungen aufzubauen, aufrecht zu erhalten und abzubauen.“

23

Die Bitübertragungsschicht sorgt für die Übertragung eines transparenten Bitstroms

zwischen Sicherungsschicht-Instanzen über physikalische Verbindungen

Eine physikalische Verbindung realisiert die Übertragung eines Bitstroms im Vollduplex- oder im Halbduplex-Modus

Vollduplex = gleichzeitiger bidirektionaler Datenaustausch

Halbduplex (=Simplex) = zu einer Zeit nur in einer Richtung, dann wird die Richtung gewechselt u.s.w. (= unidirektionaler Datenaustausch mit wechselnden Kommunikationsrichtungen)

4.1

Es werden in der Bitübertragungsschicht mechanische, elektrische, funktionale und

prozedurale Schnittstellen und Regeln definiert, die von Sender und Empfänger eingehalten werden müssen, damit Daten ausgetauscht werden können

4.1.1

Mechanische Schnittstellen

Hier geht es im die Abmessungen der Stecker, die Anordnung der Pins im Stecker etc.

4.1.2

Spezifikationen in der Bitübertragungsschicht

Elektrische Schnittstellen auf den Leitungen

Hier werden die Signalpegel (Spannungs- oder Stromwerte) für High- und Low-Bits, sowie die Art der Erdung und Schirmung der Kabel festgelegt

24

4.1.3

Funktionale Schnittstellen

Hier wird festgelegt, welcher Pin welche grundsätzliche Funktion hat und wie deren

Zeitverhalten, das sog. Timing ist

Hier wird auch die Bitrate der Bitübertragung und die Art der verwendeten Codierung

festgelegt

Beispiel: V.24/RS-232 mit den Datenleitungen TX, RX und den optionalen Steuerleitungen Request to Send, Clear to Send, Data Set Ready und Data Terminal Ready, sowie

GND

4.1.4

Prozedurale Regeln

Hier wird festgelegt, wie die Pins des Steckers im Kontext zu den anderen Pins sich verhalten müssen, d.h., hier geht es um das logische Zusammenspiel der einzelnen

Schnittstellenleitungen

Wichtig für die Benutzung der Schnittstellenleitungen

Beispiel: bei V.24/RS-232 darf das Clear to Send-Signal des Modems erst dann aktiv

werden (High), wenn zuvor Data Set Ready des Modems und wenn Request to Send des

Computers aktiv wurde, der an das Modem angeschlossen ist

25

4.1.5

Beispiele für mechanische Spezifikationen: USB

USB 3.0-Stecker, Standard Typ A (10 Pins)

USB 3.0-Stecker, Micro Typ B (10 Pins)

USB 3.1-Stecker, Typ C (24 Pins)

Beispiel für eine elektrische Spezifikation: V.24 EIA RS-232

Driver

Sender

Interconnecting Cable Terminator

Empfänger

Kabel

12 V

D

Interface

4.1.6

Signal Ground

26

T

In der kleinsten V24/RS-232-Version sind nur 2 verdrillte Kabeladern + Masse (GND) nötig

Keine Abschirmung der Adern, nur Verdrillung (= Telefonkabel) => sehr preisgünstig

4.2

Asynchron heißt: kein Taktsignal zwischen Sender und Empfänger, Bsp.: V.24/RS-232

Synchron heißt: Taktinformation wird zeitgleich mit den Nutzbits übertragen, Bsp. USB

Für synchrone Übertragung wird eine Codierung, verwendet die auf der Datenleitung

den Takt mitüberträgt (preisgünstig, da keine separate Taktleitung nötig)

Da der Empfänger den Sendetakt erhält, wird dieser zur Abtastung der Bitsignale benutzt = Synchronisation der Bitsignale mit dem Taktsignal => stabile Erkennung der

Bits selbst bei hohen Datenraten

4.2.1

Asynchrone und synchrone Übertragung

Asynchrone Übertragung

Sender und Empfänger haben voneinander unabhängige, i.e. lokale Taktgeber

Beispiel: V.24/RS-232

„Freie Leitung“ (= Leitung ohne Daten) entspricht einem kontinuierlich gesendeten

High-Bit Problem der Unterscheidung zwischen freier Leitung und High-Pegel.

Das Start-Bit setzt die Leitung auf Low und startet so den Taktgeber beim Empfänger

Ein Übertragungsrahmen enthält 5 bis 8 Nutzbits (= 1 Zeichen)

27

Das Stop-Bit setzt die Leitung wieder auf High. Dieses Signal muss 1, 1.5 oder 2 BitIntervalle andauern; entspricht 1, 1.5 oder 2 Stop-Bits

Ein Paritätsbit dient zur Überprüfung der Nutzbits beim Empfänger

4.2.1.1

Vorteile der asynchronen Übertragung

Es wird keine Synchronisierung des Empfänger-Taktgebers mit dem Sender-Taktsignal benötigt, da kein Takt übertragen wird

Hardware-mäßig leicht zu implementieren

4.2.1.2

Nachteile der asynchronen Übertragung

Die Taktgeber weichen im Laufe der Zeit voneinander ab, da sich kleine Zeitunterschied

akkumulieren

Erhebliche Einschränkungen bzgl. Datenraten und Rahmenlängen

Beispiel: V.24/RS-232

Die „Nutzlast“ des Rahmens ist sehr kurz (nur 1 Zeichen; entspricht 5-8 Bits)

Es sind nur niedrige Datenraten und kurze Längen möglich

Die Start- und Stop-Bits bedeuten einen Mehraufwand, und die Effizienz sinkt

28

Beispiel: 1 Start-Bit + 7-Bit ASCII-Zeichen + 1 Paritätsbit + 1 Stop-Bit => d.h., insgesamt

10 Bit pro Rahmen für 7 Nutzbits => 30% Overhead. Nur 70% der Leitungsbandbreite stehen für Benutzerdaten zur Verfügung.

Bitrate begrenzt auf 100 kbit/s bei einer Entfernung von 15 m

Aufgrund der geringen Komplexität, des geringen Preises und der kleinen Polzahl immer im Vergleich zu USB noch in Verwendung

4.2.1.3

Timing-Diagramm einer asynchronen Übertragung (V24/RS-232)

In den beiden nachfolgenden Timing-Diagrammen wird der Signalverlauf über der Zeit

bei der Übertragung eines Zeichens und bei einer Zeichenfolge gezeigt

29

4.2.1.4

Leitungscode für ein Zeichen

Signalhöhe

Stopbit (Pegel wie im Ruhezustand)

Lange Eins = Ruhezustand

5 bis 8 Datenbits

Signalwert = 1

Signalwert = 0

Zeit

Startbit

1

Paritybit

(Odd, Even)

1,5

2

4.2.1.5

Leitungscode für eine Zeichenfolge

Beliebig lange Ruhepause zwischen Rahmen

Ruhezustand

Startbit

Stop

bit

Start

bit

Stop

bit

))

))

))

1 1 1 1 0 0 0 1

Stop

bit

Start

bit

0 0 1 0 1 1 0 0

= 1. Zeichen+ odd Parity

= 2. Zeichen+odd Parity

30

1 00

1

0 1

0

= 3. Zeichen+odd Parity

4.2.1.6

Effekt der auseinander laufenden Uhren bei asynchroner Übertragung

Senderate f1

Abtastrate f2 > f1

start

1

2

3

4

5

6

7

8 stop

Fehlabtastung!

4.2.2

Synchrone Übertragung

Sende- und Empfangstakt laufen beliebig lange im Gleichtakt, d.h. synchron

=> Eine Neusynchronisation der Takte über ein Startbit vor jedem Zeichen ist nicht erforderlich

Taktsignal wird entweder auf einer separaten Leitung übertragen (= zu teuer) oder aus

dem Code des Datensignals regeneriert (= Regelfall)

Taktregenerierung aus dem Datensignal erfordert eine spezielle Codierung der Daten

z. B. mittels Manchester-Code, um Daten und Takt gemeinsam auf derselben Leitung

übermitteln zu können

31

4.2.2.1

Timing-Diagramm einer synchronen Übertragung

Bit = Bit = Bit = Bit =

Zelle Zelle Zelle Zelle

1

0

1

1

0

0

1

0

0

1

0

0

Daten

Clock

(Takt)

Abtastzeitpunkte liegen stets in der Mitte der Bitzelle

Im Beispiel erfolgt das Auslesen der Datenbits bei abfallender Flanke des Taktsignals

4.2.2.2

Beispiel für synchrone Übertragung: der Universal Serial Bus (USB)

Dient zur Anbindung von Peripherie an Rechner, Tablets und Smartphones über Kupferkabel

Die neueste Version USB 3.1 mit Typ C Stecker/Buchse überträgt Daten mit 10 Gb/s

Erlaubt zusätzlich 100 W Leistung bei +5 V zu übertragen, um die Peripherie zu versorgen

32

4.2.3

USB bietet deutlich mehr Funktionen als RS232:

• Datensignale können über USB-Hubs auf der ISO-Schicht 1 an mehrere periphere Geräte sternförmig verteilt werden

• Es sind auch Hub-Kaskaden möglich, die eine baumförmige Verteilung erlauben

• USB-Geräte werden in „Klassen“ unterteilt

· Klassen unterscheiden sich u.a. bzgl. der Datenmenge pro Rahmen und den zeitlichen Abstände zwischen den Rahmen

· Die jeweilige Geräteklasse wird automatisch erkannt, was ein komplexes Protokoll

beim Einstecken eines neuen USB-Geräts erfordert

· Für jede Geräteklasse ist ein anderer USB-Gerätetreiber erforderlich

• Daten werden in Form von „Transaktionen“ übertragen

4.2.3.1

Vergleich synchrone/asynchrone Übertragung am Beispiel USB

Nachteile von USB-Geräten

Es gibt eine Vielzahl von USB-Versionen, -Kabeln, -Steckern und -Buchsen

• Der Host hat stets einen andere Buchse und damit auch einen anderen Stecker als die Peripherie

• Die einzelnen Versionen sind nur manchmal abwärts-kompatibel zueinander

Entfernung ist bei USB 3.1 mit Typ C-Stecker auf ca. 2 m Länge beschränkt => kein LAN

sondern Bus

33

USB 3.1 mit Typ C-Stecker benötigt 24-polige Kabel und Stecker/Buchsen

USB ist insgesamt komplex und damit rel. teuer

USB ist ein Sicherheitsrisiko:

• Es gibt die Möglichkeit des „Device Firmware Upgrades“, bei dem harmlose USB-Geräte

durch Hacker umprogrammiert werden können

• Es gibt in den USB-Gerätetreibern gängiger Betriebssysteme keine Firewall

4.3

Physikalische Medien zur Datenübertragung

1.) Verdrilltes Adernpaar („twisted pair“) zur Verminderung von Übersprechen auf parallel geführte, sonstige Kabel, sowie zur Elimination von Einstreuungen von diesen

Kabeln

• Dies ist die klassische Telefonverkabelung. Sie wird auch für DSL-Übertragung zur Ortsvermittlungsstelle eingesetzt

• Braucht wenig Platz, hat enge Biegeradien, ist sehr preiswert

• Datenrate bis ca. 50 Mbit/s bei VDSL

2.) Abgeschirmtes und verdrilltes Adernpaar, „shielded twisted pair“, STP

• Unempfindlich gegen Störstrahlung von außen

• Sendet auch keine Störstrahlung nach außen

• Der Schirm erlaubt einen definierten Wellenwiderstand zwischen Signalleitungen und Masse => Datenraten bis ca. 3 Gbit/s sind damit auf einer einzigen Doppelader von ca. 5 m Länge möglich

34

• Ist teurer als twisted pair

3.) Koaxialkabel: Noch störsicherer, ermöglicht noch höhere Datenraten bis ca. 100 Gbit/s

über viele Kilometer, noch teurer, in Kupferkabel-basierten Weitverkehrsnetzen verbreitet

4.) Lichtwellenleiter (Glasfaser): sehr hohe Übertragungsraten bis ca. 1 Tbit/s, geringe

Dämpfung und völlig ohne Störungsein- und -auskopplungen, aufwendige Steckverbinder, am teuersten. Die Basis aller Weitverkehrsnetze ab ca. 1985.

35

4.3.1

Aufbau eines STP-Kabels, Beispiel USB 3.0

4.3.2

Aufbau eines Koaxialkabels

50 Ohm-Koaxialkabel heißt: Wellenwiderstand zwischen Innenleiter und Schirm ist 50

Ohm

Sender u. Empfänger müssen die gleiche Impedanz wie das Kabel haben, damit es zu

keinen Reflektionen kommt und damit die LAN-Transceiver die hohe Spannung eines

Wellenbergs erhalten

36

Kupferkern (Innenleiter)

mit Leitfähigkeit >> 1

Isolierschicht (Dielektrikum) mit relativer Dielektrizitätskonstante r > 1

4.3.3

geflochtener, elektrisch leitender

Außenleiter mit Leitfähigkeit >> 1

Plastikschutzschicht

Glasfaserkabel

Theoretisches Limit: ca. 300 TeraBit/s = ungefähr die Frequenz des Lichts

Als Transmitter und Receiver werden Halbleiterbauelemente verwendet:

• Laserdiode oder Leuchtdiode als Sender, Photodiode als Empfänger

Beschränkende Faktoren für die Datenrate: Absorption und Dispersion in der Faser

37

4.3.3.1

Absorption in der Faser

Eingangssignal

4.3.3.2

Ausgangssignal

Dispersion in der Faser

Eingangssignal

Ausgangssignal

Zeit

Zeit

Die optische Kopplung zwischen zwei Fasern ist mechanisch aufwendig, da der Kern

der Faser, der das Licht leitet, nur ca. 1 m - 50 m dünn ist (Präzisionsstecker!)

4.3.4

Technologien bei Glasfasern

Es gibt Stufenindex-, Gradientenindex- und Monomode-Fasern

38

4.3.4.1

Stufenindex-Faser

Radius r

Kern

Brechungsindex n

Zeit

Mantel

Output

Signal ist

schwach und

breit

Zeit

Totalreflektionen

Der Brechungsindex springt zwischen Kern und Mantel bei ca. 50 m Innendurchmesser

4.3.4.2

Gradientenindex-Faser

Radius r

Faser

Input

Kern

Brechungsindex n

Faser

Input

Mantel

„Kontinuierliche“

Reflektionen

Zeit

Output

geringere

Dämpfung

und Verzerrung

Zeit

Der Brechungsindex des Kerns geht im Intervall 0 bis 50 m kontinuierlich in den des

Mantels über

39

4.3.4.3

Monomode-Faser

Radius r

Input

Kern

Brechungsindex n

Faser

Mantel

Output

Signal ist

am besten

Zeit

= Wellenleiter: Faserdurchmesser ist

in der Größenordnung der Wellenlänge

Zeit

Die Faser ist so dünn (ca. 1 m), dass sie in der Größenordnung der Wellenlänge liegt

Das Licht wird nur von der Faser über quantenmechanische Effekte gelenkt

40

4.3.5

Vergleich der Glasfasertechnologien

104

Übertragbare Informationsmenge (M Bit/s)

Gr

103

565

140

102

34

101

Mo

no

mo

Systemparameter:

max. Regeneratorabstand aufgrund der

Dämpfung

de

ad

fas

ie n

er

t en

in d

ex

f as

er

Si

gn

a lw

Gr

e ll

ad

en

ie n

lä n

t en

ge

in d

13

ex

00

fas

3

nm

er

(fe

85

rn

0n

es

m

In f

(n

ah

ra

ro

es

t)

In f

ra

ro

t)

2

1

0

2

6 10

20

30

40

100

200

Verstärkerabstand in km

41

600

1000

1

Gradientenfaser, LED

als Sender, 850nm

Wellenlänge

2

Gradientenfaser, Laser

als Sender, 1300nm

Wellenlänge

3

Monomodefaser, Monomode-Laser als Sender, 1300nm Wellenlänge

4.4

Modulation von Signalen

Modulation: Aufprägung von digitalen Daten oder analogen Signalen auf hochfrequente analoge Signale (=elektromagnetische Wellen)

Modem (= Modulator + Demodulator): dient zur Modulation digitaler Daten (Modulator

zum Senden; Demodulator zum Empfangen)

Es gibt 3 Modulationsarten für elektromagnetische Wellen

1.) Amplitudenmodulation (AM) => Amplitude Shift Keying (ASK) für Binärdaten

2.) Frequenzmodulation (FM) => Frequency Shift Keying (FSK) für Binärdaten

3.) Phasenmodulation (PM) => Phase Shift Keying (PSK) für Binärdaten

Signalstärke

Amplitude

Sinusschwingung

{

Zeit

Phase

Frequenz / Wellenlänge

42

4.4.1

Beispiele zu Modulationsverfahren

0

1

0

1

1

0

0

1

0

0

1

0

(a)

(b)

große/kleine

Amplitude

(c)

große/kleine

Frequenz

(d)

High = kleine

Phase = Sinus;

Low = große

Phase = Cosinus

(a) binäres Datensignal, das eine Welle moduliert

(b) Extremfall der amplitudenmodulierten Welle, Amplitude 1 ist >0, Amplitude 2 = 0

(c) Frequenzmodulierte Welle (Frequenz springt zwischen 2 Frequenzen hin und her)

(d) Phasenmodulierte Welle (Phase springt zwischen 2 Phasen hin und her)

43

4.5

Codierung von Signalen

Die analogen Signale werden in der Zeit und in der Signalhöhe diskretisiert (= quantisiert) und dann durch einen Code repräsentiert. Anstelle des Analogsignals wird der

Codewert übertragen. Dies wird als Analog/Digital-Umsetzung bezeichnet.

Im einfachsten Fall wird der Binärcode zur Darstellung des Signals verwendet; bei

Rechnernetzen wird der Binärcode allerdings nicht eingesetzt, da ungeeignet

Zur Analog/Digital-Umsetzung gibt es auch die inverse Operation, die D/A-Wandlung

(Rückkonvertierung). Ein elektronischer Baustein (Chip) kann beides. Er wird als

CODEC (Codierer/Decodierer) bezeichnet und ist in Handys und ISDN-Telefonen eingebaut.

Analogsignale

4.5.1

CODEC

Digitale PCM-Signale

CODEC

Analogsignale

Non Return to Zero Codes (NRZ-Codes)

Die NRZ-Codes bilden eine ganze Familie von Codes

Das gemeinsame Kennzeichen der NRZ-Codes ist, dass ein fester Pegel während eines

Bitintervalls herrscht. Pegelwechsel erfolgen nur an den Intervallgrenzen.

44

Non return to zero soll daran erinnern, dass der Signalpegel für die Übertragung der

„1“ innerhalb des Bitintervalls nicht auf 0 Volt zurückkehrt, sondern beim High-Pegel

bleibt

NRZ Codes sind einfach zu implementieren

4.5.1.1

NRZ-L-Code (L= Level)

Der NRZ-L-Code ist der bekannte Binärcode, wie er in jedem Rechner verwendet wird

• d.h.,: „1“ = hoher Pegel, „0“ = niedriger Pegel

4.5.1.2

NRZ-M-Code und NRZ-S-Code (M = Mark, S = Space)

NRZ-M und NRZ-S sind sog. differenzielle Codierungen

D.h., es wird nicht der absolute Spannungswert (hoher Pegel bzw. niedriger Pegel) zur

Codierung von „0“ und „1“ verwendet, sondern ein Spannungswechsel vom augenblicklichen Wert in den komplementären Wert (z.B. von hoch nach niedrig oder von

niedrig nach hoch).

NRZ-M heißt:

• zur Darstellung der „1“ wird ein Spannungswechsel vorgenommen

• Zur Darstellung der „0“ wird kein Signalwechsel vorgenommen

NRZ-S heißt:

• zur Darstellung der „0“ wird ein Spannungswechsel vorgenommen

• Zur Darstellung der „1“ wird kein Signalwechsel vorgenommen

45

Vorteile von NRZ-M und NRZ-S gegenüber NRZ-L:

• Unter Einfluss von Störungen wie z.B. Rauschen sind Signalwechsel leichter zu detektieren als absolute Signalpegel, da Wechsel nur kurz dauern, während Pegel im Wert einbrechen können

• D.h. Pegel schwanken bei Störungen, müssen aber mit einem festen Schwellwert verglichen werden, um zwischen „0“ und „1“ zu unterscheiden, was dann zu Fehlinterpretationen führt

Nachteile aller NRZ-Codes:

1.) eine stets vorhandene Gleichstromkomponente => keine Trafo- oder Kondensatorkopplung möglich => sog. „Erdschleifen“ und Störungen sind wahrscheinlich

2.) Es gibt Synchronisierungsprobleme zwischen Sender und Empfänger bei langen „0“Folgen bei NRZ-M, bzw. bei langen „1“-Folgen bei NRZ-S, da sich nichts auf der Leitung ändert

4.5.2

Biphase-Codes = Zweite Gruppe von Codes

Das Kennzeichen aller Biphase-Codes ist, dass es zwei zeitliche Abschnitte (Phasen)

in jeder Bitzelle gibt => höhere Bandbreite erforderlich

Alle Biphase-Codes haben mindestens einen und höchstens zwei Spannungswechsel

pro Bitzelle

46

4.5.2.1

Biphase-L (= Manchester-Code)

Die erste Hälfte der Bitzelle enthält die Binärdarstellung, d.h. eine hohe Spannung bei

„1“, eine niedrige Spannung bei „0“

In der 2. Hälfte der Bitzelle wechselt der Spannungswert zum Komplement

Immer ein Signalwechsel in der Mitte des Intervalls; Je nach Bitfolge ggf. auch Signalwechsel am Ende des Intervalls

Der Signalwechsel in der Mitte wird vom Empfänger als Taktsignal für eine synchrone

Übertragung genutzt

Vor- und Nachteile von Manchester:

• Nachteil: Doppelte Baudrate bei unveränderter Bitrate gegenüber reinem Binärcode (doppelt so häufige Spannungswechsel)

• Vorteil: Takt und Daten können gleichzeitig auf demselben Kabel übertragen werden = taktsynchrone Übertragung

Wird für Ethernet verwendet

4.5.2.2

Differential Manchester-Code

Immer ein Signalwechsel in der Intervallmitte (= wie bei Manchester, die Bits werden

aber nicht explizit in der ersten Hälfte der Bitzelle kodiert)

Bei „0“ zusätzlicher Signalwechsel am Intervallbeginn. Bei „1“ passiert nichts.

Wird für Token Ring verwendet, da störungsicherer als Manchester

47

4.5.2.3

Immer ein Signalwechsel am Intervallbeginn

Bei „1“ zusätzlicher Signalwechsel in der Intervallmitte. Bei „0“ passiert nichts.

4.5.2.4

Biphase-S

Immer ein Signalwechsel am Intervallbeginn (wie Biphase-M)

bei „0“ zusätzlicher Signalwechsel in der Intervallmitte (komplementär zu Biphase-M)

4.5.2.5

Biphase-M (= Miller-Code oder FM-Code)

Modified Miller-Code (= Modified Delay „Modulation“, MFM-Code)

Signalwechsel am Ende des Intervalls, wenn nach einer Null wieder eine „0“ folgt

Bei „1“ zusätzlicher Signalwechsel in der Intervallmitte

Vorteile:

• Bandbreitebedarf ist geringer als bei Manchester oder Biphase-M

• Störsicherheit ist größer als bei Manchester, da differentieller Code

Wird für die Datenaufzeichnung bei magnetischen Medien (Festplatten, Bänder) verwendet. Bits können damit auf der Festplatte dichter gepackt werden.

4.5.2.6

Bipolar-Code (= Alternate Mark Inversion)

Verwendet drei Signalwerte: positive Spannung, Null und negative Spannung

48

„1“ wird im Wechsel durch einen positiven bzw. negativen Impuls in der 1. Hälfte des

Bitintervalls dargestellt

„1“ ist abwechselnd eine positive Spannung und eine negative Spannung

In der 2. Hälfte kehrt die Spannung jeweils auf Null zurück

Nachteil: doppelte Baudrate

Vorteil: keine Gleichstromkomponente => Trafo- oder Kondensatorkopplung ist möglich

Wird bei ISDN verwendet

4.5.2.7

Vorteile der Biphase-Codes

Leichte Taktsynchronisierung zwischen Sender und Empfänger, weil mindestens ein

Spannungswechsel pro Bitintervall stattfindet = taktsynchrone Übertragung, d.h. Takt

kann zusammen mit den Daten in demselben Signal übertragen werden

Spannungswechsel dienen als Impulsflanke zum Triggern des Empfänger-Flipflops

Fehlererkennung ist bereits auf Ebene 1 des ISO-7-Schichten-Modells anhand des Ausbleibens eines Spannungswechsels in einer Bitzelle möglich

49

4.5.3

Graphische Beispiele bei Leitungscodes

1

0

1

1

0

0

0

1

1

0

1

NRZ-L

NRZ-L = non return to

zero-level

NRZ-M = non return to

zero-mark

NRZ-S = non return to

zero-space

NRZ-M

NRZ-S

Biphase-L

(Manchester)

Biphase-M

Biphase-S

DifferentialManchester

Modified Miller

Bipolar

50

4.6

Multiplexen von Signalen

Definition: Übertragungsweg

• physikalisch-technisches Transportsystem für Signale (z. B. Kabel)

Definition: Übertragungskanal

• Verwaltungsgröße innerhalb eines Übertragungsweges zur Übertragung des Signalstroms

einer einzigen Quelle

Auf einem Übertragungsweg können mehrere Übertragungskanäle parallel betrieben

werden

Die Aufspaltung der gesamten Übertragungskapazität eines Übertragungsweges auf

verschiedene Übertragungskanäle ist möglich und effizient

Definition: Multiplexing

• Die Aufspaltung eines Übertragungswegs in mehrere Übertragungskanäle heißt Multiplexing

• Durch Multiplexing wird es möglich, einen Übertragungsweg mehrfach zu nutzen => Effizienzsteigerung

Übertragungswege können sowohl in der Zeit als auch in der Bandbreite mehrfach genutzt werden => Frequenzmultiplex + Zeitmultiplex

51

4.6.1

Frequenzmultiplexen

a)

b)

Amplituden

Modulation

Input

Basisband

Kanal 1

c)

Output

(a) Spektren dreier Telefongespräche (3

Basisbänder)

(b) Im Spektrum verschobene Basisbänder (Breitband)

(c) Spektrum der Signale auf dem Übertragungsweg (Kabel)

verschobenes Basisband (Breitband)

1

f

0

Spektrum

f

60

64

68

72

Spektrum

Kanal 1

Kanal 2

Kanal 2

1

f

0

f

60

64

68

0

f

60

72

64

Kanal 3

1

f

300

3100

Kanal 3

0

f

60

64

68

72

52

68

72

4.6.1.1

Grundidee des Frequenzmultiplexens

Breitbandige Übertragungswege ermöglichen die Unterbringung vieler Übertragungskanäle in unterschiedlichen Frequenzbereichen (Frequenzbändern), d. h., man teilt die

verfügbare Bandbreite in eine Reihe von - nicht notwendigerweise gleich breiten - Frequenzbändern auf und ordnet jedem Frequenzband einen Übertragungskanal zu.

Frequenz

Bandbreite des

Übertragungskanals

Kanal 1

Kanal 2

Bandbreite des

Übertragungsweges

...

Kanal n

Zeit

Es gilt: Summe über alle Kanalbandbreiten Bandbreite des Übertragungsweges

53

4.6.1.2

Prinzipielle Realisierung von Frequenzmultiplexen

Amplituden-Modulatoren

Bits

BST = Bitstrom

BST1

Amplituden-Demodulatoren

Filter f1

Träger f1

BST1

BST2

Frequenzgemisch

BST2

Bits

Filter f2

Träger f2

3 AM-modulierte

Träger f1, f2, f3 auf

einem Kabel

BST3

BST3

Träger f3

Filter f3

Hinweis: BST i = Bitstrom i, entspricht Kanal i; Träger = Sinusschwingung, die moduliert wird

54

4.6.2

Zeitmultiplexen tritt in Form des synchronen und des asynchronen Zeitmultiplexens

auf (synchronous/asynchronous Time Division Multiplexing)

4.6.3

Zeitmultiplexen

Synchrones Zeitmultiplexen

Beim synchronen Zeitmultiplexen wird die Zeit in sog. Zeitscheiben gleicher Länge eingeteilt, die auf Sender und Empfängerseite zum selben Zeitpunkt beginnen und enden

Die gesamte verfügbare Bandbreite wird für eine feste Zeit ts, der sog. Zeitscheibe, jedem Kanal zur Verfügung gestellt

Nach einer Umschaltzeit wird die Bandbreite zum nächsten Kanal weitergereicht

Nach einer Periodendauer T>ts wiederholt sich das Schema

Pro Periode erhält jeder Kanal eine Zeitscheibe (time slot) => time sharing

Zeitmultiplex ist aufgrund der notwendigen Pufferung nur für zeitdiskrete Signale einsetzbar (bevorzugt zeit- und wertdiskrete Signale, d.h. Digitalsignale)

55

4.6.3.1

Beispiel: Telefonvermittlung- und übertragung

Frequenz

Es gilt: Summe über alle Zeitscheiben

Periodendauer des Übertragungswegs

Bandbreite des

Übertragungswegs

Umschaltzeiten

ZeitscheiZeitscheibe K5

be K1

K1

K2

K3

K4

Periodendauer

56

K5

Zeit

4.6.3.2

Prinzipielle Realisierung von synchronem Zeitmultiplexen

Rotierender Abtaster

Bits

BST = Bitstrom

BST1

BST2

BST3

Puffer 1

Puffer 2

Puffer 3

Rotierender Verteiler

Bits

t1

t1

t2

TS1

TS3

TS2

t2

TS4

t3

t3

Puffer 1

Puffer 2

Puffer 3

BST1

BST2

BST3

• Jeder Sender i hat innerhalb einer Umlaufperiode des Abtasters eine feste Zeitscheibe (time slot) TSi. Abtaster und Verteiler rotieren im gleichen Takt und mit gleicher Phase

Synchrones Zeitmultiplexing

• Die Zeittakt-Stabilität (Jitter) zwischen Abtaster und Verteiler ist wichtig, sonst erfolgt eine

falsche Zuordnung des Bitstroms beim Empfänger

57

4.6.4

Asynchrones Zeitmultiplexen

Hierbei wird der Übertragungsweg dem Sender nicht fest über eine Zeitscheibe, sondern nach Bedarf zugeteilt

Anforderungsbasierter Medienzugang, Beispiel Ethernet

Asynchrones Zeitmultiplex wird auch als statistisches Zeitmultiplexing (STDM = statistical time division multiplexing) bezeichnet, weil a priori nicht klar ist, wer wann senden will

Der Empfänger kann aus der Zeitlage der Zeitscheiben nicht mehr die Herkunft der Daten erkennen

Es ist für jeden Datenrahmen eine Verwaltungszusatzinformation in Form eines sog.

Vorspanns (Headers) bestehend aus Zieladresse, Kanalkennzahl u.s.w. erforderlich

Man spricht nicht mehr von Zeitscheiben sondern von (Daten)rahmen

4.6.4.1

Aufbau der Datenrahmen bei asynchronem Zeitmultiplex

Zeit

Header

Inhalt

1. Datenblock (Rahmen)

...

...

Header

Inhalt

i. Datenblock

58

Header

Inhalt

(i+1). Datenblock

4.6.5

Vergleich zwischen synchronem und asynchronem Zeitmultiplexen

A2

synchrones Zeit-Multiplexing

A1

2

3

1

Bitströme 1 - 3

C2 B1 leer C1 leer A2 leer leer A1

B1

Multiplexer

C2

Ausgang

C1

C2 B1 C1

asynchrones Zeit-Multiplexing

= effizienter

Eintreffende Datenrahmen

A2 A1

Beim synchronen Zeitmultiplex ist die Zeitscheibe eines Kanals, auf dem nicht gesendet wird, verloren!

Vorteil von asynchrones Zeitmultiplexing: nützt den Übertragungsweg effizienter

Nachteil von asynchronem Zeitmultiplexing: Wenn sehr viele gleichzeitig senden,

kommt ein Sender möglicherweise nie zum Senden => für Echtzeit ungeeignet

Synchrones Zeitmultiplexing: für Echtzeit geeignet

Asynchrones Zeitmultiplexing wird häufig bei LANs eingesetzt, u.a. auch im Ethernet

59

4.6.6

Mobilfunknetz als Beispiel für gleichzeitiges Zeit- und Frequenzmultiplexen

GSM = Global System for Mobile Communication, UMTS = Universal Mobile Telephone

system, LTE = Long Term Evolution

Bei GSM/UMTS/LTE wird gleichzeitig synchrones Zeit- und Frequenzmultiplex eingesetzt, um für eine a priori nicht bekannte Zahl von Mobiltelefonen die niedrige Bandbreite des Funk-Übertragungsweges effizienter zu nutzen

Beispiel GSM: Der zur Verfügung stehende Frequenzbereich ist 890,2-914,8 MHz für die

uplink-Kommunikation (vom Mobiltelefon zur Basisstation) und 935,2-959,8 MHz für die

downlink-Kommunikation (von der Basisstation zum Mobiltelefon)

Damit werden pro Basisstation 124 Kanäle für up- und downlink durch Frequenzmultiplex realisiert => Die Bandbreite eines Kanals beträgt 200 KHz

Gleichzeitig wird jeder Kanal in 8 Zeitscheiben zu je 577 s unterteilt

im Prinzip könnten von jeder Basisstation bis zu 124*8 = 992 Mobiltelefone simultan

bedient werden

Hinzu kommt: jede Basisstation muss auf anderen Frequenzen innerhalb des zur Verfügung stehende Frequenzbereichs senden als die Nachbarbasisstation, damit Störungen zwischen den Basisstationen vermieden werden

=> Aufteilung der Frequenzbereiche in räumliche Bezirke („Zellen“), in deren Mitte

jeweils eine Basisstation steht, so dass sich keine Frequenzen zwischen benachbarten Basisstationen überlappen

60

Da sich die Funkwellen kugelförmig ausbreiten, ist das Verbreitungsgebiet einer Zelle

auf dem Boden ein Kreis

Der Kreis wird mittels eines regelmäßigen Sechsecks approximiert

Bienenwabenstruktur der Funkzellen

B

G

a) homogene Zellgröße auf

dem flachen Land (gleiche

Buchstaben bezeichnen gleiche Frequenzen)

b) kleinere Zellen für Städte in

der Mitte

C

A

F

B

G

A

D

E

C

F

B

G

D

E

C

A

a)

F

D

b)

E

5 Sicherungsschicht (ISO-Schicht 2)

Im ISO-Modell ist die Sicherungsschicht zwischen je zwei benachbarten Rechnern relevant

Sie leistet mehr als nur die Daten zu sichern

61

5.1

Verdeckung (= Unsichtbarmachung) von Übertragungsfehlern zwischen direkt benachbarten Rechnern (keine Zwischenknoten), bestehend aus den Teilschritten Erkennung

und Behebung

Flusssteuerung (flow control) des Datenverkehrs zum Nachbarrechner

Bei LANs mit mehreren Sendern auf einem Übertragungsmedium: Steuerung des Zugangs zum gemeinsam genutzten Medium (= Medium Access Control, MAC)

5.2

Aufgaben der Sicherungsschicht

Ursachen von Übertragungsfehlern

Fehler werden häufig durch andere elektrische und elektronische Geräte verursacht

Diese Störungen haben physikalische Gründe:

1.) „Weißes Rauschen“ = thermisches Rauschen von Leitungen und Bauteilen aufgrund

der Brownschen Molekularbewegung

• hohe Temperatur, z.B. aufgrund der Abwärme von Geräten => starkes Rauschen

• Entscheidend für die Signalgüte ist das Verhältnis von Signalspannung/Rauschspannung

2.) Dämpfung des Nutzsignals

• Ist abhängig von der Frequenz des Nutzsignals: hohe Frequenz => hohe Dämpfung

3.) Verzerrung des Nutzsignals

62

• Ist abhängig von der Frequenz und von der Amplitude des Nutzsignals: hohe Frequenz

oder hohe Amplitude => hohe Verzerrung

4.) Übersprechen auf Leitungen

• verursacht durch Induktion, kapazitive Kopplung und elektromagnetische Wellen

• Induktion (Magnetfelder): schnelle Feldänderungen => hohe Störspannung

• Kapazitive Kopplung (elektrische Felder): lange, parallele Leitungen => hohe Störspannung

• Elektromagnetische Wellen => hohe Frequenz => hohe Störspannung

5.) Potentialunterschiede in der Masseleitung zwischen Sender und Empfänger

• Verursacht z.B. aufgrund von sog. Erdschleifen

• Eine Erdschleife kommt über die sog. „Erdung“ ins Spiel, d.h. über die Schutzerde an metallischen Gerätesteckern, die der VDE vorschreibt.

• Die Erdschleife wird geschlossen, wenn an den Gerätesteckern von Sender und Empfänger aus Unkenntnis die Signalerden mit Schutzerde verbunden werden

• Durch das Verbinden von Signal- mit Schutzerde entsteht parallel zur Masseleitung des Signals eine zweite Masseleitung über die Schutzerde, und die Erdschleife ist geschlossen

• Über die geschlossene Erdschleife können erhebliche Ströme (sog. Ausgleichsströme)

fliessen, die wiederum einen Potentialunterschied zwischen der Signalerde von Sender

und Empfänger bewirken. Dieser Potentialunterschied verursacht Störungen.

• Es ist deshalb verboten, Signalerde mit Schutzerde zu verbinden!

63

5.3

Fehlercharakteristik bei Übertragungsfehlern

Fehler kommen oft nach einer langen Pause und dann kurz aufeinander folgend: sog.

Bursts auch Fehlerbündel genannt

Beispiel: bei einem Burst von 10 ms und einem 1,5 Mbit/s-DSL-Modem entspricht dies

15 000 falschen Bits

Vorteil von Bursts: Nur wenige Blöcke enthalten Fehler

Nachteil: Schwer zu korrigieren, da i.d.R. viele Fehler auf einmal auftreten

Wiederholung eines ganzen Datenrahmens wegen Burst-artigem Fehlerverhalten

5.4

Fehlererkennung

Zur Fehlererkennung wird die Nutzinformation durch Zusatzinformation ergänzt

Diese wird als Prüfbit oder als Prüfsumme zusammen mit den Nutzdaten übertragen

Je nach Umfang der Redundanz und verwendetem Code kann eine gewisse Anzahl an

Fehlern sogar korrigiert werden

Fehlerkorrektur wird bei Rechnernetzen allerdings nicht eingesetzt, statt dessen wird

die Datenübertragung wiederholt

Der Zusammenhang zwischen der Fehlerhäufigkeit der Übertragungsstrecke und der

gewünschten Wahrscheinlichkeit der Entdeckung bzw. Korrektur eines Fehlers wird in

der Nachrichtentechnik, einem Teilgebiet der Elektrotechnik, behandelt

64

Die Nachrichtentechnik kann erklären, wie groß bei n Nutzbits der Umfang der notwendigen Redundanz sein muss, um i Bitfehler erkennen und j<i korrigieren zu können

5.4.1

Fehlererkennung durch Paritätsbit

Bsp. 1

ein

ASCIIZeichen

Bsp. 2

Bsp. 3

Bit 1

0

1

1

Bit 2

1

0

1

Bit 3

0

0

0

Bit 4

0

1

0

Bit 5

0

0

0

Bit 6

0

1

0

Bit 7

1

1

1

0

0

1

Paritätsbit

gerade

Parität

1

1

65

0

ungerade

Das Paritätsbit ergänzt die Anzahl der Einsen im Zeichen (= „Quersumme“), so dass sie

gerade/ungerade wird (gerade Parität = gerade Zahl von Einsen)

Berechnung erfolgt so, dass die gesamten Quersumme inkl. Parity gerade oder ungerade wird

Bei einer asynchronen Übertragung (V.24) wird für jedes einzelne Zeichen ein Prüfbit

verwendet

Nachteil: Es kann nur ein Fehler erkannt und keiner korrigiert werden

Genauer: es kann eine ungerade Zahl von Bitfehlern erkannt werden

Auskunft, wie viele falsche Bits erkannt bzw. wie viele korrigiert werden können, gibt

die sog. Hamming-Distanz H

Zwei Binärworte A, B derselben Länge haben die Hamming-Distanz H, wenn sie sich in

H Bits unterscheiden

Die Hamming-Distanz definiert eine Metrik in einem diskreten n-dimensionalen Punktraum, in dem jedes Binärwort der Länge n einen Punkt darstellt

Wird im Punktraum um jedes Nutzwort A ein Sicherheitsabstand H bis zu einem beliebigen Nachbarn B geschaffen, können H-1 falsche Bits erkannt und H/2 korrigiert werden

Alle Bitkombinationen innerhalb des Sicherheitsabstandes H sind bis auf das Wort A

selbst verboten

Erkennt der Empfänger eine verbotene Bitkombination, dann weiß er, dass ein Fehler

vorliegt

66

Erkennt der Empfänger die erlaubte Bitkombination A, dann liegt mit hoher Wahrscheinlichkeit kein Fehler vor

Eine Methode zur Erzielung einer Hamming-Distanz H zwischen zwei Worten A, B ist

der Cyclic Redundancy Check (CRC)

5.4.2

Fehlererkennung durch Prüfsumme (Cycling Redundancy Check, CRC)

Das Prinzip für Cycling Redundancy Check lautet:

1.) Betrachte einen Bitstring als die Kurzdarstellung eines Polynoms vom Grad n in der

Variablen x, bei dem nur die Koeffizienten 0 und 1 aufgeschrieben werden

• Beispiel: 11001 sei ein Polynom in x vom Grad 4 gemäß: x4 + x3 + x0

2.) Wähle ein sog. Generatorpolynom G(x) vom Grad g in Form eines zweiten Bitstrings

• Einige Generatorpolynome sind bereits fertig und normiert, so dass die Wahl leicht fällt

3.) Hänge an die Nachricht M(x) eine CRC-Prüfsumme so geschickt an, dass das daraus

entstehende neue Polynom T(x) aus Nachricht plus Prüfsumme durch G(x) teilbar ist.

4.) Übertrage T(x) und prüfe beim Empfänger das empfangene T(x) auf Teilbarkeit durch

G(x)

5.) Die Nachricht ist mit hoher Wahrscheinlichkeit dann korrekt übertragen, wenn die

Teilbarkeit gegeben ist

67

5.4.2.1

Algorithmus für die CRC-Berechnung

1.) Es sei die Nachricht M und das Generatorpolynom G(x) vom Grad g gegeben. Dann

hänge man g Nullen an M an, erzeuge also M(x)00...0

2.) Teile M(x)00...0 durch G(x) gemäß Division modulo 2, d.h. ohne Borgen, ohne Übertrag. (Diese spezielle Arithmetik ist Teil der sog. Galouis-Feldtheorie)

• Bei der Division kann ein Rest R entstehen. Falls R>0, dann Schritt 3.) sonst Schritt 4.)

3.) Subtrahiere den Rest von M(x)00...0 gemäß modulo 2 (= ohne Borgen, ohne Übertrag)

4.) Das Ergebnis ist T(x), d.h. die zu transferierende Nachricht samt Prüfsumme

• Die g least significand bits von T(x) sind die CRC-Prüfsumme

• T(x) ist garantiert durch G(x) teilbar, da ein etwaiger Rest vorher subtrahiert wurde.

5.) Der Empfänger teilt das empfangene T(x) durch G(x)

6.) Gibt es keinen Rest (R=0), ist T(x) mit hoher Wahrscheinlichkeit fehlerfrei übertragen

worden

68

5.4.2.2

Erstes Beispiel für CRC-Berechnung

Rahmen: 1 1 0 1 0 1 1 0 1 1 Generator: 1 0 0 1 1 => Grad g = 4

Nachrichten nach dem Anhängen von 4 Nullbits: 1 1 0 1 0 1 1 0 1 1 0 0 0 0, dann teilen:

1 1

-1 0

’’ 1

-1

’’

0

0

0

0

0

-0

’’

1

1

0

0

0

0

0

-0

’’

0 1 1 0 1 1 0 0 0 0 : 1 0 0 1 1 = 1 1 0 0 0 0 1 0 1 0 mit Rest 1 1 1 0

1

kein Borgen!

1 1

Daraus:

1 1

11010110110000-1110=11010110111110

0 0 1

0 0 0

gesendeter Rahmen

0 0 1 0

Nutzdaten

CRC-Prüfsumme

0 0 0 0

0 0 1 0 1

-0 0 0 0 0

Wichtig:

’’0 1 0 1 1

1.) Addition ohne Übertrag ist hier wie Subtraktion ohne

-0 0 0 0 0

Borgen d.h. diese spezielle Addition ist mit dieser spezi’’ 1 0 1 1 0

ellen Subtraktion identisch! Beides wiederum ist mit der

-1 0 0 1 1

bitweisen EXOR-Operation identisch (gemäß algebrai’’ 0 1 0 1 0

scher Feldtheorie von Galois)

-0 0 0 0 0

’’1 0 1 0 0

2.) Subtraktion von Dividend und Divisior erfolgt bereits

- 1 0 0 1 1

dann, wenn Dividend und Divisor gleich viele Stellen ha’’ 0 1 1 1 0

ben, nicht erst wenn Dividend größer oder gleich Divisor

-0 0 0 0 0

ist, wie sonst üblich. Eine Null als MSB zählt dabei nicht

Rest:

’’ 1 1 1 0

als Stelle!

69

5.4.2.3

Zweites Beispiel für CRC-Berechnung

Rahmen: 1 0 0 1 1 0 0 1

1 0 0 1

-1 0 1 0

’’ 0 1 1

-0 0 0

’’ 1 1

- 1 0

’’ 1

- 1

’’

Rest:

1

1

0

0

0

1

1

0

1

-1

’’

Generator: 1 0 1 0 1 => g=4, also: 1 0 0 1 1 0 0 1 0 0 0 0

0 0 1 0 0 0 0 : 1 0 1 0 1 = 1 0 1 1 1 1 0 1 mit Rest 1001

0

0

0 0

0 1

0 1

1 0

1 1

0 1

1 0

-1 0

’’ 0

-0

’’

gesendeter Rahmen: 1 0 0 1 1 0 0 1 0 0 0 0 - 1 0 0 1 =

1 0 0 1 1 0 0 1 1 0 0 1

1

1

0

0

0

1

1

0

1

-1

’’

0

1

1

0

1

0

1

0

1

0

1

1

0

1

1

0

0

0

0 0

0 1

0 1

Der Empfänger

1 0 0 1 1 0 0

-1 0 1 0 1

’’ 0 1 1 0 0

-0 0 0 0 0

’’ 1 1 0 0 0

- 1 0 1 0 1

’’ 1 1 0 1

-1 0 1 0

’’ 1 1 1

-1 0 1

’’ 1 0

-1 0

’’ 0

-0

’’

Rest:

70

berechnet nach der Übertragung:

1 1 0 0 1 : 1 0 1 0 1 = 1 0 1 1 1 1 0 1

1

1

0

0

0

1

1

0

1

-1

’’

1

1

0

0

0

0

0

0

0

0

1

1

0

1

1

0

0

0

0 1

0 1

0 0 = O.K.

5.4.2.4

Beispiele für CRC-Generatorpolynome

CRC-16 =x16 + x15 + x2 + 1 (ISO)

CRC-CCITT =x16 + x12 + x5 + 1

Beide werden für Datenübertragung benutzt, die Regel sind aber heutzutage 32 Bit

5.4.2.5

Erkannt werden:

•

•

•

•

alle einfachen und zweifachen Bitfehler

alle Fehler mit einer ungeraden Bitzahl

alle Fehler, die direkt hintereinander auftreten (= Bursts), aber nur mit einer Länge < 16 Bit

99,998% aller längeren Bursts mit > 16 fehlerhaften Bit direkt hintereinander

5.4.2.6

Implementierung der CRC-Berechnung

CRC lässt sich sehr einfach in Hardware mit Hilfe eines Schieberegisters und der bitweisen XOR-Funktion implementieren

5.5

Potential der Fehlererkennung durch CRC-16- und CRC-CCITT-Polynome

Bit Stuffing und Rahmenbegrenzer

Zur Anwendung von fehlererkennenden und fehlerkorrigierenden Codes muss der Datenstrom in einzelne Abschnitte unterteilt werden => „Rahmen“ (frames) bzw. Pakete

ab ISO Schicht 3

71

Problem: Wie kann man den Rahmenanfang im Bitstrom erkennen, wenn jedes beliebige Bitmuster in den Nutzdaten vorkommen kann?

Bit Stuffing (Bitstopfen) zur Kennzeichnung des Rahmenanfangs

Als Kennzeichnung wählt man z.B. 01111110 (= 6 Einsen hintereinander). Der Sender

fügt nach fünf Einsen im Nutzdatenstrom eine 0 ein.

Er fügt keine 0 ein, wenn es sich um den Rahmenanfang handelt.

Wenn der Empfänger nach fünf Einsen eine Null sieht, entfernt er diese aus dem Datenstrom.

Wenn er keine 0 sieht, weiß er, dass es sich um einen Rahmenanfang und nicht um

Nutzdaten handelt.

5.5.1

Beispiel für Nutzdatentransfer mit 6 Einsen am Stück

Sender

Leitung

Empfänger

011111

0111110

011111

101011111

1010111110

101011111

72

0101

0101

0101

5.5.2

Weitere Beispiele für Bit Stuffing

0

1

2

3

4

5

6

7

Kennzeichnung des Rahmenanfangs

Übertragung von 6 Einsen im

Nutzdatenstrom:

1

eingeschoben

Übertragung von 5 Einsen einer Null und einer Eins:

0

1

0

0

eingeschoben

Übertragung von 5 Einsen

und zwei Nullen:

eingeschoben

Sechs Einsen hintereinander kann es auf der Leitung nur am Rahmenanfang geben

73

5.5.3

Realisierung des Bitstopfens

Empfangen von Nutzdaten

Senden von Nutzdaten

(Kein Rahmenanfang)

(Ereignis: eintreffendes Bit)

Sender hat 6 Zustände

Empfänger hat 8 Zustände (inkl. Fehlerzustand)

0/0

Start

A

0/0

0/0

0/0

Drei Einsen

gekommen

1/1

0/0

Vier Einsen

gekommen

E

1/1

Fünf Einsen 1/1

gekommen

und 0 eingefügt

Notation: e/a

e = Eingabe

a = Ausgabe

1/1

1/10

F

Realisierung über endliche Automaten für Sender und Empfänger

D

1/1

E

1/1

C

1/1

0/0

1/1

0/0

Zwei Einsen

gekommen

D

Start

B

1/1

0/0

Ersetze die 5.

Eins durch 10

0/0

Eine Eins

gekommen

C

1/1

A

1/1

B

0/0

0/0

F

0/0

eingefügte G

0 wurde entfernt

0/

1/1

Ersetze 10 durch

1, wenn 4 Einsen

vorausgegangen

sind.

H Fehlerzustand: Rahmenanfang in den Nutzdaten

74

5.6

Typisches Rahmenformat der Schicht 2

Zeit

Flag, z.B.:

01111110

Target

Address

Source

Address

Control

(Steuerung)

0,1, 2,...Data

Bytes

Checksum

(CRC)

Rahmen-Kennzeichner

Rahmen-Kennzeichner (frame delimiter)

Flag = „Flagge“ = Rahmenkennzeichnung mittels Bit Stuffing

Rahmenbegrenzer am Paketende kann entfallen, wenn die Rahmenlänge bekannt ist,

oder wenn nächster Rahmen unmittelbar nachfolgt

5.6.1

Flag

01111110

Sprachregelung bei Schicht 1, 2 und 3

Auf der Schicht 1 spricht man von Bitstrom

Auf der Schicht 2 spricht man von Rahmen

Auf allen Schichten 3 spricht man von Paket

5.6.2

Das Steuerfeld eines ISO-Schicht 2-Rahmens („Control“)

Hinweis: to control: steuern; to check: kontrollieren; feed-back control: regeln

75

Im Steuerfeld eines ISO-Schicht 2-Rahmens steht die Rahmenlänge, sowie ggf. eine

sog. Empfangsbestätigung (Acknowledge) oder eine Rahmen-Sequenznummer

Hinweis: Acknowledgement = Anerkennung, Bestätigung, Quittung

Im Falle von Ethernet steht im Steuerfeld die Rahmenlänge aber kein Acknowledge,

bzw. keine Sequenznummer

Im Internet wird deshalb die Funktion von Acknowledges bzw. Sequenznummern

durch weitere Steuerfelder in Paketen der Schichten 3 und 4 nachgeahmt

D.h., im Internet tauchen Acknowledges bzw. Sequenznummern erst auf den Schichten

3 bzw. 4 auf und haben dort dieselbe Funktion wie in ISO-Schicht 2-Rahmen

Die Rahmenlänge wird bei variabel langen Rahmen vom Empfänger der Schicht 2 stets

benötigt, um zu wissen, wo die Prüfsumme anfängt bzw. der Rahmen endet

Schicht 2-Acknowledges, sofern vorhanden, werden vom Empfänger zur Quittierung

korrekt erhaltener Rahmen, sowie zur Flusssteuerung (flow control) zwischen benachbarten Rechnern benutzt

Hinweis: Flusssteuerung heißt: Sind die letzten Blöcke zu schnell gekommen? Falls ja, bremst der

Empfänger den Sender.

Schicht 2-Sequenznummern, sofern vorhanden, werden benutzt zur:

1.) Erkennung doppelt bzw. mehrfach gesendeter Datenrahmen

2.) Zur Sicherstellung der korrekten Rahmenreihenfolge, sowie ebenfalls zur Flusssteuerung

76

5.7

Bestätigungen (Acknowledges)

Für jedes Datenpaket vom Sender zum Empfänger wird eine Bestätigung in Gegenrichtung geschickt, sofern das Datenpaket unversehrt empfangen wurde

Wird das Paket nicht empfangen oder fehlerhaft empfangen, erhält der Sender keine

Bestätigung => der Sender merkt dies anhand einer Zeitschranke (time out)

Zwei Fälle müssen dabei unterschieden werden: a) wenn das Paket nicht empfangen

wurde b) wenn die Bestätigung verloren ging

5.7.1

Zwei Fälle von Datenverlust

Sender

Empfänger

Sender

Empfänger

AC

Paketverlust

Hinrichtung

K

Paketverlust

Rückrichtung

1. Verlust eines Datenblocks:

2. Verlust einer Quittung:

- Senke wartet auf Daten

- Quelle wartet auf Bestätigung

- Quelle wartet auf Bestätigung - Senke wartet auf neue Daten

77

Problem mit Acknowledges: Ohne Überwachung einer Zeitobergrenze würde der Sender in beiden Fällen beliebig lange auf das Acknowledge warten

Lösung: Einführung einer Zeitschranke (Timeout) beim Sender

Neues Problem: welchen Wert soll die Zeitschranke haben?

Für den Time Out-Wert gibt es keine generelle Lösung!

5.7.2

Bestätigung mit Zeitschranke (timeout) auf der Senderseite

Sender

Empfänger

Zeitüberwachung

Bl

oc

Time- benötigte

Zeit

outZeit

k

K

AC

Sender

Empfänger

Zeitüberen

wachung B

tw

l oc

ed

k

er

TimeoutZeit

Aktivierung

des Timouts

er

od

K

AC

(1) Beispiel für eine fehlerfreie Übertragung

(2) Beispiel für das Erkennen eines

Nachrichtenverlustes durch Ablauf

der Zeitschranke

de

Bl rsel

oc be

k

(1)

K

AC

(2)

rechtzeitig

Weiteres Problem: Der Rahmen i wird 2x fehlerfrei übertragen

78

Gibt der Empfänger den Block i an die nächst höhere Schicht 2x weiter?

Daraus entstünde ein Duplikat, das zu einem Fehler führen würde

Lösung: Einführung von Sequenznummern

5.7.3

Bestätigung mit Zeitschranke und Sequenznummern auf der Sender- und Empfängerseite

Aufgaben von Sequenznummern:

1.) Erkennung von Duplikaten

• bei einer unerwünschten Verdopplung des Rahmens bleibt die Sequenznummer gleich

2.) Quittieren von mehreren Rahmen auf ein Mal (Sammelquittung)

3.) Zur Flusssteuerung zwischen benachbarten Rechnern

Im Internet wird eine Flusssteuerung nur von TCP vorgenommen

Dazu benützt TCP keinen eigenen Mechanismus

Vielmehr werden Sequenznummern zweckentfremdet, indem das Absenden etwas verzögert wird (delayed acknowledge)

Sequenznummern werden sowohl zur Fehlerkontrolle als auch zur Flusssteuerung

verwendet

79

5.7.3.1

Beispiel für das Erkennen von Duplikaten

Sender

Empfänger

Bl

oc

ki

-1

verarbeiten

Zurückgeschickte Sequenznummern, i-1, i, i+1, ... dienen zugleich

als Bestätigung.

K

AC

Zeitüberwachung

Bl

oc

i-1

ki

K

AC

timeout

Bl

oc

= weiterleiten zur Schicht 3

(Vermittlungsschicht)

i

verarbeiten

= weiterleiten zur Schicht 3

(Vermittlungsschicht)

ki

wegwerfen,

K

AC

80

i

weil schon einmal empfangen

5.7.3.2

Beispiel für eine Sammelquittung

Quelle

(Sender)

0

I(0)

1

verarbeiten

I(1)

2

I(2)

I(3)

3

4

)

B( 1

verarbeiten

t

ou

e

tim 2

3

4

5

wegwerfen,

weil I(3) fehlt

wegwerfen,

weil I(3) fehlt

wegwerfen,

weil I(2) schon da

I(5)

I(2)

I(3)

Situation: I(2) wird zu

spät bestätigt und I(3)

geht verloren. Deshalb

wird I(2), I(3), I(4) und I(5)

zwei Mal gesendet => ineffizient im Fehlerfall

verarbeiten

I(4)

)

B(2 I(

5)

)

B(4

verarbeiten

verarbeiten

)

B(5

verarbeiten

I(4)

5

Zeitüberwachung

Senke

(Empfänger)

I = Informationsblock

B = Bestätigung

Zurückgeschickte Sequenznummer B (1) dient als Bestätigung für die Blöcke 0 und 1

81

5.8

Nachdem ein Übertragungsfehler durch CRC-Prüfung oder Timeout erkannt wurde,

sollte der betreffende Rahmen neu geschickt werden, sofern nicht Echtzeitbedingungen herrschen (z.B. aufgrund von Video-Streaming in web TV)

Für die Rahmenwiederholung gibt es verschiedene Strategien:

5.8.1

Fehlererbehebung durch Rahmenwiederholung

Fehlerbehebung mit „go-back-n“ und ohne Pufferung beim Empfänger

Im Falle eines Fehlers (CRC falsch) bleibt das Ack aus

Nach Ablauf des Timers überträgt der Sender sämtliche Rahmen ab dem unbestätigten

Rahmen neu.

alle Rahmen ab dem Fehler

noch einmal übertragen

Timeout-Intervall

Sender 0

1

2

3

4

5

6

7

8

2

3

4

0

1

F

6

7

8

9

10

5

6

2

4

3

k ck ck ck ck

c

A

A

A

A

A

1

0

k ck

c

A

A

Empfänger

5

V

V

V

V

V

V

2

3

4

5

Fehler

Von der Sicherungsschicht

verworfene Rahmen

82

Zeit

6

7

8

Fehler werden empfängerseitig anhand eines falschen CRCs festgestellt und senderseitig anhand des Timeouts

Jeder Rahmen muss einzeln quittiert werden

Keine Sammelquittung möglich, da keine Pufferung

Vorteil: Einsparen von Pufferplatz. Ist heutzutage nicht mehr wichtig.

Nachteil: Ineffizient im Fehlerfall, da alle Rahmen des Timeout-Intervalls neu übertragen werden müssen. Ist auch heute noch ein Nachteil.

83

5.8.2

Fehlerbehebung mit „go-back-n“ und mit Pufferung beim Empfänger

Für Rahmen 6 kommt Ack 8 zu spät, aber

Rahmen 7 und 8 werden nicht zweimal

übertragen

Timeout-Intervall

Sender 0

1

2

3

4

5

6

7

8

2

3

4

1

0

k ck

c

A

A

Empfänger

0

1

F

k

Ac

3

4

5

6

7

8

2

Fehler

Zeit

5

Von der Sicherungsschicht

gepuffert (gespeichert)

V

6

9

10 11 12

8

k

Ac

V

V

V

9

9

10

Nachricht 2-8 an die

Vermittlungsschicht

übergeben

Im Falle eines Fehlers bleibt das Ack aus

Der Empfänger puffert alle danach korrekt erhaltenen Rahmen

Nach Ablauf des Timers beginnt der Sender, alle Rahmen ab dem Unbestätigten neu zu

übertragen, bis er eine Sammelquittung vom Empfänger erhält

Der Sender fährt danach mit dem ersten noch nicht übertragenen Rahmen fort

Die erneute Übertragung von 7 und 8 wird durch Sammelacknowledge vermieden

Sammelquittungen haben den Vorteil höherer Ausnutzung der Bandbreite

Anwendung: TCP

84

5.8.3

Fehlerbehebung durch „selective repeat“

Timeout-Intervall

Sender 0

1

2

3

A

Empfänger

0

ck

1

4

0

A

ck

F

Fehler

5

6

1

A

3

ck

4

3

7

2

9

10 11 12 13 14

2

9

10 11

4

5

6

7

8

k

k

k

k

k

k

k

k

k

Ac Ac Ac Ac Ac Ac Ac Ac Ac

5

6

7

8

2

Von der Sicherungsschicht

gepuffert

Zeit

8

9

10 11 12

Rahmen 2-8 werden an die

Vermittlungsschicht

übergeben => Latenz durch Fehlerkorrektur

Der Empfänger bestätigt jeden korrekt erhaltenen Rahmen sofort (keine Sammelquittung)

Er puffert alle korrekt erhaltenen Rahmen, auch nach einem fehlerhaften Rahmen

Bei Ablauf des Timers überträgt der Sender nur den nicht bestätigten Rahmen neu

Jedes fehlerfreie Paket wird bestätigt

Nachteil: viele Bestätigungen => schlechte Ausnutzung der Bandbreite in Gegenrichtung

Vorteil: keine unnötige Wiederholung korrekt empfangener Pakete => gute Ausnutzung

der Bandbreite zwischen Sender und Empfänger

Da Acknowledges viel kürzer als Nutzdaten sind, lohnt sich dieses Verfahren

85

Allen Verfahren gemeinsam ist eine erhöhte Latenz bei der Datenübergabe im Fehlerfall

5.8.4

Aktive Fehlerkontrolle

Bisher: passive Fehlerkontrolle

Passiv heißt nicht-Senden von (positiven) Acknowledges

Nachteile der passiven Fehlerkontrolle:

• Keine Unterscheidung zwischen fehlenden und fehlerhaften Blöcken

• Zeitverzögerung bis zur Wiederholung des Sendevorgangs = unnötige Wartezeit beim Sender im Fehlerfall

Milderung des Latenzproblems durch aktive Fehlerüberwachung