Statistik I Einführung

Werbung

Statistik IEinführung

Statistik I

Einführung

Prof. Dr. Andreas Behr

1 / 40

Statistik IEinführung

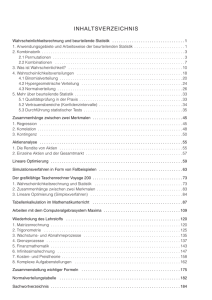

Inhaltsverzeichnis

Einleitung

Ziele

Motivation

Literatur und Vorlesungsplan

Beispiel: PSID

Das PSID

Die Lohnverteilung

Gruppenvergleiche

2 / 40

Statistik IEinführung

Einleitung

Einleitung

I

Deskriptive Statistik:

I

I

I

Nächstes Semester: ’Stochastische Statistik’

I

I

I

3 / 40

Einführung in die deskriptive (beschreibende) Datenanalyse

Darstellung und Charakterisierung von Daten

Einführung in die Wahrscheinlichkeitsrechnung

Zufallsvorgänge

Wahrscheinlichkeitsurteile

Statistik IEinführung

Einleitung

Ziele

Ziele der Vorlesung "Deskriptive Statitik"

I

Wissen um Methoden und Probleme der

I

I

I

I

Statistischen Begriffsbildung

Methoden der Datengewinnung

Methoden der Datenauswertung

Schwerpunkt: Datenauswertung, Datenanalyse

1. Aufbereitung und Verdichtung von Daten

2. Tabellarische und grafische Darstellung

3. Charakterisierung der Daten durch Kennzahlen

4 / 40

Statistik IEinführung

Einleitung

Ziele

Ziele

I

Auswertungsmethoden

I

I

I

5 / 40

Methoden der graphischen Darstellung

Beschreibung eindimensionaler Daten mit Hilfe von

Maßzahlen

Beschreibung mehrdimensionaler Daten mit Hilfe von

Maßzahlen

Statistik IEinführung

Einleitung

Motivation

Motivation

I

Funktion der Statistik in den Wirtschaftswissenschaften

I

I

I

I

6 / 40

Die Statistik ist das Sinnersorgan der

Wirtschaftswissenschaften

BWL: Die Umsatzentwicklung läßt sich nicht ’erfühlen’

VWL: Die Entwicklung der Arbeitslosigkeit läßt sich nicht

’erfühlen’

Es muß jeweils gezählt/gemessen, ausgewertet und

dargestellt werden!

Statistik IEinführung

Einleitung

Motivation

Motivation

I

Beispiele aus der Tageszeitung:

1. Aktienindex−→ Kapitel Preisindizes

2. Arbeitslosenquote−→ Kapitel Zeitreihen

7 / 40

Statistik IEinführung

Einleitung

Literatur und Vorlesungsplan

Grundlegende Literatur zur Vorlesung

8 / 40

Statistik IEinführung

Einleitung

Literatur und Vorlesungsplan

Grundlegende Literatur zur Vorlesung

9 / 40

Statistik IEinführung

Einleitung

Literatur und Vorlesungsplan

Grundlegende Literatur zur Vorlesung

10 / 40

Statistik IEinführung

Einleitung

Literatur und Vorlesungsplan

Weitere Literatur

11 / 40

I

Rohwer, Götz u. Ulrich Pötter, Grundzüge der

sozialwissenschaftlichen Statistik, 2001, Juvenat,

Weinheim.

I

Assenmacher, Walter, Deskriptive Statistik, 3. Aufl., 2003,

Springer, Berlin.

I

Lippe, Peter von der, Deskriptive Statistik, 7. Aufl., 2006,

Oldenbourg.

I

Formelsammlung: Bomsdorf, E. et al., Definitionen, Formeln

und Tabellen zur Statistik, 4. Auflage, 2003, Köln.

I

In der Klausur wird ein ’Formelblatt’ ausgeteilt.

Statistik IEinführung

Einleitung

Literatur und Vorlesungsplan

3 Komponenten der Veranstaltung

I

Vorlesung

I

Übung: Wiederholung wichtiger Konzepte, Beispiele

Tutorien: Besprechung der Aufgabenblätter

I

I

I

12 / 40

Beachte: nur eigenständiges Lösen der Aufgaben nützt Ihnen

Nutzen der Tutorien hängt weitgehend von Ihrer individuellen

Vorbereitung ab!

Statistik IEinführung

Einleitung

Literatur und Vorlesungsplan

Gliederung der Vorlesung

1. Einführung

2. Daten und Variablen

3. Grundlagen Häufigkeitsverteilung

4. Maßzahlen zu Häufigkeitsverteilung

5. Klassierte Daten

6. Vergleichsmaßzahlen

7. Konzentrationsmessung

8. Preis- und Mengenindizes

9. Zeitreihen

10. Korrelationsrechnung I

11. Korrelationsrechnung II

12. Regressionsrechnung

13 / 40

Statistik IEinführung

Einleitung

Literatur und Vorlesungsplan

Empirische Analysen

14 / 40

I

Zum Erlernen der Methoden sind Mickey Maus-Beispiele

nützlich (Berechnen Sie den Durchschnitt folgender 3

Zahlen...)

I

Aber in der Praxis warten große Datenmengen auf Sie

I

Im Bereich der BWL: Kundendatenbanken, etc.

I

Im Bereich der VWL: Haushalts- oder

Unternehmensdatensätze, etc.

I

Daher soll auch mit einem echten Datensatz gearbeitet

werden!

Statistik IEinführung

Beispiel: PSID

Eine Analyse der Lohneinkommen

15 / 40

I

PSID: Panel Study of Income Dynamics

I

Querschnitt: Einheiten werden zu einem Zeitpunkt befragt

I

Längsschnitt (Zeitreihe): Einheit wird an mehreren

Zeitpunkten beobachtet

I

Panelerhebung: Gleiche Einheiten werden an mehreren

Zeitpunkten befragt

Statistik IEinführung

Beispiel: PSID

Das PSID

PSID

16 / 40

I

Erste Welle in 1968

I

Bis 1997 jährlich, seither 2-jährlich (Kosten!)

I

4.800 Haushalte in 1986, mehr als 7.000 Haushalte in 2005

I

Anwachsen durch Weiterverfolgung bei Haushaltssplits

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

Urliste

21481 28130 81835 24550 15000 14321 12786 14321 35803

61376 7860 40917 1636 26902 25573 20636 15344 33245

33757 28130 30686 22095 13297 3000 8183 25573 14321

18002 26596 3000 20458 98625 38870 12275 61376 35803 ...

17 / 40

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

0.010

0.000

0.005

Dichte

0.015

0.020

Histogramm der Lohnverteilung 2005

0

1000

2000

3000

4000

Jahreslohn in 1000 US−Dollar

18 / 40

5000

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

40

Sektorale Durchschnittslöhne nach Geschlecht

Männer

19 / 40

Services

Bank/Insurance

Transport

Trade

Construction

Manufacturing

Agr./Energy/Min.

Missing

0

10

20

30

Frauen

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

0.010

0.000

0.005

Dichte

0.015

0.020

Ungleiche Klassenbreiten

0

25

50

75

100

125

Jahreslohn in 1000 US−Dollar

20 / 40

150

175

200

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

Maßzahlen: Lagemaße

21 / 40

I

Wie läßt sich das Lohnniveau mit einer Zahl beschreiben?

I

Modus: Welches Einkommen kommt am häufigsten vor?

I

Zentralwerte: Welches Einkommen liegt in der Mitte?

I

Durchschnitt: Welches Einkommen, wenn alle gleiches

Einkommen hätten?

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

Lagemaße

0.010

0.000

0.005

Dichte

0.015

0.020

Z X

0

25

50

75

100

125

Jahreslohn in 1000 US−Dollar

22 / 40

150

175

200

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

Maßzahlen: Streuungsmaße

23 / 40

I

Liegen die Daten dicht bei dem Lagemaß oder streuen sie

weit?

I

Spannweite: Wie breit ist das Intervall zwischen kleinstem

und größtem Wert?

I

Quartilsabstand: Wie breit ist das Intervall der mittleren

50%?

I

Standardabweichung: Wie ist die Wurzel der mittleren

quadrierten Abstände aller Einkommen vom Durchschnitt?

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

0.010

Intervall: 14.4 − 46.0

0.005

Dichte

0.015

0.020

Streuung: Quartilsabstand

0.000

50%

0

25

50

75

100

125

Jahreslohn in 1000 US−Dollar

24 / 40

150

175

200

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

Maßzahlen: Schiefe

25 / 40

I

Ist die Verteilung symmetrisch oder schief?

I

Liegt eine links- oder rechtsschiefe Verteilung vor?

I

überwiegen große Abweichungen nach oben oder nach

unten?

I

Rechtsschief bedeutet linkssteil und rechtsflach

Statistik IEinführung

Beispiel: PSID

Die Lohnverteilung

0.010

0.000

0.005

Dichte

0.015

0.020

Schiefe: rechtsschief, linkssteil und rechtsflach

0

25

50

75

100

125

Jahreslohn in 1000 US−Dollar

26 / 40

150

175

200

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Streuungszerlegung

27 / 40

I

Betrachtung von Gruppen/Klassen

I

Unterscheiden sich die Verteilungen (Lage, Streuung) der

Gruppen?

I

Welcher Teil der Gesamtstreuung läßt sich auf

Gruppenzugehörigkeit zurückführen?

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

0.010

Mittl. Eink. Frauen: 28 Tsd. $

Mittl. Eink. Männer: 51 Tsd. $

0.000

Dichte

0.020

Einkommensverteilungen nach Geschlecht

●

0

25

X

●

50

X

75

100

125

Jahreslohn in 1000 US−Dollar

28 / 40

150

175

200

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

0.02

0.03

Mittl. Std.lohn Frauen: 16 $

Mittl. Std.lohn Männer: 24 $

0.00

0.01

Dichte

0.04

0.05

Einkommensverteilungen nach Geschlecht

●

0

10

●

X 20 X

30

40

50

60

Stundenlohn in US−Dollar

29 / 40

70

80

90

100

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Beispiel: Geschlecht

30 / 40

I

Frauen verdienen weniger als Männer

I

Warum? Eigener Forschungszweig

I

Welcher Teil läßt sich durch ’Humankapitalvariablen’

erklären?

I

Welcher Teil ist reine Diskriminierung?

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Strukturvergleiche

I

Frauen und Männer weisen eine unterschiedliche Struktur

auf, bezüglich Iher

I

I

I

31 / 40

Tätigkeiten

Branchen

etc.

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Vergleichsmaßzahlen

32 / 40

I

Mit welchen Maßzahlen läßt sich der Strukturunterschied

zusammenfassend beschreiben?

I

Bsp: 0.5· Summe der absoluten Anteilsdifferenzen

I

Sagt aus, wieviel % der Frauen ihre Tätigkeit wechseln

müssen, damit ihre Beschäftigungsstruktur der der Männer

entspricht.

33 / 40

Services

Bank/Insurance

Transport

Trade

Construction

Manufacturing

Agr./Energy/Min.

Missing

0.0

0.1

0.2

0.3

0.4

0.5

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Sektorale Beschäftigungsstruktur

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Analytische Vergleiche

34 / 40

I

Woher kommt der Unterschied im Einkommensniveau?

I

Erhalten Frauen für gleiche Tätigkeiten/in denselben

Sektoren weniger?

I

Oder erhalten Frauen für gleiche Tätigkeiten das Gleiche,

aber üben Tätigkeiten mit geringerem Lohnniveau aus?

I

Wie groß wäre der Unterschied, wenn Frauen die gleiche

Tätigkeitsstruktur hätten?

I

Wie groß wäre der Unterschied, wenn Frauen je Tätigkeit den

gleichen Lohn erhielten?

35 / 40

Services

Bank/Insurance

Transport

Trade

Construction

Manufacturing

Agr./Energy/Min.

Missing

0.0

0.1

0.2

0.3

0.4

0.5

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Sektorstruktur nach Geschlecht

Männer

Frauen

36 / 40

Services

Bank/Insurance

Transport

Trade

Construction

Manufacturing

Agr./Energy/Min.

Missing

0

5

10

15

20

$ je Stunde

25

30

35

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Durchschnittslöhne in den Sektoren

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

40

Sektorale Durchschnittslöhne nach Geschlecht

Männer

37 / 40

Services

Bank/Insurance

Transport

Trade

Construction

Manufacturing

Agr./Energy/Min.

Missing

0

10

20

30

Frauen

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

Maßzahlen des Zusammenhangs

38 / 40

I

Wird in Sektoren mit hohem Frauenanteil mehr oder weniger

gezahlt?

I

Ausgangsbasis sind für die 10 Sektoren (Missing als eigener

Sektor) Wertepaare mit

I

Frauenanteil und durchnittlichen Stundenlöhnen

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

30

Frauenanteil und Durchschnittslöhne

● Construction

25

20

● Manufacturing

● Transport

● Services

● Agr./Energy/Min.

● Trade

15

Durschnittslohn

● Bank/Insurance

● Missing

0.0

0.2

0.4

0.6

Frauenanteil

39 / 40

0.8

1.0

Statistik IEinführung

Beispiel: PSID

Gruppenvergleiche

30

Frauenanteil und Durchschnittslöhne

● Construction

25

20

● Manufacturing

● Transport

● Services

● Agr./Energy/Min.

● Trade

15

Durschnittslohn

● Bank/Insurance

● Missing

0.0

0.2

0.4

0.6

Frauenanteil

40 / 40

0.8

1.0

Statistik I Daten und Variablen

Statistik I

Daten und Variablen

Prof. Dr. Andreas Behr

1 / 37

Statistik I Daten und Variablen

Inhaltsverzeichnis

Das Untersuchungsobjekt

Grundbegriffe

Die Operationalisierung

Untersuchungsmerkmale

Die Erhebung

Der Erhebungsplan

Erhebungstechniken

Notation

Merkmalsträger und Merkmale

Datenstruktur

Merkmalswerte und -ausprägungen

Datenquellen

Amtliche Statistik

Nicht-amtliche Statistik

Panel Study of Income Dynamics

2 / 37

Statistik I Daten und Variablen

Internet: www.stat.wiwi.uni-due.de/studium-lehre

3 / 37

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Grundbegriffe

Grundbegriffe

4 / 37

I

Erkenntnisprojekt (Was interessiert?)

I

Erhebungsobjekt (Wen befragen?)

I

Begriffsmerkmale (Wie erkennen?)

I

Untersuchungsmerkmale (Was fragen?)

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Grundbegriffe

Beispiel: Einkommenssituation

5 / 37

I

Erkenntnisprojekt: Einkommenssituation von Haushalten

I

Erhebungsobjekt: Haushalte

I

Begriffsmerkmale: Gemeinsame Wohnung, gemeinsames

Wirtschaften

I

Untersuchungsmerkmal: Haushaltsnettoeinkommen

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Die Operationalisierung

Der Idealtypus

I

Ausgangspunkt ist das Erkenntnisprojekt (z.B.

Wohnsituation von Studierenden)

I

Die Idee des Forschers bezieht sich zunächst auf einen

„Idealtypus“

I

I

6 / 37

Der „Idealtypus“ ist eine idealisierte, möglicherweise nicht

existierende Vorstellung

Der Idealtypus ist nicht „objektiv eindeutig“, nicht

„operational“

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Die Operationalisierung

Idealtypus und statistischer Begriff

I

Für eine praktische Erhebung ist der Idealtypus meist nicht

direkt verwendbar

I

Es muss ein „statistischer Begriff“ entwickelt werden

Der statistische Begriff soll

I

I

I

I

7 / 37

die Einheiten klar definieren

leicht erkennbare Kriterien verwenden

und evtl. eine leicht handhabbare Messvorschrift enthalten

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Die Operationalisierung

Begriffs- und Untersuchungsmerkmale

I

Beispiele: Erhebungsobjekt und Untersuchungsmerkmal

Grundgesamtheit

Private Haushalte

in Deutschland

am 1.1.2004

Handwerksbetriebe

in Münster, 1.1.2004

Studierende WiWi

Beginn WS 2008

8 / 37

Merkmal

Monatliches

Haushaltsnettoeinkommen

Anzahl der

Beschäftigten

Geschlecht

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Die Operationalisierung

Güte der Operationalisierung

9 / 37

I

Der statistische Begriff weicht vom Idealtypus ab

I

Die Entwicklung statistischer Begriffe wird als

Operationalisierung bezeichnet

I

Die Güte der Operationalisierung (auch Adäquation) ist für

das gesamte Erkenntnisprojekt entscheidend

I

Fehler in der Adäquation sind in der Auswertungsphase

nicht mehr zu reparieren

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Untersuchungsmerkmale

Merkmalsarten

Merkmalsuntergliederungen

I qualitative vs. quantitative Merkmale

I

I

häufbare vs. nichthäufbare Merkmale

I

I

Beispiele: Hobbys, 1. Wohnsitz

diskrete vs. stetige Merkmale

I

10 / 37

Beispiele: Geschlecht, Alter

Beispiele: Anzahl Artzbesuche, Behandlungsdauer

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Untersuchungsmerkmale

Skalierung

I

Nominalskala (unterscheidbar)

I

Ordinalskala (anordenbar)

Kardinalskala (messbar)

I

I

I

11 / 37

Intervallskala (kein abs. Nullpunkt)

Verhältnisskala (abs. Nullpunkt)

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Untersuchungsmerkmale

Nominalskala

12 / 37

I

Ein Merkmal ist nur nominal skalierbar, wenn lediglich die

Andersartigkeit festgestellt werden kann

I

Eine Rangfolge lässt sich nicht begründen

I

Für die Einheiten wird nur festgestellt, welche Ausprägung

vorliegt

I

Oftmals werden numerische Symbole (Zahlen) zur

Kennzeichnung der Ausprägungen benutzt

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Untersuchungsmerkmale

Ordinalskala

13 / 37

I

Ein Merkmal ist nur ordinal skalierbar, wenn die

Ausprägungen in eine Rangordnung gebracht werden

können

I

Die Abstände sind jedoch nicht sinnvoll quantifizierbar

I

Meist werden Zahlen zur Kennzeichnung der Ausprägungen

benutzt

I

Die Zahlen geben jedoch nur die Rangfolge an

Statistik I Daten und Variablen

Das Untersuchungsobjekt

Untersuchungsmerkmale

Kardinalskala: Intervall- und Verhältnisskala

14 / 37

I

Für intervallskalierte Merkmale lassen sich Abstände

quantifizieren, Verhältnisse der Ausprägungen machen

jedoch keinen Sinn

I

Für verhältnisskalierte Merkmale lassen sich sowohl

Differenzen als auch Verhältnisse sinnvoll interpretieren

I

Kardinalskalierte Merkmale werden auch als metrische

Merkmale bezeichnet

Statistik I Daten und Variablen

Die Erhebung

Der Erhebungsplan

Erhebungsplan

I

Festlegung des Verfahrens, Anweisungskatalog

I

Erhebungsgegenstand und die zugehörigen Messkonzepte

Statistischer Begriff: zu erfassende Masse und zu

erfassende Untersuchungsmerkmale

I

I

I

I

15 / 37

das Erhebungsgebiet

die Berichtsperiode bzw. der Berichtszeitpunkt

die anzuwendende Erhebungstechnik

Statistik I Daten und Variablen

Die Erhebung

Der Erhebungsplan

Erhebungseinheit

I

Oftmals ist Erhebungseinheit nicht mit der statistischen

Einheit identisch

I

I

I

16 / 37

Die Auskunftsstelle oder Auskunftsperson

Die Aufbereitungs- oder Darstellungseinheit

Die Auswahleinheit

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Erhebungstechniken

I

I

Verfahrenstechniken, die in einer konkreten Erhebung

kombiniert werden

Beobachtung falls

I

I

I

I

I

17 / 37

keine Alternative besteht (Verkehrszählung)

Beobachtung leichter, verlässlicher als Befragung (z.B

Saatenstandsbegutachtung)

die Beobachtung Kontrollfunktionen hat (statistische

Qualitätskontrolle)

technische Voraussetzungen für Befragung fehlen

„Beobachtung“ meint auch: die Auswertung von Dateien,

Karteien etc.

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Befragung

I

Vorteile der Befragung von Auskunftspersonen:

I

I

I

Nachteile der Befragung:

I

I

I

Auskunft eventuell nicht wahrheitsgemäß (vorsätzlich oder

irrtümlich)

Schriftliche Befragung, Erhebungsbogen

Güte des Fragebogens entscheidet über Güte der Ergebnisse

I

I

18 / 37

Wissen von Auskunftspersonen nutzen

Erfragung „subjektiver“ Phänomene (Einstellungen,

Erwartungen)

Allgemeinverständlichkeit

Klarheit und Einfachheit

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Befragung

I

Arten von Fragen

I

I

I

Wegen Eindeutigkeit und leichterer Eingabe/Auswertung

dominieren geschlossene Fragen

I

Mündliche Befragung (Interview)

Vorteil des Interviews

I

I

I

I

19 / 37

geschlossene Fragen: Ankreuzen

offene Fragen: Formulierung der Antwort

Hilfestellung bei Beantwortung

Überprüfung der Antworten auf Plausibilität

Nachteile: hohe Kosten, schwierige Auswertung

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Primärstatistische und sekundärstatistische

Erhebung

I

Primärstatistisch: Erhebung von Daten eigens für

Erkenntnisprojekt

I

I

I

Sekundärstatistisch: Auswertung von vorliegenden Daten

I

I

20 / 37

Vorteil: Fragen genau auf Erkenntnisprojekt ausgerichtet

Nachteil: Teuer und zeitaufwendig

Vorteil: Oft professionelles Erhebungspersonal, hohe

Datenqualität

Nachteil: Interessierende Merkmale nicht oder nicht in der

gewünschten Weise erfasst

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Vollerhebung (Totalerhebung) und Teilerhebung

Vollerhebung (Totalerhebung)

21 / 37

I

Alle Einheiten der statistischen Masse werden befragt

I

Vorteil: Alle Details, Untersuchung der Feinstruktur

I

Nachteil: Teuer, zeitaufwendig, begrenztes Frageprogramm

I

Daher fast nur Teilerhebungen: schneller, billiger,

schwierigere Fragen möglich

I

Problem: eventuell keine Feinstruktur, Auswahlgrundlage

nötig

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Vollerhebung (Totalerhebung) und Teilerhebung

Teilerhebung (Stichprobe)

22 / 37

I

anstelle einer Vollerhebung: schneller und billiger

I

zusätzlich: Erhebung „komplizierter“ Sachverhalte

I

zusätzlich: Kontrolle der Vollerhebung

I

aus dem Erhebungsmaterial einer Totalerhebung

I

wenn sich eine Vollerhebung verbietet: „zerstörende

Qualitätskontrolle“ (Crashtest)

I

wenn eine Vollerhebung unmöglich ist: „unendliche

Grundgesamtheit“, z.B. laufende Produktion

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Teilerhebung

I

I

23 / 37

Erhebung von Teilmasse, aber Urteile über die

Gesamtmasse

Teilmasse soll Gesamtmasse repräsentieren, aber was heißt

„repräsentativ“?

I

Repräsentativität bezüglich aller Merkmale?

I

Repräsentativität nur bezüglich ausgewählter Merkmale?

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Auswahlverfahren

Zwei prinzipielle Möglichkeiten:

I Echte Zufallsstichproben (Stichproben)

I

I

I

Nicht-zufällige Auswahlverfahren

I

I

I

24 / 37

Auswahl mit Hilfe eines Zufallsgenerators

Möglichkeit von Wahrscheinlichkeitsaussagen

Z.B. Auswahl typischer Fälle

Quotenverfahren

Keine Wahrscheinlichkeitsaussagen möglich

Statistik I Daten und Variablen

Die Erhebung

Erhebungstechniken

Datenqualität

I

Erhobene Daten weisen in der Praxis oft gravierende Mängel

auf

I

I

I

I

25 / 37

Non-Response: Antwortverweigerung

Item-Non-Response: Antwortverweigerung bei bestimmten

Fragen

Falsche Angaben (unabsichtlich, absichtlich)

Rundungen

Statistik I Daten und Variablen

Notation

Merkmalsträger und Merkmale

Einheiten und Merkmale

I

I

I

I

I

I

Grundgesamtheit G = {e1 , . . . , en }

Umfang der Grundgesamtheit n = |G |

Bestandsmasse (Angabe zu Zeitpunkt)

Bewegungsmasse (Angabe zu Zeitraum)

Merkmalsträger (e1 , . . . , en )

Daten: beobachtete Werte eines Merkmals (oder mehrerer

Merkmale)

Notation bei einem Merkmal X :

x1 , . . . , xn

I

Notation bei zwei Merkmalen X und Y :

(x1 , y1 ), . . . , (xn , yn )

26 / 37

Statistik I Daten und Variablen

Notation

Datenstruktur

Datenmatrix

27 / 37

I

Daten werden meist als Matrix gespeichert

I

Bei einem Eintrag xij bezeichnet i die Einheit (Zeile) und j

das Merkmal (Spalte)

I

Werden z.B. bei n = 4 Einheiten jeweils die Ausprägungen

von m = 3 Merkmalen X1 , X2 , X3 erhoben, ergibt sich

folgende Datenmatrix der Dimension 4 × 3

⎡

⎤

⎢⎢ x1,1 x1,2 x1,3 ⎥⎥

⎢⎢⎢ x2,1 x2,2 x2,3 ⎥⎥⎥

⎢⎢

⎥⎥

⎢⎢ x

⎥

⎢⎢ 3,1 x3,2 x3,3 ⎥⎥⎥

⎣

⎦

x4,1 x4,2 x4,3

Statistik I Daten und Variablen

Notation

Merkmalswerte und -ausprägungen

Merkmale, Werte, Ausprägungen

28 / 37

I

Merkmal (X , Y etc.)

I

Merkmalswerte (x1 , x2 , ...)

I

Merkmalsausprägungen (x̃1 , x̃2 , ...)

Statistik I Daten und Variablen

Notation

Merkmalswerte und -ausprägungen

Ausprägungen und Häufigkeiten

Ein Beispiel:

29 / 37

I

n = 3, x1 = 1, x2 = 4, x3 = 4

I

J = 2, x̃1 = 1, x̃2 = 4

I

Die Verwendung von Ausprägungen x̃j und Häufigkeiten nj

ist oftmals ökonomischer

I

Statt x1 = 1, x2 = 1, ..., x10 = 1

I

Nun x̃1 = 1, n1 = 10

Statistik I Daten und Variablen

Notation

Merkmalswerte und -ausprägungen

Klassierung

I

Oft werden Merkmalswerte zu Klassen (Intervallen)

zusammengefasst

I

I

30 / 37

Klassengrenzen und Häufigkeiten [xju ; xjo [, nj

Häufigkeitsverteilung gibt dann für jede Klasse die Häufigkeit

an

I

Die Klassierung erlaubt die übersichtliche Darstellung

großer Datenmengen

I

Mit der Klassierung geht meist ein erheblicher

Informationsverlust einher

Statistik I Daten und Variablen

Datenquellen

Amtliche Statistik

Datenquellen der amtlichen Statistik:

31 / 37

I

Statistisches Bundesamt

I

Statistische Landesämter

I

EUROSTAT

I

Deutsche Bundesbank

I

Bundesagentur für Arbeit

I

Bundesanstalt für Finanzdienstleistungsaufsicht

I

Kraftfahrtbundesamt

I

etc.

Statistik I Daten und Variablen

Datenquellen

Nicht-amtliche Statistik

Datenquellen der nicht-amtlichen Statistik:

32 / 37

I

Wirtschaftswissenschaftliche Institute (IfW Kiel, DIW, HWWA,

ifo, RWI, IWH)

I

Wirtschaftsforschungsinstitute von Interessenverbänden

I

halbamtliche Institutionen (Sachverständigenrat,

Monopolkommission)

Statistik I Daten und Variablen

Datenquellen

Panel Study of Income Dynamics

PSID

I

Panel Study of Income Dynamics

I

Querschnitt: Einheiten werden zu einem Zeitpunkt befragt

I

Zeitreihe (Längsschnitt): Ein Merkmal wird an mehreren

Zeitpunkten beobachtet

I

Panelerhebung: Gleiche Einheiten werden an mehreren

Zeitpunkten befragt

I

Vorteil von Panelerhebungen: Verläufe werden sichtbar

I

Bekanntes Beispiel

2 Querschnitte in t = 0 und t = 1, Arbeitslosenquote je 10%

Beachte: 2 völlig verschiedene Sachverhalte möglich!

- gleiche Personen in t = 0 und t = 1 arbeitslos

- komplett andere Personen in t = 0 und t = 1 arbeitslos

33 / 37

Statistik I Daten und Variablen

Datenquellen

Panel Study of Income Dynamics

PSID

34 / 37

I

Erste Welle in 1968

I

Bis 1997 jährlich, seither 2-jährlich (Kosten!)

I

4.800 Haushalte in 1986, 7.000 Haushalte in 2001

I

Insgesamt 65.000 Personen in bis zu 37 Jahren

I

Insgesamt mehrere hundert Variable

I

Änderungen im Frageprogramm, der Codierung, etc.

I

PSID-Daten sind relativ schwer zu handhaben

Statistik I Daten und Variablen

Datenquellen

Panel Study of Income Dynamics

PSID-CNEF

35 / 37

I

CNEF: Cross National Equivalent Files

I

Forschergruppe, die Daten verschiedener nationaler

Erhebungen vergleichbar macht

I

ähnliche Panelerhebungen in anderen Ländern:

I

Deutschland: SOEP (Sozioökonomisches Panel)

I

UK: BHPS (British Household Panel Study)

I

Canada: SLID (Survey of Labour and Income Dynamics)

Statistik I Daten und Variablen

Datenquellen

Panel Study of Income Dynamics

PSID-CNEF

36 / 37

I

Bereitstellung von harmonisierten Datensätzen

I

Ziel ist die Möglichkeit vergleichender Analysen

I

Wenige aber vereinheitlichte Variablen

I

CNEF-File mit PSID Daten leichter zu handhaben

I

Wir nutzen die PSID-CNEF-Daten 2005 (Querschnitt)

I

2005 ist letzte verfügbare Welle

I

Wenige ausgewählte Variablen

Statistik I Daten und Variablen

Datenquellen

Panel Study of Income Dynamics

Variablen

I

Variablen (I)

I

I

I

I

I

I

Variablen (II)

I

I

I

I

37 / 37

pid: Personennummer

age: Alter

sex: Geschlecht

edu: Bildungskategorien (3)

eduyears: Ausbildungsjahre

wage: Jahreseinkommen

hours: Jahresarbeitsstunden

occupa: Tätigkeit/Beruf

sector: Branche/Wirtschaftszweig

Statistik I Auswertung eindimensionaler Daten

Statistik I

Auswertung eindimensionaler Daten

Prof. Dr. Andreas Behr

1 / 33

Statistik I Auswertung eindimensionaler Daten

Inhaltsverzeichnis

Häufigkeiten

Absolute und relative Häufigkeiten

Häufigkeitstabelle

Grafische Darstellung

Empirische Verteilungsfunktion

Definition

Eigenschaften

Beispiel

Quantile

Definition

Ermittlung von Quantilen

PSID

2 / 33

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Absolute und relative Häufigkeiten

Eindimensionale Daten

I

Ausgangssituation: Grundgesamtheit G vom Umfang n

I

Nur ein Merkmal X wird betrachtet

I

Urliste: x1 , . . . , xn

Zahlenbeispiel I:

x = {2, 4, 5, 2, 1, 4, 3, 5, 5, 1, 2, 3, 2, 3, 2, 2, 2, 5, 3, 5}

n = 20

I

3 / 33

Problem: Wie kann man die Informationen kompakt und

übersichtlich darstellen?

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Absolute und relative Häufigkeiten

Definition von Häufigkeiten

I

Anzahl unterschiedlicher Merkmalsausprägungen: J

I

Merkmalsausprägungen: x̃1 , x̃2 , . . . , x̃J

I

Absolute Häufigkeit von x̃j

nj = Anzahl der Daten mit Merkmalsausprägung x̃j

I

Relative Häufigkeit von x̃j

fj =

4 / 33

nj

= Anteil der Daten mit Merkmalsausprägung x̃j

n

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Absolute und relative Häufigkeiten

Definition von Häufigkeiten

I

Es gilt

J

∑︀

j =1

I

nj = n und

J

∑︀

fj = 1

j =1

Diskrete Klassierung (oder: Häufigkeitsverteilung)

(x̃1 , n1 ), (x̃2 , n2 ), . . . , (x̃J , nJ )

bzw.

(x̃1 , f1 ), (x̃2 , f2 ), . . . , (x̃J , fJ ).

5 / 33

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Häufigkeitstabelle

Häufigkeitstabelle

Darstellung in Form einer Häufigkeitstabelle:

6 / 33

x̃j

x̃1

x̃2

..

.

nj

n1

n2

..

.

fj = nj /n

f1

f2

..

.

x̃J

nJ

n

fJ

1

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Häufigkeitstabelle

Häufigkeitstabelle

Unser Zahlenbeispiel I:

x̃j

x̃1 = 1

x̃2 = 2

x̃3 = 3

x̃4 = 4

x̃5 = 5

7 / 33

nj

n1 = 2

n2 = 7

n3 = 4

n4 = 2

n5 = 5

n = 20

fj = nj /n

f1 = 0.1

f2 = 0.35

f3 = 0.2

f4 = 0.1

f5 = 0.25

Σ=1

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Häufigkeitstabelle

Grafische Darstellung der Häufigkeitstabelle:

Häufigkeitsfunktion

4

0

1

2

3

f(x)

5

6

7

8

Häufigkeitsfunktion

0

1

2

3

x

8 / 33

4

5

6

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Häufigkeitstabelle

Beispiel II:

I

Grundgesamtheit: 20 Beschäftigte eines Betriebs

I

Merkmal: Verkehrsmittel für den Arbeitsweg

I

Merkmalsausprägungen:

x̃1 = 1 (öPNV)

x̃2 = 2 (PKW)

x̃3 = 3 (Motorrad)

x̃4 = 4 (Fahrrad)

x̃5 = 5 (zu Fuß)

9 / 33

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Häufigkeitstabelle

Beispiel II:

I

Urliste:

1, 1, 2, 2, 2, 4, 3, 5, 2, 2, 5, 2, 4, 1, 1, 2, 2, 1, 2, 1

I

Häufigkeitstabelle

x̃j

(1) öPNV

(2) PKW

(3) Motorrad

(4) Fahrrad

(5) zu Fuß

10 / 33

nj

6

9

1

2

2

20

fj

0.30

0.45

0.05

0.10

0.10

1.00

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

6

4

0

2

Häufigkeiten nj

8

10

Stabdiagramm

ÖPNV

PKW

Motorrad

Verkehrsmittel

11 / 33

Fahrrad

zu Fuß

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

Balkendiagramm

zu Fuß

Fahrrad

Motorrad

PKW

ÖPNV

0

2

4

6

Häufigkeiten nj

12 / 33

8

10

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

Tortendiagramm (Pie)

Schön bunt, nicht sehr informativ ...

ÖPNV

PKW

zu Fuß

Fahrrad

Motorrad

13 / 33

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

Manipulation von Grafiken

I

Grafiken können auf viele Arten manipuliert werden

I

Manipulation muss nicht immer schlecht sein

Typische Fälle:

I

I

I

I

14 / 33

Verzerren der Achsen

Skalierung der y-Achse

Irreführende Flächen

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

Beispiel: Original y-Achse

Müll (kg) je Einwohner

0

100 200 300 400 500 600 700

Höhe (u. Fläche) proportional zu Verbrauch

Japan

EU

Land

15 / 33

USA

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

Beispiel: Verzerrende y-Achse

600

500

400

300

Müll (kg) je Einwohner

700

Achsenmanipulation

Japan

EU

Land

16 / 33

USA

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

Beispiel: Verzerrende Fläche

Müll (kg) je Einwohner

0

100 200 300 400 500 600 700

Fläche überproportional zu Verbrauch

Japan

EU

USA

Land

17 / 33

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

10

Beispiel: Orignal x-Achse

●

9

●

8

●

7

●

Y

6

●

5

●

4

●

3

●

1

2

●

●

2001

2002

2003

2004

2005

2006

Jahr

18 / 33

2007

2008

2009

2010

Statistik I Auswertung eindimensionaler Daten

Häufigkeiten

Grafische Darstellung

10

Beispiel: Verzerren der x-Achse

9

●

7

8

●

Y

6

●

5

●

4

●

3

●

1

2

●

●

2001

2002

2003

2004

2005

Jahr

19 / 33

2006

2008

2010

Statistik I Auswertung eindimensionaler Daten

Empirische Verteilungsfunktion

Definition

Empirische Verteilungsfunktion

I

Die Merkmale müssen mindestens ordinal skaliert sein

F (x) = Anteil der Daten mit Merkmalswert ≤ x

=

=

|{i |xi ≤ x}|

n

∑︁

fr

{r|x̃r ≤x}

20 / 33

I

Sprungstellen: Die Werte, die vorkommen

I

Sprunghöhen: Relative Häufigkeiten

Statistik I Auswertung eindimensionaler Daten

Empirische Verteilungsfunktion

Eigenschaften

Eigenschaften der empirischen Verteilungsfunktion:

21 / 33

I

Definitionsbereich R, Wertebereich [0; 1]

I

limx→−∞ F (x) = 0 und limx→∞ F (x) = 1

I

Monoton steigend

I

Rechtsstetig, d.h. limx↓x0 F (x) = F (x0 )

Statistik I Auswertung eindimensionaler Daten

Empirische Verteilungsfunktion

Beispiel

Nochmal Beispiel I: Häufigkeitstabelle

I

x = {2, 4, 5, 2, 1, 4, 3, 5, 5, 1, 2, 3, 2, 3, 2, 2, 2, 5, 3, 5}

x̃j

x̃1 = 1

x̃2 = 2

x̃3 = 3

x̃4 = 4

x̃5 = 5

22 / 33

nj

n1 = 2

n2 = 7

n3 = 4

n4 = 2

n5 = 5

n = 20

fj = nj /n

f1 = 0.1

f2 = 0.35

f3 = 0.2

f4 = 0.1

f5 = 0.25

Σ=1

Fj

F1 = 0.10

F2 = 0.45

F3 = 0.65

F4 = 0.75

F5 = 1.00

Statistik I Auswertung eindimensionaler Daten

Empirische Verteilungsfunktion

Beispiel

Darstellung der empirischen Verteilungsfunktion:

1.0

Verteilungsfunktion

0.6

F(x)

●

●

●

0.2

0.4

0.3

0.2

0.1

f(x)

●

0.8

0.4

Häufigkeitsfunktion

0.0

0.0

●

0

1

2

3

x

23 / 33

4

5

6

0

1

2

3

x

4

5

6

Statistik I Auswertung eindimensionaler Daten

Quantile

Definition

Quantile

I

Definition:

x̃p

= min{x|F (x) ≥ p}

x∈R

= kleinster Wert x ∈ R mit der

Eigenschaft, dass F (x) ≥ p

heißt p-Quantil (oder p · 100%-Punkt)

I

24 / 33

Bestimmung aus der empirischen Verteilungsfunktion oder

aus der (geordneten) Urliste

Statistik I Auswertung eindimensionaler Daten

Quantile

Definition

Spezielle Quantile:

Median (Zentralwert)

Quartile

Quintile

Dezile

25 / 33

x̃0.5

x̃0.25 ,

x̃0.2 ,

x̃0.1 ,

x̃0.5 ,

x̃0.4 ,

x̃0.2 ,

x̃0.75

x̃0.6 ,

...,

x̃0.8

x̃0.9

Statistik I Auswertung eindimensionaler Daten

Quantile

Ermittlung von Quantilen

Quantile

I

Urliste:

Mit jedem Wert steigt F (x) um 1/n

Wandere so weit in der Urliste, bis F (x) ≥ p

I

Das p-Quantil ist

{︃

xnp ,

falls np ganzzahlig

x̃p =

x[np ]+1 , sonst

wobei [np] der ganzzahlige Anteil von np ist.

26 / 33

Statistik I Auswertung eindimensionaler Daten

Quantile

Ermittlung von Quantilen

Beispiel III: Bestimmung über die Urliste

I

Bestimme x̃0.1 , und x̃0.72 aus der (geordneten) Urliste

{1, 1, 2, 2, 2, 2, 2, 2, 2, 3, 3, 3, 3, 4, 4, 5, 5, 5, 5, 5}

I

Ganzzahlige Werte np

x̃0.1 = x0.1·20 = x2 = 1

I

Nicht ganzzahliger Wert np

x̃0.72 = x[0.72·20]+1 = x[14.4]+1 = x15 = 4

27 / 33

Statistik I Auswertung eindimensionaler Daten

Quantile

Ermittlung von Quantilen

Beispiel III: Bestimmung über F(x)

1.0

Verteilungsfunktion, n=20

●

0.6

●

0.4

●

0.2

F(x)

0.8

●

0.0

●

0

1

2

3

x

28 / 33

4

5

6

Statistik I Auswertung eindimensionaler Daten

Quantile

Ermittlung von Quantilen

Beispiel IV:

29 / 33

I

Grundgesamtheit: 20 Studentinnen, die an einer Klausur

teilnehmen

I

Merkmal: Note (1, 2, 3, 4 oder 5)

I

Urliste: 4, 3, 4, 5, 3, 2, 1, 2, 3, 3, 4, 5, 4, 4, 2, 3, 1, 3, 3, 5

I

Bestimme x̃0.5 , x̃0.85 und x̃0.99 .

Statistik I Auswertung eindimensionaler Daten

Quantile

Ermittlung von Quantilen

Beispiel IV: Bestimmung über die Urliste

I

Bestimme x̃0.5 , x̃0.85 und x̃0.99 aus der (geordneten) Urliste

1, 1, 2, 2, 2, 3, 3, 3, 3, 3, 3, 3, 4, 4, 4, 4, 4, 5, 5, 5

I

Ganzzahlige Werte np

x̃0.5 = x0.5·20 = x10 = 3

x̃0.85 = x0.85·20 = x17 = 4

I

Nicht ganzzahliger Wert np

x̃0.99 = x[0.99·20]+1 = x[19.8]+1 = x20 = 5

30 / 33

Statistik I Auswertung eindimensionaler Daten

Quantile

Ermittlung von Quantilen

Beispiel IV: Bestimmung über F(x)

1.0

Verteilungsfunktion

●

0.6

0.8

●

0.4

F(x)

●

0.2

●

0.0

●

0

1

2

3

x

31 / 33

4

5

6

Statistik I Auswertung eindimensionaler Daten

Quantile

PSID

PSID, Häufigkeitsfunktion

250

Häufigkeitsfunktion, n=10023

150

0

50

100

f(x)

200

0.25−Quantil (14 Tsd. US $)

0.50−Quantil (28 Tsd. US $)

0.75−Quantil (45 Tsd. US $)

0

50

100

Einkommen, 1000 US$

32 / 33

150

200

Statistik I Auswertung eindimensionaler Daten

Quantile

PSID

PSID, Verteilungsfunktion

0.6

0.4

0.25−Quantil (14 Tsd. US $)

0.50−Quantil (28 Tsd. US $)

0.75−Quantil (45 Tsd. US $)

0.0

0.2

F(x)

0.8

1.0

Verteilungsfunktion, n=10023

0

50

100

Einkommen, 1000 US$

33 / 33

150

200

Statistik I Maßzahlen

Statistik I

Maßzahlen

Prof. Dr. Andreas Behr

1 / 32

Statistik I Maßzahlen

Inhaltsverzeichnis

Einleitung

Maßzahlen

Lagemaße

Streuungsmaße

Schiefemaße

Wölbungsmaße

2 / 32

Statistik I Maßzahlen

Einleitung

Maßzahlen

3 / 32

I

Maßzahlen zur Beschreibung von Häufigkeitsverteilungen

(HV)

I

Ziel ist, wesentliche Charakteristika der HV mit wenigen

Maßzahlen zu beschreiben

I

Durch Kenntnis wichtiger Maßzahlen, entsteht eine

Vorstellung der HV

I

Nicht alle Maßzahlen sind für alle Häufigkeitsverteilungen

gleichermaßen geeignet

Statistik I Maßzahlen

Einleitung

PSID: Jahreseinkommen 2007

0.010

0.000

0.005

Dichte

0.015

0.020

Ungleiche Klassenbreiten

0

4 / 32

25

50

75

100

125

Jahreslohn in 1000 US−Dollar

150

175

200

Statistik I Maßzahlen

Einleitung

Behandelte Maßzahlen

5 / 32

I

Lagemaße

I

Streuungsmaße

I

Schiefemaße

I

Wölbungsmaße

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Niveaucharakterisierende Maßzahlen

6 / 32

I

Lagemaße sind Maßzahlen, die ausdrücken „wo“ die Daten

sich befinden

I

Je nach Skalenniveau sind unterschiedliche Lagemaße

sinnvoll anwendbar

I

Je nach Fragestellung sind unterschiedliche Lagemaße

aussagekräftiger

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Behandelte Lagemaße

1. Modus (häufigster Wert)

2. Median (0.5-Quantil)

3. Arithmetisches Mittel, (Durchschnitt)

4. Harmonisches Mittel

5. Geometrisches Mittel

7 / 32

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Modus

I

Auch bei nominalen und ordinalen Merkmalen anwendbar

I

Am häufigsten vorkommender Wert

I

8 / 32

Bei metrischen Merkmalen oft keine Werte mehrfach, dann

„Verdichtungsstelle“

I

Sehr anschauliches Lagemaß

I

Nur bei unimodalen (eingipfligen) Verteilungen

aussagekräftig

I

Unempfindlich gegenüber Ausreißern

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Modus: Beispiel

I

Urliste

1, 1, 2, 2, 2, 3, 3, 3, 3, 3, 3, 3, 4, 4, 4, 4, 4, 5, 5, 5

I

Häufigkeitstabelle

x̃j

1

2

3

4

5

9 / 32

nj

2

3

7

5

3

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Median (Zentralwert)

10 / 32

I

Das 0.5-Quantil bereits betrachtet: x̃0.5

I

Sehr anschauliches Maß :

50% der Werte sind kleiner(gleich),

50% der Werte sind größer

I

Wert, der die Fläche einer Verteilung halbiert

I

Sehr robust gegenüber Ausreißern

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Arithmetisches Mittel (Durchschnitt)

11 / 32

I

Gebräuchlichster Mittelwert

I

Aber auch unanschaulichster Wert

I

Muss als Wert selbst gar nicht vorkommen

I

Sehr empfindlich gegenüber Ausreißern

I

Popularität ist durch die Verwendung der Normalverteilung

in der Stochastik begründet

I

Für deskriptive Zwecke sind oft andere Lagemaße besser

geeignet

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Ungewichtetes/gewichtetes arithmetisches Mittel

I

Ungewichtetes arithmetisches Mittel

n

x̄ =

1 ∑︁

xi

n

i =1

I

Gewichtetes arithmetisches Mittel:

Entweder mit absoluten oder mit relativen Häufigkeiten

J

J

j =1

j =1

∑︁

1 ∑︁

x̄ =

x̃j nj =

x̃j fj

n

12 / 32

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Arithmetisches Mittel: 1. Beispiel

I

Grundgesamtheit: n = 5 Angestellte in

einem Betrieb

I

Merkmal X : Bruttomonatsgehalt

I

Durchschnittliches Bruttomonatsgehalt:

i

1

2

3

4

5

xi

2258

2343

2218

1703

3444

x̄ = (2258 + 2343 + 2218 + 1703 + 3444) /5 = 2393.20

13 / 32

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Arithmetisches Mittel: 2. Beispiel

I

Grundgesamtheit: n = 520 Haushalte

eines Vororts

I

Merkmal X : Anzahl der

Haushaltsmitglieder

I

Durchschnittliche Haushaltsgröße

x̄ =

14 / 32

x̃j

1

2

3

4

5

6

nj

188

173

79

56

20

4

520

1

(1 · 188 + 2 · 173 + . . . + 6 · 4) = 2.1519

520

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Harmonisches Mittel

I

I

I

Oft als Rechenprogramm für das gewichtete arithmetische

Mittel

Reziprokes arithmetisches Mittel der reziproken

Merkmalswerte

ungewichtet

⎞−1

⎛ n

⎟⎟

⎜⎜ 1 ∑︁

1

xi−1 ⎟⎟⎟⎠ = 1 ∑︀n 1

x̄H = ⎜⎜⎜⎝

n

i =1 x

n

i =1

I

i

gewichtet

⎞−1

⎛ ∑︀J

∑︀J

nj

⎜⎜ j =1 x̃j−1 · nj ⎟⎟⎟

⎜

⎟⎟ = ∑︀ j =1

x̄H = ⎜⎝ ∑︀J

⎠

J

1

j =1 n j

j =1 x̃ · nj

j

15 / 32

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Harmonisches Mittel: Beispiel

I

I

Ein Fahrzeug fährt 200 km mit 100 km/Std. und 300 km mit

150 km/Std. Mit welcher mittleren Geschwindigkeit ist es

gefahren?

Berechnung über arithmetisches Mittel:

I

I

Erst Stunden als Gewichte berechnen:

2 Std. mit 100 km/Std. und 2 Std. mit 150 km/Std.

dann gewichtet arithmetisch mitteln

x̄ =

16 / 32

km

km

2Std . · 100 Std

500 km

km

. + 2Std . · 150 Std .

=

= 125

4Std .

4 Std

Std

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Harmonisches Mittel: Beispiel (Forts.)

I

Berechnung direkt mit harmonischem Mittel:

I

200 km mit 100 km/Std. und 300 km mit 150 km/Std.

=

x̄H

=

I

· 200km +

1

km

150 Std

.

· 300km

500 km

km

= 125

4 Std

Std

Achtung: Falsch wäre

x̄

,

=

17 / 32

200km + 300km

1

km

100 Std

.

km

km

200km · 100 Std

. + 300km · 150 Std .

500km

650 km 2 /Std .

km

= 130

5

km

Std

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Geometrisches Mittel

I

Verwendung in einer „multiplikativen Welt“

I

ungewichtet

⎛ n ⎞ n1

⎜⎜∏︁ ⎟⎟

√

x̄G = ⎜⎜⎜⎝

xi ⎟⎟⎟⎠ = n x1 · x2 · . . . · xn

i =1

I

gewichtet

⎞1

⎛

J

⎟ n √︁

⎜⎜∏︁

n⎟

n

n

n

⎟

⎜

x̄G = ⎜⎜⎜

x̃j j ⎟⎟⎟ = n x̃1 1 · x̃2 2 · . . . · x̃J J

⎠

⎝

j =1

18 / 32

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Geometrisches Mittel: Beispiel

I

Bsp. Portfolioveränderung in 2007 10% und in 2008 −20%

I

Wie hoch war die mittlere Veränderung in beiden Jahren?

I

Ungewichtetes geometrisches Mittel

I

Beachte: Es muß mit Vervielfachungskoeffizienten gerechnet

werden

I

Wachstum von 10% heißt

I

1.1 ist der Vervielfachungskoeffizient

I

Wert2007

Wert2006

I

Wert2007

Wert2006

= 1.1

− 1 = 0.1 ist die Wachstumsrate

(︁

)︁

2007

üblich Wachstumsrate in Prozent: Wert

−

1

· 100 = 10%

Wert

2006

19 / 32

Statistik I Maßzahlen

Maßzahlen

Lagemaße

Geometrisches Mittel: Beispiel (Forts.)

I

Also:

⎛ n ⎞ n1

√

⎜⎜∏︁ ⎟⎟

x̄G = ⎜⎜⎜⎝

xi ⎟⎟⎟⎠ = 1.1 · 0.8 = 0.938 08

i =1

20 / 32

I

Mittlerer Vervielfachungskoeffizient ist also 0.938 08

I

D.h. die Wachstumsrate betrug 0.938 08 − 1 = −0.061 92

bzw. −6.19 %

Statistik I Maßzahlen

Maßzahlen

Streuungsmaße

Maßzahlen der Streuung

I

Streuungsmaße sind Maßzahlen, die ausdrücken „wie stark“

die Daten streuen (um ein Lagemaß herum)

0.8

0.6

0.4

0.0

0.0

−3

−2

−1

0

x

21 / 32

σ = 0.5

0.2

0.4

Dichte

0.6

σ=1

0.2

Dichte

0.8

1.0

Kleine Streuung

1.0

Große Streuung

1

2

3

−3

−2

−1

0

x

1

2

3

Statistik I Maßzahlen

Maßzahlen

Streuungsmaße

Behandelte Streuungsmaße

1. Standardabweichung, Varianz

2. Mittlere absolute Abweichung

3. Quartilsabstand

4. Spannweite

22 / 32

Statistik I Maßzahlen

Maßzahlen

Streuungsmaße

Varianz und Standardabweichung

I

Varianz (Streuung)

n

s2 =

1 ∑︁

(xi − x̄)2

n

i =1

I

Standardabweichung

√

s = s2 =

⎯

⎷

n

1 ∑︁

(xi − x̄)2

n

i =1

23 / 32

Statistik I Maßzahlen

Maßzahlen

Streuungsmaße

Eigenschaften von Varianz und Standardabweichung

24 / 32

I

Beide Maße sind extrem empfindlich gegenüber Ausreißern

I

Popularität ist durch die Verwendung der Normalverteilung

in der Stochastik begründet

I

Für deskriptive Zwecke sind oft andere Streuungsmaße

besser geeignet

Statistik I Maßzahlen

Maßzahlen

Streuungsmaße

Mittlere absolute Abweichung

I

Mittlere absolute Abweichung

n

d=

1 ∑︁

|xi − x̃0.5 |

n

i =1

25 / 32

I

Die mittlere absolute Abweichung ist das zum Zentralwert

korrespondierende Streuungsmaß

I

Gelegentlich wird auch die mittlere absolute Abweichung

vom arithmetischen Mittel betrachtet

I

Die mittlere abs. Abw. ist anschaulicher als die

Standardabweichung und deutlich unempfindlicher

gegenüber Ausreißern

Statistik I Maßzahlen

Maßzahlen

Streuungsmaße

Quartilsabstand

I

Quartilabstand

Q = x̃0.75 − x̃0.25

26 / 32

I

Der Quartilsabstand ist sehr anschaulich und unempfindlich

gegenüber Ausreißern

I

Er gibt die Länge des Intervalls an, in dem die mittleren 50%

der Daten liegen

I

Die Werte im ersten und vierten Quartil bleiben völlig

unberücksichtigt

I

Alternativ werden auch andere Quantile (z.B. 10 und 90%)

betrachtet

Statistik I Maßzahlen

Maßzahlen

Streuungsmaße

Spannweite

I

Spannweite

R = max xi − min xi

i

27 / 32

i

I

Die Spannweite gibt die Länge des Intervalls an, indem alle

Daten liegen

I

Die Spannweite ist ein sehr anschauliches Maß

I

Da sie vollständig von kleinstem und größtem Merkmalswert

bestimmt wird, ist sie extrem reagibel gegenüber Ausreißern

Statistik I Maßzahlen

Maßzahlen

Schiefemaße

Schiefe: Grafische Darstellung

I

I

Rechtsschief (=linkssteil), wenn g > 0

Linksschief (=rechtssteil), wenn g < 0

0.5

0.4

0.3

0.1

0.0

0.1

0.0

−3

−2

−1

0

x

28 / 32

g = 0.57

0.2

0.3

Dichte

g = −0.64

0.2

Dichte

0.4

0.5

0.6

Rechtsschief

0.6

Linksschief

1

2

3

−3

−2

−1

0

x

1

2

3

Statistik I Maßzahlen

Maßzahlen

Schiefemaße

Maßzahlen der Schiefe

I

I

I

Kennzahl für die Symmetrie einer Häufigkeitsverteilung

Verhältnis von drittem Zentralmoment zur 3. Potenz der

Standardabweichung

𝜇3

g= 3

s

Allgemein: k − tes Zentralmoment

n

𝜇k =

1 ∑︁

(xi − x̄)k

n

i =1

I

Schiefe

n (︂

)︂

1 ∑︁ xi − x̄ 3

g=

=

n

s

i =1

29 / 32

1

n

∑︀n

i =1 (xi

s3

− x̄)3

=

𝜇3

s3

Statistik I Maßzahlen

Maßzahlen

Wölbungsmaße

Wölbung: Grafische Darstellung

I

I

Steiler als Normalverteilung, wenn k > 0

Flacher als Normalverteilung, wenn k < 0

1.0

0.8

Platykurtisch

1.2

Leptokurtisch

k = −1.3

0.2

0.0

0.2

0.0

−3

−2

−1

0

x

30 / 32

0.4

Dichte

0.6

0.4

Dichte

0.8

0.6

k = 2.4

1

2

3

−3

−2

−1

0

x

1

2

3

Statistik I Maßzahlen

Maßzahlen

Wölbungsmaße

Maßzahlen der Wölbung (Kurtosis)

31 / 32

I

„Spitzigkeit“, Aufgewölbtheit der Verteilung

I

Verhältnis von viertem Zentralmoment zur 4. Potenz der

Standardabweichung

I

Exzess: Wölbung abzüglich dem Wert 3

Wölbung der Normalverteilung ist gleich 3 (Exzess 0)

I

Steil aufgewölbt: Leptokurtisch

I

Wenig aufgewölbt: Platykurtisch

Statistik I Maßzahlen

Maßzahlen

Wölbungsmaße

Maßzahlen der Wölbung (Kurtosis)

k

I

32 / 32

⎤

⎡ n

⎢⎢ 1 ∑︁ (︂ xi − x̄ )︂4 ⎥⎥

⎥⎥ − 3

= ⎢⎢⎢⎣

⎥⎦

n

s

i =1

4

1 ∑︀n

𝜇4

i =1 (xi − x̄)

n

=

−3 = 4 −3

4

s

s

Beachte: Nur bei symmetrischen Verteilungen

aussagekräftig

Statistik I Klassierte Daten

Statistik I

Klassierte Daten

Prof. Dr. Andreas Behr

1 / 35

Statistik I Klassierte Daten

Inhaltsverzeichnis

Einführung

Additionssätze

Teilgesamtheit

Grundgesamtheit

Stetige Klassierung

Grundlagen

Histogramm

Empirische Verteilung und Quantile

Mittelwert und Varianz

2 / 35

Statistik I Klassierte Daten

Einführung

Klassierte Daten

3 / 35

I

Daten werden in der Praxis meist in klassierter Form

dargestellt

I

Z.B. Umsatzklassen und Anzahl der Unternehmen in einer

Klasse statt Urliste

I

Daten können auch nach inhaltlichen Kriterien gruppiert

werden (z.B. Rechtsform)

Statistik I Klassierte Daten

Einführung

Additionssätze

4 / 35

I

Fragestellung (1):

Wie kann man aus Mittelwerten von Teilgesamtheiten den

Mittelwert der Grundgesamtheit errechnen?

−→ Additionssatz für Mittelwerte

I

Fragestellung (2):

Wie kann man aus Varianzen von Teilgesamtheiten die

Varianz der Grundgesamtheit errechnen?

−→ Additionssatz für Varianzen, Streuungszerlegungssatz

Statistik I Klassierte Daten

Einführung

Ausgangssituation:

5 / 35

I

Grundgesamtheit lässt sich in J Teilgesamtheiten G1 , . . . , GJ

gliedern

I

j ist der Index, der die Klassen kennzeichnet, j = 1, ..., J

I

in einer Klasse befinden sich nj Einheiten, Index k = 1, ..., nj

I

xjk ist k − tes Element in Klasse j

I

Jede der J Teilgesamtheiten kann wie bisher als eigene

Gesamtheit betrachtet werden

Statistik I Klassierte Daten

Additionssätze

Teilgesamtheit

Mittelwert und Varianz der Teilgesamtheit

I

Mittelwert in Gruppe j

x̄j =

nj

1 ∑︁

xjk

nj

k =1

I

Varianz in Gruppe j

sj2

nj

1 ∑︁

(xjk − x̄j )2

=

nj

k =1

I

Beachte: Mosler/Schmid verwenden andere Notation

nj

1 ∑︁

1 ∑︁

x̄j =

xjk =

xi

nj

nj

k =1

6 / 35

i ∈Gj

Statistik I Klassierte Daten

Additionssätze

Teilgesamtheit

Beispiel

I

I

I

I

I

Beispiel: x1 = 1, x2 = 3, x3 = 2, x4 = 4

in Klasse j = 1 sind x11 = 1 (x1 ) und x12 = 3, (x2 )

in Klasse j = 2 sind x21 = 2 (x3 ) und x22 = 4 (x4 )

bzw. G1 = {1, 2} und G2 = {3, 4}

Mit doppelter Indizierung

n1

1

1

1 ∑︁

x1k = (x11 + x12 ) = (1 + 3) = 2

x̄1 =

n1

2

2

k =1

I

Mit Indexmenge

x̄1 =

1 ∑︁

1

1

xi = (x1 + x2 ) = (1 + 3) = 2

n1

2

2

i ∈G1

7 / 35

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Mittelwert der Grundgesamtheit

I

I

I

Mittelwerte x̄1 , . . . , x̄J und Varianzen s12 , . . . , sJ2 der

Teilgesamtheiten

Mittelwert x̄ und Varianz s 2 der Grundgesamtheit

Umfänge der Teilgesamtheiten |Gj | = nj und der

Grundgesamtheit |G | = n

n=

J

∑︁

nj

j =1

I

Additionssatz für Mittelwerte

x̄ =

J

∑︁

j =1

8 / 35

x̄j

nj

n

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Mittelwert der Grundgesamtheit

I

Warum?

x̄ =

J

∑︁

x̄j

j =1

=

=

9 / 35

1

n

1

n

nj

J

nj ∑︁ nj 1 ∑︁

=

xjk

n

n nj

j =1

nj

J ∑︁

∑︁

j =1 k =1

n

∑︁

xi

i =1

xjk

k =1

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Mittelwert der Grundgesamtheit: Beispiel

Männer

2797

2119

3967

3738

Frauen

2284

3570

3889

2042

3887

2977

Männer

n1 = 4

x̄1 = 3155.25

10 / 35

I

Merkmal X : Einkommen

I

2 Teilgesamtheiten

Frauen

n2 = 6

x̄2 = 3108.17

Gesamt

n = 10

x̄ = 3127

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Varianz der Grundgesamtheit

I

Additionssatz für Varianzen, Streuungszerlegungssatz

s2 =

J

∑︁

j =1

⏟

J

)︁2 nj

nj ∑︁ (︁

+

x̄j − x̄

n

n

j =1

⏞

⏟

⏞

sj2

2

=sint

I

Interne Varianz und externe Varianz

I

Bestimmtheitsmaß

B=

11 / 35

2

=sext

2

sext

s2

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Varianz der Grundgesamtheit: Beispiel

I

I

I

12 / 35

Situation I

Männer

Frauen

Merkmal X :

1

0.5

Einkommen

2

1.5

2 Teilgesamtheiten

3

2.5

Streuungszerlegung

4

3.5

für beide Situationen

4.5

5.5

Situation II

Männer Frauen

1

3.5

2

4.5

3

5.5

4

6.5

7.5

8.5

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Varianz der Grundgesamtheit: Beispiel 1

Situation I

Männer Frauen

1

0.5

2

1.5

3

2.5

4

3.5

4.5

5.5

Männer

n1 = 4

x̄1 = 2.5

s12 = 1.25

13 / 35

Frauen

n2 = 6

x̄2 = 3

s22 = 2.91667

Gesamt

n = 10

x̄ = 2.8

s 2 = 2.31

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Varianz der Grundgesamtheit: Beispiel 1

I

Varianz

s

2

=

J

∑︁

j =1

s2

J (︁

∑︁

)︁2 nj

x̄j − x̄

+

n

n

nj

sj2

j =1

[︂

]︂

4

6

= 1.25 ·

+ 2.91667 ·

+

10

10

[︂

]︂

4

6

(2.5 − 2.8)2 ·

+ (3 − 2.8)2 ·

10

10

=

2.25 + 0.06 = 2.31

⏟ ⏞

⏟ ⏞

int. Varianz

I

Bestimmtheitsmaß

B=

14 / 35

ext. Varianz

2

sext

0.06

=

= 0.026

2

2.31

s

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Varianz der Grundgesamtheit: Beispiel 2

Situation II

Männer Frauen

1

3.5

2

4.5

3

5.5

4

6.5

7.5

8.5

Männer

n1 = 4

x̄1 = 2.5

s12 = 1.25

15 / 35

Frauen

n2 = 6

x̄2 = 6

s22 = 2.91667

Gesamt

n = 10

x̄ = 4.6

s 2 = 5.19

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Varianz der Grundgesamtheit: Beispiel 2

I

Varianz

s

2

=

J

∑︁

j =1

s2

J (︁

∑︁

)︁2 nj

x̄j − x̄

+

n

n

nj

sj2

j =1

[︂

]︂

4

6

= 1.25 ·

+ 2.91667 ·

+

10

10

[︂

]︂

4

6

(2.5 − 4.6)2 ·

+ (6 − 4.6)2 ·

10

10

=

2.25 + 2.94 = 5.19

⏟ ⏞

⏟ ⏞

int. Varianz

I

Bestimmtheitsmaß

B=

16 / 35

ext. Varianz

2

sext

2.94

=

= 0.566

2

5.19

s

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Situation 1: Grafische Darstellung

0.15

0.10

0.00

0.05

Density

0.20

0.25

Situation 1

0

5

x

17 / 35

10

Statistik I Klassierte Daten

Additionssätze

Grundgesamtheit

Situation 2: Grafische Darstellung

0.15

0.10

0.00

0.05

Density

0.20

0.25

Situation 2

0

5

x

18 / 35

10

Statistik I Klassierte Daten

Stetige Klassierung

Grundlagen

Stetige Klassierung

I

I

I

Stetige Merkmale werden oft in Klassen (Intervalle)

zusammengefasst (stetige Klassierung)

Notation: Anzahl der Klassen J

Klassengrenzen

x1u < x1o = x2u < x2o = x3u < . . . < xJo−1 = xJu < xJo

I

Intervalle:

K1 = [x1u , x1o ],

I

Kj =]xju , xjo ],

j = 2, . . . , J

Stetige Klassierung

(K1 , n1 ), (K2 , n2 ), . . . , (KJ , nJ )

bzw. (K1 , f1 ), (K2 , f2 ), . . . , (KJ , fJ )

19 / 35

Statistik I Klassierte Daten

Stetige Klassierung

Grundlagen

Stetige Klassierung

I

Häufigkeitsverteilung in Form einer

Tabelle

I

Beim übergang von der Urliste zur

stetigen Klassierung geht viel

Information verloren

I

I

I

20 / 35

Kj

K1

K2

..

.

über die Verteilung innerhalb der

Klassen macht die

Häufigkeitsverteilung keine Angaben K

J

Häufig verwendete Näherung:

Gleichverteilung in den Intervallen

Konsequenzen für empirische

Verteilungsfunktion und Quantile?

nj

n1

n2

..

.

fj = nj /n

f1

f2

..

.

nJ

n

fJ

1

Statistik I Klassierte Daten

Stetige Klassierung

Histogramm

Histogramm

I

I

I

I

I

Stetig klassierte Daten lassen sich durch Histogramme

grafisch darstellen

Durch Rechtecke über den Klassen werden die relativen

Häufigkeiten repräsentiert

Beachte: Fläche über Kj proportional zu fj

Es muss also die Dichte und nicht einfach die relative

Häufigkeit abgetragen werden

Empirische Dichte in der Klasse Kj

xjo

I

21 / 35

fj

− xju

Nur bei konstanten Klassenbreiten kann fj verwendet

werden

Statistik I Klassierte Daten

Stetige Klassierung

Histogramm

PSID: Fläche proportional zur Häufigkeit

0.010

0.000

0.005

Dichte

0.015

0.020

Ungleiche Klassenbreiten

0

25

50

75

100

125

Jahreslohn in 1000 US−Dollar

22 / 35

150

175

200

Statistik I Klassierte Daten

Stetige Klassierung

Histogramm

FALSCH: Höhe proportional zur Häufigkeit

Dichte

FALSCH!!!

0

25

50

75

100

125

Jahreslohn in 1000 US−Dollar

23 / 35

150

175

200

Statistik I Klassierte Daten

Stetige Klassierung

Histogramm

PSID: Grobe Klassierung

Tabelle: Klassenmittel und -varianzen

(0,40]

(40,80]

(80,120]

(120,160]

(160,200]

24 / 35

n

7035

2253

495

174

66

mean

19.94

55.62

96.90

137.51

182.41

variance

130.84

122.77

119.88

149.50

177.93

Statistik I Klassierte Daten

Stetige Klassierung

Histogramm

Histogramm: PSID-Jahreslöhne (≤200Tsd. $)

5000

3000

0 1000

Abs. Häufigkeit

7000

5 Klassen gleicher Breite

0

25

50

75

100

125

Jahreslohn in 1000 US−Dollar

25 / 35

150

175

200

Statistik I Klassierte Daten

Stetige Klassierung

Empirische Verteilung und Quantile

Empirische Verteilungsfunktion und Quantile

I

Annahme: Gleichverteilung innerhalb der Klassen

I

Nur die Werte F (xjo ) sind exakt bekannt (und F (x1u ))

(︁

(︁ )︁)︁ (︁

)︁

(︁

)︁

Die Punkte x1u , F x1u , x1o , F (x1o ) , . . . , xJo , F (xJo ) werden

linear interpoliert

I

26 / 35

Statistik I Klassierte Daten

Stetige Klassierung

Empirische Verteilung und Quantile

Polygonzug: PSID-Jahreslöhne (≤200Tsd. $)

1.0

Annahme der Gleichverteilung in den Klassen

●

●

●

0.8

●

0.0

0.2

0.4

F(x)

0.6

●

●

0

20

40

60

80

100

x

27 / 35

120

140

160

180

200

Statistik I Klassierte Daten

Stetige Klassierung

Empirische Verteilung und Quantile

Beispiel: Gesucht ist F(50)

1.0

Approximative Ermittlung von F(x)

●

●

●

0.8

●

0.0

0.2

0.4

F(x)

0.6

●

●

0

20

40

60

80

100

x

28 / 35

120

140

160

180

200

Statistik I Klassierte Daten

Stetige Klassierung

Empirische Verteilung und Quantile

Approximative empirische Verteilungsfunktion

I

Approximative empirische Verteilungsfunktion

)︁

(︁

(︁ )︁

fj

)︁ x − xju

F (x) = F xju + (︁

xjo − xju

I

29 / 35

Wählen wir für F (x) einen vorgegebenen Wert p, führt

Auflösen nach x zu dem gesuchten approximativen Quantil

x̃p

(︁ )︁

)︁

p − F xju (︁

xjo − xju

x̃p = xju +

fj

Statistik I Klassierte Daten

Stetige Klassierung

Empirische Verteilung und Quantile

Herleitung

I

I

I

I

30 / 35

(︁ )︁

Start ist der Punkt xju ; F xju

(︁ )︁

Die Gerade zum Punkt xjo ; F xjo hat die Steigung

(︁ )︁

(︁ )︁

F xjo − F xju

fj

= o

o

u

xj − xj

xj − xju

Wir laufen die Strecke x − xju mit dieser Steigung

und landen bei F (x) :

(︁ )︁

(︁ )︁

(︁ )︁

F xjo − F xju

F (x) = F xju + (x − xju ) ·

xjo − xju

(︁ )︁

fj

= F xju + o

(x − xju )

xj − xju

Statistik I Klassierte Daten

Stetige Klassierung

Mittelwert und Varianz

Mittelwert bei klassierten Daten

(1) Wenn Klassenmittelwerte x̄j bekannt sind, gilt exakt

x̄ =

J

∑︁

x̄j

j =1

nj

n

(Folge aus Additionssatz für Mittelwerte)

(2) Wenn Klassenmittelwerte unbekannt sind, gilt approximativ

x̄ ≈

J

∑︁

j =1

mit x̃j = Klassenmitte von Kj

31 / 35

x̃j

nj

n

Statistik I Klassierte Daten

Stetige Klassierung

Mittelwert und Varianz

Varianz bei klassierten Daten

(1) Wenn x̄j und sj2 für alle Kj bekannt sind, verwende

Streuuungszerlegungssatz

2

s =

J

∑︁

j =1

J (︁

∑︁

)︁2 nj

+

x̄j − x̄

n

n

nj

sj2

j =1

(2) Wenn nur x̄j bekannt sind, approximiere

J (︁

∑︁

)︁2 nj

s ≈

x̄j − x̄

n

2

j =1

Beachte: Es fehlt die gesamte „interne Streuung“!

32 / 35

Statistik I Klassierte Daten

Stetige Klassierung

Mittelwert und Varianz

Varianz bei klassierten Daten

(3) Wenn auch x̄j unbekannt sind, approximiere mit

Klassenmitten x̃j

J (︁

∑︁

)︁2 nj

s ≈

x̃j − x̄

n

2

j =1

Beachte: Es fehlt die gesamte „interne Streuung“, die

„externe Streuung“ wird approximiert!

33 / 35

Statistik I Klassierte Daten

Stetige Klassierung

Mittelwert und Varianz

Varianz bei klassierten Daten: PSID-Löhne

I

PSID 2005: n = 10023 Jahreslöhne (≤ 200 Tsd $)

I

Tatsächliche Varianz

s

2

=

J

∑︁

j =1

J (︁

∑︁

)︁2 nj

+

x̄j − x̄

n

n

nj

sj2

j =1

= 129.1163 + 769.5483

= 898.6647

34 / 35

Statistik I Klassierte Daten

Stetige Klassierung

Mittelwert und Varianz

Approximation bei klassierten Daten: PSID-Löhne

I

Approximation mit Klassenmitteln x̄j

s

2

J (︁

∑︁

)︁2 nj

x̄j − x̄

≈

n

j =1

= 769.5483

I

Unterschätzung um 14.4% (769.5483/898.6647 =

0.856 32)

Approximation mit Klassenmitten x̃j

s2

≈

J (︁

∑︁

)︁2 nj

x̃j − x̄

n

j =1

= 837.2031

Unterschätzung um 6.8% (837.2031/898.6647 = 0.931 61)

35 / 35

Statistik I Vergleichsmaßzahlen

Statistik I

Vergleichsmaßzahlen

Prof. Dr. Andreas Behr

1 / 29

Statistik I Vergleichsmaßzahlen

Inhaltsverzeichnis

Verhältniszahlen

Gliederungszahlen

Beziehungszahlen

Strukturanalysen

Grundlagen

Maßzahlen des Strukturvergleichs

Standardisierung und Isolierung

PSID

2 / 29

Statistik I Vergleichsmaßzahlen

Verhältniszahlen

Arten von Verhältniszahlen

I

I

Eine Verhältniszahl ist der Quotient von zwei statistischen

Maßzahlen

Drei Arten von Verhältniszahlen:

1. Gliederungszahlen (Anteile)

2. Beziehungszahlen

3. Messzahlen

3 / 29

Statistik I Vergleichsmaßzahlen

Verhältniszahlen

Gliederungszahlen

Gliederungszahlen (Anteile)

I