Musterlösung zur Serie 12

Werbung

D-MATH, D-PHYS, D-CHAB

Lineare Algebra II

Prof. Giovanni Felder, Thomas Willwacher

FS 10

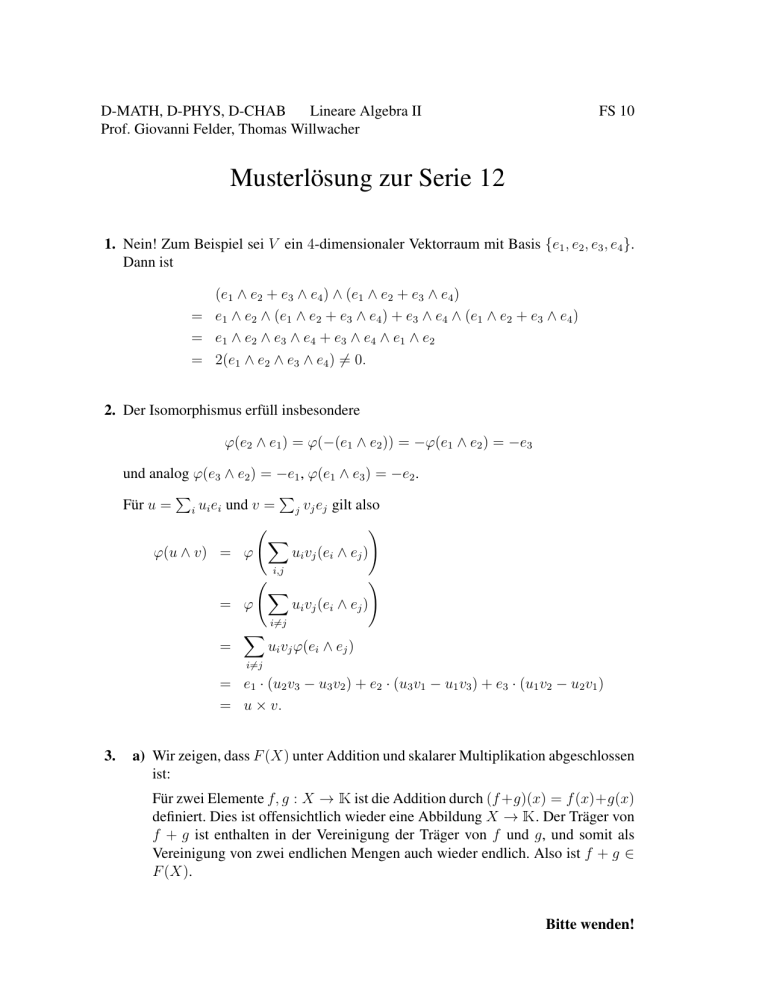

Musterlösung zur Serie 12

1. Nein! Zum Beispiel sei V ein 4-dimensionaler Vektorraum mit Basis {e1 , e2 , e3 , e4 }.

Dann ist

(e1 ∧ e2 + e3 ∧ e4 ) ∧ (e1 ∧ e2 + e3 ∧ e4 )

= e1 ∧ e2 ∧ (e1 ∧ e2 + e3 ∧ e4 ) + e3 ∧ e4 ∧ (e1 ∧ e2 + e3 ∧ e4 )

= e1 ∧ e2 ∧ e3 ∧ e4 + e3 ∧ e4 ∧ e1 ∧ e2

= 2(e1 ∧ e2 ∧ e3 ∧ e4 ) 6= 0.

2. Der Isomorphismus erfüll insbesondere

ϕ(e2 ∧ e1 ) = ϕ(−(e1 ∧ e2 )) = −ϕ(e1 ∧ e2 ) = −e3

und analog ϕ(e3 ∧ e2 ) = −e1 , ϕ(e1 ∧ e3 ) = −e2 .

P

P

Für u = i ui ei und v = j vj ej gilt also

!

X

ϕ(u ∧ v) = ϕ

ui vj (ei ∧ ej )

i,j

!

= ϕ

X

ui vj (ei ∧ ej )

i6=j

=

X

ui vj ϕ(ei ∧ ej )

i6=j

= e1 · (u2 v3 − u3 v2 ) + e2 · (u3 v1 − u1 v3 ) + e3 · (u1 v2 − u2 v1 )

= u × v.

3.

a) Wir zeigen, dass F (X) unter Addition und skalarer Multiplikation abgeschlossen

ist:

K

Für zwei Elemente f, g : X → ist die Addition durch (f +g)(x) = f (x)+g(x)

definiert. Dies ist offensichtlich wieder eine Abbildung X → . Der Träger von

f + g ist enthalten in der Vereinigung der Träger von f und g, und somit als

Vereinigung von zwei endlichen Mengen auch wieder endlich. Also ist f + g ∈

F (X).

K

Bitte wenden!

Weiter verändert auch die skalare Multiplikation (λf )(x) = λ · f (x) nichts an

der Tatsache, dass es eine Abbildung X →

ist, und der Träger bleibt dabei

gleich (ausser er wird durch λ = 0 auf die leere Menge reduziert.)

P

b) Sei f ∈ F (X) mit Träger X 0 = {x1 , . . . , xn }. Dann ist f 7→ 1≤i≤n f (xi )exi

eine Abbildung von F (X) in den Raum der endlichen formalen Linearkombinationen. Aus der Definition ist klar, dass diese Abbildung linear ist. Auch die

Injektivität ist offensichtlich. Für die

PSurjektivität basteln wir uns aus der endlichen formalen Linearkombination 1≤j≤m λxj exj durch f (xj ) = λxj , f (x) =

0∀x ∈ X \ {x1 , . . . , xj } eine Abbildung X → mit endlichem Träger, also ein

f ∈ F (X), welches auf diese Linearkombination abgebildet wird. Somit ist die

Abbildung linear und bijektiv, also ein Isomorphismus.

K

K

Von jetzt an schreiben wir Elemente aus F (X) als endliche formale Linearkombination der ex .

c) Behauptung: Die Abbildung ϕ̃ : ex 7→ ϕ(x) tut’s.

Mit ϕ̃(λex + ey ) = λϕ(x) + ϕ(y) ist sie linear. Die Gleichung ϕ̃ ◦ e = ϕ ist aus

der Definition offensichtlich. Die Eindeutigkeit ergibt sich aus der Eindeutigkeit

auf dem Erzeugendensystem (ex )x von F (X).

4. Wir zeigen zuerst ein Lemma.

Lemma: Seien v1 , . . . , vk ∈ V beliebig. Dann gilt

v1 ∧ . . . ∧ vk = 0 ⇐⇒ v1 , . . . , vk sind linear abhängig.

Beweis: Wir zeigen zuerst die Gegenrichtung und nehmen an, die k Vektoren seien linear abhängig. Dann gibt

P es (nach eventueller Umnummerierung der vi ) Koeffizienten

λk ∈ , so dass v1 = 1<i≤k λi vi gilt. Es gilt nun

!

X

v1 ∧ . . . ∧ vk =

λi vi ∧ v2 ∧ . . . ∧ vk

K

1<i≤k

=

X

λi (vi ∧ v2 ∧ . . . ∧ vk )

1<i≤k

Durch Vertauschen des ersten mit dem i-ten Faktor erhalten wir die Gleichung

vi ∧ v2 ∧ . . . ∧ vk = −(vi ∧ v2 ∧ . . . ∧ vk ),

die nur vi ∧ v2 ∧ . . . ∧ vk = 0 als Lösung hat. Somit ist die Summe auch 0.

Für die andere Richtung verwenden wir eine Induktion über die Anzahl Faktoren. Wir

starten bei 2 Faktoren v ∧ w und erinnern uns an die Definition: Ein Wedgeprodukt ist

Siehe nächstes Blatt!

ein Tensorprodukt “modulo Symmetrie”. Ein Wedgeprodukt ist somit genau dann 0,

wenn das zugrundeliegende Tensorprodukt verschwindet oder von der Form λ(v ⊗ v)

ist.

Aus der Serie 11 wissen wir, dass ein Tensorprodukt genau dann verschwindet, wenn

einer der beiden Faktoren von v ⊗ w schon 0 ist. In diesem Fall sind aber v und w

linear abhängig und die Aussage stimmt. Im anderen Fall haben wir w = λv, somit

sind diese Vektoren auch linear abhängig.

Wir kommen nun zum Induktionsschritt k − 1

k. Falls vk = 0 ist die Aussage

klar. Nach Induktionsvoraussetzung stimmt die Aussage auch für v1 ∧ . . . ∧ vk−1 = 0.

Wir betrachten das zugrundeliegende Tensorprodukt v1 ⊗ . . . ⊗ vk , welches im Ideal

Span{u1 ⊗ . . . ⊗ uk | ul ∈ V, ∃1 ≤ i < j ≤ k : ui = uj } liegen muss. Da aber

v1 ∧ . . . ∧ vk−1 6= 0, muss das Tensorprodukt sogar in Span{u1 ⊗ . . . ⊗ uk | ul ∈

V, ∃1 ≤ i < k : ui = uk } liegen. Dies wiederum bedeutet, dass es λi gibt mit

X

v1 ⊗ . . . ⊗ vk =

λi (v1 ⊗ . . . ⊗ vk−1 ⊗ vi ) .

1≤i<k

Damit ist vk =

P

i

λi vi linear abhängig. Mit diesem Lemma ist die Aufgabe gelöst: Falls x ∈ Span(v1 , . . . , vk ), so ist v1 ∧

. . . ∧ vk ∧ x = 0.

Und falls v1 ∧ . . . ∧ vk ∧ x = 0, so ist x linear abhängig von v1 , . . . , vk , also x ∈

Span(v1 , . . . , vk ).

5.

a) Wir überprüfen die Gleichheit auf der Basis: Es gilt

MBU ⊗V (F ⊗ G) (ei ⊗ fj )

= MBU (F (ei )) ⊗ MBV (G(fj ))

= (a1i , a2i , . . . , ami )T ⊗ (b1j , b2j , . . . , bnj )T

= (a1i b1j , a1i b2j , . . . , a2i bnj , a2i b1j , a2i b2j , . . . , ami b1j , ami b2j , . . . , ami bnj ).

Dies ist nach Konstruktion die n(i − 1) + j-te Spalte der gesuchten Matrix.

b) Da sich die Spur unter Basiswechsel nicht verändert (sie ist u.a. gegen durch die

Summe der Eigenwerte), verwenden wir die Darstellung aus der Teilaufgabe a).

Hier können wir die Spur ablesen:

tr(F ⊗ G) = a11 trB + . . . + amm trB = tr(A) · tr(B).

Bitte wenden!

c) Es gilt für alle u ∈ U, v ∈ V :

((F1 ⊗ G1 ) ◦ (F2 ⊗ G2 )) (u ⊗ v) =

=

=

=

(F1 ⊗ G1 )(F2 (u) ⊗ G2 (v))

F1 (F2 (u)) ⊗ G1 (G2 (v))

(F1 ◦ F2 )(u) ⊗ (G1 ◦ G2 )(v)

((F1 ◦ F2 ) ⊗ (G1 ◦ G2 )) (u ⊗ v).

d) Die zweite Gleichung lässt sich aus der Darstellung in der Teilaufgabe a) sofort

ablesen: Es gilt

B

m

dim U

..

det(idU ⊗G) = det

= (det B) = (det B)

.

B

Für die erste Gleichung müssen wir etwas mehr arbeiten, der letzte Schritt ist aber

der Gleiche: Durch Zeilen- und Spaltenumformungen lässt sich sich die Matrix

nämlich in die Form bringen, die wir schon für die zweite Gleichung ausgenutzt

haben.

Wir führen zuerst Zeilenvertauschungen durch: Aus der ursprünglichen Ordnung

wird durch die Zeilenvertauschung (1, 2, . . . , mn) 7→ (1, n + 1, 2n + 1, . . . , (m −

1)n + 1, 2, n + 2, . . . , (m − 1)n + 2, . . . , n, 2n, . . . , mn) eine Matrix erzeugt, die

aus n × n-Blöcken besteht und im i-ten Block der j-ten Blockzeile die i-te Spalte

der Matrix MBU (A) steht. Sie sieht nun beispielsweise für m = n = 4 ungefähr

so aus:

Dabei steht ein für einen Spaltenvektor mit 4 Einträgen der Form ajk für ein

fixes k.

Wir führen die analoge Spaltenvertauschung (1, 2, . . . , mn) 7→ (1, n + 1, 2n +

1, . . . , (m − 1)n + 1, 2, n + 2, . . . , (m − 1)n + 2, . . . , n, 2n, . . . , mn) durch, und

erhalten nun die Matrix

A

...

,

A

die als Determinante den Wert (det A)dim V hat. Nun müssen wir noch das Vorzeichen der Permutationen bestimmen: Da wir aber zwei mal genau die gleiche

Permutation angewendet haben, ist es (±1)2 = 1.

Siehe nächstes Blatt!

e) Schreibe F = F ◦ idU und G = idV ◦G. Dann gilt

det(F ⊗ G) =

=

=

=

det((F ◦ idU ) ⊗ (idV ◦G)

det((F ⊗ idV ) ◦ (idU ⊗G))

det(F ⊗ idV ) · det(idU ⊗G)

(det A)dim V · (det B)dim U .