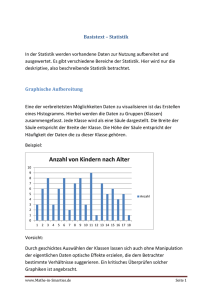

Leitfaden statistische Auswertung

Werbung