3.1. Lineare Regression 32 Bestimmtheitsmaß Als Maß für die Güte

Werbung

32

3.1. Lineare Regression

Bestimmtheitsmaß

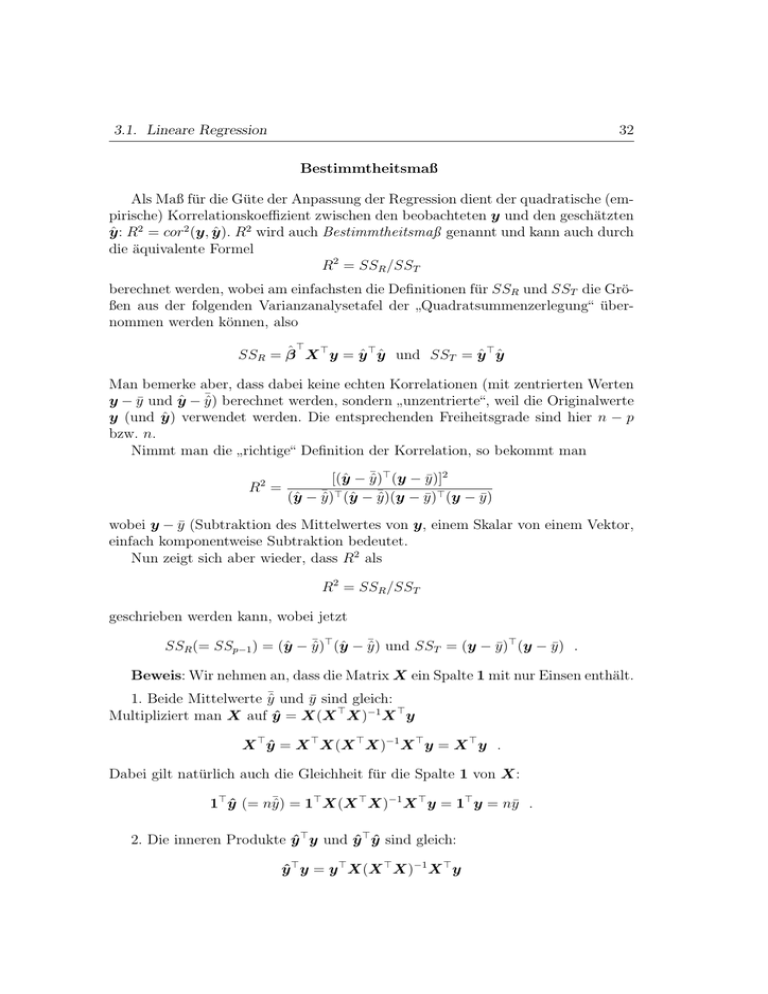

Als Maß für die Güte der Anpassung der Regression dient der quadratische (empirische) Korrelationskoeffizient zwischen den beobachteten y und den geschätzten

ŷ: R2 = cor2 (y, ŷ). R2 wird auch Bestimmtheitsmaß genannt und kann auch durch

die äquivalente Formel

R2 = SSR /SST

berechnet werden, wobei am einfachsten die Definitionen für SSR und SST die Größen aus der folgenden Varianzanalysetafel der Quadratsummenzerlegung“ über”

nommen werden können, also

⊤

SSR = β̂ X ⊤ y = ŷ ⊤ ŷ und SST = ŷ ⊤ ŷ

Man bemerke aber, dass dabei keine echten Korrelationen (mit zentrierten Werten

¯ berechnet werden, sondern unzentrierte“, weil die Originalwerte

y − ȳ und ŷ − ŷ)

”

y (und ŷ) verwendet werden. Die entsprechenden Freiheitsgrade sind hier n − p

bzw. n.

Nimmt man die richtige“ Definition der Korrelation, so bekommt man

”

¯ ⊤ (y − ȳ)]2

[(ŷ − ŷ)

R2 =

¯ ⊤ (ŷ − ŷ)(y

¯

(ŷ − ŷ)

− ȳ)⊤ (y − ȳ)

wobei y − ȳ (Subtraktion des Mittelwertes von y, einem Skalar von einem Vektor,

einfach komponentweise Subtraktion bedeutet.

Nun zeigt sich aber wieder, dass R2 als

R2 = SSR /SST

geschrieben werden kann, wobei jetzt

¯ ⊤ (ŷ − ŷ)

¯ und SST = (y − ȳ)⊤ (y − ȳ) .

SSR (= SSp−1 ) = (ŷ − ŷ)

Beweis: Wir nehmen an, dass die Matrix X ein Spalte 1 mit nur Einsen enthält.

1. Beide Mittelwerte ŷ¯ und ȳ sind gleich:

Multipliziert man X auf ŷ = X(X ⊤ X)−1 X ⊤ y

X ⊤ ŷ = X ⊤ X(X ⊤ X)−1 X ⊤ y = X ⊤ y .

Dabei gilt natürlich auch die Gleichheit für die Spalte 1 von X:

¯ = 1⊤ X(X ⊤ X)−1 X ⊤ y = 1⊤ y = nȳ .

1⊤ ŷ (= nŷ)

2. Die inneren Produkte ŷ ⊤ y und ŷ ⊤ ŷ sind gleich:

ŷ ⊤ y = y ⊤ X(X ⊤ X)−1 X ⊤ y

33

3.1. Lineare Regression

= y ⊤ X(X ⊤ X)−1 X ⊤ X(X ⊤ X)−1 X ⊤ y

= ŷ ⊤ ŷ .

3. Die Kovarianz von ŷ und y ist gleich der Kovarianz von ŷ und ŷ:

In exakter Matrizenform geschrieben gilt für das Produkt

¯ ⊤ (y − ȳ1) = ŷ ⊤ y − ŷ1

¯ ⊤ y − ŷ ⊤ ȳ1 + ŷ¯ȳ1⊤ 1

(ŷ − ŷ1)

Mit den obigen Punkten 1. und 2. weitergerechnet, erhalten wir

¯ ⊤ (y − ȳ1) = ŷ ⊤ ŷ − nŷ¯2 = (ŷ − ŷ)

¯ ⊤ (ŷ − ŷ)

¯

(ŷ − ŷ1)

worauf sich die Formel für den Bestimmtheitsgrad auf

R2 = SSR /SST

zusammenkürzt.

R2 liegt naturgemäß zwischen 0 und 1; je größer R2 wird, desto besser passt

sich das gewählte Modell an die Daten an.

Gewichtete Regression

Es kann vorkommen, dass manche Beobachtungen weniger zuverlässig sind als

andere. Das bedeutet, dass die Varianz von e nicht Iσ 2 ist, sondern eine Diagonalmatrix mit unterschiedlichen Elementen (Verletzung der Homoskedastizität). Es

kann auch vorkommen, dass die Nichtdiagonalelemente ungleich sind, das bedeutet, dass die ei nicht unkorreliert sind (Verletzung der Unabhängigkeit). Beide Fälle

stellen eine Verletzung der Voraussetzungen dar und damit können obige Aussagen

nicht mehr aufrechterhalten werden. Die grundsätzliche Idee zur Beseitigung dieser

Schwierigkeit ist recht einfach: man versucht, y derart zu transformieren, dass die

Voraussetzungen für die transformierte Variable z wieder gelten.

Nehmen wir an, dass e ∼ N (0, V σ 2 ), wobei V eine bekannte, positiv definite

Matrix ist. Man kann für V eine Matrix P finden, sodass P P ⊤ = V gilt (siehe

Draper and Smith, 1981, pp. 108). Wenn wir die urprüngliche Regressionsgleichung

y = Xβ + e mit P −1 multiplizieren, erhalten wir

bzw.

−1

−1

P −1 y = P

| {z X} β + |P {z e}

z

Q

f

| {z }

z = Qβ + f

mit den gewünschten Eigenschaften, weil

⊤

V ar(f ) = E(f f ⊤ ) = E(P −1 ee⊤ P −1 )

⊤

⊤

= P −1 E(ee⊤ )P −1 = P −1 P P ⊤ P −1 σ 2 = Iσ 2 .

34

3.1. Lineare Regression

Lineares Modell?

Als lineares Modell bezeichnen wir alle Modelle der Form:

y = β0 + β1 x1 + . . . + βp xp .

Man kann aber auch Regressionsansätze, die im ersten Moment nicht als linear

erscheinen, durch geeignete Transformationen linearisieren:

y = β0 + β1 x1 + β2 x2 + . . . + βp xp

kann durch Setzen von x̃i = xi−1 , i = 1, ..., p + 1, auf ein lineares Modell zurückgeführt werden. Auch

y = β0 eβ1 x

kann durch Logarithmieren linearisiert werden. Als nichtlinear bezeichnen wir Modelle, die nicht durch Transformationen auf die lineare Form gebracht werden können, wie etwa

y = β0 eβ1 x1 +β2 x2 + β3 x3 .

Quadratsummenzerlegung

Mit Hilfe einer Zerlegung der gesamten Quadratsumme SST = y ⊤ y können wir

folgende Varianzanalysetabelle erstellen (siehe auch Abschnitt 2.2):

Variationsquelle

FG

Quadratsumme

Regression

p

SSR = β̂ X ⊤y

mittlere QS

F-Wert

⊤

ˆ

⊤y

M SR = β X

p

⊤

ˆ

⊤

β

X ⊤y )

M S e = (y y −

(n−p)

⊤

Residuen

n−p

SSe = y ⊤y − β̂ X ⊤y

Gesamt

n

SST = y ⊤y

MSR /MSe

⊤

Aus Abschnitt 2.2 wissen wir, dass MSR /MSe F-verteilt ist. Als Hypothese nehmen wir H0 : β1 = β2 = . . . = βp = 0. Eine weitere Aufteilung der Quadratsummen

der Regression kann vorgenommen werden, wenn ein konstanter Term im Modell

vorhanden ist:

⊤

⊤

SSR = β̂ X ⊤y = nȳ 2 + β̂ X ⊤y − nȳ 2

|{z}

SSkons

|

{z

SSp−1

}

Diese Art der Zerlegung finden wir auch in den entsprechenden Programmen.

Wird die mittlere Quadratsumme der Regression MSR im Verhältnis zur mittleren Quadratsumme der Residuen zu groß, müssen wir H0 verwerfen, und es gilt,

dass zumindest ein βj 6= 0 sein muss.

3.2. Auswahl von Variablen

3.2

35

Auswahl von Variablen

In der Regressionsanalyse stellt sich oft die Frage, ob es sich gelohnt hat, gewisse

Variablen in das Modell einzubeziehen, bzw. welche Variablen am besten geeignet

erscheinen.

Die erste Frage lässt sich mit Hilfe jenes Teils der Quadratsumme der Regression, der auf die zur Diskussion stehenden Variablen zurückzuführen ist, untersuchen.

Man nennt das Prinzip nach dem dabei vorgegangen wird, Extra-Quadratsummenprinzip.

Dazu nehmen wir folgendes (volles) Modell Ω an: Ω : y = Xβ + e mit p

unabhängigen Variablen. Nun betrachten wir ein reduziertes Modell mit q (q >

0) Variablen mit der Hypothese (ohne Einschränkung der Allgemeinheit) βq+1 =

βq+2 = . . . = βp = 0. Damit wissen wir aus Abschnitt 2.2), dass

SSeω − SSeΩ n − p

×

∼ Fp−q,n−p .

SSeΩ

p−q

Die Differenz SSeω - SSeΩ der Quadratsummen des reduzierten und des vollen

Modells wird häufig als Extra-Quadratsumme bezeichnet.

Mit Hilfe von SSeω kann man einzelne Variablen auf ihren Wert für das Regressionsmodell überprüfen. Wir vergleichen dabei die Quadratsumme des Modells

ohne die i-te Variable mit der Quadratsumme des Modells mit der i-ten Variablen.

Dieses Verfahren kann Schritt für Schritt für jede in Frage kommende Variable

durchgeführt werden; deswegen wird es auch sequentieller F-Test genannt.

Im Programm für schrittweise Regression von beispielsweise BMDP werden

diese F-Statistiken ‘F-to-enter’ und ‘F-to-remove’ genannt, wobei die Größe der

F-Statistik bestimmt, welche Variable als nächste zum Modell hinzugefügt bzw.

weggenommen wird. Man bemerke, dass hier wegen der theoretischen Unzulässigkeit des ‘sequentiellen F-Tests’ keine Quantile mit gegebenen Wahrscheinlichkeiten,

sondern feste, aber willkürliche Werte genommen werden.

Durch Grenzwerte für die F-Werte kann man festlegen, bis zu welcher Größe

des F-Wertes eine Variable in das Modell aufgenommen wird. Es kann vorkommen,

dass eine Variable im Modell plötzlich unwesentlich wird. Diese soll dann aus dem

Modell genommen werden. Die Entscheidung wird sukzessive mit der Größe des

F-Wertes im Vergleich mit einem F-to-remove“ durchgeführt.

”

Wie wir in vielen Beispielen sehen, ist es nicht immer notwendig, alle zur Verfügung stehenden Variablen in das Modell einzubeziehen. Gerade bei mehreren

Variablen ist es möglich, dass manche Variablen ähnliche Dinge messen, bzw. dass

es Abhängigkeiten zwischen einzelnen Variablen gibt (Multikollinearität). Das kann

dazu führen, dass die Matrix X ⊤X fast singulär wird.

Bei der Auswahl der Variablen gilt es, einen Kompromiss zu finden zwischen

folgenden Zielen:

• um eine möglichst gute Vorhersage treffen zu können, sollten möglichst viele

Variablen in unser Modell eingehen

36

3.3. Diagnostik

• um das Modell übersichtlich und einfach zu gestalten, sollten möglichst wenige Variablen in unser Modell eingehen.

Wir wollen nun einige Verfahren anführen, die sich mit einer möglichst guten

Auswahl der Variablen befassen.

Eine Möglichkeit haben wir bereits kennengelernt: die schrittweise Regression

mit einem Grenzwert für F-to-enter und einen für F-to-remove. Eine andere Möglichkeit besteht darin, die Regressionsanalyse für alle möglichen Variablenkombinationen durchzurechnen und dann die ‘beste’ Kombination zu wählen. Üblicherweise

wird als Kriterium dafür entweder R2 oder Mallows-Cp -Statistik herangezogen.

Für R2 sieht die Vorgangsweise folgendermaßen aus:

pro p (Anzahl der Variablen) werden die größten Werte R2 mit den entsprechenden

Variablen gelistet. Man kann nun entscheiden, ab welcher Anzahl von Variablen R2

nicht mehr wesentlich größer wird. Als ‘bestes’ Modell wird dann jenes gewählt,

das das größte R2 hat bei der Anzahl von Variablen, wobei durch Hinzunahme

einer weiteren Variablen nichts Entscheidendes mehr gewonnen wird.

Mallows-Cp -Statistik stellt die Restquadratsumme als Summe des quadrierten Fehlers und des quadrierten Bias (Verzerrung durch das falsche Modell) dar

und ist wie folgt definiert:

Cp′ = RSSp′ /s2 − (n − 2p′ ),

wobei RSS′p die Residuenquadratsumme eines Modells mit p′ Parametern darstellt,

s2 ist die mittlere Residuenquadratsumme des vollen, idealen Modells. Vorausgesetzt p′ Parameter reichen aus, dann gibt es keinen Mangel an Anpassung und

damit ist E(RSSp′ ) = (n − p′ )σ 2 . Da E(s2 ) = σ 2 gilt, folgt (approximativ), dass

E(RSSp′ /s2 ) = (n − p′ )σ 2 /σ 2 = n − p′ ,

sodass

E(Cp′ ) = n − p′ − (n − 2p′ ) = p′ .

Daraus folgt, dass ein Plot von Cp gegen p die geeigneten Modelle als Punkte

nahe der Cp = p-Linie zeigen wird. Modelle mit einem Mangel an Anpassung

(Modellfehler, Bias) werden deutlich über der Cp = p-Linie zu finden sein. Das

Kriterium der Auswahl des ‘optimalen’ Modells ist nun einerseits ein Cp -Wert nahe

dem p bei einer möglichst geringen Anzahl von Variablen.

( : Siehe Paket wle!)

3.3

Diagnostik

Bisher haben wir uns mit der Berechnung und der optimalen Zusammensetzung

von Modellen beschäftigt und dabei stillschweigend angenommen, dass alle Voraussetzungen, die wir postuliert haben, zutreffen. Wie aber können wir überprüfen, ob

37

3.3. Diagnostik

unsere Annahmen stimmen? Dazu gibt es eine Reihe von diagnostischen Verfahren

von denen wir im folgenden einige wichtige kennenlernen werden. Eine ausführliche

Diskussion von diagnostischen Routinen findet sich in Draper and Smith (1981), sowie in Atkinson (1985), eines der neueren Bücher auf diesem Gebiet ist Rousseeuw

and Leroy (1987).

Wahrscheinlichkeitspapier

Eine der Annahmen, die wir getroffen haben, war, dass die Residuen normalverteilt sind (e = N (0, Iσ 2 ). Eine Möglichkeit, diese Annahme anschaulich

zu testen, ist das Wahrscheinlichkeitspapier. Dabei werden die Residuen gegen

G−1 (Fn (Residuen)) aufgetragen, wobei G−1 die Inverse der Normalverteilungsfunktion und Fn die empirische Verteilungsfunktion der Residuen bezeichnet. Wenn

die Residuen in etwa normalverteilt sind, so liegen die entstehenden Punkte einer

Treppenfunktion ungefähr auf einer Geraden.

( : Siehe Paket e1071: probplot, qqplot ...!)

Andere Möglichkeiten, die Residuen auf Normalverteilung zu überprüfen, wären

etwa der χ2 -Test, Shapiro-Wilk oder der Kolmogorow-Smirnow-Test.

Residuen - ŷ- Plot

Eine weitere Annahme, die von uns getroffen wurde, ist die Annahme der Homoskedastizität, d.h. die Residuen besitzen alle die gleiche Varianz. Eine anschauliche Möglichkeit einer Überprüfung dieser Annahme bietet ein Plot der Residuen

e gegen die geschätzten Werte ŷ. Bei Homoskedastizität sollten die Residuen in

y-Richtung über die gesamte x-Achse in etwa die gleiche Streuung aufweisen. Darüberhinaus können wir mit dieser Grafik auch unser Modell prüfen: wenn es korrekt

ist, so dürfen die Residuen nur zufällig um die 0-Linie streuen; wenn die Residuen

aber noch eine Struktur erkennen lassen, so kann unser Modell nicht richtig sein.

Entdeckung von einflussreichen Beobachtungen

Es kann vorkommen, dass einzelne Beobachtungen die gesamte Schätzung sehr

stark beeinflussen; man spricht dann von einflussreichen Beobachtungen oder Ausreißern. Da in extremen Situationen eine einzelne ‘schlechte’ Beobachtung ausreicht, um die Schätzung gänzlich unsinnig zu machen, oder zumindest sehr stark

zu verfälschen, ist es wichtig, zu überprüfen, ob solche einflussreichen Beobachtungen vorhanden sind. Eine Testgröße, die von den meisten Programmpaketen als

Erkennungshilfe für Ausreißer angeboten wird, ist die Cook-Distanz1 :

1

b −β

d }⊤ X ⊤X{β

b −β

d }/(p × σ̂ 2 )

D i = {β

(i)

(i)

( : Siehe Paket car, Funktion cookd!)

38

3.4. Robuste Regression

wobei βd

(i) der geschätzte Parametervektor ist, der ohne die i-te Beobachtung berechnet wurde. Ein großer Wert Di für eine Beobachtung i weist auf eine einflussreiche Beobachtung hin. Auf diese Art kann man einzelne Ausreißer gut feststellen,

bei mehreren Ausreißern hingegen tritt ein sogenannter Maskierungseffekt zu Tage,

der die entsprechenden Abstände klein hält und damit Ausreißer ‘maskiert’.

Mit diagnostischen Hilfsmitteln - wie dem Cook-Abstand, oder der äquivalenten

Mahalanobisdistanz - ist es daher nicht möglich, eine Gruppe von Ausreißern zu

erkennen, man muss also sinnvollerweise das Problem der Ausreißererkennung auf

grundsätzlich andere Art anpacken.

Im nächsten Kapitel werden wir robuste Methoden in der Regressionsanalyse

kennenlernen, mit deren Hilfe sich auch dieses Problem lösen lässt.

3.4

Robuste Regression

Mit robusten statistischen Verfahren meint man Verfahren, die nicht sehr empfindlich auf Verletzungen der zugrundeliegenden Verteilungsannahmen reagieren.

Bisher haben wir für die Schätzung unserer Parameter praktisch nur die Methode der kleinsten Quadrate verwendet, es gibt aber noch verschiedene andere

Möglichkeiten, die Parameter zu schätzen. In der kleinsten Quadrate-Schätzung

minimieren wir ja folgenden Ausdruck (ri bezeichnet das i-te Residuum):

n

X

ri2 = min;

i=1

dabei geht jede Beobachtung mit demselben Gewicht in die Berechnung ein. Das

bedeutet, dass eine einzelne ‘schlechte’ Beobachtung (Ausreißer) die Schätzung

beliebig verzerren kann. Ein Ansatz, der von Huber (1981) und Hampel et al. (1986)

gewählt wurde, geht von einer Verallgemeinerung der quadratischen Schätzung der

Parameter aus. Wir versuchen dabei, folgenden Ausdruck zu minimieren:

n

X

i=1

ρ(

ri

)vi pi = min,

σpi

wobei σ den (robust geschätzten) Skalierungsfaktor bezeichnet, pi , vi sind Gewichtsfaktoren, die nur vom Faktorraum, also von den xi. = (xi1 , xi2 , ..., xip )⊤ , abhängen

sollen und üblicherweise zunächst gleich 1 sind, und ρ ist eine Funktion, mit deren

Hilfe wir den Einfluss von den Residuen beschränken können. Diese verallgemeinerte Art der Schätzung nennt man auch M-Schätzung. Im folgenden sind einige

der gebräuchlichsten ρ-Funktionen durch ihre Ableitungen ψ angeführt:

ψLS (t) = t (kleinste Quadrate-Schätzung ).

3.4. Robuste Regression

39

ψL1 (t) = sgn(t), (L1 -Schätzung,

Minimierung der absoluten Abstände).

ψH (t) = max(−c, min(t, c)) mit c > 0 (Huber’s ψ).

t

wenn |t| ≤ a

sgn(t)a

wenn a < |t| ≤ b

ψHA (t) = d−|t|

d−b sgn(t)a wenn b < |t| ≤ d

0

wenn d < |t|

mit 0 < a < b < d (Hampel’s ψ).

ψA (t) =

(

c sin(t/c) wenn |t| ≤ cπ

0

wenn |t| > cπ

mit c > 0 (Andrews’ ψ).

Die erste ψ-Funktion entspricht der kleinsten Quadrate-Schätzung. Durch die

Unbeschränktheit dieser Funktion lässt sich auch die Verwundbarkeit der Schätzung durch Ausreißer in den Residuen erklären. Die anderen ψ-Funktionen sind

beschränkt und damit robust gegen Ausreißer in den Residuen.

Unabhängig von der Gestalt der gewählten ψ-Funktion können Ausreißer im

Faktorraum (in den x-Variablen) die Schätzung immer noch ‘beliebig’ stark beeinflussen. Wir können aber die Gewichte pi und vi der M-Schätzung benutzen,

um den Einfluss der unabhängigen Variablen zu beschränken. Wählen wir die Gewichte identisch 1, so erhalten wir die Schätzung, wie wir sie bisher kennengelernt

haben - die x-Variablen bleiben ungewichtet, und damit ist ihr Einfluss weiter unbeschränkt. Diese Art der Schätzung wird auch Huber-Typ-Schätzung genannt.

Setzen wir nur pi gleich 1, so erhalten wir den sogenannten Mallows-Typ-Schätzer,

bei dem alle Beobachtungen, die im Faktorraum als ‘weit entfernt’ erkannt werden,

ungeachtet der Größe ihres Residuums ein kleineres Gewicht bekommen. Damit

bekommen aber auch Beobachtungen, die durchaus in die Schätzung passen würden, nur auf Grund ihrer Lage im Faktorraum ein niedriges Gewicht. Setzen wir

pi = vi , so erhalten wir die sogenannte Schweppe-Typ-Schätzung, bei der Beobachtungen nur dann ein niedriges Gewicht erhalten, wenn einerseits die Lage im

Faktorraum ‘extrem’ ist, und andererseits das Residuum dieser Beobachtung groß

ist. Die Mallows- und die Schweppe-Typ-Schätzung wird auch robuste Regression

mit beschränktem Einfluss der unabhängigen Variablen genannt (bounded influence

regression).

Als ein Maß der Robustheit eines Schätzers gilt der Bruchpunkt. Damit bezeichnet man jenen Anteil an Ausreißern, der ausreicht, um die Schätzung beliebig

zu beeinflussen und im schlechtesten Fall sinnlos zu machen. Rousseeuw (siehe

40

3.4. Robuste Regression

Rousseeuw and Leroy, 1987) zeigt, dass bei M -Schätzern der Bruchpunkt maximal

1/p werden kann, wobei p die Anzahl der unabhängigen Variablen bezeichnet. Mit

steigender Anzahl der Dimensionen sinkt also der Bruchpunkt rapide. Rousseeuw

schlägt daher eine Methode vor, die unabhängig von der Anzahl der Dimensionen

den Bruchpunkt nahe 0.5 hat, das bedeutet, dass bis zu 50% der Beobachtungen schlecht sein können, ohne dass deshalb die Schätzung zusammenbricht (0.5

ist auch der höchst mögliche Bruchpunkt, wie man sich leicht überlegen kann).

Dabei schlägt er vor, statt der Summe der quadrierten Residuen den Median der

quadrierten Residuen zu minimieren:

med(ri )2 = min.

Wir suchen also jenes Band, das eine minimale Breite hat und 50% der Beobachtungen beinhaltet. Als praktischer Algorithmus bietet sich ein wiederholtes

Ziehen von Unterstichproben der Größe p an, wobei man entweder alle möglichen

Unterstichproben zieht, oder so viele, dass die Wahrscheinlichkeit z.B. 0.95 beträgt,

mindestens eine Probe mit ausschließlich guten Beobachtungen zu erhalten:

0.95 = 1 − (1 − (1 − ε)p )m ,

ε bezeichnet den Anteil der schlechten Beobachtungen im Datensatz, p die Anzahl

der unabhängigen Variablen und m die Anzahl der zu ziehenden Stichproben, damit

die gewünschte Wahrscheinlichkeit erreicht wird.

Die in diesem Kapitel beschriebenen Methoden sind in dem bisher verwendeten

Programmpaket BMDP nicht enthalten. Am Institut für Statistik und Wahrscheinlichkeitstheorie gibt es jedoch FORTRAN-Programme (BLINWDR und PROGRESS),

sowie ein APL-Programmpaket (GRIPS), in dem diese Methoden verwirklicht sind.

Auch S-PLUS und ROBSYS/ROBETH bieten diese Möglichkeiten. Als Lektüre

können die Bücher von Huber (1981), Hampel et al. (1986) und Rousseeuw and

Leroy (1987) empfohlen werden.