Binäre Auswahlmodelle (Logit, Probit, ...)

Werbung

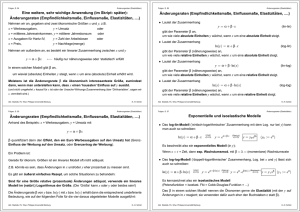

Binäre Auswahlmodelle (Logit, Probit, ...) Folie 2 Warum keine lineare Regression? • Rein technisch ließe sich das Problem durch eine lineare Regression, d.h. eine OLSSchätzung von yi = β0 + β1 xi,1 + . . . βK xi,K + εi Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild behandeln. 27. November 2014 In diesem Kapitel führen wir eine Klasse von Modellen für binäre Auswahlprobleme ein, deren wichtigste Vertreter das Logit- und das Probit-Modell sind. Außerhalb der Ökonometrie wird fast immer das Logit-Modell verwendet. In der Ökonometrie spielt auch das Probit-Modell eine wichtige Rolle. Die binären Auswahlmodelle (Modelle mit einer dichotomen Struktur der erklärten Variable) besitzen Verallgemeinerungen auf die Situation, dass die erklärte Variable eine kategoriale Variable mit endlich vielen (statt zwei) Ausprägungen ist, z.B. ‘schlecht’, ‘mittel’, ‘gut’. Dabei kann man unterscheiden zwischen ungeordneten und geordneten Kategorien. Auf die Verallgemeinerung der binären zu multinomialen Auswahlmodellen (voraussichtlich nur auf das ordered Logit-Modell) gehen wir im nächsten Kapitel ein. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Binäre Auswahlmodelle (Logit, Probit, ...) • Dagegen sprechen mindestens zwei Gründe: 1. Beim lin. Regr.Modell hätte β x die Interpretation einer Wkt., die zwischen 0 und 1 liegen sollte. Beachte dazu: Für eine binäre Variable y gilt P (y = 1 | x) = E[y | x]; unter der Annahme E[y | x] = β x (Exogenitätsannahme!) wird das zu P (y = 1 | x) = β x. Klar: Das Lin. Regr.mod. führt zu unsinnigen Prognosen der Wkt, dass y = 1 bzw. 0 ist 2. Heteroskedastie-Problematik: Verteilung des Störterms ε gegeben x ist ebenfalls binär: E[ε | x] = 0 P (ε = −β x | x) = P (y = 0 | x) = 1 − β x ⇒ P (ε = 1 − β x | x) = P (y = 1 | x) = β x Var[ε | x] = (1 − β x) · β x Zwar ist E[ε | x] = 0, aber die Varianz von ε hängt von x ab (Heteroskedastie). Konsequenzen v. Heterosked. bei OLS: (a) fehlerhafte Inferenzen; (b) Effizienzverlust. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Folie 1 Binäre Auswahlprobleme • Wie bei der linearen Regression soll in diesem Kapitel das Problem betrachtet werden, eine Variable y durch K Variablen x1, . . . , xK zu erklären mit der Einschränkung: Die erklärte Variable y ist binär (dichotom, durch Dummy-Variable zu beschreiben). Wir nehmen an, dass y 0/1-kodiert ist. Die Bezeichnung Binäres Auswahlproblem“ ergibt sich daraus, dass y häufig eine Aus” wahl aus (Entscheidung zwischen) zwei Alternativen repräsentiert. • Einige Beispiele aus der Mikroökonometrie: – Verheiratete (Frauen): berufstätig (y = 1) oder nicht (y = 0); – Arbeitnehmer: arbeitslos (y = 1) oder nicht (y = 0); Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild Folie 3 Einschränkung bei erklärter Variable versus Einschränkung bei erklärender Variable • Es macht einen Unterschied, ob die erklärte Variable (y) oder eine erklärende Variable (x) einer Einschränkung unterliegt (wie die, dass sie eine binäre Variable ist). • Generell: Bei Regressionsanalysen spielt die Verteilung der erklärenden Variablen eine geringe Rolle (es ist lediglich günstiger, wenn die x-Variablen möglichst breit streuen – man kann auch sagen: möglichst weit von einer kollinearen Situation bzw. singulären Varianzmatrix entfernt sind). • Dagegen: Einschränkungen an die Verteilung der erklärten Variable, wie im Fall einer binären Variable, sind problematischer, – Wähler (bei einer Volksabstimmung): Dafür (y = 1) oder dagegen (y = 0); – Krankenversicherte: Gesetzlich (y = 0) oder privat versichert (y = 1); – Unternehmen (in der EU): Credit Rating (von S&P, Moody’s ...) vorhanden oder nicht. • Auch hier oft von Interesse: – Effekte erklärender Variablen x1, . . . , xK auf die ‘Wahl’ y = 0 oder y = 1 – und die Schätzung der Effektstärke auf Basis einer Stichprobe (yi, xi)i=1,...,N . Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg schreibe im Folgenden: β xi Dabei wird schlichtweg ignoriert, dass die erklärte Variable y eine binäre Variable ist. • da sie Restriktionen an die Störterm-Verteilung implizieren, die man (sowohl aus Inferenzals auch aus Effizienzgründen) in der Modellbildung berücksichtigen sollte. • Analoge Anmerkungen gelten allgemein für den Fall kategorialer Variablen: Solche Einschränkungen an die erklärte Variable sollte man modellieren, nicht ignorieren K.-H. Schild Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 4 Binäre Auswahlmodelle (Logit, Probit, ...) Eine Klasse binärer Auswahlmodelle Die Wkt., dass ein Individuum mit den im Vektor x zusammengefassten Merkmalen die Wahl y = 1 statt y = 0 trifft, sei beschrieben durch P (y = 1 | x) = F (β x) Modell F (s) = P (y = 1 | x) Logit Λ(s) = es/(1 + es) s Φ(s) = −∞ ϕ(t)dt Probit Linear Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Folie 5 0 1 n.a. n.a. −0.5772 π 2/6 F −1(p) = Φ−1(p) −1 (p) = p (−0.5) log − log(1 − p) F 1 fLogit fLinear fProbit fCLogLog .6 0 x 0 FProbit FCLogLog 2 4 -4 -2 0 x 2 4 Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 7 Zusammenhang zwischen βj und marginalem Effekt von xj Die Modelle unterscheiden sich hinsichtlich der Wahl der Funktion F . Die am häufigsten verwendeten Modelle sind: • das Logit-Modell, wo F (s) = Λ(s) die kumulative Vtlgsfunktion (c.d.f.) der logistischen Verteilung ist: es Logit: F (s) = =: Λ(s) 1 + es • und das Probit-Modell, bei dem F (s) = Φ(s) die kumulative Vtlgsfkt. der Standardnormalverteilung ist: Probit: F (s) = π 2/3 .2 -2 Logit und Probit als wichtigste Repräsentanten 0 .4 .6 .4 -4 K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) FLogit FLinear 0 • β der Vektor der Regressionskoeffizienten. (Dieser ist auf Basis der vorliegenden Daten (y1, x1), . . . , (yN , xN ) zu schätzen.) .2 • s = β x = β0 + β1 x1 + . . . + βK xK eine Art Index, der auf einer Skala von −∞ bis +∞ misst, wie sehr das Individuum zur Entscheidung y = 1 neigt; (s wird auch als linearer Prädiktor bezeichnet. Durch die Responsefkt. F wird der lineare Prädiktor in eine Wkt. p = F (s) ∈ [0, 1] transformiert.) Varianz Graphen der Responsefktnen (links) u. der zugehörigen Dichten (rechts, Formeln → nä. Folie): .8 als Linkfunktion; konkrete Beispiele für F siehe unten; die Modelle unterscheiden sich hinsichtlich der Wahl von F ) Extremwert Erw.Wert .8 • F (s) eine gegebene Funktion, die das Argument s ∈ (−∞, +∞) monoton wachsend in das Intervall [0, 1] abbildet (F wird auch als Responsefunktion bezeichnet, ihre Umkehrfkt. F −1 Link-Fkt. F −1(p) = p Λ−1(p) = ln 1−p F (s) = s (+0.5) C(s) = 1 − exp − exp(s) 1 Dabei sei/ist: Folie 6 Eigenschaften der am häufigsten verwendeten Modelle 1 2 1 √ e− 2 t dt =: Φ(s) 2π −∞ s Die Regressionskoeffizienten βj eines binären Auswahlmodells sind zwar qualitativ (z.B. in Bezug auf ihr Vorzeichen) leicht zu verstehen, ihre quantitative Interpretation ist allerdings nicht ganz einfach. Denn anders als bei der linearen Regression gibt das βj eines binären Auswahlmodells nicht unmittelbar den Effekt einer marginalen Erhöhung von xj auf P (y = 1) wieder: Als Proportionalitätsfaktor zwischen den beiden tritt der Wert der Dichte f (s) = F (s) im jeweiligen s = β x auf: ∂P (y = 1 | x) Marginaler Effekt von = f (s) · βj , : = xj auf P (y = 1 | x) ∂xj Modell F (s) = P (y = 1 | x) Logit Λ(s) = es/(1 + es) s Φ(s) = −∞ ϕ(t)dt Probit f (s) = F (s), s = β x Dichte f (s) = F (s) λ(s) = Λ(s) 1 − Λ(s) ϕ(s) = √1 2π 1 2 e− 2 s ∂p Marginaler Effekt ∂x j Λ(s) 1 − Λ(s) · βj ϕ(s) · βj F (s) = s (+0.5) f (s) = 1 βj Extremwert C(s) = 1 − exp − exp(s) c(s) = 1 − C(s) exp(s) 1 − C(s) exp(s) · βj Linear • Gelegentlich werden auch andere Funktionen F (s) verwendet, wie die komplementäre log-log-Verteilungsfunktion, die in Verbindung mit einer Extremwertverteilung steht. (Anders als die beiden zuvor genannten ist diese nicht symmetrisch um s = 0.) Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Auf den folgenden Folien: Alternative Interpretationen der βj speziell für das Logit-Modell Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 8 Logit: βj gibt den marginalen Effekt von xj auf die log-odds an Binäre Auswahlmodelle lassen sich als lineare Regressionsmodelle für eine latente (d.h. die Entscheidung diskriminierende, aber unbeobachtete) Variable interpretieren: F −1(p) = β x Dabei stellt der Quotient p 1−p = (∗) Es wird genau dann die Entscheidung ‘y = 1’ statt ‘y = 0’ getroffen werden, wenn der Nutzen aus der Wahl y = 1 denjenigen aus der Wahl y = 0 überschreitet. Schreiben wir y ∗ für die Nutzendifferenz, so ist also P (y=1 | x) P (y=0 | x) 1 falls y ∗ > 0 y = 0 falls y ∗ ≤ 0 die odds (Chancen) für die Auswahl ‘y = 1’ in der Subpopulation mit den Kovariaten x dar. Die odds eines Ereignisses geben an, in welchem Verhältnis die Wkt. p für den Eintritt des Ereignisses zur Wkt. 1 − p für den Nichteintritt des Ereignisses steht. Sie stellen die Chancen für den Eintritt des Ereignisses auf einer Skala 0 bis ∞ dar (statt auf der Skala von 0 bis 1, wie sie für Wkten. p benutzt wird). Die Beziehung (*) zeigt nun: Das Logit-Modell kann man als lineares Regressionsmodell für den natürl. Logarithmus der odds für die Wahl ‘y = 1’ auf die Variablen in x lesen. Beispiel: βj = 0.05: Eine Erhöhung von xj um eine Einheit bewirkt eine Vergrößerung der odds für ‘y = 1’ um 5% (näherungsweise c.p.). Liegen die odds einer Subpopulation bei 3, besteht dort eine dreimal so hohe Wkt. für y = 1 wie für y = 0 (entspricht P (y = 1|x) = 34 ). Bei βj = 0.05 bewirkt eine Erhöhung von xj um eine Einheit in dieser Subpopul. eine Zunahme der odds auf 1.05*3 = 3.15. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 9 βj Logit: Interpretation von e Wir nehmen nun an, dass die latente Variable y ∗ durch ein lineares Regressionsmodell beschrieben werden kann: y ∗ = β x + ε wobei die Verteilung des (negativen) Fehlerterms −ε durch die kumulierte Verteilungsfkt. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild Folie 11 P (y = 1) = P (y ∗ > 0) = P (β x + ε > 0) = P (−ε < β x) = F (β x) und wir erhalten: Bildet man exp auf beiden Seiten, schreibt sich die Formel als = eβ x Für zwei Subpopulationen mit den Kovariaten x und x̃ folgt für das Verhältnis ihrer odds: P (y=1 | x) P (y=1 | x̃) β (x−x̃) P (y=0 | x) P (y=0 | x̃) = e Wenn x̃ sich nur in xj von x unterscheidet, und zwar um 1, entsteht rechts eβj . Links steht dann der Quotient der odds, der sich bei einer c.p.-Erhöhung von xj um eine Einheit ergibt. Diese Größe wird als odds-ratio (infolge einer marginalen Änderung von xj ) bezeichnet: Im Logit-Modell: eβj = odds-ratio, die sich bei Erhöhung von xj um eine Einheit ergibt Zusammengefasst: Beim Logit-Modell gibt βj also den marginalen Effekt von xj auf die log-odds wieder und eβj stellt eine odds-ratio dar. Beides gilt allerdings nur beim Logit-Modell (und z.B. nicht bei Probit). Die gute Interpretierbarkeit der Regr.Koeffizienten ist einer der Gründe für die Popularität des Logit-Modells. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Da die Nutzendifferenz y ∗, anders als die aus ihr resultierende Entscheidung y, unbeobachtet ist, spricht man von y ∗ als einer latenten Variable. (c.d.f.) F beschrieben sei, d.h. P (−ε < s) = F (s). Dann ist als odds-ratio Wir bleiben beim Logit-Modell und betrachten noch einmal die Formel (*): (y=1 | x) log P P (y=0 | x) = β x P (y=1 | x) P (y=0 | x) Folie 10 Latente-Variablen-Interpretation binärer Auswahlmodelle Allgemein lässt sich die definierende Beziehung P (y = 1 | x) = F (β x) umformen zu: für p = P (y = 1 | x) p es ) wird das zu: Speziell beim Logit-Modell (F (s) = 1+es , F −1(p) = log 1−p p = β x für p = P (y = 1 | x) log 1−p Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild Dasjenige Regressionsmodell für die latente Variable y ∗, dessen (negativer) Fehlerterm gemäß der c.d.f. F verteilt ist, entspricht demjenigen binären Auswahlmodell für y, das die Funktion F als Response-Funktion verwendet. [Responsefkt.:Transform. der Werte s = β x in Wkten p = F (s). c.d.f. von X : F (s) = P (X < s)] Wenn umgekehrt im binären Auswahlmodell die Response-Funktion F eine c.d.f. ist, dann lässt sich das binäre Auswahlmodell als lineares Regressionsmodell für eine latente Variable y ∗ interpretieren, dessen negativer Fehlerterm gemäß der c.d.f. F verteilt ist. Die latente Variable lässt sich dabei als Nutzendifferenz interpretieren, deren Vorzeichen sich in der Entscheidung ‘y = 0’ bzw. ‘y = 1’ manifestiert. Das Probit-Modell lässt sich mithin als ein lineares Regressionsmodell für eine latente Variable y ∗ mit normalverteiltem Fehlertermen ε interpretieren. Beim Logit-Modell hat man anstatt der Normalverteilung die logistische Verteilung. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 12 Binäre Auswahlmodelle (Logit, Probit, ...) Folie 14 Schätzung binärer Auswahlmodelle (mit Max. Likelihood) Herleitung der Formel für die Likelihood Abgesehen vom linearen Modell werden binäre Auswahlmodelle fast immer mit Maximum Likelihood geschätzt. Für eine Maximum-Likelihood-Schätzung benötigt man: 1. Aufstellen der individuellen Likelihood (als Funktion der Parameter β mit den Daten (xi, yi) der i-ten Beobachtung als Parametern). Hier: F (β xi) P (yi = 1 | xi; β) f. yi = 1 f. yi = 1 = Li(β) = P (yi = 0 | xi; β) f. yi = 0 1 − F (β xi) f. yi = 0 y 1−yi = F (β xi) i · 1 − F (β xi) • beobachtete Daten (in Form einer Stichprobe) Hier: (x1, y1), . . . , (xN , yN ) • Parameter, deren Wert man schätzen möchte; Hier: Die Regressionskoeffizienten β 2. Aufstellen der Gesamt-Likelihood“, hier: ” N N y 1−yi L(β) = Li(β) = F (β xi) i · 1 − F (β xi) • ein Modell, das die Parameter und die beobachteten Daten in Beziehung setzt; Hier: Das binäre Auswahlmodell P (yi = 1 | xi) = F (β xi). Anmerkung: Das Modell selbst wird bei der ML-Schätzung nicht in Frage gestellt; das Ziel ist die Schätzung der Parameter, unter der Annahme, dass das Modell korrekt spezifiziert ist. Bei der Maximum-Likelihood-Methode schätzt man die Parameter β des Modells so, dass die Wkt, gerade die beobachteten Daten (x1, y1), . . . , (xN , yN ) zu erhalten, maximal wird. i=1 3. und Übergang zur Log-Likelikhood, hier (mit Anwendung der Logarithmus-Gesetze): logL(β) = log L(β) Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 13 Log-Likelihood Funktion des binären Auswahlmodells N i=1 N 1 − yi log 1 − F (β xi) yi log F (β xi) + i=1 Anmerkungen: • Da yi nur die Werte 0 oder 1 annehmen kann, läuft die erste Summe über diejenigen Individuen i, die yi = 1 wählen, die zweite Summe über diejenigen i, die yi = 0 wählen. • Ein großer Wert der logL wird dann erreicht, wenn – die Individuen i mit yi = 1 im Schnitt auch hohe Wkten. F (β xi) = P (yi = 1 | β, xi) für die Wahl yi = 1 aufweisen und – die Individuen i mit yi = 0 im Schnitt auch hohe Wahrscheinlichkeiten 1 − F (β xi) = P (yi = 0 | β, xi) für ihre Wahl yi = 0. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg N i=1 N i=1 log F (β xi) yi 1−yi · 1 − F (β xi) N yi log F (β xi) + 1 − yi log 1 − F (β xi) i=1 Da yi nur den Wert 0 oder 1 annehmen kann, entsteht die logL hier, indem man die logarithmierten F -Werte derjenigen Individuen i, die yi = 1 gewählt haben, summiert und dazu die Summe der logarithmierten komplementären F -Werte derjenigen Individuen i mit yi = 0 addiert. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild Folie 15 Globale Konkavität der log-Likelihood Auch wenn dies für die software-gestützte Anwendung nicht relevant ist, soll die log-Likelihood des binären Auswahlmodells mit der Responsefunktion F hier angegeben werden. Sie ergibt sich als: logL(β) = = = Dazu ist die Likelihood-Funktion L(x1,y1),...,(xN ,yN )(β) zu ermitteln. Die Likelihood-Fkt. muss die Wkt., die beobachteten Daten (x1, y1), . . . (xN , yN ) zu erhalten, in Abhängigkeit vom Parametervektor β wiedergeben. Anstatt der Likelihood-Fkt. wird fast durchgängig deren Logarithmus, die sog. log-Likelihood logL(β ), betrachtet. i=1 K.-H. Schild (Konvergenz des Newton-Verfahrens gegen globales Maximum) Man kann zeigen, dass die log-Likelihood eines Logit- oder Probit-Modells eine global konkave Funktion in β darstellt (d.h. in allen β eine negativ-definite Hesse-Matrix aufweist). Konsequenzen: 1. Sofern überhaupt ein Extremum existiert: Die logL-Fkt. hat eine globale Maximalstelle β̂, für die die Bed. 1. Ordn. (∂logL/∂βj = 0) sowohl notwendig als auch hinreichend ist. Ohne globale Konkavität ist die Bed. erster Ordnung i.d.R. nur eine notwendige Bedingung, d.h. man erhält damit lediglich Kandidaten für eine Extremstelle, die auch Minimalstellen, Sattelpunkte oder nur lokale Extremstellen sein können. 2. Eine softwaregestützte Durchführung der ML-Schätzung wird i.d.R. versuchen, die Bedingung erster Ordnung numerisch zu lösen. Da die Bedingung erster Ordn. ein i.d.R. nicht-lineares Gleichungssystem von K Gleichungen in den K Unbekannten β1, . . . βK darstellt, kommen dazu iterative Verfahren, wie das Newton-Verfahren, zum Einsatz. Ohne globale Konkavität oder Konvexität ist der automatisierte Einsatz iterativer Verfahren oft recht problematisch, da nicht sichergestellt ist, dass das iterative Verfahren überhaupt konvergiert und, sofern ja, ob es gegen das (globale) Maximum konvergiert (siehe Punkt 1.). Mit globaler Konkavität ist beispielsweise für das Newton-Verfahren sichergestellt, dass es – für jeden Startvektor – gegen das globale Maximum konvergiert. Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 16 Binäre Auswahlmodelle (Logit, Probit, ...) Binäre Regressionen in Stata Folie 18 RATING.DTA: Summary statistics Der Befehl zur ML-Schätzung eines Logit- bzw. Probit- bzw kompl.-Log-Log-Modells lautet logit bzw. probit bzw. cloglog. Befehl logistic statt logit gibt odd-ratios eβ̂ statt β̂ aus. Die Syntax ist ansonsten analog zum regress-Befehl, z.B. wird durch logit y x1 x2 eine logistische Regression von y auf x1, x2 (und Konstante) durchgeführt Führt man in Stata eine binäre Regression mit einer nicht-binären erklärten Variable y durch, so werden nicht-positive Werte von y als 0, positive Werte als 1 interpretiert. In der Ausgabe wird zunächst der Fortschritt des numerischen Iterationsverfahrens bei der Maximierung der Log-Likelihood gelistet. Grundsätzlich sollte man den Ergebnissen eines iterativen numerischen Verfahrens kritisch gegenüberstehen (Konvergiert die Iteration überhaupt? Wenn ja, ist ein globales Extremum der Likelihood gefunden worden? Ist es ein Max.?) Wie oben erläutert, ist das bei binären Auswahlmodellen nicht sehr problematisch, da – theoretisch – das iterative Verfahren nur dann versagt, wenn gar kein (endliches) Max. der Likelihood existiert. Dann wird das Ergebnis des (asymptotischen) LR-Tests auf Exkludierbarkeit aller Variablen außer der Konstanten (H0 : β1 = 0, . . . , βK = 0) ausgegeben sowie ein Pseudo-R2 (s.u.). Schließlich folgt ein Tableau mit den geschätzten Regr.Koeffizienten β̂j , ihren (asymptotiˆ β̂j ) und den p-Werten. ˆ β̂j ), der t-Statistik β̂j /se( schen) Std.Fehlern se( . sum booklev marklev ebit_ta re_ta wk_ta logsales rating invgrade Variable | Obs Mean Std. Dev. Min Max -------------+-------------------------------------------------------booklev | 921 .2931868 .1735339 0 .9992067 marklev | 921 .2547287 .1879701 0 .9648595 ebit_ta | 921 .0938921 .0843643 -.3841692 .6515085 re_ta | 921 .1569942 .300684 -.9958922 .9799219 wk_ta | 921 .1404142 .1503398 -.4120839 .7480223 -------------+-------------------------------------------------------logsales | 921 7.995754 1.497413 1.100278 12.70142 rating | 921 3.499457 1.134561 1 7 invgrade | 921 .4723127 .4995041 0 1 Also für ein durchschnittliches Unternehmen: • Fremdkapitalquote (Buch): 30% • Fremdkapitalquote (Markt): 25% • Gewinn pro Jahr ist knapp 10% des (buchmäßigen) Unternehmenswerts Ein Euro buchmäßiges Betriebskapital“ erwirtschaftet jedes Jahr 10 Cent Gewinn (Rendite, Dividende, ...) ” Die t-Statistik wird hier als z -Statistik bezeichnet, da die kritischen Werte bzw. die p-Werte aus einer Normalvtlg. (und nicht: einer t-Vtlg.) genommen werden. • 14% des Unternehmenswerts (= Wert des Kapitals im UN) stecken im Umlaufvermögen • 47% der Unternehmen des Samples haben ein Investment Grade“ ” Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild Folie 17 Binäre Auswahlmodelle (Logit, Probit, ...) Beispiel RATING.DTA: Datenbeschreibung K.-H. Schild Folie 19 RATING.DTA: Logit • Datei RATING.DTA enthält Daten von 921 US-amerik. Unternehmen im Jahr 2005, • rating: alle UN des Samples haben ein Credit Rating“ (von S & P) ” Variable enthält das Rating von S&P auf einer Skala von 0 = ˆ D(efault) bis 7 = ˆ AAA. . logit invgrade $xlist Iteration 0: log likelihood Iteration 1: log likelihood Iteration 2: log likelihood Iteration 3: log likelihood Iteration 4: log likelihood = = = = = -636.97578 -347.34337 -341.11626 -341.07759 -341.07758 • Daraus wurde mit gen invgrade = rating > 3 die 0/1-Variable invgrade generiert. Klasse Nr. 3 entspricht BB”, alle UN mit BBB, A , AA oder AAA-rating gelten als ’‘Investment Grade’, ” solche darunter, d.h. BB, B, C, D als ‘Speculative Grade’ • Außerdem sind in der Datei Buch(d.h. Bilanz)- und Marktdaten der UNen enthalten, wie – booklev = book leverage = buchmäßige Fremdkapitalquote (Anteil an Bilanzsumme) = Verschuldungsgrad = Fremdkapital/Bilanzsumme (debt/total assets), – marklev = dasselbe mit Werten für UN u. FK vom Kapitalmarkt statt aus der Bilanz – ebit ta = Earnings before income and tax / total assets (Gewinn/Bilanzsumme) – re ta = Retained earnings / total assets (Gewinnausschüttung(?)/Bilanzsumme) – wk ta = Working capital / total assets (Umlaufvermögen / Bilanzsumme) – logsales = Log. der Umsätze (misst UN-Größe – Bilanzsumme nicht verfügbar) Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Logistic regression Number of obs = 921 LR chi2(5) = 591.80 Prob > chi2 = 0.0000 Log likelihood = -341.07758 Pseudo R2 = 0.4645 -----------------------------------------------------------------------------invgrade | Coef. Std. Err. z P>|z| [95% Conf. Interval] -------------+---------------------------------------------------------------booklev | -4.427266 .7714185 -5.74 0.000 -5.939218 -2.915313 ebit_ta | 4.354735 1.439922 3.02 0.002 1.532539 7.176931 re_ta | 4.116108 .4885083 8.43 0.000 3.158649 5.073566 wk_ta | -4.012492 .7479141 -5.36 0.000 -5.478377 -2.546607 logsales | 1.081593 .0956839 11.30 0.000 .8940558 1.26913 _cons | -8.214321 .8668543 -9.48 0.000 -9.913324 -6.515317 -----------------------------------------------------------------------------Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 20 Binäre Auswahlmodelle (Logit, Probit, ...) RATING.DTA: Zum Vgl: Linear (OLS) RATING.DTA mit Logit: β̂ über log-odds interpretieren Ergebnis der Logit-Schätzung war: . regress invgrade $xlist invgrade | Coef. Std. Err. z P>|z| [95% Conf. Interval] -------------+---------------------------------------------------------------booklev | -4.427266 .7714185 -5.74 0.000 -5.939218 -2.915313 ebit_ta | 4.354735 1.439922 3.02 0.002 1.532539 7.176931 re_ta | 4.116108 .4885083 8.43 0.000 3.158649 5.073566 wk_ta | -4.012492 .7479141 -5.36 0.000 -5.478377 -2.546607 logsales | 1.081593 .0956839 11.30 0.000 .8940558 1.26913 _cons | -8.214321 .8668543 -9.48 0.000 -9.913324 -6.515317 Aufgabe: Sämtliche β̂ über log-odds interpretieren. Formel war: log Beispiel: Source | SS df MS -------------+-----------------------------Model | 103.21462 5 20.6429241 Residual | 126.329354 915 .138064867 -------------+-----------------------------Total | 229.543974 920 .24950432 odds f. ‘y = 1’ P (y=1 | x) P (y=0 | x) = β x β̂booklev = −4.4: Wenn der Verschuldungsgrad um (seine Einheit, also) 100% steigt, sinken die Odds für die Klassifikation ‘investment grade’ (statt ‘speculative grade’) um 440% (um 4.4 × Einheit odds, das sind 100%). Mit jedem Prozent Verschuldungsgrad mehr also 4.4% weniger Chancen“ (im Sinne von ” odds), ein InvestmentGrade-Rating zu erhalten (oder: 4.4% mehr Risiko, gemessen in odds, für ein ’speculative Grade’-Rating. Z.B.: Bei UNen mit odds von 0.5 – halb so große P(InvGrade) wie P(SpecGrade)– führt ein Prozent mehr Leverage zu odds von (1 - 0.044)*0.5 = 0.478, bei odds von 2 zu (1-0.044)*2 = 1.912) Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild Folie 21 = = = = = = = = = = = 921 149.52 0.0000 0.4497 0.4466 .37157 Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild Folie 23 RATING.DTA: CLogLog . cloglog Iteration Iteration Iteration Iteration Iteration -636.97578 -345.74046 -342.76979 -342.7586 -342.75859 invgrade 0: log 1: log 2: log 3: log 4: log $xlist likelihood likelihood likelihood likelihood likelihood = = = = = -457.98395 -342.35019 -339.74036 -339.73126 -339.73126 Complementary log-log regression Number of obs = 921 Zero outcomes = 486 Nonzero outcomes = 435 LR chi2(5) = 594.49 Log likelihood = -339.73126 Prob > chi2 = 0.0000 -----------------------------------------------------------------------------invgrade | Coef. Std. Err. z P>|z| [95% Conf. Interval] -------------+---------------------------------------------------------------booklev | -2.882513 .5292876 -5.45 0.000 -3.919898 -1.845129 ebit_ta | 3.020533 .8366154 3.61 0.000 1.380797 4.66027 re_ta | 3.060518 .3406317 8.98 0.000 2.392892 3.728144 wk_ta | -2.936858 .496712 -5.91 0.000 -3.910395 -1.96332 logsales | .6830403 .0559354 12.21 0.000 .5734089 .7926716 _cons | -5.742326 .5557671 -10.33 0.000 -6.831609 -4.653042 Probit regression Number of obs = 921 LR chi2(5) = 588.43 Prob > chi2 = 0.0000 Log likelihood = -342.75859 Pseudo R2 = 0.4619 -----------------------------------------------------------------------------invgrade | Coef. Std. Err. z P>|z| [95% Conf. Interval] -------------+---------------------------------------------------------------booklev | -2.55615 .4334149 -5.90 0.000 -3.405628 -1.706672 ebit_ta | 2.109837 .7610309 2.77 0.006 .6182443 3.601431 re_ta | 2.380991 .2672343 8.91 0.000 1.857222 2.904761 wk_ta | -2.198055 .4170333 -5.27 0.000 -3.015426 -1.380685 logsales | .6002705 .0503303 11.93 0.000 .5016248 .6989161 _cons | -4.510692 .4657989 -9.68 0.000 -5.423641 -3.597743 -----------------------------------------------------------------------------Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Number of obs F( 5, 915) Prob > F R-squared Adj R-squared Root MSE -----------------------------------------------------------------------------invgrade | Coef. Std. Err. t P>|t| [95% Conf. Interval] -------------+---------------------------------------------------------------booklev | -.4465031 .0867871 -5.14 0.000 -.6168279 -.2761783 ebit_ta | .3986857 .1666036 2.39 0.017 .0717162 .7256552 re_ta | .4348789 .0500627 8.69 0.000 .3366279 .53313 wk_ta | -.4132102 .0891478 -4.64 0.000 -.5881681 -.2382522 logsales | .1331835 .0094693 14.06 0.000 .1145994 .1517677 _cons | -.5093676 .0927605 -5.49 0.000 -.6914157 -.3273195 ------------------------------------------------------------------------------ RATING.DTA: Probit . probit invgrade $xlist Iteration 0: log likelihood Iteration 1: log likelihood Iteration 2: log likelihood Iteration 3: log likelihood Iteration 4: log likelihood Folie 22 K.-H. Schild Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 24 Stata Do-File zum Vgl. der Ergebnisse Binäre Auswahlmodelle (Logit, Probit, ...) Laut Amemiya: use rating.dta, clear global xlist booklev ebit_ta re_ta wk_ta logsales * lineare Regression regress invgrade $xlist estimates store RLinear * Logit logit invgrade $xlist estimates store RLogit * Probit probit invgrade $xlist estimates store RProbit * kompl. Log-Log cloglog invgrade $xlist estimates store RCloglog β̂Logit ≈ 4 β̂OLS β̂P robit ≈ 2.5 β̂OLS β̂Logit ≈ 1.6 β̂P robit Relationen zum lin. Modell hier nicht sehr gut erfüllt, eher β̂Logit ≈ 10 β̂OLS β̂P robit ≈ 7 β̂OLS β̂Logit ≈ 1.6 β̂P robit Anmerkung KHS: Die Relationen müssten denen der Standardabweichungen der zugrundeliegenden Verteilung entsprechen (siehe Tabelle vorne). D.h. es müsste gelten: estimates table RLinear RLogit RProbit RCloglog, b(%8.3f) se stats(N r2 r2_p ll) eq(1) Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Binäre Auswahlmodelle (Logit, Probit, ...) K.-H. Schild Folie 25 β̂Logit ≈ β̂cLogLog ≈ β̂cLogLog ≈ π √ 3 π √ 6 √1 2 β̂P robit = 1.81 β̂P robit β̂P robit = 1.28 β̂P robit β̂Logit = 0.71 β̂Logit Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg K.-H. Schild Binäre Auswahlmodelle (Logit, Probit, ...) Folie 27 2 Vgl. der Ergebnisse Goodness-of-Fit (Pseudo-R ) Ziel: Man möchte auf einer Skala von 0 bis 1 angeben, wie gut die β̂ xi die yi approximieren. In linearen Regr.modellen hat man dazu das R2, das angibt wieviel der Varianz in y durch den Modell-Fit ŷ erklärt wird. Da bei binären Auswahlmodellen die Varianzzerlegung nicht gilt, existiert dort kein direktes Analogon dazu. Man spricht bei den folgenden Größen von einem Pseudo- oder Quasi-R2: Da LogL0 < LogL1 < 0, R2 1 gilt 0 < R2 < 1 1 2 Rpseudo = 1− Pseudo R2 1 + 2(logL − logL )/N -----------------------------------------------------Variable | RLinear RLogit RProbit RCloglog -------------+---------------------------------------booklev | -0.447 -4.427 -2.556 -2.883 | 0.087 0.771 0.433 0.529 ebit_ta | 0.399 4.355 2.110 3.021 | 0.167 1.440 0.761 0.837 re_ta | 0.435 4.116 2.381 3.061 | 0.050 0.489 0.267 0.341 wk_ta | -0.413 -4.012 -2.198 -2.937 | 0.089 0.748 0.417 0.497 logsales | 0.133 1.082 0.600 0.683 | 0.009 0.096 0.050 0.056 _cons | -0.509 -8.214 -4.511 -5.742 | 0.093 0.867 0.466 0.556 -------------+---------------------------------------N | 921 921 921 921 r2/r2_p | 0.450 0.465 0.462 ll |-392.028 -341.078 -342.759 -339.731 -----------------------------------------------------legend: b/se Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg Folie 26 Annähernd feste Relationen in den Schätzungen der versch. Modelle 1 2 RM cF adden 0 logL1 = 1− logL0 McFadden R2 LogL0 Dabei ist jeweils 0 0 LogL1 • logL1 die Log-Likelihood des vollständigen Modells (in der ML-Schätzung β̂) und • logL0 die Log-Likelihood des Modells nur mit Konstante (so dass logL0 ≤ logL1 ≤ 0). Letztere lässt sich theoretisch (auch ohne Durchführung der numerischen Maximierung) wie folgt ermitteln: Es ist klar (bzw. man kann leicht zeigen), dass die ML-Schätzung des Modells nur mit Konstante“ die ” Wkt. p = P (y = 1 | x) = P (y = 1) auf den Anteil der Individuen, die y = 1 wählen, schätzt: p̂ = N1/N . D.h. der (einzige) unbekannte Koeffizient β0 wird so geschätzt, dass F (β̂0) = F (ŝ) = P (y = 1) = p̂ = N1/N . Mit der allgemeinen Formel für die Log-Likelihood ergibt sich (unabh. von F ): logL0 = N1 log(N1/N ) + N0 log(N0/N ), K.-H. Schild Abt. Statistik, Fb. Wirtschaftswissenschaften, Philipps-Universität Marburg N0 = N − N1 K.-H. Schild