Kompaktübersicht Bäume – as

Werbung

Kompaktübersicht Bäume

Diese Übersicht entstand im Wintersemester 2003/04 parallel zur Vorlesung Grundzüge der Informatik III an der Technischen Universität Darmstadt (TUD) und soll die behandelten Aspekte zum Thema Bäume kompakt zusammenfassen.

Die in der Vorlesung verwendeten Materialen welche auch die Grundlage dieser Zusammenfassung darstellen waren:

TUD Skript von H. Waldschmidt, K. Guntermann: Grundzüge der Informatik III - Nichtnumerische Algorithmen und

Datenstrukturen (3. verbesserte Auage; Stand September 2003), die begleitenden Folien zur Vorlesung im WS2003/04

von Prof. A. Buchmann, PhD, sowie die ebenfalls verwendeten Folien des WS2001/02 (Dr. Felix Gärtner).

Für Korrekturen bin ich jederzeit dankbar und wünsche viel Erfolg beim Einstieg in das Thema!

- Andreas Schwarzkopf

Inhaltsverzeichnis

1 Zusammenfassung zu Bäumen

3

1.1

Bäume allgemein . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3

1.2

gerichtete Bäume - auch: orientierte Bäume

3

1.3

Baumdenition . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3

1.4

weitere Denitionen (Knoten) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3

1.5

weitere Denitionen (Bäume)

3

1.6

geordnete Bäume . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3

1.7

Binärbäume - binary trees . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4

1.8

. . . . . . . . . . . . . . . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

spezielle Binärbäume . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4

1.8.1

Strikte Binärbäume

4

1.8.2

Ausgeglichene Binärbäume

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4

1.8.3

Fast vollständige Binärbäume . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4

1.8.4

Vollständige Binärbäume

1.8.5

Erweiterte Binärbäume

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4

2 Traversierung von (Binär-)Bäumen

5

3 Implementieren von Bäumen

5

3.1

Feldbäume . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

5

3.2

Sequentielle Verfahren

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

5

3.3

Dynamische Struktur . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

5

4 Fädelung

6

5 Binäre Suchbäume

6

5.1

Positionssuche in binären Suchbäumen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6 Balancierte binäre Suchbäume

6.1

6.2

Höhenbalancierte binäre Suchbäume

7

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7

6.1.1

AVL - Bäume (Adelson-Velskii und Landis 1962) . . . . . . . . . . . . . . . . . . . . . . .

8

6.1.2

Höhe von AVL Bäumen: . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

8

6.1.3

Fibonacci-Bäume:

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

8

Gewichtsbalancierte binäre Suchbäume . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

9

7 Optimale binäre Suchbäume

9

8 Sortieren mit Bäumen

8.1

7

Tree Sort

10

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

10

8.1.1

Tournament sort

8.1.2

Standard Tournament Sort (Auswahlverfahren) . . . . . . . . . . . . . . . . . . . . . . . .

10

10

8.1.3

Tournament Sort with replacement (Auswahlverfahren mit Ersetzen) . . . . . . . . . . . .

10

8.1.4

2-Wege Mischen

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

10

8.2

Heapsort . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

11

8.3

Proxmap Sort . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

11

1

9 Mehrwegbäume

11

9.1

m-Wege Suchbäume

9.2

Denition m-Wege Suchbäume

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

12

9.3

B-Baum . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

12

9.3.1

Denition B-Baum . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

12

9.3.2

Klasse

9.3.3

Höhe und Schlüsselanzahl eines B-Baums der Klasse

9.3.4

Einfügen in einen B-Baum der Klasse

9.3.5

Löschen in einem B-Baum der Klasse

τ (k,

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

h) eines B-Baums . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

τ (k, h)

τ (k, h)

h) . . . . . . . . . . . . . . . . .

13

13

. . . . . . . . . . . . . . . . . . . . . . . . .

13

. . . . . . . . . . . . . . . . . .

13

. . . . . . . . . . . . . . . . . .

14

. . . . . . . . . . . . . . . . . .

14

∗

∗

k , h )

. . . . . . . . . . . . .

15

. . . . . . . . . . . . . . . . . .

15

. . . . . . . . . . . . . . . . . .

15

. . . . . . . . . . . . . . . . . .

15

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

15

9.5

2-3 Baum

9.6

Binäre B-Bäume

9.7

Symmetrische binäre B-Bäume, SBB-Baum

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

10 Digitale Suchbäume

10.1 m-ärer Trie

12

. . . . . . . . . . . . . . . . . . . . . . . . .

∗

B-Baum mit Mehrfachüberlauf (international: B Bäume)

∗

+

B -Baum (international B tree) . . . . . . . . . . . . . . . . . .

+

∗

∗

9.4.1

Denition B Baum der Klasse τ (k, k , h ) . . . . . . . .

+

9.4.2

Höhe und Schlüsselanzahl eines B -Baums der Klasse τ (k,

∗

∗

9.4.3

Operationen in einem B-Baum der Klasse τ (k, k , h ) . .

+

9.4.4

Präx B -Baum . . . . . . . . . . . . . . . . . . . . . . .

+

9.4.5

Vergleich B-Baum und B -Baum . . . . . . . . . . . . . .

9.3.6

9.4

τ (k,

11

16

17

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

10.1.1 Trie Optimierung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

10.2 Binäre Digitale Suchbäume

16

17

17

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

17

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

18

10.2.2 Binärer Radix Baum . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

18

10.2.1 PATRICIA-Baum

2

1

Zusammenfassung zu Bäumen

1.1

Bäume allgemein

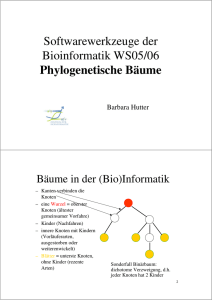

- Bäume sind eine wichtige Teilmenge der Graphen

- sie sind zusammenhängend, azyklisch und einfach (ungerichtet, keine Mehrfachkanten)

- es gibt einen ausgezeichneten Knoten: die Wurzel

- Darstellung: zu jedem Baum existiert ein isomorpher Graph, auch Mengendarstellung möglich

- i.A. zeichnet man die Wurzel oben und die weiteren Knoten auf tiefer liegende Ebenen

1.2

gerichtete Bäume - auch: orientierte Bäume

- Kanten sind einfach aber gerichtet

- Wurzel bestimmt auch die Orientierung der Kanten

- implizite Orientierung: Kanten von Wurzel weggerichtet

- explizite Orientierung: Kanten zeigen zur Wurzel hin

1.3

Baumdenition

- Baumstruktur wird rekursiv deniert

- Denition: Ein orientierter Wurzelbaum ist eine endiche Menge B von Elementen die entweder leer ist, oder

für die gilt:

◦

◦

in B existiert ein ausgezeichnetes Element w ohne Vorgänger: die Wurzel

die Elemente von B

\

{w} lassen sich disjunkt in B1 . . . Bm zerlegen, so daÿ jedes Bi wieder ein

orientierter Wurzelbaum ist.

- kurz: {} und {w} sind Bäume

- wenn B1 . . . Bm Bäume sind, so ist B = {w}

∪

B1

∪

B2

∪

. . . ∪ Bm ebenfalls ein Baum

- B1 . . . Bm heiÿen Unterbäume von B

1.4

weitere Denitionen (Knoten)

- Ist w die Wurzel eines (Teil-)Baumes B(i) , so sind alle übrigen Knoten (B

\

{w})

Nachfahren von w

- Ist in einem Teilbaum das Wurzelelement A und sind B, C, D... die direkten Nachfolger, so sagt man:

◦

◦

◦

- die

B, C, D... sind die Kinder (äquivalent: Kindknoten, Sohn, Nachfolger)

Knoten mit gleichem Elternknoten (B, C, D...) werden oft als Geschwister bezeichnet

Stufe (oder Ebene) eines Knotens ist die Länge des Pfades von der Wurzel zu ihm

◦

◦

- der

A ist der Elternknoten (äquivalent: Vater, Vorgänger)

entspricht also dem Zählen der Kanten bis zum Knoten

(Stufe der Wurzel) = 0, (Stufe des Knotens v) = (Stufe des Vaters von v) + 1

Grad eines Knotens (auch Ordnung ) bezeichnet die Anzahl der Nachfolger

Blatt, alle anderen innere Knoten

- Knoten v mit Grad(v) = 0 heiÿen

1.5

weitere Denitionen (Bäume)

Höhe des Baumes ist die maximale Stufe + 1, also die Anzahl der Ebenen

Gewicht eines Baumes ist die Anzahl seiner Blätter

der Grad eines Baumes (auch Ordnung ) wird durch den Knoten mit maximalem Grad bestimmt

der Grad des Baumes wird häug auch als fan-out (engl. Anzahl ausgehender Kanten) bezeichnet

Bäume sind ähnlich : Sie besitzen die gleiche Struktur (sehen vom Aufbau her gleich aus)

Bäume sind äquivalent : Sie sind ähnlich und enthalten die gleiche Information

als natürlichen Baum bezeichnet man einen Baum, der durch iteratives Einfügen von Elementen entsteht, also

- die

- das

-

natürlich (= ohne Reorganisation) wächst

- eine spezielle, meist unerwünschte Form natürlicher Bäume ist der

entartete Baum : Höhe des Baumes ist gleich

der Anzahl seiner Knoten

1.6

geordnete Bäume

- ist die Reihenfolge der Nachfolger relevant handelt es sich um einen

- die Unterbäume eines Knotens bilden eine geordnete Menge

- Nachfolger lassen sich nummerieren:

erstes Kind, zweites Kind, . . .

3

geordneten Baum

1.7

Binärbäume - binary trees

- binäre Bäume sind geordnete Bäume mit Grad 2

- Denition: Ein Binärbaum ist eine endliche Menge B von Elementen die entweder leer ist, oder für die gilt:

◦

◦

in B existiert ein ausgezeichnetes Element w ohne Vorgänger: die Wurzel

die Elemente von B

\

{w} lassen sich disjunkt in die Binärbäume B1 (linker Unterbaum) und B2

(rechter Unterbaum) zerlegen

- jeder Binärbaum auÿer dem leeren Baum ist also geordnet, aber nicht jeder geordnete Baum ist auch binär

- die maximale Anzahl an Knoten in einem Binärbaum der Höhe h beträgt

- die maximale Anzahl an Knoten auf Stufe i

1.8

≤

h beträgt

2h − 1

i

2

spezielle Binärbäume

1.8.1 Strikte Binärbäume

- jeder innere Knoten hat Grad 2

- d.h.: entweder zwei oder keinen Nachfolger

1.8.2 Ausgeglichene Binärbäume

- ein fast ausgeglichener Binärbaum mit k+1 Stufen ist bis Stufe k vollständig

- jeder Knoten, dessen Stufe kleiner k ist, hat Grad 2

1.8.3 Fast vollständige Binärbäume

- ein fast vollständiger Binärbaum mit k+1 Stufen ist bis Stufe k vollständig

- jeder innere Knoten, der einen rechten Nachfahren auf Stufe k+1 hat, besitzt einen vollständigen linken

Teilbaum mit Blättern auf Stufe k+1

- damit ist jeder vollständige Binärbaum auch strikt, aber nicht umgekehrt

- jeder fast vollständige Binärbaum ist ausgeglichen, aber nicht umgekehrt

1.8.4 Vollständige Binärbäume

- ein vollständiger Binärbaum hat für seine Höhe die volle Anzahl an Knoten, das heiÿt:

- jeder Knoten der letzten Stufe k ist ein Blatt und jeder Knoten auf Stufe i

<

- jeder vollständige Binärbaum ist strikt, aber nicht umgekehrt

1.8.5 Erweiterte Binärbäume

- wird an jeden freien Platz ein besonderer (externer) Knoten angehängt, spricht

man von einem

erweiterten Binärbaum

- der entstehende Baum hat nur noch die externen Knoten als Blätter

- hatte der Binärbaum n Knoten, erhält er n+1 externe Knoten dazu - die

externe Pfadlänge ist die Summe der Längen aller Pfade von der Wurzel zu

den Blättern (= externen Knoten)

- die

interne Pfadlänge ist die Summe der Längen aller Pfade von der Wurzel

zu den inneren Knoten

- es gilt:

-

Extern = Intern + 2n

gewichtete Binärbäume sind erweiterte Binärbäume deren externen Knoten

Si

Gewichte

qi

zugeordnet werden.

- die gewichtete Externe Pfadlänge ist deniert als

Extw =

4

Pi=1

n+1

Stuf e(Si ) · qi

k hat zwei Nachfolger

2

Traversierung von (Binär-)Bäumen

Unter

Traversierung versteht man das Durchlaufen eines Baumes. Die Traversierung ergibt eine lineare Ord-

nung der Knoten. Beim Abarbeiten der Informationen eines Binärbaumes gibt es an jedem Knotens nur drei

Möglichkeiten:

- Verarbeitung der Information der Wurzel:

W

L

- Verarbeitung des rechten Teilbaumes: R

- Verarbeitung des linken Teilbaumes:

Da für gewöhnlich der linke Teilbaum vor dem rechten Teilbaum traversiert wird, ergeben sich automatisch die

folgenden Permutationen:

- W L R: Vorordnung (preorder )

- L W R: Zwischenordnung (inorder )

- L R W: Nachordnung (postorder )

3

Implementieren von Bäumen

Es gibt 2 Ansätze Bäume zu implementieren: statisch oder dynamisch

Feldbaum und andererseits das rein sequentielle

Array implementiert. Die Variante per dynamischer Struktur

Die gängigen statischen Verfahren sind einerseits der sogenannte

Verfahren. Beide werden in der Regel mit einem

wird als

Listenstruktur verwaltet.

Die statischen Verfahren zeigen eine hohe Ezienz bei der Traversierung, die dynamische Variante bietet demgegenüber eine ezientere Speicherbelegung und höhere Flexibilität.

3.1

Feldbäume

Feldbäume werden meist als Array implementiert.

Beispiel: Für einen Binärbaum erfolgt die Verwaltung als eine Art Tabelle, deren Zeilen nummeriert

sind und drei Spalten umfassen:

Die

eigentliche

Nutzlast,

die

Zeilennummer

des

linken Kindes und die Zeilennummer des rechten

Kindes. Als Einstieg in die Struktur benötigt man

eine Variable, die die Zeilennummer der Wurzel

speichert, sowie zur Arbeit mit der Struktur eine Variable, welche die erste freie Zeile referenziert. Jede

freie Zeile enthält als Nutzlast die nächste freie Zeile.

3.2

Sequentielle Verfahren

Das Prinzip hinter den sequentiellen Verfahren ist

das Einsparen der Verweise auf die Kindknoten durch

physisch eindeutige Lagerung der Informationen.

Zum Beispiel kann man die Knoten Ebene für Ebene

abspeichern, jeweils von links nach rechts - wie unschwer zu erkennen ist, bietet sich diese Möglichkeit

eher für dicht besetzte Bäume an, da nicht vorhandene Knoten im Array mitgespeichert werden müssen,

also trotzdem Platz benötigen...

3.3

Dynamische Struktur

Am exibelsten lassen sich Bäume mit

Listen verwalten.

Eine Listenimplementation eines Binärbaumes könnte zum Beispiel folgenden Aufbau haben:

Es gibt einen Zeiger

root, der den Wurzelknoten referenziert.

Jeder Knoten ist ein Objekt mit einer Nutzlast, einem linken und einem rechten Zeiger auf einen anderen Knoten. Die Zeiger entsprechen

den Kanten des Baums. Existiert kein Nachfolger, ist der entsprechende

Zeiger

null. Blätter sind also Knoten deren Zeiger beide Nullpointer sind.

Erfolgt die Traversierung bei Listenstrukturen iterativ, muss ein Kellerspeicher (Stack) implementiert werden.

5

4

Fädelung

Die Idee der Fädelung: Man erweitert die Struktur der Knoten um weitere Pointer (Fädelungszeiger).

Diese haben die Aufgabe das nächste Element zu

referenzieren, welches verarbeitet werden soll.

Je nachdem welche Traversierung man bevorzugt,

kann man die Fädelung entsprechend vornehmen. Es

ist ebenfalls möglich von links nach rechts oder von

rechts nach links zu fädeln - je nachdem in welcher

Reihenfolge die Knoten besucht werden sollen.

Analysiert man einen nach diesem Schema gefädelten Binärbaum auf Listenbasis stellt man fest, daÿ

ein Groÿteil der Zeiger ungenutzt ist:

Jedes Blatt hat zwei Nullpointer - einen für den rechten und einen für den linken (nicht vorhandenen) Sohn.

Die Fadenzeiger der inneren Knoten sind bei Vorordnung parallel zu den vorhandenen Strukturzeigern - also

redundant. Es gelingt also einen solchen Baum ohne Einführung neuer Zeiger zu fädeln.

Man muss lediglich beachten, daÿ jeder Knoten nun eine Information

über den Typ seiner Zeiger mitführen muss, da nun nicht mehr eindeutig

erkennbar ist, welche Zeiger Fädelungspointer sind!

Wir erweitern nun die Struktur um je einen boolschen Wert pro Zeiger,

der angibt ob es sich um einen Fadenzeiger handelt. Es entsteht ein

rechts-links-gefädelter Binärbaum in Vorordnung, wenn wir den linken

Verweis der Blätter zur Linksfädelung und den rechten zur Rechtsfädelung nutzen.

5

Binäre Suchbäume

- jeder Knoten N enthält Daten und einen zugehörigen Schlüssel

kN

(der Sortierschlüssel )

- die Schlüsselwerte sind eindeutig und aus einer geordneten Menge

- für jeden Knoten N mit linkem Nachfolger L und rechtem Nachfolger R gilt:

-

kL < kN < kR

natürliche binäre Suchbäume entstehen durch iteratives Einfügen von Elementen

- Einsparung der Reorganisationskosten kontra entartete Fälle...

- bei

n

n!Permutationen

von denen viele ähnlich sind

2n

1

unterschiedliche natürliche Suchbäume

n+1

n

Schlüsseln gibt es

- es gibt für n Knoten

- Basisoperationen: Einfügen, Suchen, Löschen

- Einfügen und Suchen sind relativ einfach zu implementieren, man biegt sozusagen einfach links oder rechts

ab, je nachdem was der Vergleich mit dem Schlüssel ergab

- Löschen ist etwas komplizierter, da man Fälle unterscheiden muss:

◦

◦

Knoten ist ein Blatt: Er kann einfach gelöscht werden

Knoten hat einen rechten oder linken Nachfolger: Verweis des Vorgängers auf den einzigen Nachfolger setzen

◦ Knoten hat Grad 2: Nimm entweder kleinstes Element des rechten oder gröÿtes Element des linken

Teilbaums (es handelt sich dabei um ein Blatt). Ersetze den zu löschenden Knoten durch dieses

Element. Nun gilt wieder: Elemente des linken Teilbaums sind kleiner, Elemente des rechten

Teilbaumes sind gröÿer.

- Maximale mittlere Zugriskosten ergeben sich bei entarteten Suchbäumen und liegen in O(n)

- Minimale mittlere Zugriskosten sind bei ausgeglichenen Suchbäumen zu erwarten und liegen durch das Divide and Conquer Prinzip der binären Suche (im Idealfall wird der Suchraum in jedem Schritt halbiert) in O(log2 n)

6

5.1

Positionssuche in binären Suchbäumen

- Beobachtung für direkt indizierte Zugrie: Sequentielle Datenstrukturen besser...

⇒

O(1)

- Beispiel sortiertes Array: Element an 3-ter Stelle ist im Array auch dort mit einem Abruf bereit

- beim Abstieg in binären Suchbäumen unklar, ob Element im linken oder rechten Teilbaum zu nden ist

- die geordnete Ausgabe eines Binärbaumes erfolgt durch inorder Traversierung (LWR)

- um den Aufwand bei der indizierten Elementsuche zu minimieren wird neue Denition notwendig:

- Denition: unter dem

Rang eines Knotens versteht man die Anzahl der Knoten im linken Unterbaum + 1

- jeder Knoten speichert nun seinen aktuellen Rang

- man kann von jedem Knoten lokal entscheiden wieviele Knoten sich weiter links in der Struktur benden

- das kann beim Abstieg im Baum dazu verwendet werden um einen bestimmten Knoten schnell zu nden:

Algorithmus zum Finden des k-ten Elements einer sortierten Datenmenge im Binärbaum:

1. INITIALISIERUNG:

setze Aktueller Knoten AK = Wurzel

setze i = k

2. WENN i = Rang(AK) DANN

Knoten gefunden; fertig

3. WENN i < Rang(AK) DANN

AK = linkes Kind, weiter bei 2.

4. WENN i > Rang(AK) DANN

i = i - Rang(AK)

AK = rechtes Kind, weiter bei 2.

Betrachtet man einem Teilbaum so erkennt man,

dass der Rang eines Wurzelknotens immer seiner

Position der Ausgabe in Zwischenordnung (inorder, LWR) entspricht.

6

Balancierte binäre Suchbäume

6.1

Höhenbalancierte binäre Suchbäume

- Problem: Natürliche Binärbäume können degenerieren (entarten)

- Beispiel: 1 Mio. Elemente; entarteter

◦

◦

Mittlerer Fall entartet: n/2

⇒

⇔

ausgeglichener Binärbaum

500000 Schritte

Mittlerer Fall ausgeglichen: log2 n-1

⇒

19 Schritte

- Abhilfe: Pfadlängendierenz durch Reorganisationsalgorithmen beschränken

- höhenbalancierte Bäume: Beschränken der Höhendierenz der Unterbäume

- Überlegung: globale Reorganisation relativ teuer (∈ Ω(n))

- fast ausgeglichene Bäume sind einfacher zu reorganisieren

- Denition:

BL (x) und BR (x) sind linker und rechter Unterbaum des Knotens x,

h(B) die Höhe eines Baumes B

ein k-balancierter Binärbaum ist entweder leer oder es gilt für

jeden Knoten x:

|h (BL (x)) − h (BR (x))| ≤ k

- die Balance kann bzw. muss lokal an allen Knoten gemessen werden

- der maximaler Höhenunterschied an beliebigen Knoten x deniert also die Balance des Baumes

- Vorteil der Lokalität: Knoten der das Kriterium verletzt (≤

k)

kann lokal in O(log2 (n)) korrigiert werden

- Denition auch auf andere Arten möglich, z.B. ausgeglichen bezüglich der Gewichte der Unterbäume

7

6.1.1 AVL - Bäume (Adelson-Velskii und Landis 1962)

- Denition: Ein AVL-Baum ist ein 1-balancierter Binärbaum

- demnach lautet das AVL Kriterium:

|h (BL (x)) − h (BR (x))| ≤ 1

- Folgerung 1: an jedem Knoten x gilt: linker und rechter Teilbaum sind auch AVL-Bäume

- Folgerung 2: es handelt sich nur um einen speziellen binären Suchbaum: Änderungen betreen also die vorhandenen Algorithmen nur dort, wo die Invarianz der AVL Bedingung gefährdet ist

- Implemetierung: Jeder Knoten x speichert seinen Balancierungsfaktor BF(x) =

h (BL (x)) − h (BR (x))

- nach Änderung in einem Unterbaum erfolgt Neuberechnung des BF

- -1, 0, 1 erfüllen das Kriterium, ansonsten Reorganisation notwendig

- Reorganisation erfolgt durch Rotationen an den betroenen Knoten

- prüft man die verschiedenen Fälle beim Einfügen in AVL Bäume an Beispielen nach ergibt sich:

◦ AVL Kriterium kann nur auf dem Pfad von der Wurzel zur Einfügeposition verletzt werden

◦ dabei entstehen an den betroenen Wegknoten Balancierungen mit ± 2

◦ der Weg vom nächsten ±2 Knoten zur Einfügeposition ist eine doppelte rechts/links - Kombination

◦ je nach Art genügt eine einfache oder doppele Rotation um AVL Kriterium wiederherzustellen:

◦

◦

◦

◦

◦

→ Linksrotation

→ Rechtsrotation

Rechts-Links → Doppelrotation

Links-Rechts → Doppelrotation

Rechts-Rechts

Links-Links

rechts-links

links-rechts

diese Rotationen genügen um immer wieder das AVL Kriterium herzustellen

- Einfügen benötigt maximal eine der eben genannten Rotationen

- Löschen ist komplizierter, auf dem Weg zur Wurzel sind ggf. mehrere Rotationen erforderlich.

- Lösung: Löschen wird auf das Löschen von Randknoten zurückgeführt, der Balancefaktor muss rekursiv an

allen Knoten auf dem Pfad zur Wurzel hin neu berechnet und angepasst werden

- Allgemein nach Löschen prüfen: Hat sich die Höhe des betrachteten AVL Unterbaumes geändert? falls ja:

Rebalancierung rekursiv auf Elternknoten anwenden

6.1.2 Höhe von AVL Bäumen:

- Ziel war: relativ ausgeglichener Baum

- durch das AVL Kriterium ist Degeneration nicht möglich

- Überlegung zu worst-case AVL Baum führt zu Fibonacci-Bäumen

- Satz über die Höhe der AVL-Bäume (siehe Fibonacci Bäume):

Für die Höhe h(B) eines AVL Baumes B mit n Knoten gilt:

[log2 n] + 1 ≤ h(B) ≤ 1.44log2 (n + 1)

- da die Höhe auch die Pfadlänge beschränkt ist der Aufwand zum Einfügen eines Elements in O(log2 n)

6.1.3 Fibonacci-Bäume:

- Ergeben sich nach folgender Vorschrift:

◦ B0

◦ B1

◦ Bh

ist der leere Fibonacci-Baum der Höhe 0

ist der Fibonacci-Baum aus einem einzigen Knoten mit Höhe 1

ist ein Fibonacci-Baum der Höhe h, der aus einem neuen Knoten x mit den Unterbäumen Bh−1

und Bh−2 besteht

- für die Höhe eines Fibonacci-Baumes gilt also h(Bh ) = h

- per Induktion lässt sich zeigen, dass jeder Fibonacci-Baum ein AVL Baum ist

- es handelt sich sozusagen um den worst-case AVL-Baum...

- Zusammenhang zu den Fibonacci Zahlen F1 , F2 , F3 , F4 , F5 , F6 , F7 , F8 , . . . = 1, 1, 2, 3, 5, 8, 13, 21 . . . :

Die Anzahl der Knoten nh im Fibonacci-Baum Bh ist gleich der (h+2)-ten Fibonacci Zahl minus 1

Gewicht(Bh ) = nh = Fh+2 − 1

8

- die Anzahl der Knoten wächst exponentiell zur Höhe

- umgekehrt wächst die Höhe logarithmisch bei steigender Knotenzahl

h

- für einen Binärbaum der Höhe h benötigt man ca. 2

Knoten

- für einen Fibonacci-Baum der Höhe h benötigt man ca 1,6180...

h

Knoten (Basis bekannt als goldener Schnitt)

- aus n Knoten kann also entweder ein ausgeglichenen Binärbaum der Höhe log2 (n) oder ein Fibonacci Baum

(= worst-case AVL Baum) der Höhe log1,6180... (n) gebaut werden.

- der Quotient h(bonacci) / h(ausgeglichen) ergibt sich aus log1,6180... (n) / log2 (n)

log1,6180... (n)

=

log2 (n)

logb (n)

logb (1,6180...)

logb (n)

logb (2)

logb (n)

logb (2)

logb (2)

·

=

= 1, 440...

logb (1, 6180...) logb (n)

logb (1, 6180...)

=

- Fazit: ein natürlich entstandener AVL-Suchbaum ist schlimmstenfalls ein Fibonacci-Baum und damit ca. 44%

höher als ein ausgeglichener Binärbaum

6.2

Gewichtsbalancierte binäre Suchbäume

- analog zu höhenbalancierten Bäumen: Maÿ für Ausgeglichenheit ist die Gewichtsdierenz

- soweit keine andere Gewichtung festgesetzt ist gilt: Gewicht = Anzahl der Knoten im Unterbaum

BL ist linker Unterbaum eines binären Suchbaumes B, n(X) die Anzahl der Knoten

eines Baumes X

Der Wert

ρ(B)

=

Ein Baum heiÿt

n(BL )+1

n(B)+1 ist die sogenannte Wurzelbalance von B

α-gewichtsbalanciert,

wenn für jeden Unterbaum U von B gilt:

α ≤ ρ(U) ≤

BB(α) ist die Menge aller

- per Denition

-

α

α

α-gewichtsbalancierten

Bäume

bounded balance )

(BB steht für

- einsichtig:

1 -

α

α

> 0,5 nicht möglich (α

≤

1 -

α)

= 1/2 beschreibt den vollständigen Baum, für

α

= 0 sind alle Strukturen möglich

bestimmt sozusagen die Abweichung vom vollständigen Baum

1

2 bedeutet rechtslastiger Baum

- je mehr ein Baum linkslastig (rechtslastig) entartet desto mehr geht die Wurzelbalance gegen 1 (0)

- Wurzelbalance <

- beim Einfügen und Löschen müssen die Wurzelbalancen entlang des Pfades bis zur Wurzel aktualisiert werden

- Ggf. muss der Baum reorganisiert werden

7

Optimale binäre Suchbäume

- optimal bedeutet geringe Zugriszeit bei gegebener Zugriswahrscheinlichkeit

- Erweiterung des Modells:

◦ zu jedem Schlüssel k1 < k2 < . . . < kn

wahrscheinlichkeiten p1 , p2 , . . . , pn

Pn

existieren Zugris-

◦

es gilt

◦

X ist die Menge der Schlüssel, P die Menge der zugehöri-

i=1

pi = 1

gen Wahrscheinlichkeiten

- optimale binäre Suchbäume optimieren (=minimieren)

den

Zusammenhang

von

Zugriswahrscheinlichkeit

und

Suchtiefe

- man deniert die mittlere Suchdauer

T (P ) =

n

X

T

abhängig von P

pi · (Stuf e(ki ) + 1)

i=1

(N.B.: Summe über alle Knoten, Wahrscheinlichkeit

·

Tiefe)

9

- erfolglose Suche muss mitberücksichtigt werden; dazu wird der Suchbaum erweitert

- Erinnerung: Als erweiterter Suchbaum erhält er n+1 externe Knoten zu seinen n alten Knoten hinzu

- Erfolgreiche Suche endet im inneren Knoten mit Schlüssel ki

- Erfolglose Suche endet in den externen Knoten

{x1 , x2 , x3 , . . . , xn } ∪ {y0 , y1 , y2 , . . . , yn }

y0 < x1 < y1 < x2 < y2 < . . . yn−1 < xn < yn

- der Suchbereich ist X =

- es gilt weiterhin:

- die externen Knoten mit yi symbolisieren die Intervalle zwischen den vorhandenen Werten

- ist x der gesuchte Wert gilt:

◦

◦

◦

x < k1

⇒

Suche endet im Knoten mit y0

ki < x < ki+1

x > kn

⇒

⇒

Suche im Knoten mit yi für 0

≤

i < n

Suche endet im Knoten mit yn

- Beobachtung: Ein optimaler binärer Suchbaum hat optimale linke und rechte Unterbäume

- die eziente Konstruktion eines optimalen Suchbaumes erfolgt also von den Blättern zu Wurzel rekursiv

- endgültige Denition: Ein allgemeiner sortierter Suchbaum heiÿt

lichkeitsverteilung P die mittlere Suchdauer

T (P)

- Hilfsmittel: Unterteilung von X in Teilbereiche Xij mit

- Wahrscheinlichkeit, daÿ ein Element y

∈

optimal, wenn zu vorgegebener Wahrschein-

minimal ist.

Xij = {xi+1 , . . . , xj } ∪ {yi , . . . , yj }

Xij ist: Wij = p(Xij )

- Mittlere Suchdauer im Teilsuchbaum für den Suchbereich Xij : Tij = Wij +

T i,k−1

+

T k,j

- da die Teilbäume eines optimalen Suchbaumes ebenfalls optimal sein müssen, erhält man:

- (Bellmann:) für die optimale mittlere Suchdauer

T ij (P ), 0 ≤ i < j ≤ n

gilt:

T ij (P ) = Wij + mini<k≤j T i,k−1 (P ) + T k,j (P )

mit

T ii (P)

= 0

- hier nicht näher behandelt: Algorithmus von Bellmann, Algorithmus von Knuth

3

2

- Bellmann baut den optimalen Baum in O(n ) auf, Knuth modiziert den Bellmann-Algorithmus nach O(n )

8

8.1

Sortieren mit Bäumen

Tree Sort

- Idee: Sortierung durch Konstruktion eines Sortierbaumes und Traversierung in Zwischenordnung

- z.B. mit AVL Baum: Höhe beschränkt die Pfadlänge, Aufwand zum Einfügen eines Elements liegt in O(log2 n)

- für die Konstruktion eines AVL Baumes aus n Elementen ergibt sich also O(n log2 n)

8.1.1 Tournament sort

8.1.2 Standard Tournament Sort (Auswahlverfahren)

- Idee: Prinzip eines Turniers mit KO Verfahren

- die zu sortierenden Elemente werden an die Knoten gehängt und im rekursiven Aufstieg die Gewinner eines

Direktvergleiches nach oben gezogen

- nur der Teilbaum des Gewinners muss neu durchgespielt werden

- Auf/Abstieg über k Stufen

→

2k, k begrenzt durch Höhe

→

Komplexität liegt in O(n log2 n)

- Leider: Hoher Speicherverbrauch (gegen 2n für groÿe n)

8.1.3 Tournament Sort with replacement (Auswahlverfahren mit Ersetzen)

- Ziel: Korrekte Sortierung per tournament sort, allerdings nur kleine Speicherstruktur nutzbar

- Idee: Zerlegung der Gesamtfolge in Teilfolgen, diese per tournament sort verarbeiten und ablegen

- das Zusammenmischen vorsortierter Folgen ist linear, liegt also in O(n)

8.1.4 2-Wege Mischen

- je 2 aller p Folgen der Länge m werden gemischt, übrig: p/2 Folgen der Länge 2m

- Mischen zwar linear, bei vielen Teilfolgen werden die Elemente aber immer wieder aufgegrien

- Teilfolgen sollten also so lang wie möglich sein

- Änderung des standard tournament sort:

- der Gewinner (kleinstes Element) einer Runde wird am Blatt durch einen Nachrücker ersetzt, der in der

nächsten Runde mitspielt

- Problem: wenn der Nachrücker kleiner ist als der letzte Gewinner! Ergebnis würde falsch sein...

- Lösung: Ist der Nachrücker kleiner wird er bzw. sein Blatt markiert und darf nicht mitspielen

- sind schlieÿlich alle Blätter markiert, wird eine Runde mit einer neuen Ergebnisteilfolge gestartet

10

8.2

Heapsort

- Hauptkritikpunkt Tournament Sort: Speicherbedarf, neuer Ansatz 1964 J.W.J William mit Heapsort

- Denition Heap: Ein Binärbaum B mit n Knoten ist ein Heap der Gröÿe n, wenn gilt:

◦

B ist fast vollständig

◦

Die Schlüssel sind in den Knoten so angeordnet, daÿ für jeden Knoten i ki

≤

kj gilt, wobei Knoten j der

Elternknoten von Knoten i ist.

- N.B.: ein Heap ist ein fast vollständiger Binärbaum, aber kein binärer Suchbaum!

- Oensichtlich: In einem Heap ist jeder Unterbaum wieder ein Heap

- der gröÿte Schlüssel in einem Heap steht denitiv in der Wurzel

- Vorgehensweise:

- Erstelle aus unsortierter Liste einen fast vollständigen Binärbaum durch iteriertes Einfügen

- Stelle auf diesem Baum durch Vertauschen von den Blättern aus die Heapbedingung her; die Struktur des

Baumes ändert sich also nicht

- jetzt folgt das eigentliche Sortieren: Vertausche Wurzel mit letztem Blatt und markiere dieses Blatt als fertig

sortiert, es wird nicht mehr berücksichtigt

- stelle die Heapbedingung wider her

- diese Reihenfolge wird bis zur vollständigen Sortierung beibehalten:

- vom Prinzip her Wurzel aus Heap herausrupfen, Heap wieder herstellen

- Vorteile: kann im Prinzip per Array realisiert werden, kein extra Speicherbedarf, statische Struktur

- Herstellung des Heapkriteriums in O(log2 n), Sortiert nach n maligem Entnehmen der Wurzel

- Gesamtlaufzeit demnach in O(n log2 n)

8.3

Proxmap Sort

- Sortieren mit Adressenberechnung, Grundidee ähnelt dem Bucket-Sort:

- Die Schlüssel werden durch eine Funktion (MapKey-Funktion) einer Adresse zugeordnet und so im ersten

Durchgang in die Nähe der endgültigen Position gebracht

- Beispiel: Reelle Zahlen in [0, 10] werden per Gauÿfunktion ihres Nachkommaanteils entledigt um ihre Adresse

zu erhalten und sammeln sich in 11 Behältern (von 0 bis 10)

- Diese Behälter können nun falls mehrere Werte in einen solchen Adressbereich gefallen sind mit einer

anderen, einfachen Sortiermethode bearbeitet werden

2

- Worst-Case: Alle Schlüssel landen in einem Bereich, Nachbehandlung mit einfachem Sortierverfahren in O(n )

- Idealfall: Jeder Schlüssel wird in einen eigenen Bereich gemapt - liegt in O(n)!

- Verbesserungen: Man wendet einmal die MapKey Funktion an und zählt die HitCounts um sich einen Überblick

über die Verteilung der Werte zu verschaen und reserviert Bereiche dynamisch um Kollisionen zu vermeiden

- Platzierung der Elemente: Entweder in einem zweiten Array (leichtere Implementierung, etwas schneller) oder

im gleichen Array (komplexer zu implementieren, etwas langsamer)

- Versuch eine bessere Abbildung zu bekommen (→ Problemstellung vergleichbar zum Hashing)

- auch für die Verbesserungen gilt im Idealfall O(n), da alle Aufgaben (HitCount Durchlauf, Proxmap und

Ergebnisarray erstellen) in O(n) liegen

- je nach Qualität der MapKey sind die quadratischen Zeiten der internen Sortierung vernachlässigbar, insbesondere ist ProxMap auch experimentell linear

9

9.1

Mehrwegbäume

m-Wege Suchbäume

Motivation: Es gibt Fälle in denen eine niedrige Baumhöhe erwünscht ist, zum Beispiel wenn die Datenstruktur

auf Festplatte ausgelagert ist und die Zugriszeiten hohe interne Baumoperationen vernachlässigen lassen. Man

will mit wenigen Zugrien zum Ziel gelangen.

Ein anderes Beispiel ist die Indizierung einer groÿen Grundmenge, die über die ganze Festplatte verteilt ist.

∗

(siehe später dazu speziell B -Bäume bzw B

+

trees). Der Baum ist dann sozusagen ein Überbau, der beim

Durchlaufen auf die ungefähr richtige Stelle auf der Platte führen soll. In jedem Fall soll die Breite groÿ und die

Höhe klein sein, was ein höheres fan-out erfordert: Jeder Knoten hat mehrere Unterbäume.

Der bisher betrachtete Binärbaum ist also ein 2-Wege Baum. Im folgenden untersuchen wir nun allgemeine

m-Wege Suchbäume.

Bemerkung: Der m-Wege Baum dient oft als Indizierungshilfe, oft sind die im Baum abgelegten Daten nur die

Zeiger auf die extern abgelegten Daten.

11

9.2

Denition m-Wege Suchbäume

Ein m-Wege Suchbaum ist ein Suchbaum, in dem alle Knoten n einen Grad(n)

≤

m besitzen.

B ist entweder ein leerer Baum oder hat folgenden Aufbau:

- die Struktur der Knoten:

◦

◦

◦

b gibt die Anzahl der Schlüssel im Knoten an

Ki und Di sind jeweils die Schlüssel und die Daten(referenzen) mit 1

Pi sind die Unterbäume des Knotens, hier mit 0

≤i≤

≤i≤

b

b

- innerhalb eines Knotens sind die Schlüsselwerte aufsteigend sortiert: Ki

- die Schlüsselwerte kx des Unterbaums Pi sind kleiner als ki+1 für 1

≤

≤

Ki+1 für 1

≤

i < b

i < b

- die Schlüsselwerte kx des Unterbaums Pb sind gröÿer als kb

- die Unterbäume Pi sind alle ebenfalls m-Wege Bäume.

Diese grundlegende Denition fordert noch keine Reorganisationsmaÿnahmen, der Baum ist nicht ausgeglichen

und kann degenerieren. Für die Anzahl N der Knoten im vollständigen Baum gilt:

N=

h−1

X

m1 =

i=0

mh − 1

m−1

Die maximale Anzahl von Schlüsseln nmax ist:

nmax = N · (m − 1) =

(mh − 1)(m-1)

(m-1)

= mh − 1

Im entarteten Baum gilt N = h. Die Anzahl der Knoten n begrenzt die Höhe im m-Wege Suchbaum auf:

logm (n + 1) ≤ h ≤ n

9.3

B-Baum

In der Praxis der am häugsten implementierte Baum. Es handelt sich vom Prinzip her um einen ausgeglichenen

Mehrwegbaum.

9.3.1 Denition B-Baum

- die Wurzel ist entweder ein Blatt oder hat mindestens 2 Kinder

- jeder Knoten auÿer der Wurzel und den Blättern hat mindestens k+1 Kinder

- jeder Knoten hat höchstens 2k + 1 Kinder

- alle Pfadlängen von der Wurzel zu den Blättern sind gleich lang

- jedes Blatt (Ausnahme: Wurzel als Blatt) hat mindestens k und höchstens 2k Einträge

Die Struktur eines solchen Knotens ist wie folgt vorgegeben

Beim Einfügen wird b erhöht und gibt zu jedem Zeitpunkt die Anzahl der Einträge des Knotens an.

Die Tripel (kx , Dx , Px ) haben eine feste Länge Lk + LD + LP , der freie Platz wird nach und nach belegt.

Es gilt: bmax = [(Gesamtlänge Platz für b LP 0 ) / (Lk + LD + LP )] = 2k

Ist 2k also die maximale Anzahl an Einträgen, muss der Knoten nach Denition immer halb voll sein (→ k).

9.3.2 Klasse τ (k, h) eines B-Baums

Man deniert die Klasse eines B-Baumes wie folgt:

≥ 0 und k die geforderte

τ (k, h) eines Baumes.

Ist h die Höhe eines B-Baumes mit h

k > 0, spricht man von der

Klasse

12

Mindestanzahl an Einträgen pro Knoten mit

Auf den Punkt gebracht: Der Baum hat h Ebenen und mit Ausnahme der Wurzel an jedem Knoten k Werte,

also k+1 Verzweigungen. Beispiel kleinstmöglicher B-Baum der Klasse

τ (2,3):

9.3.3 Höhe und Schlüsselanzahl eines B-Baums der Klasse τ (k, h)

Für die Höhe h eines Baumes der Klasse

τ (k,

h) gelten aufgrund der minimalen und maximalen Knotenzahlen

folgende Schranken:

log2k+1 (n + 1) ≤ h ≤ logk+1

(n + 1)

+1

2

Die Anzahl n an Schlüsseln im B-Baum ist ebenfalls begrenzt und liegt in:

2(k + 1)h−1 ≤ n ≤ (2k + 1)h − 1

9.3.4 Einfügen in einen B-Baum der Klasse τ (k, h)

- man beginnt mit einem leeren Knoten als Wurzel

- die ersten 2k Schlüssel werden sortiert in die Wurzel eingefügt

- das 2k+1te Element passt nicht mehr hinein: 2k Elemente [1..k, k+1, k+2..2k+1]

- es werden 2 neue Knoten angelegt, die Wurzel wird gesplittet:

- die ersten k Elemente in den linken, die letzten k Elemente in den rechten Knoten

- das mittlere Element k+1 bleibt in der Wurzel

- weiteres Einfügen: Man sucht im Abstieg die Position indem man innerhalb eines Knoten nach rechts wandert.

- ist der neue Schlüssel < dem aktuellen Schlüssel ki wird in den Unterbaum Pi−1 verzweigt

- ist der neue Schlüssel > dem letzten Schlüssel kb wird in den Unterbaum Pb verzweigt

- auf Blatthöhe wird geordnet eingefügt

- bei einem Überlauf wird das Blatt gesplittet, das mittlere Element wandert als Separator in den Elternknoten

- ist der Elternknoten voll wird weitergesplittet, schlimmstenfalls bis zur Wurzel

9.3.5 Löschen in einem B-Baum der Klasse τ (k, h)

- Problem: die Mindestanzahl an Schlüsseln darf nicht unterschritten werden

- Zunächst Schlüssel zum Löschen im Abstieg suchen

- normales Löschen auf Blattebene ohne Verletzung der Mindesanzahl einfach

- löschen im B-Baum ohne Unterlauf erfordert zumindest Auüllen durch kleinsten Schlüssel im rechten Unterbaum Baum oder gröÿten Schlüssel im linken Unterbaum

- Entsteht ein Unterlauf , dann nur auf Blattebene. Lösung:

- Rotieren: Ein Schlüssel aus dem Elternknoten wird heruntergezogen und durch einen Nachbarknoten dort

nachgefüllt

- Hat der Nachbarknoten genau k Schlüssel (kurz vor Unterlauf ) muss gemischt werden

⇒

Umkehrung des

Splittens

- dazu wird der Separator des Elternknotens mit den k-1 Elementen des einen und den k Elementen des anderen

Teilbaumes zu einem Knoten der Länge 2k gemischt.

9.3.6 B-Baum mit Mehrfachüberlauf (international: B∗ Bäume)

- das einfache Konzept sieht vor: Splitten, wenn ein Knoten voll ist

- dabei werden alle Elemente auf zwei neue Knoten verteilt. Deren Belegung ist dann

β = 1/2 = 50%

- Doppelter Überlauf bedeutet:

- ist ein Knoten voll, wird versucht Schlüssel in einen Nachbarknoten zu rotieren

- das Splitten wird heraus gezögert. Sind zwei Knoten voll wird dann doch gesplittet:

- 2 volle Knoten werden auf 3 Knoten aufgeteilt; deren Belegung ist dann

β = 2/3 = 66, 6%

- allgemeiner Mehrfachüberlauf sieht nun vor m volle Knoten auf m+1 neue Knoten aufzuteilen

- ein Erhöhen des Splitfaktors m erschwert die Implementation und kostet Rotierzeit

- dafür erhöht es jedoch den Belegungsfaktor (Splitfaktor 1

⇒ β = 1/2,

2

⇒ β = 2/3,

3

⇒ β = 3/4)

- je höher der Belegungsfaktor ist, desto länger wird praktisch eingefügt ohne dass es zum Splitten kommt

- allgemein spart Rotieren im Gegensatz zum Splitten Zeit, es gilt allgemein

βi = m/(m + 1)

- der Fall m = 2 (B-Baum mit doppeltem Überlauf ) heiÿt im internationalen Sprachgebrauch

13

B∗

tree

B∗ -Baum (international B+ tree)

9.4

+

Internationale Bezeichnung: B

tree, nicht verwechseln mit B-Baum mit doppeltem Überlauf.

+

Um Miÿverständnisse auszuschlieÿen, wird er im folgenden B -Baum genannt.

In B-Bäumen erfüllt ein Tripel (kx , Dx , Px ) im Knoten zwei Aufgaben: Der Schlüssel kx dient als Wegweiser

bei der weiteren Suche in die Unterbäume Px oder indiziert die Daten Dx .

+

In B -Bäume werden diese Aufgaben getrennt. Der Baum enthält lediglich die Schlüssel um korrekt absteigen

zu können. Vorteile: Die Knoten können bei gleicher Gröÿe mehr Schlüssel aufnehmen, habe ein höheres fan-out.

Der Baum wird noch acher und breiter. Man muss zwar nun denitiv bis in die Blätter absteigen, der Abstieg

erfolgt aber schneller, da ein extra Vergleich entfällt und der Baum onehin acher ist. Der gesamte Baum bildet

einen groÿen Index auf die sortierte Grundmenge.

9.4.1 Denition B+ Baum der Klasse τ (k, k∗ , h∗ )

∗

Es gilt: k, k , h

Ein B

+

∗

∈

N

wobei k > 0, k

Baum der Klasse

τ (k,

∗

∗

> 0, h

∗

≥

0

∗

∗

k , h ) ist entweder leer oder ein geordneter Baum der Höhe h

für den gilt:

1. Die Pfadlängen von der Wurzel zu allen Blättern sind gleich lang

2. Die Wurzel ist entweder ein Blatt oder hat 2 Kinder

3. Jeder Knoten auÿer der Wurzel und den Blättern hat mindestens k+1 Kinder

4. Jeder innere Knoten hat höchstens 2k+1 Kinder

∗

5. Jeder Blattknoten (auÿer der Wurzel als Blatt) hat mindestens k

∗

Auf den Punkt gebracht: Der Baum hat h

∗

und höchstens 2k

Einträge

Ebenen und mit Ausnahme der Wurzel an jedem Knoten k Werte,

also k+1 Verzweigungen. Bis hierhin entspricht das dem B-Baum. Neu ist der mittlere Parameter in der Klassendenition: k

∗

legt im Prinzip fest wieviele Daten auf der Blattebene in einem Knoten untergebracht werden.

+

Stellt man sich den B

Baum als Index-Baum vor, teilt er ein groÿes Array geordneter Daten in Partitionen

∗

auf; wie breit eine solche Partition ist bzw. sein muss, wird durch diesen zweiten Parameter k

festgesetzt.

Beachte: Da die Schlüssel der inneren Knoten nur als Wegweiser dienen, treten sie nocheinmal in den Blättern

auf (siehe Beispiel weiter unten).

+

Die Struktur eines Knotens im B

+

Die Struktur eines Blattes im B

Baum:

Baum:

Der Wert b gibt nicht nur an, wieviele Datensätze im Knoten vorhanden sind, sondern auch um welchen Knotentyp es sich handelt (z.B. durch Vorzeichen).

Im Falle eines Knotens gilt:

k ≤ b ≤ 2k ,

im Falle eines Blattes:

k ∗ ≤ b ≤ 2k ∗

Pprev ist der Zeiger auf den links liegenden Blattknoten, Pnext zeigt auf den rechts liegenden Blattknoten.

Für die Gesamtlänge sowie die Schlüsselanzahl k in inneren Knoten gilt:

L

= Lb + LP + 2k(Lk + LP )

k = [(L − Lb − LP )/2(Lk + LP )]

∗

Für die Gesamtlänge sowie die Schlüsselanzahl k

in Blättern gilt:

L

= Lb + 2LP + 2k ∗ (Lk + LD )

k ∗ = [(L − Lb − 2LP )/2(Lk + LD )]

14

Beispiel für einen Klasse

τ (3,2,3)

Baum:

9.4.2 Höhe und Schlüsselanzahl eines B+ -Baums der Klasse τ (k, k∗ , h∗ )

Anzahl der Knoten bei minimaler Belegung:

Bmin (k, h∗ ) =

1

∗

= 2(k + 1)h −2

für h

∗

= 1

für h

∗

≥

2

Anzahl von Elementen bei minimaler Belegung:

nmin (k, k ∗ , h∗ ) =

1

∗

∗

= 2k (k + 1)h −2

Anzahl der Knoten bei maximaler Belegung:

∗

Bmax (k, h∗ ) = (2k + 1)h

−1

Anzahl von Elementen bei maximaler Belegung:

∗

nmax (k, k ∗ , h∗ ) = 2k ∗ (2k + 1)h

Höhe h

∗

des B

+

für h

∗

= 1

für h

∗

≥

für h

−1

∗

≥

für h

2

1

∗

≥

1

Baums:

1 + log2k+1 (n/2k ∗ ) ≤ h∗ ≤ 2 + logk+1 (n/2k ∗ )

für h

∗

≥

2

9.4.3 Operationen in einem B-Baum der Klasse τ (k, k∗ , h∗ )

∗

Die Grundoperationen sind denen des B-Baums sehr ähnlich. Die Suchtiefe beträgt konstant h , da immer bis

zu den Blättern gesucht werden muss.

Das Einfügen muss beim Splitten der Blätter dafür sorgen, daÿ der gröÿte Schlüsselwert als Wegweiser in den

Elternknoten kopiert wird.

Das Löschen ist einfacher: Da die Schlüssel im inneren nur als Wegweiser fungieren, können sie beim Löschen

stehenbleiben. Gelöscht wird also nur auf Blattebene.

9.4.4 Präx B+ -Baum

- als Separator werden kleine Präxe der Schlüssel verwendet

- Ideal für Strings variabler Länge

- kurze Präxe benötigen wenig Platz, führen zu hohen fan out

- Beispiel: erster Knoten enthält die Separatoren A, B, C

. . . Y, Z

- in den Unterbäumen lassen sich nun

jeweils Strings mit den entsprechenden Anfangsbuchstaben nden...

9.4.5 Vergleich B-Baum und B+ -Baum

B-Baum:

- Daten werden in allen Knoten gespeichert

- Schlüssel sind einfach vorhanden

- schneller Einzelzugri, schweres sequentielles Lesen

+

B -Baum:

- Daten nur in den Blättern, hohes fan-out/extreme Breite

- Schlüssel sind redundant gespeichert (aber nur geringer Mehraufwand)

- leichter sequentieller Zugri, gleichguter Einzelzugri

- einfaches Löschen

9.5

2-3 Baum

- B-Bäume verwalten durch ihr hohes fan out ezient Daten auf Externspeichern (wenige Zugrie im Abstieg)

- bei anderen Anwendungen z.B. Hauptspeicherstrukturen ist aber kleine Knotengröÿe gefragt

- die Anzahl der minimalen Knoten eines B-Baumes wird durch die Klasse bestimmt

- B-Bäume der Klasse

τ (1,

h) haben minimale Knotengröÿen und sind allgemein als 2-3 Bäume bekannt

- Ergo: Alle Knoten haben einen, maximal zwei Schlüssel und zwei oder drei Unterbäume

15

9.6

Binäre B-Bäume

- 2-3 Bäume haben besonders nach Höhenänderungen schlechte Speichernutzung

- Abhilfe durch die sogenannten

binären B-Bäume

- Knoten werden als gekettete Listen mit ein oder zwei Elementen implementiert

- durch Unterscheidung von Zeigern werden variabel 2/3-elementige Knoten simuliert

- man unterscheidet dabei in vertikale (δ ) und horizontale (ρ) Zeiger

-

δ

Zeiger gehen in die Tiefe,

ρ

Zeiger bleiben auf gleicher Ebene

- Denition: Ein binärer B-Baum ist ein binärer Suchbaum mit zwei Arten von Verweisen:

◦

◦

◦

◦

δ -Verweise

δ oder ρ-Verweise sein

aufeinanderfolgenden ρ-Verweise

alle linke Verweise sind

rechte Verweise können

es gibt keine zwei

die Pfade von der Wurzel zu den Blättern haben gleich viele

δ -Verweise

Beispiel: Die zum binärern B-Baum transformierte Struktur des bereits gezeigten

τ (2,3)

- die Traversierung in Zwischenordnung (LWR) ergibt die sortierte Folge

- Suche wie bei binären Suchbäumen

- Einfügen wie bei B-Bäumen immer am Blatt mit entsprechenden Ausgleichsvorgängen

- Ggf.

9.7

δ

Zeiger zu

ρ

Zeigern hochklappen oder (Doppel-) Rotieren

Symmetrische binäre B-Bäume, SBB-Baum

- kann nur der rechte Zeiger ein

ρ-Zeiger

sein, wird der binäre B-Baum schräg

- lässt man nun rechte und linke p Verweise zu, entstehen symmetrische binäre Bäume

- Denition SBB:

◦

◦

◦

◦

δ und ρ-Verweise

δ -Verweise

Ein SBB ist ein binärer Suchbaum mit zwei Arten von Verweisen:

die Pfade von der Wurzel zu den Blättern haben gleich viele

es gibt keine zwei aufeinanderfolgenden

ρ-Verweise

δ -Ebene

alle inneren Knoten auÿer denen auf der letzten

16

besitzen 2 Söhne

Baums

10

Digitale Suchbäume

- die Idee: Schlüssel werden in Fragmente zerlegt und diese in den Knoten gespeichert

- jeder Knoten enthält einen Zeiger zum nächsten Schlüsselfragment, sofern dieses vorhanden ist

- beim Absteigen im Baum B ergibt sich der Schlüssel durch Zusammensetzen der Fragmente aus den Knoten

- Schlüssel mit gleichem Präx laufen zunächst den gleichen Pfad

- unser Alphabet mit 26 Zeichen ergibt mit einem Zeichen Fragmentlänge Grad(B) = 26

- allgemein gilt bei einem Alphabet der Mächtigkeit m und für Schlüsselfragmente der Länge n: Grad(B) = m

n

- haben die Schlüssel eine feste Länge l und die Fragmente eine feste Länge k gilt: Höhe(B) = l/k

- sind die Schlüssel von variabler Länge determiniert der Längste Schlüssel die Baumhöhe

10.1

m-ärer Trie

- die Knoten eines m-ären Tries, ein Digitalbaum mit Knoten vom Grad m, sind Vektoren mit m Zeigern

- jeder Zeiger steht für ein Zeichen des Alphabets

- ist ein Zeiger

null, gibt es das gesuchte Präx nicht

- die Positionen sind geordnet von links (höherwertig) nach rechts (niederwertig) festgelegt

- zusätzliche Trennzeichen ermöglichen bei Schlüsseln dynamischer Länge das Erkennen eines Schlüssels, der

Präx eines anderen Schlüssels ist

- Vorteil: Ezient bei negativer Suche; es wird früh erkannt, daÿ ein Schlüssel nicht vorhanden ist

- Nachteil: Meist schlechte Speichernutzung, da nur dünn besetzt

- oft Einweg-Verzweigung: Pfad ohne Abzweigung wenn Schlüssel kein Präx mit anderen gemeinsam hat

- Einfügen, Löschen und Suchen sind recht intuitiv; die Implementierung ist nicht sehr schwer

- die Struktur des Tries ist lediglich von den vorhandenen Schlüsseln abhängig:

- iteratives Einfügen erzeugt bei gleichen Schlüsseln egal welche Reihenfolge immer den gleichen Trie

10.1.1 Trie Optimierung

Erster Ansatzpunkt: Die Einweg-Verzweigungen

- Lösung durch variable Länge der Schlüsselfragmente

- enthält ein Unterbaum nur einen Schlüssel werden die Fragmente zu einem gröÿeren Stück zusammengesetzt

- dieses etwas gröÿere Fragment kann in einem Knoten gespeichert werden

- Vorteil: Bessere Speichernutzung

- Nachteil: Etwas schwierigere Implementierung:

- es müssen nun eventuell kleine Splittungen beim Einfügen und Löschen berücksichtigt werden

Zweiter Ansatzpunkt: Das feste, dünn besetzte Knotenformat

- Lösung: variabel gestaltete Knotenstruktur

- es werden nur noch nicht-null Zeiger gespeichert

- aber: die sequentielle Ordnung die dem Zeiger seine Bedeutung gab ist nicht mehr vorhanden

- jeder Zeiger muss nun eine Information mitführen die erkennen lässt für welches Schlüsselfragment er steht

- dabei steigt jedoch die Anzahl der Vergleiche!

10.2

Binäre Digitale Suchbäume

- Spezialfall: das Alphabet ist digital - nur 0 oder 1

- an jedem Knoten kann durch Vegleich des jeweiligen Bits links oder rechts weiterverzweigt werden

- kurze Schlüssel sind problematisch wenn die Schlüsselfolge zu kurz ist um einen freien Platz zu nden

17

10.2.1 PATRICIA-Baum

- Practical Algorithm To Retrieve Information Coded In Alphanumeric

- die Schlüssel werden nur in den Blättern abgelegt

- in den Knoten wird gespeichert, wieviele Bits beim Vergleich übersprungen werden können

- gewährleistet ein Minimum an Vergleichen, es gibt keine Einwegverzweigungen

- da die Schlüssel erst in den Blättern liegen, muss auch bei negativen Suchen bis zum Ende gesucht werden

10.2.2 Binärer Radix Baum

- Abhilfe um negative Suchen zu beschleunigen: Modizieren des PATRICIA Baumes wie folgt:

- in den Knoten wird ausser der Information wieviele Bits zu überspringen sind auch noch der jeweilige

Teilschlüssel gespeichert

- in den Blättern liegen die Restschlüssel

- beim Traversieren wird so der Schlüssel wieder stückweise zusammengesetzt

- das Knotenformat ist nun entsprechend komplexer, negative Suchen sind jedoch früh erkennbar

- diese Modikation des PATRICIA Baums wird

Binärer Radix Baum genannt

18

Index

ähnlich, 1

interne Pfadlänge, 2

äquivalent, 1

k-balanciert, 5

allgemeines, 1

Kindknoten, 1

Array, 3

Knoten, 1

ausgeglichene Binärbäume, 2

Kriterium, 5

AVL, 5

AVL-Bäume, 5

Löschen, 4

AVL-Kriterium, 5

linker, rechter Teilbaum, 3

AVL-Suchbaum, 6

Liste, 3

Lokalität, 5

Balance, 5

LWR, 3

balanciert, 5

Menge, 4

Balancierung, 5

Balancierungsfaktor, BF, 5

Nachfolger, 1

Baumdenition, 1

Nachordnung, 3

Binärbäume, 2

natürlich, 1, 4, 5

binäre Suchbäume, 4

binary trees, 2

Ordnung, 1

orientierte Bäume, 1

degeneriert, 5

Doppelrotation, 5

Permutation, 4

dynamisch, 3

Pfadlängen, 5

Pfadlängendierenz, 5

Ebene, 1

Pointer, 4

Einfügen, 4, 5

postorder, 3

Einfügeposition, 5

preorder, 3

Elternknoten, 1

entartet, 1, 5

referenzieren, 4

erweiterte Binärbäume, 2

Reihenfolge, 1

explizit, 1

rekursiv, 1

externe Pfadlänge, 2

Reorganisation, 4, 5

Rotation, 5

Fädelung, 4

RWL, 3

Fädelungszeiger, 4

fast vollständige Binärbäume, 2

Schlüssel, 4

Feldbäume, 3

sequentiell, 3

Fibonacci, 6

Sortierschlüssel, 4

Fibonacci-Bäume, 6

Speicherbelegung, 3

statisch, 3

geordnet, 4

strikte Binärbäume, 2

geordnete Bäume, 1

Stufe, 1

geordnete Menge, 1

Suchbaum, 4

gerichtete Bäume, 1

Suchen, 4

Geschwister, 1

Gewicht, 1

Tabelle, 3

gewichtet, 2

Traversierung, 3

Goldener Schnitt, 6

Grad, 4

Verweise, 3

Grad eines Baumes, 1

vollständige Binärbäume, 2

Grad eines Knotens, 1

Vorordnung, 3

Höhe, 1

WLR, 3

höhenbalanciert, 5

worst-case, 6

Höhenunterschied, 5

Wurzel, 1

implementieren, 3, 4

Zeiger, 4

implizit, 1

Zugriskosten, 4

inorder, 3

Zwischenordnung, 3

19