Ausarbeitung - Detlef Krömke - Goethe

Werbung

Goethe-Universität Frankfurt

Diplomarbeit

Point Based Animation

eingereicht bei

Prof. Dr.-Ing. Detlef Krömker

Professur für Graphische Datenverarbeitung

von

Sven Pallus

Eingereicht am 21.03.2011

Eidesstattliche Erklärung

Ich erkläre hiermit an Eides Statt, dass ich die vorliegende Arbeit selbstständig und ohne Benutzung

anderer als der angegebenen Hilfsmittel angefertigt habe; die aus fremden Quellen direkt oder indirekt

übernommenen Gedanken sind als solche kenntlich gemacht.

Die Arbeit wurde bisher in gleicher oder ähnlicher Form keiner anderen Prüfungskommission vorgelegt und auch nicht veröffentlicht.

Frankfurt am Main, den 21. März 2011

—————————

(Sven Pallus)

i

ii

Danksagung

Ich danke allen, die mich während meines Studiums unterstützt und gefördert haben. Zuallererst bedanke ich mich bei meinen Eltern und meiner Familie, die mir dieses Studium ermöglicht haben.

Zudem bedanke ich mich bei allen Korrekturlesern, die diese Arbeit zu dem gemacht haben, was sie

jetzt ist: Nicole, Petra, Michael, Christian.

Mein weiterer Dank gilt meinem Betreuer Dipl. Inf. Daniel Schiffner für seine tatkräftige Unterstützung und zahlreichen Ratschläge, sowie Prof. Dr.-Ing. Detlef Krömker, der diese Arbeit erst ermöglicht hat.

Nicht zuletzt bedanke ich mich bei meiner Freundin Nicole, die mich während des gesamten Studiums

unterstützt hat und immer für mich da war.

Inhaltsverzeichnis

Zusammenfassung

1

Deutsch . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1

Englisch . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2

1

Einleitung

3

2

Grundlagen

5

2.1

Animation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

5

2.1.1

Animationspipeline . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

5

2.1.2

Prinzipien der Animation . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7

Animationstechniken . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

9

2.2

2.3

3

4

2.2.1

Elementaranimation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

10

2.2.2

Simulative Animation . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

10

2.2.3

Kinematische Techniken . . . . . . . . . . . . . . . . . . . . . . . . . . . .

12

2.2.4

Animation durch Interpolation . . . . . . . . . . . . . . . . . . . . . . . . .

14

2.2.5

Bewegungserfassung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

15

2.2.6

Punktbasierte Animation . . . . . . . . . . . . . . . . . . . . . . . . . . . .

16

Grundlagen der Physik . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

18

State of the Art

20

3.1

Partikelsysteme . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

20

3.2

Smoothed Particle Hydrodynamics . . . . . . . . . . . . . . . . . . . . . . . . . . .

23

3.3

Anwendungen von punktbasierter Animation . . . . . . . . . . . . . . . . . . . . .

25

3.3.1

Animation von elastischen, plastischen und schmelzenden Objekten . . . . .

26

3.3.2

Punktbasierte Animation von elastoplastischen Festkörpern . . . . . . . . .

27

3.3.3

Punktbasierte Animation von inkompressiblen Strömungen . . . . . . . . . .

29

3.4

Physikengine . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

30

3.5

Bullet Grundlagen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

33

Eigene Verfahren

38

4.1

38

Anforderungsanalyse . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

iii

INHALTSVERZEICHNIS

5

iv

4.2

Punktmodell . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

39

4.3

Bullet Viewer . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

43

4.4

Verknüpfung Punktmodell mit Physikengine . . . . . . . . . . . . . . . . . . . . . .

45

4.5

Konzeption und Implementierung starrer Körperdynamik . . . . . . . . . . . . . . .

48

4.6

Konzeption und Implementierung elastischer Körperdynamik . . . . . . . . . . . . .

56

4.7

Benchmarks . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

78

Aussichten und Diskussion

Literaturverzeichnis

80

83

Quellcode

3.1

Standard Bullet Welt für starre Körperdynamik . . . . . . . . . . . . . . . . . . . .

34

4.1

Bauminitialisierung der Punkte . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

41

4.2

Viewerkonstruktor zur Menübildung . . . . . . . . . . . . . . . . . . . . . . . . . .

43

4.3

Motion-State für das Punktmodell . . . . . . . . . . . . . . . . . . . . . . . . . . .

47

4.4

Punktmanipulation für elastische Körper . . . . . . . . . . . . . . . . . . . . . . . .

48

4.5

Bildung eines starren Körpers . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

49

4.6

Constraint zwischen starren Objekten . . . . . . . . . . . . . . . . . . . . . . . . .

54

4.7

Elastizität über starre Körperdynamik . . . . . . . . . . . . . . . . . . . . . . . . .

55

4.8

Node und dynamischer Link im Point Body . . . . . . . . . . . . . . . . . . . . . .

57

4.9

Initialisierung eines Point Body . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

57

4.10 Initialisierung eines Links . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

58

4.11 Strahlberechnung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

62

4.12 Herausschneiden von Punkten aus dem elastischen Objekt . . . . . . . . . . . . . .

66

4.13 Reparaturschritt des Point Body für Fall 5 . . . . . . . . . . . . . . . . . . . . . . .

72

4.14 Einfügen eines Nodes in den Point Body für Fall 1 . . . . . . . . . . . . . . . . . .

77

v

Abbildungsverzeichnis

2.1

Animationssequenz eines Daumenkinos [Dau] . . . . . . . . . . . . . . . . . . . . .

6

2.2

Animationspipeline nach [Bre07] . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6

2.3

Masse-Feder-Dämpfer System [Mas] . . . . . . . . . . . . . . . . . . . . . . . . . .

11

2.4

Unterteilung in finite Elemente [Mü08] . . . . . . . . . . . . . . . . . . . . . . . .

12

2.5

Kinematische Kette eines Roboterarms [Bre07] . . . . . . . . . . . . . . . . . . . .

13

2.6

Hierarchischer Aufbau eines Menschen sowie die dazu gehörige Baumstruktur [Par02] 14

2.7

Interpolation zwischen zwei Bildern [Bre07] . . . . . . . . . . . . . . . . . . . . . .

15

2.8

Motion Capture [Mot] . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

16

2.9

Meshbasierter [Mes] und punktbasierter [Poi] Standford Bunny . . . . . . . . . . . .

17

3.1

Animation eines Feuerwerks mit Hilfe eines Partikelsystems [Hei02] . . . . . . . . .

23

3.2

Flüssigkeitsdarstellung mit der SPH Methode [SPH] . . . . . . . . . . . . . . . . .

25

3.3

Das linke Bild zeigt Phyxel (gelb) und Surfels (blau), die übrigen Bilder zeigen elastische und plastische Verformungen nach [MKN+ 04] . . . . . . . . . . . . . . . . .

26

3.4

Elastoplastisches Objekt nach [GBB09] . . . . . . . . . . . . . . . . . . . . . . . .

29

3.5

Ablauf der punktbasierten Methode nach [SH09] . . . . . . . . . . . . . . . . . . .

30

3.6

Beliebteste Physikengines [Gam] . . . . . . . . . . . . . . . . . . . . . . . . . . . .

33

3.7

Organisation der Hauptkomponenten von Bullet [Bulb] . . . . . . . . . . . . . . . .

34

3.8

Drei am häufigsten verwendete Collision-Shapes zur Kollisionserkennung [Kle05] .

35

3.9

Drei verschiedene Gelenktypen [Bulb] . . . . . . . . . . . . . . . . . . . . . . . . .

36

3.10 Soft Body bestehend aus Nodes, Links und Faces . . . . . . . . . . . . . . . . . . .

37

4.1

Aufbau der Basisdaten des Punktmodell [SK10] . . . . . . . . . . . . . . . . . . . .

39

4.2

Punktinformationen werden aus dem Puffer gezogen . . . . . . . . . . . . . . . . .

40

4.3

Baumdarstellung für neun Punkte . . . . . . . . . . . . . . . . . . . . . . . . . . .

40

4.4

Aufbau eines beispielhaften Tree-Cut nach [SK10] . . . . . . . . . . . . . . . . . .

42

4.5

Aktualisierungsmethoden eines Tree-Cut [SK10] . . . . . . . . . . . . . . . . . . .

42

4.6

Bullet Viewer zur Anzeige der Animation . . . . . . . . . . . . . . . . . . . . . . .

44

4.7

Arbeitsablauf des Frameworks . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

45

4.8

Berechnung der Punktanzahl des Punktbaums . . . . . . . . . . . . . . . . . . . . .

46

vi

ABBILDUNGSVERZEICHNIS

4.9

vii

Aktualisierungsschritt bei der starren Körperdynamik . . . . . . . . . . . . . . . . .

50

4.10 Freier Fall eines starren Körpers . . . . . . . . . . . . . . . . . . . . . . . . . . . .

50

4.11 Kollisionen zwischen starren Objekten . . . . . . . . . . . . . . . . . . . . . . . . .

51

4.12 Auswirkung von Constraints auf Objektsabstände . . . . . . . . . . . . . . . . . . .

53

4.13 Animation einer elastischen Kette auf Grundlage der starren Körperdynamik . . . . .

55

4.14 Grundaufbau eines Point Body . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

59

4.15 Aktualisierungsschritt bei der elastischen Körperdynamik . . . . . . . . . . . . . . .

60

4.16 Kollision einer elastischen Ebene mit einem starren Körper . . . . . . . . . . . . . .

60

4.17 Werfen eines Strahls von der Mausposition in die Szene [Pic] . . . . . . . . . . . . .

62

4.18 Ziehen und Zurückschwingen eines Point Body . . . . . . . . . . . . . . . . . . . .

63

4.19 Herausschneiden eines Nodes . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

65

4.20 Ausschneiden einzelner Nodes aus dem Point Body . . . . . . . . . . . . . . . . . .

65

4.21 Zerschnittener Point Body mit Gravitationswirkung . . . . . . . . . . . . . . . . . .

67

4.22 Kombiniertes Ziehen und Schneiden des Point Body . . . . . . . . . . . . . . . . .

68

4.23 Reparieren des Point Body für die Fälle 1 und 2 . . . . . . . . . . . . . . . . . . . .

69

4.24 Reparieren des Point Body für die Fälle 3 und 4 . . . . . . . . . . . . . . . . . . . .

71

4.25 Reparieren des Point Body für die Fälle 5 und 6 . . . . . . . . . . . . . . . . . . . .

72

4.26 Einfügen eines Punkts in den Point Body für die Fälle 1 und 2 . . . . . . . . . . . .

74

4.27 Einfügen eines Punkts in den Point Body für die Fälle 3 und 4 . . . . . . . . . . . .

75

4.28 Einfügen eines Punkts in den Point Body für die Fälle 5 und 6 . . . . . . . . . . . .

76

5.1

82

Krönchenbildung durch Auftreffen von Wassertropfen [Tro] . . . . . . . . . . . . .

Kurzfassung

Die punktbasierte Animation ist ein relativ neues Gebiet im Bereich der Animation. Der Unterschied

zu den weit verbreiteten polygonnetzbasierten Verfahren liegt darin, dass zwischen den einzelnen

Punkten, welche die Oberfläche des zu animierenden Objekts definieren, keine Topologieinformationen vorhanden sind. Mit polygonnetzbasierten Techniken ist keine Volumensimulation möglich, da

keine Volumeninformationen vorhanden sind. Die aktuellen Verfahren im punktbasierten Feld ermöglichen die Animation von Flüssigkeiten, Rauch oder Explosionseffekten. In dieser Arbeit wird eine

Animation auf Grundlage eines zur Verfügung gestellten Punktmodells ausgeführt. Um zu gewährleisten, dass die Animation korrekt nach den Gesetzen der Physik arbeitet, wird eine Physikengine

zu Hilfe genommen. Diese beiden Bereiche werden in dieser Arbeit miteinander verknüpft. Zunächst

werden einfache Simulationen im Sektor der starren Körperdynamik durchgeführt. Dabei werden einzelne Punkte unter Einfluss der Gravitation auf eine Ebene fallen gelassen. Vor allem die Berechnung

der Kollision mit der Ebene und der Punkte untereinander ist hierbei interessant. Um sehenswerte physikalische Effekte animieren zu können, muss die Elastizität mit berücksichtigt werden. Des Weiteren

wird in der Arbeit die Animation elastischer Körper verwirklicht. Hierbei wird eine an den Ecken

fixierte elastische Ebene animiert. Einzelne Punkte können aus diesem elastischen Objekt herausgezogen werden, in Folge dessen sich das Objekt selbst repariert. Ebenfalls kann ein herausgeschnittner

Punkt wieder in das Objekt eingefügt werden.

1

Zusammenfassung

2

Abstract

The point-based animation is a relatively new area in the field of animation. The difference to the well

known mesh-based methods is that there is no topology information between the single points which

define the surface of the animated object. With mesh-based methods no volume simulation is possible, because no volume information is available. The current techniques for point-based animation

allow the animation of liquids, smoke and explosion effects. In this diploma thesis, the animation is

performed on the basis of a provided point model. In order to ensure that the animation is physically

correct, a physics engine is used. The objective of this thesis is to combine these two fields. Initially

simple simulations are performed in the area of rigid body dynamics. In the process, single points are

dropped to the ground plane under the influence of gravity. Particularly interesting is the calculation

of the collision between the points and plane, and also between the points among themselves. To animate visual interesting physical effects, the influence of elasticity has to be included. Furthermore this

thesis shows how elastic objects can be animated. To achieve this, an elastic plane fixed at his corners

will be animated. Individual points can be extracted from this elastic object; in consequence the object

is able to repair the occurred hole by itself. Also a cut point can be integrated back to the object.

Kapitel 1

Einleitung

“Der Mensch ist ein Augentier” [Sei01]

Aus diesem Zitat lässt sich herauslesen, dass der wohl wichtigste Sinn der menschlichen Wahrnehmung der Sehsinn ist. In den meisten Fällen ist das, was zuerst wahrgenommen wird, die visuell

erfassbare Information. Aus den aufgenommenen visuellen Reizen zieht jeder Mensch die für ihn

persönlich relevanten Informationen heraus.

Auch aus diesem Grund ist es ein wichtiges Ziel der Computergraphik, Bilder möglichst realitätsnah darzustellen. In der fortlaufenden Entwicklung der Computergraphik ist es mittlerweile möglich,

fotorealistische Bilder zu erzeugen. Um der Szene, die durch das Bild angezeigt wird, Leben einzuhauchen, muss Bewegung in die Szene integriert werden. Solch “bewegte Bilder” sind unter dem

Namen Animation bekannt. Dabei handelt es sich um das zeitliche hintereinander Abspielen von einzelnen Bildern. Zu Beginn waren das einfache Strichmännchen, die sich durch die Szene bewegten.

Da im Laufe der Zeit die Leistungsstärke der Rechner stetig anstieg, ist die Erzeugung fotorealistischer Bilder mittlerweile auch für den normalen Anwender möglich. Doch mit der gewachsenen

Leistungsfähigkeit der Rechner stiegen auch die Ansprüche an die Animation. Aktuell sollen sich

Objekte in einer animierten Szene korrekt nach den physikalischen Gesetzmäßigkeiten verhalten. In

Computeranimationsfilmen wie “Findet Nemo” oder “Ratatouille” kann man beobachten, wie weit die

Animation inzwischen schon vorangeschritten ist und welche überzeugenden Ergebnisse sie liefert.

Diese Arbeit beschäftigt sich mit der punktbasierten Animation, die ein relativ neues Gebiet ist. Die

punktbasierten Methoden gewannen in den vergangenen Jahren zunehmend an Beliebtheit und sind

eine Alternative zu bekannten Animationsmethoden, die auf der Basis von Polygonnetzen arbeiten.

Dabei werden die Oberflächen der Objekte durch eine Vielzahl von Punkten abgetastet. Physikalisch

aufwendige Simulationen wie die von Gasen oder Flüssigkeiten werden aktuell mit der punktbasierten

Animation bearbeitet, da polygonnetzbasierte Verfahren keine Volumeninformationen besitzen. Dabei

enthält jeder definierte Punkt die Eigenschaften des Objekts an der jeweiligen Position in der Szene.

Die Animations- bzw. Physik-Simulation findet dann ausschließlich auf diesen Punkten statt. Somit

ist die Methode gut geeignet zur Modellierung eines großen Bereichs von verschiedenen Materialien.

Diese Vielseitigkeit macht sie speziell attraktiv für Computergraphik-Anwendungen.

3

KAPITEL 1. EINLEITUNG

4

Ziel der Arbeit ist es, diese beiden Bereiche miteinander zu verknüpfen. Es muss somit für jeden

einzelnen Punkt die Physik an der jeweiligen Stelle berechnet werden. Dadurch soll es ermöglicht

werden, auf einer gemeinsamen Datenstruktur die Geometrie, in diesem Fall die Punkte, als auch

die Physik auszuwerten. Es soll somit zu einem bestehenden Renderer und dem Punktmodell eine

Physiksimulation integriert werden. Zudem ist es wünschenswert zu untersuchen, inwiefern sich eine

vorhandene Datenhierarchie dafür eignet, die Anzahl der Simulationsknoten dynamisch festzulegen.

In Kapitel 2 werden die Grundlagen erklärt, wozu die Animation und verschiedene Animationstechniken gehören, sowie Felder der Physik, die für die Animation von Bedeutung sind. Eine Analyse

des aktuellen Stands der Technik im Gebiet der Animation auf Punkten, sowie ein Vergleich aktueller

Physikengines folgt in Kapitel 3. Kapitel 4 zeigt die Konzeption und Implementierung des eigenen

Verfahrens der Arbeit. Abschließend folgen in Kapitel 5 eine kritische Bewertung des entstandenen

Verfahrens und ein Ausblick auf mögliche Erweiterungen.

Kapitel 2

Grundlagen

Im Folgenden soll zunächst allgemein auf den Begriff der Animation eingegangen werden. Danach

werden verschiedene Animationstechniken näher gebracht. Abschließend wird auf die physikalischen

Grundlagen eingegangen, die zum Verständnis der Arbeit notwendig sind.

2.1

Animation

Der Begriff Animation bzw. etwas animieren stammt von dem lateinischer Wort “animare”, was so

viel wie “zum Leben erwecken” bedeutet.

In dieser Arbeit wird der Begriff der Animation ausschließlich im Sinne der Computergraphik verwendet. Daraus ergibt sich die Definition der Animation als “graphische Erzeugung von Lebendigkeit

mit Hilfe des Computers” [Bre07].

In [Par02] wird Animation als eine Abfolge von Standbildern definiert, die beim Betrachter den visuellen Eindruck von Bewegung hervorruft. Das ist möglich, da die visuelle Verarbeitung im Gehirn die

Abfolge von Standbildern aneinanderfügt und sie als fortlaufende Bewegung wahrnimmt. Diesen Effekt von Bewegung kennt man beispielsweise von einem Daumenkino, wie in Abbildung 2.1 zu sehen

ist. Um eine annähernd flüssige Bewegung zu erhalten, sind etwa 24 Bilder pro Sekunde notwendig.

Somit ist die Zeit ein wichtiger Bestandteil der Animation.

2.1.1

Animationspipeline

Eine Animationspipeline stellt die klassische Reihenfolge der Arbeitsschritte einer Animation dar. Es

handelt sich dabei um die Erstellung von Bewegtbildmedien. Die einzelnen Schritte der Animationspipeline werden in Abbildung 2.2 dargestellt und im Folgenden kurz verdeutlicht.

• Preproduction

Hierbei handelt es sich um die Vorarbeiten von der ersten Idee bis zum Konzept. Anhand des

Konzeptes wird die Handlung der Geschichte erzählt. Die Produktionsplanung, wie die Bildung

eines Teams, das Aufstellen eines Budgets und eines Ablaufplans, fallen ebenfalls in diesen

Bereich.

5

KAPITEL 2. GRUNDLAGEN

Abbildung 2.1: Animationssequenz eines Daumenkinos [Dau]

Abbildung 2.2: Animationspipeline nach [Bre07]

6

KAPITEL 2. GRUNDLAGEN

7

• Object Modelling

Unter einem Objekt versteht man in der Computergraphik einen darzustellenden Gegenstand

in einer Szene. Dafür können einfache Primitve wie Punkte, Linien oder Polygone verwendet

werden. Ein Objekt kann sowohl geometrisch, als auch prozedural modelliert werden, wie z.B.

bei Fraktalen. Parameter wie Farbe, Reflektion oder Textur können hierbei durch Oberflächenoder Volumenmodellierung bestimmt werden.

• Scene Modelling

Zur Modellierung der Szene gehören Bereiche wie die Positionierung der Objekte, die globale

Beleuchtung, das Festlegen des Hintergrunds, sowie Umgebungseigenschaften wie Nebel und

die Einstellung der Kamera. Das Scene Modelling ist häufig auch als Teil des Animationssystems implementiert.

• Animation

Hiermit ist im Zuge der Animationspipeline die “Belebung"der Szene gemeint. Da eine Animation aus einer bestimmten Anzahl von Bildern besteht, ist das Bild auch die wichtigste Zeiteinheit. Objekt-, Szene- und Renderingparameter spielen ebenfalls eine Rolle bei der Animation.

• Produktions-Rendering

Das Produktions-Rendering ist die Umsetzung der Geometrie- und Merkmalsrepräsentation in

Pixelrepräsentation. An das Produktions-Rendering werden sehr hohe Qualitätsanforderungen

bis hin zu einem guten Antialiasing1 gestellt. Da ein Produktionsrenderer ein System für interaktives Arbeiten ist, ist seine Flexibilität ein wichtiger Punkt.

• Postproduction

Bei der Postproduction wird die erstellte Arbeit auf klassische Bewegtbildmedien wie Video

aufgezeichnet, bzw. für moderne Medien in einem Computervideo. Zudem kann das Video

noch vertont und geschnitten werden.

2.1.2

Prinzipien der Animation

Um verschiedene Techniken und Algorithmen aus der Computergraphik genauer zu untersuchen, ist es

hilfreich, sich zunächst mit den Animationsprinzipien zu beschäftigen, die in handgezeichneten Animationen benutzt werden. [LJ87] beschreibt die Basisprinzipien der traditionellen, handgezeichneten

Animation und ihre Anwendung zur dreidimensionalen Computeranimation. Die Grundlage dafür

stammt aus [TJ81]. Hier werden die Erfahrungen führender Animatoren der Walt Disney Company

zusammengestellt, die seit 1930 entstanden sind, und es wird versucht, realistische Animation zu produzieren. Daraus leiten sich die zwölf Basisprinzipien der traditionellen Animation ab. Im Folgenden

wird auf diese Prinzipien eingegangen.

1 Antialiasing:

Methoden zur Reduzierung von unerwünschten Abtasteffekten

KAPITEL 2. GRUNDLAGEN

8

• Quetschen und Strecken

Ein Objekt kann zusammengedrückt oder in die Länge gezogen werden. Dabei ändert sich die

Form, aber das Objektvolumen bleibt erhalten. Das gibt ein Gefühl von Masse und Elastizität

eines Objekts.

• Bewegungsdauer

Beschreibt die Dauer, bzw. die Geschwindigkeit einer Bewegung. Wichtige Eigenschaften für

die Bewegungsdauer sind Masse und Größe eines Objekts, welche dazu beitragen, wie schnell

oder langsam es sich bewegen kann.

• Antizipation

Unter Antizipation versteht man die Vorbereitung einer Aktion. Dabei wird die Hauptaktion

durch eine Gegenbewegung vorbereitet, etwa wie bei einem Golfspieler, der vor einem Schlag

den Schläger nach hinten schwingt. So wird die eigentliche Bewegung für den Beobachter besser lesbar und wirkt natürlicher.

• Inszenierung der Posen

Es wird die Aufmerksamkeit des Publikums auf das Wichtigste der Szene gelenkt. Somit werden unnötige Details vermieden, und das Relevante der Szene steht im Fokus.

• Weiterführende und überlappende Bewegung

Hierbei handelt es sich um den Ablauf einer Aktion und das Etablieren seiner Beziehung zur

nächsten Aktion. Bei weiterführenden Bewegungen gehen Elemente in Folge der Hauptbewegung über deren Endpunkt zeitversetzt hinaus. Überlappende Bewegungen beschreiben, wie

Teile des Körpers sich mit verschiedenen Geschwindigkeiten bewegen. Die Definitionsgrenzen

zwischen weiterführenden und überlappenden Aktionen sind oft fließend.

• Straight Ahead und Pose-to-Pose

Dabei handelt es sich um zwei gegensätzliche Ansätze für die Bildung von Bewegung. Straight

Ahead ist dabei das Zeichnen einer Szene Bild für Bild vom Anfang bis zum Ende, wodurch eine

dynamische Illusion der Bewegung entsteht. Pose-to-Pose zeichnet zu Beginn wenige Schlüsselbilder, und füllt die Intervalle zu einem späteren Zeitpunkt. Es wird hauptsächlich für dramatische Szenen benutzt. Oft wird auch mit einer Kombination dieser beiden Techniken gearbeitet.

• Beschleunigung und Abbremsung

Bewegungen des menschlichen Körpers brauchen Zeit zur Beschleunigung und zum Abbremsen. Deshalb beginnt eine natürliche Bewegung meist langsam, beschleunigt dann, und bremst

zum Ende der Bewegung wieder ab. Zu Anfang und Ende einer Bewegung werden daher mehr

Einzelbilder verwendet als im Mittelteil.

• Bewegungsbögen

Die meisten menschlichen Aktionen treten entlang einer bogenförmigen Bewegungsbahn auf,

KAPITEL 2. GRUNDLAGEN

9

wie z.B. der Rotation von Gliedmaßen um ein Gelenk. Animation reproduziert diese Bewegung

für größeren Realismus.

• Übertreibung

Mit Übertreibung kann man das Wesentliche einer Idee hervorheben. Um Bewegungen deutlich zu machen, ist es eventuell nötig, diese zu übertreiben. Dabei muss allerdings kontrolliert

werden, dass die Übertreibung die Bewegung nicht zu ungenau macht.

• Zweitrangige Bewegung

Das Hinzufügen einer zweiten Aktion zur Hauptaktion hilft diese zu unterstützen, und gibt

der Szene mehr Leben. Beispielsweise kann eine laufende Person gleichzeitig mit den Armen

schwingen. Die Hauptaktion sollte dennoch im Fokus stehen.

• Anreiz

Sowohl das Aussehen einer Figur, als auch ihre Bewegungen sollen ihrem Charakter angemessen sein. Das Wichtigste ist, dass der Beobachter die Interessantheit und den Realismus des

Charakters wahrnimmt.

• Solides Zeichnen

Prinzip von solidem Zeichnen bedeutet, dass es Formen im dreidimensionalen Raum annimmt.

Dabei sollen die Objekte in der Szene richtig proportioniert und perspektivisch korrekt sein,

und diese Qualitäten auch in der Bewegung nicht verlieren.

Die Anwendungen dieser Prinzipien sind unabhängig vom Medium der Animation. Zweidimensionale, handgezeichnete Animation arbeitet mit einer Abfolge von Zeichnungen, welche Bewegung simulieren, wohingegen dreidimensionale Computeranimation ein dreidimensionales Modell im Computer

bildet. Bewegungsdauer, Antizipation, Inszenierung der Posen, weiterführende und überlappende Aktionen, Übertreibung und zweitrangige Bewegung wenden die gleichen Methoden für beide Arten der

Animation an. Während die Bedeutung von Quetschen und Strecken, Beschleunigung und Abbremsung, Bewegungsbögen, Anreiz und Straight-Ahead und Pose-to-Pose Aktionen gleich bleibt, ändert

sich ihre Anwendung, wenn die Animation in einem anderen Medium stattfindet.

2.2

Animationstechniken

Es gibt eine Vielzahl von Animationstechniken, die beim Beobachter den Eindruck von Bewegung

erwecken. Im Folgenden werden einige bekannte Animationstechniken vorgestellt. Den Abschluss

des Unterkapitels bildet die punktbasierte Animation, welche im Hauptteil dieser Arbeit genauer beschrieben wird.

KAPITEL 2. GRUNDLAGEN

2.2.1

10

Elementaranimation

Im Bereich der Elementaranimation, auch als klassische Animation bezeichnet, ist die wohl bekannteste Methode die Stop-Motion Technik. Diese Technik wird vor allem beim Film benutzt. Dabei können Objekte animiert werden, indem von ihnen mehrere aufeinanderfolgende Bilder gemacht werden,

wobei in den Aufnahmepausen die Position des Objekts geringfügig verändert wird. Dieses Schema

wird solange wiederholt, bis man alle für die zu animierende Szene notwendigen Bilder erstellt hat.

Danach werden die Bilder in der aufgenommen Reihenfolge hintereinander in einer Sequenz abgespielt, um so eine flüssige Bewegung zu erzeugen.

Der Pionier, der diese Technik im Film benutzte, war Willis O’Brien. Er verwendete die StopMotion Technik 1933 bei seinem Film King-Kong. Ray Harryhausen verfeinerte diese Technik in

den fünfziger Jahren und verwendete sie in seinen Filmen wie in Jason und die Argonauten. Weitere

Anwendungsgebiete von Stop-Motion sind Animation von Puppen oder Knetmännchen. Auch Zeichentrickfilme gehören zum Bereich der Elementaranimation. Hierbei verwendet man eine Vielzahl

von handgezeichneten Bildern, die zeitlich nacheinander dargestellt werden. Dabei entsteht ebenfalls

eine flüssige Bewegung. Die einfachste Form eines Zeichentrickfilms ist ein Daumenkino, was meist

ein Strichmännchen oder Objekt zeigt, das sich in einer Szene bewegt.

Obwohl Stop-Motion eine einfache und kostengünstige Technik ist, macht sie die Umpositionierung

der Szene für jedes neue Bild sehr zeitaufwendig. Für flüssige Bewegungen sind deshalb sehr viele

Bilder notwendig. Zudem wirken Bewegungsabläufe oft unrealistisch.

2.2.2

Simulative Animation

Aus dem Bereich der simulativen Animation sollen zwei Basisverfahren, die man zur Objektdeformation verwendet, näher erklärt werden. Bei beiden Verfahren muss die Objektverformung numerisch

berechnet werden. Dabei werden Objekte in eine endliche Anzahl von Unterelementen aufgeteilt, wovon jedes dann separat berechnet wird. Zur Berechnung werden die mechanischen Gesetze von Navier,

Stoke oder Hooke verwendet. Bei den beiden Methoden handelt es sich um das Masse-Feder-Dämpfer

System und um die Finite-Elemente-Methode [NC06].

Masse-Feder-Dämpfer Systeme sind wohl die einfachsten und intuitivsten aller deformierbaren Modelle. Hierbei muss die Deformation auf Grundlage der Polygonnetze von Objekten berechnet werden.

Das Modell besteht aus Punktmassen für jeden Eckpunkt des Polygonnetzes. Die Punktmassen sind

über ein Netzwerk von masselosen Federn miteinander verbunden.

Die physikalische Grundlage solcher Systeme basiert auf dem Hookschen-Gesetz. Es beschreibt ein

linear-elastisches Verhalten von Festkörpern. Dabei sind einwirkende Kraft und elastische Verformung

proportional zueinander.

Die Gesamtmasse des zu simulierenden Objekts verteilt sich gleichmäßig auf eine endliche Anzahl

verschiedener Massepunkte. Benachbarte Massepunkte sind über masselose elastische Federn miteinander verbunden, welche die Federkonstante k besitzen. Diese Konstante gibt die Starrheit der

jeweiligen Feder an. Durch Ändern der Federkonstante lässt sich die Elastizität des Objekts variieren.

KAPITEL 2. GRUNDLAGEN

11

Parallel zu den Federn befinden sich imaginäre masselose Dämpfungsglieder. Den Aufbau eines solchen Systems zeigt Abbildung 2.3. Dieses besitzt die Dämpfungskonstante cv . Das Dämpfungsglied

sorgt dafür, dass eine einmal in Schwingung versetzte Feder nach einer bestimmten Zeit langsam

ausschwingt und schließlich in die Ruhelage zurück kehrt. Je mehr dieser Federn in einem Objekt

vorhanden sind, desto genauer und realistischer kann die Deformation des Objekts dargestellt werden.

Die Gesamtkraft des Systems setzt sich aus drei Teilen zusammen: Dämpfer, Feder und Trägheit.

fGesamt = fDämpfer + fFeder + fTrägheit

(2.1)

Die einzelnen Elemente aus Gleichung (2.1) stellen sich folgendermaßen dar:

fDämpfer = v · cv

(2.2)

−

−

−

fFeder (→

x i ) = −k(→

x i −→

x rest )

(2.3)

fTrägheit = m · a

(2.4)

wobei k die Federkonstante, a die Beschleunigung, v die Geschwindigkeit, cv die Dämpfungskonstante, m die Masse und xrest die Ruheposition ist.

Die Gründe für die weite Verbreitung des Masse-Feder-Dämpfer Systems sind das leichtverständliche physikalische Konzept, die einfache Implementierung und die relativ niedrigen Rechenanforderungen. Allerdings ist es sehr ungenau. [TF88] liefert einen Ansatz der Masse-Feder-Dämpfer Systeme um Viskoelastizität, Plastizität und Fraktur erweitert.

Abbildung 2.3: Masse-Feder-Dämpfer System [Mas]

Die Finite-Elemente-Methode ist ein beliebtes Standardverfahren zur Festkörpersimulation. Bei diesem numerischen Verfahren werden partielle Differentialgleichungen auf irregulären Gittern gelöst.

Bei komplexen Zusammenhängen wird das Gesamtproblem in eine endliche Anzahl einfacher Teilprobleme zerlegt, wobei jedes Teilproblem, wie in Abbildung 2.4 dargestellt, ein finites Element be-

KAPITEL 2. GRUNDLAGEN

12

schreibt. Man überführt dadurch ein kontinuierliches Problem in ein diskretes und berechnet dabei

eine approximative Lösung. Je höher der Diskretisierungsgrad ist, desto genauer nähert sich die approximative Lösung der exakten Lösung an.

Die gebildeten finiten Elemente sind an ihren Eckpunkten mit den Nachbarelementen verbunden.

Innerhalb der finiten Elemente werden für die gesuchte Lösung Ansatzfunktionen definiert. Diese

Ansatzfunktionen werden dann in die zu lösenden Differentialgleichungen eingesetzt. Gemeinsam

mit den Randbedingungen erhält man ein Gleichungssystem von Gleichgewichts- und Bewegungsgleichungen. Dieses Gleichungssystem wird numerisch gelöst.

Wenn bei einem zu simulierenden Objekt bestimmte Gebiete von größerem Interesse sind, können

diese Bereiche mit kleineren Elementen beschrieben werden, um einen höheren Detaillierungsgrad zu

erhalten.

Im Bereich der numerischen Strömungsmechanik gibt es noch weitere Verfahren wie die FiniteDifferenzen-Methode oder die Finite-Volumen-Methode [NC06]. Diese Methoden liefern eine hohe

Genauigkeit bei der Simulation. Der Aufwand ist dafür größer, da ein vollständiges Polygonnetz zur

Simulation gespeichert werden muss.

Abbildung 2.4: Unterteilung in finite Elemente [Mü08]

2.2.3

Kinematische Techniken

Der Begriff Kinematik kommt aus dem Sektor der Robotik. Ein typischer Roboterarm besteht aus zwei

verschiedenen Elementtypen. Dies sind starre Elemente, welche auch als Hebel bekannt sind und als

Verbindungselemente Gelenke verwenden. Der Aufbau eines Roboterarms ist dabei ein hierarchisches

Modell, wobei Hebel an ihren Enden durch Gelenke miteinander verbunden werden. Die Abfolge von

Hebeln und Gelenken, die schließlich den Roboterarm bilden, bezeichnet man als kinematische Kette.

Den Fixpunkt des Roboterarms deklariert man als Basis, dass freie Ende der Kette heißt Endeffektor.

Dieser Aufbau wird in Abbildung 2.5 dargestellt.

KAPITEL 2. GRUNDLAGEN

13

Abbildung 2.5: Kinematische Kette eines Roboterarms [Bre07]

Wie bei [Bre05] beschrieben, kann man einen menschlichen Arm mittels Kinematik simulieren. Dabei ist der Rumpf die Basis mit der Schulter als Basisgelenk, an die in hierarchischer Weise Oberarm als erstes kinematisches Glied, Ellenbogen als Zweitgelenk, Unterarm als zweites kinematisches

Glied, Handbeuge als Drittgelenk und Hand als drittes kinematisches Glied angeheftet sind. Die Hand

fungiert gleichzeitig als Endeffektor. Das Ganze bildet eine offene kinematische Kette.

Um eine parametrische Beschreibung von kinematischen Ketten zu erreichen, verwendet man die

Regeln von Denavit und Hartenberg. Dabei wird jeder starre Hebel mit den Parametern Gelenkwinkel,

Hebelverschiebung, Hebellänge und Hebeldrehung beschrieben [Par02].

Zur Berechnung von offenen kinematischen Ketten gibt es in der Kinematik zwei Möglichkeiten.

Bei der Vorwärtskinematik wird die Position und Orientierung des Endeffektors als Funktion seiner

Gelenkwinkel berechnet. Bei gegebenen Gelenkwinkeln kann man ausgehend von der Basis entlang

der kinematischen Kette sukzessive die Positionen der kinematischen Glieder berechnen.

Als Eingangswerte der Berechnung dienen dabei die Koordinaten des jeweils vorherigen Kettengliedes, sowie die Winkelstellungen des vorherigen Gelenkes. Aus den gegebenen Gelenkstellungen wird

dann die finale Endeffektorstellung berechnet.

Bei der Inversen Kinematik ist die Berechnungsreihenfolge innerhalb der Hierarchie der kinematischen Kette genau entgegengesetzt zur Vorwärtskinematik. Hierbei hat der Nutzer die Position des

Endeffektors gegeben, und berechnet die Gelenkstellungen.

Die Vorwärtskinematik führt immer auf eine eindeutige analytische Lösung. Bei der Inversen Kinematik ist das Problem nicht immer analytisch lösbar, und enthält im Allgemeinen Mehrdeutigkeiten.

Eine Animationsart aus dem Feld der Kinematik ist die Boneanimation. Hierbei werden Bereiche

des Körpers durch gewisse Repräsentanten, auch Knochen genannt, dargestellt. Die Knochen bauen

den Menschen hierarchisch auf. Wie oben beschrieben besitzt die Darstellung Hebel und Gelenke.

Dieser Aufbau des menschlichen Skeletts kann somit in einer Baumdatenstruktur abgelegt werden

[Shi05, Par02].

Die Basis sitzt im Körperschwerpunkt, dem Rumpf. In der Baumdarstellung ist der Rumpf der Wurzelknoten. Da es sich um eine offene kinematische Kette handelt, besitzt das Modell Endeffektoren für

KAPITEL 2. GRUNDLAGEN

14

Füße, Hände und den Kopf. In der Baumdarstellung liegen die Endeffektoren an den Blattknoten. Die

Knoten werden über Kanten verbunden. Die Hebel werden als Knoten dargestellt, die Gelenke sind

die Baumkanten, wie in Abbildung 2.6 zu sehen ist. Die Knoten besitzen jeweils eine Transformationsmatrix. Ein Pfad enthält die Transformation des jeweiligen Hebels. Wenn man sich entlang des

Pfades zu einer Hand bewegt, entspricht das einer Hintereinanderausführung der einzelnen Transformationsmatrizen, um an die entsprechende Position zu gelangen. Das lässt sich beispielsweise durch

folgende Gleichung verdeutlichen.

Hand = Rumpf · Oberkörper · Schulter · Oberarm · Unterarm

Abbildung 2.6: Hierarchischer Aufbau eines Menschen sowie die dazu gehörige Baumstruktur [Par02]

2.2.4

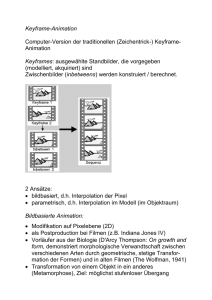

Animation durch Interpolation

Bei der Animation durch Interpolation wird die Bewegung der Szene durch Schlüsselbilder, sogenannte Keyframes, dargestellt. Die Keyframes geben grob den Bewegungsablauf der Animation an.

Folglich findet zwischen den Keyframes eine Bildinterpolation statt, für welche die Zwischenbilder

berechnet werden müssen.

Eine der bekanntesten Keyframing-Techniken ist das Morphing. Dabei wird versucht, einen optisch

realistischen Übergang von einem Ursprungsbild zu einem Zielbild zu erzeugen. Dazu werden die

Positionen der korrespondierenden Pixel zwischen den beiden Keyframes interpoliert. Meist wird

parallel auch die Farbe der Pixel interpoliert, so dass ein weicher Übergang entsteht [Bre05]. Damit der

Übergang zwischen den Bildern möglichst realistisch wirkt, sollten sich Ursprungs- und Zielbild nicht

zu sehr voneinander unterscheiden. So ist es beispielsweise vorteilhafter, zwei Gesichter ineinander

umzuwandeln anstatt ein Gesicht in ein Objekt. Diese Technik wird vor allem in der Filmindustrie

angewandt.

KAPITEL 2. GRUNDLAGEN

15

Um die Technik etwas genauer zu erläutern, wird kurz der aus drei Arbeitsschritten bestehende Ablauf des Morphing erklärt.

Der erste Schritt ist das Verzerren. Hier wird das aktuelle Bild transformiert, um die Konturen der

beiden Bilder zur Übereinstimmung zu bringen. Das bedeutet, dass jeder Position eines Punktes im

Quellbild eine neue Position zugeordnet wird.

Der zweite Teil benutzt Zwischenbilder. Hierbei wird jeder Punkt im Quellbild in die durch die

Verzerrung berechnete Position überführt. Das geschieht durch eine lineare Interpolation.

Der finale Schritt ist die Überblendung, die parallel zur Berechnung der Zwischenbilder stattfindet.

Bei den ersten Interpolationsschritten ist der Anteil des Ursprungsbildes bestimmend. Im weiteren

Verlauf der Interpolation nimmt der Anteil des Zielbildes immer weiter zu, bis das Morphing schließlich beim Zielbild beendet ist.

Abbildung 2.7: Interpolation zwischen zwei Bildern [Bre07]

2.2.5

Bewegungserfassung

Eine weitere Technik um Bewegungen zu animieren ist das Motion Capture. Hierbei werden menschliche Bewegungen mit einer Kamera aufgezeichnet. Die dabei erfassten Informationen können ganz

allgemein sein, wie Positionen eines Körpers im Raum, oder komplex, wie die Deformation des Gesichts oder der Muskelmassen. Die Technik eignet sich zur Animation von Computercharakteren.

Dabei werden die aufgezeichneten menschlichen Bewegungen auf Bewegungen eines Computercharakters abgebildet [Stu94].

Zur Aufzeichnung der Bewegungen von realen Objekten gibt es im Motion Capture grundsätzlich

KAPITEL 2. GRUNDLAGEN

16

zwei verschiedene Verfahren [Shi05]. Bei optischen Methoden werden kleine Markierungen am jeweiligen Objekt angebracht. Diese Markierungen werden durch verschiedene Kameras aufgezeichnet,

die dabei Aufschluss über die Position des Objekts im Raum liefern. Allerdings müssen die Kameras

im Raum so angebracht sein, dass möglichst wenige Markierungen verdeckt werden.

Bei nicht-optischen Verfahren werden Ganzkörperanzüge benutzt, an denen elektromagnetische Sensoren angebracht sind. Die Sensoren geben Auskunft über die Position im Raum und dienen somit zur

Erfassung der Bewegung.

Nach der Aufnahme der Bewegung können die Daten weiter verarbeitet werden. Dabei werden die

Daten auf eine Art Strichmännchen abgebildet. Dieses Strichmännchen folgt den aufgenommenen

Bewegungen. Somit führt das virtuelle Objekt die aufgezeichneten Bewegungen des Menschen aus.

Ein Beispiel dafür ist die Figur des “Gollum” im Film “Der Herr der Ringe”, wie in Abbildung 2.8

gezeigt wird.

Abbildung 2.8: Motion Capture [Mot]

Mit der erwähnten Methode können komplexe Bewegungen wie Laufen mit geringerem Aufwand

als bei anderen Techniken dargestellt werden.

Allerdings können die mit Motion Capture erstellten Bewegungen einen unnatürlichen Eindruck

erwecken. Das kann passieren, wenn sich die menschliche Figur zu sehr von der neuen Figur unterscheidet, da hierbei zu wenige Daten zur Berechnung von Zwischenbildern zur Verfügung stehen.

Zudem müssen die Kosten für die verwendete Ausrüstung beachtet werden.

2.2.6

Punktbasierte Animation

Im bisherigen Verlauf wurden vor allem Methoden vorgestellt, die auf Netzen, sogenannten Meshes,

beruhen. Bei der Repräsentation eines menschlichen Skeletts werden die einzelnen Knochen über

Gelenke zusammengehalten, so dass immer ein Zusammenhang zwischen einzelnen Körperelementen

KAPITEL 2. GRUNDLAGEN

17

besteht.

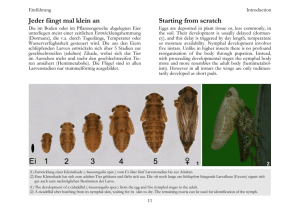

Bei der punktbasierten Animation werden meshfreie Methoden verwendet. Diese Verfahren stellen

eine Alternative zu den bereits etablierten meshbasierten Techniken dar. Im Gegensatz zu meshbasierten Techniken, in welcher die einzelnen Dreiecke miteinander verbunden sind, besteht zwischen den

einzelnen Punkten dabei kein Zusammenhang. Die Punkte besitzen keine Topologieinformationen.

Die punktbasierten Techniken eignen sich zur Volumensimulation, da im Unterschied zu den meshbasierten Verfahren Volumeninformationen vorhanden sind. Jeder der Punkte hat in seiner Umgebung

lokale Eigenschaften, welche ihn beschreiben. Abbildung 2.9 vergleicht ein Objekt aus Meshes mit

einem auf Punkten basierenden Objekt.

Abbildung 2.9: Meshbasierter [Mes] und punktbasierter [Poi] Standford Bunny

Solche meshfreien Methoden, zu denen die punktbasierte Animation gehört, kommen in Partikelsystemen zum Einsatz. Hierdurch lassen sich Rauch und Flüssigkeiten besonders gut animieren, wobei

auf diesen Bereich in Kapitel 3 noch genauer eingegangen wird.

Punkte sind immer dann eine gute Wahl, wenn man dreidimensionale Objekte animieren möchte,

welche sich dynamisch ändern. Wenn bei der Simulation einzelne Punkte hinzugefügt oder gelöscht

werden, muss man sich keine Gedanken darüber machen, dass der Zusammenhang zerstört wird, da

Punkte nicht zusammenhängend sind. Bei meshbasierten Methoden würde eine solch dynamische

Änderung zu schlecht konditionierten Meshes führen. Zusammenhangs- und Nachbarschaftsinformationen würden teilweise nicht mehr stimmen, wodurch das Mesh neu berechnet werden müsste. Diese

Technik ist als Remeshing bekannt.

Aus diesem Grund eignen sich punktbasierte Techniken zur Animation von großen Deformationen.

Allerdings bringen diese Verfahren nicht nur Vorteile. Wenn neue Punkte in das Modell eingefügt

werden, muss in einem Schritt die Nachbarschaft neu berechnet werden, da man ohne Zusammenhangsinformationen kein Wissen darüber hat, welche Punkte nun in der Nachbarschaft liegen.

KAPITEL 2. GRUNDLAGEN

2.3

18

Grundlagen der Physik

Um eine Animation physikalisch korrekt ablaufen zu lassen, muss man feststellen, welche Bereiche

der Physik dafür wichtig und von Interesse sind.

Die Physik beschäftigt sich mit den Vorgängen der unbelebten Natur und ihrer mathematischen Beschreibung. Sie ist aus dem Wunsch der Menschen entstanden, die Naturerscheinungen zu verstehen,

auf allgemeine Gesetze zurückzuführen und sich die Natur durch diese Erkenntnisse zu Nutze zu machen. In der Experimentalphysik werden Naturgesetze durch Beobachtung und Erfahrung gewonnen,

in der Theoretischen Physik durch Mathematik und Logik. Dabei ergänzen sich Experimental- und

Theoretische Physik, indem die Experimentalphysik Hypothesen der Theoretischen Physik bestätigt

und die Theoretische Physik auf Ergebnisse der Experimentalphysik zurückgreift [Phya].

Der Überbegriff Physik besteht aus vielen Teilbereichen, wie z.B. Mechanik, Thermodynamik, Elektrodynamik, Optik oder Akustik.

Da die Animation physikalisch korrekt ablaufen soll, ist entscheidend, welche Gebiete der Physik

besonderen Einfluss darauf haben. Physikalische Korrektheit ist im Sektor der Computerspiele ein

wichtiger Faktor. Da hier einige Effekte aus verschiedenen physikalischen Bereichen keinen Einfluss

haben, lohnt sich der Blick auf dieses Feld.

Die Thermodynamik hat noch keinen Einzug erhalten, sonst würden Schüsse aus einer Laserwaffen

diese sofort verdampfen lassen [Kle05]. Die Optik und Akustik werden meist von speziellen Engines

berechnet. Zudem findet die Elektrodynamik im Computerspielebereich keinen direkten Einfluss auf

die physikalische Korrektheit. Unter den oben aufgezählten Teilgebieten hat die Mechanik somit den

größten und wichtigsten Einfluss auf das physikalisch korrekte Ablaufen der Animation.

Die Mechanik befasst sich mit der Bewegung von Körpern und der Einwirkung von Kräften auf diese

Körper. Dabei sind äußere Kräfte wie die Gravitation und Kräfte, welche Körper aufeinander ausüben,

zu beachten. Der einfachste Teil der Mechanik behandelt Fälle, in denen man von der Ausdehnung der

Körper absehen und sie als mit Masse behaftete Punkte, sogenannte Massenpunkte, betrachten kann

[Mes06].

Ein Bereich der Mechanik der Massepunkte ist die Kinematik, die den Ablauf der Bewegung untersucht, ohne nach dem Grund für diese zu Fragen. Wichtige Größen sind dabei der Ortsvektor, die

Geschwindigkeit und die Beschleunigung.

Das Gegenstück der Kinematik ist die Dynamik, die sich mit der Bewegung von Körpern unter Einwirkung von Kräften beschäftigt. Es wird also nach der Ursache der Bewegung, besser nach der Ursache einer Änderung des Bewegungszustandes gefragt. Kräfte und Impulse, sowie deren Erhaltung,

spielen also eine wichtige Rolle.

Aus der Punktmechanik kann man logisch einwandfrei die Mechanik des starren Körpers und die der

deformierbaren Körper entwickeln, indem man diese als Systeme unendlich vieler Massenpunkte mit

festen bzw. veränderlichen relativen Lagebeziehungen auffasst.

Bisher durften sich Dinge nur wie Massepunkte verhalten, d.h. translatorisch bewegen. In der Me-

KAPITEL 2. GRUNDLAGEN

19

chanik der starren Körper erhalten die Körper eine Ausdehnung und können sich daher auch drehen.

Eine Translation ist eine Bewegung, bei der alle Punkte des Körpers kongruente Bahnen beschreiben.

Diese Bahnen dürfen durchaus gekrümmt sein. Bei einer Rotation beschreiben alle Punkte konzentrische Kreise um eine bestimmte Gerade, die Drehachse [Mes06]. Weitere wichtige Begriffe aus diesem

Feld sind die Winkelgeschwindigkeit, das Drehmoment und der Drehimpuls.

Im täglichen Leben hat man es mit Systemen aus sehr vielen Teilchen zu tun, die alle aufeinander

Kräfte ausüben. Dazu kommen noch von außen wirkende Kräfte. Im Sektor der Mechanik deformierbarer Körper spielen zusätzlich noch die Kräfte eine Rolle, die innerhalb der Körper wirken. Insofern

können Körper bei Kollision oder Krafteinwirkung von außen ihre Form ändern, und sind deshalb

deformierbar.

Oben genannte physikalische Größen müssen nun für jedes Objekt gespeichert werden, um die

Grundlage für Simulationen zu erhalten. Das Problem besteht nun darin, die Bewegungsgleichung

der einzelnen Körper zu lösen. Die Bewegungsgleichung drückt aus, an welchem Ort sich ein Körper

zu einem bestimmten Zeitpunkt befindet.

Kapitel 3

State of the Art

Im vorigen Kapitel über die Grundlagen der Arbeit wurden einige Animationstechniken vorgestellt,

die auf der Basis von Polygonnetzen arbeiten. Im Zuge der punktbasierten Animation interessieren

Animationsmethoden, bei denen die einzelnen Punkte keine Topologieinformationen besitzen. In diesem Kapitel wird auf den aktuellen Stand der Technik im Bereich der meshfreien Techniken eingegangen. Hierzu werden Partikelsysteme, mit denen sich Feuer-, Rauch- oder Explosionseffekte animieren

lassen, und die Smoothed Particle Hydrodynamics Methode, mit der es möglich ist, Flüssigkeiten zu

animieren, näher betrachtet. Ebenfalls werden einige Anwendungsmethoden aufgezeigt, die mit der

punktbasierten Animation arbeiten. Da die physikalischen Berechnungen in dieser Arbeit mit Hilfe einer Physikengine durchgeführt werden, folgt eine Einführung dieser. Abschließend werden die

Grundlagen der in dieser Arbeit verwendeten Physikengine erläutert.

3.1

Partikelsysteme

Seit Beginn der Computergraphik werden dreidimensionale Objekte, die eine feste Oberfläche haben,

durch Netze und Kombinationen von Polygonen dargestellt. Die Darstellung von Objekten mit variabler Oberfläche war nicht möglich. Dabei handelt es sich um elastische Gegenstände oder auch die

Simulation von Feuer oder Nebel.

Eine Methode, um solche Phänomene zu simulieren, sind die Partikelsysteme. Ein Partikelsystem

ist eine Ansammlung von winzigen Partikeln, die zusammen das verschwommene Objekt bilden.

Es besitzt einen Kern, der alle Partikel steuert, deren Bewegungsabläufe bestimmt und ebenfalls die

physikalischen Gesetze definiert, durch welche die Partikel beeinflusst werden.

Diese Partikelsysteme wurden in [Ree83] eingeführt, um einen realitätsnahen Feuereffekt zu entwickeln. Die Objekte werden als verschwommen und somit als nicht starr bezeichnet. Die Darstellung

von Partikelsystemen unterscheidet sich in drei Arten von meshbasierten Techniken.

Als erstes wird ein Objekt nicht durch eine Menge von primitiven Oberflächenelementen wie Polygonen repräsentiert, sondern als Wolke von primitiven Partikeln, die das Volumen definieren. Ein

Partikel ist also ein Punkt im dreidimensionalen Raum, der das Volumen des Objekts darstellt [Kei06].

20

KAPITEL 3. STATE OF THE ART

21

Zum zweiten ist ein Partikelsystem kein statisches Objekt. Seine Partikel ändern ihre Form und

bewegen sich im Laufe der Zeit. Neue Partikel werden “geboren” und ältere Partikel “sterben”.

Als drittes ist ein Objekt, das durch ein Partikelsystem animiert wird, nicht deterministisch, da seine

Form nicht vollständig spezifiziert ist. Stattdessen benutzt man stochastische Prozesse, um die Objektform zu bilden und zu ändern.

Um jedes einzelne Bild in der Bewegungssequenz zu berechnen, werden fünf Phasen durchlaufen

[Ree83, Hei02].

In der ersten Phase werden neue Partikel im System erzeugt. In Phase zwei werden jedem neuen

Partikel individuelle Eigenschaften zugewiesen. Die dritte Phase untersucht die vorgeschriebene Lebensdauer der Partikel. Wenn ein Partikel innerhalb des Systems diese Lebensdauer überschritten hat,

wird er ausgelöscht. In Phase vier werden die noch vorhandenen Partikel gemäß ihrer definierten

Eigenschaften bewegt und verändert. In den ersten vier Phasen wurden alle benötigten Änderungen

an den Partikeln vorgenommen. Abschließend wird in Phase fünf ein Bild aus den noch “lebenden”

Partikeln in den Bildspeicher gerendert.

Im Ablauf von Partikelsystemen wurden schon die individuellen Eigenschaften jedes Partikels erwähnt. Für jedes in Phase eins neugebildeten Partikel muss das System die folgenden Eigenschaften

bestimmen:

• Position

Die Position beschreibt den Punkt im Raum, wo sich das entsprechende Partikel während der

Animation in der Szene befindet.

• Geschwindigkeit und Richtung

Die Bewegung eines Partikels in der Szene wird durch jeweils einen Geschwindigkeits- und

Richtungsvektor festgelegt. Sowohl die Geschwindigkeit, als auch die Richtung kann während

ihrer Lebensdauer noch durch äußere Einflüsse, wie die Gravitation, oder durch Interaktion mit

anderen Partikeln geändert werden.

• Größe

Im Normalfall werden Partikel als nulldimensionale Objekte wie Punkte im Raum definiert.

Tritt der Fall ein, dass ein- oder mehrdimensionale Strukturen benutzt werden, kann einem

Partikel ebenfalls eine Größe zugeordnet werden. Diese Größe kann sich im Laufe des Lebens

der Partikel durch Einflüsse des Systems ändern.

• Farbe

Die Partikelfarbe, die zu Beginn der Simulation festgelegt wurde, kann sich im Laufe der Zeit

auch ändern. Wenn beispielsweise ein Feuer animiert werden soll, kann die Anfangsfarbe ein

Weiß oder helles Gelb sein. Im Zuge der Simulation kann durch die Temperaturänderung dieser

Farbton ins Rötliche übergehen und schließlich einen immer dunkleren Farbton annehmen.

KAPITEL 3. STATE OF THE ART

22

• Transparenz

Aus vielen Computergraphik-Anwendungen kennt man den Begriff des Alpha-Kanals2 . Vergleichbar zu diesem Begriff ist die Transparenz, die ein Partikel durchsichtig macht. Auch die

Transparenz kann sich während der Lebensdauer ändern.

• Form

Neu erstellte Partikel haben eine bestimmte Form. Während der Simulation kann sich diese

Form durch äußere Einflüsse oder Interaktion mit benachbarten Partikeln ändern.

• Lebensdauer

Wie oben erwähnt, werden neue Partikel “geboren” und ältere Partikel “sterben”. Der Zeitraum

zwischen der “Geburt” und dem “Ableben” eines Partikels bezeichnet man als Lebensdauer.

Bei den aufgezählten Attributen handelt es sich um die Haupteigenschaften, die jeder Partikel eines

Partikelsystems besitzt. Natürlich können Partikel auch noch weitere Eigenschaften wie Masse oder

Alter besitzen.

Sobald die Positions- und Erscheinungsparameter aller Partikel berechnet wurden, erzeugt der Renderingalgorithmus daraus ein Bild. Klassische dreidimensionale Renderingverfahren wie das Raytracing sind für Partikelsysteme nicht geeignet. Da eine hohe Anzahl an Partikeln vorliegt, muss das

Verfahren sehr viele Schnittberechnungen für alle Partikel durchführen, was es extrem rechenaufwendig macht.

Für Partikelsysteme werden spezielle Renderingverfahren benötigt. Bei der Berechnung des Bildes

wird zwischen Methoden für selbstleuchtende und reflektierende Partikel unterschieden.

Partikelsysteme können zudem hierarchisch aufgebaut sein. Das bedeutet, dass ein Partikel, welcher

vom Partikelsystem erzeugt wurde, selbst ein Partikelsystem ist. Dieses neue Partikelsystem ist nun

auch in der Lage neue Partikel zu erschaffen und auszusenden, da es alle Regeln und Eigenschaften

des Elternsystems “erbt”. Somit gibt es nicht nur eine einzige Quelle zur Neubildung von Partikeln.

Die Datenstruktur, die sich für einen derartigen hierarchischen Aufbau eignet, ist ein Baum.

Ein Anwendungsbeispiel eines hierarchischen Aufbaus ist die Explosion von Feuerwerkskörpern,

wie in Abbildung 3.1 dargestellt. Zu Beginn wird die Explosion von einem zentralen Punkt gestartet.

Im weiteren Verlauf spaltet sich die Explosion in verschiedene Teilexplosionen auf, was sich sehr

schön mit einer Baumdatenstruktur verwirklichen lässt.

Beim Modellieren von verschwommenen Objekten haben Partikelsystem-Anwendungen einige wichtige Vorteile gegenüber klassischen, oberflächenorientierten Techniken [Ree83, Kei06]. Zunächst ist

ein Partikel ein einfacheres Primitiv als ein Polygon. Das ermöglicht die Animation einer großen

Anzahl von Partikeln für komplexe Szenen. Ein zweiter Vorteil ist die prozedurale Definition des Modells. Seine stochastische Kontrolle vereinfacht den Aufbau des Systems. Schließlich können durch

Partikelsysteme “lebende” Objekte modelliert werden, die ihre Form im Laufe der Zeit ändern. Es

2 Alpha-Kanal

gibt die Durchsichtigkeit eines Bildpunkts an

KAPITEL 3. STATE OF THE ART

23

ist schwierig, komplexe Dynamik solcher Form mit Hilfe von oberflächenbasierten Techniken zu repräsentieren. Somit lassen sich Animationen von physikalischen Phänomenen realitätsnah darstellen.

Partikelsysteme sind flexibel und lassen sich hierarchisch aufbauen. Mit diesen Partikelhierarchien

können verschwommene Objekte wie Wolken erzeugt und überwacht werden. Zudem nehmen Zufallskomponenten durch stochastische Prozesse Einfluss.

Da Partikelsysteme aus tausenden Partikeln bestehen, und für jedes Partikel individuell die Physik

berechnet werden muss, wird die Methode extrem rechenintensiv. Ein weiterer Nachteil ist der hohe

Implementierungsaufwand von Partikelsystemen.

Mit Partikelsystemen können eine Vielzahl von physikalischen Phänomenen animiert werden. Sie

werden gerne zur Animation von Feuer, Rauch oder Explosionen verwendet. Wie im Fall von Explosionen zuvor schon erwähnt, führt der hierarchische Aufbau von Partikelsystemen zu besseren

Ergebnissen bei der Animation. Ebenfalls können Wasserfontänen, Flüssigkeiten oder Wolken auf

diese Weise animiert werden. Andere Anwendungen von Partikelsystemen sind die Animation von

Gras bzw. Pflanzen oder Tierschwärmen. Gleichwohl finden sie Einzug in Computerspielen, sowie in

Kinofilmen, um Spezialeffekte darzustellen.

Abbildung 3.1: Animation eines Feuerwerks mit Hilfe eines Partikelsystems [Hei02]

3.2

Smoothed Particle Hydrodynamics

Ein zweites Verfahren im Bereich der meshfreien Anwendungen ist die sogenannte Smoothed Particle

Hydrodynamics3 (SPH). Es handelt sich um eine numerische Methode, mit welcher hydrodynamische

Gleichungen gelöst werden können.

Ursprünglich ist SPH eine Methode zur Simulation von astrophysikalischen Problemen, die von

[GM77] eingeführt wurde. Diese ist aber allgemein genug, um für jegliche Art von Flüssigkeitssimulation benutzt zu werden. Für vertiefende Informationen zur SPH Technik sei dem Leser [Mon92]

empfohlen.

3 SPH:

geglättete Teilchen-Hydrodynamik

KAPITEL 3. STATE OF THE ART

24

SPH ist eine Interpolationsmethode für Partikelsysteme. Bei der Methode werden diskrete, geglättete

Partikel benutzt, um approximierte Werte von den benötigten physikalischen Größen und ihren räumlichen Ableitungen zu berechnen. Mit Hilfe der Partikel wird eine Flüssigkeit abgetastet. Die Partikel

sind Punkte auf der Oberfläche der Flüssigkeit, welche zu Beginn zufällig, wie bei der Monte-CarloMethode, verteilt werden. Für jedes Partikel können physikalische Eigenschaften wie Masse, Position

oder Geschwindigkeit in Abhängigkeit seiner Nachbarn berechnet werden.

Die Zahl der Partikel in einem bestimmten Bereich des Fluids ist ein Maß für die Dichte. In SPH

wird die Dichte mit dem Wert 0 dadurch simuliert, dass sich in einem solchen Gebiet keine Partikel

befinden. Wird die Dichte in diesem Umfeld im Laufe der Zeit größer, wandern die Partikel in dieses

bisher leere Gebiet [Ott95]. Es folgt eine mathematische Beschreibung dieser Methode.

Eine Funktion A wird an einer Position x von seinen benachbarten Partikeln interpoliert und benutzt

eine Summation [NC06]:

A(x) = ∑ m j

j

Aj

W (r, h)

ρj

(3.1)

A j bezeichnet den Funktionswert des Partikel p j am Interpolationspunkt x j , m j und ρ j sind die Masse

und Dichte des Partikel p j , und entsprechend r = x − x j .

Die Dichte ρi kann mit Gleichung (3.1) berechnet werden und führt zu

ρi = ρ(xi ) = ∑ m jW (xi − x j , h).

(3.2)

j

W (r, h) ist ein sogenannter smoothing Kernel4 . h ist die Glattlänge und beschreibt den wichtigsten

Parameter der SPH Methode. Er stellt den mittleren Abstand der einzelnen Partikel dar. Die Glattlänge

bestimmt die Auflösung dieser Methode und hat somit einen großen Einfluss auf den Rechenaufwand

der Simulation. Je niedriger die Größe von h ist, desto genauer ist die Simulation.

In Bereichen mit einer höheren Dichte benutzt man eine große Glattlänge. Entsprechend wird in

Gebieten mit kleiner Dichte eine kleine Glattlänge zur Simulation verwendet. Somit lässt sich der Rechenaufwand bei gleich bleibender Genauigkeit verringern. Schließlich wird zwischen den Partikeln

der Flüssigkeit die Oberfläche mit Hilfe des Kernels geglättet.

R

Eigenschaften des Kernel sind W (r, h)dr = 1, W (r, h) = 0 für |r| > h und limh→0 W (x, h) = δ (x),

wobei h die zuvor beschrieben Glattlänge und δ die Dirac Funktion ist. Die Wahl des smoothing

Kernels ist eine wichtige Aufgabe der Methode, da hierdurch festgelegt wird, wie viele Nachbarn zur

Berechnung mit einbezogen werden. Somit lässt sich der Rechenaufwand eingrenzen. Ausführliche

Informationen über Kernels sind in [Mon92] nachzulesen.

Ganz allgemein lässt sich sagen, dass die Animationsqualität und die Genauigkeit mit größerer Anzahl an Partikeln wachsen.

Bei der Methode werden aus partiellen hydrodynamischen Differentialgleichungen gewöhnliche Differentialgleichungen. SPH Methoden haben gegenüber traditionellen gitterbasierten Verfahren einige

4 Glättungskern

KAPITEL 3. STATE OF THE ART

25

Vorteile. Da SPH eine Lagrange-Methode ist, ist die Kontinuitätsgleichung automatisch erfüllt. Die

Programmierungs- und Berechnungskomplexität wird im Gegensatz zu anderen Ansätzen reduziert,

was die Methode brauchbar für interaktive Anwendungen macht. Zudem ist der Code sehr robust.

Durch die zufällige Verteilung der Partikel zu Beginn der Anwendung werden zu erwartende Fehler

minimiert. Darüber hinaus wird für die Berechnung von Ableitungen kein Gitter benötigt.

Allerdings zeigt die Methode auch Nachteile gegenüber gitterbasierten Techniken. Manchmal ist der

Code zu robust, was zur Folge hat, dass SPH Ergebnisse zu einem falschen Modell liefert, die dann

aber nicht physikalisch korrekt sind. Im Übrigen ist es bisher nicht möglich, die Inkompressibilität

des Materials exakt aufrecht zu erhalten. Werden höhere Auflösungen gefordert, sind dazu sehr viele

Partikel notwendig, wodurch der Vorteil des geringeren Rechenaufwandes wieder aufgehoben oder

gar ins Gegenteil verkehrt wird.

Abschließend wird noch auf einige Anwendungen von SPH eingegangen. SPH wurde ursprünglich

von [GM77] eingeführt, um astrophysikalische Probleme wie die Teilung von Sternen zu simulieren.

Die Methode wird immer häufiger für die Animation von Flüssigkeitsbewegungen angewendet, wie in

Abbildung 3.2 gezeigt wird. Des Weiteren wird die Technik benutzt, um Feuer, gasartige Phänomene

und stark deformierbare Objekte zu animieren. Im Laufe der Zeit wurde die SPH Methode erweitert,

um Objekte wie kochendes Wasser, eingeschlossene Luft sowie die Dynamik einer Lavalampe zu

simulieren. Darauf wird in der Arbeit [MG05] genauer eingegangen.

Abbildung 3.2: Flüssigkeitsdarstellung mit der SPH Methode [SPH]

3.3

Anwendungen von punktbasierter Animation

Im Bereich der punktbasierten Animation werden nun verschiedene Arbeiten vorgestellt, die den Ansatz der punktbasierten Animation verwenden. Zunächst eine Methode, mit der sich elastische, plastische und schmelzende Objekte animieren lassen. Eine weitere Arbeit benutzt einen punktbasierten

Ansatz zur Animation von elastoplastischen Festkörpern. Abschließend wird eine punktbasierte Ani-

KAPITEL 3. STATE OF THE ART

26

mation von inkompressiblen Strömungen beschrieben.

3.3.1

Animation von elastischen, plastischen und schmelzenden Objekten

[MKN+ 04] beschreibt ein Verfahren zur Animation von volumetrischen Objekten mit Materialeigenschaften im Bereich starr-elastisch bis zu plastisch-fließend. Bei der meshfreien Methode wird sowohl

das Volumen, als auch die Oberfläche durch eine Punktwolke modelliert, wozu keine Zusammenhangsinformationen zwischen den Punkten benötigt werden. Das verwendete physikalische Modell

basiert auf der Kontinuumsmechanik.

Das Verfahren berechnet mit Hilfe der Methode der kleinsten Quadrate in jedem Zeitschritt die partiellen Ableitungen des Verformungsfeldes, welches für die Deformation benötigt wird. Aus den partiellen Ableitungen des Verformungsfeldes können dann Dehnungen, Spannungen und elastische Kräfte an jedem simulierten Punkt gewonnen werden. Basierend auf den ermittelten Kräften können anschließend die Bewegungsgleichungen gelöst werden. Zur Simulation von elastischen und plastischen

Verformungen wird sowohl ein Elastizitäts- wie auch ein Plastizitätsmodell benötigt.

Die Kontinuumselastizitätsgleichungen beschreiben, basierend auf einem gegebenen Verformungsfeld, wie elastische Spannungen innerhalb eines Volumenobjekts berechnet werden.

In meshfreien Methoden wird das Volumen an einer endlichen Anzahl von Punkten abgetastet, ohne

Zusammenhangsinformationen und ohne den Zwang ein Volumennetz zu generieren.

Abbildung 3.3: Das linke Bild zeigt Phyxel (gelb) und Surfels (blau), die übrigen Bilder zeigen elastische und plastische Verformungen nach [MKN+ 04]

Die Methode benutzt eine abgetrennte Datenrepräsentation. Ein Datensatz wird zur Simulation des

physikalischen Verhaltens benutzt. Diese physikalischen Simulationspunkte werden als phyxel5 bezeichnet. Sie führen alle Simulationsgrößen wie Position, Dichte, Deformation, Geschwindigkeit,

Dehnung, Spannung und Kraft mit. Die Phyxel befinden sich im Inneren des Elements, sind also

Volumenelemente, auf denen die Physik berechnet wird.

Der zweite Datensatz besteht aus Oberflächenelementen. In der Arbeit werden sie als surfels6 bezeichnet. Die Surfels befinden sich auf der Oberfläche des Objekts, bilden seine äußere Haut und

werden zum Rendering benutzt. Abbildung 3.3 zeigt diese Datenrepräsentation, sowie Ergebnisse der

Arbeit.

5 phyxel:

6 surfel:

physical element

surface element

KAPITEL 3. STATE OF THE ART

27

Beim Arbeitsablauf der vorgestellten Methode wird von einer high-level Sicht aus und für jeden

Zeitschritt ∆t die Simulationsschleife folgendermaßen beschrieben:

ut

|{z}

→

Verschiebungen

∇u

|{z}t

Ableitungen

→

εt

|{z}

→

Verformungen

σt

|{z}

Spannungen

→ ft → ut+∆t

|{z}

| {z }

Kräfte

Integration

Nach der Initialisierung startet die Simulationsschleife. Von den Verschiebungsvektoren ui werden

die partiellen Ableitungen approximiert, welche sowohl den Dehnungs- als auch den Spannungstensor definieren. Die Kräfte, die an den Punkten wirken, werden dann als negativer Gradient der Dehnungsenergie bezüglich ihrer Verschiebungen und Zeit berechnet, was neue Verschiebungen ut+∆t

zum Zeitpunkt t + ∆t ergibt.

Durch die Verwendung von Dehnungsstatusvariablen kann man auf elegante Art plastisches Verhalten simulieren [OH02]. Jedes Phyxel i speichert dabei einen plastischen Dehnungstensor εip . Die

Dehnung, welche die Elastizität ε̃i = εi − εip berücksichtigt, ist die Differenz zwischen gemessener

Dehnung εi und der plastischen Verformung. Ist die gemessene Dehnung gleich der plastischen Verformung, wirken keine Kräfte. Da εip innerhalb eines Zeitschritt konstant ist, werden die elastoplastsichen Kräfte durch Benutzen von σ̃i = Cε̃i , anstatt von σi berechnet. Die plastische Verformung wird

in jedem Zeitschritt gemäß [OH02] aktualisiert.

Mit der vorgestellten Methode lassen sich beliebig große Deformationen simulieren. Objekte mit den

Materialeigenschaften starr-elastisch bis plastisch-fließend sind mit diesem Verfahren gut realisierbar.

Eine Besonderheit der Anwendung ist, dass zwischen den verschiedenen Materialeigenschaften zur

Laufzeit gewechselt werden kann.

Allerdings ist die Methode nur zur Animation von dreidimensionalen Volumenobjekten geeignet,

da jedes Phyxel mindestens drei Nachbarn braucht. Daher ist die Animation von zweidimensionalen

Schichten nicht möglich. Zudem finden zwischen in der Nähe liegenden Phyxeln Wechselwirkungen

statt. Bruchsimulationen sind mit dieser Methode somit auch nicht zu verwirklichen.

3.3.2

Punktbasierte Animation von elastoplastischen Festkörpern

Die Animation von elastoplastischen Festkörpern steht im Fokus von [GBB09]. Elastoplastische Festkörper besitzen bei geringer Krafteinwirkung vorwiegend elastische Eigenschaften, d.h. ein Objekt

wird nach Krafteinwirkung wieder in seinen Anfangszustand zurückversetzt. Wenn die einwirkende

Kraft einen bestimmten Wert überschreitet, zeigt das Objekt plastische Eigenschaften und zerfließt,

anstatt in den Anfangszustand zurückzukehren. Stoffe die diese Eigenschaft besitzen, sind z.B. Kaugummi, Zahnpasta oder Knete.

Zur Animation von elastoplastischen Körpern stützt sich die Arbeit auf Modifikationen, die man zum

“Open-Source SPH-Simulator” aus [AG07] gemacht hat.

Ziel dieser Arbeit ist die Berechnung der Elastizität in einer punktbasierten Simulation. Dazu wird

zuerst die Deformation in der Umgebung von jedem Partikel pi berechnet; durch Finden einer affinen Abbildung, welche die Bewegung der benachbarten Partikel über einen einzelnen Zeitschritt am

KAPITEL 3. STATE OF THE ART

28

besten approximiert. Dabei sei xi die Position von pi am Anfang des Zeitschritts, und yi der Ort von

pi am Ende des Zeitschritts. p j sind dabei die Partikel in der Nachbarschaft von pi . Jetzt muss eine

Transformationsmatrix F gefunden werden, die jedes Partikel aus der jeweiligen Anfangsposition x in

die Endposition y transformiert. Dazu muss

n

∑ kF(x j − xi ) − (y j − yi )k

(3.3)

j=1

minimiert werden. Nach Gleichung (3.3) ist x j − xi der Anfangszustand von pi mit dem Nachbarn p j .

Die Transformationsmatrix F verschiebt diesen Anfangszustand nun möglichst nah an den Endzustand

y j − yi . Die Anfangszustände der Partikel werden in der Matrix X und die Endzustände in der Matrix

Y abgelegt. Mit diesen beiden Matrizen wird die Transformationsmatrix F gesucht, so dass

FX = Y.

(3.4)

Auf Gleichung (3.4) wird dann eine Methode der kleinsten Quadrate angewendet. Anschließend transponiert man die Matrizen, um nach der Matrix F aufzulösen, was genauer in[GBB09] beschrieben

ist. Hierdurch erhält man die beste lineare Transformation für die Nachbarschaft um pi , im Sinne

der kleinsten Quadrate. Allerdings muss noch beachtet werden, dass Partikel, die weiter vom Ausgangspartikel entfernt sind, weniger Einfluss haben, als Partikel, die näher an diesem sind. Dazu wird

auf die Spalten X und Y ein Gewichtungskernel multipliziert. Die Implementierung benutzt den poly6

Kernel, der in [MG03] als default smoothing kernel definiert wurde:

2

2 3

315 (h − r )

Wpoly6 (r, h) =

64πh9 0

0≤r≤h

(3.5)

andernfalls.

Der eben beschriebene Kernel multipliziert den konstanten Wert

315

64πh9

mit einem Abstandsterm auf

das jeweilige Nachbarpartikel, wenn das Partikel innerhalb des Abstandsradius liegt. Falls das Partikel

außerhalb des Abstandsradius liegt, wird es mit 0 multipliziert, wodurch das entsprechende Partikel

nicht mit einbezogen wird [Neu10].

Dieser Ansatz ergibt die Deformation über einen einzelnen Zeitschritt. Um die Matrix F zu erhalten,

welche die gesamte elastische Deformation für das jeweilige Partikel liefert, wird das Zeitintervall

in eine bestimmte Anzahl an Zeitschritten aufgetrennt. Für jeden Zeitschritt des Intervalls wird die

Deformation nun zur Gesamtdeformation aufmultipliziert.

Um nach der Elastizität nun noch die Plastizität einfließen zu lassen, wird die Matrix F mit einer

Singulärwertzerlegung diagonalisiert und anschließend mit dem Plastizitätsmodell nach [BT07] multipliziert.

Die vorgestellte Methode besitzt zwei wichtige Vorteile. Zunächst muss kein Anfangsruhezustand

gespeichert werden. Unter großen plastischen Deformationen würde die Abbildung vom Anfangsruhezustand zum aktuellen Zustand numerisch schlecht darzustellen sein. Dadurch, dass nur der elastische Teil der Deformation gespeichert wird, vermeidet man diese numerischen Probleme. Ein zweiter

KAPITEL 3. STATE OF THE ART

29

Vorteil ist, dass direkt mit dem Deformationsgradienten gearbeitet wird. Das Arbeiten mit einem Deformationsgradienten führt zu einer multiplikativen Formulierung der Deformation. Diese ist besser

zur Darstellung endlicher Deformationen geeignet als ein additives Modell von klassischer Plastizität, wie es oft in Graphikanwendungen benutzt wird [SH98]. Hinzu kommt, dass sich die Methode

relativ einfach implementieren lässt. Abbildung 3.4 zeigt ein Ergebnis dieser Arbeit. Wenn der Deformationsgradient abgeschätzt wird, tritt bei der Methode besonders dann ein Problem auf, wenn ein

Partikel zu wenige Nachbarn bei großen Deformationen hat. Das kann zu ungenauen Werten führen.

Aus diesem Grund wird der Deformationsgradient nicht mehr aktualisiert, wenn ein Partikel weniger

als sechs Nachbarn hat. Zudem eignet sich das Verfahren nicht für große elastische Deformationen.

Abbildung 3.4: Elastoplastisches Objekt nach [GBB09]

3.3.3

Punktbasierte Animation von inkompressiblen Strömungen

[SH09] beschäftigt sich mit inkompressiblen Strömungen. Bei der Methode werden die Abtastpunkte

durch die Strömung in einer Lagrangeschen Weise bewegt. Dafür müssen bei der Strömungssimulation die Navier-Stokes-Gleichungen gelöst werden. Es handelt sich dabei um die Grundgleichungen der

Strömungsmechanik. In strömenden Flüssigkeiten ist die Dichte im Allgemeinen überall gleich, denn

der Druck ist nirgendwo hoch genug, um sie wesentlich zu ändern. Strömungen mit konstanter Dichte

heißen inkompressibel [Mes06]. Wenn die Geschwindigkeit vernachlässigt werden kann, erhält man

die Euler-Gleichungen, welche einen Sonderfall der Navier-Stokes-Gleichungen darstellen.

∂u

= −(u · ∇)u − ∇p

∂t

(3.6)

∇ · u = 0,

(3.7)

wobei u die Geschwindigkeit, t die Zeit, p den Druck, und ∇ den Gradienten (∂ /∂ x, ∂ /∂ y, ∂ /∂ z)T

beschreibt.

Die in der Arbeit benutzte Methode kann in sechs Phasen aufgeteilt werden. Zuerst hat man eine

Menge von Abtastpunkten gegeben, welche die Werte des Geschwindigkeitsfelds aufbewahren. Im

zweiten Schritt wird aus den gegebenen Abtastwerten ein Voronoi-Diagramm gebildet. In Phase drei

werden freie Flächen als Vereinigung von Kugeln um die Abtastpunkte definiert. Danach wird das

Voronoi-Diagramm gegen die eben definierten Flächen geclippt. In Schritt fünf führt die Methode eine

Druckprojektion aus, mit deren Hilfe ein divergenzfreies Geschwindigkeitsfeld gebildet wird. Zum

KAPITEL 3. STATE OF THE ART

30

Abschluss werden die Abtastpunkte durch das Geschwindigkeitsfeld transportiert. Eine ausführliche

Beschreibung der einzelnen Schritte ist der Arbeit [SH09] zu entnehmen. Eine graphische Darstellung

der einzelnen Phasen wird in Abbildung 3.5 dargestellt.

Abbildung 3.5: Ablauf der punktbasierten Methode nach [SH09]

Mit dem vorgestellten Verfahren ist es möglich, inkompressible Strömungen und wirbelnden Rauch

zu modellieren. Im Gegensatz dazu kann die SPH Methode nur kompressible Strömungen darstellen. Bei SPH ist die Wahl des smoothing Kernel für die Lösung der Navier-Stokes-Gleichungen sehr

wichtig. Die hier vorgestellte Methode benutzt einen Kernel für alle Simulationen.

Im Vergleich zu gitterbasierten Techniken zeigt die Methode größere Flexibilität in der Repräsentation von Randbedingungen. Die Anwendung ist stabil, flexibel und kombiniert viele wünschenswerte

Eigenschaften von punkt- und gitterbasierten Techniken. Allerdings generiert SPH Bilder achtmal

schneller als der vorgestellte Ansatz.

3.4

Physikengine