Kapitel 1 Einige Begriffe aus der Asymptotik

Werbung

Kapitel 1

Einige Begriffe aus der

Asymptotik

1.1

Wiederholung

Ein wesentlicher Teil der Ökonometrie befasst sich mit der Ermittlung von Schätzern

und deren Eigenschaften. Diese werden benötigt, um aus den beobachtbaren Daten einer Stichprobe Informationen über interessierende Parameter einer unbekannten Grundgesamtheit zu gewinnen. Schätzer (bzw. Schätzfunktionen) werden meist

als Durchschnitte oder gewichtete Durchschnitte von Stichprobendaten berechnet.

Deshalb nimmt die Bestimmung der Verteilung von Mittelwerten oder gewichteten

Durchschnitten in der Ökonometrie einen zentralen Stellenwert ein.

Die grundlegende Vorstellung ist, dass die Stichprobe das Resultat einer Zufallsziehung ist (random sampling). Aus diesem Grund ist z.B. der Mittelwert einer

Stichprobe selbst wieder eine Zufallsvariable, die eine Verteilung hat. Die Verteilung der Mittelwerte (oder anderer Parameter) wird Stichprobenkennwertverteilung

(sampling distribution) genannt.

Gehen wir vom einfachsten Fall einer einfachen Zufallsstichprobe aus. Wenn aus einer

gegebenen Grundgesamtheit eine Stichprobe mit dem Umfang n gezogen wird erhält

man x1 , . . . , xn Realisationen. Vor der tatsächlichen Ziehung ist das Ergebnis aber

noch unbekannt, deshalb kann jedes xi vor der Ziehung als Zufallsvariable betrachtet

werden, denn vor der Ziehung können die einzelnen xi jeden in der Grundgesamtheit

enthaltenen Wert annehmen; erst mit der Ziehung wird ein konkreter Wert für jedes

xi realisiert. Die Annahme, dass sich die Grundgesamtheit während der Ziehungen

nicht verändert impliziert, dass die Xi identisch verteilt sind.

Bei einer reinen Zufallsziehung kann man aus der Beobachtung von z.B. x1 keine

Schlussfolgerung auf den erwarteten Wert von x2 ziehen, die einzelnen Ziehungen

sind untereinander unabhängig. Deshalb sind die einzelnen xi (vor der Ziehung!)

i.i.d.-verteilte Zufallsvariablen (independent and identically distributed ).

Beispiel: Die Verteilung des Stichprobenmittelwertes Der Stichprobenmittelwert x̄ einer Stichprobe des Umfangs n ist

n

1X

x̄ =

xi

n i=1

1

2

Empirische Wirtschaftsforschung

Da jedes xi eine Zufallsvariable ist, ist auch der Stichprobenmittelwert x̄ eine Zufallsvariable, und die Verteilung des Stichprobenmittelwerts ist ein Beispiel für eine

Stichprobenkennwertverteilung. Der Erwartungswert und die Varianz des gewichteten Mittelwerts von x können einfach berechnet werden. Wir bezeichnen den Mittelwert und die Varianz der Grundgesamtheit mit µx und σx2 , d.h.

x ∼ i.i.d.(µx , σx2 )

Der Erwartungswert des Stichprobenmittelwertes ist

!

n

n

1X

1

1X

E(x̄) = E

xi =

E(xi ) = nµx = µx

n i=1

n i=1

n

Der Stichprobenmittelwert ist also ein erwartungstreuer Schätzer für den Mittelwert

der Grundgesamtheit.

Ähnlich kann die Varianz von x̄ berechnet werden

!

n

1X

xi

var(x̄) = var

n i=1

n

n

n

1 X

1 XX

var(xi ) + 2

cov(xi , xj )

=

n2 i=1

n i=1 j=1

i6=j

=

σx2

n

wenn cov(xi , xj ) = 0 und var(xi ) := σx2

Achtung: var(x̄) := σx̄2 ist die Varianz der Stichprobenkennwertverteilung, während

var(xi ) := σx2 die Varianz jeder einzelnen Zufallsvariablen xi bezeichnet.

Dieses Ergebnis gilt immer, wenn die Grundgesamtheit i.i.d. ist. Wenn die xi zusätzlich normalverteilt sind, sind auch auch die Mittelwerte der Stichproben normalverteilt, da die gewichtete Summe normalverteilter Zufallsvariablen selbst wieder

normalverteilt sind. Wenn also x1 , . . . , xn Ziehungen aus einer N(µx , σx2 ) Verteilung

sind, dann ist der Stichprobenmittelwert x̄ ∼ N(µx , σx2 /n).

1.2

Asymptotische Näherungen von Stichprobenkennwertverteilungen

Was vorhin für den Stichprobenmittelwert gezeigt wurde gilt – wenn die entsprechenden Annahmen erfüllt sind – ebenso gut für den OLS Schätzer.

Wir haben schon früher gezeigt, dass unter den Gauss Markov Annahmen der OLS

Schätzer erwartungstreu und effizient ist.

Wenn die Gauss Markov Annahmen erfüllt sind gelten diese Eigenschaften der Erwartungstreue und Effizienz unabhängig von der Stichprobengröße, also auch in

kleinen Stichproben. In vielen Fällen sind auch die Stichprobenkennwertverteilungen von solchen Schätzern bekannt, zum Beispiel die Verteilung der Mittelwerte

aus aus wiederholten Zufallsstichprobenziehungen, die aus einer normalverteilten

Grundgesamtheit gezogen wurden.

Empirische Wirtschaftsforschung

3

Aber oft kennt man die Verteilung der Grundgesamtheit nicht, oder die Gauss

Markov Annahmen sind nicht erfüllt, und oft können diese sogenannten ‘KleineStichproben Eigenschaften’ aufgrund mathematischer Probleme nicht ermittelt werden. In solchen Fällen wird meist auf sogenannte ‘Große-Stichproben Eigenschaften’

(asymptotische Eigenschaften) zurückgegriffen.

Die Idee dabei ist eine Näherung für die Stichprobenkennwertverteilung zu finden,

die umso genauer wird, je größer die Stichprobe wird. Diese werden auch asymptotische Verteilungen genannt, da sie sich asymptotisch der exakten Stichprobenkennwertverteilung annähern, wenn n → ∞.

Im Wesentlichen werden zwei Methoden angewandt um die Näherungen für die

Stichprobenkennwertverteilungen von großen Stichproben zu ermitteln, Gesetze der

großen Zahl und zentrale Grenzwertsätze.

Stark vereinfacht ausgedrückt garantiert das Gesetz der großen Zahl, dass in großen

Stichproben der Stichprobenmittelwert x̄ mit hoher Wahrscheinlichkeit sehr nahe

beim wahren Mittelwert der Grundgesamtheit µx liegt, oder etwas allgemeiner, dass

die Stichprobenmomente der Wahrscheinlichkeit nach gegen die entsprechenden Momente der Grundgesamtheit konvergieren. Ebenso vereinfacht ausgedrückt verspricht

der zentrale Grenzwertsatz, dass sich die Verteilung des standardisierten Mittelwertes (x̄ − µx )/σx̄ mit zunehmender Stichprobengröße der Normalverteilung annähert.

Asymptotische Ergebnisse spielen in der Ökonometrie eine wichtige Rolle, da sie in

vielen Fällen auch für relativ kleine Stichproben noch annehmbare Approximationen

liefern, und auch weil sie häufig sehr viel einfacher zu berechnen sind als die exakten

Stichprobenkennwertverteilungen.

Am einfachsten können die grundlegenden asymptotischen Konzepte wieder anhand

der Verteilung des Mittelwertes einer Zufallsvariablen veranschaulicht werden. Sei

X eine Zufallsvariable mit unbekannter Dichtefunktion, von der aber bekannt ist,

dass Mittelwert µ und Varianz σ 2 fixe Zahlen sind, d.h. nicht unendlich groß sind.1

Aus dieser Verteilung werden n Zahlen gezogen und daraus der Stichprobenmittelwert x̄n berechnet, wobei das tiefgestellte n angibt, auf wievielen Beobachtungen

der Stichprobenmittelwert beruht. Dieses n bringt zum Ausdruck, dass wir eigentlich eine Folge von Schätzern untersuchen, denn wenn zusätzliche Beobachtungen

dazukommen, ändert sich in der Regel auch die Schätzfunktion. Für den einfachen

Stichprobenmittelwert ist eine solche Folge von Schätzfunktionen z.B.

x1 + x2 x1 + x2 + x3

x1 + x2 + · · · + xn

x̄n = x1 ,

,

,...,

2

3

n

Diese Mittelwerte sind natürlich selbst wieder Zufallsvariablen mit einer Dichtefunktion f (x̄n ). Die asymptotische Theorie untersucht z.B., wie sich eine Folge von

Zufallsvariablen {x̄n } und deren Verteilung verhält, wenn die Stichprobengröße n

gegen Unendlich geht, d.h. n → ∞.

1

Die aus einer endlichen Stichprobe berechnete Varianz kann nie unendlich groß werden, sehr

wohl sind aber datengenerierende Prozesse bekannt, für die die Varianz der Grundgesamtheit unendlich groß ist!

4

Empirische Wirtschaftsforschung

1.3

Gesetze der großen Zahl, Konvergenz der

Wahrscheinlichkeit nach, Konsistenz

Generell sind ‘Gesetze der großen Zahl’ meist Aussagen über das Verhalten von

Erwartungswerten (oder anderen Momenten) einer großen Zahl von Zufallsvariablen.

Für eine unendliche Folge von Zufallsvariablen x1 , x2 , . . ., die alle denselben Erwartungswert µ besitzen, wird folgende Konvergenzaussage als schwaches Gesetz der

großen Zahlen bezeichnet:

Das arithmetische Mittel von n Zufallsvariablen x̄n = (x1 + x2 + · · · + xn )/n konvergiert stochastisch gegen µ; das bedeutet, für jede positive Zahl ǫ (beliebig klein)

gilt

lim Pr (|x̄n − µ| < ǫ) = 1

n→∞

Ein schwaches Gesetz der großen Zahl gilt beispielsweise, wenn die Zufallsvariablen

x1 , x2 , x3 , . . . endliche Varianzen σ12 , σ22 , . . . haben (d.h. große Ausreißer unwahrscheinlich sind), die zudem durch eine gemeinsame obere Grenze beschränkt sind,

sowie unkorreliert sind (d.h., cov(xi , xj ) = 0, falls i 6= j).

Der Beweis für das Gesetz der großen Zahl folgt aus Chebychev’s (dt. manchmal

Tschebyschew) Ungleichung.

Auf diesen einfachen Fall angewandt besagt Chebychev’s Ungleichung

Pr (|x̄ − µ| ≥ ǫ) ≤

var(x̄)

ǫ2

wobei x̄ eine Zufallsvariable, µ ein Parameter und ǫ > 0 eine Konstante ist.

Da xi ∼ i.i.d.(µ, σ 2 ) ist die Varianz von x̄ = σ 2 /n, und deshalb für jedes ǫ > 0 die

rechte Seite von Chebychev’s Ungleichung var(x̄)/ǫ2 = σ 2 /(nǫ2 ), und da

σ2

→0

n→∞ (nǫ2 )

lim

folgt auch für die linke Seite von Chebychev’s Ungleichung

lim Pr (|x̄ − µ| > ǫ) → 0

n→∞

Insbesondere kann ǫ auch beliebig klein sein. Dies impliziert also, dass die Wahrscheinlichkeit, dass die Differenz zwischen Stichprobenmittelwert und Mittelwert

der Grundgesamtheit größer als eine beliebig kleine konstante Zahl ist, gegen Null

konvergiert.

Exkurs: Chebychev’s Ungleichung Chebychev’s Ungleichung verwendet die

Varianz einer Zufallsvariablen V um die Wahrscheinlichkeit einzugrenzen, dass V

weiter als ±ǫ vom Erwartungswert µ entfernt liegt, wobei ǫ eine beliebige positive

Konstante ist.

Chebychev’s Ungleichung besagt in diesem Fall

Pr (|V − µ| ≥ ǫ) ≤

var(V )

ǫ2

5

Empirische Wirtschaftsforschung

Um dies zu beweisen definieren wir eine Zufallsvariable W = V − µ; außerdem sei f

die Dichtefunktion von W und ǫ eine beliebige positive Konstante. Dann gilt

2

E(W ) =

Z

+∞

w 2 f (w) dw

−∞

−ǫ

=

Z

2

w f (w) dw +

−∞

−ǫ

Z

Z

+ǫ

2

w f (w) dw +

−ǫ

+∞

w 2 f (w) dw +

+∞

w 2 f (w) dw

+ǫ

Z

w 2 f (w) dw

−∞

+ǫ

Z −ǫ

Z +∞

2

≥ ǫ

f (w) dw +

f (w) dw

−∞

+ǫ

Z

2

= ǫ

f (w) dw = ǫ2 Pr(|W | ≥ ǫ)

≥

Z

(siehe Abb. 1.1)

|W |>ǫ

= ǫ2 Pr(|V − µ| ≥ ǫ)

Die erste Gleichung folgt aus der Definition des Erwartungswertes, die zweite Gleichung folgt weil die Bereiche, über die integriert wird, über die gesamten realen

Zahlen umfasst.

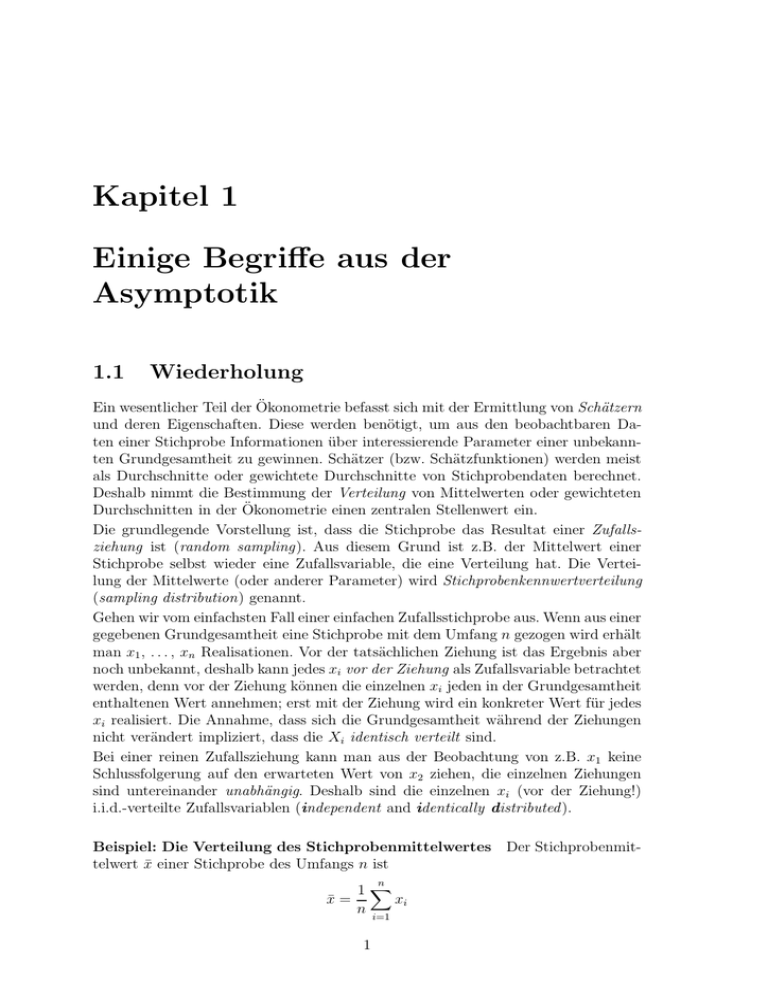

Die erste Ungleichung folgt weil der weggelassene Term immer positiv ist. Die zweite

Ungleichung folgt, weil über den Bereich der Integration w 2 ≥ ǫ2 . Dies folgt aus der

quadratischen Funktionsform, wie man aus Abbildung 1.1 einfach erkennen kann.

w2

ǫ2

bc

bc

bc

bc

−ǫ

+ǫ

w

Abbildung 1.1: Für w ≤ −ǫ und w ≥ +ǫ ist w 2 ≥ ǫ2 .

Die vorletzte Gleichung folgt aus der Definition von Pr(|W | ≥ ǫ). Unter Berücksichtigung von

E(W 2 ) = E[(V − µ)2 ] = var(V )

folgt daraus Chebychev’s Ungleichung

var(V )

≥ Pr (|V − µ| ≥ ǫ)

ǫ2

vgl. Stock & Watson (2007), S. 702f.

6

Empirische Wirtschaftsforschung

Die Eigenschaft, dass mit steigendem Stichprobenumfang die Wahrscheinlichkeit,

mit der z.B. der Stichprobenmittelwert x̄ beliebig nahe beim wahren Wert µx liegt,

gegen Eins konvergiert, wird Konvergenz der Wahrscheinlichkeit nach (stochastische Konvergenz) genannt.

Konsistenz kann man in einem gewissen Sinn als eine Erweiterung des Gesetzes der

Großen Zahl für beliebige Funktionen einer Stichprobe h(X1 , X2 , . . . , Xn ) auffassen

(Spanos, 1999, 616).

Die stochastische Konvergenz ist ein zentrales Konzept zur Klärung des Verhaltens

von Zufallsvariablen bei wachsendem Stichprobenumfang. Sie gibt an, in welchem

Bereich sich im Falle unendlich vieler Experimente die Zufallsvariable befindet.

Sei X eine i.i.d.(µ, σ 2) Zufallsvariable, dann wissen wir bereits

σ2

n

d.h., x̄n ist ein unverzerrter Schätzer für jede Stichprobengröße und die Varianz geht

mit steigendem Stichprobenumfang gegen Null.

Wir können die Wahrscheinlichkeit angeben, mit der x̄n in einem beliebig kleine

ǫ-Intervall liegt

Pr(µ − ǫ < x̄n < µ + ǫ) = Pr(|x̄n − µ| < ǫ)

E(x̄n ) = µ und

var(x̄n ) =

Definition: Eine Zufallsvariable x̄n konvergiert der Wahrscheinlichkeit nach gegen

eine Konstante µ, wenn

lim Pr (|x̄n − µ| < ǫ) = 1

n→∞

oder in Kurzschreibweise

plim x̄n = µ

oder noch kürzer

p

x̄ −→ µx

Dies ist die übliche Definition von Konsistenz, d.h. der Stichprobenmittelwert ist

p

ein konsistenter Schätzer für das wahre µ, da x̄ −→ µx .

Etwas ungenau lässt sich dies folgendermaßen ausdrücken: wenn der Stichprobenumfang sehr sehr groß wird, wird es sehr wahrscheinlich, dass der Schätzer sehr nahe

beim wahren Wert µ der Grundgesamtheit liegt.

Eine hinreichende, aber nicht notwendige, Bedingung für Konsistenz ist, dass

lim E(x̄n ) = µ

n→∞

und

lim var(x̄n ) = 0

n→∞

d.h. wenn der der Schätzer asymptotisch unverzerrt ist und die Varianz mit zunehmendem Stichprobenumfang gegen Null geht.

Beispiel 1: Sei y ∼ i.i.d.(µ, σ 2 ). Ist der Schätzer m = y1 konsistent?

Dieser Schätzer verwendet nur die erste Beobachtung. Er ist erwartungstreu, da

E(m) = E(y1 ) = µ

er ist aber nicht konsistent, da

Pr(|m − µ| ≥ ǫ) = Pr(|y1 − µ| ≥ ǫ)

nicht gegen Null konvergiert wenn n → ∞, da y1 unabhängig von n ist.

7

Empirische Wirtschaftsforschung

Beispiel 2: Asymptotische Unverzerrtheit und Konsistenz sind nicht exakt das

gleiche, wie man sich anhand des folgenden – etwas seltsamen – Schätzer überlegen

kann (vgl. Murray 2006, 498): angenommen, wir möchten µ mit einem Schätzer m

schätzen, der nur zwei Werte annehmen kann, nämlich mit Wahrscheinlichkeit n1 den

Wert µ + 2n, und mit Wahrscheinlichkeit (1 − n1 ) den Wert µ + n1 .

Der Erwartungswert von m ist also

1

1

1

1

1

E(m) = (µ + 2n) + µ +

1−

=µ+2+ − 2

n

n

n

n n

Offensichtlich ist dieser Schätzer selbst dann verzerrt, wenn n gegen Unendlich geht.

Trotzdem ist dieser Schätzer konsistent, da die Wahrscheinlichkeit für die Realisation

von µ + 2n, nämlich 1/n, immer kleiner wird, und die Wahrscheinlichkeit für die

Realisation von µ + n1 zunimmt. Dies ist natürlich ein etwas konstruierter Fall, der

die Idee aber sehr schön zeigt.

Konvergenz im quadratischen Mittel (convergence in mean square oder convergence in quadratic mean) ist eine hinreichende Bedingung für Konsistenz und

häufig einfacher zu zeigen.

Wenn eine Zufallsvariable xn den Erwartungswert µ und die Varianz σ 2 hat, und

der Erwartungswert µ im Grenzwert gegen eine Konstante c geht, und die Varianz

im Grenzwert gegen Null geht, dann konvergiert xn im quadratischen Mittel gegen

c, d.h. plim(xn ) = c.

Hinreichend für die Konsistenz einer (beliebigen) Schätzfunktion θ ist also E(θ̂n ) = θ

und var(θ̂n ) → 0. Der Beweis folgt wieder aus der Chebychev’s Ungleichung.

1.3.1

Regeln für das Rechnen mit ‘probability-limits’

Der Grund, warum die Eigenschaft der Konsistenz soviel leichter zu beweisen ist als

die Unverzerrtheit, liegt v.a. darin, dass die plim’s von Funktionen von Zufallsvariablen viel leichter zu berechnen sind als die Erwartungswerte, so gilt z.B.

1. Wenn c eine Konstante ist gilt

plim c = c

2. Wenn θˆ1 und θˆ2 konsistente Schätzfunktionen sind gilt

plim (θˆ1 + θˆ2 ) = plim θˆ1 + plim θˆ2

plim (θˆ1 θˆ2 ) = plim θˆ1 plim θˆ2

θˆ1

plim θˆ1

plim

=

θˆ2

plim θˆ2

Man beachte, dass die letzten beiden Eigenschaften für den Erwartungswertoperator nur dann gelten, wenn θˆ1 und θˆ2 stochastisch unabhängig sind.

8

Empirische Wirtschaftsforschung

3. Slutsky-Theorem: Wenn θ̂ eine konsistente Schätzfunktion für θ ist und h(θ̂)

eine stetige Funktion von θ̂ ist gilt:

plim h(θ̂) = h(θ)

Man sagt auch, dass sich die Konsistenz ‘überträgt’. Wenn θ̂ eine konsistente

Schätzfunktion für θ ist, dann ist z.B. 1/θ̂ auch eine konsistente Schätzfunktion

für 1/θ, oder ln θ̂ ist eine konsistente Schätzfunktion für für ln θ (dies gilt nicht

für den Erwartungswertoperator!).

Das Slutsky-Theorem gilt auch für Funktionen von Vektoren und Matrizen

von Zufallsvariablen. So kann z.B. die Konsistenz des OLS-Schätzers gezeigt

werden (siehe Greene 2003, S. 66f).

Zusammenfassend halten wir fest, dass der Stichprobenmittelwert unter relativ wenig strengen Bedingungen ein konsistenter Schätzer für den Mittelwert der GrundgeP

samtheit ist, d.h. wenn n gegen Unendlich geht kollabiert die Verteilung von 1/n xi

um E(xi ) = µ.

Dies gilt auch genereller: wenn die Daten aus einer i.i.d. Zufallsstichprobe stammen sind unter wenig strengen Bedingungen die Stichprobenmomente konsistente

Schätzer für die wahren Momente der Grundgesamtheit.

Wenn xi ∼ i.i.d. und das r-te Moment nicht unendlich groß ist, µr ≡ E[(xi − µ)r ] <

∞, dann gilt

!

n

1X

r

(xi − x̄n ) = µr

plim

n i=1

z.B. konvergiert die Stichprobenvarianz stochastisch (der Wahrscheinlichkeit nach)

gegen die wahre Varianz der Grundgesamtheit, die Stichprobenkovarianzen gegen

die Kovarianzen der Grundgesamtheit, usw.

Wir halten also nochmals allgemeiner fest, dass aufgrund des schwachen Gesetzes

der großen Zahl Stichprobenmomente gegen Populationsmomente konvergieren.

Es gibt zahlreiche Gesetze der großen Zahl, die sich vor allem hinsichtlich der erforderlichen Annahmen unterscheiden.

Neben den (einfacheren) ‘schwachen Gesetzen der großen Zahl’, die auf stochastischer Konvergenz beruhen, gibt es auch ‘starke Gesetze der großen Zahlen’, die auf

einem allgemeinerem Konvergenzkonzept beruhen, nämlich der ‘fast sicheren Konvergenz’.

Als starkes Gesetz der großen Zahlen wird folgende Konvergenzaussage für eine unendliche Folge von Zufallsvariablen x1 , x2 , x3 , . . . mit Erwartungswert µ bezeichnet:

Pr lim x̄n = µ = 1

n→∞

d. h., die repräsentative Stichprobe konvergiert fast sicher gegen µ. Das starke Gesetz der großen Zahlen impliziert das schwache Gesetz der großen Zahlen.

Für die Gültigkeit des starken Gesetzes der großen Zahlen ist in der Regel die Annahme erforderlich, dass alle Zufallsvariablen dieselbe Verteilung haben und untereinander unabhängig sind.

Siehe z.B. http://de.wikipedia.org/wiki/Kategorie:Stochastik

9

Empirische Wirtschaftsforschung

1.3.2

Beispiel: Konsistenz des OLS-Schätzers bei stochastischen Regressoren (x)

In diesem Unterabschnitt interessieren uns die Eigenschaften des OLS-Schätzers,

wenn die erklärende Variable x ebenso stochastisch ist. Wir beginnen mit dem bivariaten Fall

P

ẍi ÿi

βb2 = P 2

ẍi

wobei ẍi = xi − x̄ und ÿi = yi − ȳ. Um die Erwartungstreue zu überprüfen setzen wir

wieder den wahren Zusammenhang ÿi = β2 ẍi +εi ein und bilden den Erwartungswert

P

ẍi εi

b

E[β2 ] = β2 + E P 2

ẍi

Wenn nun die ẍi stochastisch sind hängt die Erwartungstreue von der gemeinsamen Wahrscheinlichkeitsverteilung von ẍi und εi ab (man beachte, dass E(x/y) 6=

E(x)/ E(y)!).

Um die Konsistenz zu zeigen bilden wir das probability-limit und wenden die entsprechenden Rechenregeln an

P

ẍi εi

b

plim β2 = plim β2 + plim P 2

ẍ

P

i

plim ẍi εi

P

= β2 +

plim ẍ2i

P

plim n1

ẍi εi

P 2

= β2 +

plim n1

ẍi

Wir haben Zähler und Nenner des zweiten Ausdrucks durch n dividiert und erhalten

damit konsistente Schätzer für die Varianz und Kovarianz der Grundgesamtheit.2

Der Schätzer βb2 ist also konsistent, wann immer die Störterme der Grundgesamtheit

εi und die erklärenden Variablen ẍi unkorreliert sind, d.h. wenn

X

1

plim

ẍi εi = 0

n

P 2

und wenn plim n1

ẍi > 0.

In diesem Fall gilt

plim βb2 = β2 +

0

= β2

σẍ

Im Unterschied zum Beweis für die Erwartungstreue müssen für Konsistenz nicht

alle x1 , x2 , . . . xn mit allen ε1 , ε2 , . . . εn unkorreliert sein, sondern es genügt für Konsistenz, wenn die xi einer Beobachtung oder Zeitperiode mit den entsprechenden εi

der gleichen Beobachtung oder Periode unkorreliert sind!

2

Ob wir durch n oder n − 1 dividieren spielt keine Rolle wenn n → ∞.

10

Empirische Wirtschaftsforschung

Wichtig ist aber nach wie vor die Annahme, dass die Störterme der Grundgesamtheit

εi mit dem Regressor xi unkorreliert sind. Ist diese Annahme nicht erfüllt ist der

OLS-Schätzer auch nicht konsistent!

Im wesentlichen verlangen wir von den Regressoren x also, dass sie nur über den

spezifizierten Zusammenhang yi = β1 + β2 xi + εi mit den y verknüpft sind, und

dass es keine anderen nicht spezifizierten Zusammenhänge zwischen x und y gibt –

wie z.B. bei simultanen Gleichungssystemen – da diese anderen nicht spezifizierten

Zusammenhänge eine Korrelation zwischen den ε und x bewirken würden, die zu

systematisch verzerrten Schätzern führt.

Konsistenz des OLS-Schätzers in Matrixschreibweise

Wir definieren x als einen k × 1 Spaltenvektor derart, dass x′i die i-te Zeile der X

Matrix ist

x1i

x2i

xi = ..

.

x′1

x′

2

X = ..

.

und

x′n

xki

Damit kann y = Xβ + ε beobachtungsweise geschrieben werden als

yi = x′i β + εi

und der OLS Schätzer

′

−1

′

β̂ = (X X) X y =

n

X

i=1

xi x′i

!−1

n

X

xi y i

i=1

Ein häufig angewandter Trick in der Asymptotik besteht darin, den Schätzfehler als

Funktion von Mittelwerten zu schreiben (siehe Greene, 2007, p. 64f)

β̂ − β = (X ′ X)−1 X ′ ε

−1

1 ′

1 ′

=

XX

Xε

n

n

−1

x1

ε

. 1

.1

1

x1 , . . . , xn ..

= x1 , . . . , xn ..

n

n

xn

εn

!

−1

n

n

1X

1X

′

=

xi xi

xi εi

n i=1

n i=1

Wenn β̂n = (Xn′ Xn )−1 Xn′ yn = β0 + (Xn′ Xn )−1 Xn′ εn der OLS-Schätzer für βn für

eine Stichprobe der Größe n ist, dann ist jedes Element der Folge {β̂n }∞

n=k wieder

eine Zufallsvariable.

Mit stochastischen x benötigen eine Annahme über die Daten

plimn→∞

Xn′ Xn

=Q

n

sei eine positiv definite Matrix.

11

Empirische Wirtschaftsforschung

Der OLS-Schätzer kann geschrieben werden

′ −1 ′ Xε

XX

β̂ = β +

n

n

wenn Q−1 existiert ist

−1

plim β̂ = β + Q

und wenn

plim

X ′ε

n

plim

X ′ε

n

=0

was unter weniger strengen Bedingungen als E(X ′ ε) = 0 gilt, dann ist

plim β̂ = β + Q−1 · 0 = β

1.4

Konvergenz hinsichtlich der Verteilung (Convergence in Distribution)

Für die statistische Absicherung der Schätzungen benötigt man die Verteilung des

Schätzers, d.h. die Stichprobenkennwertverteilung, um z.B. die Konfidenzintervalle

berechnen zu können. Deshalb ist die nächste Frage, wie sich die Verteilung von x̄n

mit steigendem n verhält. Wenn die Verteilung einzelner xi unbekannt ist ist, so ist

z.B. auch die Verteilung des Mittelwerts x̄n – eine Linearkombination der einzelnen

xi – unbekannt.

Aber wenn die Stichprobengröße n gegen Unendlich geht kann man eine asymptotische Stichprobenkennwertverteilung bestimmen.

Auf den ersten Blick scheint es ein Problem zu geben: wenn ein Schätzer konsistent ist, wird mit steigendem Stichprobenumfang die Varianz der Schätzfunktion

im Grenzwert gegen Null gehen, d.h. die die Verteilung kollabiert bei µ; man sagt

auch, die Verteilung ‘degeneriert’.

Wie sollte also eine asymptotische Verteilung aussehen, wenn diese für alle konsistenten Schätzfunktionen degeneriert?

Der Trick besteht darin eine Funktion von x̄n zu suchen, deren Verteilung weder

degeneriert noch explodiert, die sogenannte Grenzverteilung (limiting distribution).

Beispiel: Wir vergleichen zwei Schätzfunktionen βb1 und βb2 mit

E(βb1 ) = β

E(βb2 ) = β

und

σ2

σ2

var(βb1 ) =

var(βb2 ) =

n

n2

Wenn n → ∞ kollabieren beide Verteilungen um β, aber βb2 kollabiert offensichtlich ‘schneller’. Wenn n sehr groß wird, wird es zunehmend schwieriger zwischen

12

Empirische Wirtschaftsforschung

den beiden zu unterscheiden, da beide Varianzen sehr klein werden, man bräuchte

gewissermaßen ein ‘Vergrößerungsglas’.

Man könnte die Schätzfunktionen z.B. mit n multiplizieren, um die Verteilung zu

‘stabilisieren’. Aber wenn n → ∞ explodieren die ersten Momente nβb1 und nβb2 , da

E(nβb1 ) = n E(βb1 ) = nβ

und

E(nβb2 ) = n E(βb2 ) = nβ

Die Lösung dieses Problems besteht darin, dass man die Fehler untersucht, die

weiterhin um Null schwanken

E[n(βb1 − β)] = E[n(βb2 − β)] = nβ − nβ = 0

Was passiert mit der Varianz von βb1 ?

var[n(βb1 − β)] = n2 var(βb1 − β) = n2 var(βb1 ) = n2

σ2

n

= nσ 2

Wenn n → ∞ geht die Varianz von n(βb1 − β) gegen Unendlich, sie explodiert.

Anders für βb2

var[n(βb2 − β)] = n var(βb2 − β) = n var(βb2 ) = n

2

2

2

σ2

n2

= σ2

Wenn n → ∞ konvergiert die Varianz von n(βb2 − β) gegen σ 2 !

Deshalb hat n(βb2 − β) eine stabile asymptotische Verteilung mit Mittelwert Null

und Varianz σ 2 .

Offensichtlich kann man auch die Verteilung von βb1 stabilisieren, wenn man βb1 mit

√

n multipliziert, denn

2

√

σ

= σ2

var[ n(βb1 − β)] = n var(βb1 − β) = n var(βb1 ) = n

n

√

Wenn n → ∞ konvergiert die Varianz von n(βb1 − β) gegen σ 2 , d.h. die asympto√

tische Verteilung von n(βb1 − β) hat einen Mittelwert Null und Varianz σ 2 .

Durch Multiplikation der Fehler b−β mit einer Potenz von n kann die Verteilung also

‘stabilisiert’ werden. Diese ‘stabilisierte’ Verteilung wird Grenzverteilung (‘limiting distribution’ ) genannt. Die Potenz von n, die zu einer stabilen asymptotischen

Verteilung führt, wird ‘Konvergenzrate’

genannt. Die Konvergenzgeschwindigkeit

√

b

von β1 − β ist also Wurzel n ( n), die Konvergenzgeschwindigkeit von βb2 − β ist n.

Offensichtlich konvergiert βb2 schneller als βb1 .

Wenn Schätzer mit der gleichen Konvergenzgeschwindigkeit verglichen werden, dann

heißt der Schätzer mit der kleinsten asymptotischen Varianz asymptotisch effizient

innerhalb der Klasse mit dieser Konvergenzgeschwindigkeit.

13

Empirische Wirtschaftsforschung

Übungsbeispiel:

P

Gegeben seien zwei Schätzfunktionen βb1 und βb2 mit

σ2

b

β1 ∼ N β, 3 P 2

n

xi

!

2

σ

P

βb2 ∼ N β, 3

n 1 − n1 ( x2i )2

x2i → Q mit 1 < Q < ∞ (Q sei eine endliche reelle Zahl größer Eins).

Wie groß ist die Konvergenzgeschwindigkeit von (βb1 − β) und βb2 − β? Welcher

Schätzer ist asymptotisch effizienter?

wobei

Konvergenz hinsichtlich der Verteilung Sei F1 , F2 , . . . , Fn , . . . eine Folge von Verteilungsfunktionen einer entsprechenden Folge von Zufallsvariablen

b1 , b2 , . . . , bn , . . . (z.B. standardisierte Mittelwerte (ȳ − µȳ )/σȳ ), dann konvergiert

d

die Folge der Zufallsvariablen bn der Verteilung nach gegen β, geschrieben bn −→ β,

wenn die Folge der Verteilungsfunktionen Fn gegen F konvergiert, der Verteilung

von β, d.h.

d

bn −→ β wenn und nur wenn lim Fn (t) = F (t)

n→∞

wobei der Grenzwert in allen Punkten t gilt, in denen die Grenzverteilung F stetig

ist. F wird auch die asymptotische Verteilung von bn genannt.

Man beachte die Unterschiede zwischen der Konvergenz der Wahrscheinlichkeit nach

und Konvergenz hinsichtlich der Verteilung. Konvergenz der Wahrscheinlichkeit nach

p

– bn −→ β – bedeutet, dass die Wahrscheinlichkeit dafür, dass bn nahe bei β liegt,

mit zunehmendem n steigt.

d

Konvergenz hinsichtlich der Verteilung – bn −→ β – bedeutet, dass die Verteilung

von bn mit zunehmenden n immer ähnlicher der Verteilung von β wird.

Zentraler Grenzwertsatz

Bei den Zentralen Grenzwertsätzen handelt es sich um eine Familie schwacher Konvergenzaussagen aus der Wahrscheinlichkeitstheorie. Allen gemeinsam ist die Aussage, dass die (normierte) Summe einer großen Zahl von unabhängigen, identisch

verteilten Zufallsvariablen annähernd (standard)normalverteilt ist. Dies erklärt auch

die Sonderstellung der Normalverteilung.

Die wichtigste und bekannteste Aussage wird auch einfach als “Der Zentrale Grenzwertsatz” bezeichnet und befasst sich mit unabhängigen, identisch verteilten Zufallsvariablen, deren Erwartungswert und Varianz endlich sind.

√

Z y

n(x̄n − µ)

1

2

√ e−z /2 dz

lim Pr

≤y =

n→∞

σ

2π

−∞

oder einfacher

√

d

n (x̄ − µx ) −→ N(0, σx2 )

14

Empirische Wirtschaftsforschung

d.h. √

wenn xi ∼ i.i.d.(µ, σ 2 ) und 0 < σ 2 < ∞, dann konvergiert die Verteilung

von n(x̄ − µ) gegen die Normalverteilung mit Mittelwert Null und Varianz σ 2 ,

unabhängig von der Verteilung der xi .

Dies gilt auch für den multivariaten Fall. Seien y1 , . . . yk i.i.d. n × 1 Spaltenvektoren mit den Erwartungswertvektoren E(yk ) = µk und der Kovarianzmatrix

E(yi − µ)(yi − µ)′ = Σ, wobei Σ positiv definit und nicht unendlich groß sei, dann

gilt

√

d

n(ȳ − µ) −→ N(0, Σ)

P

wobei ȳ = n1 ni=1 yi .

Es existieren verschiedene Verallgemeinerungen, für die eine identische Verteilung keine notwendige Voraussetzung ist. Stattdessen wird dann eine andere

Voraussetzung gefordert, die sicher stellt, dass keine der Variablen einen zu

großen Einfluss auf das Ergebnis erhält.3 Darüber hinausgehende Verallgemeinerungen gestatten sogar “schwache” Abhängigkeit der Zufallsvariablen. Siehe:

http://de.wikipedia.org/wiki/Kategorie:Stochastik

Mit Hilfe der zentralen Grenzwertsätze kann auch die asymptotische Normalverteilung des OLS-Schätzers gezeigt werden.

Der OLS-Schätzer ist

β̂ = β +

oder

√

n(β̂ − β) =

X ′X

n

−1 X ′X

n

X ′ε

n

−1 1

√

n

X ′ε

unter einer Reihe von Annahmen (z.B. Unabhängigkeit der Beobachtungen) gilt

1

d

√

X ′ ε → N(0, σ 2 Q)

n

wobei Q = plimn→∞ Xn′ Xn /n eine positiv definite Matrix sei.

und in weiterer Konsequenz

√

d

n(β̂ − β) → N(0, σ 2 Q−1 )

woraus schließlich die asymptotische Verteilung von β̂ für unabhängige Beobachtungen folgt:

Wenn die {εi } unabhängig verteilt sind mit Mittelwert Null und endlicher Varianz

σ 2 , sowie die xik die Grenander Bedingungen (siehe Greene 2003, S. 68) erfüllen,

dann gilt

σ 2 −1

a

β̂ ∼ N β,

Q

n

wobei (1/n)Q−1 mit (X ′ X)−1 und σ 2 mit ε̂′ ε̂/(n − k) geschätzt wird.

3

Siehe Grenander Bedingungen, z.B. Greene 2003, S. 68.

Empirische Wirtschaftsforschung

15

Literaturverzeichnis

Angrist, J. D. and Pischke, J.-S. (2008), Mostly Harmless Econometrics: An Empiricist’s Companion, Princeton University Press.

Greene, W. H. (2007), Econometric Analysis, 6th edn, Prentice Hall. 10

Long, J. S. and Ervin, L. H. (2000), ‘Using heteroscedasticity consistent standard

errors in the linear regression model’, The American Statistician 54(3), 217–224.

URL: http://www.jstor.org/stable/2685594

Spanos, A. (1999), Probability Theory and Statistical Inference: Econometric Modeling with Observational Data, Cambridge University Press. 6

![S. FX(x) fX(x) E[X] Var[X] diskret 26 Pr[X ≤ x] Pr[X = x] ∑ xfX(x) E[(X](http://s1.studylibde.com/store/data/009308841_1-a646025deab6d8ab299a07364077e1f4-300x300.png)