Geschichte der Rechnerarchitektur

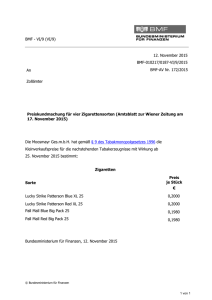

Werbung