BildtechnologieII

Werbung

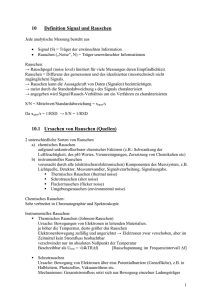

Bildtechnologie II Bildtechnologie II Inhaltsverzeichnis Digitale Fotographie ..................................................................................................................... 3 Warum digitale Kameras ..................................................................................................................... 3 Typen digitaler Kameras ...................................................................................................................... 3 Wie funktionieren digitale Kameras .................................................................................................... 3 Spiegelreflex: ................................................................................................................................... 3 Von der Linse zum Bildsensor.......................................................................................................... 4 Optik .................................................................................................................................................... 4 Definition von Linsen: Brennweite, Gegenstandsweite, Bildweite ................................................. 4 Schärfentiefe ................................................................................................................................... 5 Hyperfokale Distanz ........................................................................................................................ 5 Blende & Verschluss ........................................................................................................................ 6 Brennweiten .................................................................................................................................... 6 Perspektiven .................................................................................................................................... 6 Unterschied Fotografie – Betrachtung von Auge ............................................................................ 6 CCD .............................................................................................................................................. 7 Wie arbeitet der Sensor ...................................................................................................................... 7 Der Photoeffekt ................................................................................................................................... 7 Spektrale Empfindlichkeit................................................................................................................ 8 Wie wird Licht dektektiert? ............................................................................................................. 8 Farbsensoren ................................................................................................................................... 9 Farbwiedergabe................................................................................................................................... 9 Weisspunkt ...................................................................................................................................... 9 Interpolation.................................................................................................................................... 9 Qualitätskriterien von Bildsensoren .................................................................................................. 10 Auflösung....................................................................................................................................... 10 Dynamik ......................................................................................................................................... 10 Rauschen ....................................................................................................................................... 10 Empfindlichkeit .............................................................................................................................. 11 Pixelgrösse & Optik ........................................................................................................................... 11 Huygen-Fresnel.............................................................................................................................. 11 Wirkung einer Blende .................................................................................................................... 11 1 Bildtechnologie II Farbe I........................................................................................................................................ 12 Farbeigenschaften ............................................................................................................................. 12 Modifizierung des Lichts durch Material ....................................................................................... 12 Spektrale Charakteristiken ............................................................................................................ 13 Goniophotometrie......................................................................................................................... 13 Auge................................................................................................................................................... 14 Visuelles System ............................................................................................................................ 14 3-Farben Theorie ............................................................................................................................... 15 Gegentheorie: Zonen-Theorie ....................................................................................................... 15 Sehfehler ....................................................................................................................................... 15 Farbe II....................................................................................................................................... 16 Empfindungsgemässe Farbeinteilung ............................................................................................... 16 Quantitative Beschreibung der Farbe ............................................................................................... 16 auf physikalischen Farbmustern basierende Farbsysteme ........................................................... 16 auf Wahrnehmung basierende Farbsysteme ................................................................................ 16 CIE-System (Additive Mischung)........................................................................................................ 17 Grassmann’s Gesetzt der additiven Farbmischen (1853).............................................................. 17 Chromazitätsdiagramm ................................................................................................................. 17 Normierung CIE ............................................................................................................................. 18 CIE 1931 („Standart kolorimetrisches System“) ............................................................................ 18 Farbe III...................................................................................................................................... 19 Berechnung von Farbkoordinaten..................................................................................................... 19 Photographie additiver Prozess ........................................................................................................ 19 Farbsysteme: UCS, Uniform Chromaticity Scale, CIE-LAB ................................................................. 20 Empfindungsgemässe Farbsysteme .............................................................................................. 21 Gleichmässige Helligkeitsabstufung .............................................................................................. 21 CIE-LAB .......................................................................................................................................... 21 Farbe IV ..................................................................................................................................... 22 Messen von Farben ........................................................................................................................... 22 Lichtabsorptionsmessung .............................................................................................................. 22 RGB-Berechnungen ........................................................................................................................... 22 Rechenbeispiel: Was ist die Farbe von RGB = 40,140,80 .............................................................. 23 Druck ................................................................................................................................................. 23 Rasterverfahren additiv & subtraktiv ............................................................................................ 23 Neugebauer Modell....................................................................................................................... 23 Farbkonzentration ......................................................................................................................... 23 Appendix: Meilensteile der Fotographie ..................................................................................... 24 2 Bildtechnologie II Digitale Fotographie Warum digitale Kameras Erschwinglichkeit und Bildqualität Speicher und Duplizieren Schnelligkeit und Bequemlichkeit Modifizieren von Farbe und Schärfe Verbreitung digitaler Bilder Movie? Probleme bei analogen Kameras (und Lösungen): Falsche Belichtung Belichtungsmesser Ausschnitts-Kontrolle Spiegelreflex, 2-äugige Reflex Schäfre Entfernungsmesser, Spiegelreflex Verwackeln kurze Verschlusszeiten (hochempfindliche Filme), Bildstabiulisatoren Voll-Automatik Typen digitaler Kameras ultracompact compact „Brigde“ Professional Wie funktionieren digitale Kameras Spiegelreflex: 1) 2) 3) 4) 5) 6) 7) 8) 3 Objektiv Spiegel Verschluss Film/Sensor Mattscheibe Kondensator / Fresnellinse Pentaprisma Okular Bildtechnologie II Von der Linse zum Bildsensor Digital Die Linsen fokussieren das Abbild auf einem lichtempfindlichen Computer-Chip (Bildsensor) Durch eine „microcontroller unit“ wird die ganze Kamera gesteuert (resp. MUSS gesteuert werden) Das „flüchtige“ Bild auf dem Bildsensor muss permanent auf einem extenrnen Gerät gespeichert werden. Der Sensor kann wieder benutzt werden Silberhalogenid Die Linsen fokussieren das Abbild auf einem Lichtempfindlichen Film Bei modernen Kameras wird die ganze Kamera durch Elektronik gesteuert (das ist jedoch keine Notwendigkeit) Das Bild wird permanent und irreversibel auf dem Sensor gespeichert (Sensor und Speicher identisch). Für weitere Aufnahmen muss ein neuer Sensor benutzt werden (= Film transportieren) Die (technische) Bildaqualität wird durch Optik und Film bestimmt Die (technische) Bildqualität wird durch Optik und Sensor bestimmt Optik Camera obscura Licht wird durch dünnes Loch gebündelt je dünner das Loch, desto schärfer das Bild je dicker das Loch, desto heller das Bild Sammellinsen Definition von Linsen: Brennweite, Gegenstandsweite, Bildweite Linsengleichung I: 1 𝑓 = 1 𝑔 + 1 𝑏 Linse kann als aus Prismen zusammengesetzt betrachtet werden 4 Bildtechnologie II Linsengleichung II: 1 𝑓 1 𝑟1 1 𝑟2 = (𝑛 − 1)( − ) („Linsenmachergleichung“) innerhalb gewisser Grenzen sind 𝑟1 und 𝑟2 frei wählbar, wenn f konstant ist Biconvex: Sammellinse, positive Brennweite Biconkav: Zerstreuungslinse, negative Brennweite Schärfentiefe immer nur eine Ebene scharf Blende offen Blende zu Hyperfokale Distanz Unschärfetoleranz u Bei Einstellung auf unendlich (b = f), Blende k und Unschärfetoleranz u liegt der nächste, scharf abgebildete Gegenstand im Abstand h, d.h. in der hyperfokalen Distanz 5 Bildtechnologie II eingestellt h h/2 h/3 h/4 Schärfebereich ∞ - h/2 h – h/3 h/2 – h/4 h/3 – h/5 Blende & Verschluss Blende: Blendenzahl k (2, 2.8, 4, 5.6, 8, 11, 16, 22) Faktor 2, √2-Abstufung Lichtintensität Schärfentiefe Verschluss Verschlusszeit bestimmt, wie lange belichtet wird bei Film-Fotografie (mechanischer) Verschluss essentiell digitale Fotografie: elektronischer Verschluss, nur professionelle Kameras haben zusätzlich einen echten mechanischen Verschluss. Blende dient als Lichtschutz kein Verschluss kein Auslösegeräusch. Daher akustisches / optisches Signal bei Digicams Bei digitalen Kameras kann Blende & Belichtungszeit nur bei professionellen Kameras manuell eingestellt werden! Schärfentiefe bei Format-Wechsel: albierung des Formates f / u halb so gross 𝑓2 hyperfokale Distanz ℎ = 𝑢𝑘 ℎ(𝑛𝑒𝑢) = (0.5𝑓)2 (0.5)𝑢𝑘 = 0.5 𝑓2 𝑢𝑘 = 0.5 ℎ(𝑎𝑙𝑡) Blende 2 Stufen öffnen! Brennweiten Weitwinkel grosser Ausschnitt Normalbrennweiten Tele kleiner Ausschnitt Supertele Normalbrennweite: normale Sehschärfe, normaler Betrachtungswinkel Bilckwinkel entspricht in etwa dem Menschen 35mm Film 50 mm (analog) 14mm Chip 16 mm (KAF-1600 Sensor) Regel: je grösser der Sensor, desto besser und desto teurer Perspektiven Augenperspektive Froschperspektive Vogelperspektive Unterschied Fotografie – Betrachtung von Auge Das Auge ist Mischung aus Tele und WW Abrastern und stereoskopisches Sehen im Nahbereich. In der Photograpghie muss man Objektive wechseln um ähnliche Reultate zu erzielen. Auge: selektioniert Details ohne das Ganze zu verlieren Photo: Tele isoliert Details, verliert Umgebung Weitwinkel erfasst alles, Details gehen verloren Im Nahbereich Normaloptik (50mm) ungünstig. Man müsste bei einem Portrait 50cm Abstand haben für ein formatfüllendes Bild 6 Bildtechnologie II CCD CCD = charge coupled device Wie arbeitet der Sensor Filmemulsion chemisch Lichtempfindliche Silberhalogenid-Kristalle sind in Gelatine eingebettet. Bei der Belichtung bilden sich mikroskopische Silbercluster (Bildkeime, latentes Bild). Der Entwicklungs-prozess verstärkt diese Bildkeime („Reduktion“ der belichteten Silberhalogenidkristalle zu Silber) und es entsteht ein sichtbares Bild. Jeder Schritt irreversibel Film dient als Bildspeicher schnell Bildsensor elektronisch Der Sensor besteht aus einer Siliziumschicht, bedeckt mit einem Gitter quadratischer Elektroden. Durch Anlegen einer Spannung an die Elektroden werden bei belichteten Detektoren die durch das Licht freigesetzten Elekronen („angeregte Photoelektronen“) angesammelt, es bildet sich eine Ladung. Diese wird gemessen & in diskrete Zahlen umgewandelt Jeder Schritt reversibel Sensor ist kein Bildspeicher, braucht externes Medium langsam, Gesamtprozess 5-10sq Auslöseverzögerung, 1-2s Digitalisierung 1. Rasterung: Auswahl der MEssfenster 2. Messung der physikalischen Grösse 3. Quanitsierung: Umwandlung der analogen Messung in einen Zeichencode Der Photoeffekt Trifft ein Photon auf einen Halbleiter, so wird ein gebundenes Elektron in einen energetisch höheren Zustand angeregt und wird im Kristallgitter frei beweglich. Gebundener Zustand Valenzband Angeregter Zustand Leitungsband Energie eines Photons ist abhängig von der Wellenlänge des Lichtes: Rot: lange Wellenlänge = Tiefere Energie Blau: kurze Wellenlänge = Höhere Energie Dotierungen: n-dotiert (Phosphor) o bewegliche Ladung: Elektronen (Majoritätsladungsträger) o Gegenladung: positive Phosphor-Ionen (Minoritätsladungsträger) u.a. unter Lichteinfall werden die überschüssigen Elektronen ins Leitungsband gebracht und liefern so Strom p-dotiert (Bor) o bewegliche Ladung: „Löcher“ o Gegenladung: negative Bor-Ionen u.a. unter Lichteinfall verhält sich „Loch“ wie ein freibeweglicher positiver Ladungsträger (im Valenzband) und liefert so Strom. Dabei springt ein Elektron aus einer Atombindung heraus, füllt ein Loch und hinterlässt ein neues Loch 7 Bildtechnologie II Spektrale Empfindlichkeit Charakterisiert das Verhalten in den unterschiedlichen Farbbereichen von Film oder Sensor Voraussetzung für Farbfotografier: Film/Sensor muss im Rot- Grün- und Blaubereich empfindlich sein Die Wellenlänge des Lichts bewirkt immer denselben Effekt auf den Sensor freie Elektronen erzeugen Der Wirkungsgrad von diesem Prozess ist abhängig von der Wellenlänge Wie wird Licht dektektiert? Aufbau MOS (Metal Oxid Semiconductor): Gate, Dielektrikum aus SiO2, halbleitendes Substrat aus p-dotiertem Silizium Majoritätsladungsträger = Löcher Gate Positiv Tiefe Verarmung in Nähe des Gates (unstabil!), da freie Ladungsträger (Löcher) vom Gate weggestossen werden. Sobald es freie Elektronen hat ( Lichteinstrahlung!), sammeln diese sich beim Gate und können weitertransportiert werden. Danach sequentielles Auslesen jeder Zelle. Wichtig: 1 Lichtquant = 1 Elektron-Lochpaar Ladung streng proportional zur Lichtmenge Gibt 2-4-Phasensysteme (2-4 Kondensatoren pro Pixel). Bei 2-Phasen System braucht es verschieden dicke Dielektrikum: CCD-Shift Register muss von Licht abgeschirmt werden! Verschiedene Methoden: Frame-Transfer Interline-Transfer Kombination Frame – Interline 8 Bildtechnologie II Device Frame Transfer Interline Pro Hohe horiz. Auflösung Chip gross (teuer) Grosse Pixel (Empf) Kleiner Chip Frame-Interline Geringer Smear Contra Chip gross (teuer) Grosse Pixel (Empf) Smear Geringe Apertur (Empf) Smear, Technologie) Grosse Chips Geringe Apertur (Empf) Technologie Problem Timing Das Auslesen von vielen tausenden Pixel braucht viel Zeit Während dem Auslesen kann kein neues Bild aufgenommen werden Für Videoanwendung zu langsam Farbsensoren Normal: additives Raster mit Streifenfilter, z.B. RGB oder C,G,Y C = B+G, Y = R+G , G = Überlagerung aus C,Y R = Y-G, G = G, B = C –G Vorteil: Grün in allen Kanälen (visuell wichtig für Schärfe & Kontrast = Luminanz) Nachteil: Farbwiedergabe schlechter, mehr Rauschen (Differenzssignale) Meist Bayer-Matrix: Selten: 3 CCD Sensoren und Farbteiler (professionelle Videos) Farbwiedergabe Sensor wird mit monochromatischem Licht belichtet Signalstärke wird entsprechend zur Wellenlänge für die Kanäle R, G und B aufgetragen Sensor wird nicht für eine bestimmte Lichtart konzipiert Anpassung durch Weisspunkt Weisspunkt Ausgangssignal eines Sensors entspricht der Dauer einer Exposition von Licht einer gewissen Helligkeit Ausgangssignal = Integral des Messbereichs des Kanals (R, G oder B) weisses Licht: R = G = B Weisspunkt muss im Prinzip immer bei einer Änderung der Lichtquelle (Farbtemparatur) geändert werden Interpolation (Grund: Durch 3 Kanäle Auflösungsverlust: 10 MPixel CFA 2.5 MPixel Color (pro Pixel nur 1 Farbe)) Zu gegebenen diskreten Daten soll eine kontiunierliche Funktion gefunden werden, die diese Daten abbildet 9 Bildtechnologie II Qualitätskriterien von Bildsensoren Auflösung = Pixels/Länge [dpi] Dynamik (Darstellbarer Helligkeitsumfang Rauschen Empfindlichkeit Auflösung Pixelzahl nicht verwechseln mit Auflösung (dpi)! Auflösung wird definiert durch Grösse des Sensors und Anzahl der Pixel: Anzahl Pixel auf eine Raumdimension bezogen 10‘000 Pixel auf 70mm = 3623 dpi Je grösser Sensor, umso besser die Dynamik der Pixel (Elektronen haben mehr Volumen zur Verfügung) Kleine Pixel sind unempfindlicher gegen Moiré Kleine Pixel benötigen Spitzenoptiken (Linsenfehler) mit grosser Öffnung (Beugung) Auflösung steigt mit zunehmendem Durchmesser der Aperturund kürzer werdener Wellenlänge Dynamik Unterschied zwischen dem hellsten und dem dunkelsten reproduzierbaren Bildteil (Bildkontrast) Je grösser die Dynamik einer Kamera, unempfindlicher ist man gegen Fehlbelichtungen Grössere Pixel können mehr Photonen sammeln, dadurch wird der darstellbare Kontrast automatisch grösser Der Dynamikumfang leitet sich aus der Grösse der einzelnen Pixel und dem intrinsischen Rauschen (statisches Rauschen, thermisches Rauschen) Eine gute Kamera schafft ca 1:1000 bei kleiner Dynamik wird Sättigung erreicht völliger Informationsverlust in den Lichtern Rauschen messbare Signalwschankung Alle elektrischen Bauteile besitzen ein intrinsisches Rauschen, so auch ein Bildsensor. (im analogen Film kennt man auch eine Art von Rauschen: Das Bildkorn) Weisses Rauschen: Die Leistungsdichte des Rauschspektrums ist in einem grossen Bereich gleich ähnlich wie weisses Licht! Rosa Rauschen: Die Leistungsdichte des Rauschens nimmt mit zunehmender Frequenz ab (auch 1/f oder 1/f2 Rauschen) Statisches Rauschen: Die durch eintreffende Photonen erzeugte Spannung in einem Pixel streut um den Wurzelwert der Anzahl eintreffender Photonen man kann nichts dagegen machen (ausser richtig damit umgehen) o SNR (Signal to Noise Ratio) = 𝐶⁄ √𝐶 definiert die Qualität eines Nutzsignals, das von einem Rauschsignal überlagert ist Thermisches Rauschen (Dunkelstrom): Anregung der Elektronen durch Wärmebewegung. Kühlen von Sensoren hilft, TR zu reduzieren. TR ist immer dem Bild überlagert und nimmt mit Belichtungszeit zu. TR kann gemessen & abgezogen werden 10 Bildtechnologie II Empfindlichkeit Bei einem Sensor wird die Empfindlichkeit durch elektrisches Verstärken gesteigert Rauschen wird zwangsläufig auch verstärkt. Bsp: Empfindlichkeitssteigerung um zwei Blenden von 100 ASA auf 400 ASA (pro ganze ASA Stufe halbiert sich die notwendige Lichtmenge um ein bestimmtes Signal zu erreichen) Signal & Rauschen um Faktor 4 verstärkt Problem: Sättigung wird früher erreicht! Empfindlichkeit des Sensors wird durch die Apertur des Pixels bestimmt wie viel Licht gelangt auf den photoelektrisch aktiven Bereich grosse Pixel sind hier naturgemäss empfindlicher Mikrolinsen erhöhen die Lichtausbeute Mikrolinsen: Mikrolinsen sammeln das Licht und lenken es auf die lichtempfindliche Stelle des Sensors (es gibt viele Bereiche auf dem Sensor, die nicht empfindlich sind: Datenleitungen, Spannungsversorgung) Folgen der Verstärkung Immer mehr Rauschen als ohne zusätzliche Verstärkung Schnelles Ausfressen in kontrastreichen Aufnahmesituationen Night Shot Infrarot wird abgeblockt, da es schlecht für Farbwiedergabe ist. Zur Steigerung der Empfindlichkeit kann der IR-Filter weggelassen werden Sony Night-Shot Pixelgrösse & Optik Warum keine grossen Chips? Grosse Sensoren sind teuer, Halbleiterherstellung ist immer mit gewissen Fehlern verbunden Huygen-Fresnel Jeder Punkt einer Wellenfront kann als Ausgangspunkt einer neuen Welle, der sogenannten Elementarwelle, betrachtet werden. Die neue Lage der Wellenfront ergibt sich durch Superposition sämtlicher Elementarwellen (in 3 Dimensionen sind Elementarwellen kugelförmig, in 2 kreisförmig) Ein Punkt wird als kleine Scheibe abgebildet. Scheibengrösse hängt unmittelbar mit der Öffnung der Apertur zusammen Unschärfe (Apertur: Öffnung eines technischen Gerätes für Lichtstrahlen, die entweder durch Linsen oder Spiegel weitergeleitet werden) Wirkung einer Blende Bei Beugungserscheinungen kann sich die Welle im geometrischen Schattenraum des Hindernisses (Spalt, Gitter, Fangspiegel usw.) ausbreiten. Zur Beugung kommt es durch Entstehung neuer Wellen entlang einer Wellenfront gemäss dem Huygenschhen Prinzip, Dies können durch Überlagerungen zu Interferenzerscheinungen führen. 11 Bildtechnologie II Farbe I Farbeigenschaften Farbe resultiert aus der Interaktion einer Lichtquelle, einem Objekt und dem Auge und Gehirn, unserem visuellen System Verursacher von Farbe Brennvorgänge Gasanregung „Vibration und Rotation“ Übergangsmetallverbindungen Übergangsmetalle und Verunreinigungen Organische Verbindungen Metalle Halbleiter (rein und dotiert) Ladungstransfer Farbzentren Dispersive Brechung Streuung Interferenz Beugung Farbeindruck wird durch Umgebung beinflusst „weiss“ Schwarze Strahler strahlt elektromagnetische Strahlung aus, die nur von Temperatur abhängt (nicht vom Material). Bsp: Glühlampen, Halogenlampen (allerdings T(Metall)≠T(Farbtemperatur) Farbtemperatur Temperatur eines Schwarzen Strahlers in Kelvin Farbwiedergabe Effekt einer Lichtquelle auf die Farberscheinung eines Objekts, wird bewusst oder unbewusst mit der „Farbe“ unter einer Referenzlichtquelle (meist Sonnenlicht) verglichen Korrelierte Farbtemperatur Temperatur eines schwarzen Strahlers der am ähnlichsten der Farbe einer beliebigen Lichtquelle gleicht (Fluoreszenzlampen) (Beleuchtungs-)Metamerie Effekt, dass Paare von Farbproben unter einer Lichtart den gleichen Farbreiz besitzen, unter einer anderen Lichtart aber unterscheiden werden können Standartlichtquellen & Standard-Beleuchtung Standartlichtquelle A: Glühlampe mit 2856K Standartlichtquelle C: Glühlampe mit Flüssig-Filtern um Tageslicht zu erzeugen D50, D65 (5000K, 6500K) sind numerische Standart-Beleuchtungen Modifizierung des Lichts durch Material Transmission / Absorption o Transmission T = I/I0 o Optische Dichte OD = -log T T 100% 50% 10% 1% OD 0 0.3 1 2 o trüb, opak, durchscheinend, lichtdurchlässig, streuend, diffus o Streuung unterschiedliche Brechungsindizes Brechungsindex n o Verhältnis der Lichtgeschwindigkeit c im Vakuum dividiert durch die Geschwindigkeit des Lichts im Material. o An jeder Grenze, wo eine Änderung des Brechungsindex auftritt, wird ein Teil des Lichts reflektiert, der andere Teil wird gebrochen 12 Bildtechnologie II Reflexion Fluoreszenz o Stoffe, die Licht absorbieren und dabei einen Teil als längerwelliges Licht emmitieren (Opt. Aufheller, InkJet Tinten, FL-Lampen) Spektrale Charakteristiken Transmission: Verhältnis von durchgelassenem zu auffallendem Licht unter definierter Geometrie Reflexion: Verhältnis von reflektiertem zu auffallendem Licht unter definierter Geometrie Reflexions-Faktor: Verhältnis von reflektiertem Licht eines Objekts im Vergleich zum reflektierten Licht eines ideal diffus Reflektor unter definierter Geometrie Glatte, spiegelnde Oberfläche Matte Oberfläche Kombination diffuse / gerichteter Reflexion Goniophotometrie Material ändert nicht nur die spektralen Eigenschaften des Lichts, Material kann auch die gemoetrischen oder goniophotometrischen Eigenschaften von Licht ändern Glatte Oberflächen erzeugen Glanz Materialien, deren Farbe mit dem Winkel ändern nennt man goniochromatisch (iridisierend) 13 Bildtechnologie II Auge Visuelles System Das Sehsystem ist der leistungsfähigkste Fernsinn des menschlichen Organismus. Es liefert mehr Informationen an das Gehirn als alle anderen Sinnessysteme zusammen Der adäquate Reiz ist ein schmales Band elektromagnetischer Wellen, mit Wellenlängen zwischen 400 und 750 nm Die Photonen werden von Photopigmenten der spezifischen Rezeptoren an der Retina absorbiert Diese Photorezeptoren sind der Beginn eines neuronalen Systems, welches über getrennte Kanäle Informationen über Form, Farbe, räumliche Tiefe und Bewegung von „Sehdingen“ zum visuellen Kortex und damit zur bewussten Wahrnehmung dieser Sinneseindrücke bringt. Diese so genannte Sehbahn umfasst eine Kette von „4 Neuronen“ und führt von der Retina über den Thalamus zur Area striata (BA 17). Neben dem „Teilsystem“ für die bewusste Wahrnehmung visueller Information, gibt es 4 weitere „Teilsysteme“, die mit Hilfe retinaler Information bestimmte Reflexe regulieren. 5 Teil-Systeme: retino-genikulo-kortikales System (bewusste Wahrnehmung von visuellen Stimuli) retino-praetektales System (Regulation Pupillomotorik & Akkommodation) retino-tektales System (Koordination von Augen- mit Kopf- und Rumpfbewegungen) akzessorisches optisches System (Okulomotorik) retino-hypothalamistisches System (weitergabe von Hell-/Dunkelinformation an Regulationszentren des zirkadianen Systems) Lichtempfindliche Zellen (Photorezeptoren) : Zapfen und Stäbchen Phototransduktionsprozess 1. Absorption eines Photons: Aktivierung von Rhodopsin, Transducin & Phosphodiesterase. Der cGMP-Spiegel sinkt. 2. Umwandlung von Lichtenergie in elektrische Energie: Verschluss von Natriumkanälen führt zur Hyperpolarisation 3. Umwandlung von elektrischer Energie in ein chemisches Signal: verminderte Freisetzung von Glutamat Vitamin-A Mangel kann zu Nachtblindheit führen, da Stäbchen (benötigen Vitamin A) für das skotopische Sehen verantwortlich sind 14 Bildtechnologie II 3-Farben Theorie Spektrale Empfindlichkeiten der L,M und S Zellen (Zapfen, cones) Integration der 3 Kurven (Augenempfindlichkeiten) über die Wellenlänge: Gleiches Verhältnis L:M:S = identischer Farbeindruck „Mischverhältnisse“ der Anregung bestimmt Farbempfindung Gegentheorie: Zonen-Theorie Sehfehler Linsentrübung grauer Star Katarakt Dichromatie „farbenblind“ o 0.6% Frauen, 8% Männer o Isihara-Test 1) 2) 3) 4) 15 Original missing S cones missing L cones missing M cones Bildtechnologie II Farbe II Empfindungsgemässe Farbeinteilung Lightness (Helligkeit): Vergleich mit empfindungsmässig gleicher Helligkeit zu einer Serie von Grauwerten Hue (Farbton): Ähnlichkeit zu einer der 4 Grundfarben: ROT, GELB, GRÜN, BLAU Chroma (Sättigung): Mass für die Abweichung von GRAU Farbe ist 3-wertig, 3-dimensional (Netzhaut: L,M,S (RGB); Empfindung: Lightness, Hue, Chroma) Chromatische Adaption: Änderungen im visuellen System, die Änderungen in der spektralen Qualität der Beleuchtung kompensieren Helligkeits-Adaption: Änderungen im visuellen System, die Änderungen in der Helligkeit der Beleuchtung kompensieren Farbkonstanz: Tendenz einer Farbe eines Objekts konstant zu bleiben, auch wenn Helligkeit und Farbe der Beleuchtung variieren Beobachter-Metamerie: Unterschiedliche Beobachter sehen Unterschiedliches Farbfilm ≠ Scanner ≠ Auge Quantitative Beschreibung der Farbe auf physikalischen Farbmustern basierende Farbsysteme Farbmisch-Systeme 3 „Primär“-Farben (bei Farbmonitor) o Farbmonitor: RGB o Druck: CMY RGB-Würfel „Gamut RGB-Würfel-Rotation doppeltes Sechseck Pantone HLS-Koordinaten Hue, Lightness, Saturation(Computergrafik) Problem: Beziehung zwischen gleichmässiger empfindungsmässiger Abstufung und gleichmässiger „Mischung“ (Farbstoffe, „RGB“ im Computer) ist nicht-linear! auf Wahrnehmung basierende Farbsysteme Farben werden so abgestuft, dass eine gleichmässige Fabverteilung entsteht, der „Farbraum“ ist harmonisch (gleichmässig) geordnet! Munsell (1905) o 10 Hue: R, YR, Y, GY, G, BG, B PB, P RP o 10 Values o Chroma NCS, Natural Color System (in Achritektur weit verbreitet) o Zonentheorie: 2 Farbpaare R-G und Y-B Problem: funktionieren nur bei einer einzigen Lichtsorte korrekt 16 Bildtechnologie II CIE-System (Additive Mischung) Farbmischungen beruhend auf der Überlagerung (Addition) von farbigen Lichtquellen (relative power hängt von Lichtart ab; reflectance factor hängt vom Farbstoff ab) Es gibt keine 3 Primärfarben, die jede Zelle unabhängig von der anderen „reizt“ man kann mit 3 Primärfarben nie alle möglichen Farben nachmachen. Grassmann’s Gesetzt der additiven Farbmischen (1853) 1. Auf das Ergebnis einer additiven Farbmischung hat nur das Aussehen der Farbreize Einfluss, nicht deren Zusammensetzung 2. Zur Kennzeichnung eines Farbreizes sind drei voneinander unabhängige Grössen notwendig und hinreichend 3. Alle Farbmischungen sind stetig Color-Match Test: auch wenn die Farberscheinung ändert, der „ColorMatch“ der beiden Felder ist unverändert 3 Primär-Farben = 3 Vektoren lineare Vektoralgebra Vielfach ist die Helligkeit nicht so wichtig Angabe: Durchstosspunkt durch die Einheitsebene Chromazitätsdiagramm 𝑟= 𝑅 𝑅+𝐺+𝐵 𝑔= 𝐺 𝑅+𝐺+𝐵 𝑏= 𝐵 𝑅+𝐺+𝐵 𝑟+𝑔+𝑏 =1 Problem: Farben, die man mit Primärfarben nicht nachmachen kann Bsp: Blaugrün 𝑆(𝑅, 𝐺, 𝐵) ≠ 𝑅𝑹 + 𝐺𝑮 + 𝐵𝑩 Blaugrün mit Rot entmischen: 𝐺𝑮 + 𝐵𝑩 − 𝑅𝑹 = 𝑆(𝑅, 𝐺, 𝐵) 3 Primärfarben genügen (immer), um alle anderen Farben nachzumachen, jedoch nur im mathematischen Sinne, z.T. mit negativen Vorzeichen. Physisch kann man mit 3 Primärfarben (immer) nur diejenigen Farben nachmachen, die innerhalb des Farbdreiecks („Gamut“) liegen. 17 Bildtechnologie II In der Ebene ist jede Farbe bestimmt. Farben die möglich sind, sind von „Schuh-Sohle“ umschlossen Helligkeitsabgleich zwischen 2 monochromatischen Lichtern: normiert bei 555nm Braucht z.B. bei Blau (≈450nm) wehsentlich mehr Strahlungsleistung (in Watt) als bei 555nm Photometrie photometrische Einheit: Integral von Stimulus * photopischer Normalbeobachter Normierung CIE Welche „Primärfarben sollen gewählt werden? 1. Wellenlängen so wählen, dass grösstmögliche Unabhängigkeit entsteht 2. Lichtquellen und –wellenlänge wählen, die technisch einfach und reproduzierbar herzustellen sind Blau: 435.8 nm, Grün: 546.1 nm, Rot: 700nm Verhältnis der Strahlungsleistung: 1.0 : 1.14 : 72.1 (B:G:R) Kurve nicht eindeutig bestimmt, sonder statistisch ermittelt CIE 1931 („Standart kolorimetrisches System“) Aus den realen R,G,B Stimuli wird eine Koordinatentransformation gefunden, dass die Chromazitätskoordinaten keine negativen Anteile mehr enthalten wenigstens rechnerisch alle Farben (auch Spektralfarben) positiv mischbar Red(X) : r = 1.28 g = -0.28 Green(Y): r = -1.74 g = 2.77 Blue(Z): r = -0.74 g = 0.14 nicht spektrale Augenempfindlichkeiten! b = 0.0 b = -0.3 b = 1.6 18 Bildtechnologie II Farbe III Helmholtz: Es gibt physisch keine 3 Farben, mit denen alle Farben nachgemacht werden können, ausser imaginäre Farben, die theoretisch (resp. praktisch beim numerischen Rechnen) von Interesse sind Berechnung von Farbkoordinaten 𝑋 = 𝑘 ∫𝜆 𝑅(𝜆)𝑆(𝜆)𝑥̅ (𝜆)𝑑𝜆 𝑋 = 𝑘 ∫ 𝑅(𝜆)𝑆(𝜆)y̅(𝜆)𝑑𝜆 𝜆 𝑋 = 𝑘 ∫ 𝑅(𝜆)𝑆(𝜆)z̅(𝜆)𝑑𝜆 𝜆 100 ∫𝜆 𝑆(𝜆)𝑦̅(𝜆)𝑑𝜆 R(λ) = Objektspektrum S(λ) = Lichtspektrum In Praxis Summenbildung: Δ λ alle 5, 10 oder 20nm (380-730 nm) 𝑘= 𝑥= 𝑋 (𝑋 + 𝑌 + 𝑍) 𝑦= 𝑌 (𝑋 + 𝑌 + 𝑍) 𝑧= 𝑍 (𝑋 + 𝑌 + 𝑍) 𝑋= 𝑥 z 𝑌, 𝑍 = Y 𝑦 y Konvention: Kleinschrift: Chromazitäts-Koordinaten (chromaticity) (x,y,z) Grosschrift: Tristimulus-Werte (X,Y,Z) Tristimulus-Werte der Spektralfarben, die den Standart definieren, werden mit 𝑥̅ , y̅, z̅ bezeichnet Eigenschaften von X Y Z weisses Licht, das energiegleich ist (ähnlich Tageslicht) hat x = y = z = 1/3 X, Y (etwa „Rot“, „Grün“) so definiert, dass die Linie entlang der „Rot-Gelb“-Achse geht Y entspricht Helligkeitsempfindungskurve Photographie additiver Prozess Farben in der Photographie 1802 Thomas Young: Theorie des Farbseens 1852 Hermann Helmholtz: erweiterte Theorie des Farbsehens 1861 James Clerk Maxwell: additive Farbenphotographie mit Dreifarbenprojektion 19 Bildtechnologie II Farbraster-Verfahren 1875 Du Hauron: Rasterverfahren 1895 John Joly: Linienraster 1904 Auguste und Louis Lumière: Kornraster, AutochromePlatte 1910 L. Dufay: Linienrasterfilm Dufaycolor 1916 Agfa: Agfa Kornrasterplatte, ab 1932 AgfacolorRasterfilm 1925 Kodak: Kodacolor Linsenrasterschmalfilm Fernsehen und Fernsehkamera Wie muss die spektrale Sensibilisierung sein, damit Farbwiedergabe auf dem Monitor optimal wird? Für optimale Farbwidergabe Farben möglichst am Rand des CIE-Diagramms wählen, das sind jedoch Spektralfarben technisch schwierig zu machen Versuch Farbmischung mit vorigen Primärfarben: ergeben überall negative Tristimulus-Werte Kamera bräuchte 6 Röhren, je 2 pro Kanal. Gute Kameras stimulieren negative Empfindlichkeiten mit Matrix (nicht ganz korrekt, da der negative Teil aus den Signalen der beiden anderen gemacht wird, das ergibt im Spektralverlauf kleine Änderungen). Farbwiedergabe-Fehler bei Verwendung von Röhren mit/ohne Matrixierung, ohne Negativ-Korrektur: alle Farbe gehen nach „unbunt“. Farbsysteme: UCS, Uniform Chromaticity Scale, CIE-LAB MacAdam-Ellipsen Wie gross ist die gerade noch wahrnehmbare Farbdifferenz? Grün = überbetont CIE-Diagramm ist nicht linear mit Farbempfindung lineare Transformation des CIE X,Y,Z-Raumes CIE 1976 Chromazitätskoordinaten u‘, v‘ 𝑢′ = 4𝑋 4𝑥 = 𝑋 + 15𝑌 + 3𝑍 −2𝑥 + 12𝑦 + 3 𝑣′ = 9𝑌 9𝑦 = 𝑋 + 15𝑌 + 3𝑍 −2𝑥 + 12𝑦 + 3 inverse Funktion: 𝑥= 𝑦= 6𝑢′ 9𝑢′ − 16𝑣 ′ + 12 6𝑢′ 4𝑣′ − 16𝑣 ′ + 12 20 Bildtechnologie II Empfindungsgemässe Farbsysteme Munsell-System ist für praktische Anwendungen sehr gut geeignet, da es empfindungsmässig stimmt. kann man CIE-XYZ so umtransformieren dass es empfindungsmässig korrekt(er) wird? u/v-Koordinaten nicht so gut geeignet, da lineare Transformation von CIE-XYZ Gleichförmigkeit der MacAdam-Ellipsen wird durch nicht-lineare Transformation erreicht Gleichmässige Helligkeitsabstufung „achromatische Eigenschaften (Helligkeit, Weissgard) Problem: Eine Grauabstufung wird durch den Hintergrund beeinflusst! viele mathematische Formeln: 1920 (Priest) Quadratwurzel 𝑉 = 10√𝑌 (0 < 𝑌 < 1) 1943 (Newhall) Polynom 5ter Ordnung Y =1.1913V -0.22532V2 + 0.2351V3- 0.020483V4 + 0.00081935V5 CIE kubische Wurzel stimmt relativ genau mit Munsell überein 1 𝑊 ∗ = 25𝑌 3 − 17 (1 ≤ 𝑌 ≤ 100) 1 ∗ 𝐿 = 𝐿∗ = 𝑌 3 𝑌 116 ( ) − 16, > 0.008856 𝑌𝑛 𝑌𝑛 𝑌 𝑌 903.29 (𝑌 ) , 𝑌 ≤ 0,008856 𝑛 𝑛 Yn ist das Y des Referenz-Lichtes CIE-LAB Ein Farbsystem, dass auf dem Zonensystem beruht 3 Variablen: L Helligkeit a rot-grün b gelb-blau 1 ∗ 𝐿 = 116 𝑌 3 ( ) 𝑌𝑛 − 16 1 (Lightness) 1 1 𝑋 3 𝑌 3 𝑎 = 500 [ ( ) − ( ) ] 𝑋𝑛 𝑌𝑛 1 𝑋 3 𝑍 3 𝑏 = 200 [ ( ) − ( ) ] 𝑋𝑛 𝑍𝑛 ∗ Xn, Yn, Zn sind die Tristimuluswerte des Referenzweiss 1⁄ 2 𝐶𝑎∗ 𝑏 = (𝑎∗2 + 𝑏 ∗ 2 ) (Chroma) ℎ𝑎 𝑏 = tan−1 (𝑎∗ ) (hue) 𝑏∗ ∗ 1 Einheit Unterschied Δ𝐸𝑎𝑏 von Auge gerade noch wahrnehmbar „Weiss“ ist L= 100, a,b= 0 unabhängig von der Lichtart 21 Bildtechnologie II Farbe IV Messen von Farben Farbmessung (Color): Eine Messung, die sich auf das bezieht, was der Beobachter sieht Farbstofmessung (Colorant): Eine Messung, die sich auf die Farbstoffe bezieht, die in einem farbigen Material gebraucht werden. Oft hat das wenig mit dem zu tun was ein Beobachter sieht Messung: Farberscheinung: Farbe allein Farbdifferenzen: Muster mit Standart vergleichen Materialfärbung: spektrale Eigenschaften ermittelt Messgeräte Kolimeter: Messen von CIE Tristimuluswerten Spektrophotometer: für Reflexion Spektroradiometer: spektrale Strahlungsmessung Lichtabsorptionsmessung Transmission 𝑻 = 𝐼𝑡 𝐼0 = durchgelassenes Licht Total auffallendes Licht Bei Papieren ähnlich: Reflexion R. Das Konzept der Reflexion ist jedoch wesentlich komplizierter, da 𝑅 = ∫(Einfallswinkel, Materialeigenschaften) In der photographischen Praxis (Filme, Filter…) wird anstatt des Transmissionswertes die optische Dichte OD verwendet. Dies ist der Logarithmus (Basis 10) der inversen Transmission (oder Reflexion) 𝐼0 𝐷 = log ( ) = − log(𝑇) 𝐼𝑡 Logarithmus unerlässlich, da: 1. Absorption von Licht ist eine Funktion der Dicke d der absorbierenden Schicht: OD = k*d (giltnur bei einer einzigen Wellenlänge) Wenn die Konzentration c des absorbierenden Mediums geändert wird, dann ändert sich auch die optische Dichte: OD = k‘ *c * d (Beer-Lambertsches Gesetz) 2. Der Gebrauch von logarithmischen Einheiten hängt mit den Eigenschaften des menschlichen Sehvorgangs zusammen RGB-Berechnungen 𝑑 𝑟,𝑔,𝑏 R, G oder B = (1.02 ( 255 ) − 0.02)2.4 22 Bildtechnologie II Rechenbeispiel: Was ist die Farbe von RGB = 40,140,80 X(mix) = R · X(r,max) + G · X(g,max) + B · X(b,max) = (0.009 x 33.17)+(0.228 x 30.22)+( 0.056 x 11.71) = 7.84 Y(mix) = R · Y(r,max) + G · Y(g,max) + B · Y(b,max) = (0.009 x 17.46)+(0.228 x 57.38)+(0.056 x 5.16) = 13.53 Z(mix) = R · Z(r,max) + G · Z(g,max) + B · Z(b,max) = (0.009 x 1.69)+(0.228 x 10.02)+(0.056 x 60.79) = 5.70 L* = [ 116 (Y / Yw)1/3 - 16] = [ 116 (13.53 / 80.0)1/3 - 16] = 48.2 = 500 [ (X / Xw)1/3 - (Y / Yw)1/3 ] = 500 [ (7.84 / 75.1)1/3 - (13.53 / 80.0)1/3 ] = -41.0 = 200 [ (Y / Yw)1/3 - (Z / Zw)1/3 ] = 200 [ (13.53 / 80.0)1/3 - (5.70 / 72.5)1/3 ] = 24.9 a* b* Druck Fast immer 4 Farben: Gelb (Y), Magenta (M), Cyan (C) und Schwarz (K). Mit dem Schwarz kann ein grösserer Farbraum (Gamut) erzielt werden „Alte“ Farbseparation RGB wird in CMY geteilt (wie bei Farbphotographie), Schwarz wird als Kontrastmaske für die dunkelsten Bildteile eingesetzt Rasterverfahren additiv & subtraktiv Druckraster gleich viel cyan & magenta und trotzdem sieht es anders aus: das Muster ist verschieden Neugebauer Modell Man nehme an Gelb und Magenta würde in Streifen im rechten Winkel zueinander gedruckt, jeder Streifen bedecke a = 20% der gesamten Fläche. Bei der Überlappungsstelle wird subtraktives Rot produziert. Das ergibt additive Mischung aus 5 Farben (Rot, Magenta, Gelb, Weiss) Farbkonzentration Continous tone, Konzentration ändert sich halftoning, Konzentration gleich, aber prozentualer Deckgrad ändert sich Die resultierende Farbe der mittleren Helligkeiten ist verschieden Magenta 50% (halbe Konzentration) ≠50% Vollton-Magenta + 50% Weiss gerasterte Farbtöne haben weniger Sättigung GCR (Gray Color Removal) und UCR (Under Color Removal) Die Farbe wird rechnerisch in den achromatischen Teil (=Schwarz ) und den chromatischen Teil (C,M,Y) unterteilt 23 Bildtechnologie II Appendix: Meilensteile der Fotographie Jahr 1827 1839 1851 1880 1890 1900 1930 1940 1950 1980 1990 2000 Ereignis Erfindung der Fotografie (Nièpce – Daguerre - Archer) Die Fotographie wird ein industrielles, popularisiertes Massenprodukt (Eastman Kodak) Farbfotografie (chromogenes Verfahren) als Massenprodukt (Agfa, Kodak) Aufkommen der Elektronik Computer und elektronische Sensoren, Digital-Fotografie industrieller Rückgang der AgXFotografie 24 Technische Erfindung und weitere Entwicklungen von visuellen Medien Fixieren der Fotoschicht Steigerung der Lichtempfindlichkeit durch Entwicklung und lichtempfindliche Silbersalze Gelatine-Trockenplatte biegsamer Träger Zelluloid in diese Zeit fällt auch das Entstehen des Kinofilm und Cinema Diffusionsfeste Farbstoffe in diese Zeit fällt auch das Entstehen des Fernsehens Halbleitertechnologie Internet