theoretische physik klassische mechanik

Werbung

T HEORETISCHE P HYSIK

Hans-Jürgen Matschull

Institut für Physik, Universität Mainz

23.7.2003

T EIL II

K LASSISCHE M ECHANIK

9 Tensoren

Im Teil I haben wir die wesentlichen Eigenschaften des physikalischen Raumes mit den Mitteln der linearen Algebra beschrieben. Die Orte im Raum haben wir mit den Punkten eines dreidimensionalen,

metrischen affinen Raumes identifiziert, und darauf aufbauend haben wir die Newtonsche Mechanik für

Systeme von Punktteilchen formuliert. Außerdem haben wir Kraftfelder zur Beschreibung von Wechselwirkungen verwendet, etwa in Form von Gravitations- oder elektromagnetischen Feldern.

In diesem Kapitel wollen wir die mathematischen Strukturen, die hinter diesen Begriffen stehen, etwas

weiter vertiefen. Oft begegnen uns in ganz unterschiedlichen physikalischen Fragestellungen ähnliche mathematische Strukturen. Es ist deshalb nützlich, eine Sprache zu entwickeln, die solche Ähnlichkeiten und

Analogien zwischen scheinbar ganz verschiedenen Objekten leichter erkennbar macht. Gleichzeitig sollte

diese Sprache aber auch dazu geeignet sein, die physikalischen Fragestellungen möglichst anschaulich zu

formulieren. Wir suchen also einen Kompromiss zwischen der Sprache der Mathematiker, die oft speziell darauf ausgelegt ist, möglichst elegante und allgemeingültige Beweise zu führen, und der Sprache der

Physiker, die primär darauf ausgelegt ist, Beobachtungen und Experimente zu beschreiben.

Dass zwischen diesen Anforderungen manchmal eine gewisse Spannung besteht, haben wir bereits

bei der Beschreibung des physikalischen Raumes gesehen. Der Mathematiker denkt bei einem N dimensionalen affinen Raum immer gleich an den speziellen Raum R N . Der Grund ist sehr einfach. Man

weiß, dass alle affinen Räume gleicher Dimension isomorph sind. Um Sätze über affinen Räume und Vektorräume zu beweisen, kann man sich daher auf einen speziellen, möglichst einfach strukturierten Raum

beschränken und alle Beweise in diesem Raum führen. Für den Physiker ist die Vorstellung des Raumes als R3 aber sehr unbefriedigend, denn sie vermittelt die falsche Vorstellung, dass es so etwas wie ein

ausgezeichnetes Koordinatensystem gäbe, und insbesondere einen Nullpunkt.

Gesucht ist deshalb eine Formulierung von physikalischen Theorien, in der die verwendeten mathematischen Objekte die physikalischen Strukturen möglichst gut widerspiegeln, auch wenn dies hin und wieder

bedeutet, dass die Beweise für mathematische Sätze, wenn wir sie denn führen wollen, ein wenig umständlicher aussehen als sie tatsächlich sind. Eine dafür recht gut geeignete Sprache, in der sich einerseits alle

wesentlichen Aspekte der linearen Algebra und der Analysis erfassen lassen, die aber andererseits auch

sehr gut an die gängigen physikalischen Konzepte von Raum und Zeit, Kraftfeldern und die Beschreibung

von dynamischen Systemen angepasst ist, bietet das Tensorkalk ül.

Etwas überspitzt kann man sagen, dass alle mathematischen Objekte, die wir bis jetzt eingeführt und

benutzt haben, Tensoren oder Tensorfelder sind, oder dass sie zumindest etwas mit diesem Konzept zu

tun haben. Das Tensorkalkül dient im wesentlichen dazu, mathematische Objekte und Strukturen, wie sie

typischerweise in physikalischen Theorien auftreten, zu klassifizieren. Außerdem stellt es einen Rahmen

bereit, der sich fast beliebig erweitern lässt, und in dem in einer sehr genau definierten Art und Weise neue

Objekte aus bereits vorhandenen konstruiert werden können.

Natürlich müssen wir erst einmal definieren, was denn ein Tensor überhaupt ist. Das werden wir in

diesem Kapitels tun, und wir werden zeigen, wie sich die wichtigsten mathematischen Begriffe aus dem

ersten Teil in dieses Konzept einpassen. Viele der dort hergeleiten, scheinbar sehr unterschiedlichen Eigenschaften von Vektoren und Vektorfeldern werden dabei in einem neuen, einheitlichen Licht erscheinen.

Vektoren und duale Vektoren

Es sei V ein N -dimensionaler Vektorraum über R. Um später eine einheitliche Notation einzuführen,

bezeichnen wir die Vektoren mit fett gedruckten Buchstaben x, y, . . . ∈ V, und eine Basis von V mit e i ,

wobei der Vektorindex i irgendeine nicht weiter spezifizierte Indexmenge mit N Elementen durchläuft.

Einen Vektor x können wir dann durch seine Komponenten x i bezüglich dieser Basis darstellen,

x = xi ei ∈ V.

1

(9.1)

Warum wir den Index nach oben schreiben, werden wir gleich verstehen. Wir verwenden außerdem die

folgende, leicht veränderte Summenkonvention.

Über Vektorindizes in einem Produkt ist genau dann zu summieren, wenn derselbe Index einmal als oberer und einmal als unterer Index auftritt.

Andere Situationen, also Ausdrücke, in denen derselbe Index zweimal unten oder zweimal oben steht,

werden im folgenden nicht auftreten und sind, wie wir sehen werden, auch nicht sinnvoll.

Der zu V duale Vektorraum V ∗ ist die Menge aller linearen Abbildungen V → R. Ist u ∈ V ∗ , so

bezeichnen wir die durch u definierte Abbildung mit einem Punkt, also

u:

V → R,

x 7→ u · x.

(9.2)

Da diese Abbildung linear ist, gilt für alle x, y ∈ V, u ∈ V ∗ und s ∈ R

u · (x + y) = u · x + u · y,

u · (s x) = s (u · x).

(9.3)

Damit V ∗ zu einem Vektorraum wird, erklärt man die Vektoraddition und skalare Multiplikation in V ∗ wie

für Abbildungen üblich. Für u, v ∈ V ∗ , x ∈ V und s ∈ R ist

(u + v) · x = u · x + v · x,

(s u) · x = s (u · x).

(9.4)

Umgekehrt definiert jeder Vektor x ∈ V eine lineare Abbildung V ∗ → R, die genau die gleichen Eigenschaften hat, nämlich

x : V ∗ → R,

u 7→ u · x.

(9.5)

Tatsächlich lässt sich jede lineare Abbildung V ∗ → R so schreiben. Der zu V ∗ duale Vektorraum ist

demnach V. Um diese Symmetrie zum Ausdruck zu bringen, fasst man den Punkt auch als eine bilineare

Abbildung auf, die einen dualen Vektor und einen Vektor auf eine reelle Zahl abbildet,

V∗ × V → R :

(u, x) 7→ u · x.

(9.6)

Bilinear bedeutet linear in beiden Argumenten, also die Eigenschaften (9.3) und (9.4). Wir nennen u · x

auch einfach das Produkt von u und x.

Zu jeder Basis ei von V gibt es eine zugehörige duale Basis ei von V ∗ . Der Index i durchläuft dabei

die gleiche Indexmenge. Wir unterscheiden die Basis von der dualen Basis dadurch, dass wir den Index

einmal nach unten und einmal nach oben schreiben.

Die duale Basis ist dadurch eindeutig festgelegt, dass die dualen Vektoren e i ∈ V ∗ , aufgefasst als lineare

Abbildungen V ∗ → R, die Basisvektoren ej ∈ V auf Null oder Eins abbilden, je nachdem, ob i gleich j

ist oder nicht. Das lässt sich mit dem bekannten Kronecker-Symbol schreiben,

1

für i = j,

i

i

e · ej = δ j =

(9.7)

0

für i 6= j.

Auch diese Bedingung ist symmetrisch in dem Sinne, dass ei dann auch die zu ei duale Basis ist.

Zu jeder Basis von V gibt es eine eindeutig bestimmte duale Basis von V ∗ .

Einen dualen Vektor u ∈ V können wir durch seine Komponenten bezüglich der dualen Basis e i darstellen,

wobei wir den Index diesmal nach unten schreiben, damit wieder die Summenkonvention zur Anwendung

kommt,

u = u i ei ∈ V ∗ .

(9.8)

Bilden wir nun das Produkt von u und a, so finden wir

u · x = (ui ei ) · (ej xj ) = ui (ei · ej ) xj = ui δ ij xj = ui xi .

Das Produkt ist einfach durch die Summe über die Produkte der Komponenten gegeben.

2

(9.9)

Aufgabe 9.1 Eine andere nützliche Eigenschaften einer Basis und ihrer dualen Basis ist, dass die dualen

Basisvektoren ei , aufgefasst als lineare Abbildungen V → R, den Vektoren ihre Komponenten zuordnen,

und umgekehrt die Basisvektoren ei , aufgefasst als lineare Abbildungen V ∗ → R, den dualen Vektoren

ihre Komponenten zuordnen. Man zeige das, also

x = x i ei ,

u = u i ei

⇒

xi = ei · x,

ui = u · e i .

(9.10)

Ein typisches Beispiel für einen Vektorraum und seinen Dualraum sieht wie folgt aus. Es sei V der Raum

aller Spaltenvektoren der Länge N , also

1

x

..

(9.11)

x = . ∈ V, mit x1 , . . . , xN ∈ R.

N

x

Jede lineare Abbildung u : V → R kann dann wie folgt geschrieben werden,

u:

x

7→

u · x = u 1 x1 + · · · + u N xN ,

(9.12)

mit eindeutig bestimmten Koeffizienten u1 , . . . uN ∈ R. Fassen wir diese zu einem Zeilenvektor zusammen,

u = u1 · · · uN ∈ V ∗ , mit u1 , . . . , uN ∈ R,

(9.13)

so lässt sich die Abbildung (9.12) als Matrixmultiplikation schreiben,

1

x

.

u · x = u1 · · · un .. = u1 x1 + · · · + uN xN .

xN

(9.14)

und die Zahlen u1 , . . . , uN sind die Komponenten von u bezüglich der dazu dualen Basis

e1 = 1 0 · · · 0 ,

...,

eN = 0 · · · 0 1 .

(9.16)

Natürlich sind in diesem Fall die Zahlen x1 , . . . , xN die Komponenten des Vektors x bezüglich der Basis

1

0

0

..

e1 = .. ,

...,

eN = . ,

(9.15)

.

0

0

1

Der zum Spaltenvektorraum V duale Vektorraum ist folglich der Zeilenvektorraum V ∗ . Dies ist gewissermaßen der Prototyp für einen Vektorraum und seinen Dualraum. Oft ist es nützlich, sich Vektoren als

Spalten und duale Vektoren als Zeilen vorzustellen. Insbesondere wird dadurch klar, dass es sich um zwei

verschiedene Arten von Objekten handelt. Obwohl der duale Vektorraum V ∗ die gleiche Dimension hat

wie der Vektorraum V selbst, ist er nicht mit diesem identisch.

Aufgabe 9.2 Die Regeln (9.3) und (9.4) entsprechen formal den Eigenschaften eines Skalarproduktes. Was

ist jedoch der wesentliche Unterschied zwischen dem hier definierten Produkt und einem Skalarprodukt?

3

Aufgabe 9.3 Es sei V der Raum aller Spaltenvektoren der Länge N , und V ∗ der Raum aller Zeilenvektoren

der Länge N . Ferner sei die folgende Basis von V gegeben,

1

1

1

1

1

1

1

0

1

1

0

0

(9.17)

···,

eN = 1 .

e3 = 0 ,

e2 = 0 ,

e1 = 0 ,

..

..

..

..

.

.

.

.

1

0

0

0

Man bestimme die duale Basis ei , i ∈ {1, . . . , N }, von V ∗ .

Aufgabe 9.4 Wir haben hier der Einfachheit halber nur endlich dimensionale Vektorr äume betrachtet.

Für Vektorräume unendlicher Dimension kann man ganz analog einen dualen Vektorraum einf ühren. Allerdings ist dieser in der Regel nicht mehr genauso groß wie die Vektorraum selbst. Es sei zum Beispiel V

der Raum aller unendlichen Folgen a = (a1 , a2 , . . .) mit der Eigenschaft, dass alle bis auf endlich viele

Glieder gleich Null sind. Das ist ein unendlich dimensionaler Vektorraum, der aber noch vergleichsweise

klein ist. Es lässt sich sogar recht leicht eine Basis ei von V angeben, mit i ∈ N, so dass sich jeder Vektor

eindeutig als endliche Linearkombination der Basisvektoren schreiben l ässt. Wie sieht diese Basis aus?

Was ist der duale Vektorraum V ∗ ? Gibt es eine zu ei duale Basis von V ∗ ?

Basistransformationen

Die Komponenten eines Vektors sind immer nur bezüglich einer gegebenen Basis definiert. Ändern wir

die Basis, so ändern sich auch die Komponenten. Wir müssen zwischen dem Vektor x ∈ V als solchem

und seiner Darstellung durch die Komponenten xi unterscheiden, und entsprechend zwischen dem dualen

Vektor u ∈ V ∗ seine Darstellung durch die Komponenten ui .

Wir betrachten im folgenden zwei Basen ei und ea , die wir durch ihre Indizes unterscheiden. Der Index

a durchlaufe eine andere Indexmenge als der Index i, zum Beispiel i ∈ {x, y, z} und a ∈ {1, 2, 3} im Falle

eines dreidimensionalen Vektorraumes. Die Beziehung zwischen den Basen kann durch eine N ×N - Übergangsmatrix ausgedrückt werden, wobei wieder N = dim V ist. Wir stellen dazu die Basisvektoren e a als

Linearkombination der Basisvektoren ei dar, oder umgekehrt die Basisvektoren ei als Linearkombination

der Basisvektoren ea ,

ea = ei Λia ⇔ ei = ea Λai .

(9.18)

Damit die beiden Gleichungen zueinander äquivalent sind, müssen die Übergangsmatrizen zueinander

invers sein, also

Λia Λaj = δ ij oder Λai Λib = δ ab .

(9.19)

Wir können das als Matrixmultiplikation lesen, wenn wir den ersten, oberen Index der Übergangsmatrix

als Zeilenindex, und den zweiten, unteren Index als Spaltenindex interpretieren. Die Summenkonvention

sorgt dafür, dass die Matrixmultiplikation richtig ausgeführt wird.

Natürlich besteht dann auch ein Zusammenhang zwischen den dualen Basen e i und ea . Dieser wird

durch die gleichen Übergangsmatrizen vermittelt. Es gilt nämlich

ea = Λai ei

⇔

ei = Λia ea .

(9.20)

Der Beweis ist ganz einfach. Es sei ei die zu ei duale Basis, also ei · ej = δ ij . Dann ist

ea · eb = (Λai ei ) · (ej Λjb ) = Λai (ei · ej ) Λjb = Λai δ ij Λjb = Λai Λib = δ ab ,

4

(9.21)

also ist auch ea die zu ea duale Basis.

Die Transformationseigenschaften (9.18) und (9.20) lassen sich leicht einprägen, denn das sind die einzigen Möglichkeiten, die Basisvektoren so mit den Übergangsmatrizen zu kombinieren, dass alle Indizes

richtig zusammenpassen und dabei die Summenkonvention zur Anwendung kommt.

Aus diesen Transformationsgesetzen lassen sich schließlich auch die Regeln für die Komponenten eines

Vektors und eines dualen Vektors ableiten. Es sei also

x = xi ei = xa ea ∈ V,

und u = ui ei = ua ea ∈ V ∗ .

(9.22)

Dann ergibt sich aus (9.10)

xi = ei · x,

xa = ea · x,

ui = u · e i ,

ua = u · e a ,

(9.23)

und durch Einsetzen von (9.18) und (9.20) das folgende Transformationsverhalten für die Komponenten

eines Vektors,

xa = Λai xi ⇔ xi = Λia xa .

(9.24)

Für die Komponenten eines dualen Vektors gilt entsprechend

ua = ui Λia

⇔

ui = ua Λai .

(9.25)

Auch diese Zusammenhänge lassen sich leicht einprägen, da es keine andere Möglichkeit gibt, die Komponenten so mit der Übergangsmatrix zu kombinieren, dass die Indexstellung stimmt und die Summenkonvention zur Anwendung kommt. Alternativ können wir das auch wie folgt formulieren:

Bei einem Basiswechsel transformieren sich die Komponenten von Vektoren so wie die dualen

Basisvektoren und die Komponenten von dualen Vektoren so wie die Basisvektoren.

Ein Vektor wird also durch einen Satz von N reellen Zahlen dargestellt, der sich beim Wechsel der Basis

in einer ganz bestimmten Art und Weise transformiert. Wir können das im Prinzip als eine Definition

des Begriffes “Vektor” auffassen. Das gleiche gilt für einen dualen Vektor, nur dass für diesen eben ein

anderes Transformationsverhalten gilt. Vektoren und duale Vektoren unterscheiden sich dadurch, dass ihre

Komponenten beim Basiswechsel anders transformieren. Deshalb unterscheiden wir sie durch obere und

untere Indizes.

Die verschiedenen Transformationseigenschaften von oberen und unteren Indizes haben zur Folge, dass

eine bestimmte Kombination eines dualen Vektors und eines Vektors von der Basis unabhängig ist, nämlich

das Produkt

u · x = u i xi = u a xa .

(9.26)

Einen solchen Ausdruck nennen wir einen Skalar. Ein Skalar ist einfach eine reelle Größe, die sich bei

einem Basiswechsel gar nicht verändert.

Aufgabe 9.5 Es sei V der Raum aller Spaltenvektoren der Länge 3, und

Zeilenvektoren der Länge 3. Eine Basis ea , mit a ∈ {1, 2, 3}, sei durch

1

0

e1 = 0 ,

e2 = 1 ,

e3 =

0

0

gegeben, eine zweite Basis ei , mit i ∈ {x, y, z}, durch

1

0

1 ,

1 ,

ex =

ey =

0

1

V ∗ der dazu duale Raum aller

0

0

1

(9.27)

1

ez = 0 .

1

(9.28)

Man bestimme die Übergangsmatrizen Λai und Λia , finde die dualen Basen ea und ei , und verifiziere das

Transformationsverhalten (9.20).

5

Aufgabe 9.6 Es seien ei und ea zwei Basen von V, und ei bzw. ea die dazu dualen Basen. Man zeige, dass

sich die Übergangsmatrizen wie folgt darstellen lassen,

Λai = ea · ei ,

Λia = ei · ea .

(9.29)

Aufgabe 9.7 Es sei V der Raum aller Spaltenvektoren der Länge 2, und V ∗ der entsprechende Zeilenvektorraum. Die Basis ea , mit a ∈ {1, 2}, und die Basis ei , mit i ∈ {u, v}, seien durch

sin α

cos α

0

1

(9.30)

, ev =

,

eu =

, e2 =

e1 =

− cos α

sin α

1

0

gegeben, wobei α ein fest gewählter Winkel ist. Man bestimme die Übergangsmatrizen und die dualen

Basisvektoren.

Aufgabe 9.8 Basistransformationen können verkettet werden. Es seien ei , ea und eµ drei Basen von V,

die wir durch unterschiedliche Indexmengen unterscheiden. Man zeige, dass dann die Übergangsmatrix

Λiµ , die die erste Basis in die dritte überführt, durch das Matrixprodukt der Übergangsmatrizen Λia und

Λaµ gegeben ist, also

Λiµ = Λia Λaµ .

(9.31)

Die Menge aller möglichen Basistransformationen bildet folglich eine Gruppe. Um welche Matrixgruppe

handelt es sich?

Tensoren

Das Konzept eines Vektors oder eines dualen Vektors als ein Satz von N reellen Zahlen, die sich unter

einem Basiswechsel in einer ganz bestimmten Art transformieren, lässt sich verallgemeinern.

Betrachten wir zum Beispiel einen Satz von N 2 reellen Zahlen, die wir in Form einer Matrix anordnen

und mit Aij bezeichnen, wobei die Indizes i und j jeweils N Werte annehmen. Wir postulieren, dass sich

dieses Zahlenschema unter einem Basiswechsel wie folgt transformieren soll. Beim Übergang von einer

Basis ei zu einer neuen Basis ea soll sich die Matrix Aij in eine Matrix

Aab = Λai Aij Λjb

(9.32)

transformieren. Der erste, obere Index verhält sich wie der eines Vektors, der zweite, untere Index wie der

eines dualen Vektors.

Wird dadurch irgendein sinnvolles Objekt definiert? Tatsächlich ist das der Fall. Es handelt sich um die

Matrixdarstellung einer linearen Abbildung A : V → V. Sie ordnet einem Vektor x mit den Komponenten

xi bzw. xa einen Vektor y = A(x) mit den Komponenten

y i = Aij xj

bzw. y a = Aab xb

(9.33)

zu. Um zu zeigen, dass diese beiden Gleichungen tatsächlich äquivalent sind, also den gleichen Zusammenhang zwischen den Vektoren x und y ausdrücken, benutzen wir das Transformationsgesetz für die

Komponenten von Vektoren und das postulierte Transformationsgesetz (9.32) für die Matrix. Daraus folgt

y a = Aab xb = Λai Aij Λjb Λbk xk = Λai Aij δ jk xk = Λai Aij xj = Λai y i .

(9.34)

Die rechte Seite der Gleichungen (9.33) transformiert sich in der gleichen Weise wie die linke Seite. Die

Gleichungen drücken denselben Sachverhalt aus, benutzen nur verschiedenen Darstellungen der Vektoren.

Diese Grundidee lässt sich leicht verallgemeinern. Wir können zunächst ganz abstrakt reelle Zahlen zu

einem Schema anordnen, und dann verlangen, dass sich dieses Zahlenschema bei einem Basiswechsel in

6

einer ganz bestimmten Art transformiert. Wir erklären das Transformationsverhalten implizit dadurch, dass

wir das Zahlenschema durch ein Symbol mit m oberen und n unteren Indizes bezeichnen, etwa B i ··· jk ··· l ,

wobei jeder Index Werte aus derselben Indexmenge mit N = dim V Elementen annimmt. Insgesamt

besteht das Schema dann aus N n+m Zahlen. Wir können uns die Einträge des Zahlenschemas in einem

imaginären, höherdimensionalen Raum in Form von Spalten und Zeilen angeordnet vorstellen.

Beim Übergang von einer Basis ei zu einer neuen Basis ea soll sich das Schema B i ··· jk ··· l in ein neues

Schema

B a ··· bc ··· d = Λai · · · Λbj B i ··· jk ··· l Λkc · · · Λld

(9.35)

transformieren. Wir transformieren quasi jeden einzelnen Index mit einer passenden Übergangsmatrix. Die

Transformationsgesetze (9.24) für Vektoren und (9.25) für duale Vektoren sind einfache Spezialfälle davon, die sich für m = 1 und n = 0, bzw. für m = 0 und n = 1 ergeben. Und das Transformationsverhalten

(9.32) für die Matrixdarstellung einer linearen Abbildung ergibt sich für m = 1 und n = 1.

Ein auf diese Weise zunächst ganz abstrakt definiertes Zahlenschema heißt Tensor der Stufe (m, n). Ein

Vektor ist in diesem Sinne ein Tensor der Stufe (1, 0), ein dualer Vektor ein Tensor der Stufe (0, 1), und

eine linear Abbildung V → V ein Tensor der Stufe (1, 1). Einen Skalar, also eine reelle Zahl, die sich beim

Basiswechsel gar nicht transformiert, können wir als Tensor der Stufe (0, 0) auffassen. Er trägt gar keine

Indizes, und transformiert daher auch nicht beim Basiswechsel.

Wir können das in der folgenden, leicht rekursiven, aber sehr intuitiven Definition zusammenfassen:

Ein Tensor der Stufe (m, n) ist ein Zahlenschema mit m oberen und n unteren Indizes, das

sich beim Basiswechsel wie ein Tensor transformiert.

Wir unterscheiden zwischen dem Tensor als abstraktes Objekt, das wir mit B bezeichnen, und seiner

Darstellung bezüglich einer bestimmten Basis durch ein Zahlenschema B i ··· jk ··· l . Als was wir uns dieses

abstrakte Objekt vorstellen müssen, hängt von der Stufe des Tensors ab. Meistens gibt es mehrere Möglichkeiten, einen Tensor als mathematisches Objekt zu interpretieren. So haben wir zum Beispiel gesehen, dass

sich ein Tensor A der Stufe (1, 1) als lineare Abbildung A : V → V interpretieren lässt. Ein Tensor x der

Stufe (1, 0) ist ein Vektor, oder auch eine lineare Abbildung x : V ∗ → R.

Den Raum aller Tensoren der Stufe (m, n) bezeichnen wir mir V (m,n) . Das ist ein (dim V)m+n dimensionaler Vektorraum, und als Spezialfälle haben wir V (1,0) = V, V (0,1) = V ∗ und V (0,0) = R. Die

Addition und skalare Multiplikation in diesen Vektorräumen ist wie üblich Komponentenweise definiert.

Wir addieren zwei Tensoren gleicher Stufe, indem wie die Einträge des Zahlenschemas addieren. Das gleiche gilt für die skalare Multiplikation. Das ist offenbar mit dem linearen Transformationsverhalten (9.35)

verträglich, und es entspricht der komponentenweisen Addition und skalaren Multiplikation von Vektoren.

Die Summe A + B von zwei Tensoren und das reelle Vielfache s A eines Tensors existieren unabhängig

von der gewählten Basis.

Aufgabe 9.9 Warum kann man einen Tensor der Stufe (1, 1) auch als Darstellung einer linearen Abbildung V ∗ → V∗ auffassen?

Aufgabe 9.10 Man zeige, dass das Kronecker-Symbol δ ij einen Tensor δ der Stufe (1, 1) definiert, indem

man das Transformationsverhalten (9.35) nachweist. Einen solchen Tensor, der in allen Basen durch dasselbe Zahlenschema dargestellt wird, nennt man invarianten Tensor. Wenn wir Tensoren der Stufe (1, 1)

als lineare Abbildungen V → V interpretieren, welche spezielle solche Abbildung wird dann durch den

Tensor δ dargestellt?

Aufgabe 9.11 Ein Tensor A der Stufe (0, 2) sei bezüglich einer Basis ei durch seine Darstellung Aij =

δij , also durch das Kronecker-Symbol mit zwei unteren Indizes definiert. Man zeige, dass dies kein invarianter Tensor ist, dass also die Darstellung Aab bezüglich einer anderen Basis ea im allgemeinen nicht

durch das Kronecker-Symbol δab gegeben ist.

7

Aufgabe 9.12 Bevor man das Transformationsverhalten (9.35) postulieren kann, muss man eigentlich erst

zeigen, dass es konsistent ist. Wenn wir zuerst von einer Basis zu einer anderen transformieren, und dann

zu einer dritten, dann muss das Ergebnis dasselbe sein wie wenn wir gleich von der ersten zur dritten

Basis transformieren. Man verwende das Ergebnis von Aufgabe 9.8, um zu zeigen, dass das Transformationsverhalten (9.35) diese Konsistenzbedingung erfüllt.

Aufgabe 9.13 Es sei ein Tensor der Stufe (m, n) gegeben, dargestellt durch ein Zahlenschema B i ··· jk ··· l

bezüglich einer Basis ei . Wir definieren eine Abbildung

B:

∗

V

· · × V }∗ × V

· · × V} → R,

| × ·{z

| × ·{z

m

durch

(9.36)

n

B(u, . . . , v, x, . . . , y) = B i ··· jk ··· l ui · · · vj xk · · · y l ,

(9.37)

B i ··· jk ··· l = B(ei , . . . , ej , ek , . . . , el ).

(9.38)

wobei ui , . . . , vj bzw. xk , . . . , y l die Komponenten von u, . . . , v bzw. x, . . . , y bezüglich der gegeben Basis

sind. Man zeige, dass die so definierte Abbildung, die in jedem ihrer Argumente linear ist, nicht von

der gewählten Basis abhängt. Jeder Tensor der Stufe (m, n) definiert auf diese Weise eine multilineare

Abbildung, die als Argumente m duale Vektoren und n Vektoren hat. Man zeige umgekehrt, dass sich jeder

solchen Abbildung ein Zahlenschema zuordnen lässt, welches sich wie ein Tensor transformiert. Man muss

dazu nur die gegebene Abbildung B für die Basisvektoren auswerten, also

Welche bilineare Abbildung V ∗ × V → R definiert der Tensor δ aus Aufgabe 9.10?

Der Tensor-Baukasten

Tensoren lassen sich nicht nur wie Vektoren addieren und mit Zahlen multiplizieren, sondern sie lassen

sich auch zu neuen Tensoren kombinieren. Das ist die eigentliche Stärke des Tensorkalküls. Zum Teil

haben wir solche Operationen auch schon durchgeführt. So haben wir zum Beispiel aus einem Vektor x

mit Komponenten xi und einem dualen Vektor u mit Komponenten ui einen Skalar u · x = ui xi gebildet.

Oder wir haben eine lineare Abbildung A, dargestellt durch eine Matrix A ij , auf einen Vektor, dargestellt

durch seine Komponenten xi , angewandt, um so einen neuen Vektor y = A(x) zu bekommen, dargestellt

durch y i = Aij xj .

Alle diese Operationen setzen sich aus zwei Grundoperationen zusammen, die Tensoren auf andere Tensoren abbilden. Die erste Grundoperation ist die Tensormultiplikation. Wir multiplizieren zwei Tensoren

beliebiger Stufe, indem wir ihre Komponenten auf alle möglichen Arten multiplizieren und das Ergebnis wieder in einem Schema anordnen. Auf alle möglichen Arten heißt, dass wir jeden Eintrag des einen

Tensors mit jedem des anderen multiplizieren.

Explizit sieht das zum Beispiel so aus, dass wir aus einem Tensor A der Stufe (2, 0) und einem Tensor

B der Stufe (1, 1) einen Tensor C der Stufe (3, 1) bilden, der durch das Zahlenschema

C ijkl = Aij B kl

(9.39)

dargestellt wird. Wir schreiben dafür auch C = A ⊗ B, und nennen dies das Tensorprodukt von A und

B. Dass auf diese Weise tatsächlich ein neuer Tensor definiert wird, müssen wir natürlich beweisen. Wir

müssen also zeigen, dass das Zahlenschema (9.39) bei einem Basiswechsel wie ein Tensor transformiert.

Wir setzen voraus, dass A und B Tensoren sind, das heißt für zwei beliebigen Basen e i und ea gilt

Aab = Λai Λbj Aij ,

B cd = Λck B kl Λld .

8

(9.40)

Wenn wir die beiden Gleichungen multiplizieren, bekommen wir

C abcd = Aab B cd = Λai Λbj Λck Aij B kl Λld = Λai Λbj Λck C ijkl Λld .

(9.41)

Das ist genau das Transformationsverhalten eines Tensors der Stufe (3, 1). Also haben wir gezeigt, dass

durch (9.39) ein solcher Tensor definiert ist, und zwar unabhängig davon, in welcher Basis wir diese

Gleichung aufschreiben. Genau wir die komponentenweise Addition ist auch die komponentenweise Multiplikation von zwei Tensoren, wenn sie auf diese Weise ausgeführt wird, unabhängig von der gewählten

Darstellung.

Wie das Tensorprodukt zu verallgemeinern ist, ist sofort offensichtlich.

Das Tensorprodukt eines Tensor der Stufe (m, n) mit einem Tensor der Stufe (p, q) ist ein

Tensor der Stufe (m + p, n + q).

Das einfachste Beispiel ist das Tensorprodukt eines Vektors z = z i ei mit einem dualen Vektor w = w i ei .

Das ist ein Tensor A = z⊗w der Stufe (1, 1), dessen Komponenten durch A ij = z i wj gegeben sind. Wenn

V der Spaltenvektorraum der Länge N , V ∗ der zugehörige Zeilenvektorraum, und ei die Standardbasis

(9.15) ist, dann lässt sich auch dieses Produkt als Matrixmultiplikation schreiben. Es gilt dann nämlich

1

z

..

z = . ,

w = w1 · · · wN ,

(9.42)

N

z

und folglich

z1

A = z ⊗ w = ...

zN

w1 · · · wN

z 1 w1 · · · z 1 wN

..

..

..

=

.

.

.

.

N

1

N

N

z w ··· z w

(9.43)

Die Matrix A wird offenbar aus allen möglichen Produkten der Komponenten von z und w gebildet.

Das Tensorprodukt ist etwas anderes als das Produkt (9.6) eines Vektors mit einem dualen Vektor, das

eine Zahl liefert. Mit dem Tensorprodukt lassen sich Tensoren höherer Stufe bilden. Man kann damit auch

eine Basis der Vektorräume V (m,n) konstruieren. Bleiben wir bei dem Beispiel von eben, und ersetzen den

Vektor z der Reihe nach durch alle Basisvektoren ei , und den dualen Vektor w der Reihe nach durch alle

dualen Basisvektoren ej . Das Tensorprodukt ei ⊗ ej wird dann durch eine Matrix dargestellt, die nur in

der i-ten Spalte und j-ten Zeile eine Eins, und sonst nur Nullen als Einträge hat. Diese Matrizen bilden

eine Basis von V (1,1) .

Das lässt sich natürlich wieder verallgemeinern. Um eine Basis von V (m,n) zu definieren, müssen wir alle

möglichen Tensorprodukte von m Basisvektoren und n dualen Basisvektoren bilden. Es gibt (dim V) m+n

Möglichkeiten, dies zu tun, und das ist auch die Dimension von V (m,n) . Ein Tensor der Stufe (m, n) hat

dann die Darstellung

k

⊗ ·{z

· · ⊗ e}l .

(9.44)

B = B i ··· jk ··· l ei ⊗ · · · ⊗ ej ⊗ e

{z

} |

|

m

n

Aufgabe 9.14 Man beweise, dass die rechte Seite von (9.44) tats ächlich unabhängig von der Basis ist,

also unter einem Basiswechsel invariant bleibt. Der so definierte Tensor B existiert also unabh ängig von

seiner Darstellung.

Die zweite Grundoperation des Tensorkalküls ist die Spurbildung oder Kontraktion. Wir betrachten noch

einmal eine lineare Abbildung A : V → V, dargestellt durch eine Matrix A ij . Die Spur der Matrix ist die

Summe über die Diagonalemente, also

sp(A) = Aii .

(9.45)

9

Die Spur ist unabhängig von der gewählten Basis. Das lässt sich leicht zeigen. Es gilt

Aaa = Λai Aij Λja = Aij δ ji = Aii .

(9.46)

Die Spur eines Tensors der Stufe (1, 1) ist ein Skalar, der nicht von der gewählten Basis abhängt.

Auch das lässt sich wieder verallgemeinern. Betrachten wir einen beliebigen Tensor A, der mindestens

einen oberen und einen unteren Index hat. Dann können wir über diese Indizes die Spur bilden und so

einen neuen Tensor B definieren. Etwas schematisch,

B ············ = A··· i ······ i··· ,

(9.47)

oder am Beispiel eines Tensors der Stufe (1, 3),

Bkl = Aikil .

(9.48)

Sobald ein Tensor mehr als einen oberen oder mehr als einen unteren Index hat, gibt es mehrere Möglichkeiten, eine Spur zu bilden. Wir sagen in diesem Fall, dass wir den ersten und den dritten Index des Tensors

A kontrahiert haben, um den Tensor B zu bilden.

Auch hier müssen wir erst nachweisen, dass durch die Kontraktion tatsächlich ein neuer Tensor definiert

wird. Der Beweis ist wieder sehr einfach und völlig analog zu (9.46). Wir müssen nur ein paar zusätzliche

Übergangsmatrizen ausschreiben. Wir führen ihn exemplarisch für den Fall (9.48). Es ist

Bcd = Aacad = Λai Aikjl Λkc Λja Λld = δ ji Aikjl Λkc Λld = Bkl Λkc Λld ,

(9.49)

was wieder dem Transformationsverhalten eines Tensors der Stufe (0, 2) entspricht. Für den allgemeine

Fall ist der Beweis genauso zu führen.

Die Kontraktion eines Tensors der Stufe (m, n) ergibt einen Tensor der Stufe (m − 1, n − 1).

Wir verstehen nun auch, warum die Summenkonvention gerade so und nicht anders formuliert ist. Der

Beweis (9.49) funktioniert nur, wenn einer der Indizes, über den summiert wird, oben steht und der andere

unten. Denn nur dann heben sich die beiden Übergangsmatrizen Λai und Λja gegenseitig weg. Würden wir

über einen doppelt oben der doppelt unten vorkommenden Index summieren, hätte das Ergebnis nicht das

richtige Transformationsverhalten, wäre also kein Tensor. Und schon gar nicht, wenn wir über einen Index

summieren würden, der nur einmal oder dreimal vorkommt.

Tatsächlich lassen sich jetzt alle Operationen, die wir mit Vektoren, dualen Vektoren oder Tensoren

höherer Stufe durchgeführt haben, auf diese zwei Grundoperationen zurückführen. So entsteht zum Beispiel das Produkt eines Vektors mit einem dualen Vektor, u · x = ui xi , durch Tensormultiplikation und

anschließende Kontraktion. Ein anderes Beispiel ist die Verkettung von zwei linearen Abbildungen A und

B zu einer Abbildung C = A ◦ B. Diese erfolgt durch Multiplikation der Matrizen, also C ik = Aij B jk .

Auch das ergibt sich aus einer Tensormultiplikation und einer Kontraktion.

Die beiden Grundoperationen können verwendet werden, um Tensoren fast beliebig zu neuen Tensoren

zu kombinieren. Auf diese Weise entsteht ein Art Baukasten. Die Bausteine sind die Tensoren. Ihre Indizes

kann man als Stecker und Buchen interpretieren. Man kann zwei Tensoren aneinander heften und das ganze

als einen zusammengesetzten Baustein betrachten. Das entspricht der Tensormultiplikation. Man kann

auch einen Stecker mit einer Buchse verbinden, und das als einen Baustein mit wenigen freien Steckern

und Buchsen betrachten. Das entspricht der Kontraktion.

Wir werden hier höchstens Tensoren zweiter Stufe benötigen, bis auf eine spezielle Ausnahme eines

Tensor dritter Stufe, den wir am Ende dieses Kapitels einführen werden. Trotzdem ist es ganz nützlich,

das allgemeine Prinzip verstanden zu haben. Das Tensorkalkül bietet eine einheitliche Sprache, in der

sich fast alle Aussagen der linearen Algebra formulieren lassen. Wir wollen das im folgenden anhand von

ein paar Beispielen zeigen, und dabei auch den Anschluss an das herstellen, was wir im Teil I über die

Strukturen des physikalischen Raumes gesagt haben.

10

Aufgabe 9.15 Mit der Interpretation eines Tensors als multilineare Abbildung aus Aufgabe 9.13 l ässt sich

das Tensorprodukt auch ohne Rückgriff auf eine Basis definieren. Im hier gezeigten Beispiel (9.39) sind

die Tensoren bilineare Abbildungen A : V ∗ × V ∗ → R und B : V ∗ × V → R. Man zeige, dass der Tensor

C = A ⊗ B durch die folgende multilineare Abbildung gegeben ist,

C:

V ∗ × V ∗ × V ∗ × V → R,

C(u, v, w, x) = A(u, v) B(w, x).

(9.50)

Aufgabe 9.16 Es sei ei eine beliebige Basis von V und ei die zugehörige duale Basis von V ∗ . Man zeige,

dass der Kronecker-Tensor δ aus Aufgabe 9.10 durch δ = e i ⊗ ei dargestellt werden kann.

Die Metrik

Wir betrachten jetzt einen Vektorraum V, auf dem eine Metrik, also ein Skalarprodukt V ×V → R definiert

ist. Um es von dem Produkt (9.6) zu unterscheiden, für das wir den Punkt verwenden, bezeichen wir das

Skalarprodukt von zwei Vektoren x, y ∈ V zunächst mit g(x, y).

Die Axiome für einen metrischen Vektorraum verlangen, dass das Skalarprodukt symmetrisch und bilinear ist. Daraus folgt mit x = xi ei und y = y i ei

g(x, y) = g(xi ei , y i ei ) = g(ei , ej ) xi y j = gij xi y j ,

(9.51)

wobei gij eine symmetrische N ×N -Matrix ist. Tatsächlich handelt es sich dabei, wie man aus der Indexstellung abliest, um einen Tensor der Stufe (0, 2). Es gilt nämlich beim Übergang von der Basis ei zu einer

neuen Basis ea

gab = g(ea , eb ) = g(ei Λia , ej Λjb ) = g(ei , ej ) Λia Λjb = gij Λia Λjb .

(9.52)

Das ist das Transformationsverhalten, das einen Tensor der Stufe (0, 2) definiert. Wir nennen einen Tensor

symmetrisch, wenn das Zahlenschema unter Vertauschung von zwei Indizes invariant ist, also

gij = gji .

(9.53)

Außerdem müssen wir noch verlangen, dass die Metrik positiv ist. Für alle x ∈ V gilt

g(x, x) ≥ 0,

g(x, x) = 0

⇒

x = 0.

(9.54)

⇒

xi = 0.

(9.55)

Das ist eine weitere Forderung an die Matrix gij , nämlich

gij xi xj ≥ 0,

gij xi xj = 0

Zusammenfassend können wir sagen:

Eine Metrik ist ein positiver, symmetrischer Tensor der Stufe (0, 2).

Mit einer Metrik auf V ist auch eine Metrik auf V ∗ definiert. Aus der Positivität der Matrix gij folgt

nämlich, dass sie invertierbar ist. Es existiert also eine ebenfalls symmetrische, inverse Matrix, die wir mit

g ij bezeichnen, so dass

g ij gjk = δ ik ⇔ gij g jk = δi k .

(9.56)

Diese inverse Matrix ist die Darstellung eines Tensors der Stufe (2, 0). Das müssen wir jetzt gar nicht

mehr anhand der Transformationseigenschaften beweisen, sondern das können wir unmittelbar aus den

Gleichungen (9.56) ablesen.

Dazu argumentieren wir wie folgt. Zuerst wählen wir irgendeine Basis, und definieren einen Tensor

g ij , dessen Komponenten in dieser Basis die Gleichungen (9.56) erfüllen. Dann transformieren wir diesen

11

Tensor in eine beliebige andere Basis. Von der jeweils rechten Seite der Gleichung wissen wir, dass sich

δ ik wie ein Tensor transformiert. Also steht dort auch in jeder anderen Basis das Kronecker-Symbol.

Auf der linken Seite wissen wir, dass sowohl g ij als auch gjk die Darstellungen von Tensoren sind. Außerdem wissen wir, dass wir Tensoren multiplizieren und kontrahieren dürfen, und dass sich das Ergebnis

dieser Operation wieder wir ein Tensor verhält. Wir schließen daraus, dass die Gleichung, so wie sie dort

steht, in jeder Darstellung, als für jeder Wahl der Basis gilt. Wir hätten genauso gut eine andere Basis

wählen können, um die inverse Metrik als Tensor zu definieren.

Das ist eine ganz wesentliche Eigenschaft der Tensorkalküls. Wir können es einer Gleichung, die eine

Beziehung zwischen Tensoren herstellt, allein an ihre Form ansehen, dass sie in in jeder Basis, also für

jede Darstellung der Tensoren gilt. Die Voraussetzung dafür ist, dass auf beiden seiten der Gleichung die

gleichen freien Indizes erscheinen, also die, für die wir noch Werte einsetzen können. Das sind hier die

Indizes i und k. Und alle Indizes, über die summiert wird, müssen genau einmal oben und einmal unten

stehen. Das ist hier der Index j.

Mit Hilfe der inversen Metrik können wir nun das Skalarprodukt von zwei dualen Vektoren u = u i ei

und v = vi ei bilden. Wir setzen dazu g(ei , ej ) = g ij , so dass

g(u, v) = g(ui ei , vi ei ) = g(ei , ej ) ui vj = g ij ui vj .

(9.57)

Tatsächlich können wir sogar noch einen Schritt weiter gehen. Die Tensoren g ij und g ij lassen nämlich

noch eine andere Interpretation zu. Sie lassen sich als lineare Abbildungen V → V ∗ , bzw. V ∗ → V

auffassen. Wir ordnen einem Vektor x = xi ei ∈ V umkehrbar eindeutig einen dualen Vektor x∗ =

x∗i ei ∈ V ∗ zu, indem wir

(9.58)

x∗i = gij xj ⇔ xi = g ij x∗j

setzen. Wenn wir den dualen Vektor x∗ als lineare Abbildung V → R auffassen, dann lässt sich diese mit

den Worten “bilde das Skalarprodukt mit x” anschaulich beschreiben. In einem metrischen Vektorraum

entspricht also jedem Vektor eindeutig eine solche lineare Abbildung, und umgekehrt kann jede lineare

Abbildung V → R, also jeder duale Vektor, eindeutig als Skalarprodukt mit einen Vektor dargestellt

werden.

Es ist daher sinnvoll, die Räume V und V ∗ miteinander zu identifizieren, indem man den Vektor x mit

dem dualen Vektor x∗ gleich setzt. Der Punkt bekommt dann auch wieder seine Bedeutung als Skalarprodukt, denn nun ist

g(x, y) = x∗ · y = x · y.

(9.59)

Eine weitere Konsequenz ist, dass nun auch die Komponenten x i = x∗i und xi Darstellungen desselben

Vektors sind, nämlich

x = x i ei = x i ei ∈ V = V ∗ .

(9.60)

Für die Beziehungen zwischen den Komponenten xi und xi bzw. den Basisvektoren ei und ei finden wir

xi = g ij xj ,

xi = gij xj ,

ei = gij ej ,

ei = g ij ej .

(9.61)

Wir können einen Vektor also wahlweise durch seine “oberen” oder “unteren” Komponenten darstellen,

indem wir ihn entweder als Linearkombination der Basisvektoren, oder der dualen Basisvektoren schreiben. Die beiden Darstellungen transformieren bei einem Basiswechsel noch immer verschieden, aber sie

repräsentieren beide dasselbe Objekt, nämlich den Vektor x.

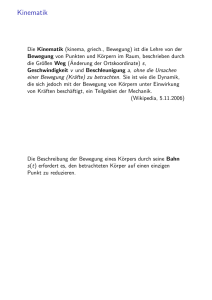

Diese etwas verwirrende Tatsache lässt sich, wie fast alles in einem metrischen Vektorraum, geometrisch

veranschaulichen. Am Beispiel eines zweidimensionalen Vektorraumes wird dies in Abbildung 9.1(a) gezeigt. Dort ist zunächst eine Basis (e1 , e2 ) eingezeichnet. Der Vektor x kann in dieser Basis als Linearkombination x = x1 e1 + x2 e2 dargestellt werden. Die entsprechenden Komponenten (x1 , x2 ) können an

den Achsen, die von den Basisvektoren aufgespannt werden, abgelesen werden.

12

(c)

(d)

x2

x2

x2

e2

e2

x

x

e2

e1

x1

x1 e1

e1

x1

(b)

(a)

Abbildung 9.1: In einem metrischen Vektorraum V gibt es zu jeder Basis e i von V eine duale Basis ei ,

die ebenfalls eine Basis von V ist (a). Nur eine Orthonormalbasis (b) ist zu sich selbst dual.

Die duale Basis (e1 , e2 ) ist eindeutig durch die Forderung ei · ej = δ ij festgelegt. Dies ist jetzt eine

Forderung an die Skalarprodukte der Basisvektoren mit den dualen Basisvektoren. Der Vektor e 1 steht

auf e2 senkrecht, und sein Betrag wird dadurch bestimmt, dass das Skalarprodukt mit e 1 gleich Eins ist.

Entsprechend ist der Vektor e2 festgelegt.

Stellt man nun denselben Vektor als Linearkombination x = x1 e1 + x2 e2 dar, so liest man die entsprechenden Komponenten (x1 , x2 ) an den gestrichelten Achsen ab, die von den dualen Basisvektoren

aufgespannt werden. Sie sind im allgemeinen von der Komponenten (x 1 , x2 ) desselben Vektors verschieden, und sie transformieren auch bei einem Basiswechsel anders.

Es gibt allerdings den Spezialfall, in dem die Basis mit der dualen Basis identisch ist. Aus (9.61) entnehmen wir, dass dies genau dann der Fall ist, wenn gij = δij , und folglich auch g ij = δ ij ist, die Metrik

also durch die Einheitsmatrix gegeben ist. Das ist allerdings keine Forderung an die Metrik, sondern an

die Basis. Eine Basis mit dieser Eigenschaft heißt Orthonormalbasis.

Wir können die wesentlichen Eigenschaften eines metrischen Vektorraumes wie folgt zusammenfassen:

Ein metrischer Vektorraum ist mit seinem Dualraum identisch. Eine Orthonormalbasis ist

mit ihrer dualen Basis identisch.

Wenn wir eine Orthonormalbasis verwenden, dann müssen wir nicht mehr zwischen oberen und unteren

Indizes unterscheiden. Wir können, wie in Abbildung 9.1(b) gezeigt, alle Indizes nach unten schreiben

und einen Vektor einfach als Linearkombination x = xi ei darstellen, wobei wir die Summenkonvention

entsprechend abändern. So hatten wir sie ja auch ursprünglich eingeführt. Der Grund dafür ist, dass in

(9.61) überall das Kronecker-Symbol steht, so dass alle Größen mit oberen Indizes zu den entsprechenden

Größen mit unteren Indizes gleichgesetzt werden.

Das geht natürlich nur dann, wenn wir uns darauf einigen, nur Orthonormalbasen zu verwenden. Das

ist aber, wie wir später sehen werden, nicht immer sinnvoll. Deshalb werden wir auch in einem metrischen

Vektorraum die Unterscheidung zwischen einer Basis und der dazugehörigen dualen Basis nicht aufgeben.

Folglich müssen wir auch weiterhin zwischen oberen und unteren Indizes unterscheiden. Es gibt aber eine

einfache Regel, sie ineinander umzurechnen, nämlich die Formeln (9.61).

Um einen oberen Index in einen unteren zu verwandeln, müssen wir nur das jeweilige Objekt mit der

Metrik multiplizieren und die Spur über den betreffenden Index bilden. Wir sagen auch, dass wir einen

13

Index mit Hilfe der Metrik “nach unten ziehen”. Entsprechend können wir den Index mit der inversen

Metrik wieder “nach oben ziehen”. Laut (9.61) gilt diese Regel sowohl für die Komponenten von Vektoren,

als auch für die Basisvektoren selbst.

Sie lässt sich auf beliebige Tensoren verallgemeinern. Da wir in einem metrischen Vektorraum nicht

zwischen Vektoren und dualen Vektoren unterscheiden müssen, müssen wir auch nicht zwischen Tensoren

der Stufen (m, n) und (p, q) unterscheiden, falls m + n = p + q ist, falls also beide Tensoren insgesamt

gleich viele Indizes haben. Mit Hilfe der Metrik können wir zum Beispiel einen Tensor der Stufe (0, 2)

mit einem Tensor der Stufe (2, 0) identifizieren, indem wir

Bij = gik gjl B kl

⇔

B ij = g ik g jl Bkl

(9.62)

setzen, und dann beides als Darstellungen desselben Tensors zweiter Stufe B interpretieren, so wie wir x i

und xi als Darstellungen desselben Vektors x betrachten können. In einem metrischen Raum können wir

einfach von einem Tensor der Stufe m sprechen, wenn es sich um ein Objekt mit m Indizes handelt. Er

besitzt jedoch verschiedene Darstellungen, die bei einem Basiswechsel verschieden transformieren.

Aufgabe 9.17 Warum ist eine positive Matrix immer invertierbar?

Aufgabe 9.18 Wenn V der Spaltenvektorraum der Länge N ist, V ∗ der entsprechende Zeilenvektorraum,

und die Metrik auf V durch die Summe über der Produkte der Einträge gegeben ist, also das StandardSkalarprodukt auf dem RN , wie sieht dann die Abbildung V → V ∗ : x → x∗ aus? Mit anderen Worten,

welcher Spaltenvektor wird mit welchem Zeilenvektor identifiziert, wenn man V = V ∗ setzt?

Aufgabe 9.19 Für einen speziellen Tensor hatten wir bereits eine Version mit zwei oberen und eine Version

mit zwei unteren Indizes definiert, nämlich für die Metrik g, die einmal durch die Matrix gij und einmal

durch die inverse Matrix g ij dargestellt wird. Ist das mit (9.62) konsistent? Mit anderen Worten, gilt diese

Gleichung auch, wenn wir dort Bij = gij und B ij = g ij setzen?

Aufgabe 9.20 Auf dem dreidimensionalen Vektorraum aus Aufgabe 9.5 sei eine Metrik durch ihre Komponenten g11 = g22 = g33 = 1 und g12 = g23 = g31 = 0 bezüglich der Basis (e1 , e2 , e3 ) definiert. Man

bestimmte die Komponenten bezüglich der Basis (ex , ey , ez ).

Die orthogonale Gruppe

Da Orthonormalbasen in der Physik eine wichtige Rolle spielen, wollen wir uns kurz mit den Besonderheiten befassen, die beim Übergang zwischen zwei solchen Basen auftreten. Es sei also ei eine Orthonormalbasis und ea eine andere Orthonormalbasis. Da in diesem Fall beide Basen mit ihren jeweiligen dualen

Basen übereinstimmen, können wir in diesem Abschnitt alle Indizes nach unten schreiben.

Das gilt auch für die Übergangsmatrizen, so dass der Zusammenhang zwischen den Basen durch

ea = ei Λia

⇔

ei = ea Λai

(9.63)

gegeben ist. Das ergibt sich aus (9.18), wenn wir dort einfach alle Indizes nach unten schreiben. Die

Übergangsmatrizen Λia und Λai sind natürlich wieder zueinander invers, also

Λia Λaj = δij ,

⇔

Λai Λib = δab .

(9.64)

Sie können aber nicht beliebig gewählt werden. Aus der Forderung, dass mit e i auch ea eine Orthonormalbasis ist, ergibt sich folgende Bedingung an die Übergangsmatrizen,

ea · eb = (ei Λia ) · (ej Λjb ) = (ei · ej ) Λia Λjb = δij Λia Λjb = Λia Λib = δab .

14

(9.65)

Nur, wenn die Übergangsmatrix die letzte Gleichung erfüllt, bildet sie eine Orthonormalbasis wieder auf

eine Orthonormalbasis ab. Wenn man die Basen ei und ea vertauscht, findet man natürlich dieselbe Bedingung für die inverse Matrix, also

Λia Λib = δab

⇔

Λai Λbj = δij .

(9.66)

Eine Matrix mit dieser Eigenschaft heißt orthogonale Matrix. Um das in der üblichen Matrixnotation

aufzuschreiben, schreiben wir für die Übergangsmatrizen

Λ = Λai ,

Λ−1 = Λia ,

(9.67)

wobei der erste Index als Zeilenindex, der zweite als Spaltenindex zu lesen ist. Die zweite Gleichung in

(9.66) lautet dann

Λ Λ> = I ⇔ Λ> = Λ−1 ,

(9.68)

wobei I die N ×N -Einheitsmatrix ist, die durch das Kronecker-Symbol dargestellt wird, und Λ > die

transponierte Matrix ist, die durch das Vertauschen von Zeilen und Spalten entsteht. Die erste Gleichung

in (9.66) ist dazu äquivalent und macht dieselbe Aussage über die inverse Matrix Λ −1 .

Eine orthogonale Matrix Λ hat also die Eigenschaft, dass sie zu ihrer transponierten Matrix Λ > invers

ist. Die Menge aller dieser Matrizen bildet eine Gruppe, die man mit O(N ) bezeichnet und orthogonale

Gruppe der Dimension N nennt.

Aufgabe 9.21 Man beweise das. Zu zeigen ist dazu, dass die Einheitsmatrix orthogonal ist, also I ∈

O(N ), dass mit jeder Matrix Λ ∈ O(N ) auch die inverse Matrix Λ−1 ∈ O(N ) orthogonal ist, und dass

mit je zwei orthogonalen Matrizen Λ1 , Λ2 ∈ O(N ) auch das Produkt Λ1 Λ2 ∈ O(N ) orthogonal ist.

Wir können hier nicht die gesamte Theorie der orthogonalen Gruppe erarbeiten, wollen aber kurz die

wichtigsten Eigenschaften zusammenstellen. Diese lassen sich bereits an der Gruppe O(2) ablesen, also

der Gruppe aller orthogonalen Transformation in einem zweidimensionalen Vektorraum. Wir setzen

a b

a c

>

Λ=

⇒ Λ =

.

(9.69)

c d

b d

Die Bedingung (9.68) lautet in diesem Fall

2

a b

a c

a + b2 a c + b d

1 0

>

ΛΛ = I ⇔

=

.

c d

b d

a c + b d c 2 + d2

0 1

(9.70)

Komponentenweise ausgeschrieben,

a2 + b2 = 1,

c2 + d2 = 1,

a c + b d = 0.

(9.71)

Die ersten beiden Gleichungen lassen sich durch den Ansatz a = cos α, b = sin α, c = sin β und d = cos β

lösen. Die dritte Gleichung lautet dann

cos α sin β + sin α cos β = sin(α + β) = 0,

also α + β = 0 oder α + β = π. Eingesetzt ergibt das

cos α sin α

Λ = D(α) =

oder

− sin α cos α

15

Λ = S(α) =

cos α

sin α

sin α − cos α

(9.72)

.

(9.73)

replacements

(c)

(d)

ey

ey

eu

eu

α

α

ex

ex

ev

ev

(b)

(a)

Abbildung 9.2: In einem zweidimensionalen metrischen Vektorraum gibt es orthogonale Basistransformationen ohne (a) und mit (b) Spiegelung. Beide werden durch einen Winkel α parametrisiert.

Die erste Übergangsmatrix beschreibt eine Drehung der Basis um den Winkel α. Wählen wir als Indexmenge a ∈ {u, v} und i ∈ {x, y}, so lautet die explizite Transformation der Basisvektoren

eu = cos α ex + sin α ey ,

ev = − sin α ex + cos α ey .

(9.74)

Die zweite Möglichkeit in (9.73) entspricht einer Drehung mit anschließender Spiegelung,

eu = cos α ex + sin α ey ,

ev = sin α ex − cos α ey .

(9.75)

Es gibt also zwei Arten von orthogonalen Basistransformationen, nämlich solche, die die Orientierung der

Basis erhalten und solche, die sie umkehren.

Das gilt in jeder Dimension, wobei sich anhand der Determinante der Übergangsmatrix entscheiden

lässt, ob die Orientierung erhalten bleibt oder nicht. Aus (9.68) folgt nämlich

det(Λ Λ> ) = det(Λ) det(Λ> ) = det(Λ)2 = det(I) = 1

⇒

det(Λ) = ±1.

(9.76)

Hier haben wir benutzt, dass die Determinante des Produktes von zwei Matrizen das Produkt der Determinante ist, und dass die Determinante einer Matrix beim Transponieren erhalten bleibt.

Die Determinante einer orthogonalen Matrix ist also entweder +1 oder −1, wobei der positive Werte

einer Drehung der Basis ohne Spiegelung, ein negativer Wert einer Drehung der Basis mit Spiegelung

entspricht. Die Teilmenge von O(N ), die die Drehungen ohne Spiegelung enthält, bildet eine Untergruppe,

die spezielle orthogonale Gruppe SO(N ). Sie besteht aus allen orthogonalen Basistransformationen, bei

denen die Orientierung der Basis erhalten bleibt.

In der Physik ist natürlich die orthogonale Gruppe O(3) von besonderer Bedeutung. Wir werden auf sie

später noch ausführlicher eingehen. Im Prinzip gilt für sie aber dasselbe wir für O(N ) im allgemeinen.

Sie zerfällt in zwei Teilmengen, wobei die Untergruppe SO(3) die Drehgruppe ist, also alle möglichen

Drehungen der Basis enthält, aber keine Spiegelungen.

Aufgabe 9.22 Warum bilden die orthogonalen Basistransformationen ohne Spiegelung eine Untergruppe

der orthogonalen Gruppe, die Transformationen mit Spiegelung aber nicht?

Aufgabe 9.23 Man beweise, dass alle Einträge einer orthogonalen Matrix vom Betrag kleiner oder gleich

Eins sind.

16

Aufgabe 9.24 Man berechne für die Matrizen aus (9.73) die Produkte D(α) D(β), D(α) S(β),

S(α) D(β) und S(α) S(β).

Aufgabe 9.25 Wie lauten die explizit ausgeschriebenen Bedingungen (9.68) an die Eintr äge einer Matrix

U ∈ O(3)? Wie viele unabhängige Gleichungen ergeben sich, und wie viele unabhängige Parameter

bleiben übrig?

Das Kreuz- und Spatprodukt

Bei der Diskussion der Geometrie des dreidimensionalen Euklidischen Raumes hatten wir noch zwei andere Produkte von Vektoren eingeführt, nämlich das Kreuzprodukt und das Spatprodukt. Wir wollen nun

zeigen, dass auch sie eine recht einfach Darstellung als Tensoren haben.

Dazu sei V von nun an ein dreidimensionaler, metrischer Vektorraum, und e a eine Orthonormalbasis.

Für die Metrik gilt also gab = δab und g ab = δ ab . Wir definieren dann einen Tensor ω dritter Stufe, der

bezüglich dieser Basis die Komponenten

ω abc = εabc

bzw. ωabc = εabc

(9.77)

haben soll, wobei εabc bzw. εabc das Levi-Civita-Symbol ist, welches wir in (2.27) definiert hatten. Es ist

gleich +1, wenn die Indizes {a, b, c} eine gerade Permutation der vorgegebenen Indexmenge bilden, −1,

wenn sie eine ungerade Permutation bilden, und 0, wenn mindestens zwei der Indizes den gleichen Wert

annehmen. Insbesondere ist der so definierte Tensor ω total antisymmetrisch. Er ändert sein Vorzeichen

bei jeder Vertauschung von zwei Indizes,

ωabc = ωbca = ωcab = −ωacb = −ωbac = −ωcba .

(9.78)

Da wir uns in einem metrischen Vektorraum befinden, können wir Indizes wahlweise nach oben oder nach

unten schreiben. Die beiden Darstellungen (9.77) repräsentieren denselben Tensor ω, und (9.78) gilt entsprechend mit oberen Indizes. Da wir zudem eine Orthonormalbasis verwenden, sind beide Darstellungen

sogar gleich.

Eine wichtige Frage ist nun, wie die Darstellungen des Tensors ω in anderen Basen aussehen. Dazu

sei ei irgendeine andere Basis, die nicht unbedingt eine Orthonormalbasis sein muss. Dann können wir

die Komponenten ω ijk des Tensor ω in dieser Basis mit Hilfe des allgemeinen Transformationsgesetzes

ausrechnen. Es gilt

ω ijk = Λia Λjb Λkc ω abc .

(9.79)

Natürlich ist der Term auf der rechten Seite wieder total antisymmetrisch, das heißt er ändert sein Vorzeichen bei jeder Vertauschung von zwei Indizes. Er ist daher bis auf eine Konstante bestimmt und proportional zum Levi-Civita-Symbol εijk . Wir müssen nur noch die Konstante finden.

Aufgabe 9.26 Warum ist jeder total antisymmetrische Ausdruck mit drei Indizes in einem dreidimensionalen Vektorraum proportional zum Levi-Civita-Symbol?

Um die Konstante zu finden, setzen wir den Ansatz ω ijk = c εijk in (9.79) ein und drücken die Komponenten ω abc durch (9.77) aus,

c εijk = Λia Λjb Λkc εabc .

(9.80)

Für eine fest gewählte Permutation der Zeilenindizes {i, j, k} der Übergangsmatrizen wird auf der rechten

Seite über alle Permutationen der Spaltenindizes {a, b, c} summiert. Dabei werden jeweils Produkte von

drei Matrixelementen gebildet, von denen nie zwei in einer Zeile oder zwei in einer Spalte stehen. Anschließend wird das Produkt mit einem Vorzeichen versehen, welches davon abhängt, ob die Permutation

der Spaltenindizes {a, b, c} gerade oder ungerade ist.

17

Das ist die Definition der Determinante einer Matrix. Die Zahl c ist demnach die Determinante der

Übergangsmatrix Λia , und es gilt

ω ijk = det(Λia ) εijk ,

ωijk = det(Λai ) εijk .

(9.81)

Die zweite Gleichung für die Darstellung mit unteren Indizes folgt dabei aus der analogen Überlegung, bei

der wir die Darstellung mit unteren Indizes transformieren. Es tritt dabei die inverse Transformationsmatrix

auf, und daher auch deren Determinante.

Daraus können wir unmittelbar folgenden Schluss ziehen. Wenn wir die Basis e a , von der wir ausgegangen sind, als positiv orientiert definieren, dann hat die Tensor ω in jeder positiv orientierten Orthonormalbasis ei die Darstellung

ω ijk = εijk bzw. ωijk = εijk .

(9.82)

Die Basis ea , von der wir ausgegangen sind, ist also in keiner Weise speziell. Wir hätten jede andere

Orthonormalbasis mit der gleichen Orientierung als Ausgangspunkt nehmen können, um den Tensor ω

durch (9.77) zu definieren.

Wir finden aber, dass der Tensor ω in einer negativ orientierten Orthonormalbasis e i eine andere Darstellung hat, nämlich

ω ijk = −εijk bzw. ωijk = −εijk .

(9.83)

Damit können wir das, was wir weiter oben über Orthonormalbasen gesagt haben, wie folgt ergänzen

In einer positiv orientierten Orthonormalbasis gilt gij = δij und ωijk = εijk .

In einer negativ orientierten Orthonormalbasis gilt gij = δij und ωijk = −εijk .

Und wie verhält es sich mit einer Basis ei , die keine Orthonormalbasis ist? In diesem Fall gibt es einen

sehr eleganten Trick, mit dem man den Tensor ω darstellen kann, ohne die Übergangsmatrizen explizit

benutzen zu müssen. Wir betrachten dazu eine andere Determinante, nämlich die der Matrix g ij . Wir

können diese wie folgt definieren,

g = det(gij ) =

1 ikm jln

ε ε gij gkl gmn .

6

(9.84)

Wenn man hier die Summen über die Indizes {j, l, n} explizit ausschreibt, ergeben sich wieder die Summen über alle Permutationen von Zeilen- und Spaltenindizes der Matrix g ij , wobei immer nur solche

Matrixelemente multipliziert werden, die nicht zusammen in einer Zeile oder einer Spalte stehen. Der

Faktor 6 tritt auf, weil wir anschließend auch noch über die Indizes {i, k, m} summieren.

Die Determinante g der Metrik ist kein Skalar, denn die Levi-Civita-Symbole zu verschiedenen Basen

sind nicht verschiedene Darstellungen eines Tensor. Genau das haben wir ja gerade widerlegt. Wir können

aber nun den folgenden Ausdruck bilden,

1 ikm jln

ω ω gij gkl gmn = 1.

6

(9.85)

In diesem Fall ist die linke Seite ein Skalar, denn sie entsteht durch Multiplikation und Kontraktion aus

Tensoren. Sie hat folglich in jeder Basis denselben Wert. In einer Orthonormalbasis ergibt sich der Wert 1,

folglich ist dies der Wert in jeder Basis. Durch Vergleich von dieser Gleichung mit (9.84) ergibt sich nun

1

ω ijk = ± √ εijk ,

g

√

bzw. ωijk = ± g εijk .

(9.86)

Der zweite Ausdruck folgt wieder aus einer analogen Überlegung für die Darstellung mit unteren Indizes.

Nur das Vorzeichen bleibt unbestimmt. Es hängt auch hier wieder von der Orientierung der Basis ab, das

18

heißt darüber entscheidet die Determinante der Übergangsmatrix. Wir müssen irgendeine Basis auswählen

und diese als positiv orientiert definieren, dann gilt in dieser und in allen anderen Basen mit der gleichen

Orientierung das positive Vorzeichen, in allen anderen das negative. Für den Spezialfall einer Orthonormalbasis stimmt dies natürlich mit dem Ergebnis von oben überein, denn dann ist g ij = δij , uns somit die

Determinante g = 1.

Für den Tensor ω führen wir die Bezeichnung antisymmetrischer Einheitstensor ein. Seine Definition

lässt sich leicht auf einen N -dimensionalen metrischen Vektorraum verallgemeinern, und es gelten die

gleichen Darstellungen, wenn man entsprechend ein Levi-Civita-Symbol mit N Indizes einführt. Voraussetzung für für die Existenz dieses Tensors ist allerdings eine Metrik, denn sonst gibt es keine ausgezeichneten Basen, nämlich die Orthonormalbasis, die wir zur Definition verwendet haben.

In jedem metrischen Vektorraum gibt es einen bis auf das Vorzeichen eindeutig definierten

antisymmetrischen Einheitstensor.

Nun können wir die Definition des Kreuz- und Spatproduktes reproduzieren und als Tensoroperationen

darstellen. Hier ist sogar das Spatprodukt das einfachere. Es ist diejenige Abbildung, die durch den Tensor

ω in Sinne der Aufgabe 9.13 definiert wird, nämlich

√

ω(x, y, z) = ωijk xi y j z k = ± g εijk xi y j z k .

(9.87)

Das Vorzeichen ist durch die Orientierung der Basis festgelegt, und für eine positiv orientierte Orthonormalbasis gilt offenbar der bekannte Ausdruck εijk xi yj zk , wenn wir alle Indizes nach unten schreiben.

Wir können nun aber auch das Spatprodukt in jeder anderen Basis berechnen. Eine sehr praktische Anwendung dafür wird sich im nächsten Kapitel ergeben, wenn wir Integrationen ausführen. Wir können

damit nämlich das Volumen eines Spates ausrechnen, ohne dazu auf eine Orthonormalbasis zurückgreifen

zu müssen.

Das Kreuzprodukt ist nun ebenfalls leicht darzustellen. Wir setzen

√

x × y = ωijk xi y j ek = ± g εijk xi y j ek .

(9.88)

Auch hier ergibt sich in einer positiv orientierten Orthonormalbasis wieder der bekannte Ausdruck

εijk xi yj ek , wenn wir alle Indizes nach unten schreiben. Man beachte jedoch, dass in (9.88) der duale Basisvektor ek steht, so dass, wenn wir die Vektoren x und y einer bestimmten Basis darstellen, das

Kreuzprodukt x × y zunächst in der dualen Basis dargestellt wird. Aber wir können dies natürlich mit

Hilfe der Metrik umrechnen. In Komponenten ausgeschrieben gilt

x×y =z

⇔

z i = g ij ωjkl xk y l .

(9.89)

Das Kreuzprodukt wird also genau genommen durch eine Kombination des antisymmetrischen Einheitstensor mit der Metrik gebildet.

Aufgabe 9.27 Man zeige, dass das hier definierte Kreuzprodukt alle bekannten Eigenschaften hat. Es ist

antisymmetrisch und das Produkt von zwei Vektoren steht auf beiden senkrecht. Außerdem gilt in einer

positiv orientierten Orthonormalbasis ei × ej = εijk ek .

Aufgabe 9.28 Man zeige, dass mit den hier vorgenommenen Definitionen f ür das Spatprodukt

η(x, y, z) = (x × y) · z gilt.

Aufgabe 9.29 Man leite die jeweils zweite Gleichung in (9.86) und (9.81) her.

19

Aufgabe 9.30 Da die beiden Ausdrücke in (9.86) zwei Darstellungen desselben Tensors in einem metrischen Vektorraum sind, sollte es möglich sein, die eine aus der anderen durch Hoch- bzw. Runterziehen

der Indizes zu bekommen. Man bestätige dies, also

ωikm = gij gkl gmn ω ilm .

(9.90)

Aufgabe 9.31 Die drei Basisvektoren ei eine dreidimensionalen metrischen Vektorraums spannen, wenn

sie keine Orthonormalbasis bilden, keinen Würfel, sondern einen Spat auf. Wie groß ist das Volumen dieses

Spates?

Aufgabe 9.32 Es sei V ein nicht notwendigerweise metrischer, dreidimensionaler Vektorraum. Man zeige,

dass durch

Ωijk lmn = εikm εjlm

(9.91)

ein invarianter Tensor Ω der Stufe (3, 3) definiert wird, und dass folglich f ür jeden Tensor A der Stufe

(1, 1) die Größe

1

(9.92)

det(A) = εikm εjlk Aij Akl Amn

6

ein Skalar ist, und zwar die Determinante der Matrix Aij . Was ist der wesentliche Unterschied zwischen

dieser Definition einer Determinante und der Determinante der Metrik (9.84)? Warum handelt es sich dort

nicht um einen Skalar? Gibt es eine alternative Definition von Ω, die explizit deutlich macht, dass es sich

um einen Tensor handelt?

20

10 Tensorfelder

Im letzten Kapitel haben wir Tensoren nur im Zusammenhang mit Vektorräumen diskutiert. In physikalischen Theorien tauchen Tensoren aber meistens in Form Tensorfelder auf, zum Beispiel als Kraftfelder auf

dem physikalischen Raum. Unter einem Feld verstehen wir eine Abbildung, die jedem Punkt des Raumes

eine Zahl, einen Vektor, oder eben einen Tensor bestimmter Stufe zuordnet. In diesem Kapitel wollen wir

uns mit der Darstellung von solchen Feldern in verschiedenen Koordinatensystemen beschäftigen.

Insbesondere geht es darum, das Transformationsverhalten von Tensorfeldern bei Koordinatentransformationen zu verstehen, das wir im letzten Kapitel anhand von Basistransformationen in Vektorräumen

diskutiert haben. In physikalischen Anwendungen müssen wir oft spezielle Koordinatensysteme wählen,

die dem gestellten Problem angepasst sind, um überhaupt einer Lösung näher zu kommen. Zum Beispiel

konnten wir das Kepler-Problem, also die Bewegungsgleichung für einen Planeten im Sonnensystem, erst

durch den Übergang zu Kugelkoordinaten lösen.

Kugelkoordinaten sind krummlinige Koordinaten. Das bereitete ein paar Schwierigkeiten, da wir, bevor

wir die Bewegungsgleichungen explizit aufstellen konnten, erst einmal Größen wir Geschwindigkeit und

Beschleunigung in solchen Koordinaten darstellen mussten. Um solche Rechnungen nicht für jedes neue

Koordinatensystem noch einmal durchführen zu müssen, wollen wir hier eine Art Rezeptsammlung für

den Umgang krummlinigen Koordinatensystem bereitstellen. Das Tensorkalkül ist dafür die geeignete

Sprache.

Wir werden zuerst nur affine Koordinatensystem betrachten und zeigen, dass sich das Transformationsverhalten von Tensorfeldern in solchen Koordinatensystem unmittelbar auf das Transformationsverhalten

beim Basiswechsel zurückführen lässt. Anschließend werden wir dies verallgemeinern und zeigen, dass in

krummlinigen Koordinatensystemen ein ganz ähnliches Verhalten gilt. Schwierigkeiten mach dort nur das

Ableiten, so dass wir dazu eine spezielle kovariante Ableitung einführen müssen.

Mit ihr werden wir in der Lage sein, viele der Ergebnisse, zu denen wir früher erst nach mühsamen

Rechnungen gekommen sind, durch sehr einfaches Einsetzen von nur ein paar wenigen zu bestimmenden

Größen zu reproduzieren. Dazu gehören zum Beispiel die Ausdrücke für Geschwindigkeit und Beschleunigung in Kugelkoordinaten, oder auch die für den Laplace-Operator oder die Divergenz oder Rotation

eines Vektorfeldes in verschiedenen krummlinigen Koordinatensystemen.

Vektoren und duale Vektoren

Wir erinnern uns, dass ein affiner Raum E eine Menge von Punkten ist, der ein Vektorraum V zugeordnet

ist, so dass zu je zwei Punkten ein Abstandsvektor existiert. Um die Notation etwas besser an die aus

dem letzten Kapitel anzupassen, bezeichnen wir die Punkte jetzt auch mit fett gedruckten Buchstaben

a, b, . . . ∈ E. Außerdem schreiben wir für den Abstandsvektor, der von a ∈ E nach b ∈ E zeigt, einfach

b − a ∈ V.

Obwohl es sich dabei nicht wirklich um das Bilden einer Differenz handelt, ist die Notation sehr naheliegend. Entsprechend können wir den Punkt, der aus a ∈ E durch Verschiebung um einen Vektor v ∈ V

entsteht, mit a + v ∈ E bezeichnen. Es gilt dann zum Beispiel a + (b − a) = b, und es gelten auch sonst

die üblichen Rechenregeln wie bei der gewöhnlichen Addition und Subtraktion von Vektoren. Wir müssen

nur darauf achten, dass wir nicht zwei Punkte addieren können, und dass wir Punkte nicht mit Zahlen

multiplizieren können. Für a, b ∈ E und s ∈ R ergeben die Ausdrücke a + b oder s a keinen Sinn.

Wir ersetzen außerdem das Symbol V für den zugeordneten Vektorraum durch die Bezeichnung TE, was

soviel bedeutet wie Tangentenraum von E. Die Bezeichnung rührt daher, dass der zugeordnete Vektorraum

TE als die Menge aller Tangentenvektoren von Kurven in E betrachtet werden kann. Eine Kurve ist eine

differenzierbare Abbildung λ : R → E, deren Ableitung ein Vektor ist, nämlich der Tangentenvektor

λ0 (s) =

λ(s + ) − λ(s)

dλ

= lim

.

→0

ds

21

(10.1)

Im Zähler steht ein Abstandsvektor von zwei Punkten, so dass der Grenzwert im Vektorraum TE gebildet

wird. Der Tangentenvektor einer Kurve ist also auf ganz natürliche Weise ein Vektor, ohne das wir dafür

zuerst ein Koordinatensystem einführen müssen, um die Ableitungen auf die Koordinatendarstellung der

Kurve anzuwenden.

Es gibt nun eine ebenso natürliche Definition des zu TE dualen Vektorraumes T ∗ E. Dazu betrachten

wir ein skalares Feld, also eine Abbildung φ : E → R. Wir definieren die Richtungsableitung von φ an

der Stelle r ∈ E in Richtung des Vektors v ∈ TE wie folgt. Wie werten das Feld φ entlang der Kurve

s 7→ r + s v aus, und bilden von dieser Funktion die Ableitung an der Stelle s = 0. Das Ergebnis

bezeichnen wir mit

φ(r + v) − φ(r)

dφ(r + s v) .

(10.2)

v · ∇φ(r) =

= lim

→0

ds

s=0

Aufgabe 10.1 Man zeige, dass die rechte Seite von (10.2) für festes r ∈ E eine lineare Funktion von

v ∈ TE ist, wenn die Funktion φ hinreichend glatt ist, so dass Grenzwerte beliebig vertauscht werden

können.

Demnach wird, wenn wir den Punkt r ∈ E festhalten, durch

∇φ(r) :

TE → R,

v 7→ v · ∇φ(r)

(10.3)

eine lineare Abbildung definiert. Diese lineare Abbildung heißt Gradient von φ an der Stelle r. Für jedes r

ist folglich ∇φ(r) ∈ T∗ E, das heißt der Gradient ist ein dualer Vektor, oder genauer ein duales Vektorfeld

auf E.

In einem affinen Raum sind Vektoren die Tangentenvektoren von Kurven, und duale Vektoren die Gradienten von skalaren Feldern.

Tatsächlich besteht zwischen den beiden Objekten eine Art Symmetrie, denn ein Tangentenvektor ist die

Ableitungen einer Kurve, also einer Abbildung R → E in den affinen Raum hinein, während der Gradient

die Ableitung eines skalaren Feldes ist, also einer Abbildung E → R aus dem affinen Raum hinaus.

Beide Objekte lassen sich in natürlicher Weise miteinander kombinieren, nämlich indem wir die Ableitung eines Feldes φ : E → R entlang einer Kurve λ : R → E berechnen. Das ist die Ableitung einer

gewöhnlichen Funktion R → R, nämlich

dφ(λ(s))

= λ0 (s) · ∇φ(λ(s)).

ds

(10.4)

Sie wird gebildet, indem man der Tangentenvektor der Kurve mit dem Gradienten des Feldes multipliziert,

und zwar im Sinne der natürlichen Produktes eines Vektors mit einem dualen Vektor. Wie hier schreiben

wir den Vektor auch gelegentlich als erstes Argument, und den dualen Vektor als zweites Argument. Da

die Beziehung zwischen einem Vektorraum und seinem Dualraum symmetrisch ist, spielt das keine Rolle.

Aufgabe 10.2 Man mache sich auch hier noch einmal klar, dass der Punkt in (10.4) kein Skalarprodukt ist,

der affine Raum E also kein metrischer Raum sein muss, um eine solche Ableitung eines skalaren Feldes

entlang einer Kurve zu bilden.

Affine Koordinaten

Um Kurven und Felder explizit zu beschreiben, müssen wir ein Koordinatensystem verwenden. Ein affines

Koordinatensystem wird durch die Wahl eines Ursprungs o ∈ E und einer Basis e i von TE festgelegt. Jeder

Punkt r ∈ E lässt sich dann eindeutig durch einen Satz von Koordinaten r i identifizieren,

r = o + r i ei ,

r i = (r − o) · ei .

22

(10.5)

Man beachte, dass die Koordinaten r i jetzt einen oberen Index tragen, da es sich um die Komponenten

eines Vektors r − o ∈ TE handelt.

Eine sehr geschickte Art, den Zusammenhang zwischen dem Koordinatensystem auf E und der zugehörigen Basis ei von TE auszudrücken, ergibt sich aus der folgenden Beobachtung. Wir betrachten den

Punkt r ∈ E als eine Funktion der reellen Zahlen {r i }. Das Koordinatensystem ist eine Abbildung

RN → E :

{r i }

r({r i }) = o + r i ei ,

7→

(10.6)

mit N = dim E. Wenn wir die partiellen Ableitungen dieser Funktion r nach den Koordinaten r i bilden,

finden wir

∂r

= ei .

(10.7)

∂r i

Die Basisvektoren ei von TE, die zu einem affinen Koordinatensystem gehören, sind die

partiellen Ableitungen des Punktes r nach den Koordinaten r i .

Dafür gibt es auch eine sehr anschauliche geometrische Erklärung. Die Basisvektoren e i sind die Tangentenvektoren der Koordinatenlinien. Eine Koordinatenlinie ist eine Kurve, die dadurch definiert ist, dass

alle bis auf eine Koordinate konstant sind, und die verbleibende Koordinate als Kurvenparameter aufgefasst wird. In einem affinen Koordinatensystem sind die Koordinatenlinien die Geraden, die parallel zu

den Achsen liegen. Der Tangentenvektor einer solchen Koordinatenlinie ist die Ableitung nach dem Kurvenparameter, also genau die partielle Ableitung ∂r/∂r i , bei der eine Koordinaten variiert wird und alle

anderen festgehalten werden.

Mit diesem Trick können wir den Tangentenvektor einer Kurve sehr leicht berechnen. Die Kurve λ(s)

wird durch ihre Koordinatendarstellung λi (s) beschrieben, also durch eine Verkettung einer Funktion R →

RN : s → {λi (s)} mit der Koordinatenabbildung {r i } 7→ r. Folglich gilt für die Ableitung die Kettenregel

∂r dλi

dλ

= i

= ei λ0i (s).

(10.8)

λ0 (s) =

ds

∂r = (s) ds

Die Komponenten des Tangentenvektors sind durch die Ableitungen der Koordinatenfunktionen gegeben.

Das ist natürlich nichts neues, denn so hatten ursprünglich den Tangentenvektor einer Kurve definiert. Mit

Hilfe der Darstellung (10.7) lässt sich das offenbar sehr geschickt reproduzieren.

Entsprechend wird ein skalares Feld durch eine Funktion φ({r i }) der Koordinaten dargestellt. Betrachten wir wieder die Richtungsableitung des Feldes an der Stelle r ∈ E in Richtung eines Vektors v ∈ TE,

so finden wir mit der Kettenregel

∂φ({r i })

dφ({r i + s v i }) dφ(r + s v) =

= vi

= v i ∂i φ(r).

(10.9)

v · ∇φ(r) =

s=0

s=0

ds

ds

∂r i

Daraus folgt, dass die partiellen Ableitungen ∂φ/∂r i an der Stelle r die Komponenten des Gradienten

∇φ(r) bezüglich der dualen Basis ei sind. Wir benutzen dafür die abkürzende Schreibweise ∂i = ∂/∂r i ,

also

∇φ(r) = ∂i φ(r) ei .

(10.10)

Der Index bei ∂i steht unten, weil es sich um die Komponenten eines dualen Vektors handelt.

Für die Ableitung eines Feldes entlang einer Kurve gilt schließlich in der Koordinatendarstellung

dφ(λ(s))

= λ0 (s) · ∇φ(λ(s)) = λ0i (s) ∂i φ(λ(s)).

ds

(10.11)

Das können wir wieder als Tensoroperation verstehen. Wir haben einen Tensor der Stufe (1, 0) mit einem

Tensor der Stufe (0, 1) multipliziert und anschließend die kontrahiert. Das Ergebnis ist ein Tensor der Stufe

(0, 0), also ein Skalar.

23

Aufgabe 10.3 Es sei E ein zweidimensionaler affiner Raum, auf dem die affinen Koordinaten (x, y) definiert sind. Wir betrachten eine Kurve λ und ein skalares Feld φ, gegeben durch

x(s) = cosh(s),

y(s) = sinh(s),

φ(x, y) = x2 − y 2 .

(10.12)

Man stelle den Tangentenvektor der Kurve in der Basis (ex , ey ), und den Gradienten des Feldes in der

dualen Basis (ex , ey ) dar. Man bestimme daraus die Ableitung des Feldes entlang der Kurve und überprüfe

das Ergebnis durch direktes Nachrechnen, also durch Ableiten der Funktion φ(s) = φ(x(s), y(s)) nach s.

Aufgabe 10.4 Man zeige, dass sich auch die dualen Basisvektoren als Ableitungen ausfassen lassen. Dazu

betrachtet man die Koordinaten r i als reelle Funktionen auf E. Dann ist ∇r i = ei , das heißt die dualen

Basisvektoren sind die Gradienten der Koordinaten.

Koordinatentransformationen

Wir wollen nun zeigen, dass sich die gerade eingeführten Objekte tatsächlich wie Tensoren verhalten.

Dazu müssen wir untersuchen, was bei einer Koordinatentransformation passiert, die ja gleichzeitig einen

Basiswechsel impliziert.

Es sei ein “altes” Koordinatensystem gegeben, in dem wir die Koordinaten eines Punktes r mit r i

bezeichnen. Die “neuen” Koordinaten r a desselben Punktes definieren wir dadurch, dass wir entweder die

alten Koordinaten als Funktion der neuen schreiben, oder umgekehrt die neuen als Funktion der alten.

Beim Übergang von einem affinen Koordinatensystem zu einem anderen handelt es sich dabei um eine

affine Abbildung, also

(10.13)

r i = Λia r a + ξ i ⇔ r a = Λai r i + ξ a .

Eine affine Koordinatentransformation besteht aus einer linearen Abbildung mit Verschiebung. Damit die

beiden Gleichungen (10.13) äquivalent sind, muss gelten

Λai Λib = δ ab ,

Λai ξ i + ξ a = 0.

(10.14)

Die Übergangsmatrizen sind wieder zueinander invers, und die Verschiebungen müssen sich gegeneinander aufheben, wenn wir die eine zuerst mit der Übergangsmatrix transformieren.

Aufgabe 10.5 Man zeige, dass ξ i die alten Koordinaten des neuen Ursprungs sind, und ξ a die neuen Koordinaten des alten Ursprungs. Die additiven Terme in (10.13) sind also die Darstellungen von Vektoren, die

angeben, wohin der Ursprung des Koordinatensystems verschoben wird.

Betrachten wir nur die Beziehungen (10.13) zwischen den Koordinaten, so stellen wir fest, dass sich die

Übergangsmatrizen Λia und Λai wieder sehr geschickt als partielle Ableitungen schreiben lassen, nämlich

als die der neuen Koordinaten nach den alten oder umgekehrt,

Λia

∂r i

= a,

∂r

Λai

∂r a

= i.

∂r

(10.15)

Dass die beiden Matrizen zueinander invers sind, ergibt sich dann ganz einfach aus der Kettenregel,

Λai Λib =

∂r a

∂r a ∂r i

=

= δ ab .

∂r i ∂r b

∂r b

(10.16)

Außerdem können wir daraus sehr leicht die Transformation der zugehörigen Basis ableiten. Es gilt in

beiden Koordinatensystemen, dass die zugehörige Basis von TE durch die partiellen Ableitungen des