Bedingte Wahrscheinlichkeit und Unabhängigkeit Inhalt: 1

Werbung

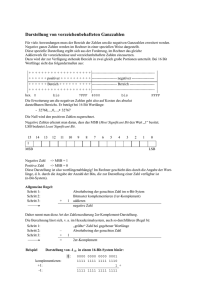

Universität Basel

Wirtschaftswissenschaftliches Zentrum

Bedingte Wahrscheinlichkeit und

Unabhängigkeit

Dr. Thomas Zehrt

Inhalt:

1. Einführung

2. Bedingte Wahrscheinlichkeit

3. Wichtige Sätze

4. Unabhängigkeit

5. Produktexperimente

2

Teil 1

Einführung

3

gegeben:

• Zufallsexperiment mit dem Wahrscheinlichkeitsraum (Ω, P)

•

Zusatzinformation über den Ausgang

ω ∈ Ω des Experimentes:

ω∈B⊂Ω

• A ein beliebiges Ereignis

A Β

U

Β

A

Ω

Frage:

Mit welcher Wahrscheinlichkeit tritt A

ein, wenn man weiss, dass B eintritt bzw.

eingetreten ist?

4

Beispiele:

Ein Jassspieler sieht seine eigenen Karten. Möchte er also wissen, mit welcher

Wahrscheinlichkeit einer der anderen Spieler 2 Asse hat (Ereignis A), so sollte er

zunächst seine eigenen Asse zählen (Zusatzinformation B).

Hat er selbst 3 oder 4 Asse, so ist die gesuchte Wahrscheinlichkeit natürlich Null,

hat er maximal 2 Asse, so ist sie positiv.

5

Teil 2

Bedingte Wahrscheinlichkeit

6

Laplace-Experimente, d.h. alle Ergebnisse ω ∈ Ω sind gleichwahrscheinlich

Zusatzinformation:

ω∈B⊂Ω

Also:

• allen Ergebnissen aus B wird die bedingte Wahrscheinlichkeit 0 zugeordnet und

• die Ergebnisse aus B werden als gleichwahrscheinlich unter der bedingten Wahrscheinlichkeit angesehen.

Für jedes Ereignis A ⊂ Ω ist die

bedingte Wahrscheinlichkeit P(A|B)

von A unter der Bedingung, dass B eingetroffen ist (kurz A unter B):

|A ∩ B|

.

P(A|B) =

|B|

7

Ausserdem gilt:

|A ∩ B|

P(A ∩ B) =

|Ω|

und

|B|

P(B) =

|Ω|

|A ∩ B|

=

|Ω| · P(A ∩ B)

|B|

=

|Ω| · P(B)

Falls nun noch P(B) > 0 gilt, ergibt sich:

|A ∩ B|

P(A|B) =

|B|

|Ω| · P(A ∩ B)

=

|Ω| · P(B)

P(A ∩ B)

=

P(B)

8

Definition:

gegeben:

• (Ω, P) ein beliebiger Wahrscheinlichkeitsraum

• B ein Ereignis mit P(B) > 0

• A ein beliebiges Ereignis

Dann ist die bedingte Wahrscheinlichkeit

P(A|B) von A unter B definiert als:

P(A ∩ B)

.

P(A|B) =

P(B)

9

Aufgabe 1

Es werde mit zwei (unterscheidbaren) Würfeln

einmal gewürfelt. Für die zufälligen Ereignisse

• A: ,,Die Augensumme ist 7“

• B: ,,Unter den Augenzahlen befinden sich keine 2 und keine 5“

• C: ,,Eine Augenzahl ist gerade und die andere Augenzahl ist ungerade“

bestimme man

P (A), P (B), P (C),

P (A|B), P (B|A), P (A|C),

P (C|A),P (B|C), P (C|B),

P (A|B ∩ C) und P (B|A ∩ C).

10

Teil 3

Wichtige Sätze

11

Teil 3.1

Wichtige Sätze: Der Multiplikationssatz

12

In der Praxis wird meist P(A ∩ B) aus

P(B) und P(A|B) berechnet, d.h. wir nutzen

P(A ∩ B) = P(B) · P(A|B)

= P(A) · P(B|A)

Verallgemeinerung:

Sind A, B, C ⊂ Ω Ereignisse mit P(A ∩

B) > 0, so gilt (durch mehrfaches Anwenden der Gleichung):

P(A ∩ B ∩ C)

= P((A ∩ B) ∩ C)

= P(A ∩ B) · P(C|A ∩ B)

= P(A) · P(B|A) · P(C|A ∩ B).

13

Diese Gleichung lässt sich durch Induktion noch weiter verallgemeinern.

Der Multiplikationssatz

Sind A1, A2, . . . , Ak ⊂ Ω Ereignisse mit

P(A1 ∩ . . . ∩ Ak−1) > 0, so gilt

P(A1 ∩ . . . ∩ Ak)

= P(A1) · P(A2|A1) · P(A3|A1 ∩ A2)

.........

·P(Ak−1|A1 ∩ . . . ∩ Ak−2)

·P(Ak|A1 ∩ . . . ∩ Ak−1)

14

Teil 3.2

Wichtige Sätze: Der Satz von der totalen

Wahrscheinlichkeit

15

Satz von der totalen Wahrscheinlichkeit

• B1, . . . , Bk ⊂ Ω eine vollständige Zerlegung von Ω (paarweise disjunkte Ereignisse deren Vereinigung ganz Ω ist)

• P(Bi) > 0 für alle i

Dann gilt für ein Ereignis A

P(A) =

k

X

P(A ∩ Bi) =

k

X

P(Bi) · P(A|Bi)

i=1

i=1

B4

B1

Ω

B2

11111111111111111

00000000000000000

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

A

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

B3

00000000000000000

11111111111111111

00000000000000000

11111111111111111

B8

B7

B6

B5

16

Beweis:

Wir nutzen hier die Eigenschaften einer

vollständigen Zerlegung von Ω ( alle Schnittmengen A ∩ Bi sind paarweise disjunkt )

und die Definition der bedingten Wahrscheinlichkeit aus:

P(A)

= P((A ∩ B1) ∪ (A ∩ B2) ∪ . . . ∪ (A ∩ Bn))

= P(A ∩ B1) + P(A ∩ B2) + . . . + P(A ∩ Bn)

=

k

X

P(A ∩ Bi)

k

X

P(Bi) · P(A|Bi).

i=1

=

i=1

17

00111111111111111111111

11

111111111111111111111

000000000000000000000

0000

1111

00000000000000000000000

11

000000000000000000000

111111111111111111111

0000

1111

000000000000000000000

111111111111111111111

000000000000000000000

111111111111111111111

0000111111111111111111111

1111

000000000000000000000

000000000000000000000

111111111111111111111

0000

1111

000000000000000000000

000000000000000000000

111111111111111111111

0000111111111111111111111

1111

000000000000000000000

111111111111111111111

000000000000000000000

111111111111111111111

0000111111111111111111111

1111

000000000000000000000

000000000000000000000

111111111111111111111

0000111111111111111111111

1111

000000000000000000000

000000000000000000000

111111111111111111111

0000

1111

000000000000000000000

111111111111111111111

000000000000000000000

111111111111111111111

0000

1111

000000000000000000000

111111111111111111111

P( B1)

P( B 2 1111

)

P( B k )

000000000000000000000

111111111111111111111

0000

000000000000000000000

111111111111111111111

000000000000000000000

111111111111111111111

0000111111111111111111111

1111

000000000000000000000

000000000000000000000

111111111111111111111

0000111111111111111111111

1111

000000000000000000000

000000000000000000000

111111111111111111111

0000

1111

000000000000000000000

000000000000000000000

111111111111111111111

0000111111111111111111111

1111

000000000000000000000

111111111111111111111

000000000000000000000

111111111111111111111

0000

1111

000000000000000000000

111111111111111111111

0000011111

1111

0000

0000

1111

000000000000000000000

111111111111111111111

0000

1111

000000000000000000000

00000

1111

1 B 2 111111111111111111111

0

B1

0000

1111

0000

1111

0000

1111

00001 B k

1111

00001111

1111

0000

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

0000

1111

0000

P(A| B1111

P(A| B21111

)

P(A| Bk1111

)

0000

1)

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

0000

1111

00001111

1111

0000

0000

1111

0000

1111

A

U

B1

B2

A

U

U

A

Bk

18

Spezialfall:

• B, B ⊂ Ω (vollständige Zerlegung)

• P(B), P(B) > 0

• Ereignis A

Dann gilt:

P(A) = P(B) · P(A|B) + P(B) · P(A|B)

B

Ω

11111111111111111

00000000000000000

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

A

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

00000000000000000

11111111111111111

B

19

P( B )

P(B )

B

U

A B

P(A| B)

U

P(A| B )

B

A B

20

Aufgabe 2:

Aus einer Urne mit 10 weissen und 5 schwarzen Kugeln wird zweimal hintereinander je eine

Kugel gezogen, wobei nicht zurückgelegt wird.

Mit welcher Wahrscheinlichkeit ist die zweite

entnommene Kugel schwarz?

21

Teil 3.3

Wichtige Sätze: Der Satz von Bayes

22

Der Satz von Bayes

• B1, . . . , Bk ⊂ Ω eine vollständige Zerlegung von Ω (paarweise disjunkte Ereignisse deren Vereinigung ganz Ω ist)

• P(Bi) > 0 für alle i

• Ereignis A mit P(A) > 0

Dann gilt für jedes j:

P(A ∩ Bj)

P(Bj|A) =

P(A)

=

P(Bj) P(A|Bj)

k

X

i=1

P(Bi) · P(A|Bi)

23

Beweis:

Für die Formel von Bayes nutzen wir zunächst die Identitäten

P(A ∩ Bj) = P(Bj) · P(A|Bj)

= P(A) · P(Bj|A).

Kombinieren wir nun die beiden rechten

Seiten und nutzen die Formel von der totalen Wahrscheinlichkeit, so erhalten wir

P(Bj) · P(A|Bj)

P(Bj|A) =

P(A)

=

P(Bj) P(A|Bj)

k

X

i=1

P(Bi) · P(A|Bi)

.

24

Spezialfall:

• B, B ⊂ Ω (vollständige Zerlegung)

• P(B), P(B) > 0

• Ereignis A mit P(A) > 0

Dann gilt:

P(B) P(A|B)

P(B|A) =

P(B) · P(A|B) + P(B) · P(A|B)

25

Eine Krankheit kommt bei etwa 0.5% der

Bevölkerung vor. Ein Test zur Auffindung

der Krankheit führt bei 99% der Kranken

zu einer (positiven) Reaktion, aber auch

bei 2% der Gesunden.

Frage:

Wie gross ist die Wahrscheinlichkeit, dass

eine Person, bei der die Testreaktion auftritt, die Krankheit wirklich hat?

Bevölkerung: Ω = {1, 2, . . . , N}

Menge aller Kranken: B

Menge aller Gesunden: B

Menge der Personen mit (positiver) Testreaktion: A

Β

Β

A

Ω

26

Vorbereitungen

5

|B| ≈

N

1000

99

|B|

|A ∩ B| ≈

100

995

|B| ≈

N

1000

2

|A ∩ B| ≈

|B|

100

Zufällige Auswahl einer Person (Anzahl

möglicher Wahlen ist 1/N):

5

5

1

·

·N =

P(B) =

N 1000

1000

1 995

995

P(B) =

·

·N =

N 1000

1000

Fehlerquoten des Tests:

99

P(A|B) =

100

2

P(A|B) =

100

27

Die gesuchte Wahrscheinlichkeit ist nun

P(B|A) und es folgt

P(A ∩ B)

P(B|A) =

P(A)

28

Die gesuchte Wahrscheinlichkeit ist nun

P(B|A) und es folgt

P(A ∩ B)

P(B|A) =

P(A)

P(B) · P(A|B)

=

P(B) · P(A|B) + P(B) · P(A|B)

29

Die gesuchte Wahrscheinlichkeit ist nun

P(B|A) und es folgt

P(A ∩ B)

P(B|A) =

P(A)

P(B) · P(A|B)

=

P(B) · P(A|B) + P(B) · P(A|B)

5 ·

1000

= 5

99 +

·

1000 100

99

100

995 · 2

1000 100

30

Die gesuchte Wahrscheinlichkeit ist nun

P(B|A) und es folgt

P(A ∩ B)

P(B|A) =

P(A)

P(B) · P(A|B)

=

P(B) · P(A|B) + P(B) · P(A|B)

5 ·

1000

= 5

99 +

·

1000 100

99

100

995 · 2

1000 100

495

=

≈ 0.2

2485

und das bedeutet, dass von allen Personen, an denen eine (positive) Testreaktion beobachtet wird, nur etwa 20% wirklich krank sind!

31

Aufgabe 3:

Die Produktion einer Abteilung wird von zwei

Kontrolleuren mit den Anteilen 30% bzw. 70%

sortiert. Dabei ist für den ersten bzw. zweiten

Kontrolleur die Wahrscheinlichkeit dafür, eine

Fehlentscheidung zu treffen, gleich 0.03 bzw. 0.05.

Es wird beim Versand ein fehlsortiertes Teil gefunden. Mit welcher Wahrscheinlichkeit wurde

es

• vom ersten,

• vom zweiten Kontrolleur sortiert?

• Man bestimme die Wahrscheinlichkeit dafür,

dass ein zufällig ausgewähltes Teil richtig einsortiert wurde.

32

Teil 4

Unabhängigkeit

33

Es kann sein, dass das Eintreffen von B

keinen Einfluss auf die Wahrscheinlichkeit von A hat:

P(A|B) = P(A)

Falls nun P(B) > 0 ist so folgt

P(A ∩ B) = P(A|B) · P(B) = P(A) · P(B).

Allgemein:

Zwei Ereignisse A und B heissen

(stochastisch) unabhängig,

wenn die folgende Gleichung gilt

P(A ∩ B) = P(A) · P(B)

34

Bemerkungen:

• Ist P(B) > 0, so sind die Gleichungen

P(A|B) = P(A) und

P(A ∩ B) = P(A) · P(B)

äquivalent.

• Die Unabhängigkeit von zwei Ereignissen A und B drückt aus, dass A und

B im wahrscheinlichkeitstheoretischen

Sinne keinerlei Einfluss aufeinander haben. Das muss sehr genau von realen

Beeinflussungen unterschieden werden.

• Andererseits: Zwei Ereignisse A und B

können selbst dann unabhängig sein,

wenn real das Eintreten von A davon

abhängt, ob B geschieht.

35

Verallgemeinerung auf n Ereignisse:

n Ereignisse A1, A2, . . . , An ⊂ Ω heissen

stochastisch unabhängig, wenn für jede

Auswahl Ai1 , Ai2 , . . . , Aim mit m ≤ n die

folgende Gleichung gilt

P(Ai1 ∩ . . . ∩ Aim ) = P(Ai1 ) · . . . · P(Aim )

36

Teil 5

Produktexperimente

37

Wir nehmen an, dass wir schon Modelle

(Ω1, P1), (Ω2, P2), . . . , (Ωn, Pn) für Zufallsexperimente kennen und wollen nun ein

Modell für das Experiment konstruieren,

welches aus der unabhängigen Hintereinanderausführung dieser Teilexperimente

besteht.

Das Paar (Ω, P) heisst das Produkt der

Wahrscheinlichkeitsräume (Ωi, Pi), wobei

Ω =

n

Y

Ωi = Ω1 × Ω2 × . . . × Ωn

i=1

= { (ω1, . . . , ωn) : ωi ∈ Ωi }

P(ω) =

n

Y

Pi(ωi)

i=1

für alle ω = (ω1, . . . , ωn) ∈ Ω.

38

Bernoulli-Experimente

unabhängige n-fache Wiederholung eines

Einzelexperimentes, welches nur zwei mögliche Ausgänge 1 (Erfolg) und 0 (Misserfolg) hat.

Einzelexperiment: (Ωi, Pi)

Ωi = {0, 1}

Pi(1) = p ist konstant

Pi(0) = 1 − p = q

p

q

1

0

p

q

1

p

0

q

p

q

p

1

q

p

0

q

p

q

1

0

1

0

1

0

1

0

(1,1,1)

(1,1,0)

(1,0,1)

(1,0,0)

(0,1,1)

(0,1,0)

(0,0,1)

(0,0,0)

39

Produktraum:

Ω = { ω = (ω1, . . . , ωn) : ωi ∈ {0, 1} }

P(ω) =

n

Y

Pi(ωi)

i=1

=

Y

i : ωi=1

p·

Y

(1 − p)

i : ωi=0

= pk(1 − p)n−k

wenn k die Anzahl der Einsen in (ω1, . . . , ωn)

(und dann natürlich n − k die Anzahl der

Nullen) ist.

Ein Experiment dieser Gestalt heisst

Bernoulli-Experiment

und P heisst

Bernoulli-Verteilung.

40

Sei nun Ek ⊂ Ω das Ereignis, dass insgesamt k Erfolge auftreten:

Ek =

ω = (ω1, . . . , ωn) ∈ Ω :

n

X

ωi = k

i=1

Es gilt

P(Ek) =

X

P(ω)

X

pk(1 − p)n−k

ω∈Ek

=

ω∈Ek

= |Ek| pk(1 − p)n−k

n

pk(1 − p)n−k

=

k

denn die Anzahl der Elemente in Ek ist

gleich der Anzahl der Möglichkeiten, k

Elemente aus den n Elementen auszuwählen.

41

Aufgabe 4

Beweisen Sie auf zweierlei Art, dass

n X

n

k=0

k

pk (1 − p)n−k = 1

gilt, in dem Sie

1. die gerade erläuterte Bedeutung der Summanden nutzen und

2. die Gleichung direkt beweisen.

42

Merke!!:

Für alle k ∈ {0, 1, . . . , n} ist

n

pk(1 − p)n−k ≥ 0

Bn,p(k) =

k

die Wahrscheinlichkeit dafür, dass man

bei einem Bernoulliexperiment (n-malige

Wiederholung eines Einzelexperimentes,

welches nur zwei mögliche Ausgänge, Erfolg und Misserfolg, hat) genau k-mal Erfolg hat.

Man nennt diese Wahrscheinlichkeitsverteilung Bn,p auch Binomialverteilung mit

den Parametern n und p.

43

Beispiel:

Wir suchen die Wahrscheinlichkeit E2 dafür,

dass in einer Familie mit 4 Kindern 2

Jungen und 2 Mädchen vorkommen. Durch

statistische Untersuchungen findet man,

dass die Wahrscheinlichkeit für die Geburt eines Jungen etwa p = 51/100 ist.

Man nimmt an, dass aufeinander folgende Geburten unabhängige “Einzelexperimente“ sind. Damit folgt

4

p2(1 − p)2

P(E2) =

2

2 2

51

49

= 6

100

100

≈ 0.375

44

Beispiel:

Wir wollen die Wahrscheinlichkeit dafür

berechnen, dass beim zehnmaligen Würfeln (genau) 3 Sechsen fallen, d.h. wir betrachten die geworfenen Sechsen als Erfolg (1) und alle anderen Zahlen als Misserfolg.

Wir haben also n = 10, k = 3 und p = 1/6,

also folgt

3 7

1

10

5

P(E3) =

3

6

6

= 0.155