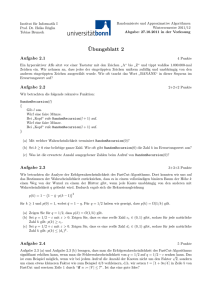

1 Mathe Formeln Statistik und Wahrscheinlichkeitsrechnung

Werbung

1

Mathe Formeln Statistik und Wahrscheinlichkeitsrechnung

Jörn Horstmann, 26.10.2003. Alle Angaben ohne Gewähr.

http://www.ba-stuttgart.de/∼wi02172/

1.1

Grundlagen

• Einzelklassen

[ai ; bi [

• Klassenweite

bi − ai = wi

• Klassenmitte

x̃i =

ai +bi

2

• Mittelwert

n

x̄ =

n

X

1X

xi · ni =

xi · hi ≈

n i=1

i=1

{z

}

|

gruppierte Werte

• Absolute Häufigkeit

ni

• Relative Häufigkeit

hi =

• Kumulierte Häufigkeit

n

X

x̃i · hi

i=1

|

{z

}

klassierte Daten

ni

n

Hi =

P

hj

• Median, analog für Q1 (0, 25) und Q3 (0, 75)

z = ai +

hi

wi

• Modalklasse (klassierte Daten)

0, 5 − Hi−1

· wi

hi

= max

• Geometrisches Mittel (bei Wachstumsraten)

√

x̄g = n x1 · x2 · x3 . . . xn

• Histogramm: Fläche des Rechtecks proportional zu hi

1.2

h∗i =

hi

wi

Streuungsmaße

R =

Q =

dm

=

dz

=

dx̄

=

σ2

=

=

σ

=

V

=

Spannbreite = xmax − xmin

Quartilsabstand = Q3 − Q1

1X

|xi − m|

n

X

1

|xi − z|

n

X

1

|xi − x̄|

n

1X

2

Varianz =

(xi − x̄)

n

X

1X 2

xi − x̄2 =

x2i hi − x̄2

n

√

Standardabweichung = σ 2

σ

Variationskoeffizient =

x

• Der Gini-Koeffizient

P

DG

=

≈

(Hk−1 + Hk ) · nk · x̄k

− 1 (grup. Daten)

n · x̄

P

(Hi−1 + Hi ) · ni · x̃i

− 1 (klass. Daten)

n · x̃

1

DG

0 < DG

0, 4 ≤ DG

0, 6 ≤ DG

DG

=0

< 0, 4

< 0, 6

<1

=1

absolute Gleichverteilung

geringe Konzentration

mittlere Konzentration

hohe Konzentration

absolute Konzentration

• Die Lorenz-Kurve

ci

Ci

ni · x̄i

ni · x̃i

≈

n · x̄

n · x̃

i

X

=

cj

=

Anteile der Merkmalssumme

j=1

Schutzkoeffizient S = max (Si )

Si = Hi − Ci

P (Hi ; Ci ) ist ein Punkt auf der Lorenzkurve

DG = 2 · Fläche zw. Winkelhalbierender und Lorenzkurve

1.3

Korrelation und Regression

• Bedingte Häufigkeiten

h (xi |yj fest) = hi|j =

nij

hij

=

h·j

n·j

• Kovarianz Cov(x, y) = σxy

σxy

=

=

1X

(xi − x̄) · (yi − ȳ)

n

1X

xi · yi − x̄ · ȳ

n

x, y sind unabhängig ⇒ Cov(x, y) = 0

Cov(x, y) 6= 0 ⇒ x, y sind abhängig

x, y sind unahängig wenn für alle i, j gilt: nij =

ni· ·n·j

n

• Korrelationskoeffizient

r

σxy

σxy

σx · σy

= r · σx · σy

=

• Regressionsgerade

Linearer Zusammenhang zw. x und y, Suche einer Geraden ỹ = a + bx nach der Methode der

kleinsten Quadrate

X

2

f=

(a + bxi − yi )

f wird am kleinsten wenn

P

(yi − ȳ) · (xi − x̄)

σxy

= 2

P

2

σx

(xi − x̄)

a = ȳ − bx̄

b

1.4

=

Indizes

• Index nach Laspeyres

L

I0,t

(p)

=

L

Mengenindex I0,t

(q)

=

Preisindex

2

P i i

p ·q

P it 0i · 100

p0 · q 0

P i i

p ·q

P i0 it · 100

p0 · q 0

• Index nach Paasche

P

Preisindex I0,t

(p)

=

P

Mengenindex I0,t

(q)

=

P i i

p ·q

P it ti · 100

p0 · q t

P i i

p ·q

P it it · 100

pt · q 0

• Index nach Fischer

F

Preisindex I0,t

(p)

F

Mengenindex I0,t

(q)

1.5

q

L (p) · I P (p)

I0,t

0,t

q

L (q) · I P (q)

=

I0,t

0,t

=

Wahrscheinlichkeiten

• Klassische Definition der Wahrscheinlichkeit (Laplace)

nur bei Zufallsexperimenten, deren Ergebnisse gleiche Wahrscheinlichkeit haben

P (A) =

Anzahl der zu A gehörenden Ereignisse

|A|

=

Anzahl aller Ereignisse

|G|

• Bedinge Wahrscheinlichkeit (Wahrscheinlichkeit von A wenn B eingetreten ist)

P (A|B) =

P (A ∩ B)

P (B)

• Additionssatz

P (A ∪ B)

= P (A) + P (B) − P (A ∩ B)

= P (A \ B) + P (A ∩ B) + P (B \ A)

• Spezieller Additionssatz wenn A ∩ B = {}

P (A ∪ B) = P (A) + P (B)

• Multiplikationssatz

P (A ∩ B) = P (A|B) · P (B)

P (A ∩ B) = P (A) · P (B|A)

• Satz der totalen Wahrscheinlichkeit

A1 , A2 , A3 , . . . , An seien disjunkte Ereignisse mit A1 ∪ A2 ∪ A3 ∪ . . . ∪ An = G

B

P (B)

(B ∩ A1 ) ∪ (B ∩ A2 ) ∪ (B ∩ A3 ) ∪ . . . ∪ (B ∩ An )

n

X

=

P (Ai ) · P (B|Ai )

=

i=1

• Satz von Bayes

A1 , A2 , A3 , . . . , An seien disjunkte Ereignisse mit A1 ∪ A2 ∪ A3 ∪ . . . ∪ An = G

P (Ai |B) =

P (Ai ) · P (B|Ai )

P (Ai ∩ B)

=

P (B)

P (B)

3

1.6

Kombinatorik

Permutation

Variation (Reihenfolge wichtig)

ohne Wiederholung

verschiedene Elemente

P (n) = n!

mit Wiederholung

gruppenweise identische Elemente

n1 , n 2 , n 3 , . . .

P

( ni )!

P (n1 , n2 , . . .) =

n1 ! · n2 ! · . . .

m Elemente nacheinander aus n Elementen ziehen.

nm

V (m, n) =

Kombination (Reihenfolge unwichtig)

1.7

1.7.1

n!

(n − m)!

gleichzeitiges Ziehen (mit einem

Griff) m aus n

n

n!

C(m, n) =

=

m

m!(n − m)!

n+m−1

m

Zufallsverteilungen

Diskrete ZV

E(X)

V ar(x)

=

X

f (xi ) · xi

=

X

f (xi ) · x2i − µ2

• Diskrete Gleichverteilung (Laplace)

x nimmt n verschiedene Werte an

f (x = xi ) =

1

n

• Binomialverteilung (Bernoulli - Experiment)

Ein Zufallsexperiment mit zwei möglichen Ausgängen wird n-mal wiederholt, p ist Wahrscheinlichkeit des günstigen Ausgangs und k ist die Anzahl der günstigen Ausgänge

P (A) = p

P (Ā) = 1 − p = q

n

P (X = k) =

· pk · (1 − p)n−k

k

E(X) = n · p

V ar(X) = n · p · (1 − p)

• Poisson-Verteilung

Approximation der Binomialverteilung B(n, p) wenn n > 50 und p < 0, 05

P (X = k)

=

µk · e−µ

k!

= P (k − 1) ·

µ

k

• Hypergeometrische Verteilung

Eine Urne enthält N Elemente, davon M günstige. Es werden n Elemente ohne zurücklegen (mit

4

einem Griff) gezogen. X = Anzahl der dabei gezogenen günstigen Elemente.

M N −M

P (X = k)

E(X)

V ar(X)

1.7.2

k

=

n−k

N

n

M

N

M N −M N −n

= n·

·

·

N

N

N −1

= n·

Stetige ZV

Z

E(X)

=

f (x) x dx

Z

V ar(x)

=

f (x) x2 dx − µ2

• Normalverteilung

−

1

P (X = k) = √ · e

σ 2π

(x − µ)2

2σ 2

• Standardnormalverteilung, Verteilungsfunktion Φ

X −µ

σ

E(Z) = 0

V ar(Z) = 1

a−µ

a−µ

P (X ≤ a) = P Z ≤

=Φ

σ

σ

Φ(−Z) = 1 − Φ(Z)

c

−1

P (µ − c ≤ X ≤ µ + c) = 2 · Φ

σ

Z

=

• Lineare Transformation

Y = aX + b

E(Y ) = a + E(X)

V ar(Y ) = b2 · V ar(X)

• X, Y unabhängig

E(X + Y )

V ar(X + Y )

= E(X) + E(Y )

= V ar(X) + V ar(Y )

• xi ist N (µ, σ 2 ) für i = 1 . . . n

x1 + x2 + . . . + xn

n

E(x̄) = µ

σ2

V ar(x̄) =

n

x̄ =

1.8

ist ebenfalls normalverteilt

Hypothesentest

• Fehler 1. Art: Die richtige Hypothese wird abgelehnt

• Fehler 2. Art: Die falsche Hypothese wird angenommen

5