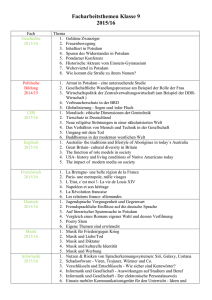

Seminarplan mit Literaturhinweisen: Grundlegende

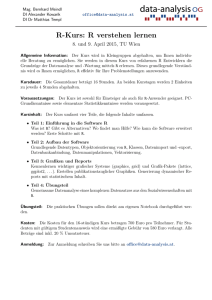

Werbung