Inhaltsverzeichnis

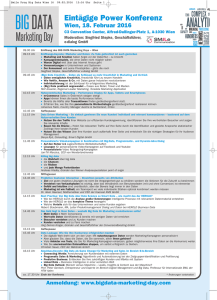

Werbung

Einsatz_von_Big_Data_in_der_Konsumgüterbranche Hochschule: Standort: Studiengang: Veranstaltung: Betreuer: Typ: Themengebiet: Autor(en): Studienzeitmodell: Semesterbezeichnung: Studiensemester: Bearbeitungsstatus: Prüfungstermin: Abgabetermin: Fallstudienarbeit Hochschule für Oekonomie & Management Dortmund Bachelor Wirtschaftsinformatik Fallstudie / Wissenschaftliches Arbeiten Prof._Dr._Uwe_Kern Fallstudienarbeit Big Data Michael Butterweck, Fabian Prinz Abendstudium SS15 2 Bearbeitung abgeschlossen 10.7.2015 21.6.2015 Inhaltsverzeichnis • 1 Verzeichnisse ♦ 1.1 Abkürzungsverzeichnis ♦ 1.2 Abbildungsverzeichnis ♦ 1.3 Tabellenverzeichnis • 2 Einleitung ♦ 2.1 Thema ♦ 2.2 Zielsetzung ♦ 2.3 Aufbau und methodische Vorgehen • 3 Big Data Grundlagen ♦ 3.1 Begriffsdefinition Big Data ♦ 3.2 Produktionsfaktor Daten ♦ 3.3 Relevante Technologien ◊ 3.3.1 Daten-Haltung ⋅ 3.3.1.1 Hadoop ⋅ 3.3.1.2 Relevante Datenbanken ◊ 3.3.2 Daten-Zugriff ⋅ 3.3.2.1 Batch-Processing ⋅ 3.3.2.2 Streaming und Complex Event Processing ⋅ 3.3.2.3 Search und Discovery ⋅ 3.3.2.4 Query ◊ 3.3.3 Analytische Verarbeitung ⋅ 3.3.3.1 Text und semantische Analyse Inhaltsverzeichnis 1 Einsatz_von_Big_Data_in_der_Konsumgüterbranche ⋅ 3.3.3.2 Predictive Analytics ⋅ 3.3.3.3 Machine Learning ◊ 3.3.4 Visualisierung ⋅ 3.3.4.1 Dashboards ⋅ 3.3.4.2 Real-time intelligence • 4 Einsatz von Big Daten in der Konsumgüterbranche ♦ 4.1 Marketing & Vertrieb ◊ 4.1.1 Kostenreduzierung ◊ 4.1.2 Umsatzsteigerung ◊ 4.1.3 Markt- & Wettbewerbsanalyse ♦ 4.2 Forschung & Entwicklung ◊ 4.2.1 Produktneuentwicklungenund verbesserungen ◊ 4.2.2 Social-Media Trendanalysen ♦ 4.3 Produktion, Service & Support ◊ 4.3.1 Produktionsoptimierung ◊ 4.3.2 Early recognition von Produktionsproblemen ♦ 4.4 Distribution & Logistik ◊ 4.4.1 Optimierung der Supply Chain ◊ 4.4.2 Optimierung der Logistik ♦ 4.5 Finanz- und Risikocontrolling ◊ 4.5.1 Echtzeit-Reaktionen auf Geschäftsinformationen ◊ 4.5.2 Simulation, Vorhersagen und Szenarienbildung • 5 Big Data und Datenschutz ♦ 5.1 Privacy-Preserving Data Mining ♦ 5.2 Ganzheitliche Sicherheitskonzepte • 6 Schlussbetrachtung ♦ 6.1 Fazit ♦ 6.2 Ausblick • 7 Anhang ♦ 7.1 Fußnoten ♦ 7.2 Literatur- und Quellenverzeichnis 1 Verzeichnisse 1 Verzeichnisse 2 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 1.1 Abkürzungsverzeichnis Abkürzung BI CEP CRM EDW ERP HDFS IoT NAS NER OLAP SAN SCM SQL TB Bedeutung Business Inteligence Complex Event Prosessing Customer Relationship Management Enterprise Data Warehouse Enterprise Resource Planning Hadoop Distributed File System Internet of Things Network Attached Storage Named Entity Recognition Online Analytical Processing Storage Area Network Supply Chain Management Structured Query Language Terabyte 1.2 Abbildungsverzeichnis Abb.-Nr. 1 2 3 4 5 6 7 8 9 Abbildung 5V Vollkosten Datenhaltung Hadoop Framework Beispielcluster mit drei Knoten Anscombe's Quartet Anscombe's Quartet Dashboard Reife des Unternehmens Targeting 1.3 Tabellenverzeichnis Tabelle Nr. Quelle 1 Volume - Variety - Velocity - Veracity 2 SQL Beispieldatenbank 3 SQL Beispielausgabe 2 Einleitung 1.1 Abkürzungsverzeichnis 3 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 2.1 Thema Obwohl das Thema Big Data seit mehreren Jahren in Fachkreisen und in den Medien umfangreich präsent ist und vielfältig diskutiert wird, konnte Big Data sich dennoch nicht in allen Industriezweigen, Ländern und Unternehmensgrößen durchsetzen. Während viele bekannte Unternehmen wie Google, Facebook und Amazon zeigen, wie Big Data in der Organisation gewinnbringend eingesetzt werden kann und sich daraus entscheidende Wettbewerbsvorteile generieren lassen, scheitern viele Unternehmen bereits an den Barrieren der Einführung. [1] Insbesondere der Konsumgüterbranche bietet der Einsatz von Big Data einen entscheidenden Mehrwert. Ist doch gerade die Konsumgüterindustrie größtenteils geprägt von gesättigten Märkten. Ein Hoher Preis- und Margendruck, der Kampf um Marktanteile, ein starker Verdrängungswettbewerb und kürzere Produktlebenszyklen fordern eine hohe Innovationsfähigkeit der Unternehmen, um eine wettbewerbsfähige Marktposition zu sichern. Daher wird der Produktionsfaktor Daten für die moderne Wirtschaft zu einem immer erfolgsentscheidenden Faktor. So äußern sich Verbraucher zu Produkten und Services in Online-Foren oder sozialen Netzwerken, die Verbreitung mobiler Endgeräte steigt rasant an und Sensoren an Produktionsmaschinen erfassen den Zustand hunderter Parameter in Echtzeit. Somit können Unternehmen viel schneller als früher neue Erkenntnisse über die Marktentwicklung, Kundenbedürfnisse und der Lieferkette gewinnen.[2] 2.2 Zielsetzung Die Zielsetzung dieser Fallstudie ist, die möglichen Einsatzszenarien von Big Data anhand einer typischen Wertschöpfungskette in der Konsumgüterindustrie aufzuzeigen. Betrachtet werden dabei die Bereiche: • Marketing & Vertrieb • Forschung & Entwicklung • Produktion, Service & Support • Distribution & Logistik • Finanz- und Risikocontrolling 2.3 Aufbau und methodische Vorgehen Im Rahmen dieser Fallstudie werden nach der Einleitung und der Zielsetzung zunächst im Kapitel 3 die grundlegenden Begriffe von Big Data erläutert und definiert. Ebenso werden in diesem Kapitel die relevanten Big Data-Technologien vorgestellt und erläutert. Das Kapitel 4 zeigt mögliche Einsatzszenarien anhand einer typischen Wertschöpfungskette in der Konsumgüterindustrie auf. Hier wird insbesondere auf die Wertschöpfungsbereiche Marketing & Vertrieb, Forschung & Entwicklung, Produktion Service & Support, sowie auf das dem Finanz- und Risikocontrolling näher eingegangen. Im Kapitel 5 werden die relevanten Datenschutzmaßnahmen vorgestellt und erläutert, sowie ein kurzer Überblick über weiteren Sicherungsmaßnahmen im Unternehmen dargestellt. Diese Fallstudie wird im Kapitel 6 mit einem Fazit und einem Ausblick abgeschlossen. 2.1 Thema 4 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 3 Big Data Grundlagen 3.1 Begriffsdefinition Big Data Big Data wird genutzt, um große Datenmengen aus internen und externen Datenquellen schnell zu verarbeiten. Aus den verarbeiteten Daten sollen relevante Informationen für wirtschaftliche Entscheidungen erzeugt werden.[3] Big Data spaltet sich in die fünf Facetten Datenmenge (Volume), Datenvielfalt (Variety), Geschwindigkeit (Velocity), Sinnhaftigkeit (Veracity) und Value (Mehrwert) auf.[4] Eigene Darstellung Abbildung 1: 5V • Volume Die Datenmengen, die zur Analyse von Big Data verwendet werden. Können gigantische Datenvolumen in Größenordnungen von einigen hundert Terabyte bis Petabyte annehmen.[4] • Variety Steigende Vielfalt der Datenformate und Datenquellen. Daten lassen sich in unstrukturierte, semistrukturierte und strukturierte Daten gruppieren. Interne Daten werden durch externe Datenquellen ergänzt.[4] • Velocity Die riesigen Datenvolumen müssen schnell auswertbar sein. Ziel von Velocity bei Big Data sind hohe Geschwindigkeiten der Datenübertragung, Datenverarbeitung in Realtime und Analyse der 3 Big Data Grundlagen 5 Einsatz_von_Big_Data_in_der_Konsumgüterbranche Daten in Kurzzeit[4] • Veracity Autonomes erkennen und nutzen von Zusammenhängen und Bedeutungen von un- oder semistrukturierten Daten, z.B. durch Data Mining oder Bild- und Textanalytik.[5] • Value Ist die Fähigkeit einen Nutzen und einen Mehrwert aus den gewonnen Daten zu ziehen. Gefundene Modelle und Regeln auf zukünftige Szenarien anzuwenden.[6] 3.2 Produktionsfaktor Daten Um aus der Datenflut des Big Data die richtigen Informationen zu erlangen, ist es entscheidend die Technologien zu verstehen. Unternehmen, die das Value der Daten für sich nutzen können, werden auf lange Sicht wettbewerbsfähig bleiben. Die gesammelten Daten des Big Data Volumes müssen in riesigen Systemen vorgehalten werden, um sie mit verschiedenen Verfahren auswerten und zuordnen zu können. Es können sogar Modelle erstellt werden, die einen Ausblick in die Zukunft ermöglichen. Um diese Entscheidungshilfen dem menschlichen Nutzer verständlicher zu machen, werden sie visualisiert dargestellt. Dies kann in statischen Grafiken, bis hin zu dynamischen Animationen in Real-Time erfolgen. Im folgenden Abschnitt 3.3 werden diese Verfahren erläutert. 3.3 Relevante Technologien 3.3.1 Daten-Haltung 3.1 Begriffsdefinition Big Data 6 Einsatz_von_Big_Data_in_der_Konsumgüterbranche In Anlehnung an: Bitkom (2014) S.36[7] Abbildung 2: Vollkosten Datenhaltung Die Speicherung und Bearbeitung von Daten im Big Data ist eine Herausforderung an die Infrastruktur. Das zu speichernde Datenvolumen nimmt exponentiell zu, um keine Verluste in der Bearbeitungsgeschwindigkeit zu erhalten, müssen Unternehmen ihre Infrastruktur auf dem Stand der Zeit halten. Bisher wurden die Daten bei BI Systemen auf relationalen Datenbanken gespeichert. Daten die zum Speichern bereit stehen, müssen erst deklariert werden, ein Speichern der Rohdaten war nicht vorgesehen. Außerdem wurden die erlangten Daten nur einige Jahre vorgehalten, da die Speicherung zu kostenintensiv ist.[8] Dabei muss die Infrastruktur drei Ziele erfüllen: Daten so günstig wie Möglich speichern, flexible Analyse der Daten und schnelle Bearbeitungszeit der Aufgaben. Es gibt zwei Möglichkeiten, um die Infrastruktur auf die Datenmengen vorzubereiten: • Vertikale Skalierung (Skale-Up) Dabei wird die Leistungskraft des Servers im Hinblick auf Prozessorleistung, Speicherkapazität und Konnektivität verbessert. Allerdings gibt es für jede Komponente eine Obergrenze ihrer Leistungsfähigkeit. Ist diese Obergrenze erreicht, kann durch Skale-Up eines Servers keine Verbesserung erzielt werden.[9] • Horizontale Skalierung (Skale-Out) Bei dem Skale-Out wird die zu bearbeitende Aufgabe auf mehrere Server verteilt. Hierbei ist die Verbindung untereinander die Schwachstelle, da alle Server auf eine Datenquelle zugreifen.[9] Die Unternehmen Google, Facebook und Yahoo stießen zuerst auf das Problem, der immer größer werdenden Datenmengen, die von ihren Nutzern angesammelt wurden. Deshalb benutzen sie Hadoop, eine erweiterte Form des Skale-Out.[8] 3.3.1 Daten-Haltung 7 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 3.3.1.1 Hadoop In Anlehnung an: Fischer (2014)[10] Abbildung 3: Hadoop Framework In Anlehnung an: Fischer (2014)[10] Abbildung 4: Beispielcluster mit drei Knoten Um den Problemen des Skale-Up und Skale-Out zu entgehen, wurde Hadoop von Apache Software Foundation entwickelt. Apache Hadoop ist ein Open-Source-Framework und wurde in der Sprache Java programmiert. Hadoop wird unter anderem von den Unternehmen Amazon, Ebay, Facebook, Google, IBM, Twitter und Yahoo verwendet.[11] Bei Apache Hadoop wird durch verteilte Parallelverarbeitung eine stetige Verarbeitungsgeschwindigkeit bei zunehmenden Datenaufkommen gewährleistet. Dabei werden bei dem Hadoop Distributed File System (HDFS) Daten auf mehreren Servern verteilt gespeichert, den DataNodes. Jeder DataNode ist drei Mal vorhanden, um Datenverluste bei Ausfall eines Servers zu vermeiden. Die Bearbeitung der Aufgaben erfolgt auf den DataNodes, welche die relevanten Daten gespeichert haben. Steigen die Datenvolumen, können durch Scale-Out weitere DataNodes hinzugefügt werden. Die Verwaltung der Daten, die die DataNodes speichern, übernimmt der NameNode, der die zentrale Komponente im HDFS bildet. Der NameNode kennt den Speicherort der Datenblöcke auf den DataNodes und weiß wie viel Kapazität diese besitzen. In regelmäßigen Zyklen schickt der NameNode Prüfsignale an alle DataNodes, um deren Funktionsfähigkeit zu überprüfen. Fällt ein DataNode aus, verteilt der NameNode die Last auf die verbleibenden DataNodes im Hadoop-Cluster. Um wiederum einen Ausfall eines NameNodes abzusichern, stehen immer zwei NameNodes im HDFS bereit. Sie laufen auf verschiedenen Maschinen und jeweils aktiv bzw. passiv.[12] Das HDFS wendet das Master-Slave Prinzip an, bei 3.3.1.1 Hadoop 8 Einsatz_von_Big_Data_in_der_Konsumgüterbranche denen die NameNodes die Master und die DataNodes die Slaves sind.[10] Mithilfe des Hadoop MapReduce Framework wird eine Hauptaufgabe in mehrere Teilaufgaben aufgeteilt, den sogenannten Map-Tasks. Die Map-Tasks werden an die Server im Hadoop zur parallelen Bearbeitung verteilt. Die bearbeitet Zwischenergebnisse werden unter den Servern durch "Shuffling" ausgetauscht. Zum Schluss werden die einzelnen Zwischenergebnisse gesammelt und zu einem Endresultat zusammengefasst (Reduce-Tasks). Um die Datenmengen der Zwischenergebnisse so gering wie möglich zu halten, können diese durch "Combine" zusammengefasst werden. MapReduce arbeitet wie HDFS nach dem Master-Slave Prinzip. Der JobTracker (Master) teilt die Hauptaufgaben in Teilaufgaben auf und weist sie den TaskTracker (Slave) zu. Die TaskTracker sind meist die Server, auf denen sich die benötigten Daten befinden. Den Fortschritt der Bearbeitung überwacht der JobTracker. Bei Ausfall eines TaskTrackers weist der JobTracker die Aufgabe einem neuen Server zu.[13] 3.3.1.2 Relevante Datenbanken • Relationale Datenbanken Die relationale Datenbank unterstützt das gleichzeitige Arbeiten vieler Nutzer, erfüllt Skalierbarkeit und Performanz. Somit ist sie die Basis für transaktionale Anwendungen wie, Supply-Chain-Mamagement (SCM), Customer-Relationship-Management CRM) und Enterprise-Resource-Planning (ERP) Systeme. Die Anwendungen auf relationalen Datenbanken erlauben die Bearbeitung in Echtzeit.[14] • Enterprise Data Warehouse Business Intelligence greift auf Datensätze aus Data Warehouse-Systemen zu. In regelmäßigen Abständen werden Daten aus den relationalen Datenbanken in das EDW übertragen, mit denen durch OLAP Datenanalysen getrieben werden.[14] 3.3.1.2 Relevante Datenbanken 9 Einsatz_von_Big_Data_in_der_Konsumgüterbranche • NoSQL-Datenbanken NoSQL-Datenbanken werden für Web-Applikationen und Social Media genutzt und sind nicht-relationale Datenbanken. NoSQL-Datenbanken gliedern sich in Key-Value-Datenbanken (Key-Value Stores), dokumentenorientierte Datenbanken (Document Stores), Graph-Datenbanken und Objekt-Datenbanken.[14] ◊ Key-Value-Datenbanken Key-Value-Stores besitzen nur Implementierungen die für große Web-Anwendungen mit Millionen Nutzern benötigt werden. Sie können auf verteilte Datensätze mit hoher Geschwindigkeit zugreifen. Es wird in zwei Kategorien von Key-Value-Stores unterschieden, der In-Memory mit Daten im Hauptspeicher und On-Disk mit Daten auf der Festplatte.[15] ◊ Document Stores Datensätze die unvorhersehbare Verknüpfungen nach flexiblen Schemata haben, werden in Document Stores gespeichert. Der Document Store speichert einen Datensatz als Zeile ab, wobei Spaltenanzahl und Feldeigenschaften flexibel sind.[14] ◊ Graph-Datenbanken Sind Daten stark vernetzt werden Graph-Datenbanken verwendet. Die Daten werden als Knotenpunkte mit Beziehungen zu anderen Knotenpunkten gespeichert. Facebook, Twitter, und LinkedIn verwenden Graph-Datenbanken, aufgrund der starken Vernetzung der Userinhalte.[15] ◊ Objekt-Datenbanken Objektdatenbanken verwenden objektorientierte Programmiersprachen wie z.B. Java, C# oder Perl. Sie können gleichzeitig viele Nutzeraktivitäten steuern.[14] • In-Memory-Datenbanken In-Memory-Datenbanken können auf Daten sehr schnell zugreifen, da sie ihre Daten nicht auf Festplatten, sondern im Hauptspeicher ablegen. Die Verarbeitung der Kundendaten durch In-Memory-Datenbanken erlaubt die Auswertung von Kaufmustern früherer Bestellungen und Präferenzen, die durch Cross- und Upselling den Umsatz steigern können.[14] 3.3.2 Daten-Zugriff 3.3.2.1 Batch-Processing Bei Batch-Processing werden Jobs gesammelt um als Ganzes zu verarbeitet zu werden. Im Deutschen wird Batch-Processing auch Stapelverarbeitung genannt und hat ihren Ursprung in den 60. Jahren, als Lochkaten als Stapel bearbeitet wurden. Im Big-Data stößt Batch-Processing an vier Hürden: 1. Limitierte Sichtbarkeit: Daten vieler Applikationen können nicht durch Schnittstellen überspielt werden. 2. Limitierte Sichtbarkeit: Exporte von großen Datenmengen wird nicht unterstützt. 3. Limitierte Agilität: Nur Teile der Originaldaten werden beim Austausch übernommen. 4. Eingeschränkte Historisierung: Daten werden nur für gewisse Zeiträume zur Verfügung gestellt. Des Weiteren müssen im Hadoop die Abfragen in Java programmiert werden. Dies kann sich weitaus aufwändiger gestalten, als eine SQL-Abfrage einer relationalen Datenbank. Damit man im Hadoop nicht an diese Grenze stößt, wurde "Pig" entwickelt. Pig wurde für Nutzer ohne Programmierkenntnisse entworfen.[16] Laut der Apache Software Foundation hat Pig eine Philosophie mit vier Kernthesen:[17] 3.3.2 Daten-Zugriff 10 Einsatz_von_Big_Data_in_der_Konsumgüterbranche • "Pigs eat anything": Pig kann jegliche Daten verarbeiten.[17] • "Pigs live anywhere": Pig kann auch außerhalb von Hadoop verwendet werden.[17] • "Pigs are domestic animals": Pig ist einfach zu bedienen und zu erweitern.[17] • "Pigs fly": Pig verarbeitet Daten sehr schnell.[17] Den größten Vorzug bietet Pig bei der Flexibilität. Jedoch muss der Nutzer bereits Erfahrung mit Hadoop und der Pig Programmiersprache "Pig Latin" besitzen. 3.3.2.2 Streaming und Complex Event Processing Mithilfe von Streaming ist es möglich eingehende Daten in Echtzeit zu verarbeiten und an den Nutzer auszugeben. Complex Event Processing (CEP) umfasst die Verfahren der Echtzeitverarbeitung. Zu den Anwendungsgebieten zählen Businnes Activity Monitoring - Überwachung von Geschäftsprozessen, Marktdatenstreaming von Rohstoff- und Aktienkursen und das Überwachung der Sensor Netzwerke von technischen Anlagen. CEP erkennt in den Anwendungsgebieten komplexe Ereignisse und reagiert auf diese, indem es Rohstoffe kauft, einen Geschäftsprozess startet oder die Kapazität einer Maschine erhöht. Um den Nutzer über diese Ereignisse zu informieren wird CEP meist mit Visualisierung betrieben.[18] Im Gegensatz zu relationalen Datenbanken, die eine einmalige Fragestellung durch einen statischen Datenbestand beantworten, muss CEP Daten unbegrenzter Datenströme analysieren. Aus diesen Datenströmen filtert CEP Events, häuft Informationen an und stellt sie mit Erkenntnissen anderer Datenströme in Beziehung. Komplexe Events sind das Resultat, deshalb die Namensgebung ?Complex Event Processing?. Da CEP einen hohen Leistungsanspruch an die Hardware hat, läuft die Analyse der Datenströme im Hauptspeicher ab. Um die Stabilität der Anwendung zu gewährleisten, muss das CEP-System überwacht werden, um Auslastungsmaxima frühzeitig zu erkennen.[19] 3.3.2.3 Search und Discovery Um Daten mit ähnlichen Informationen zu finden wird Search and Discovery angewendet. Dem Nutzer werden neben der Hauptantwort auch Antworten gezeigt, die mit der Hauptantwort in Beziehung stehen. Wie in der Vogelperspektive, ist es dem Nutzer erlaubt, über seine Hauptantwort auf Alternativen zuschauen. So kann der Nutzer weitere Informationen und Relationen der Daten entdecken (Disvover). Open-Source Software für Search and Discovery sind Lucene und ElasticSearch, sie sind unkompliziert und lassen sich kostengünstig betreiben. So können große Datenmengen nach einem Stichwort durchsucht werden, z.B. "Kosten". Neben den genauen Ergebnissen des Suchwortes, werden ebenfalls Ergebnisse die Facetten des Wortes enthalten oder mit dem Suchwort in Beziehung stehen, also "Vollkosten" oder "Ausgaben". Des Weiteren kann Search and Discovery Begriffe mit einem ähnlichen Klangbild erkennen und das eingegebene Suchwort vervollständigen.[20][16]Suchmaschinen wie Google oder Bing und Onlinehändler wie Amazon und Ebay unterstützen Search and Discovery, um dem Kunden durch die alternativen Vorschläge einen besseren Überblick auf das Angebot zu bieten 3.3.2.4 Query Standardabfragen von relationalen Datenbanken werden über SQL erledigt, da SQL relationale Alegebra verwendet. SQL gibt es verschiedenen Versionen, die sich nur leicht durch wechselnde Sprachgebräuche unterscheiden. Die Abkürzung SQL bedeutet Structured Query Language. Die Abfragen der relationalen Datenbanken werden als Zeilen und Spalten in Tabellenform ausgegeben. Eine Datenbank auf die SQL zugreift kann dabei wie folgt aussehen.[16][21] KundenNr Name Umsatz 3.3.2.1 Batch-Processing 11 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 123 Schmidt 1500 160 Huber 800 173 Müller 2100 Als Abfragen können folgende Operationen verwendet werden: Selektion, Projetion, Vereinigung (von mehreren Tabellen), Schnitt, Differenz, Verbund und Division. Nachfolgend wird die Operation "Selektion" veranschaulicht. SQL Anfrage: SELECT * FROM Umsatz WHERE Name = 'Huber' - Zeigt den Umsatz für Huber an. (Es werden alle Spalten angezeigt, da SELECT * alle Spalten ausgibt.)[21][22] KundenNr Name Umsatz 160 Huber 800 SQL kann auch im Hadoop durch Hadoop Hive verwendet werden. So können Nutzer die SQL beherrschen Hadoop verwenden.[16] 3.3.3 Analytische Verarbeitung 3.3.3.1 Text und semantische Analyse Nicht in Tabellenform, sondern in Texten wie z.B. Artikeln, E-Mails, Publikationen oder Beiträgen in Blogs, ist das meiste Wissen erhalten. Um Texte in Bereiche einordnen oder Beschlagworten zu können, müssen die Texte nach Schlüsselwörtern durchsucht werden. Um Schlüsselwörter oder Personennamen zu erkennen und den Themenbereich des Textes zu bestimmen werden semantische Textanalysen verwendet. Dazu kann mit lexikonbasierten Named Entity Recognition (NER) der Text nach Schlagwörtern wie Personen, Firmen oder Orten durchsucht werden. Da es eine Vielzahl von möglichen Schlagwörtern gibt, kann das Lexikon sehr groß und umfangreich werden. Des Weiteren kann man die Mehrdeutigkeit von Schlagwörtern nicht vermeiden, wie etwa "Apple" als Firmenname oder als Obst. Deshalb werden offenen NER Systeme verwendet, die das Schlagwort an ihrem Kontext überprüfen und einordnen. Wurde z.B. "Hans Meier" als Person eingeordnet, ist allerdings noch nicht bekannt um welche Person es sich genau handelt. Es könnte ein Politiker oder Fernsehstar sein.[23] 3.3.3.2 Predictive Analytics Um Entscheidungen für die Zukunft vorauszusagen, wird Predictive Analytics verwendet. Bisher konnten BI-Systeme die Fragen des "Was und Warum ist etwas passiert?" beantworten. Predictive Analytics geht einen Schritt weiter, mithilfe von Daten der Vergangenheit sollen Szenarien der Zukunft entwickelt werden. Predictive Analytics greift dazu auf Data Mining Methoden zurück und erweitert diese um statische Berechnung und Simulationen. Die zu analysierenden werden dem Data Warehouse entnommen, dabei läuft Predictive Analytics in drei Teilzyklen ab.[24][25] 1. Descriptive (Beschreiben) - Descriptive erkennt Muster und Beziehungen der Datenstruktur. 2. Predictive (Vorhersagen) - Predictive gibt eine Vorhersage über das Verhalten der Daten ab. 3. Prescriptive (Empfehlen) - Prescriptive spricht bei bestimmten Verhaltensweisen Empfehlungen aus.[26] Durch diese Vorhersagen und Empfehlungen können Händler genauer ihre Absatz und Retourenquote prognostizieren und verbessern.[25] 3.3.2.4 Query 12 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 3.3.3.3 Machine Learning Machine Learning beschreibt die Fähigkeit von Software neues Wissen selbstständig zu erlernen. Diese Funktion wird z.B. bei den persönlichen Empfehlungen von Amazon verwendet. Dazu muss das Programm neue Erfahrungen Sammeln, um die gewünschte Aufgabe zu erfüllen. "A computer program is said to learn from experience E with respect to some class of tasks T and performance measure P, if its performance at tasks in T, as measured by P improves with experience E."[27] Um die gesammelten Daten verwenden zu können, müssen folgende vier Schritte durchlaufen werden: 1. Daten: Verschieden Ausgangsdaten stehen zu einem Ereignis, wie in einer mathematischen Gleichung, X steht zu Y wie: f(x) = y. 2. Reinigen: Danach werden die gewonnenen Daten von Ausreißern und falschen Aufnahmen bereinigt, indem Standards definiert werden. 3. Modell: Aus dem standardisierten Datensystem wird ein Modell erstellt. 4. Vorhersage: Anhand des Modells kann das Ereignis bei bekannten Ausgangsdaten vorhergesagt werden.[28] 3.3.4 Visualisierung Um das gewonnenen Datengold aus dem Berg der Informationen für den Nutzer besser greifbar zu machen, werden die Daten visuell dargestellt. Das visuell dargestellte Daten besser nachzuvollziehen sind, beweist das Anscombe's Quartet. (Abbildung 4 und 5) Dabei werden Datenpunkte mit Abweichungen, sogenannten Ausreißern, in Tabellenform und visuell in Graphen dargestellt.[29] Des Weiteren lassen sich Erkenntnisse die in Echtzeit ausgewertet werden für den Nutzer besser visuell darstellen lassen, wie unter Punkt-3.3.2.2 Streaming und Complex Event Processing behandelt wurde. ung an: Parikh (2014)[29] g 5: Anscombe's Quartet In Anlehnung an: Parikh (2014)[29] Abbildung 6: Anscombe's Quartet 3.3.3.3 Machine Learning 13 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 3.3.4.1 Dashboards Ein Anhäufen von visualisierten Daten allein genügt nicht, um eine Entscheidungsgrundlage zu schaffen. Sie müssen auch so zusammengefasst werden, dass alle Informationen im Überblick sind. Diese Übersichten werden ?Dashboard? genannt, ihr Name wurde an Cockpits der Autos oder Flugzeugen angelehnt, bei denen der Nutzer alle wichtigen Informationen strukturiert überblicken kann. Diese Management Dashboards sind Teil des Management Cockpits, die zur Entscheidungsfindung unterschiedlicher Instanzen genutzt werden, dazu zählen das Controlling und die Geschäftsführung. Im Gegensatz zu Reports können Dashboards die Informationen in einer Darstellung wiedergeben, die mehrschichtig ist. Dieses Prinzip wird Shneidersmans Mantra genannt. So kann interaktiv auf einen Themenbereich fokussiert werden, welche in der nächsten Schicht weiter aufgegliederte Information wiedergibt. Nach Shneiderman: Overview first, Zoom and filter und Details on demand.[30] Beispielsweise 1.Ebene ?Umsatz Bundesländer, 2. Ebene-Umsatz Städte, 3. Ebene-Umsatz Filialen. Die benötigte Zeit für die Bereitstellung der Entscheidungsgrundlagen ist von großer Bedeutung, wie nachstehende Tabelle zeigt, die Unternehmen in verschiedenen Marktpositionen auf den Erhalt der Informationen vergleicht.[31] In Anlehnung an: Bitkom (2014) Seite 75[32] Abbildung 8: Reife des Unternehmens 3.3.4.1 Dashboards 14 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 3.3.4.2 Real-time intelligence Analysen in Real-time werden in Animationen dargestellt, anstatt in starren Graphen, die eine zeitliche Dynamik nicht zulassen. Die große Herausforderung dabei ist die Velocity der Daten im Big Data, denn die Daten müssen für Real-Time schnell genug zur Verfügung stehen und Verarbeitet werden. Das heißt zwischen Gewinnung und Ausgabe der Daten sollten nur Millisekunden vergehen. Um dabei keinen riesigen Datenberg anzuhäufen, der das System verlangsamt, werden durch Streaming und CEP die relevanten Daten herausgefiltert, logisch verknüpft und analysiert. Da dieser Prozess bei großen Datenströmen nicht genau in Real-Time realisiert werden kann, wird auf von Near-Real-Time gesprochen, bei der im Minutentakt animierte Darstellung bereitgestellt werden.[33] 4 Einsatz von Big Daten in der Konsumgüterbranche 4.1 Marketing & Vertrieb 4.1.1 Kostenreduzierung Der Einsatz von Big Data im Marketing und Vertriebsabteilungen erlaubt es die Produkt- und Serviceangebote gezielt auf Kundengruppen, bzw. einzelne Kunden zuzuschneiden und dadurch Streuverluste zu reduzieren.[34] Dabei zielen die meisten Anwendungsszenarien auf die Erhöhung der Transparenz und Effizienz von Produktund Service Angeboten ab.[35] Zur Erfolgsmessung der durchgeführten Werbemaßnahmen wird eine große Zahl von Daten zum Nutzerverhalten erhoben.[36] Im Internet-Marketing steht das Online Targeting (target = Ziel) für das zielgruppenspezifische schalten von Werbemaßnahmen, um die oben skizierten Streuverluste gegenüber den klassischen Medien, wie Print, Radio und TV zu verringern. Daher ist unter Online Targeting die gezielte Adresssierung von Online-Werbung zu verstehen. Zu diesem Zweck werden verschiedene Techniken eingesetzt, um das Kaufverhalten von Nutzern im Internet genau zu beobachten und zu analysieren. Dazu werden auf den jeweiligen Computern Cookies platziert und/oder die IP-Adresse des Nutzers beim Besuch der Webseite gespeichert, wodurch die Möglichkeit besteht Webseiten und Angebote an den individuellen Kundenbedürfnissen auszurichten. [37] Dabei nutzen die unterschiedlichen Erscheinungsformen des Online Targeting vielfältige Kriterien, um Zielgruppen im Internet noch genauer einzuordnen und gezielt anzusprechen. [38] Insbesondere besteht beim Online Targeting der Vorteil in der Nutzung von Echtzeitinformationen, welche es erlauben laufende 3.3.4.2 Real-time intelligence 15 Einsatz_von_Big_Data_in_der_Konsumgüterbranche Optimierung auf Basis der Nutzerreaktion durchzuführen.[39] Eigene Abbildung Abbildung 9: Targeting Folgende Erscheinungsformen des Online Targeting lassen sich unterscheiden: • Technisches Targeting Das technische Targeting, welches die einfachste Form der Targeting-Technologie darstellt, basiert auf Daten aus der Soft- und Hardwareumgebung des Nutzers. Hiermit wurde eine rudimentäre gezielte, automatische Werbeadressierung anhand geografischer Merkmale und der Werbekontaktzahl (Frequenzy Capping), möglich.[40] • Sprachbasiertes Targeting Das sprachbasierte Targeting wird unterschieden in Keyword Targeting (Suchwort-Targeting), Contextual Targeting (wortbasiertes Targeting) und semantisches Targeting. Welche die Werbung auf Basis aktiver Texteingabe von Nutzern oder auf Basis des Inhalts einer Webseite ausliefern. Beim Keyword Targeting wird mit der Suchanfrage im Zusammenhang stehende Werbung auf der Ergebnisseite angezeigt (zum Beispiel Google Adwords). Wohingegen beim semantischen Targeting nicht nur einzelne Wörter, sondern auch Wortkombinationen berücksichtigt werden. Beim Contextual Targeting werden beispielsweise in Blogs Werbebanner mit thematischer Übereinstimmung zum Inhalt platziert, um entsprechend thematisch interessierte Nutzer zu erreichen (zum Beispiel Google AdSense).[41] • Behavioural Targeting Durch das Behavioural Targeting lassen sich Nutzer auf Grund ihres Online Verhaltens klassifizieren und Werbung unabhängig der aktuell besuchten Webseite schalten. Hierfür werden vorwiegend Cookies auf dem Gerät des Nutzer platziert, um das Surfverhalten über verschiedene Webseiten (Page Visits) zu 4.1.1 Kostenreduzierung 16 Einsatz_von_Big_Data_in_der_Konsumgüterbranche tracken. Aus dem Surfverhalten des Nutzers wird versucht auf die Interessen und Präferenzen des Nutzers zu schließen und darauf basierend Werbemittel zu platzieren.[42] Durch den Einsatz der geschilderten Online Targeting-Technologien ergeben sich nachstehende Vorteile:[43] • Steigerung von Verkaufszahlen Personalisierte Werbung führt zu einem effizienteren Werbemitteleinsatz. Umsatz und Gewinn können dadurch gesteigert werden. • Experimente Das Online Targeting ermöglicht eine einfachere und effizientere Möglichkeit, um Preise und Angebote bei unterschiedlichen Zielgruppen zu testen. • Neukundengewinnung und Bestandskundenbindung Individuelle Angebote können Erstbesucher von Webseiten zum Erstkauf stimulieren, wohingegen Bestandskunden besondere Angebote angedient werden können. Dazu bieten sich insbesondere die Steuerung von Anreizen über Informationen über die Besuchshäufigkeit, Kauffrequenz oder dem letzten Einkauf an. • Vergleich mit Wettbewerbspreisen Käufer, die über Preissuchmaschinen oder Webseiten der Mitbewerber die eigen Unternehmenswebseite besuchen, können durch das Online Targeting identifiziert werden und dadurch spezielle Kaufanreize, beispielsweise durch Sonderpreise, geboten werden. 4.1.2 Umsatzsteigerung Durch Big Data-Analysen von Kundendaten eröffnen sich Cross-Selling Potenziale, folglich dem Verkauf von komplementären Produkten und Up-Selling Potenziale, dem Verkauf höherwertiger Produkte. Dies kann erzielt werden, durch die Analyse von Kundendaten wie Transaktionen, demografische Daten und Standortdaten, um den Kunden die richtigen Angebote, zum richtigen Zeitpunkt anzubieten.[44] 4.1.3 Markt- & Wettbewerbsanalyse Daten zur Markt- und Wettbewerbsanalyse können mit verschiedenen intelligenten Verfahren erhoben werden und erweitern dadurch die Analysemöglichkeiten. Mit Screen Scraping lassen sich Webseiten der Wettbewerber maschinengesteuert auslesen. Die Semantische Auszeichnung gibt Hinweis über den Stellenwert einer Information und Ergebnisse aus Suchmaschinen ermöglichen Rückschlüsse auf regionale Märkte und Sortimente.[45] • Screen Scraping Durch das Screen Scraping besteht die Möglichkeit erhebliche Datenmengen aus fremden Internetpräsenzen auszulesen und durch Auswertungen neue Erkenntnisse zu gewinnen. Die Entnahme großer Datenmenge aus öffentlich zugänglichen Informationen wird von zahlreichen Plattformen durch 4.1.2 Umsatzsteigerung 17 Einsatz_von_Big_Data_in_der_Konsumgüterbranche die Nutzungsbedingungen untersagt. Seit 2009 sind unterschiedliche Entscheidungen seitens der Gerichte ergangen, in denen Klagen der Datenbankhersteller gegen unautorisierte Datenübernahme zurückgewiesen worden sind.[46] • Semantische Auszeichnung Dadurch, dass Webseiten mit einem Metadatensatz versehen sind, können intelligente Softwareagenten mit Hilfe der semantischen Auszeichnung erkennen, ob die gefundene Information relevant ist, respektive für den jeweiligen Zweck verwendbar ist.[47] So konstatiert die Bitkom in ihrer Studie "Big Data im Praxiseinsatz" >>Big Data-Analysen verbessern insgesamt die Basis für die Entwicklung fundierter Unternehmens- und Produkt- und Marktstrategien.<<[48] 4.2 Forschung & Entwicklung 4.2.1 Produktneuentwicklungen- und verbesserungen Durch Big Dat-Analysen von Patendatenbanken können neue Trends und neue Produktideen frühzeitig erkannt werden. Die Analyse von Messdaten (zum Beispiel Sensordaten)aus verschiedenen Quellen führen zu genaueren Erkenntnissen über die Marktreife und Qualität des Produktes. Zusätzlich können Nutzermeinungen aus Social-Media-Kanälen oder Foren in die Analyse einfließen und verringern somit die die Forschungs- und Entwicklungskosten und verkürzen die Time-to-Market.[49] So liefern etwa Social-Media-Plattformen Meinungen zu Produkten und Dienstleistungen, die genutzt werden können, um neue Produktideen zu generieren oder Verbesserungspotenziale aufzudecken. Ebenso können diese Daten für Sentimentanalysen oder für Auswertungen zur Markenwahrnehmung verwendet werden.[50] • Sentimentanalysen/Opinion Mining Durch das Sentiment (engl. Gefühl) können wichtige Erkenntnisse bezüglich der Akzeptanz von Produkten der Wahrnehmung von Marken, gerade aus nicht neutralen, subjektiven Social-Media Beiträgen gewonnen werden. Damit stellt das Sentiment einen Einstiegspunkt in die Social-Media-Analyse dar.[51] Eine direkte Analyse über klassische Verfahren wie das Data Mining oder Business Intelligence ist hier nicht praktikabel, da hier die Daten unstrukturiert vorliegen und in erheblichen Teilen auf natürlicher Sprache basieren. Daher gilt bei der Analyse von Social-Media Beiträgen der Nutzer so zu strukturieren und zu analysieren, um daraus eventuell ein Stimmungsbild abzuleiten.[52] Gegenüber den traditionellen Marktforschungsinstrumenten, die gezielt eine Stichprobe einer Zielgruppe befragt und aus den Ergebnissen auf die Allgemeinheit schließt, setz die Analyse von Stimmungsdaten systematisch bei möglichst großen Datenmengen an. Die daraus extrahierten Inhalte können dabei unterstützen, die öffentliche Meinung zu einer bestimmten Fragestellung oder die Einstellung der Kunden zu einem Produkt zu verfolgen. Der Vorteil besteht vor allem in der Tatsache, dass die Daten nicht aufwendig erhoben werden müssen und stets auf dem aktuellsten Stand sind. Um anschließend ein messbares Ergebnis zu erhalten müssen die Daten zunächst extrahiert, strukturiert und angereichert werden. Dazu werden die Inhalte daraufhin untersucht, ob sie positive, neutrale oder negative Bewertungen enthalten.[53] 4.1.3 Markt- & Wettbewerbsanalyse 18 Einsatz_von_Big_Data_in_der_Konsumgüterbranche Nach der Bewertung der Daten können diese mit anderen Datenquellen kombiniert und zum Beispiel Meinungen einem bestimmten Kundensegment zugeordnet werden. Zur Veranschaulichung der eruierten Ergebnisse bietet sich anschließend eine Business Intelligence Lösung an.[54] 4.2.2 Social-Media Trendanalysen Analyse von Social-Media-Kanälen eröffnet die Chance frühe Signale für gesellschaftliche Trends zu erkennen und damit Märkte mit genau darauf abgestimmten Produkten zu erschließen.[55] Erfolgt die Trendanalyse in der klassischen BI indem der Verlauf der Vergangenheit in die Zukunft extrapoliert wird und im Wesentlichen auf strukturierten vorliegenden Zahlenreihen erfolgt, erlaubt die semantische Analyse auch Trendaussagen auf Basis von unstrukturierten, textbasierten Daten. Auf Grund der Tatsache, dass Daten im Internet (fast) nie gelöscht werden, können die Veränderungen von Meinungen, Ideen und Wünschen im Zeitverlauf erkannt und analysiert werden. Durch die semantische Analyse von Inhalten in sozialen Medien, können zukünftige Entwicklungen (Modetrends, Konsumverhalten, Imageveränderungen) deutlich schneller prognostiziert werden, als dies früher möglich war. Ein entscheidender Vorteil liegt darin begründet, dass die Aussagen der Personen ohne externe Beeinflussung, wie beispielsweise einer Befragungssituation, innerhalb eines scheinbar freien und anonymen Raums ohne Korrektiv getätigt werden und somit der Wahrheitsgehalt einer Einzelaussage sehr hoch ist.[56] Ein weiterer interessanter Einsatzzweck ist die Analyse von schwachen Signalen, welche Signale beschreibt, die noch im Grundrauschen stecken. Auf Big Date-Analysen bezogen können dies beispielsweise Themen sein, die in Suchmaschinen auf Grund ihrer geringen Verbreitung noch nicht gefunden werden. Für Unternehmen die dieses "Datengold" heben, kann dies ein Wettbewerbsvorteil darstellen.[57] 4.3 Produktion, Service & Support Big Data-Analysen ermöglichen einen ganzheitlichen Blick auf die Fertigungsprozesse, indem sie Daten unterschiedlicher Quellen verknüpft. Dafür werden Daten zu den Produkten, Produktions- und Lieferketten systematisch erfasst und analysiert. 4.3.1 Produktionsoptimierung Durch den Beitrag des Internet der Dinge (IoT)oder der M2M-Kommunikation (Maschine-to-Maschine) erfassen Sensoren an Produkten und entlang von Produktions- und Lieferketten Daten, mit deren Hilfe die Fertigungsprozesse optimiert werden können. Die meisten dieser Daten fließen in Echtzeit in die Datenbanken ein und dienen der Überwachung und Optimierung von Prozessen.[58] Durch den verstärkten Einsatz von RFID (radio-frequency-identification) in der Produktion steigt die Menge der Daten weiter an.[59] Immer mehr Produzenten gehen dazu über, Daten unterschiedlicher Quellsysteme zu verknüpfen und erhöhen damit die Komplexität der Analysen. Andernorts nimmt die Fertigungstiefe ab. So werden zum Beispiel die einzelnen Komponenten von Produkten von unterschiedlichen Herstellern geliefert und erhöhen damit die Herausforderungen an eine übergreifende Qualitätssicherung. Zur Sicherstellung der Qualitätsanforderungen können Daten aus CAD-Systemen, dem Maschinenbau, der Fertigung sowie aus dem Product-Lifecycle-Management (PLM) aggregiert und zeitnah ausgewertet werden.[60] • M2M-Kommunikation 4.2.1 Produktneuentwicklungen- und verbesserungen 19 Einsatz_von_Big_Data_in_der_Konsumgüterbranche Die M2M-Kommunikation beschreibt die Kommunikation zwischen Geräten und Diensten, dabei meint Machine-to-Machine (M2M) den Datenaustausch zwischen Endgeräten.[61] Der automatisierte Informationsaustausch zwischen Sensoren in Maschinen, Automaten, Fahrzeugen oder Container erfolgt hierbei untereinander oder mit einer Leitstelle. Die für Big Data-Analysen zur Verfügungen stehenden hohen Datenvolumina die aus M2M-Umgebungen entstehen, sind immens, und werden durch die weitere Verbreitung von Sensoren exponentiell ansteigen. Das Internet der Dinge (IoT) leistet dazu einen entscheidenden Beitrag.[62] Die Nutzung von Sensordaten wird derzeit noch durch ihren Umfang und ihre Struktur eingeschränkt. Dadurch, dass Sensoren ständig in Betrieb sind, steigt mit der zunehmenden Anzahl an Sensoren auch exponentiell die Datenmenge an. Dies zwingt die Unternehmen entweder die Datenmenge zu begrenzen oder die Sammlung von Daten einzuschränken. Hinzukommt, dass Sensordaten zum Zeitpunkt ihrer Erhebung vorwiegend unstrukturiert vorliegen.[63] 4.3.2 Early recognition von Produktionsproblemen Durch die Verbindung von aktuellen Produkt- und Sensorinformationen mit Informationen aus dem Service oder früheren Fehlern, lassen sich Produkte auch im laufenden Produktionsbetrieb zuverlässig überwachen. Daraus lassen sich intelligente Diagnosen mit Trendanalysen erstellen, um im Falle eines Defektes die Fehlerquelle unverzüglich festzustellen und Korrekturen im Fertigungsprozess einzuleiten. Big Data ermöglicht die Auswertung von sämtlichen durch Sensoren erfassten Informationen über den Zustand von Anlagen und relevante Umgebungsdaten. Dies wiederrum ermöglicht eine vorbeugende Wartung (Predictive Maintenance), um frühzeitig Störungen zu erkennen und ungeplante Stillstände zu verhindern.[64] • Predictive Maintenance (vorbeugende Wartung) Der Einsatz von Big Data Technologien kann helfen, die Kosten für Wartung (Maintenance) zu reduzieren und dennoch die Risiken für Ausfälle gering zu halten, indem Daten aus unterschiedlichen Quellen in die Analysen eingebunden werden. So können beispielsweise Wetterdaten, Umweltdaten, Nutzungsdaten und Sensordaten die Qualität der Vorhersagen signifikant verbessern. Die Herausforderung besteht anschließend darin, aus den übertragenden Sensordaten subtile Muster zu identifizieren und daraus Wartungsbedarf, respektive Wartungszyklen abzuleiten.[65] 4.4 Distribution & Logistik 4.4.1 Optimierung der Supply Chain Big Data Technologie ermöglicht es die vielfältigen Daten der Produktions- und der Lieferkette zeitnah zu verarbeiten. Zu den Daten der eigenen Produktionsstandorte, kommen Daten der Auftragsfertiger, der Zwischenlager und der Logistikpartner, sowie Prognosen der künftigen Absatzmengen hinzu. Eine zeitnahe Analyse der Daten ist hier erfolgsentscheidend, um auf Störungen der Lieferkette adäquat reagieren zu können.[66] Dabei hat Big Data unter anderem den Effekt durch bessere Voraussicht und Beweglichkeit Wettbewerbsvorteile gegenüber der Konkurrenz zu erreichen und die Profitabilität bei steigender Komplexität der Lieferkette zu erhöhen. Ineffizienzen lassen sich durch gezielte Big-Data Analysen in der gesamten Lieferkette aufdecken. So lassen sich beispielsweise durch den Einsatz von Big Data-Technologien Preisoptimierung und Inventarmanagement mit Echtzeit-Warnungen innerhalb der Lieferkette und lokaler sowie globaler 4.3.1 Produktionsoptimierung 20 Einsatz_von_Big_Data_in_der_Konsumgüterbranche Nachfragetrends verknüpfen, wodurch sich Bestände optimieren und Fehlmengen vermeiden lassen.[67] 4.4.2 Optimierung der Logistik Immer mehr Fahrzeuge werden mit Sensoren und Steuerungsmodulen ausgestattet, die es ermöglichen die Fahrzeugdaten, wie Benzinverbrauch, den Zustand von Verschleißteilen oder Positionsdaten zu erfassen und daher für Big Data-Analysen nutzbar zu machen. Auf Basis dieser Daten können die Transporte weltweit getrackt werden, Lieferungen können zeitnah geplant, sowie Stillstandzeiten und Leerfahrten vermieden werden. Werkstattaufenthalte können an den tatsächlichen Bedarf angepasst werden. Transportzeiten können minimiert werden, indem die analysierten Daten zurück in die Cockpitsystem fließen und auf Basis der aktuellen Verkehrslage die Routen automatisch optimieren.[68] Auf Grund der optimierten Logistik können beispielsweise die Lagerbestände der Produzenten reduziert werden, da geringere Sicherheitsbestände vorgehalten werden müssen. 4.5 Finanz- und Risikocontrolling 4.5.1 Echtzeit-Reaktionen auf Geschäftsinformationen Der Einsatz von Big Data-Technoligen bietet die Möglichkeit Daten aus unterschiedlichen Quellen schnell zusammenzuführen und für die Entscheidungsfindung aufzubereiten. Gegenüber klassischen Business-Intelligence-Lösungen, auf den hauptsächlich formatierte Berichte auf starren Datenmodellen zum Einsatz kommen, ermöglichen Big Data-Technologien in einem viel stärkeren Maß die gezielte Beantwortung von Ad-hoc Fragestellungen. So können Informationen, respektive Daten aus mehreren Quellsystemen für eine Analyse verwendet werden ohne dass vorher ein klassisches Datenmodell aufgebaut werden muss. [69] 4.5.2 Simulation, Vorhersagen und Szenarienbildung Durch den Einsatz von Big Data-Technologien werden >>Was wäre, wenn<<-Analysen möglich. Waren die Berechnungen von Vorhersagemodellen mit klassischen Werkzeugen ein aufwändiger Prozess, der mit großen Datenmengen und langen Rechenzeiten verbunden war, können durch Big Data Technologien viele verschiedene Modelle berechnet werden und in ihren Auswirkungen verglichen werden. Dies ermöglicht die Simulation von verschieden Szenarien, respektive Entwicklungen aus denen die beste Alternative ausgewählt werden kann.[70] 5 Big Data und Datenschutz Während in den USA vor allem die Chancen von Big Data-Technologien gesehen werden, stehen in Deutschland eher die Risiken und die Angst vor unkontrollierter Überwachung im Fokus. Das deutsche Datenschutzrecht ist gegenüber dem US-amerikanischen Recht sehr restriktiv.[71] >>Ein wichtiger Grundsatz des Bundesdatenschutzgesetztes (BDSG) ist das Verbotsprinzip: Personenbezogene Daten dürfen nur erhoben, verarbeitet und oder genutzt werden, wenn der Betroffene eingewilligt hat oder wenn eine Rechtsvorschrift dies ausdrücklich erlaubt. Daten dürfen nur für den Zweck genutzt werden, für den sie erhoben worden sind (Zweckbindung). Es sollen möglichst wenige personenbezogene Daten verarbeitet werden 4.4.1 Optimierung der Supply Chain 21 Einsatz_von_Big_Data_in_der_Konsumgüterbranche (Datensparsamkeit).<< [72] Unternehmen sollten bereits in der Konzeptionierungsphase einer Big Data-Anwendung eruieren, welche Datenverarbeitung erforderlich ist, wie sie wirksame Einwilligungen erhalten und wie die Verfahren zum Privacy-Preserving Data Mining anzuwenden sind. Die rechtliche Zuverlässigkeit sollte bereits bei der Entwicklung geprüft werden, da sich in der Anfangsphase leichter Design Änderungen vornehmen lassen als nach der Einführung der Anwendung.[73] 5.1 Privacy-Preserving Data Mining Das Privacy-Preserving Data Mining liefert Antworten auf die Fragen, ?Welche Daten und Muster können ohne Bedenken veröffentlicht werden??, ?Wie kann eine Bestimmte Fragestellung so analysiert werden, dass dabei keine sensiblen Informationen offengelegt werden??.[74] Auf die zwei Ausprägungen des Privacy-Preserving Data Mining, die Anonymisierung und das sichere verteilte Daten Mining wird im Folgenden näher eingegangen:[75] • Anonymisierung Das deutsche Bundesdatenschutzgesetzt (BDSG) unterscheidet sehr stark zwischen personenbezogenden Daten (z.B. Name, Geburtsdatum, Adresse, E-Mail-Adresse) und pseudonymen bzw. anonymen Daten. Dabei gelten Daten bereits als personenbezogen, wenn der Betroffene potenziell identifizierbar ist. Für die personenbezogenen Daten gelten für deren Verwendung starke gesetzliche Hürden, wohingegen bei pseudonymen bzw. anonymen Daten wesentliche geringere Datenschutzanforderungen bestehen. Folglich sind nicht nur identifizierende Daten wie Name oder Anschrift personenbezogen, sondern auch Daten die durch Kombination mit anderen Attributen zu Identifizierung des Individuums verwendet werden können (sogenannte Quasi-Identifizierung). Um die Identifizierung des einzelnen zu verhindern setzen Verfahren auf Generalisierung und Unterdrückung. Bei der Generalisierung werden die Attribute so modifiziert, dass die Attribute in mehreren verschiedenen Datensätzen identisch sind und somit keinen Rückschluss mehr auf das Individuum zulassen. Zum Beispiel wird hierbei eine fünfstellige Postleitzahl auf vierstellen gekürzt. Bei der Unterdrückung werden einzelne Datensätze entfernt. • Sicheres Verteiltes Data Mining Durch das verteilte Data Mining werden zentrale Datenbestände auf mehre Datenbanken aufgeteilt, um so im Falle eines Sicherheitsleck nicht die gesamten Information zu gefährden. Möglichkeiten hierzu bietet das ?Secure Multiparty Computation?-Verfahren, welches Analysen auf verteilten Daten so durchführt, dass die Teilnehmer außer dem Ergebnis keine weitergehende Informationen 5.2 Ganzheitliche Sicherheitskonzepte Ferner sollten Unternehmen für ein ganzheitliches Sicherheitskonzept nachstehende Punkte berücksichtigen:[76] • Zugriffsbeschränkungen der Umgebung über Authentifizierung • Verschlüsselung der Daten • Maskierung der Daten (z.B. teilweises ausixen der Kreditkartennummer) 5 Big Data und Datenschutz 22 Einsatz_von_Big_Data_in_der_Konsumgüterbranche • Autorisierung (Zugriffsbeschränkungen auf das Big Data-System) • Auditing (Dokumentation der Nutzung, Lücken aufdecken im Sicherheitskonzept) • Datenübermittlung (Verschlüsselung der Daten) 6 Schlussbetrachtung 6.1 Fazit Diese Fallstudie hatte die Zielsetzung, einen Überblick über die möglichen Einsatzszenarien von Big Data anhand einer typischen Wertschöpfungskette in der Konsumgüterbranche zu geben. Die Literaturrecherche zu diesen Fallstudie zeigte, dass die Big Data-Technologie in allen Bereichen der Wertschöpfungskette einsetzbar ist und dies zu mehr Transparenz und Effizienz führt. Richtig eingesetzt leisten Big Data-Technologien einen entscheidenden Beitrag zur Produktivitätssteigerung der Unternehmen.[77] So erlaubt der Einsatz von Big Data-Technologie es den Unternehmen ihre Kunden gezielter anzusprechen, ihre Produktionsplanung an die aktuelle Nachfragesituation anzupassen, ihre Lieferkette in Echtzeit zu überwachen und ihre Produkte schneller und näher am Kundennutzen zu produzieren. Trends können von dem Unternehmen schneller erkannt und auf diese adäquat reagiert werden. Geschäftsinformationen lassen sich durch neue Erkenntnisse und aktuelle Daten anreichern, Simulationen und Szenarien geben eine sinnvolle Unterstützung bei der Entscheidungsfindung. Unternehmen können durch die Nutzung des Wissens, welches in großen Datenmengen steckt, effizienter werden und sich dadurch Vorteile gegenüber dem Wettbewerb verschaffen. 6.2 Ausblick Die zukünftigen Architekturanforderungen an eine Big Data-Lösung werden maßgeblich von der Datenvielfalt und von der Geschwindigkeit der Daten beeinflusst. Der aktuelle Stand der Technik macht es inzwischen möglich, alle für ein Unternehmen relevanten Informationen dauerhaft zu speichern. Dies ist im Hinblick auf den Datenschutz und die Datensicherheit nicht ohne Risiko. Daher muss diesem Punkt bei der Konzeptionierung, respektive bei der Einführung einer Big Data-Lösung ausreichende Beachtung geschenkt werden. Technologische Entwicklungen unterstützen immer mehr die Real-Time-Anforderungen von Unternehmen, weshalb davon auszugehen ist, dass die Technologien sich immer mehr vom klassischen Map-Reduce-Programmiermodell wegentwickeln werden.[78] Neue Trends, steigende mobile Endgeräte, das Internet der Dinge (IoT) und die weitere Verbreitung von Sensoren, lassen die Datenmengen auch zukünftig exponentiell ansteigen. Der Bereich Big Data wird daher auch in der weiteren Zukunft eine entscheidende Rolle in der IT haben und neue Wachstumschancen für Unternehmen eröffnen. 7 Anhang 7.1 Fußnoten 1. ? Vgl. King (2014), Kurzfassung 2. ? Vgl. Bitkom (2014), Seite 11 5.2 Ganzheitliche Sicherheitskonzepte 23 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 3. ? Vgl. Bitkom (2014) Seite 23 4. ? 4,0 4,1 4,2 4,3 Vgl. Bitkom (2014) Seite 12 5. ? Vgl. Dorschel (2015) Seite 260ff 6. ? Vgl. Neil Biehn 7. ? Vgl. Bitkom (2014) Seite 36 8. ? 8,0 8,1 Vgl. Dorschel (2015) Seite 278ff 9. ? 9,0 9,1 Vgl. Dorschel (2015) Seite 278 10. ? 10,0 10,1 10,2 Vgl. Fischer (2014) 11. ? Vgl. Apache (a) 12. ? Vgl. Dorschel (2015) Seite 279-288 13. ? Vgl. Dorschel (2015) Seite 279-288 14. ? 14,0 14,1 14,2 14,3 14,4 14,5 Vgl. Bitkom (2014) Seite 42-48 15. ? 15,0 15,1 Vgl. Walker-Morgan (2010) 16. ? 16,0 16,1 16,2 16,3 Vgl. Bitkom (2014) Seite 48-55 17. ? 17,0 17,1 17,2 17,3 17,4 Vgl. Apache (b) 18. ? Vgl. Eckert / Bry 19. ? Vgl. Seeger 20. ? Vgl. Fischer (2013) 21. ? 21,0 21,1 Vgl. Rausch 22. ? Vgl. Kelz. 23. ? Vgl. Adolphs (2015) 24. ? Vgl. Koeffer (2014) 25. ? 25,0 25,1 Vgl. Feindt (2012) 26. ? Vgl. Bitkom (2014) Seite 61f 27. ? Vgl. Mitchell (1997) Seite 14 28. ? Vgl. Klose (2015) 29. ? 29,0 29,1 29,2 Vgl. Parik (2014) 30. ? Vgl. Brown 31. ? Vgl. Dickerhof (2009) Seite 43 32. ? Vgl. Bitkom (2014) Seite 75 33. ? Vgl. Manhart 34. ? Vgl. Bitkom (2012), Seite 9 35. ? Vgl. Dorschel (2015), Seite 105 36. ? Vgl. Bitkom (2012), Seite 35 37. ? Vgl. Bauer / Greve / Hopf (2011), Seite 8ff 38. ? Vgl. Schlöge / Walter / Mühling (2007,2008) 39. ? Vgl. Bauer / Greve / Hopf (2011), Seite 10 40. ? Vgl. Bauer / Greve / Hopf (2011), Seite 7 41. ? Vgl. Bauer / Greve / Hopf (2011), Seite 8 42. ? Vgl. Bauer / Greve / Hopf (2011), Seite 13 43. ? Vgl. Bauer / Greve / Hopf (2011), Seite 9 44. ? Vgl. Dorschel (2015), Seite 105 45. ? Vgl. Bitkom (2012), Seite 35 46. ? Vgl. Dorschel (2015), Seite 237 47. ? Vgl. Haas (2007) 48. ? Bitkom (2012), Seite 35 49. ? Vgl. Dorschel(2015), Seite 106 50. ? Vgl. Bitkom (2012), Seite 37 51. ? Vgl. Bitkom (2013), Seite 279 52. ? Vgl. Bitkom (2014), Seite 58 53. ? Vgl. Bitkom (2014), Seite 105 7.1 Fußnoten 24 Einsatz_von_Big_Data_in_der_Konsumgüterbranche 54. ? Vgl. Bitkom (2014), Seite 105 55. ? Vgl. Bitkom (2012), Seite 37 56. ? Vgl.Dorschel (2015), Seite 325 57. ? Vgl. Dorschel (2015), Seite 326 58. ? Vgl. Bitkom (2012), Seite 38 59. ? Vgl. Bitkom (2012), Seite 38 60. ? Vgl. Bitkom (2012), Seite 39 61. ? Vgl. Sendler (2013), Seite 11 62. ? Vgl. Bitkom (2014), Seite 110f 63. ? Vgl. Bitkom (2014), Seite 111 64. ? Vgl. Bitkom (2012), Seite 39 65. ? Vgl. Härting (o.A.), Seite 57 66. ? Vgl. Bitkom (2012), Seite 39 67. ? Vgl. Buttkus / Eberenz (2014), Seite 82 68. ? Vgl. Bitkom (2012), Seite 40 69. ? Vgl. Bitkom (2012), Seite 41 70. ? Vgl. Bitkom (2012), Seite 41 71. ? Vgl. Bitkom (2012), Seite 43 72. ? Bitkom (2012), Seite 43 73. ? Vgl. Bitkom (2012), Seite 46 74. ? Vgl. GI (2010) 75. ? Vgl. GI (2010) 76. ? Vgl. Dorschel (2015), Seite 275 77. ? Vgl. King (2013), Seite 145f 78. ? Vgl. Dorschel (2015), Seite 277 7.2 Literatur- und Quellenverzeichnis Adolphs (2015) Apache (a) Apache (b) Adolphs, Peter: Semantische Textanalyse für deutsche Texte, 10.06.2015, URL: http://blog.neofonie.de/2015/06/10/semantische-textanalyse-fuer-deutsche-texte/, Abruf am 15.06.2015 1 o.V., Apache Software Foundation: Hadoop, Who uses Hadoop, URL: http://wiki.apache.org/hadoop/Pow 03.06.2015 16:23 o.V., Apache Software Foundation: Hadoop, Apache Pig Philosophy, URL: https://pig.apache.org/philos 12.06.2015 17:14 Bauer / Greve / Springer Fachmedien Wiesbaden GmbH, Wiesbaden 2011 Hopf (2011) o.V., Bitkom (Hrsg.) (2014): Big-Data-Technologien - Wissen für Entscheider. URL: Bitkom (2014) http://www.bitkom.org/files/documents/BITKOM_Leitfaden_Big-Data-Technologien-Wissen_fuer_Ents Abruf am 05.05.2015 Arns, T; Bentele, M.; Niemeier, J.; Schütt, P.; Weber, M. (Hrsg): 15. Kongress für Wissenmangement un Bitkom (2013) >>Wissensmanagement und Social-Media - Markterfolg im Innovationswettbewerb<<, GITO Verlag, Be o.V., Bitkom (Hrsg.) (2012): Big Data im Praxiseinsatz - Szenarien, Beispiele, Effekte. URL: Bitkom (2012) http://www.bitkom.org/de/publikationen/38337_73446.aspx, Abruf am 03.05.2014 Brown, Simon: Shneiderman's mantra, 2015, URL: Brown http://www.codingthearchitecture.com/2015/01/08/shneidermans_mantra.html, Abruf am 14.06.2015 21: Buttkus / Buttkus, M. , Eberenz, R. (Hrsg.) (2014): Controlling in der Konsumgüterindustrie - Innovative Ansätze Eberenz (2014) Springer Gabler, Wiesbaden 2014 7.2 Literatur- und Quellenverzeichnis 25 Einsatz_von_Big_Data_in_der_Konsumgüterbranche Dickerhof Dickerhof, Markus: Ein neues Konzept für das bedarfsgerechte Informations- und Wissensmanagement i (2009) Unternehmenskooperationen der Multimaterial-Mikrosystemtechnik, Karlsruhe, Univ., Abruf am 12.06.2 Dorschel (2015) Dorschel, Joachim (Hrsg.) (2015): Praxishandbuch Big Data: Wirtschaft - Recht - Technik, Springer Gab Eckert , Michael und Bry, Francois: Complex Event Processing (CEP), Institut fur Informatik, Ludwig-M Eckert / Bry München, URL: http://www.en.pms.ifi.lmu.de/publications/PMS-FB/PMS-FB-2009-5/PMS-FB-2009-513.06.2015 20:13 Prof. Dr. Feindt, Michael: Big Data und Predictive Analytics - der Nutzen von Daten für präzise Prognos Feindt (2012) in der Zukunft, Karlsruhe Institute of Technology KIT, 20.11.2012, URL: http://www-ekp.physik.uni-karlsruhe.de/~feindt/BigDataFrankfurtFeindt.pdf, Abruf am 07.06.2015 13:12 Fischer, Oliver B.: Volltextsuche mit ElasticSearch - Search and destroy, Heise 26.07.2013, URL: Fischer (2013) http://www.heise.de/developer/artikel/Volltextsuche-mit-ElasticSearch-1920454.html, Abruf am 07.06.2 Fischer, Oliver: Verarbeiten großer verteilter Datenmengen mit Hadoop, Heise 2014, URL: Fischer (2014) http://www.heise.de/developer/artikel/Verarbeiten-grosser-verteilter-Datenmengen-mit-Hadoop-964755. 06.06.2015, 18:43 Grosskreutz, Henrik; Lemmen, Benedikt; Ržping, Stefan: Data-Mining, Privacy-Preserving, Springer-Ve GI (2010) 2010, https://www.gi.de/service/informatiklexikon/detailansicht/article/data-mining-privacy-preserving.h Uhr) Haas, Matthias: Methoden kžnstlicher Intelligenz in betriebswirtschaftlichen Anwendungen, 1. Auflage, Haas (2007) Bremen Hamburg 2007 Härting Härting, Ralf-Christian: Big Data - Daten strategisch nutzen!, BoD - Books on Demand, Norderstedt Holland (2014) Holland, H. (Hrsg.) (2014): Digitales Dialogmarketing - Grundlagen, Strategien, Instrumente, Wiesbaden Kelz, Andreas: SQL und relationale Algebra, URL: https://www.hdm-stuttgart.de/~riekert/lehre/db-kelz/c Kelz 15.05.2015 18:57 King (2013) King, Stefanie: Big Data Potential und Barrieren der Nutzung im Unternehmenskontext, Springer Fachm Klose, Olivia: Machine Learning - Was, was nicht und wann?, 13.02.2015, URL: Klose (2015) http://oliviaklose.com/machine-learning-1-was-was-nicht-und-wann/, Abruf am 19:06.2015 15:20 Koeffer, Sebastian: Mit Predictive Analytics in die Zukunft blicken, 22.07.2014, URL: Koeffer (2014) http://www.computerwoche.de/a/mit-predictive-analytics-in-die-zukunft-blicken,2370894, Abruf am 12.0 Manhart, Klaus: Mythos ?Real-Time? Business Intelligence, IBM Experts, 10.09.2013, Mythos ?Real-Ti Manhart Intelligence, Abruf am 16.06.2015 15:03 Mitchell, Tom: McGraw Hill, 1997, URL: Mitchell (1997) http://personal.disco.unimib.it/Vanneschi/McGrawHill_-_Machine_Learning_-Tom_Mitchell.pdf, Abruf Parik, Ravi Anscombe?s Quartet, and Why Summary Statistics Don?t Tell the Whole Story, 21.04.2014, Parik http://data.heapanalytics.com/anscombes-quartet-and-why-summary-statistics-dont-tell-the-whole-story/, 17:40 Rausch, Christian: Datenbanken und SQL, 1999, URL: http://ab.inf.uni-tuebingen.de/teaching/ss03/asa/d Rausch 16.05.2015 19:32 Schlögel / Schlögel, M.; Walter, V.: Behavioaral Targeting: Chancen und Risiken einer neuen Form des Online Mar Walter / Stanoevska-Slabeva, K. (Hrsg.): Web 2.0: Die nächste Generation Internet, Nomos, Baden Baden, Seite 1 Mühling (2008) Targeting. Zielgruppen exakt online erreichen, Fischer, München 2007 Seeger, Bernhard: Complex Event Processing: Auswertung von Datenströmen - Kontinuierliche Kontroll Seeger http://www.heise.de/ix/artikel/Kontinuierliche-Kontrolle-905334.html, Abruf am 14.06.2015 17:34 Sendler, Ulrich (Hrsg.): Industrie 4.0: Beherrschung der industriellen Komplexität mit SysLM, SpringerSendler (2013) Heidelberg 2013 Walker-Morgan Walker-Morgan: NoSQL im Überblick, Heise 2010, URL: (2010) http://www.heise.de/open/artikel/NoSQL-im-Ueberblick-1012483.html, Abruf am 01.06.2015 22:12 7.2 Literatur- und Quellenverzeichnis 26