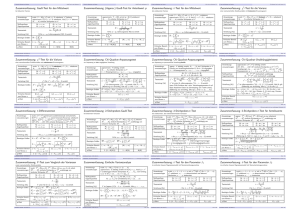

Zusammenfassung: Gauß-Test für den Mittelwert

Werbung

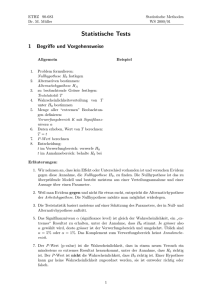

7 Tests für Mittelwert und Varianz

Gauß-Test für den Mittelwert 7.1

Zusammenfassung: Gauß-Test für den Mittelwert

7 Tests für Mittelwert und Varianz

Gauß-Test für Anteilswert p 7.2

Zusammenfassung: (Approx.) Gauß-Test für Anteilswert p

bei bekannter Varianz

Anwendungsvoraussetzungen

Nullhypothese

Gegenhypothese

exakt: Y ∼ N(µ, σ 2 ) mit µ ∈ R unbekannt, σ 2 bekannt

approximativ: E (Y ) = µ ∈ R unbekannt, Var(Y ) = σ 2 bekannt

X1 , . . . , Xn einfache Stichprobe zu Y

H0 : µ ≤ µ0

H1 : µ > µ0

H0 : µ = µ0

H1 : µ 6= µ0

Teststatistik

Verteilung (H0 )

Benötigte Größen

Kritischer Bereich

zum Niveau α

p-Wert

H0 : µ ≥ µ0

H1 : µ < µ0

Verteilung (H0 )

N für µ = µ0 (näherungsweise) N(0, 1)-verteilt

n

1X

X =

Xi

n i=1

(−∞, −N1− α2 )

∪(N1− α2 , ∞)

2 · (1 − Φ(|N|))

Benötigte Größen

(N1−α , ∞)

(−∞, −N1−α )

1 − Φ(N)

Φ(N)

Schließende Statistik (WS 2016/17)

Folie 132

7 Tests für Mittelwert und Varianz

t-Test für den Mittelwert 7.3

approximativ: Y ∼ B(1, p) mit p ∈ [0, 1] unbekannt

X1 , . . . , Xn einfache Stichprobe zu Y

Nullhypothese

Gegenhypothese

Teststatistik

X − µ0 √

n

σ

N=

Anwendungsvoraussetzungen

Kritischer Bereich

zum Niveau α

H0 : p ≤ p0

H1 : p > p0

H0 : p = p0

H1 : p 6= p0

√

b

p − p0

n

p0 · (1 − p0 )

N für p = p0 näherungsweise N(0, 1)-verteilt

n

1X

b

p=

Xi

n i=1

N= p

(−∞, −N1− α2 )

∪(N1− α2 , ∞)

2 · (1 − Φ(|N|))

p-Wert

(N1−α , ∞)

(−∞, −N1−α )

1 − Φ(N)

Φ(N)

Schließende Statistik (WS 2016/17)

Folie 134

7 Tests für Mittelwert und Varianz

Chi-Quadrat-Test für die Varianz 7.4

2

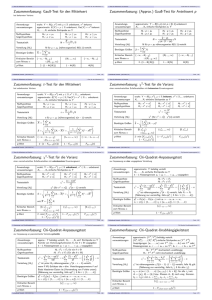

Zusammenfassung: t-Test für den Mittelwert

Zusammenfassung: χ -Test für die Varianz

bei unbekannter Varianz

einer normalverteilten Zufallsvariablen mit bekanntem Erwartungswert

Anwendungsvoraussetzungen

Nullhypothese

Gegenhypothese

exakt: Y ∼ N(µ, σ 2 ) mit µ ∈ R, σ 2 ∈ R++ unbekannt

approximativ: E (Y ) = µ ∈ R, Var(Y ) = σ 2 ∈ R++ unbekannt

X1 , . . . , Xn einfache Stichprobe zu Y

H0 : µ ≤ µ0

H1 : µ > µ0

H0 : µ = µ0

H1 : µ 6= µ0

Teststatistik

Verteilung (H0 )

t=

Anwendungsvoraussetzungen

Kritischer Bereich

zum Niveau α

Verteilung (H0 )

t für µ = µ0 (näherungsweise) t(n − 1)-verteilt

p-Wert

Schließende Statistik (WS 2016/17)

(−∞, −tn−1;1− α2 )

∪(tn−1;1− α2 , ∞)

2 · (1 − Ft(n−1) (|t|))

(tn−1;1−α , ∞)

H0 : σ 2 = σ02

H1 : σ 2 6= σ02

H0 : σ 2 ≤ σ02

H1 : σ 2 > σ02

χ2 =

Teststatistik

n

Benötigte Größen

exakt: Y ∼ N(µ, σ 2 ), µ ∈ R bekannt, σ 2 ∈ R++ unbekannt

X1 , . . . , Xn einfache Stichprobe zu Y

Nullhypothese

Gegenhypothese

H0 : µ ≥ µ0

H1 : µ < µ0

X − µ0 √

n

S

1X

X =

Xi

n i=1

v

v

u

u

n

u 1

u 1 X

S =t

(Xi − X )2 = t

n − 1 i=1

n−1

Benötigte Größen

n

X

i=1

1 − Ft(n−1) (t)

7 Tests für Mittelwert und Varianz

H0 : p ≥ p0

H1 : p < p0

Xi2 − nX

2

!

Kritischer Bereich

zum Niveau α

(−∞, −tn−1;1−α )

p-Wert

Ft(n−1) (t)

Folie 138

Chi-Quadrat-Test für die Varianz 7.4

2

H0 : σ 2 ≥ σ02

H1 : σ 2 < σ02

e2

n·S

σ02

χ2 (für σ 2 = σ02 ) χ2 (n)-verteilt

n

1X

S =

(Xi − µ)2

n i=1

e2

[0, χ2n; α )

2

∪(χ2n;1− α , ∞)

2

2 · min Fχ2 (n) (χ2 ),

1 − Fχ2 (n) (χ2 )

(χ2n;1−α , ∞)

[0, χ2n;α )

1 − Fχ2 (n) (χ2 )

Fχ2 (n) (χ2 )

Schließende Statistik (WS 2016/17)

Folie 147

8 Anpassungs- und Unabhängigkeitstests

Chi-Quadrat-Anpassungstest 8.1

Zusammenfassung: χ -Test für die Varianz

Zusammenfassung: Chi-Quadrat-Anpassungstest

einer normalverteilten Zufallsvariablen mit unbekanntem Erwartungswert

zur Anpassung an eine vorgegebene Verteilung

Anwendungsvoraussetzungen

Nullhypothese

Gegenhypothese

exakt: Y ∼ N(µ, σ 2 ), µ ∈ R unbekannt, σ 2 ∈ R++ unbekannt

X1 , . . . , Xn einfache Stichprobe zu Y

H0 : σ 2 = σ02

H1 : σ 2 6= σ02

H0 : σ 2 ≤ σ02

H1 : σ 2 > σ02

χ2 =

Teststatistik

Verteilung (H0 )

Benötigte Größen

Kritischer Bereich

zum Niveau α

p-Wert

Schließende Statistik (WS 2016/17)

H0 : σ 2 ≥ σ02

H1 : σ 2 < σ02

(χ2n−1;1−α , ∞)

[0, χ2n−1;α )

1 − Fχ2 (n−1) (χ2 )

Fχ2 (n−1) (χ2 )

Teststatistik

Verteilung (H0 )

Benötigte Größen

Kritischer Bereich

zum Niveau α

p-Wert

Folie 150

8 Anpassungs- und Unabhängigkeitstests

approximativ: Y beliebig verteilt

X1 , . . . , Xn einfache Stichprobe zu Y

k − 1 Klassengrenzen a1 < a2 < . . . < ak−1 vorgegeben

Nullhypothese

Gegenhypothese

(n − 1)S 2

σ02

χ2 (für σ 2 = σ02 ) χ2 (n − 1)-verteilt

!

n

n

X

X

1

1

2

S2 =

(Xi − X )2 =

Xi2 − nX

n − 1 i=1

n − 1 i=1

n

1X

mit X =

Xi

n i=1

[0, χ2n−1; α )

2

∪(χ2n−1;1− α , ∞)

2

2 · min Fχ2 (n−1) (χ2 ),

1 − Fχ2 (n−1) (χ2 )

Anwendungsvoraussetzungen

Chi-Quadrat-Anpassungstest 8.1

Zusammenfassung: Chi-Quadrat-Anpassungstest

χ2 =

k

X

2

i=1

H0 : FY = F0

H1 : FY 6= F0

2

k

ni

X

− pi0

(ni − npi0 )2

n

=n

=

0

npi0

p

i

i=1

2

k

1 X ni2

n i=1 pi0

!

−n

χ ist näherungsweise χ (k − 1)-verteilt, falls FY = F0

(Näherung nur vernünftig, falls npi0 ≥ 5 für i ∈ {1, . . . , k})

pi0 = F0 (ai ) − F0 (ai−1 ) mit a0 := −∞, ak := ∞,

ni = #{j ∈ {1, . . . , n} | xj ∈ (ai−1 , ai ]}, i ∈ {1, . . . , k}

(χ2k−1;1−α , ∞)

1 − Fχ2 (k−1) (χ2 )

Schließende Statistik (WS 2016/17)

Folie 157

8 Anpassungs- und Unabhängigkeitstests

Chi-Quadrat-Unabhängigkeitstest 8.2

Zusammenfassung: Chi-Quadrat-Unabhängigkeitstest

zur Anpassung an parametrische Verteilungsfamilie

Anwendungsvoraussetzungen

Nullhypothese

Gegenhypothese

Teststatistik

Verteilung (H0 )

Benötigte Größen

Kritischer Bereich

zum Niveau α

p-Wert

Schließende Statistik (WS 2016/17)

approx.: Y beliebig verteilt, X1 , . . . , Xn einf. Stichprobe zu Y

Familie von Verteilungsfunktionen Fθ für θ ∈ Θ vorgegeben

k − 1 Klassengrenzen a1 < a2 < . . . < ak−1 vorgegeben

H0 : FY = Fθ für ein θ ∈ Θ

H1 : FY 6= Fθ (für alle θ ∈ Θ)

!

2

k

k

k

ni

X

X

− pi0

(ni − npi0 )2

1 X ni2

n

χ2 =

=

n

=

−n

n i=1 pi0

npi0

pi0

i=1

i=1

χ2 ist unter H0 näherungsweise χ2 (k − r − 1)-verteilt,

wenn θb ML-Schätzer des r -dim. Verteilungsparameters θ auf

Basis klassierter Daten ist (Verwendung von θb siehe unten).

(Näherung nur vernünftig, falls npi0 ≥ 5 für i ∈ {1, . . . , k})

pi0 = Fθb(ak ) − Fθb(ak−1 ) mit a0 := −∞, ak := ∞,

ni = #{j ∈ {1, . . . , n} | xj ∈ (ai−1 , ai ]}, i ∈ {1, . . . , k}

approximativ: (Y A , Y B ) beliebig verteilt

(X1A , X1B ), . . . , (XnA , XnB ) einfache Stichprobe zu (Y A , Y B )

Ausprägungen {a1 , . . . , ak } von Y A , {b1 , . . . , bl } von Y B oder

Klassengrenzen a1 < . . . < ak−1 zu Y A , b1 < . . . < bl−1 zu Y B

Nullhypothese

Gegenhypothese

H0 : Y A ,Y B stochastisch unabhängig

H1 : Y A ,Y B nicht stochastisch unabhängig

k X

l

k X

l

X

X

nij2

(nij − e

nij )2

−n

χ2 =

=

e

e

nij

nij

i=1 j=1

i=1 j=1

Teststatistik

Verteilung (H0 )

Benötigte Größen

Kritischer Bereich

zum Niveau α

(χ2k−r −1;1−α , ∞)

1 − Fχ2 (k−r −1) (χ2 )

Anwendungsvoraussetzungen

p-Wert

Folie 168

Schließende Statistik (WS 2016/17)

χ2 ist näherungsweise χ2 ((k − 1) · (l − 1))-verteilt, falls H0 gilt

(Näherung nur vernünftig, falls e

nij ≥ 5 für alle i, j)

nij = #{m ∈ {1, . . . , n} | (xm , ym ) ∈ Ai × Bj } für alle i, j mit

Ai = {ai }, Bj = {bj } bzw. Klassen Ai , Bj nach vorg. Grenzen,

P

P

n ·n

e

nij = i·n ·j mit ni· = lj=1 nij , n·j = ki=1 nij ,

(χ2(k−1)·(l−1);1−α , ∞)

1 − Fχ2 ((k−1)·(l−1)) (χ2 )

Folie 177

9 Mittelwert- und Varianzvergleiche

Mittelwertvergleiche bei verbundenen Stichproben 9.1

Zusammenfassung: t-Differenzentest

9 Mittelwert- und Varianzvergleiche

Mittelwertvergleiche bei zwei unabhängigen Stichproben 9.2

Zusammenfassung: 2-Stichproben-Gauß-Test

bei bekannten Varianzen

Anwendungsvoraussetzungen

exakt: (Y A , Y B ) gemeinsam (zweidimensional) normalverteilt,

E(Y A ) = µA , E(Y B ) = µB sowie Varianzen/Kovarianz unbekannt

approx.: E(Y A ) = µA , E(Y B ) = µB , Var(Y A ), Var(Y B ) unbek.

(X1A , X1B ), . . . , (XnA , XnB ) einfache Stichprobe zu (Y A , Y B )

Nullhypothese

Gegenhypothese

H0 : µA ≤ µB

H1 : µA > µB

H0 : µA = µB

H1 : µA 6= µB

Benötigte Größen

Kritischer Bereich

zum Niveau α

p-Wert

Schließende Statistik (WS 2016/17)

Nullhypothese

Gegenhypothese

X√

t=

n

S

Teststatistik

Verteilung (H0 )

H0 : µA ≥ µB

H1 : µA < µB

2 · (1 − Ft(n−1) (|t|))

(−∞, −tn−1;1−α )

1 − Ft(n−1) (t)

Ft(n−1) (t)

Folie 183

Mittelwertvergleiche bei zwei unabhängigen Stichproben 9.2

Zusammenfassung: 2-Stichproben-t-Test

N für µA = µB N(0, 1)-verteilt

1

nA

PnA

XiA ,

Benötigte Größen

XA =

Kritischer Bereich

zum Niveau α

(−∞, −N1− α2 )

∪(N1− α2 , ∞)

p-Wert

H0 : µA ≥ µB

H1 : µA < µB

XA − XB

N= q 2

σA

σ2

+ nBB

nA

Verteilung (H0 )

(tn−1;1−α , ∞)

9 Mittelwert- und Varianzvergleiche

H0 : µA ≤ µB

H1 : µA > µB

H0 : µA = µB

H1 : µA 6= µB

Teststatistik

t für µA = µB (näherungsweise) t(n − 1)-verteilt

n

1X

Xi = XiA − XiB für i ∈ {1, . . . , n}, X =

Xi

n i=1

v

v

!

u

u

n

n

X

u 1

u 1 X

2

S =t

(Xi − X )2 = t

Xi2 − nX

n − 1 i=1

n − 1 i=1

(−∞, −tn−1;1− α2 )

∪(tn−1;1− α2 , ∞)

exakt: Y A ∼ N(µA , σA2 ), Y B ∼ N(µB , σB2 ), σA2 , σB2 bekannt

X1A , . . . , XnAA einfache Stichprobe zu Y A , unabhängig von

einfacher Stichprobe X1B , . . . , XnBB zu Y B .

Anwendungsvoraussetzungen

i=1

XB =

1

nB

2 · (1 − Φ(|N|))

PnB

i=1

XiB

(N1−α , ∞)

(−∞, −N1−α )

1 − Φ(N)

Φ(N)

Schließende Statistik (WS 2016/17)

Folie 187

9 Mittelwert- und Varianzvergleiche

Mittelwertvergleiche bei zwei unabhängigen Stichproben 9.2

Zusammenfassung: 2-Stichproben-t-Test für Anteilswerte

bei unbekannten, aber übereinstimmenden Varianzen

Anwendungsvoraussetzungen

Nullhypothese

Gegenhypothese

Teststatistik

Verteilung (H0 )

Benötigte Größen

exakt: Y A ∼ N(µA , σA2 ), Y B ∼ N(µB , σB2 ), µA , µB , σA2 = σB2 unbek.

approx.: E(Y A ) = µA , E(Y B ) = µB , Var(Y A ) = Var(Y B ) unbekannt

X1A , . . . , XnAA einfache Stichprobe zu Y A , unabhängig von

einfacher Stichprobe X1B , . . . , XnBB zu Y B .

zum Niveau α

p-Wert

H0 : µA ≥ µB

H1 : µA < µB

(nA −1)S 2 A +(nB −1)S 2 B

Y

nA +nB −2

(−∞, −t

nA +nB −2;1− α

2

nA +nB −2;1− α

2

∪(t

Y

)

, ∞)

2 · (1 − Ft(nA +nB −2) (|t|))

PnA

=

i=1

Verteilung (H0 )

Benötigte Größen

PnB

(XiA −X A )2 + i=1

(XiB −X B )2

nA +nB −2

(tnA +nB −2;1−α , ∞)

(−∞, −tnA +nB −2;1−α )

1 − Ft(nA +nB −2) (t)

Ft(nA +nB −2) (t)

Schließende Statistik (WS 2016/17)

Folie 189

9 Mittelwert- und Varianzvergleiche

Nullhypothese

Gegenhypothese

Teststatistik

r

XA − XB

XA − XB

nA · nB

t= q

=

2

2

S

nA + nB

S

S

+

nA

nB

t für µA = µB (näherungsweise) t(nA + nB − 2)-verteilt

P

PB B

n

A

1

A

X A = nA i=1

Xi , X B = n1B ni=1

Xi ,

r

r

S=

Kritischer Bereich

H0 : µA ≤ µB

H1 : µA > µB

H0 : µA = µB

H1 : µA 6= µB

Anwendungsvoraussetzungen

Varianzvergleiche bei zwei unabhängigen Stichproben 9.3

Zusammenfassung: F -Test zum Vergleich der Varianzen

Kritischer Bereich

zum Niveau α

p-Wert

approx.: Y A ∼ B(1, pA ), Y B ∼ B(1, pB ), pA , pB unbekannt

X1A , . . . , XnAA einfache Stichprobe zu Y A , unabhängig von

einfacher Stichprobe X1B , . . . , XnBB zu Y B .

H0 : pA ≤ pB

H1 : pA > pB

H0 : pA = pB

H1 : pA 6= pB

H0 : pA ≥ pB

H1 : pA < pB

r

b

b

pA − b

pB

pA − b

pB

nA · nB

t= q

=

S

nA + nB

S2

S2

+

nA

nB

t für pA = pB näherungsweise t(nA + nB − 2)-verteilt

(Näherung ok, falls 5 ≤ nA b

pA ≤ nA − 5 und 5 ≤ nB b

pB ≤ nB − 5)

PA A

PB B

b

pA = n1A ni=1

Xi , b

pB = n1B ni=1

Xi ,

q

pA )+nB ·b

pB ·(1−b

pB )

S = nA ·bpA ·(1−b

nA +nB −2

(−∞, −tnA +nB −2;1− α )

2

∪(tnA +nB −2;1− α , ∞)

(tnA +nB −2;1−α , ∞)

(−∞, −tnA +nB −2;1−α )

1 − Ft(nA +nB −2) (t)

Ft(nA +nB −2) (t)

2

2 · (1 − Ft(nA +nB −2) (|t|))

Schließende Statistik (WS 2016/17)

Folie 193

9 Mittelwert- und Varianzvergleiche

Mittelwertvergleiche bei k > 2 unabhängigen Stichproben 9.4

Zusammenfassung: Einfache Varianzanalyse

zweier normalverteilter Zufallsvariablen

Anwendungsvoraussetzungen

Nullhypothese

Gegenhypothese

H0 : σA2 = σB2

H1 : σA2 6= σB2

Teststatistik

Verteilung (H0 )

Benötigte Größen

Kritischer Bereich

zum Niveau α

p-Wert

Schließende Statistik (WS 2016/17)

Anwendungsvoraussetzungen

exakt: Y A ∼ N(µA , σA2 ), Y B ∼ N(µB , σB2 ), µA , µB , σA2 , σB2 unbek.

X1A , . . . , XnAA einfache Stichprobe zu Y A , unabhängig von

einfacher Stichprobe X1B , . . . , XnBB zu Y B .

H0 : σA2 ≤ σB2

H1 : σA2 > σB2

H0 : σA2 ≥ σB2

H1 : σA2 < σB2

S2 A

F = Y2

SY B

[0, FnA −1,nB −1; α )

2

(FnA −1,nB −1;1−α , ∞)

2·min FF (nA −1,nB −1) (F ),

1 − FF (nA −1,nB −1) (F )

Verteilung (H0 )

Benötigte Größen

1−FF (nA −1,nB −1) (F )

FF (nA −1,nB −1) (F )

F =

k

X

j=1

Kritischer Bereich

zum Niveau α

nj · (x j − x)2 , SW =

10 Lineare Regression

Konfidenzintervalle und Tests 10.4

nj

k X

X

(xj,i − x j )2

j=1 i=1

(Fk−1,n−k;1−α , ∞)

1 − FF (k−1,n−k) (F )

p-Wert

Folie 203

SB/(k − 1)

SW /(n − k)

F ist (approx.) F (k − 1, n − k)-verteilt, falls µ1 = . . . = µk

nj

k

1 X

1X

xj =

xj,i für j ∈ {1, . . . , k}, x =

nj · x j ,

nj i=1

n j=1

SB =

[0, FnA −1,nB −1;α )

2

H0 : µ1 = µj für alle j ∈ {2, . . . , k}

H1 : µ1 6= µj für (mindestens) ein j ∈ {2, . . . , k}

Teststatistik

F unter H0 für σA2 = σB2 F (nA − 1, nB − 1)-verteilt

PA A

PB B

X A = n1A ni=1

Xi , X B = n1B ni=1

Xi ,

P

PnA

2

nA

2

A

2

A 2

1

SY A = nA −1 i=1 (Xi − X A ) = nA1−1

− nA X A

i=1 (Xi )

PB

PnB

2

B 2

SY2 B = nB1−1 ni=1

(XiB − X B )2 = nB1−1

− nB X B

i=1 (Xi )

∪(FnA −1,nB −1;1− α , ∞)

Nullhypothese

Gegenhypothese

exakt: Yj ∼ N(µj , σ 2 ) für j ∈ {1, . . . , k}

approximativ: Yj beliebig verteilt mit E(Yj ) = µj , Var(Yj ) = σ 2

k unabhängige einfache Stichproben Xj,1 , . . . , Xj,nj vom Umfang

P

nj zu Yj für j ∈ {1, . . . , k}, n = kj=1 nj

Schließende Statistik (WS 2016/17)

Folie 210

10 Lineare Regression

Konfidenzintervalle und Tests 10.4

Zusammenfassung: t-Test für den Parameter β1

Zusammenfassung: t-Test für den Parameter β2

im einfachen linearen Regressionsmodell mit Normalverteilungsannahme

im einfachen linearen Regressionsmodell mit Normalverteilungsannahme

Anwendungsvoraussetzungen

Nullhypothese

Gegenhypothese

iid

exakt: yi = β1 + β2 · xi + ui mit ui ∼ N(0, σ 2 ) für i ∈ {1, . . . , n},

σ 2 unbekannt, x1 , . . . , xn deterministisch und bekannt,

Realisation y1 , . . . , yn beobachtet

H0 : β1 = β10

H1 : β1 6= β10

Teststatistik

t=

Verteilung (H0 )

Benötigte Größen

Kritischer Bereich

zum Niveau α

p-Wert

Schließende Statistik (WS 2016/17)

H0 : β1 ≤ β10

H1 : β1 > β10

sX ,Y

βb2 = 2

sX

H0 : β1 ≥ β10

H1 : β1 < β10

Nullhypothese

Gegenhypothese

βb1 − β10

σ

bβb1

2 · (1 − Ft(n−2) (|t|))

iid

exakt: yi = β1 + β2 · xi + ui mit ui ∼ N(0, σ 2 ) für i ∈ {1, . . . , n},

σ 2 unbekannt, x1 , . . . , xn deterministisch und bekannt,

Realisation y1 , . . . , yn beobachtet

H0 : β2 = β20

H1 : β2 6= β20

Teststatistik

t für β1 = β10 t(n − 2)-verteilt

s

(sY2 − βb2 · sX ,Y ) · x 2

, βb1 = y − βb2 · x, σ

bβb1 =

(n − 2) · sX2

(−∞, −tn−2;1− α2 )

∪(tn−2;1− α2 , ∞)

Anwendungsvoraussetzungen

t=

Verteilung (H0 )

Benötigte Größen

(tn−2;1−α , ∞)

(−∞, −tn−2;1−α )

1 − Ft(n−2) (t)

Ft(n−2) (t)

Kritischer Bereich

zum Niveau α

p-Wert

Folie 246

Schließende Statistik (WS 2016/17)

H0 : β2 ≤ β20

H1 : β2 > β20

sX ,Y

βb2 = 2 , σ

bβb2

sX

H0 : β2 ≥ β20

H1 : β2 < β20

βb2 − β20

σ

bβb2

t für β2 = β20 t(n − 2)-verteilt

s

sY2 − βb2 · sX ,Y

=

(n − 2) · sX2

(−∞, −tn−2;1− α2 )

∪(tn−2;1− α2 , ∞)

2 · (1 − Ft(n−2) (|t|))

(tn−2;1−α , ∞)

(−∞, −tn−2;1−α )

1 − Ft(n−2) (t)

Ft(n−2) (t)

Folie 247