Analysis II für Physikstudiengänge

Werbung

Analysis II für Physikstudiengänge

Ein Kompendium zur Vorlesung von L. Recke

Inhaltsverzeichnis

1 Konvergenz und Stetigkeit in metrischen Räumen

1

1.1

Metriken . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1

1.2

Normen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3

1.3

Vergleich von Metriken und Normen . . . . . . . . . . . . . . . . . . . . . . . . .

4

1.4

Konvergenz von Folgen in metrischen Räumen

. . . . . . . . . . . . . . . . . . .

4

1.5

Vollständigkeit. Der Banachsche Fixpunktsatz . . . . . . . . . . . . . . . . . . . .

5

1.6

Konvergenz von Folgen und Reihen in Kn . . . . . . . . . . . . . . . . . . . . . .

6

1.7

Teilfolgen, Häufungspunkte und der Satz von Bolzano-Weierstraß in Kn . . . . .

7

1.8

Offene Mengen, abgeschlossene Mengen und Rand . . . . . . . . . . . . . . . . .

7

1.9

Konvergenz von Abbildungen zwischen metrischen Räumen . . . . . . . . . . . .

9

1.10 Iterierte Grenzwerte . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

9

1.11 Stetige Abbildungen zwischen metrischen Räumen . . . . . . . . . . . . . . . . .

11

1.12 Grenzwerte und Stetigkeit von Abbildungen Kn → Km . . . . . . . . . . . . . .

12

2 Differenzierbare Abbildungen von Rn in Rm

12

2.1

Differenzierbarkeit und Ableitung

. . . . . . . . . . . . . . . . . . . . . . . . . .

13

2.2

Rechenregeln . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

15

2.3

Interpretationen der Ableitungen . . . . . . . . . . . . . . . . . . . . . . . . . . .

17

1

1.1

Konvergenz und Stetigkeit in metrischen Räumen

Metriken

Es seien X eine Menge und ρ : X × X → [0, ∞) eine Abbildung, so dass für all x, y, z ∈ X gilt

Definitheit: ρ(x, y) = 0 ⇔ x = y,

Symmetrie: ρ(x, y) = ρ(y, x),

Dreiecksungleichung: ρ(x, y) + ρ(y, z) ≥ ρ(x, z).

1

Dann heißt ρ Metrik auf X, und das Paar (X, ρ) heißt metrischer Raum.

Beispiele: (i) Standard-Metrik in R: X := R, ρst (x, y) := |x − y|

(ii) X ⊆ C, ρ(x, y) := |x − y|

(iii) X := {(x1 , x2 , x3 ) ∈ R3 : x21 + x22 + x23 = 1}, ρ((x1 , x2 , x3 ), (y1 , y2 , y3 )) := Länge der

kürzesten Kurve in X (der sogenannten geodätischen Kurve) von (x1 , x2 , x3 ) nach (y1 , y2 , y3 )

(iv) Kompaktifizierung von R: X := R ∪ {−∞, ∞},

x

y

−

für x, y ∈ R

1+|x|

1+|y|

x

für x ∈ R, y = ∞

1+|x| − 1

x

+ 1

für x ∈ R, y = −∞

1+|x|

(1.1)

ρ(x, y) :=

y

für x = ∞, y ∈ R

1 − 1+|y|

y

für x = ∞, y ∈ R

1

+

1+|y|

0

für x = y = ∞ oder x = y = −∞

2

für x = ∞, y = −∞ order x = −∞, y = ∞

Weitere Ungleichungen: Es sei (X, ρ) ein metrischer Raum, dann gilt für alle a, b, c, d ∈ X

Dreiecksungleichung nach unten: |ρ(a, b) − ρ(b, c)| ≤ ρ(a, c),

Vierecksungleichung: |ρ(a, b) − ρ(c, d)| ≤ ρ(a, c) + ρ(b, d).

Unterräume metrischer Räume: Wenn (X, ρ) ein metrischer Raum ist und Y eine Untermenge von X ist, so ist (die Einschränkung auf Y × Y von) ρ eine Metrik auf Y , und der

metrische Raum (Y, ρ) heißt Unterraum von (X, ρ).

Produkte metrischer Räume: Wenn (X1 , ρ1 ), . . . , (Xn , ρn ) metrische Räume sind, so kann

man in X1 × . . . × Xn folgende Metriken einführen:

σ∞ ((x1 , . . . , xn ), (y1 , . . . , yn )) :=

max ρj (xj , yj ),

(1.2)

1≤j≤n

1/p

n

X

ρj (xj , yj )p

σp ((x1 , . . . , xn ), (y1 , . . . , yn )) :=

für p ∈ [1, ∞).

(1.3)

j=1

Zum Beweis der Dreiecksungleichung für die Metriken σp benötigt man die folgenden Ungleichungen:

Youngsche Ungleichung: Für alle rellen Zahlen x, y ≥ 0 und p, q > 1 mit 1/p + 1/q = 1 gilt

xy ≤

Höldersche Ungleichung:

1/p + 1/q = 1 gilt

n

X

j=1

xp y q

+ .

p

q

Für alle reellen Zahlen x1 , . . . , xn , y1 , . . . , yn und p, q > 1 mit

1/p

1/q

n

n

X

X

|xj |p

|xj yj | ≤

|yj |q .

j=1

j=1

2

Minkowskische Ungleichung: Für alle reellen Zahlen x1 , . . . , xn , y1 , . . . , yn und p ≥ 1 gilt

1/p

1/p

1/p

n

n

n

X

X

X

|xj + yj |p ≤

|xj |p +

|yj |p .

j=1

j=1

j=1

Metriken in C([a, b]) : Die Menge aller stetigen Funktionen x : [a, b] → R wird mit C([a, b])

bezeichnet. In C([a, b]) kann man folgende Metriken einführen:

σ∞ (x, y) :=

σp (x, y) :=

1.2

max |x(t) − y(t)|,

(1.4)

a≤t≤b

Z

b

|x(t) − y(t)|p dt

a

1/p

für p ∈ [1, ∞).

(1.5)

Normen

In diesem Unterkapitel unterscheidet sich (weil im Mono-Bachelor-Studiengang an der HU die

Lineare Algebra erst in zweiten Semester gelesen wird) meine Vorlesung von dem, was sinnvoll

und allgemein üblich ist, nämlich den Begriff der Norm für allgemeine Vektorräume einzuführen

und nicht nur für die konkreten Vektorräume Rn und Cn . Der wesentliche Nachteil dieser eingeschränkten Präsentation ist, dass der Zusammenhang zwischen den analytischen Begriffen

“Norm” und “Konvergenz” einerseits und dem algebraischen Begriff “Dimension” andererseits

nicht ersichtlich wird.

Im folgenden steht die Bezeichnung K für den Körper R oder den Körper C. Folglich ist dann

Kn die Menge aller n-Tupel reeller Zahlen oder aller n-Tupel komplexer Zahlen. Wie üblich

werden Elemente von Kn Vektoren genannt und mit x = (x1 , . . . , xn ) oder y = (y1 , . . . , yn )

usw. bezeichnet, und Elemente von K werden Skalare genannt und mit λ, µ usw. bezeichnet.

Die skalare Null 0 ∈ K und der Nullvektor 0 := (0, . . . , 0) ∈ Kn werde mit demselben Symbol

bezeichnet. Ferner benutzen wir die üblichen Operationen “Addition” und “Multiplikation mit

einem Skalar”, die definiert sind durch

(x1 , . . . , xn ) + (y1 , . . . , yn ) := (x1 + y1 , . . . , xn + yn ),

λ(x1 , . . . , xn ) := (λx1 , . . . , λxn ).

Eine Abbildung k · k : Kn → [0, ∞) heißt Norm in Kn , wenn für alle x, y ∈ Kn und λ ∈ K gilt

Definitheit: kxk = 0 ⇔ x = 0,

Homogenität: kλxk = |λ|kxk,

Dreiecksungleichung: kx + yk ≤ kxk + kyk.

Beispiele:

kxkp :=

kxk∞ :=

n

X

j=1

1/p

|xj |p

max |xj |.

1≤j≤n

3

für p ≥ 1,

p

Norm in

Im Spezialfall K = R und p = 2 wird die Norm kxk2 = x21 + . . . + x2n Euklidische

p

n

2

R genannt, und im Spezialfall K = C und p = 2 wird die Norm kxk2 = |x1 | + . . . + |xn |2

Hermitesche Norm in Cn genannt.

Normen erzeugen Metriken: (i) Wenn k · k eine Norm in Kn ist, so ist

ρ(x, y) := kx − yk

(1.6)

eine Metrik in Kn .

(ii) Eine Metrik ρ auf Kn wird genau dann im Sinn von (1.6) durch eine Norm auf Kn erzeugt,

wenn für alle x, y, z ∈ Kn und λ ∈ K gilt ρ(x + z, y + z) = ρ(x, y) und ρ(λx, λy) = |λ|ρ(x, y).

Beispiel: Die Einschränkung auf R der Metrik (1.1) ist nicht durch eine Norm erzeugt.

1.3

Vergleich von Metriken und Normen

Es seien X eine Menge und ρ und σ zwei Metriken in X. Wenn gilt

∃c > 0 ∀x, y ∈ X : ρ(x, y) ≤ cσ(x, y),

so nennt man σ stärker als ρ, und man schreibt ρ ≺ σ. Wenn ρ ≺ σ und gleichzeitig σ ≺ ρ

gilt, so nennte man ρ und σ äquivalent, und man schreibt ρ ∼ σ. Die Relation “∼” ist eine

Äquivalenzrelation in der Menge aller Metriken in X.

Analog für Normen: Es seien k · k und ||| · ||| zwei Normen in Kn , und es gelte

∃c > 0 ∀x ∈ Kn : kxk ≤ c|||x|||,

dann nennt man ||| · ||| stärker als k · k. Wenn k · k stärker als ||| · ||| ist und gleichzeitig ||| · |||

stärker als k · k, so nennte man k · k und ||| · ||| äquivalent.

Beispiele: (i) Es sei ρ die Einschränkung auf R der Metrik (1.1) der Kompktifizierung von R.

Dann ist die Standard-Metrik in R stärker als ρ, aber beide Metriken sind nicht äquivalent.

(ii) Es seien σp und σ∞ die in (1.4) und (1.5) eingeführten Metriken in C([a, b]). Dann gilt

σp ≺ σq ≺ σ∞ für 1 ≤ p < q < ∞,

und alle diese Metriken sind nicht äquivalent.

(iii) Alle Normen in Kn sind äquivalent.

(iv) Die in (1.2) und (1.3) eingeführten Metriken im Produkt X1 × . . . × Xn sind äquivalent.

1.4

Konvergenz von Folgen in metrischen Räumen

Es sei (X, ρ) ein metrischer Raum. Eine Folge x1 , x2 , . . . ∈ X heißt konvergent, wenn ein x ∈ X

existiert, so dass gilt

∀ε > 0 ∃n0 ∈ N ∀n ≥ n0 : ρ(xn , x) ≤ ε.

(1.7)

Das Element x ist durch (1.7) eindeutig bestimmt und heißt Grenzwert der Folge bzgl. ρ, und

man schreibt xn → x bzgl. ρ oder, wenn aus dem Kontext klar ist, welche Metrik betrachtet

wird, limn→∞ xn = x. Die Bedingung (1.7) ist äquivalent zu

lim ρ(xn , x) = 0,

n→∞

4

(1.8)

wobei der Grenzwert in (1.8) der klassische Grenzwert von Zahlenfolgen ist.

Stärkere Metriken implizieren Konvergenz: Es seien ρ und σ Metriken auf X mit ρ ≺ σ,

und es gelte xn → x bzgl. σ. Dann gilt auch xn → x bzgl. ρ.

Beispiele: (i) Es seien ρst die Standard-Metrik in R und x, x1 , x2 , . . . ∈ R. Dann gilt xn → X

bzgl. ρst genau dann, wenn xn → x im Sinn der klassischen Definition gilt.

(ii) Es seien ρ die Metrik (1.1) der Kompaktifizierung von R und x, x1 , x2 , . . . ∈ R. Dann gilt

xn → x bzgl. ρ genau dann, wenn xn → x bzgl. ρst , obwohl ρ und ρst nicht äquivalent sind.

Ferner gilt xn → ∞ bzgl. ρ bzw. xn → −∞ bzgl. ρ genau dann, wenn xn → ∞ bzw. t xn → −∞

im Sinn der klassischen Definitionen gilt.

(iii) Es seien σ∞ die in (1.4) eingeführte Metrik in C([a, b]) und x, x1 , x2 , . . . ∈ C([a, b]). Dann

gilt xn → x bzgl. σ∞ genau dann, wenn die Funktionenfolge x1 , x2 , . . . gleichmäßig gegen die

Funktion x strebt.

1.5

Vollständigkeit. Der Banachsche Fixpunktsatz

Cauchy-Folgen: Es seien (X, ρ) ein einmetrischer Raum und x1 , x2 , . . . ∈ X eine Folge mit

∀ε > 0 ∃n0 ∈ N ∀m ≥ n ≥ n0 : ρ(xm , xn ) ≤ ε.

Dann heißt die Folge Cauchy-Folge oder Fundamentalfolge in (X, ρ). Jede konvergente Folge ist

eine Cauchy-Folge.

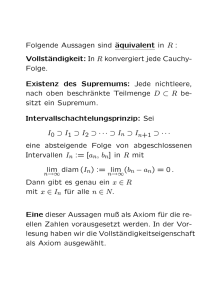

Vollständigkeit: Ein metrischer Raum heißt vollständig, wenn jede Cauchy-Folge konvergent

ist. Analoge Terminologie wird in Kn bzgl. einer Norm k · k benutzt, wobei die Begriffe nicht

davon abhängen, welche Norm gewählt worden ist.

Beispiele: (i) Die Menge der rationalen Zahlen Q ist mit der Standard-Metrik ρst (x, y) = |x−y|

nicht vollständig.

(ii) Die Menge der reellen Zahlen R ist mit der Standard-Metrik ρst (x, y) = |x−y| vollständig.

(iii) Die Mengen Rn und Cn sind bzgl. jeder Norm vollständig.

(iv) Die Funktionenräume C([a, b]) sind vollständig bzgl, der Metrik σ∞ (vgl. (1.4)), aber nicht

vollständig bzgl. der Metriken σp (vgl. (1.5)) für p ∈ [1, ∞). Zum Beispiel ist durch xn (t) := tn

ist eine Cauchy-Folge bzgl. σp gegeben, die aber keinen Grenzwert in C([a, b]) bzgl. σp besitzt

(für p ∈ [1, ∞)).

Banachscher Fixpunktsatz: Es seien (X, ρ) ein vollständiger metrischer Raum und f : X →

X eine Abbildung, und es exitiere ein c < 1, so daß gilt

kf (x) − f (y)k ≤ ckx − yk für alle x, y ∈ X.

Dann existiert genau ein x0 ∈ X mit f (x0 ) = x0 (ein sogenannter Fixpunkt von f ). Ferner gilt:

Wenn x1 ∈ X beliebig gewählt ist und wenn die Folge x2 , x3 , . . . ∈ X induktiv definiert ist durch

xj+1 := f (xj ) für j = 1, 2, . . . ,

dann folgt x0 = limj→∞ xj und

ρ(xj , x0 ) ≤

cj

c

ρ(xj , xj−1 ) ≤

ρ(x2 , x1 ) für j = 1, 2, . . . .

1−c

1−c

5

1.6

Konvergenz von Folgen und Reihen in Kn

In diesem Unterkapitel ist k · k eine beliebige Norm in Kn . Alle folgenden Definitionen und

Aussagen hängen nicht von der Wahl der Norm k · k ab.

Eine Vektorfolge x1 , x2 , . . . ∈ Kn heißt konvergent, wenn sie konvergent bzgl. der durch k · k

erzeugten Metrik ρ(x, y) = kx − yk ist, d.h. wenn ein Vektor x ∈ Kn existiert mit

∀ε > 0 ∃j0 ∈ N ∀j ≥ j0 : kxj − xk ≤ ε.

(1.9)

Konvergenz ist komponentenweise Konvergenz: Es seien k · k eine Norm in Kn ,

(x11 , . . . , xn1 ), (x12 , . . . , xn2 ), . . . , (x1j , . . . , xnj ), . . .

(1.10)

eine Folge von Vektoren aus Kn und x = (x1 , . . . , xn ) ein Vektor aus Kn . Dann gilt: Die Vektorenfolge (1.10) konvergiert bzgl. k · k gegen den Vektor x genau dann, wenn für jedes k = 1, . . . , n

die Zahlenfolge (xkj )∞

j=1 gegen die Zahl xk konvergiert. In diesem Sinne gilt

lim (x1j , . . . , xnj ) = lim x1j , . . . , lim xnj .

j→∞

j→∞

j→∞

Konvergenz und algebraische Operationen: Es seien x1 , x2 , . . . , y1 , y2 , . . . ∈ Kn zwei konvergente Vektorfolgen und λ1 , λ2 , . . . , µ1 , µ2 , . . . ∈ K zwei konvergente Zahlenfolgen. Dann ist

auch die Vektorfolge λ1 x1 + µ1 y1 , λ2 x2 + µ2 y2 , . . . konvergent, und

lim (λj xj + µj yj ) = lim λj lim xj + lim µj lim yj .

j→∞

j→∞

j→∞

j→∞

j→∞

Vektorreihen: Zu jeder Vektorfolge x0 , x1 , x2 , . . . ∈ Kn kann man die Folge

s0 := x0 , s1 := x0 + x1 , s2 := x0 + x1 + x2 , . . .

betrachten. Diese nennt man dann wie im skaleren Fall Reihe mit den Summanden xj und

den Partialsummen sk , und die Reihe heißt konvergent, wenn die Folge ihrer Partialsummen

konvergent ist. Man schreibt dann wieder

∞

X

j=0

xj := lim

k→∞

k

X

xj ,

j=0

und dieser Vektor heißt dann Grenzwert der Reihe.

Cauchy-Kriterium: Eine Vektorreihe mit den Summanden x1 , x2 , . . . ∈ Kn konvergiert genau

dann, wenn gilt:

X

k

∀ε > 0 ∃j0 ∈ N ∀k ≥ j ≥ j0 : xl ≤ ε.

l=j n

Majorantenkriterium: Eine Vektorreihe mit

P den Summanden x1 , x2 , . . . ∈ K konvergiert,

wenn eine konvergente Reihe reeller Zahlen

yn und ein j0 ∈ N existieren , so daß für alle

j ≥ j0 gilt kxn k ≤ yn . Wenn j0 = 0 gewählt werden kann, so gilt ferner

∞ ∞

∞

X

X X

yj .

kxj k ≤

xj ≤

j=0 j=0

j=0

6

Wurzelkriterium: Eine Vektorreihe mit den Summanden x1 , x2 , . . . ∈ Kn konvergiert , wenn

gilt

q

lim sup j kxj k < 1.

j→∞

Neumannsche Reihe: Es seien k · k eine Norm in Kn , A eine n × n-Matrix mit Koeffizienten

in K, und es gelte

sup kAξk < 1.

kξk≤1

Dann existiert für jedes y ∈ Kn genau ein x ∈ Kn mit x = Ax + y, und dieses x läßt sich

konvergente Reihe berechnen:

∞

X

Aj y.

x=

j=0

1.7

Teilfolgen, Häufungspunkte und der Satz von Bolzano-Weierstraß in Kn

Beschränktheit: Es seien (X, ρ) ein metrischer Raum, x1 , x2 , . . . ∈ X eine Folge in X, und es

gelte

∃x0 ∈ X ∃c > 0 ∀n ∈ N : ρ(xn , x0 ) ≤ c.

(1.11)

Dann heißt die Folge x1 , x2 , . . . beschränkt bzgl. ρ. Die Bedingung (1.11) ist äquivalent zu

∀x0 ∈ X ∃c > 0 ∀n ∈ N : ρ(xn , x0 ) ≤ c.

Konvergenz impliziert Beschränktheit: Es seien (X, ρ) ein metrischer Raum und x1 , x2 , . . . ∈

X eine bzgl. ρ konvergente Folge. Dann ist diese Folge auch beschränkt bzgl. ρ.

Häufungspunkte: Es seien (X, ρ) ein metrischer Raum, x1 , x2 , . . . ∈ X eine Folge in X und

x ∈ X, dann sind folgende Bedingungen äquivalent:

(i) Es existiert eine Teilfolge xn1 , xn2 , . . . von mit xnj → x bzgl. ρ für j → ∞.

(ii) Für alle ε > 0 existieren unendlich viele verschiedene n ∈ N mit ρ(xn , x) < ε.

Wenn eine dieser Bedingungen erfüllt ist (und folglich beide Bedingungen erfüllt sind), so heißt

x Häufungspunkt bzgl. ρ der Folge x1 , x2 , . . ..

Satz von Bolzano-Weierstraß in Kn : Es sei x1 , x2 , . . . ∈ Kn eine Folge, die beschränkt

(bzgl. einer und folglich bzgl. jeder Norm in Kn ) ist. Dann besitzt diese Folge mindestens einen

Häufungspunkt (bzgl. einer und folglich bzgl. jeder Norm in Kn ).

Beispiel: Durch xn (t) := tn ist eine Folge in C([0, 1]) definiert, die beschränkt bzgl. σ∞ (vgl.

(1.4)) ist, aber keinen Häufungspunkt bzgl. σ∞ besitzt.

1.8

Offene Mengen, abgeschlossene Mengen und Rand

In diesem Unterkapitel sind (X, ρ) ein metrischer Raum und M ⊆ X eine Teilmenge von X.

Kugeln: Es seien x ∈ X und r > 0. Dann heißen die Menge

K(x, r) := {y ∈ X : ρ(x, y) < r} bzw. K̄(x, r) := {y ∈ X : ρ(x, y) ≤ r}

7

offene bzw. abgeschlossene Kugel um x mit dem Radius r.

Innere Punkte, innerer Kern und Offenheit: Ein Punkt x ∈ M heißt innerer Punkt von

M , wenn ein r > 0 existiert mit K(x, r) ⊆ M . Die Menge aller inneren Punkte von M heißt

◦

innerer Kern von M und wird mit intM (oder M ) bezeichnet. Man sagt, dass M offen ist, wenn

M = intM ist.

Randpunkte, Rand, abgeschlossene Hülle und Abgeschlossenheit: Ein Punkt x ∈ X

heißt Randpunkt von M , wenn für alle r > 0 gilt K(x, r) ∩ M 6= ∅ und K(x, r) ∩ (X \ M ) 6= ∅.

Die Menge aller Randpunkte von M heißt Rand von M und wird mit ∂M bezeichnet. Die Menge

M ∪ ∂M heißt abgeschlossene Hülle von M und wird mit clM (oder M̄ ) bezeichnet. Man sagt,

dass M abgeschlossen ist, wenn M = clM ist.

Äquivalente Charakterisierungen: (i) Die Menge intM ist die größte offene Teilmenge von

M , d.h. für jede offene Menge A ⊆ M gilt A ⊆ intM .

(ii) Die Menge clM ist die kleinste abgeschlossene Menge, die M enthält, d.h. für jede abgeschlossene Menge A ⊆ X mit M ⊂ A gilt clM ⊂ A.

(iii) Es gilt x ∈ ∂M genau dann, wenn Folgen y1 , y2 , . . . ∈ M und z1 , z2 , . . . ∈ X \ M existieren

mit yn → x und zn → x.

(iv) M ist abgeschlossen genau dann, wenn für jede konvergente Tolge x1 , x2 , . . . ∈ M gilt

limn→∞ xn ∈ M .

Dualität von Offenheit und Abgeschlossenheit: (i) M ist offen genau dann, wenn X \ M

abgeschlossen ist, und M ist abgeschlossen genau dann, wenn X \ M offen ist.

(ii) Der Durchschnitt beliebig vieler und die Vereinigung endlich vieler abgeschlossenener

Mengen ist wieder abgeschlossen.

(iii) Die Vereinigung beliebig vieler und der Durchschnitt endlich vieler offener Mengen ist

wieder offen.

(iv) Eine Menge ist abgeschlossen (bzw. offen) genau dann, wenn sie alle ihre Randpunkte

(bzw. keinen ihrer Randpunkte) enthält.

Offenheit und Abgeschlossenheit bzgl. vergleichbarer Metriken: Es sei σ eine zweite

Metrik in X, und es gelte ρ ≺ σ. Dann folgt: Wenn M offen bzw. abgeschlossen bzgl. σ ist, so

ist M auch offen bzw. abgeschlossen bzgl. ρ.

Beispiele: (i) In jedem metrischen Raum (X, ρ) gilt: Endliche Mengen sind abgeschlossen.

Die Menge X ist sowohl offen als auch abgeschlossen, die Kugeln K(x, r) sind offen, die Kugeln

K̄(x, r) sind abgeschlossen, und clK(x, r) = K̄(x, r).

(ii) Es sei X = Kn , und ρ sei durch eine Norm k · k erzeugt. Dann ist Kn die einzige nichtleere

Menge, die sowohl offen als auch abgeschlossen ist. Ferner gilt für alle x ∈ Kn und r > 0

∂K(x, r) = ∂ K̄(x, r) = {y ∈ Kn : kx − yk = r}.

(iii) Es sei X = R mit der Standard-Metrik ρ(x, y) = |x − y|. Dann gilt für alle a < b, dass

(a, b) offen ist, dass [a, b] abgeschlossen ist, dass [a, b) weder offen noch abgeschlossen ist und

∂(a, b) = ∂[a, b) = ∂[a, b] = {a, b}.

Die Intervalle (−1/j, 1/j), j = 1, 2, . . . sind offen, aber ihr Durchschnitt

∞ \

1 1

= {0}

− ,

j j

j=1

8

ist nicht offen.Die Intervalle [−1/j, 1/j[, j = 1, 2, . . . sind abgeschlossen, aber ihre Vereinigung

∞ [

1 1

= (−1, 1)

− ,

j j

j=1

ist nicht abgeschlossen. Ferner gilt

intQ = ∅, ∂Q = clQ = R.

(iv) Es sei X = R2 , ρ sei durch eine Norm k · k erzeugt, und M sei eine Gerade in R2 , z.B.

die x-Achse {(x, 0) ∈ R2 : x ∈ R}. Dann besitzt M keine inneren Punkte.

1.9

Konvergenz von Abbildungen zwischen metrischen Räumen

In diesem Unterkapitel sind (X, ρ) und (Y, σ) metrische Räume, M ⊆ X eine Teilmenge von X

und f : M → Y eine Abbildung.

Häufungspunkte von M : Eine Element x0 ∈ X heißt Häufungspunkt von M , wenn für alle

δ > 0 ein x ∈ M existiert mit 0 < ρ(x, x0 ) < δ, d.h. wenn eine Folge x1 , x2 , . . . ∈ M \ {x0 }

existiert mit xn → x0 , d.h. wenn K(x0 , r) ∩ M eine unendliche Menge ist für jedes r > 0.

Grenzwerte von f : Es seien x0 Häufungspunkt von M , y0 ∈ Y , und es gelte

∀ε > 0 ∃δ > 0 ∀x ∈ M : 0 < ρ(x, x0 ) ≤ δ ⇒ σ(f (x), y0 ) ≤ ε.

(1.12)

Dann nennt man f konvergent für x gegen x0 , y0 heißt Grenzwert von f für x gegen x0 , und

man schreibt

x→x

lim f (x) = y0 oder f (x) → y0 für x → x0 oder f (x) −→0 y0 .

x→x0

Bemerkungen zur Terminologie: (i) Weil x0 Häufungspunkt von M ist, ist y0 durch die

Bedingung (1.12) eindeutig bestimmt. Wenn x0 nicht Häufungspunkt von M wäre, so würde

jedes y0 ∈ Y die Bedingung (1.12) erfüllen.

(ii) Die Bedingung (1.12) hängt nicht davon ab, ob f in x0 definiert ist oder nicht (d.h. ob

x0 ∈ M oder x0 ∈

/ M ), und sie hängt im Fall x0 ∈ X nicht von dem Wert f (x0 ) ab.

Äquivalenz von εδ-Sprache und Folgensprache: Es seien x0 Häufungspunkt von M und

y0 ∈ Y . Dann sind folgende Bedingungen äquivalent:

(i) limx→x0 f (x) = y0 .

(ii) Für jede Folge x1 , x2 , . . . ∈ M \ {x0 } mit limn→∞ xn = x0 gilt limn→∞ f (xn ) = y0 .

1.10

Iterierte Grenzwerte

In diesem Unterkapitel sind (X, ρ), (Y, σ) und (Z, τ ) metrische Räume, M ⊆ X und N ⊆ Y

Teilmengen, x0 ∈ X bzw. y0 ∈ Y Häufungspunkte von M bzw. N und f : M × N → Y

eine Abbildung. Die Menge X × Y wird als metrischer Raum mit einer der in (1.2) und (1.3)

9

eingeführten äquivalenten Metriken betrachtet. Dann ist (x0 , y0 ) Häufungspunkt von M × N ,

und man kann die folgenden Fragen betrachten: Existieren der sogenannte allgemeine Grenzwert

lim

(x,y)→(x0 ,y0 )

f (x, y),

(1.13)

bzw. die sogenannten iterierten Grenzwerte

lim lim f (x, y)

(1.14)

lim lim f (x, y),

(1.15)

x→x0 y→y0

und

y→y0 x→x0

impliziert die Existenz eines von ihnen die Exixstenz eines anderen und sind die entsprechenden

Grenzwerte dann gleich? Nach Definition existiert der iterierte Grenzwert (1.14) und ist gleich

z0 ∈ Z, wenn ein r > 0 und eine Abbildung g : K(x0 , r) ∩ M → Z existieren, so dass gilt

y→y0

∀x ∈ K(x0 , r) ∩ M : f (x, y) −→ g(x)

und

x→x

g(x) −→0 z0 .

(1.16)

(1.17)

Die Bedingung (1.16) bedeutet

∀x ∈ M ∀ε > 0 ∃δ > 0 ∀y ∈ N : ρ(x, x0 ) ≤ r, σ(y, y0 ) ≤ δ ⇒ τ (f (x, y), g(x)) ≤ ε,

(1.18)

und man sagt, wenn diese Bedingung erfüllt ist, dass für x → x0 die Funktionen f (x, ·) punktweise gegen die Funktion g streben. Eine Verstärkung von (1.18) ist

∀ε > 0 ∃δ > 0 ∀x ∈ M ∀y ∈ N : ρ(x, x0 ) ≤ r, σ(y, y0 ) ≤ δ ⇒ τ (f (x, y), g(x)) ≤ ε.

(1.19)

Wenn (1.19) erfüllt ist, so sagt man, dass für x → x0 die Funktionen f (x, ·) gleichmäßig gegen

die Funktion g streben.

Eine hinreichende Bedingung, dass (1.13) nicht existiert: Wenn die iterierten Grenzwerte (1.14) und (1.15) existieren, aber ungleich sind, so existiert (1.13) nicht.

Eine hinreichende Bedingung, dass (1.13) existiert: Wenn (1.17) und (1.19) gilt, so

existiert (1.13) und ist gleich z0 .

Beispiele: Wir setzen X = Y = Z = R mit der Standard-Metrik, M = N = (0, ∞) und

x0 = y0 = 0.

(i) (1.14) und (1.15) existieren und sind ungleich (und folglich existiert (1.13) nicht):

f (x, y) =

x2

.

x2 + y 2

(ii) (1.14) und (1.15) existieren und sind gleich, trotzdem existiert (1.13) nicht:

f (x, y) =

x2

10

xy

.

+ y2

(iii) (1.13) und (1.14) existieren und sind gleich, trotzdem existiert (1.15) nicht:

1

f (x, y) = x sin .

y

(iii) Wie verifizieren die obige hinreichende Bedingung, dass der allgemeine Grenzwert (1.13)

existiert und welchen Wert er annimmt, im Beispiel

x

1

sin y :

f (x, y) = sin

x

y

Nach der l’Hospital-Regel gilt

x

x

1

1

1

sin y = lim cos

sin y

sin y = sin y.

lim sin

x→0

x→0 x

y

y

y

y

Also strebt x1 sin xy sin y für x → 0 punktweise gegen y1 sin y. Diese Konvergenz ist sogar

gleichmäßig weil nach der Taylor-Formel gilt

2

x

x

x

1

sin

sin y = sin y − sin θ

sin y

y

y

2

y

und folglich

Wegen

1

y

2

1

sin x sin y − 1 sin y ≤ x sin y

≤ const x.

2

x

y

y

y

sin y → 1 für y → 0 folgt also

1

lim

sin

(x,y)→(0,0) x

1.11

x

sin y

y

= 1.

Stetige Abbildungen zwischen metrischen Räumen

In diesem Unterkapitel sind wieder (X, ρ) und (Y, σ) metrische Räume, M ⊆ X eine Teilmenge

von X und f : M → Y eine Abbildung.

Stetigkeit: Die Abbildung f heißt stetig in einem Punkt x0 ∈ M , wenn gilt

∀ε > 0 ∃δ > 0 ∀x ∈ X : ρ(x, x0 ) ≤ δ ⇒ σ(f (x), f (x0 )) ≤ ε.

Die Funktion f heißt stetig, wenn sie stetig in jedem x0 ∈ M ist.

Bemerkung zur Terminologie: Wenn x0 ∈ M nicht Häufungspunkt von M ist, dann ist jede

Abbildung f : M → Y stetig in x0 . Wenn aber x0 ∈ M Häufungspunkt von M ist, dann ist eine

Abbildung f : M → Y stetig in x0 genau dann, wenn

lim f (x) = f (x0 ).

x→x0

Stetigkeit und Superposition: Es seien f stetig in einem Punkt x0 ∈ M , (Z, τ ) ein weiterer

metrischer Raum und g : f (X) → Z eine Abbildung, die stetig in f (x0 ) ist. Dann ist die

Superposition g ◦ f ebenfalls stetig in x0 .

11

1.12

Grenzwerte und Stetigkeit von Abbildungen Kn → Km

In diesem Unterkapitel betrachten wir Abbildungen vom Typ f : X ⊆ Kn → Km , wobei Kn

und Km als metrische Räume, deren Metriken durch eine Norm erzeugt sind, betrachtet werden.

Dann gilt

f1 (x)

f2 (x)

f (x) =

,

..

.

fm (x)

und die Abbildungen f1 , . . . , fm : X → K heißen Komponentenabbildungen der Abbildung f .

Lemma: Grenzwert und Stetigkeit gelten komponentenweise. Es sei x0 ein Häufungspunkt

von X. Dann gilt

limx→x0 f1 (x),

limx→x0 f2 (x),

,

lim f (x) =

(1.20)

x→x0

...

limx→x0 fm (x)

dabei existiert der Grenzwert auf der linken Seite von (1.20) genau dann, wenn alle Grenzwerte

auf der rechten Seite von (1.20) existieren.

Insbesondere gilt: Die Abbildung f ist stetig genau dann, wenn alle Abbildungen f1 , . . . , fm

stetig sind.

Satz: Grenzwert, Stetigkeit und algebraische Operationen Es seien λ : X ⊂ Kn → R

und g : X ⊂ Kn → Km Abbildungen, und x0 sei ein Häufungspunkt von X. Dann gilt

lim (λ(x)f (x)) =

x→x0

lim (f (x) + g(x)) =

x→x0

lim λ(x) lim f (x),

x→x0

x→x0

lim f (x) + lim g(x).

x→x0

x→x0

dabei existieren die Grenzwerte jeweils auf der linken Seite, wenn alle Grenzwerte jeweils auf

der rechten Seite existieren.

Insbesondere gilt: Wenn λ, f und g stetig sind, so sind auch λf , f + g stetig.

Extrema stetiger Abbildungen auf abgeschlossenen beschränkten Mengen Es seien

K = R, m = 1, X abgeschlossen und beschränkt, und f sei stetig. Dann existieren ein x∗ ∈ X

und ein x∗ ∈ X, so daß für alle x ∈ X gilt f (x∗ ) ≤ f (x) und f (x∗ ) ≥ f (x).

2

Differenzierbare Abbildungen von Rn in Rm

In diesem Kapitel sind X ⊆ Rn eine offene Menge und f : X → Rm

schreiben

f1 (x)

f1 (x1 , . . . , xn )

.

..

..

f (x) = f (x1 , . . . , xn ) =

=

.

fm (x)

fm (x1 , . . . , xn )

12

eine Abbildung. Wir

,

d.h. fj : X → R, j = 1, . . . , m sind die sogenannten Komponentenabbildungen der Abbildung f .

Man sagt, die Abbildung f besitzt n unabhängige und m abhängige Variable. Mit

1

0

0

1

e1 := 0 , e2 := 0 , . . .

..

..

.

.

0

0

bezeichnen wir die Vektoren der Standard-Basen in Rn und Rm . Mit k·k bezeichnen wir Normen

in Rn und Rm . Alle topologischen Begriffe (Grenzwerte, Stetigkeit, Offenheit von Mengem usw.)

werden bzgl. dieser Normen betrachtet und hängen nicht von der Wahl der Normen ab.

Mit M(m × n) bezeichnen wir die Menge aller m × n-Matrizen (m Zeilen und n Spalten). Wir benutzen die “üblichen” algebraischen Operationen mit Skalaren, Vektoren und Matrizen und die

zugehörigen Rechenregeln. Was “üblich” ist, wird als bekannt aus der Vorlesung “Mathematische

Grundlagen” vorausgesetzt und in der parallel laufenden Vorlesung “Lineare Algebra” systematisch vermittelt (insbesondere: M(m × n) kann mit dem Vektorraum der linearen Abbildungen

Rn → Rm identifiziert werden).

Eine weitere Schwierigkeit, die aus der Parallelität der Vorlesungen “Analysis II” und “LIneare

Algebra” folgt, ist, dass zu dem Zeitunkt, wenn in “Analysis II” der allgemeine Ableitungsbegriff

eingeführt wird, in “Linearer Algebra” noch nicht der abstrakte Vektorraum-Begriff eingeführt

ist. Folglich wird in dieser Vorlesung “Analysis II” der allgemeine Ableitungsbegriff nur auf den

konkreten Vektorräumen Rn und Rm eingeführt. Um aber z.B. wichtige Beispiele differenzierbarer Abbildungen, die Matrizen in Matrizen überführen, mit behandeln zu können, muß dann

z.B. eine m × n-Matrix mit einem entsprechenden Vektor in Rmn identifiziert werden. Diese

Identifizierung ist allerdings sowohl aus mathematischer als auch aus physikalischer Sicht höchst

unnatürlich.

2.1

Differenzierbarkeit und Ableitung

Partielle Differenzierbarkeit:

k ∈ {1, . . . , n} der Grenzwert

(i) Es sei x ∈ X. Wenn für ein j ∈ {1, . . . , m} und ein

∂k fj (x) := lim (fj (x + tek ) − fj (x))

t→0

(2.1)

existiert, so sagt man, dass fj in x partiell differenzierbar nach xk ist, und der Grenzwert (2.1)

∂f

heißt partielle Ableitung von fj nach xk . Anstelle von ∂k fj (x) schreibt man auch ∂xjk oder

Dk fj (x) oder dk fj (x). Wenn für ein k ∈ {1, . . . , n} der Grenzwert

∂k f (x) := lim (f (x + tek ) − f (x))

t→0

(2.2)

existiert, so sagt man, dass f in x partiell differenzierbar nach xk ist, der Grenzwert (2.2) heißt

partielle Ableitung von f nach xk . Dann existieren die Grenzwerte (2.1) für alle j = 1, . . . , m,

und es gilt

∂k f1 (x)

..

(2.3)

∂k f (x) =

.

.

∂k fm (x)

13

Damit in (2.1) und (2.2) die Werte fj (x + tek ) und f (x + tek ) für kleine t existieren, muß für

kleine t der Punkt x + tek im Definitionsbereich X liegen. Damit das für alle k und alle x ∈ X

der Fall ist, haben wir vorausgesetzt, dass X offen ist.

(ii) Wenn die partiellen Ableitungen ∂k fj (x) bzw. ∂k f (x) für alle x ∈ X existieren, so heißen fj

bzw. f partiell nach xk differenzierbar, und die Abbildungen ∂k fj : X → R bzw. ∂k f : X → Rm

heißen partielle Ableitungen von fj bzw. von f .

Differenzierbarkeit: (i) Es sei x ∈ X. Wenn ein A ∈ M(m × n) existiert, so dass

lim

y→x

f (x + y) − f (x) − Ay

=0

kyk

(2.4)

gilt, dann heißt f differenzierbar (oder total differenzierbar oder Frechet-differenzierbar) in x.

Die Matrix A ist dann eindeutig bestimmt, sie heißt Ableitung (oder totale Ableitung oder

Frechet-Ableitung oder Jacobi-Matrix oder Funktionalmatrix) von f in x, und man schreibt für

sie

∂(f1 , . . . , fm )

(x).

f ′ (x) oder Df (x) oder df (x) oder

∂(x1 , . . . , xn )

(ii) Wenn die Ableitungen f ′ (x) für alle x ∈ X existieren, so heißt f differenzierbar, und die

Abbildungen f ′ : X → M(m × n) (die Menge aller m × n-Matrizen) heißt Ableitung von f .

Verhältnis von Ableitung und partiellen Ableitungen: Wenn f in x ∈ X differenzierbar

ist, so existieren alle partiellen Ableitungen (2.1) und es gilt

∂1 f1 (x) ∂2 f1 (x) . . . ∂n f1 (x)

∂1 f2 (x) ∂2 f2 (x) . . . ∂n f2 (x)

f ′ (x) =

.

..

..

..

.

.

.

.

.

.

∂1 fm (x) ∂2 fm (x) . . . ∂n fm (x)

Insbesondere gilt

Pn

k=1 ∂k f1 (x)vk

f ′ (x)v =

n

X

..

∂k f (x)vk für alle v ∈ Rn .

=

.

Pn

k=1

k=1 ∂k fm (x)vk

(2.5)

In (2.5) haben wir die Bezeichnung (2.3) benutzt.

Richtungsableitung: Wenn f in x ∈ X differenzierbar ist, so gilt für alle v ∈ Rn

1

f ′ (x0 )v = lim (f (x + tv) − f (x)).

t→0 t

Differenzierbarkeit impliziert Stetigkeit: Wenn f differenzierbar ist, so ist f auch stetig.

Stetige Differenzierbarkeit: Wenn alle partiellen Ableitungen (2.1) existieren und stetig von

x abhängen, so ist f differenzierbar, und man nennt dann f stetig differenzierbar.

14

2.2

Rechenregeln

Differenzierbarkeit von Linearkombinationen: Es sei f differenzierbar in x ∈ X und

g : X → Rm sei ebenfalls differenzierbar in x ∈ X. Dann sind für alle λ, µ ∈ R auch die

Abbildungen λf + µg in x differenzierbar, und es gilt

(λf + µg)′ (x) = λf ′ (x) + µg ′ (x).

Multilineare Abbildungen: Eine Abbildung M : Rn1 × . . . × Rnl → Rm heißt multilinear,

wenn für alle k = 1, . . . , l, v1 ∈ Rn1 , . . . , vk−1 ∈ Rnk−1 , v, w ∈ Rnk , vk+1 ∈ Rnk+1 , . . . , vl ∈ Rnl

gilt

M (v1 , . . . , vk−1 , λv + µw, vk+1 , . . . , vl )

= λM (v1 , . . . , vk−1 , v, vk+1 , . . . , vl ) + µM (v1 , . . . , vk−1 , w, vk+1 , . . . , vl ).

Beispiele bilinearer Abbildungen (l = 2): (i) Produkt Skalar × Vektor: Hier sind n1 = 1

und n2 = m = n und M (λ, v) = λv.

(ii) Euklidisches Skalarprodukt: Hier sind n1 = n2 = n und m = 1 und

M (v, w) = hu, vi :=

n

X

vk wk .

k=1

(iii) Vektorprodukt: Hier sind n1 = n2 = m = 3 und

v2 w3 − v3 v2

M (v, w) = v × w := v3 w1 − v1 w3 .

v1 w2 − v2 w1

(iv) Produkt Matrix × Vektor: Hier sind n1 = mn, n2 = n und M (A, v) = Av.

Beispiele multilinearer Abbildungen mit l > 2: (i) Determinante: Hier sind n1 = . . . =

nl = n = l und m = 1 und M (v1 , . . . , vl ) = det(v1 , . . . , vl ).

(ii) Produkt von Matrizen: Hier sind n1 = . . . = nl = m = n2 und M (A1 , . . . , Al ) = A1 ·. . .·Al .

Produktregel: Es seien M : Rn1 ×. . .×Rnl → Rm multilinear und f1 : X → Rn1 , . . . , fnl : X →

Rnl differenzierbar in x ∈ X. Dann ist auch die Abbildung x ∈ X 7→ M (f1 (x), . . . , fl (x)) ∈ Rm

differenzierbar in x, und es gilt für alle v ∈ Rn

(M (f1 , . . . , fl ))′ (x)v =

l

X

M ((f1 (x), . . . , fk−1 (x), fk′ (x)v, fk+1 (x), . . . , fl (x))).

k=1

Ableitung von Determinanten: Wenn man die Produktregel auf das obige Determinatenbeispiel anwendet, so erhält man für alle Abbildungen f1 , . . . , fl : X → Rl , die differenzierbar in

x ∈ X sind, und für alle v ∈ Rn

(det(f1 , . . . , fl ))′ (x)v =

l

X

det(f1 (x), . . . , fk−1 (x), fk′ (x)v, fk+1 (x), . . . , fl (x)).

k=1

15

Winkelgeschwindigkeit und virtuelle Drehachse: Es sei Q(t) eine 3 × 3-Matrix, die differenzierbar von der Zeit t ∈ R abhängt und die für alle Zeiten t orthogonal ist, d.h.

Q(t)Q(t)T = I,

(2.6)

die also eine zeitabhängige starre Drehung des Raumes R3 um den fixierten Nullpunkt beschreibt.

Wenn man die Identität (2.6) mit Hilfe der Produktregel differenziert, so erhält man

Q′ (t)Q(t)T + Q(t)Q′ (t)T = 0, also Q′ (t)Q(t)T = −Q(t)Q′ (t)T = − Q′ (t)Q(t)T

T

.

Mit anderen Worten: Q′ (t)Q(t)T ist eine antisymmetrische 3 × 3-Matrix, d.h. vom Typ

0

−ω3 (t) ω2 (t)

Q′ (t)Q(t)T = ω3 (t)

0

−ω1 (t) .

−ω2 (t) ω1 (t)

0

Es sei nun u ∈ R3 ein beliebiger Vektor und v(t) := Q(t)u, dann folgt

0

−ω3 (t) ω2 (t)

v1 (t)

ω2 (t)v3 (t) − ω3 (t)v2 (t)

0

−ω1 (t) v2 (t) = ω3 (t)v1 (t) − ω1 (t)v3 (t) = ω(t)×Q(t)u.

Q′ (t)u = ω3 (t)

−ω2 (t) ω1 (t)

0

v3 (t)

ω1 (t)v2 (t) − ω2 (t)v1 (t)

Der Vektor

ω1 (t)

ω(t) := ω2 (t)

ω3 (t)

heißt Winkelgeschwindigkeit zum Zeitpunkt t. Er beschreibt die sogenannte virtuelle Drehachse

durch den Nullpunkt in R3 zum Zeitpnkt t, die folgende Eigenschaften besitzt: In allen Punkten

auf der Achse ist die Geschwindigkeit Null. In allen anderen Punkten ist die Geschwindigkeit

orthogonal zur Achse, und die Euklidische Norm der Geschwindigkeit ist proportional zum Abstand des Punktes von der Achse.

Kettenregel: Es sei f differenzierbar in x ∈ X und g : Y → Rl sei differenzierbar in f (x),

wobei Y ⊆ Rm offen ist mit f (X) ⊆ Y . Dann ist auch die Superposition g ◦ f differenzierbar in

x, und es gilt

(g ◦ f )′ (x) = g ′ (f (x))f ′ (x).

(2.7)

Dabei ist das Produkt auf der rechten Seite von (2.7) als Produkt der entsprechenden JacobiMatrizen zu verstehen. Insbesondere gilt für alle k = 1, . . . , n

∂j g1 (f (x))

m

X

..

l

∂j g(f (x))∂k fj (x) mit ∂j g(f (x)) :=

∂k (g ◦ f )(x) =

∈R.

.

j=1

∂j gl (f (x))

Totale oder substantielle Zeitableitung: In der Kontinuumsmechanik bezeichnet man

üblicherweise mit x̂(t, ξ) ∈ R3 den Ort zum Zeitpunkt t ∈ R des Zeilchens, dass zum Zeitpunkt

Null am Ort ξ ∈ R3 war. Folglich ist ∂t x̂(t, ξ) die Geschwindigkeit zum Zeitpunkt t dieses

16

Teilchens. Es sei ξ̂(t, ·) die inverse Funktion zu x̂(t, ·), d.h. ξ̂(t, x) ist der Ort zum Zeitpunkt Null

des Teilchens, das zum Zeitpunkt t am Ort x ist. Dann ist

ˆ x))

u(t, x) := ∂t x̂(t, ξ(t,

die Geschwindigkeit zum Zeitpunkt t am Ort x, und nach der Kettenregel ist

3

∂t2 x̂(t, ξ) =

X

d

∂xk u(t, x̂(t, ξ))uk (t, x̂(t, ξ))

u(t, x̂(t, ξ)) = ∂t u(t, x̂(t, ξ)) +

dt

k=1

die Beschleunigung zum Zeitpunkt t des Zeilchens ξ. Mit anderen Worten:

∂t u(t, x) +

3

X

∂xk u(x, t)uk (t, x)

(2.8)

k=1

ist die Beschleunigung zum Zeitpunkt t am Ort x. Diese vektorwertige Funktion von t und x

(die nichtlinear von u abhängt!) nennt man totale oder substantielle Zeitableitung von u, und sie

geht in die Gleichgeweichtsgleichungen ein, die in der Hydrodynamik zur Bestimmung der unbekannten Funktion u dienen. Die erstaunlichen Schwierigkeiten, die bei der analytischen und/oder

numerischen Behandlung dieser Gleichungen entstehen, wurzeln fast alle in der Nichtlinearität

(2.8).

2.3

Interpretationen der Ableitungen

Der Fall n = 1. Tangenten: Es sei n = 1, und f sei differenzierbar in x ∈ X. Dann artet

f ′ (x) zu einem Spaltenvektor aus Rm aus,

′

f1 (x)

f (x + y) − f (x)

..

,

f ′ (x) =

= lim

.

t→0

y

′

fm (x)

d.h. f ′ (x) ist der Grenzwert der Sekantenvektoren (f (x+y)−f (x))/y für y → 0. Wenn f ′ (x) 6= 0,

dann heißt die Gerade

{f (x) + f ′ (x)y ∈ Rm : y ∈ R}

Tangente an die Kurve

{f (x) ∈ Rm : x ∈ X}

(2.9)

in x, und sie ist diejenige Gerade in Rm durch den Punkt f (x), die sich am besten an die Kurve

(2.9) in diesem Punkt anschmiegt. Genauer gesagt gilt folgendes: Wenn für ein a ∈ Rm gilt

f (x + y) − f (x) − ay

= 0,

y→0

y

lim

dann ist die Gerade {f (x) + ay ∈ Rm : y ∈ R} die Tangente an die Kurve (2.9) in x, d.h.

a = f ′ (x).

17

Der Fall m = 1. Gradienten: Es sei m = 1, und f sei differenzierbar in x ∈ X. Dann artet

f ′ (x) zu einem Zeilenvektor aus Rn aus. Dieser Vektor wird auch Gradient von f in x genannt

und mit ∇f (x) bezeichnet, d.h.

∇f (x) := (∂1 f (x), . . . , ∂n f (x)),

und es gilt:

(i) Wenn t ∈ (−1, 1) 7→ x̂(t) ∈ X differenzierbar ist mit x̂(0) = x und f (x̂(t)) = f (x) für

alle t ∈ (−1, 1) ist, d.h. wenn die Kurve x̂(t) innerhalb der sogenannten Niveaumange {y ∈ X :

f (y) = f (x)} (vom Niveau f (x)) liegt, so gilt

hx̂′ (0), ∇f (x)i = 0.

(ii) Wenn f stetig differenzierbar ist, dann existiert für alle v ∈ Rn mit kvk = k∇f (x)k ein

ε > 0, so daß gilt

f (x + tv) ≤ f (x + t∇f (x)) für alle t ∈ [0, ε],

d.h. der Vektor ∇f (x) zeigt in die Richtung des maximalen Wachsens von f , lokal in x.

Der Fall m = 1, n = 2. Tangentialebenen: Es sei m = 1, n = 2, und f sei differenzierbar

in x ∈ X. Wir bezeichnen mit

y1

∈ R3 : (y1 , y2 ) ∈ X

M :=

y2

f (y1 , y2 )

den Graphen von f . Dann heißen die Kurven

x1

x1 + t

und

, t ≈ 0,

x2

x2 + t

f (x1 + t, x2 )

f (x1 , x2 + t)

Koordinatenlinien an M durch den Punkt

x1

∈ M.

P :=

x2

f (x1 , x2 )

Die Tangentialvektoren an diese Koordiatenlinien sind

0

1

.

und

1

0

∂2 f (x)

∂1 f (x)

Sie spannen die sogenannte Tangentialebene an M in P auf:

x1 + y 1

∈ R3 : (y1 , y2 ) ∈ R2

x2 + y 2

TP M :=

f (x) + ∂1 f (x)y1 + ∂2 f (x)y2

auf. Unter allen Ebenen in R3 durch den Punkt P schmiegt diese sich am besten an M lokal

nahe P an.

18