Experimentelle Methoden der Teilchenphysik Sommersemester

Werbung

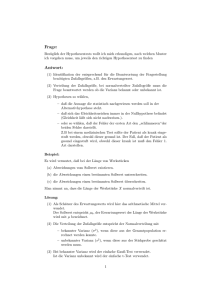

Experimentelle Methoden der Teilchenphysik Sommersemester 2011/2012 Albert-Ludwigs-Universität Freiburg Prof. Markus Schumacher Physikalisches Institut, Westbau, 2. OG Raum 008 Telefon 07621 203 7612 E-Mail: [email protected] Kapitel 13: Die Maximum-Likelihood-Methode http://terascale.physik.uni-freiburg.de/lehre/Sommersemester%202012 “Maximum Likelihood”-Schätzer: Grundidee Wenn der hypothetisch angenomme Wert θ nahe am wahren Wert ist, dann erwarten wir, dass die Wahrscheinlichkeit groß ist, eine Stichprobe zu finden, wie wir sie aktuell gemessen haben. Also definieren wir den “Maximum Likelihood (ML)”-Schätzer als den Parameterwert, der die Likelihoodfunktion maximiert. Für ML-Schätzer gibt es keine Garantie, dass sie “optimale” Eigenschaften für kleine Stichproben besitzen. Aber in der Praxis sind sie sehr gut. M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Das Maximum-Likelihood-Prinzip besteht darin, als Schätzwert eines Parameters θ i=1 jenigen zuverwenden, verwenden, fürdieden tats ächlich beobachteten Meßwerte am enjenigenWert Wert zu für den tatsdie ächlich beobachteten Meßwerte am wahrcheinlichsten sind. Etwas formaler ausgedr ückt ist ückt der ML-Sch ätzerML-Sch θ̂ für dasätzer wahreθ̂(uninlichsten sind. Etwas formaler ausgedr ist der für das wahr Es ist praktischer, mit dem Logarithmus der Likelihood-Funktion zu a ekannte) θ der Wert von θ, der die Likelihood-Funktion maximiert: “Maximum Likelihood”-Schätzer: Formal annte) θ der Wert von θ, der die Likelihood-Funktion maximiert: nannten Log-Likelihood-Funktion. Das Maximum-Likelihood-Prinzip: finde Wert des Parameters so, dass L(θ̂) = n ! n f (x ! i ; θ̂) = Maximum. i=1= L(θ̂) i=1 n " (6.1) log f (xi ; θ), L(θ) = f (xi ; θ̂) = log Maximum. i=1 Es ist praktischer, mit dem Logarithmus der Likelihood-Funktion zu arbeiten, der sogeDa der Logarithmus eine monotone Funktion ist, hat log L(θ) sein Maxim OftLog-Likelihood-Funktion. praktischer die log-Likelihood-Funktion (oder ln-Likelihood-Fkt.) annten st praktischer, mit(ln dem Logarithmus derimmer Likelihood-Funktion zu arbeiten, der Stelle wie L(θ). Der Vorteil liegt darin, das Produkt in eine Summe zu verwenden. und log meinen hier den dass natürlichen Logarithmus.) n "für die vielen relevanten Fälle in denen f (x ; θ) eine E deren Argument nten Log-Likelihood-Funktion. log f (xi ; θ), (6.2) i log L(θ) = on enthält, deutlich vereinfacht. Wenn die Likelihood-Funktion differ i=1 neiner Grenze des Parameterraums hat, dann ist ihr Maximum nicht an " Da der(Summieren Logarithmus eine monotone Funktion ist, hat log L(θ) Maximum an der selben istLikelihood-Sch einfacher als ätzer Multiplizieren.) loggegeben f (xsein log L(θ) = also durch die Gleichung i ; θ), telle wie L(θ). in eine Summe übergeht sich i=1 102 Der Vorteil liegt darin, dass das Produkt KAPITEL 6. und MAXIMUM-LIKE # Exponentialfunktieren Argument für die vielen relevanten Fälle in denen f (xi ; θ)∂eine # log L # =0 ML-Schätzer gegeben durch die Gleichung: n enthält, deutlich vereinfacht. Wenn die Likelihood-Funktion differenzierbar ist und # ∂θ der Logarithmus eine monotone Funktion ist, hat log L(θ) sein Maximum an der θ̂ hr Maximum nicht an ! des Parameterraums hat, so dann ist man der MaximumParameter θeiner = (θGrenze ) zu bestimmen gilt, stellt für jeden eine solche G 1 , ..., θm le wie L(θ). liegt durch darin, das Produkt in eine Summe übergeht un Likelihood-Sch ätzerVorteil also gegeben diedass Gleichung auf. Der Hat log L mehrere lokale Maxima, so nimmt man dasjenige mit dem ; θ) eine Exponentialf n Argument für die vielen relevanten F älle in denen dass f (xidieses ! # log L. Es ist allerdings nicht garantiert, f ür n → ∞ gegen ∂ log L ##∂ log L ! enthält, Wenn= 0die!auch Likelihood-Funktion differenzierbar (6.3) = 0, = 1, ..., m lokalen Fürdeutlich mehrerevereinfacht. Parameter:dies konvergiert; eines ider anderen Maxima sein.is ! ∂θ #kθ̂önnte ∂θi ˆ θi Maximum nicht an einer Grenze des Parameterraums hat, dann ist der Maxim Hat log L mehrereätzer lokale also Maxima, so nimmt man die dasjenige mit dem gr ößten Wert von elihood-Sch gegeben durch Gleichung 101 Dieallerdings Maximierung der (logarithmischen) og L. Es ist nicht garantiert, dass dieses für n Likelihood-Funktion → ∞ gegen den wahrenerfolgt Wert von sehr # M. Schumacher Exp. Methoden der der TP Kapitel 13 lokalen Die Maximum onvergiert; dies könnte auch eines anderen Maxima Likelihood-Methode sein. Wenn es mehrere SoSe 2012 allgemein große Verwendung finden. unmittelbar “Maximum Likelihood”-Schätzer: Gauss-Bsp. sofort erkennen, dass der ML-Sch ätzer k Eine positive Eigenschaft kann man darin er b.man 6.1 (a) zeigtdarin eine Stichprobe vom Umfang n = sofort 20 aus einer 103 6.2. EIGENSCHAFTEN VON ML-SCHATZERN auf eine wird Einteilung der Daten in Binsunmitt nimmt. D aten in Binsµnimmt. Meßwert 1 (jeder senkrechte Strich mit Mittelwert = 5 Bezug und Damit Varianz σ 2 = jeder Gauss-WDF Gauss-WDF berücksichtigt, ohne dass Information verlorengeht. außverteilten µ=5 men dass die Varianz bekannt ist und der Mittelwert mit mation verlorengeht. µ=5 ehtσ=1 füran, einen Beispiel 6.1: Abb. 6.1 (a) zeigt eineσ=1 Stichprobe vom oll. (c) zeigt die Log-Likelihood-Funktion fürµ = diese Stichprobe Stichprobe 2 r Stichprobe = Grundgesamtheit mit Mittelwert 5 und Varianz σ Stichprobe t n= eine Stichprobe vom Umfang n = 20 aus einer gaußvert 20 erste e) ihre ximum liegt bei µ̂ ≈Meßwert). 5.19. InWir (b),nehmen (d) und (f) die ist Varianz das gleich füris an, dass bekannt n= 50 2 =ätzt1 werden (jedersoll. senkrechte Strich steht für µe Stichprobe = 5 und Varianz σ gesch (c) zeigt die Log-Likelihood-Funk 50 durchgeführt. Man sieht, dass die Likelihood-Funktion vie Ableitung. Das der Maximum liegt bei µ̂ mit ≈ 5.19.der In (b), (d) schm ist. die äler Varianz bekannt ist und Mittelwert Stich meter µdiese wird durch die größeren Stichprobe eingeschr änk mit Umfang = 50 durchgefbesser ührt. Man sieht, dass di Der f ür ie Log-Likelihood-Funktion f ür diese Stichprobe, (e) ihre Der5.05 gesuchte µ wird durch größere Stichp e Schwahren ätzwert von µ̂ ≈ liegtParameter entsprechend auchdiedeutlich näh beim ei µ̂ ≈ 5.19.die Inzweiten (b),Stichprobe (d) underhaltene (f) istder das gleich eine Sch ätzwert von µ̂für ≈ 5.05 liegtStich entspr ür(h) die beiden zeigen Ableitungen Log-Likelihood-Funktio Wert µ = Likelihood-Funktion 5. (g) und (h) zeigen die zweiten Ableitungen de rt. Man sieht, dass die viel schm äle er I(µ) = 20 eiten Fall ergibt sich eine Fisher-Information vonsich I(µ) 50 gegen Stichproben. Im zweiten Fall ergibt eine = Fisher-Inform rianz. Wegen urch ößere Stichprobe besser änkt. ür im ersten Fall und damiteingeschr eineSchranke im gleichen VerhDer ältnis fklei damit die einegr im gleichen Verhältnis kleinere Minimaler genommenen zweite Ableitung Log-Like σ 2 = 1 ist die (negative) on µ̂ ≈ 5.05 liegt entsprechend auch deutlich näherderbei beim w ative) zweite Ableitung der Log-Likelihood-Funktion der n sehen, dass gaußverteilten Grundgesamtheit gerade gleich dem Stichp zweiten Ableitungen der Log-Likelihood-Funktion f ür die b ndgesamtheit geradeder gleich dem Stichprobenumfang n. Wir wer des Schätzers ML-Schätzer für den Mittelwert effizient und unverzer sichMittelwert eine Fisher-Information von I(µ) 50die gegen über I(µ)d durch und 1/I(µ)unverzerrt gegeben ist. Dies ist bekannte rt den effizient ist=und somit dieVarianz Varian M. SchumacherVerh Exp.ältnis Methoden der TP Kapitel 13 Schranke Die Maximum Likelihood-Methode SoSe 2012 W gleichen kleinere Minimaler Varianz. (a) 4 6 8 x 2 log L( µ ) log L( µ ) 2 (b) (c) -50 -100 4 6 (d) -50 -100 µ=5.19 4 5 µ=5.05 6 -150 3 7 µ 20 d log L( µ ) dµ d log L( µ ) dµ -150 3 (e) 10 -10 -20 5.2 6 7 µ (f) -10 5 5 10 0 4.8 4 20 0 -20 8 x 4.8 5 5.2 50 (g) 0 50 (h) 0 -50 4.8 µ d2 log L( µ ) dµ 2 d2 log L( µ ) dµ 2 µ -50 4.9 5 5.1 5.2 µ 4.8 4.9 5 5.1 5.2 µ Abbildung 6.1: Schätzung des Mittelwerts einer gaußverteilten Grundgesamtheit mit dem ML-Beispiel: Parameter der Exponential-WDF Betrachte Exponential-WDF: und unabhängige Messungen Die Likelihoodfunktion lautet: Der Wert von τ der L(τ) maximiert, liefert auch den Maximalwert seines Logarithmus (der Log-Likelihoodfunktion): M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 τ 1 tτ f (t; τ ) = exp − . τ τ (6.51) ML-Beispiel: Parameter der Exponential-WDF (2) Gesucht ist der Mittelwert τ . Die logarithmische Likelihood-Funktion ist Gesucht ist der Mittelwert τ . Die logarithmische Likelihood-Funktion ist & ' ' n n " n n & n " " " 1 ti t i 1 1" 1 1 ti log L(τ ) = log f (ti ; τ ) = log − = n log − log L(τ ) = log f (ti ; τ ) = log τ −τ =n log − τ τ i=1 i=1 i=1 i=1 τ τ τ i=1 Als ML-Schätzer τ̂ ergibt sich damit Als ML-Schätzer ergibt sich damit Bestimmung desτ̂Maximums 0 = ! n ∂ log L(τ ) !! 1 1 " = −n + 2 ti ∂τ ! !τ =τ̂ τ̂ τ̂ n 1" (6.52) ti τ (6 i=1 (6.53) i=1 n " ! n ∂ log 1L(τ ) 1 1 " ti . ! ⇒ τ̂ = = −n + 2 ti 0 = ! n Liefert den ML-Schätzer: ∂τ τ̂ τ̂ i=1 τ =τ̂ (6.54) (6 i=1 n ⇒ τ̂ = Hier also den arithmetischen Mittelwert der Stichprobe (daher konsistent und erwartungstreu) 1" ti . n (6 i=1 Monte Carlo-Test: generiere 50 Messwerte für τ = 1. Wir bestimmen den ML-Schätzer zu: M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 12 bei nachrechnet). Das arithmetische Mittel ist jedoch im all KAPITEL 6. MAXIMUM-LIKELIHOOD der Exponentialverteilung ergibt sich also als ML-Schätzer für den Mittelwe ML-Beispiel: Parameter der Exponential-WDF (3)direk effizient. Mit Gl.unverzerrt 5.33 ist die Varianz rithmetische Mittel.zuτ̂ vergleichen, ist damit (E[τ̂ ]wir = τ , wiedes manarithmetischen auch leicht es mit der SMV berechnen Auch bei der Exponentialverteilung ergibt sich also als ML-Schätzer für den Mittelwert echnet). Das arithmetische Mittel allgemeinen nicht notwendigerwei as arithmetische Mittel. τ̂ ist damit unverzerrt (E[τ̂ ] = im τ , wie man auch leicht direkt ! ist jedoch # 1 2 $ 1 % n 2 nt. Mit Gl. 5.33 ist die Varianz des arithmetischen Mittels " achrechnet). Das arithmetische Mittel ist jedoch im allgemeinen nicht notwendigerweise Fehler auf arithmetischen V [t] = τ ∂ log L nMittelwert2kennen wir: Vn[τ̂ ] = 2τ̂ ffizient. Mit Gl. 5.33 ist die Varianz Mittels 1− = des arithmetischen ti = 1 −n n 2 1 nτ 1 2 τ τ 1] = V1[t]2 =i=1τ V [τ̂ (6.55 V [τ̂ ] = V [t]n= τ (6.55) n Um dies mit der zu vergleichen, berechnen wir n SMV n Vergleich mit der Schranke minimaler Varianz: nverzerrt ergibt sich für die SMV Um dies derist SMV zu berechnen wir ies mitmit der SMV zuvergleichen, vergleichen, berechnen wir ! # n 2 log$L " ! # %n 2 n ∂ n ! # 2 " $ % 2 n ∂2 log L n 2τ̂ n 2 1 − (6.56) ti = 2 1 − −1 2ti " = 22 1 − = = −1 τ n ∂ ∂τ log 2τ̂ 2 2 L τ2 n τt = = τ* τ 1 − ∂τ τ +nτ '−i=1 2τ̂ () V [τ̂2] ≥= &2 n 1nτ = i=1 (6.56 i 2 2E[τ̂ ∂τ nτ τ ] nτ n Eτ 2 1 − ∂τ 2 τ2 τ SMV Da τ̂ unverzerrt ist ergibt sich für die τi=1 τ̂ unverzerrt ist ergibt unverzerrt istDa ergibt sich −1 für die SMV −1 V [τ̂ ] ≥ τ2 1− τ sich für die SMV τ2 += (6.57) τ2τ̂2() = n * 2E[τ̂] unbekannten n h ängt vom wahren = 1− n τ τ2 1 − τ 2 &n ' Wert τ ab. so auch effizient. VE [τ̂τ ] −1 −1 τ sofort den ML-Sch −1 −1 mit der Transformationsinvarianz der ML-Sch ätzer ä * + () V [τ̂ ] ≥ & n ' = = (6.57 * & ' () V [τ̂ ] ≥ = 2τ̂ 2E[τ̂] n 1 −vomτ unbekannten nWert τ ab.nWir 2τ̂ können n wahren ist also auch effizient. V [τ̂ ] E = τnτ 2hängt 2E 1 − 2 zber angeben: E 1 − Also ML-Schätzer ist für dieses Probem auch τeffizient. τ 2 1 − τ für die 2 τ ML-Schätzer mit der Transformationsinvarianz der ML-Schätzer sofort den 2 2 Varianz angeben: τ τ 2 τ2 Schätzwert für die Varianz: τ̂ unbekannten wahren Wert τ ab. Wir könne also auch effizient. V [τ̂ ] = n hängt vom 2, 2 τ̂ τ V [τ̂ ] = V, [τ̂effizient. ] = der ML-Sch (6.58)unbekannte hängt τ̂ ist also auch V [τ̂nätzer ] = nsofort mit der Transformationsinvarianz den vom ML-Sch ätzer für d n nz angeben: aber mit der Transformationsinvarianz der ML-Schätze M. Schumacher Methoden der TP Kapitel 13 Exponentialverteilung Die Maximum Likelihood-Methode Abb. 6.2 zeigt die SchExp. ätzung des Mittelwerts einer in einem Monte- SoSe 2012 1 ist die (negative) zweite Ableitungistder der angenommen σ =Mittelwert tzer für den effizient und unverzerrt undLog-Likelihood-Funktion somit die Varianz des bei Schätzers durch 1/I(µ) gegeben ist. Dies ist die bekannte Varianzn.des gerade gleich dem Stichprobenumfang WirMittelwerts. werden sehen, da gegebengaußverteilten ist. Dies ist Grundgesamtheit die bekannte Varianz des Mittelwerts. Invarianz unter Parametertransformationen n ML-Schätzern Invarianz unter Parametertransformat Invarianz unter Parametertransformationen der ML-Schätzer für den Mittelwert effizient und unverzerrt ist und somit die Varianz des Schätze durch 1/I(µ) gegeben ist. Dies ist die bekannte Varianz des Mittelwerts. transformationen SeiEigenschaften ML-Schätzer fürden denParameter Parameter Sei θ̂ML-Sch der ML-Sch ätzer für denθ ätzern Parameter un Sei θ̂ von der ML-Sch ätzer für und a(θ) eine θ belieb 6.2 von ML-Sch genschaften ätzern ML-Sch ätzer fürätzer den Parameter a? Es gilt ML-Sch f ür den Parameter a? Es gilt 6.2 Eigenschaften von ML-Sch ätzern einebeliebige beliebige Funktion des Parameters rameter θ Invarianz und a(θ) eine Funktion. ist! der ! ! Was unter Parametertransformationen unter Parametertransformationen ! ! ! ∂L !! ∂L !! ∂a a? Es gilt ! ! . ∂L ! ∂L = Invarianz unter Parametertransformationen ! ist!θ̂= ! Fu ∂θ !für ∂a !a( ∂θ L-Sch Parameter und a(θ) eineParameter beliebige Was der ! ätzer für !Seiden !ML-Sch θ̂ der fürML-Schätzer den θ und a(θ) eine beliebige Frage: wasθätzer ist der a? θ̂ Funktion. θ̂) ! ! ! ! ! ∂θ ∂a L ∂L ∂a r f!ür den a? Es fgilt SeiParameter θ̂ !ML-Sch der ML-Sch fürden den Parameter Parameter θ a? undEs a(θ) eine beliebige Funktion. Was ist θ̂ a(dθ̂ ätzer ür gilt ! ätzer = . (6.5) ! ätzer∂θ ! den ! Parameter ML-Sch für a? !Es gilt ∂a/∂θ "= !0 folgt damit θ! ∂aSolange ! ! ! θ̂ a(θ̂) Es gilt: ∂Lθ̂!! ∂L !! ∂a!!! ! ! ! ∂L ! ∂L ∂a !! = . ! ! ! ! Solange ∂a/∂θ = " 0 folgt damit ! ! ! ! ∂L ! ∂L ! ! ∂a =! !! . ∂θ !θ̂ ∂a ! .∂a ∂La(! θ̂) ∂θ! θ̂ = ∂θ ∂L ∂θ ! = ∂θ0!θ̂ ∂θ ! ! θ̂∂θ ! ∂a ⇒ ! a(θ̂) θ̂ ! a(θ̂) = 0 θ̂ ∂a ! (6.5) ⇒! (6. " a(θ) ! ! ∂θ "= 0 !folgt damit θ̂ a(θ̂) ∂L ∂L So lange folgt damit: Solange ∂a/∂θ = " 0 folgt damit damit ! =0 ! ∂L!!!Solange ∂a/∂θ "= 0 folgt ⇒ = ! " ! ! =0 ⇒ = a( θ̂). (6.6) ∂a !∂L ! a(θ) ! ! ! ∂θ ∂L !!! " ! ! θ̂ a(θ̂) ! ∂L ! θ̂). " ∂a ! a(=θ̂)0 ⇒ ∂L ! =! 0∂L !=⇒0 ⇒ ! a(θ) = a( (6.6) ∂L =0 " = a((6. ! !⇒ =a(θ) ∂θ θ̂ 0 = a( ⇒θ̂). a(θ) θ̂) ∂θ !∂a a(θ̂) = 0 ∂a !⇒ θ̂ ∂θ !θ̂ a(θ̂) ∂a !a(θ̂) D.h.: der ML-Schätzer für den transformierten Parameter ist gleich der Transformierten des ML-Schätzers des ursprünglichen Parameters. Dies ist eine sehr angenehme Eigenschaft, aber sie hat einen Preis. M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Funktionen von ML-Schätzern Annahme: wir hätten Exponential-WDF geschrieben als: i.e., wir verwenden λ = 1/τ. Was ist der ML-Schätzer für λ ? Für eine Funktion α(θ) eines Parameters θ, ist es egal, ob wir die Likelihoodfunktion L als Funktion von α oder θ schreiben Der ML-Schätzer einer Funktion α(θ) ist einfach: Für die Zerfallskonstante erhalten wir also: Caveat: ist nicht erwartungstreu, obwohl erwartungstreu ist. Man kann zeigen M. Schumacher Exp. Methoden der TP Kapitel 13 (Bias →0 für n →∞) Die Maximum Likelihood-Methode SoSe 2012 Beispiel für ML: Parameter der Gauss-WDF Betrachte n unabhängige Messungen x1, ..., xn, wobei xi derselben Gauss-WDF f(x;µ,σ2) folgen Die Log-Likelihood-Funktion ergibt sich zu: M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 i=1 Beispiel für ML: Parameter der Gauss-WDF (2) E VON ML-SCHATZERNDer ML-Schätzer für den Mittelwert einer Gaußverteilung 111 ist also das arithmetische Mi Wir wissen bereits, dass dieses ein unverzerrter und effizienter Schätzer ist. #2 2für die Varianz er µ̂ für Setze den Mittelwert erhalten wir durch Nullsetzen der Ableitung von erhalten wirdie durch Nullsetzen der Ableitung von lo Den ML-Sch ätzer σ Ableitungen nach µ , σ zu Null, und löse Gleichungen: 2 nach σ : ! ! n " ∂ log L(µ, σ 2 ) !! ∂ log L(µ, σ 2 ) !! (xi − µ̂) 0 = (6 0 = = (6.45) ! 2 #2 ! 2 ∂σ 2 ∂µ σ σ = σ µ=µ̂ i=1 n " 1 n #2 = 1" ⇒σ (xi − µ̂)2 (6 xi ⇒ µ̂ = n (6.46) i=1 n i=1 Wir hatten bereits in Abschnitt 5.5 gesehen, dass r für den Mittelwert einer Gaußverteilung ist also das arithmetische Mittel. $ % n−1 its, dassWir dieses ein unverzerrter effizienter Schätzer ist.E wissen bereits,und dass der Schätzer fürσ#2 µ= erwartungstreu ist. σ2 (6 n #2 für die Varianz erhalten wir durch Nullsetzen der Ableitung von log L er σ #2 für die Varianz einer Gaußverteilung ist also verzerrt, wobei Der ML-Schätzer σ hat ML estimator Aber wir findenVerzerrung !asymptotisch verschwindet.also Die Varianz der Stichprobe ∂ log L(µ, σ 2 ) !! 0 = (6.47) n ! 2 #2 2 " 2 ∂σ 1 =σ gilt: b→0 2für n→∞. für σ einen Bias, aberσ es σS = (xi − µ̂)2 (6 n " n − 1 i=1 #2 = 1 ⇒σ (xi − µ̂)2 (6.48) Erinnerung: n i=1 andererseits ist unverzerrt (Abschnitt 5.5), jedoch nicht der ML-Schätzer. its in Abschnitt 5.5 gesehen, dass $ % 6.4.2 n − 1 2Lebensdauer eines instabilen Teilchens # 2 E σ = σ (6.49) 2 n ist ein erwartungstreuer Schätzer für die Varianz σ . Wir betrachten eine Meßreihe von Zerfallszeiten {t1 , ..., tn } für instabilen Teilchen e ist aber nicht der ML-Schätzer #2 fürDies bestimmten Sorte. Als nehmen wir die Exponential er σ die Varianz einer Gaußverteilung ist Wahrscheinlichkeitsdichtefunktion also verzerrt, wobei die an der Stichprobe mptotisch verschwindet. Dieteilung Varianz & ' M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Schätzer effizient. Das sieht man sofort aus Gl. 5.24. Wenn es einen effizienten Schätzer L θ̂ef f gibt, dann muss die Likelihood-Funktion die Bedingung ∂ log ∼ (θ̂ef f − θ) erfüllen. ∂θ L Den ML-Schätzer erhalten wir aber aus der Bedingung ∂ log = 0 und damit ist der ∂θ ML-Schätzer θ̂M L = θ̂ef f . Eigenschaften von ML-Schätzern Konsistenz: Wenn Erwartungwert und Varianz des Schätzers endlich und Grundgesamtheit unabhängig vom Parameter, # $ dann ist der ML-Schätzer ∂b 2 konsistent. Die Varianz ist dann also gegeben durch die SMV: 1+ ∂θ % 2 &. ∂ log L E − allgemeine Aussage. ∂θ 2 ! " V θ̂ = (6.13) Erwartungstreue: Keine Muss für jeden Schätzer untersucht werden. Wenn mehrere ParameterSelten θ1 , ..., θmanalytisch. geschätzt werden Schätzer unverzerrt sind, Meistund mitdie MC-Methode. dann gilt analog für die Kovarianzmatrix Effizienz: % 2 & ∂ log L )ij = E − (V −1 . es einen effizienten ∂θi ∂θj Schätzer (6.14) gibt, Wenn für den Parameter dann wird er durch die ML-Methode gegeben. Man kann zeigen, dass ein effizienter Schätzer dann existiert, wenn die Wahrscheinlichkeitsdichte der Grundgesamtheit von der Form Wenn Grundgesamtheit beschrieben wird durch f (x; θ) = exp (B(θ)C(x) + D(θ) + E(x)) (6.15) Grundgesamtheit von Parameter, ist und die Ausdehnungund des Stichprobenraums nichtunabhängig vom zu schätzenden Parameter abhängt. dann gibt es einen effizienten Schätzer. AsymptotischeExp. Eigenschaften Methoden der TP Kapitel 13 M. Schumacher Die Maximum Likelihood-Methode SoSe 2012 Asymptotische Eigenschaften von ML-Schätzern Asymptotisch = Grenzfall unendlich großen Stichprobenumfangs 107 . VARIANZ VON ML-SCHATZERN Erwartungstreue: ML-Schätzer ist asymptotisch erwartungstreu, wenn ch Gl. 6.19 ist A in diesem Grenzfall aber konstant: Varianz endlich ist, da er konsistent ist. " # ∂ 2 log L "" 1 A = −E = 2 " 6.3. ∂θ VARIANZ VVON [θ̂] ML-SCHATZERN θ̂ ! (6.26) WDF für ML-Schätzer: Geht gegen Gauss-WDF. mit folgt Nach Gl. 6.19 ist A in diesem Grenzfall aber konstant: Effizienz: " ∂ log L "" 1 ML-Schätzer wird = (θ̂100% − θ) ∂θ "θ V [θ̂] ! " # ∂ 2 logVarianz 1= SMV L "" effizient, d.h. (6.27) A = −E = 2 " V [θ̂] wenn Grundgesamtheit unabhängig ∂θ von θ̂Parameter. urch Integration über θ ergibt sich Damit folgt (θ̂ − θ)2 Form der Likelihoodfunktion: log L(θ) = log L(θ̂) − 2V [θ̂] bei der erste iter " ∂ log L "" 1 (6.28) = (θ̂ − θ) ∂θ "θ V [θ̂] Likelihoodfunktion geht gegen Gauss-Funktion. Summand auf der rechten Seite die Integrationskonstante ist. Es folgt log-Likelihoodfunktion gegen Durch Integration übergeht θ ergibt sich Parabel. $ L(θ) = L(θ̂) exp − (θ̂ − θ)2 2V [θ̂] % log L(θ) = log(6.29) L(θ̂) − (θ̂ − θ)2 2V [θ̂] Grenzfall n → ∞ geht die Likelihood-Funktion also in der Tatauf in eine wobeider derTPerste Summand der Gaußverteilung rechten Seite die Integrationskonstante ist. E M. Schumacher Exp. Methoden Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 KAPITEL 6. MAXIMUM-LIKELIHOOD Varianz für Schätzer: Analytische Methode nalytische Methode In wenigen Fällen kann die Varianz analytisch berechnet werden. einigen Fällen kann die Varianz des ML-Schätzers θ̂ direkt analytisch ausgerechnet von: rden (θ0 Benötigt ist wieder Berechnung der wahre Wert des Parameters) ! E[θ̂] = θ̂(x1 , ..., xn )f (x1 , ..., xn ; θ0 ) dx1 ...dxn ≡ µ(θ0 ) (6.31) ! V [θ̂] = (θ̂(x1 , ..., xn ) − µ(θ0 ))2 f (x1 , ..., xn ; θ0 ) dx1 ...dxn ≡ σθ20 (6.32) wartungswert und Varianz des ML-Schätzers hängen vom wahren Wert θ0 ab. Mit Transformationsinvarianz der ML-Schätzer können wir aber für θ0 einfach den MLErwartungswert und Varianz hängen vom wahren Parameterwert ab. hätzer θ̂ einsetzen und erhalten so den ML-Schätzer für die Varianz. In der Praxis: schätze wahren Wert durch ML-Schätzer. onte-Carlo-Methode Für Exponential-WDF kann dies noch hingeschrieben werden und nn die analytische Berechnung der Varianz zu schwierig ist, kann die Monte-Carlo Meliefert bekanntes Ergebnis. de verwendet werden. Aus der Verteilung der Grundgesamtheit f (x; θ) generiert man (k) (k) chproben {x1 , ..., xn }, k = 1, ..., N und berechnet für jede den Wert des ML-Schätzers Allerdings wird diese Methode in der Praxis quasi nicht verwendet. ) = θ̂(x(k) , ..., x(k) ). Diese Werte θ̂ (k) bilden eine neue Stichprobe, und zwar aus der n 1 undgesamtheit aller ML-Schätzwerte. Als Schätzwert für deren Varianz bestimmt man Varianz der Stichprobe nach der TP Kapitel 13 M. Schumacher Exp. Methoden Die Maximum Likelihood-Methode SoSe 2012 Varianz Carlo-Methode für Schätzer: Monte-Carlo-Methode Nachdem wir den Schätzwert für den Parameter bestimmt haben analytische Berechnung der Varianz zu schwierig ist, kann die Monte-Carlo Memüssen wir nun den statistischen Fehler des Schätzers bestimmen, wendet werden. Aus der Verteilung der Grundgesamtheit f (x; θ) generiert man (k)i.e., wie (k) weit die Verteilung der Schätzwerte wäre, wenn wir die en {x1 , ..., xn }, k = 1, ..., N und berechnet für jede den Wert des ML-Schätzers gesamte identische(k) Messung sehr oft wiederholen würden. (k) (k) x1 , ..., xn ). Diese Werte θ̂ bilden eine neue Stichprobe, und zwar aus der amtheitEin allerWeg ML-Sch ätzwerte. Als 100% Schätzwert für deren man (und der einzig korrekte) dies Varianz zu tun, bestimmt ist die identischen z der Stichprobe nach Messungen viele Male mit der MC-Methode zu simulieren. N 1 " (k) 2 σS = (θ̂ − θ̂ (k) )2 . N −1 (6.33) i=1 Für unser Exponential-WDF-Beispiel erhalten wir aus der Varianz der Schätzwerte: e Minimaler Varianz h die Monte-Carlo-Methode zu aufwendig erscheint, kann man folgende Methode Verteilung ist nahezu ätzungBeachte: der Varianz verwenden. Generellgaussförmig. gilt unter sehr allgemeinen BedingunFast immer wahr für durch ML-Methode im Grenzfall die Varianz eines Sch ätzers die Schranke Minimaler Varianz nach unten großer Stichproben. st (siehe Abschnitt 5.4). % &2 ∂b Wähle Datenschätzwert als 1 + Input für MC-Simulation. # $ ∂θ Prüfe Abhängigkeit der Varianz Simulation. ' 2 von ( angenommenen Wert in der (6.34) V θ̂ ≥ ∂ log13L M. Schumacher Exp. Methoden der TP Kapitel Die Maximum Likelihood-Methode SoSe 2012 wobei b die Verzerrung des Schätzers ist. Wie wir gesehen hab Varianz der Schätzer aus SMV asymptotisch effizient und wenn es bei endlichem Stichprob Die Informationsungleichung (RCF) setzt einewird untere die effizienten Schätzer gibt, dann er Schranke durch dieauf ML-Metho Varianz für der beliebigen (nicht nur ML-Schätzer): ML-SchSchätzer ätzer asymptotisch unverzerrt, d.h. b = 0. Daher angenommen, dass sieVON auchML-SCHATZERN bei endlichem Stichprobenumfa 6.3. VARIANZ Varianz mit b = 0 erreichen, so dass die Varianz des ML-Schä $ gesagten gegeben ist. Dies ist nach dem# oben 1 jedoch nicht zw # $ V θ̂ = felsfall durch eine Monte-Carlo Studie bestätigt Wen ∂ 2 logwerden. L E − verzerrt 2 Stichprobe nicht effizient und möglicherweise ∂θ ist, dan Oft ist der Bias b klein, und die Ungleichung gilt exakt oder ist eine Untersch ätzung großer der tatsStichproben). ächlichen Varianz des Schätzers. gute Näherung (z.B. im Grenzfall Dann: bzw. im Fall mehrer Parameter θ , ..., θ die Kovarianzmatri 1 m Für die Berechnung dieser Formeln für' die Varianz( benötig ∂ 2 logDies L kann der zweiten Ableitung der Likelihood-Funktion. −1 . (V )ij = E − dass man auch direkt die (sicherere) Monte-Carlo-Methode ∂θi ∂θj haben wir jedoch gezeigt, dass im Falle eines effizienten unv Erwartungswert durch den Funktionswert an der Stelle des Wir schätzen diesen Wert durch die 2te Ableitung von ln L im Maximum: Damit erhalten wir also als Schätzwert für die Kovarianzmat " 2 ∂ log L "" ! −1 (V )ij = − . ˆ ∂θi ∂θj "θ= ! θ! M. Schumacher oder für den Fall nur eines Parameters Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 s ML-Schätzers ist â = a(θ̂). Links und rechts vom ML-Schätzer ist die Likelihood eine Varianz desdieSchätzers: Graphische Methode onotone Funktion, so dass Gleichung log La (a(θ)) = log Lθ (θ) verwenden kann, um einem bestimmten Wert von a den zugehörigen Wert von θ mit a = a(θ) zu berechnen. Entwickele ln L (θ) in Taylorreihe um das Maximum: 1 = log Lθ (θ̂) − 2 1 log Lθ (θ̂ − δθ̂,− ) = log La (â − σâ ) = log La (â) − = log Lθ (θ̂) − 2 log Lθ (θ̂ + δθ̂,+ ) = log La (â + σâ ) = log La (â) − 1 2 1 2 (6.41) (6.42) ir können also Term das Intervall direkt an der Likelihood-Funktion ablesen. Die TransErster ist ln Lwieder max, zweiter Term verschwindet, mationfür muss explizit ührt die werden. Es gibt jedoch zwei wesentliche Unterdennicht dritten Termdurchgef verwende Informationsungleichung: hiede zum Fall der gaußförmigen Likelihood. Erstens liegen die Grenzen des Intervalls (unter der Annahme der Gleichheit): − δθ̂,− , θ̂ + δθ̂,+ ] jetzt asymmetrisch um den ML-Schätzwert θ̂. Und zweitens ist das alog konstruierte 2σ-Intervall nicht genau doppelt so groß wie das 1σ-Intervall. sammenfassend stellen wir also fest, dass wir das Intervall um den wahren Wert eines rameters θ, in dem 68.3% der ML-Schätzwerte liegen, abschätzen durch das Intervall ischen den Punkten, an denen die Likelihood-Funktion um 0.5 unter ihren Maximalwert i.e., fallen ist. Intervalle mit anderem Wahrscheinlichkeitsinhalt bestimmt man analog, indem an sie an Hand der Gaußverteilung in die entsprechenden Anzahl σ umrechnet: → um zu erhalten, ändere θ von weg, bis ln L um ½ kl. ist als im Max. k2 Grenzen des k × σ-Intervalls: log L = log Lmax − 2 M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode (6.43) SoSe 2012 g in einem Montentialverteilung ert, angedeutet durch diemit senkrechten Striche in (a). (a) zeigt f (t; τ = 1). In (b) ist die Monteaus dieser Stichprobe einer Exponentialverteilung in einem nsalverteilung einem MonteGraphisch: eLikelihood-Funktion inti (a). (a)Exponentialverteilung zeigt zu sehen. Ihr Maximummit liegt bei τ̂ ≈ 1.02. eiten nach einer lverteilung mit ab [1.02 − 0.12, 1.02 + 0.16], ein fast (a) symmetrisches Intervall. urch die senkrechten Striche in (a). zeigt dieser Stichprobe nechnung (a). zeigt und damit σ̂ ≈ 0.14 in erhalten wirdie V, [τ̂aus ] = τ̂dieser = 1). (a) In (b) ist Stichprobe n ≈ 0.021 mit der graphischen liegt beiIhr τ̂ Maximum ≈Methode. 1.02.liegt bei τ̂ ≈ 1.02. ion zuStichprobe sehen. ser Analytisch: 1.02 + 0.16], ein lo-Experiment 500fast malsymmetrisches wiederholt. (c)Intervall. zeigt die Verteilung der gt bei τ̂ ≈ 1.02. etrisches Intervall. τ̂ hätzwerte ist 0.13, bestätigt ≈ RMS-Wert 0.021 und dieser damitVerteilung σ̂ ≈ 0.14 in wir V, [τ̂ ] =τ̂ . nDer Intervall. enMethode. der Varianz von τ̂ . nsches damit σ̂ ≈ 0.14 in τ̂ =ng des Mittelwerts einer Exponentialverteilung (6.58)in einem Monten 50 Zerfallszeiten BEISPIELE VON ML-SCHATZERN mit urden ti nach6.4.einer Exponentialverteilung Beispiel: WDF-Exponentialfunktion -50.5 log L( τ) f(t;τ) 1 (a) 0.8 113 2 τ τ- ∆ τ- (b) τ+ ∆ τ+ (log L) max -51 0.6 0.4 2 0.2 0 0 mit σ̂wiederholt. ≈ 0.14ätzwerte in(c) zeigt der ML-Sch θ̂ kann Hilfe derder charakteristischen t 0tion mal die mit Verteilung 4 H a ufigkeit/0.1 MC-Methode: =Verteilung exp(ikt) der exp − dt = τ τ 1 − ikτ zwerte θ̂ kann mit Hilfe der charakteristischen 0 0.13,Funktion bestätigt 2 ische der Exponentialverteilung ist .n ktion der Summe z = i=1 ti = nτ̂ ist somit $ % t 1 1 1 xp − dt = τφz (k) = 1 − ikτ n . arakteristischen (1 − ikτ ) .n 0 lverteilung ist zn = t = nτ̂ ist somit i ergibti=1 sich die Verteilung der z zu0 charakteristischen ntialverteilung ist n−1 - ∞ 1 RMS 0.13 (c) 1 * z+ exp(−ikz) 1 z . (6.60) dkExp. = Methoden dernTP exp −13 n n M. Schumacher Kapitel − ikτ(1) − ikτ(6.59) ) (n − 1)! τ τ -52 0.8 1 1.2 1.4 τ 3 (6.59) n=2 (d) n=5 2 n=20 n=50 (6.59) 0.5 g( τ;n,τ) 2 n. Die charakteristische Funktion der Exponentialverteilung ist RMS-Wert dieser Verteilung ist 0.13, bestätigt $ % n -τ̂ .∞ 3 1 1 t die Verteilung der ist 0.13, bestätigt (log L) max-0.5 -51.5 (6.60) 1.5 2 1 0 0 0.5 τ (6.61) Die Maximum Likelihood-Methode 1 1.5 2 τ SoSe 2012 Beispiel: ML-Methode mit 2 Parametern Betrachte die Verteilung eines Streuwinkels x = cos θ, Oder wenn xmin < x < xmax, müssen wir korrekt normieren: Beispiel: α = 0.5, β = 0.5, xmin = -0.95, xmax = 0.95, generiere n = 2000 Messungen/Ereignisse mit der MC-Methode. M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Beispiel: ML-Methode mit 2 Parametern- Fit-Ergebnis Numerische Bestimmung des Maximums von ln L(α, β) (MINUIT) liefert Bemerkung: Kein Binning der Daten im Fit. Histogramm nur für Visualisierung Kovarianzen aus M. Schumacher Exp. Methoden der TP Kapitel 13 (MINUIT Routine HESSE) Die Maximum Likelihood-Methode SoSe 2012 Zwei-Parameter-Fit: MC-Studie Wiederhole ML-Fit für 500 Experimente, alle mit jeweils n = 2000 Ereignissen Mittelwerte der Schätzer ~ wahre Werte Kovarianzen nahe an früheren Abschätzungen. Randverteilungen ungefähr gaussförmig. M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Die “ln Lmax - ½”-Kontur Für großen Stichprobenumfang n, wir ln L Paraboloid (quadratische Form) in der Nähe des Maximums: Die Kontur M. Schumacher Exp. Methoden der TP Kapitel 13 ist eine Ellipse: Die Maximum Likelihood-Methode SoSe 2012 Kovarianzen aus “ln L”- Kontur Die (α, β)-Ebene für die erste Messung → Tangenten an Kontur ergeben Standardabweichungen → Winkel der Hauptache der Ellipse zur Horizontalen ergibt Korrelation: Korrelation zwischen Schätzern resultieren in einer Vergrößerung der Standardabweichungen (stat. Fehler). M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Erweiterte ML-Methode Bisher haben wir nur die Form der WDF f(x,θ) verwendet. Nicht auch die die absolute Normierung. Betrachte Anzahl der Beobachtungen als Poisson-verteilte ZV Das Ergebnis eines Experimentes ist dann: n, x1, ..., xn. Die erweiterte Likelihoodfunktion lautet: Annahme die Theorie gibt einen Zusammenhang ν = ν(θ), dann ist die erweiterte ln-Likelihoodfunktion (EML) gegeben durch: wobei C Terme repräsentiert, die nicht von den Parametern θ abhängen. M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Erweiterte ML-Methode Beispiel: erwartete Anzahl von Ereignissen Wobei der totale Wirkungsquerschnitt σ(θ) als Funktion der Parameter in der Theorie vorhergesagt wird, ebenso wie die Verteilung einer Variablen x (normierter differentieller Wirkungsquerschnitt). Erweiterte ML nutzt mehr Information → kleinere Varianz für Wenn ν nicht von θ abhängt, sondern ein freier Parameter ist, dann liefert die EML-Methode: (Dennoch kann es sinnvoll sein die EML-Methode zu verwenden.) M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 ML-Methode für Histogramme Oft werden Daten in Histogramm gefüllt (um Rechenzeit bei Auswertung der Likelihood für sehr große Stichproben zu sparen) Oder Daten liegen nur in Form eines Histogrammes vor Oder WDF der Theorie kann nicht analystisch berechnet sondern nur durch MC-Simulation (z.B. Berücksichtigung von Akeptanz- und Auflösungseffekten (àFaltung)) Stichprobe liefert Histogramm mit Einträgen: Hypothese im Modell mit Parametern θ ist (mit νtot=ntot): M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 ML-Methode für Histogramme Bei analytischer bekannter WDF der Theorie ergeben sich νi oder direkt aus dem Histogramm der Simulation für die WDF. Da ntot konstant, folgt die gemeinsame WDF für den Stichprobenvektor einer Multinomialverteilung. Die log-Likelihood-Funktion ergibt sich zu: C=const.=Terme unabhängig von θi M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 ML-Beispiel für Histogram Unser beliebtes Beispiel: die Exponential-WDF, aber nun als Histogramm Im Grenzfall verschwindender Binbreite à normale ML-Methode Einteilung in Bins führt zu Informationsverlust à Varianz größer M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Erweiterte ML-Beispiel für Histogram Bisher nur Form der Histogramme. Zahl der Einträge in Theorie durch Beobachtung fixiert (mit νtot=ntot) Betrachte nun ntot als Poisson-ZV mit Mittelwert νtot=ntot. Die gemeinsame WDF ergibt sich zu: X Pois(ntot; νtot) = Produkt von N unabhängigen Poisson-WDF in jedem Bin. Und die erweiterte Likelihoodfunktion ist: M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 Erweiterte ML-Methode: Beispiel Ziel: Messung von g. Anzahl der beobachteten Ereignisse hängt quadratisch von g ab. M. Schumacher Exp. Methoden der TP Kapitel 13 Form hängt nicht trivial von g ab. Die Maximum Likelihood-Methode SoSe 2012 Erweiterte ML-Methode: Beispiel-Fit Ergebnis ML: durchgezogene Linien EML: unterbochene Linien EML reduziert den statistischen Fehler M. Schumacher Exp. Methoden der TP Kapitel 13 Die Maximum Likelihood-Methode SoSe 2012 nessungen mehrere Messungen eines Parameters θ vor, fragtML-Methode: sich, wie diese kom Kombination von Messungen mit eines θ vor, sosofragt sich, wieman man dies agt sich, wie man Parameters diese kombinieren um somit eine präzisere Schätzung des Parameters zu erreichen. Ohne Besc ne äziserezwei Sch ätzung des Parameters zu erreichen. Ohne zupr erreichen. Ohne Beschr änkung Annahme: Observable x und mit unterschiedlichen llgemeinheit betrachten wir den Fally von zwei Messungen.Abhängigkeiten Die Meßwerte x vom Parameter , der geschätzt soll. betrachten wir den Fall von zwei werden Messungen. Die Meßwer sungen. Meßwerte x θder ersten ung seien Die verteilt nach fx (x; θ), die Meßwerte y der zweiten Messung nach ontext der ML-Methode sind zwei unterscheiden. er zweiten Messung fy (y; θ).Fälle yzuder rteilt nach fx (x; θ),nach diehier Meßwerte zweiten Messung nterscheiden. sind hier zwei Fälle zu unterscheiden. ML-Methode Zwei unabhängige Messreihen/stichproben für x und y. ihood-Funktion aller Messungen bekannt tfürWenn beide Observablen die Likelihoodfunktionen bekannt sind, beidefüraller Messungen die Likelihood-Funktionen bzw. die Funktionen fx ( nktion Messungen bekannt dann ergibt sich die gemeinsame Likelihoodfunktion zu: θ) bekannt sind, dann kann die Gesamtlikelihood bzw. die Funktionen fx (x; θ) und n m $ $ Messungen die Likelihood-Funktionen bzw. die Funktione L(θ) = fx (xi ; θ) · fy (yj ; θ) = Lx (θ) · Ly (θ) ind, dann kann die Gesamtlikelihood i=1 j=1 n der Parameter mθ nach det werden und dem ML-Prinzip geschätzt werden. · Ly (θ) (6.96) x (θ) $ $ L(θ) = Bestimmung von Schätzwert und Varianz für θ fxnormaler (xi ; θ) ML-Methode · fy (yjwie ; θ)gehabt. = Lx (θ) · Ly (θ) mit i=1 j=1 M. Schumacher Exp. Methoden der TP Kapitel 13 inzip geschätzt werden. Die Maximum Likelihood-Methode SoSe 2012 tzer und Varianzen bekannt niert werden, man die beiden ätzer Meßwerte m Wenn von denindem beiden Messungen lediglich die ML-Sch ätzerals θ̂ätzer θ̂y und der ML-Sch und Varian ML-Sch ätzerML-Sch und Varianzen bekannt x und Kombination von Messungen mit ML-Methode: ! ! rianzen bekannt [θ̂x ] und Vx[;θ̂θ) sind, man für jeweils hinreichend großen θ) Vbzw. gy (θ̂Messungen ansieht und so diekann obige Methode anwendet mit y ] bekannt den beiden lediglich die ML-Sch ätzer θ̂xvon und und dere Wenn den θ̂ beiden Messung y umfang nx und ny davon ausgehen, dass die Wahrscheinlichkeitsdichtevert Wenn vonθ̂y den beiden Messungen die V! [θ̂x ] und V! [θ̂lediglich ] bekannt sind, Annahme: nur Schätzwerte und Varianzen bekannt ssungen lediglich die ML-Sch ätzer θ̂ und und deren Varianzen y ! x V ML-Sch [θ̂y ] bekannt kann fürörmig jeweils hinreichend großen S ätzer gx sind, (θ̂x ; θ) so und gy (θ̂= ;man θ)x (gaußf sind. Die beiden Messungen x ! ! L(θ) g θ̂ ; θ) · g ( θ̂ ; θ). umfang n und n davon aus x y x[θ̂y ] Stichprobeny x V hinreichend [θ̂x ] und V bekannt sind, so kann man sind, so kann man für jeweils großen und ny dass davon ausgehen, dass Wahrscheinlichkeitsdichteverte kombiniert werden, indem man die die beiden ML-Schder ätzer ätzer als Meßwerte ML-Sch gx (θ̂x ; θ) undmit gy (θ n ausgehen, die Wahrscheinlichkeitsdichteverteilungen Im Grenzfall großer Stichproben werden die WDF für die Schätzer umfang n und n davon ausgehen, dass di xdie obige yMethode kombiniert werden, indem ma g ( θ̂ ; θ) bzw. g ( θ̂ ; θ) ansieht und anwendet mit x x y x ;gaußf θ) und ; ist θ)beschrieben: gaußf örmig sind. Die beiden Messungen k dergdurch (θ̂xx(; θ̂ θ)x örmiggsind. beiden können dann außverteilte Meßwerte die Messungen ML-Methode äquivalent zur Method y (θ̂xDie Gauss-Verteilungen yg gx (θ̂xg; y θ)(θ̂ bzw. gy (θ̂gaußf ML-Sch ätzer mit gx (θ̂Verteilungen örm x ; θ) ansieht x ; θ) und x ; θ) m man die beiden ML-Sch ätzer als Meßwerte werden, man die beiden ML-Schätzer ätzerergibt als Meßwerte mit V ate (siehe indem nächstes Kapitel). Als=ML-Sch sich in diesem L(θ) g ( θ̂ ; θ) · g ( θ̂ ; θ). kombiniert werden, indem man die beiden M y x nsieht und die obige Methode anwendet mit x x L zw. gy (θ̂x ; θ) ansieht und die obige Methode anwendet mit Die Messungen können dann werden der Likelihoodfunktion gx (θ̂xkombiniert ; θ) bzw. gy (θ̂θ̂xy;mittels θ) ansieht und die obige θ̂ x FL(θ) ür gaußverteilte ist die ML-Methode äquivalent zur Methode = gx (θ̂x ; θ) · gyMeßwerte (θ̂x ; θ). (6.97) Für gaußverteilte Meßwerte is + ! ! ] ] V [ θ̂ V [ θ̂ Quadrate (siehein nächstes Kapi Quadrate (siehe nächstes Kapitel). ergibt sich diesem Fa L(θ) = gθ̂x (= θ̂x ;Als θ)x·ML-Sch gy (θ̂x ;yätzer θ). . 1 rte ist die ML-Methode äquivalent zur Methode +der 1kleinsten L(θ) = gx (θ̂x ; θ) V! [θ̂x ]θ̂ FallV! [θ̂yθ̂]y Kapitel). Als ML-Schätzer ergibt sich in diesem x erteilte Meßwerte ist die ML-Methode zurdie Methode d ! [θ̂x ] +äquivalent ! [θ̂y ] V V Der ML-Schätzer ergibtFsich zu: ür gaußverteilte Meßwerte ist ML-Met = 1dem Reziproken θ̂y werden alsoθ̂ mit θ̂x 1 . nzelnen Messungen ihrer Varianz siehe nächstes Kapitel). Als ML-Sch ätzer ergibt sich in diesem Fal + + V! [θ̂x ] V! [θ̂y ] ! ! Quadrate (siehe n ächstes Kapitel). Als ML-S ] V [θ̂x ] V [θ̂y(6.98) = die hätzer θ̂für Varianz des kombinierten Wertes 1 1 . Dieist einzelnen Messungen werd + ! ! V [θ̂x ] V [θ̂y ] θ̂y dem Reziproken θ̂x also mit ML-Schätzer für die Varianz ge d Die Messungen ihrer Varianz undeinzelnen dessen Varianz zu: werden + θ̂ x + ] V! [θ̂kombinierten V! [gewichtet. θ̂y1] Wertes x ! ! ML-Sch ätzer ür die Varianz des ist werden also mit fdem Reziproken ihrer Varianz Der V [θ̂x ] V [θ̂]1= 1 1 . 1 . θ̂ = θ̂ = anz des kombinierten Wertes ist + ! 1 + ! ! ! + 1 ] ] V [ θ̂ V [ θ̂ y V [! θ̂x ] Vx[θ̂y ] ! V! [θ̂] = M. Schumacher V [θ̂] = 1 1 1 . + ! (6.99) !Maximum 1Exp. Methoden 1 . der TP Kapitel 13 ] V [ θ̂ VLikelihood-Methode [θ̂y ] Die x + V [θ̂x ] SoSe 2012