Skript - oth-regensburg.de

Werbung

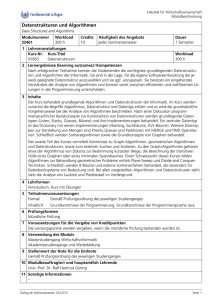

Algorithmen und Datenstrukturen

Prof. Jürgen Sauer

Algorithmen und Datenstrukturen

Skriptum zur Vorlesung im SS 2008

1

Algorithmen und Datenstrukturen

2

Algorithmen und Datenstrukturen

Inhaltsverzeichnis

Literaturverzeichnis.............................................................................................................................................. 7

1. GRUNLEGENDE KONZEPTE............................................................................................................ 9

1.1 Die zentralen Begriffe ..................................................................................................................................... 9

1.2 Algorithmische Grundkonzepte................................................................................................................... 10

1.2.1 Algorithmenbegriffe ................................................................................................................................ 10

1.2.2 Terminierung und Determinismus ........................................................................................................... 10

1.2.3 Algorithmenbausteine .............................................................................................................................. 11

1.2.4 Paradigmen der Algorithmenbeschreibung.............................................................................................. 13

1.2.4.1 Applikative Algorithmen .................................................................................................................. 14

1.2.4.2 Imperative Algorithmen .................................................................................................................... 16

1.2.4.3 Objektorientierte Algorithmen .......................................................................................................... 16

1.2.4.4 Paradigmen und Programmiersprachen ............................................................................................ 19

1.2.5 Beschreibung von Algorithmen ............................................................................................................... 19

1.2.6 Formale Eigenschaften von Algorithmen ................................................................................................ 22

1.2.6.1 Korrektheit und Terminierung .......................................................................................................... 22

1.2.6.2 Effizienz............................................................................................................................................ 23

1.2.7 Komplexität.............................................................................................................................................. 25

1.2.7.1 Laufzeitberechnungen („Big-O“-) .................................................................................................... 28

1.2.7.2 O(logN)-Algorithmen ....................................................................................................................... 32

1.2.7.3 Berechnungsgrundlagen für rechnerische Komplexität .................................................................... 32

1.3 Daten und Datenstrukturen ......................................................................................................................... 35

1.3.1 Datentyp................................................................................................................................................... 35

1.3.2 Datenstruktur............................................................................................................................................ 37

1.3.3 Relationen und Ordnungen ...................................................................................................................... 42

1.3.4 Klassifikation von Datenstrukturen ......................................................................................................... 47

1.3.4.1 Lineare Ordnungsgruppen ................................................................................................................ 47

1.3.4.2 Nichtlineare Kollektion..................................................................................................................... 50

1.3.4.2.1 Hierarchische angeordnete Sammlung (Bäume)........................................................................ 50

1.3.4.2.2 Gruppenkollektionen.................................................................................................................. 55

1.3.4.3 Dateien und Datenbanken ................................................................................................................. 56

1.3.5 Definitionsmethoden für Datenstrukturen................................................................................................ 59

1.3.5.1 Der abstrakte Datentyp...................................................................................................................... 59

1.3.5.2 Die axiomatische Methode................................................................................................................ 60

1.3.5.3 Die konstruktive Methode................................................................................................................. 62

1.3.5.4 Die objektorientierte Modellierung abstrakter Datentypen............................................................... 63

1.3.5.6 Die Implementierung abstrakter Datentypen in Java ........................................................................ 71

1.3.5.6.1 Klassen und Schnittstellen (Referenzdatentypen)...................................................................... 71

1.3.5.6.2 Generische Typen ...................................................................................................................... 76

1.3.5.6.3 Wildcard-Typen ......................................................................................................................... 83

2. DATENSTRUKTUREN UND ALGORITHMEN IN JAVA ................................................................. 88

2.1 Kollektionen (Collections) ............................................................................................................................ 89

2.1.1 Durchwandern von Daten mit Iteratoren ................................................................................................. 89

2.1.2 Die Klasse Vector .................................................................................................................................... 89

2.1.3 Die Klasse Stack ...................................................................................................................................... 92

2.1.4 Die Klasse Bitset für Bitmengen.............................................................................................................. 94

2.1.5 Die Klasse Hashtable und assoziative Speicher....................................................................................... 95

2.1.6 Die abstrakte Klasse Dictionary............................................................................................................... 98

2.1.7 Die Klasse Properties ............................................................................................................................... 98

3

Algorithmen und Datenstrukturen

2.2 Das Collection Framework........................................................................................................................... 99

2.2.1 Die Schnittstellen Collection, Iterator, Comparator................................................................................. 99

2.2.2 Die Behälterklassen und Schnittstellen des Typs List ........................................................................... 102

2.2.3 Queues ................................................................................................................................................... 107

2.2.4 Behälterklassen des Typs Set................................................................................................................. 109

2.2.5 Behälterklassen des Typs Map............................................................................................................... 111

2.2.6 Algorithmen ........................................................................................................................................... 114

2.2.5.1 Datenmanipulation .......................................................................................................................... 114

2.2.5.2 Größter und kleinster Wert einer Collection................................................................................... 115

2.2.5.3 Sortieren.......................................................................................................................................... 115

2.2.5.4 Suchen von Elementen.................................................................................................................... 117

2.2.6 Generics ................................................................................................................................................. 118

2.2.6.1 Sammlungsklassen .......................................................................................................................... 118

2.2.6.2 Implementierung von Java Generics ............................................................................................... 120

2.2.6.2.1 Übersetzung von Generics ....................................................................................................... 120

2.2.6.2.2 Repräsentation von Generics im Laufzeitsystem ..................................................................... 120

2.2.7 Spracherweiterung in Java zur Iteration................................................................................................. 121

2.2.7.1 Erweiterte for-Schleife.................................................................................................................... 121

2.2.7.2 Das Interface Iterable ...................................................................................................................... 122

2.2.8 Implementierung von Graphen-Algorithmen zur Berechnung kürzester Wege mit Behälterklassen .... 124

2.2.8.1 Die Datenstrukturen Graph, Vertex, Edge zur Implementierung von Graphenalgorithmen für die

Berechnung kürzester Wege ....................................................................................................................... 125

2.2.8.2 Kürzeste Pfade in gerichteten, ungewichteten Graphen.................................................................. 127

2.2.8.3 Berechnung der kürzesten Pfadlängen in gewichteten Graphen (Algorithmus von Dijkstra) ........ 131

2.2.8.4 Berechnung der kürzesten Pfadlängen in gewichteten Graphen mit negativen Kosten.................. 136

2.2.8.5 Berechnung der kürzesten Pfadlängen in gewichteten, azyklischen Graphen ................................ 137

3. ALGORITHMEN.............................................................................................................................. 138

3.1 Ausgesuchte algorithmische Probleme...................................................................................................... 138

3.1.1 Spezielle Sortieralgorithmen.................................................................................................................. 138

3.1.1.1 Interne Sortierverfahren .................................................................................................................. 138

3.1.1.1.1 Quicksort.................................................................................................................................. 138

3.1.1.1.2 Heap-Sort ................................................................................................................................. 140

3.1.1.1.3 Sortieren durch Mischen .......................................................................................................... 142

3.1.1.2 Externe Sortierverfahren ................................................................................................................. 145

3.1.1.2.1 Direktes Mischsortieren ........................................................................................................... 145

3.1.1.2.2 Natürliches Mischen ................................................................................................................ 149

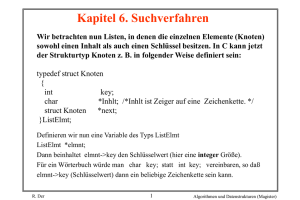

3.1.2 Suche in Texten...................................................................................................................................... 152

3.1.2.1 String Pattern-Matching.................................................................................................................. 152

3.1.2.1.1 Ein einfacher Algorithmus zum Suchen in Zeichenfolgen ...................................................... 152

3.1.2.1.2 Der Algorithmus von Knuth-Morris-Pratt ............................................................................... 153

3.1.2.1.3 Boyer / Moore - Suche ............................................................................................................. 157

3.1.2.2 Pattern-Matching mit regulären Ausdrücken .................................................................................. 164

3.1.2.2.1 Reguläre Ausdrücke..................................................................................................................... 164

3.1.2.2.2 Überprüfung regulärer Ausdrücke mit endlichen Automaten.................................................. 167

3.1.2.2.3 Java 1.4 "regex" ....................................................................................................................... 171

3.2 Entwurfstechniken für Algorithmen (Einsatz von Algorithmen-Mustern)........................................... 174

3.2.1 Greedy Algorithmen .............................................................................................................................. 174

3.2.1.1 Greedy-Algorithmen für minimale Spannbäume ............................................................................ 175

3.2.1.2 Huffman Codes ............................................................................................................................... 178

3.2.2 Divide and Conquer ............................................................................................................................... 184

3.2.3 Induktiver Algorithmenentwurf und Dynamisches Programmieren ...................................................... 184

3.3 Rekursion..................................................................................................................................................... 186

3.3.1 Linear rekursive Funktionen .................................................................................................................. 186

3.3.2 Nichtlineare rekursive Funktionen......................................................................................................... 187

3.3.3 Primitive Rekursion ............................................................................................................................... 187

3.3.4 Nicht primitive Rekursion...................................................................................................................... 187

4

Algorithmen und Datenstrukturen

3.3.5 Rekursive Kurven .................................................................................................................................. 188

3.4 Backtracking-Algorithmen ........................................................................................................................ 193

3.5 Zufallsgesteuerte Algorithmen................................................................................................................... 197

4. BÄUME ........................................................................................................................................... 198

4.1 Grundlagen.................................................................................................................................................. 198

4.1.1 Grundbegriffe und Definitionen ............................................................................................................ 198

4.1.2 Darstellung von Bäumen........................................................................................................................ 199

4.1.3 Berechnungsgrundlagen......................................................................................................................... 200

4.1.4 Klassifizierung von Bäumen.................................................................................................................. 201

4.2 Freie Binäre Intervallbäume...................................................................................................................... 204

4.2.1 Ordnungsrelation und Darstellung ......................................................................................................... 204

4.2.2 Operationen............................................................................................................................................ 208

4.2.3 Ordnungen und Durchlaufprinzipien ..................................................................................................... 222

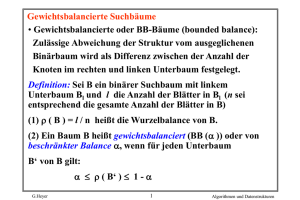

4.3 Balancierte Bäume ...................................................................................................................................... 228

4.3.1 Statisch optimierte Bäume ..................................................................................................................... 231

4.3.2 AVL-Baum ............................................................................................................................................ 232

4.3.3 Splay-Bäume.......................................................................................................................................... 243

4.4 Bayer-Bäume ............................................................................................................................................... 251

4.4.1 Grundlagen und Definitionen ................................................................................................................ 251

4.4.1.1 Ausgeglichene T-äre Suchbäume (Bayer-Bäume) .......................................................................... 251

4.4.1.2 (a,b)-Bäume .................................................................................................................................... 253

4.4.2 Darstellung von Bayer-Bäumen............................................................................................................. 254

4.4.3 Suchen eines Schlüssels ......................................................................................................................... 256

4.4.4 Einfügen................................................................................................................................................. 258

4.4.5 Löschen .................................................................................................................................................. 261

4.4.6 Demonstration eines 3ären bzw. 5ären Bayer-Baums ........................................................................... 268

4.4.6 Auf Platte/ Diskette gespeicherte Datensätze......................................................................................... 270

4.4.7 B*-Bäume .............................................................................................................................................. 272

4.5 Digitale Suchbäume .................................................................................................................................... 275

4.5.1 Grundlagen und Definitionen ................................................................................................................ 275

4.5.2 Tries ....................................................................................................................................................... 276

4.5.3 Binäre Tries............................................................................................................................................ 279

4.5.4 Patricia Bäume (Compressed Tries)....................................................................................................... 279

4.5.5 Suffix Tries ............................................................................................................................................ 281

4.5.6 Dateikompression mit dem Huffman-Algorithmus................................................................................ 281

5. GRAPHEN UND GRAPHENALGORITHMEN................................................................................ 282

5.1 Einführung .................................................................................................................................................. 282

5.1.1 Grundlagen............................................................................................................................................. 282

5.1.2 Definitionen ........................................................................................................................................... 286

5.1.3 Darstellung in Rechnerprogrammen ...................................................................................................... 291

5.2 Durchlaufen von Graphen ......................................................................................................................... 295

5.2.1 Tiefensuche (depth-first search)............................................................................................................. 295

5.2.2 Breitensuche (breadth-first search) ........................................................................................................ 299

5.2.3 Implementierung .................................................................................................................................... 302

5.3 Topologischer Sort ...................................................................................................................................... 306

5.4 Transitive Hülle........................................................................................................................................... 309

5

Algorithmen und Datenstrukturen

5.5 Kürzeste Wege............................................................................................................................................. 310

5.5.1 Der Algorithmus von Dijkstra................................................................................................................ 310

5.5.2 Der Algorithmus von Floyd ................................................................................................................... 312

5.6 Minimale Spannbäume............................................................................................................................... 313

5.6.1 Der Algorithmus von Prim..................................................................................................................... 313

5.6.2 Der Algorithmus von Kruskal................................................................................................................ 316

6

Algorithmen und Datenstrukturen

Literaturverzeichnis

Sauer, Jürgen: Programmieren in Java, Skriptum zur Vorlesung im WS 2005/2007

http://fbim.fh-regensburg.de/~saj39122/pgj/index.html

Sauer, Jürgen: Programmieren in C++, Skriptum zur Vorlesung im SS 2006

http://fbim.fh-regensburg.de/~saj39122/pgc/index.html

Sauer, Jürgen: Datenbanken, Skriptum zur Vorlesung im SS 2007

http://fbim.fh-regensburg.de/~saj39122/dbnew/index.html

Sedgewick, Robert: Algorithmen in Java, 3.überarbeitete Auflage, Pearson Studium,

München …. , 2003

Wirth, Nicklaus: Algorithmen und Datenstrukturen, 2. duchgesehene Auflage,

Teubner, Stuttgart 1979

Ottmann, Thomas und Widmayer, Peter: Algorithmen und Datenstrukturen, BI

Wissenschaftsverlag, Mannheim /Wien /Zürich 1990

Weiss, Marc Allen: Data Structures and Algorithm Analysis in Java, Pearson, Boston

…., 2007

Nowak, Johannes: Fortgeschrittene Programmierung mit Java 5, dpunkt.verlag,

Heidelberg 2005

Saake, Gunter und Sattler, Kai Uwe: Algorithmen und Datenstrukturen,

dpunkt.verlag, 2. überarbeitete Auflage, Heidelberg, 2004

Maurer, H.: Datenstrukturen und Programmierverfahren, Teubner,Stuttgart 1974

Krüger, Guido und Stark, Thomas: Handbuch der Java-Programmierung, 5. Auflage,

HTML-Ausgabe 5.0.1, Addison-Wesley, 2007

Ullenboom, Christian: Java ist auch eine Insel, 7. aktualisierte Auflage, HTMLVersion

7

Algorithmen und Datenstrukturen

8

Algorithmen und Datenstrukturen

1. Grunlegende Konzepte

1.1 Die zentralen Begriffe

In den 50er Jahren bedeutete „Rechnen“ auf einem Computer weitgehend

„numerisches Lösen“ wissenschaftlich-technischer Probleme. Kontroll- und

Datenstrukturen waren sehr einfach und brauchten daher nicht weiter untersucht

werden. Ein bedeutender Anstoß kam hier aus der kommerziellen Datenverarbeitung (DV). So führte hier bspw. die Frage des Zugriffs auf ein Element einer

endlichen Menge zu einer großen Sammlung von Algorithmen 1, die grundlegende

Aufgaben der DV lösen. Dabei ergab sich: Die Leistungsfähigkeit dieser Lösungen

(Programme) ist wesentlich bestimmt durch geeignete Organisationsformen für die

zu bearbeitenden Daten.

Der Datentyp oder die Datenstruktur und die zugehörigen Algorithmen sind

demnach ein entscheidender

Bestandteil eines leistungsfähigen Programms.

Datenstrukturen und Programmierverfahren bilden eine Einheit. Bei der Formulierung

des Lösungswegs ist man auf eine bestimmte Darstellung der Daten festgelegt. Rein

gefühlsmäßig könnte man sagen: Daten gehen den Algorithmen voraus.

Programmieren führt direkt zum Denken in Datenstrukturen, um Datenelemente, die

zueinander in Beziehung stehen, zusammen zu fassen. Mit Hilfe solcher

Datenstrukturen ist es möglich, sich auf die relevanten Eigenschaften der Umwelt zu

konzentrieren und eigene Modelle zu bilden. Die Leistung des Rechners wird dabei

vom reinen Zahlenrechnen auf das weitaus höhere Niveau der „Verarbeitung von

Daten“ angehoben

Datenstrukturen und Algorithmen bilden die wesentlichen Bestandteile der

Programmierung. Ein erster Versuch soll diese zentralen Begriffe so festlegen (bzw.

abgrenzen):

Datenstruktur

Ein auf Daten anwendbares Ordnungsschema (z.B. ein Datensatz oder Array). Mit

der Hilfe von Datenstrukturen lassen sich die Daten interpretieren und spezifische

Operationen auf ihnen ausführen

Algorithmus

Verarbeitungsvorschrift, die angibt, wie Eingabe(daten) schrittweise mit Hilfe von

Anweisungen auf Rechnern in Ausgabe(daten) umgewandelt werden. Für die Lösung

eines Problems existieren meist mehrere Algorithmen, die sich in der Länge sowie

der für die Ausführung benötigte Zeit unterscheiden.

Programm und Programmiersprache

Ein Programm ist die Formulierung eines Algorithmus und seiner Datenbereiche in

einer Programmiersprache.

Eine Programmiersprache erlaubt, Algorithmen präzise zu beschreiben.

Insbesondere legen sie fest:

- die elementaren Operationen

- die Möglichkeiten zu ihrer Kombination

1

D. E. Knuth hat einen großen Teil dieses Wissens in "The Art of Computer Programming" zusammengefaßt

9

Algorithmen und Datenstrukturen

- die zulässigen Datenbereiche

1.2 Algorithmische Grundkonzepte

1.2.1 Algorithmenbegriffe

Algorithmen im Alltag

Gegeben ist ein Problem. Eine Handlungsvorschrift, deren mechanisches Befolgen

- ohne Verständnis des Problems

- mit sinnvollen Eingabedaten

- zur Lösung des Problems

führt, wird Algorithmus genannt. Ein Problem, für dessen Lösung ein Algorithmus

existiert, heißt berechenbar.

Bsp.:

- Zerlegung handwerklicher Arbeiten in einzelne Schritte

- Kochrezepte

- Verfahren zur schriftlichen Multiplikation

- Algorithmen zur Bestimmung des größten gemeinsamen Teiles zweier natürlichen Zahlen

- Bestimmung eines Schaltjahres

- Spielregeln

Der intuitive Algorithmenbegriff

Ein Algorithmus ist eine präzise (d.h. in einer festgelegten Sprache abgefasste)

endliche Beschreibung eines allgemeinen Verfahrens unter Angabe ausführbarer

(Verarbeitungs-) Schritte.

Ein Algorithmus (in der EDV) ist

- ein Lösungsschritt für eine Problemklasse (konkretes Problem wird durch

Eingabeparameter identifiziert)

- geeignet für die Implementierung als Rechnerpogramm

- endliche Folge von elementaren, ausführbaren Instruktionen Verarbeitungsschritten

1.2.2 Terminierung und Determinismus

Abgeleitet vom intuitiven Algorithmenbegriff spielen bei der Konzeption von

Algorithmen die Begriffe Terminierung, Determinismus und Vollständigkeit eine

Rolle:

Terminierung

Ein Algorithmus heißt terminierend, wenn er (bei jeder erlaubten Eingabe von

Parametern) nach endlich vielen Schritten abbricht.

Determinismus

10

Algorithmen und Datenstrukturen

Ein Algorithmus hat einen deterministischen Ablauf, wenn er eine eindeutige

Schrittfolge besitzt. Der Algorithmus läuft bei jedem Ablauf mit den gleichen

Eingaben durch dieselbe Berechnung. Ein Algorithmus liefert ein determiniertes

Ergebnis, wenn bei vorgegebener Eingabe (auch bei mehrfacher Durchführung) stes

ein eindeutiges Ergebnis erreicht wird. Nicht deterministische Algorithmen mit

determiniertem Ergebnis heißen determinierter Algorithmus.Nicht deterministische

Algorithmen können zu einem determiniertem Ergebnis führen, z.B.:

1. Nimm eine Zahl x ungleich Null

2. Entweder: Addiere das Dreifache von x zu x und teile das Ergebnis durch den Anfangswert von x

Oder: Subtrahiere 4 von x und subtrahiere das Ergebnis von x

3. Schreibe das Ergebnis auf

Vollständigkeit

Alle Fälle, die bei korrekten Eingabedaten auftreten können, werden berücksichtigt.

Bsp.:

Nichtvollständige Algorithmen

(1) Wähle zufällig eine Zahl x

(2) Wähle zufällig eine Zahl y

(3) Das Ergebnis ist x/y

Was ist, wenn y == 0 sein sollte

Nicht terminierender Algorithmus

(1) Wähle zufällig eine Zahl x

(2) Ist die Zahl gerade, wiederhole ab (1)

(3) Ist die Zahl ungerade, wiederhole ab (1)

Nicht determinierter Algorithmus

60

64

(1) Wähle zufällig eine natürliche Zahl zwischen 2 und 2

(2) Prüfe, ob die Zahl eine Primzahl ist.

(3) Falls nicht, wiederhole ab 1.

Das Ergenis ist immer eine Primzahl, aber nicht die gleiche, daher ist der Algorithmus nicht

determiniert.

Deterministische,

terminierende

Algorithmen

definieren

jeweils

eine

Ein/Ausgabefunktion: f : Eingabewerte -> Ausgabewerte

Algorithmen geben eine konstruktiv ausführbare Beschreibung dieser Funktion, die

Funktion heißt Bedeutung (Semantik) des Algorithmus. Es kann mehrere

verschiedene Algorithmen mit der gleichen Bedeutung geben.

1.2.3 Algorithmenbausteine

Gängige Bausteine zur Beschreibung bzw. Ausführung von Algorithmen sind:

- elementare Operationen

- sequentielle Ausführung (ein Prozessor)

Der Sequenzoperator ist „;“. Sequenzen ohne Sequenzoperator sind häufig

durchnummeriert und können schrittweise verfeinert werden, z.B:

(1) Koche Wasser

(2) Gib Kaffepulver in Tasse

(3) Fülle Wasser in Tasse

11

Algorithmen und Datenstrukturen

(2) kann verfeinert werden zu:

Öffne Kaffeedose;

Entnehme Löffel von Kaffee;

Kippe Löffel in Tasse;

Schließe Kaffeedose;

- parallele Ausführung

- bedingte Ausführung

Die Auswahl / Selektion kann allgemein so formuliert werden:

falls Bedingung, dann Schritt

bzw.

falls Bedingung

dann Schritt a

sonst Schritt b

„falls ... dann ... sonst ...“ entspricht in Programmiersprachen den Konstrukten:

if Bedingung then ... else … fi

if Bedingung then … else …endif

if (Bedingung) … else …

- Schleife (Iteration)

Dafür schreibt man allgemein

wiederhole Schritte

bis Abbruchkriterium

Häufig findet man auch die Variante

solange Bedingung

führe aus Schritte

bzw. die Iteration über festen Bereich

wiederhole für Bereichsangabe

Schleifenrumpf

Diese Schleifenkonstrukte

Konstrukten:

wiederhole ... bis ...

solange … führe aus

wiederhole für

entsprechen

repeat ... until …

do …

while ...

while … do ...

while ( ... ) ...

for each ... do …

for ... do …

for ( ... ) ...

- Unterprogramm (Teilalgoritmus)

- Rekursion

12

jeweils

den

Programmiersprachen-

Algorithmen und Datenstrukturen

Eine Funktion (mit oder ohne Rückgabewert, mit oder ohne Parameter) darf in der

Deklaration ihres Rumpfes den eigenen Namen verwenden. Hierdurch kommt es zu

einem rekursiven Aufruf. Typischerweise werden die aktuellen Parameter so

modifiziert, daß die Problemgröße schrumpft, damit nach mehrmaligem Wiederholen

dieses Prinzips keine weiterer Aufruf erforderlich ist und die Rekursion abbrechen

kann.

1.2.4 Paradigmen der Algorithmenbeschreibung

Ein Algorithmenparadigma legt Denkmuster fest, die einer Beschreibung eines

Algorithmus zugrunde liegen. Faßt man einen Algorithmus als Beschreibung eines

allgemeinen Verfahrens unter Verwendung ausführbarer elementarer Schritte auf,

dann gibt es 2 grundlegende Arten, Schritte von Algorithmen zu notieren:

- Applikative Algorithmen sind eine Verallgemeinerung der Funtionsauswertung

mathematisch notierter Funktionen. In ihnen spielt die Rekursion 2 eine wesentliche

Rolle.

- Imperative Algorithmen basieren auf einem einfachen Maschinenmodell mit

gespeicherten und änderbaren Werten. Hier werden primär Schleifen und

Alternativen als Kontrollbausteine eingesetzt.

In der Informatik sind darüber hinaus noch folgende Paradigmen wichtig:

- Objektorientiete Algorithmen. In einem objektorientierten Algorithmus werden

Datenstrukturen und Methoden zu einer Klasse zusammengefasst. Von jeder

Klasse können Objekte gemäß der Datenstruktur erstellt und über die Methode

manipuliert werden.

Das objektorientierte Paradigma ist kein Algorithmenparadigma im engeren Sinne,

da es sich um ein Paradigma zur Strukturierung von Algorithmen handelt, das

sowohl mit applikativen, imperativen und logischen Konzepten zusammen

eingesetzt werden kann.

- logische (deduktive) Algorithmen. Ein logischer Algorithmus führt Berechnungen

durch, indem er aus Fakten unjd Regeln durch Ableitungen in einem logischen

Kalkül weitere Fakten ausweist.

2

vgl. 3.3

13

Algorithmen und Datenstrukturen

1.2.4.1 Applikative Algorithmen

Idee: Defintion zusammengesetzter Funktionen durch Ausdrücke / Terme, z.B.

f ( x) = 5 x + 1 .

Definitionen

Ein applikativer Algorithmus ist eine Liste von Funktionsdefinitionen

f1 (v1,1 ,..., v1,n1 ) = t1 (v1,1 ,..., v1,n1 )

.

.

f m (v m1,1 ,..., v m1,nm ) = t m (v m1,1 ,..., v m ,nm )

v1 ,..., v n : Unbestimmte vom Typ τ 1 ,...,τ n , formale Parameter.

t (v1 ,..., v n ) : ein Term (/Ausdruck), heißt Funktionsausdruck

Die erste Funktion wird ausgewertet und bestimmt die Bedeutung (Semantik) des

Algorithmus.

Bsp.: Auswertungen 3

1. f ( x, y ) = if g ( x, y ) then h( x + y ) else h( x − y ) fi

g ( x, y ) = ( x = y ) or odd ( y )

h( x) = j ( x + 1) ∗ j ( x − 1)

j ( x) = 2 x − 3

4 f (1,2) a if g (1,2) then h(1 + 2) else h(1 − 2) fi

a if 1 = 2 or odd (2) then h(1 + 2) else h(1 − 2) fi

a if 1 = 2 or false then h(1 + 2) else h(1 − 2) fi

a if false or false then h(1 + 2) else h(1 − 2) fi

a if false then h(1 + 2) else h(1 − 2) fi

a h(1 − 2)

a h(−1)

a j (−1 + 1) ∗ j (−1 − 1)

a j (0) ∗ j (−1 − 1)

a j (0) ∗ j (−1 − 1)

a j (0) ∗ j (−2)

a j (2 ∗ 0 − 3) ∗ j (−2)

a (−3) ∗ (−7)

a 21

2. f ( x, y ) = if x = 0 then y else (

if x > 0 then f ( x − 1, y ) + 1else − f (− x,− y ) fi ) fi

f (0, y ) a y für alle y

f (1, y ) a f (0, y ) + 1a y + 1

f (2, y ) a f (1, y ) + 1a y + 1 + 1 a y + 2

3

x, y : ganze Zahlen

4 a : konsekutive Ausführung mehrerer elementarer Termauswertungsgebiete

14

Algorithmen und Datenstrukturen

….

f (n, y ) a y + n

f (−1, y ) a − f (1,− y ) a −(1 − y ) a y − 1

…

f ( x, y ) = x + y

Eine Funktionsdefinition definiert eine Funktion f : τ 1 × τ 2 × ...τ n → τ n

Sind a1 ,..., a n Werte vom Typ τ 1 ,...,τ n , so ersetzt man bei der Auswertung von

f (a1 ,..., a n ) im definierten Vorkommen v1 durch a1 und wertet t (a1 ,..., a n ) aus.

a1 ,..., a n : aktuelle Parameter

f (a1 ,..., a n ) : Funktionsaufruf

Aufrufe definierter Funktionen dürfen als Terme verwendet werden.

Bsp. für applikative Algorithmen

1. Fakultätsberechnung

x!= x ∗ ( x − 1) ∗ ( x − 2) ∗ ... ∗ 2 ∗ 1

für x > 0

mathematische Funktion

fak ( x) = if x ≤ 0 then1else x ∗ fak ( x − 1)

applikativer Algorithmus

5

2. Größter gemeinsamer Teiler (ggT)

ggT ( x, x) = x

mathematische

ggT ( x, y ) = ggT ( y, x)

Gesetzmäßigkeiten

ggT ( x, y ) = ggT ( x, y − x)

für x < y

applikativer Algorithmus

ggT ( x, y ) = if ( x ≤ 0) or ( y ≤ 0) then ggT ( x, y )

else if x = y then x

else if x > y then ggT ( y, x)

else ggT ( x, y − x)

fi fi fi;

ggT ist korrekt für positive Eingaben, bei negativen Eingaben ergeben sich nicht

abbrechbare Berechnungen (undefinierte Funktionen) 6.

ggT (39,15) a ggT (15,39) + ggT (15,24) a ggT (15,9) a ggT (9,15) a ggT (9,6) a ggT (6,9)

ggT (6,3) a ggT (3,6) + ggT (3,3) a 3

3. Fibonacci-Zahlen: f 0 = f 1 = 1, f i = f i −1 + f i − 2 für i > 0

fib( x) = if ( x = 0) or ( x = 1) then1 else fib( x − 2) + fib( x − 1) fi

⎧ x _ te Fibonacci − Zahl falls x ≥ 0

Bedeutung: fib( x) = ⎨

sonst

⎩ 1

5

6

vgl. 1.2.5

Das Berechnungsschema stützt sich auf eine Formularisierung des Originalverfahrens von Euklid ab.

15

Algorithmen und Datenstrukturen

1.2.4.2 Imperative Algorithmen

In einem imperativen Algorithmus gibt es Variable, die verschiedene Werte

annehmen können. Die Menge aller Variablen und ihrer Werte (sowie der

Programmzähler) beschreiben den Zustand zu einem bestimmten Zeitpunkt. Ein

Algorithmus bewirkt eine Zustandstransformation.

Imperative Konzepte

- Anweisungen

-- primitive Anweisungen: Zuweisung, Block, Prozeduraufruf

-- zusammengesetzte Anweisungen: Sequenz, Auswahl, Iteration

- Ausdrücke

-- primitive Ausdrücke: Konstante, Variable, Funktionsaufruf

-- zusammengesetzte Ausdrücke: Operanden / Operatoren

- Datentypen

-- primitive Datentypen: Wahrheitswerte, Zeichen, Zahlen, Aufzählung

-- zusammengesetzte Datentypen: Felder, Verbund, Vereinigung, Zeiger

- Abstraktion

-- Anweisung

-- Ausdruck: Funktionsdeklaration

-- Datentyp: Typdeklaration

- Weitere Konzepte

-- Ein- und Ausgabe

-- Ausnahmenbehandlung

-- Bibliotheken

-- Parallele und verteilte Berechnungen

Wertzuweisungen sind die einzigen elementaren Anweisungen imperativer

Algorithmen. Aus ihnen werden zusammengesetzte Anweisungen gebildet, aus

denen imperative Algorithmen bestehen.

Elementare Anweisungen können auf unterschiedliche Art zu komplexen

Anweisungen zusammengestzt werden:

(1) sequentielle Ausführung

(2) bedingte Ausführung

(3) wiederholte Ausführung

(4) Ausführung als Unterprogramm

(5) rekursive Ausführung eines Unterprogramms

Diese Möglichkeiten werden als Kontrollstrukturen bezeichnet.

1.2.4.3 Objektorientierte Algorithmen

Das objektorientierte Paradigma der Algorithmenentwicklung hat verschiedene

Wurzeln:

-

Realisierung abstrakter Datentypen 7

Rechnergeeignete Modellierung der realen Welt (objektorientierte Analyse)

Problemnaher Entwurf von Softwaresystemen (objektorientiertes Design)

Problemnahe Implementierung (objektorientierte Programmierung

Ein Objekt ist die Repräsentation eines Gegenstands und Sachverhalts der realen

Welt oder eines gedanklichen Konzepts.

7

Vgl. 1.3.5.1

16

Algorithmen und Datenstrukturen

Es ist gekennzeichnet durch

-

-

eine eindeutige Identität, durch die es sich von anderen Objekten unterscheidet

Wertbasierte Objektmodelle: In diesem Modell besitzen Objekte keine eigene Identität im

eigentlichen Sinn. Zwei Objekte werden schon als identisch angesehen, wenn ihr Zustand

gleich ist.

Identitätsbasierte Objektmodelle: Jedem Objekt innerhalb des Systems wird eine vom Wert

unabhängige Identität zugeordnet,

statische Eigenschaften zur Darstellung des Zustands des Objekts in Form von Attributen

dynamische Eigenschaften in Form von Methoden, die das Verhalten des Objekts

beschreiben

Der Zustand eines Objekts zu einem Zeitpunkt entspricht der Belegung der Attribute

des Objekts zu diesem Zeitpunkt.

Der Zustand kann mit Hilfe von Methoden erfragt und geändert werden.

Methoden sind in der programmiesprachlichen Umsetzung Prozeduren und

Funktionen, denen Parameter übergeben werden können. Der Zustand eines eine

Methode ausführenden Objekts (und nur dieses Objekts) ist der Methode im Sinne

einer Menge globaler Variablen direkt zugänglich. Es kann daher sowohl gelesen als

auch geändert werden.

Objekte verwenden das Geheimnisprinzip und das Prinzip der Kapselung. Sie

verbergen ihre Interna:

-

Zustand (Belegung der Attribute)

Implementierung ihres Zustands

Implementierung ihres Verhaltens

Objekte sind nur über ihre Schnittstelle, also über die Menge der vom Objekt der

Außenwelt zur Verfügung gestellten Methoden zugänglich. Man spricht von den

Diensten des Objekts.

Objekte interagieren über Nachrichten:

-

Ein Objekt x sendet eine Nachricht an Objekt y. y empfängt die Nachricht von x

Innerhalb der Programmiersprache wird dieser Vorgang meistens durch einen

Methodenaufruf implementiert

Nachrichten (Methodenaufrufe) können den Zustand eines Objekts verändern

Ein Objekt kann sich selbst Nachrichten schicken.

Objekte können in Beziehung zueinander stehen.

-

-

-

Die Beteiligten an eine Beziehung nehmen Rollen ein, z.B.:

Rolle des Arztes: „behandelnder Arzt“,

Rolle des Patienten: „Patient“

Ein Objekt kann mit mehreren Objekten in Beziehung stehen

Rolle vom Arzt: „behandelnder Arzt“

Rolle von Patient 1: „Patient“, Rolle von Patient 2: „Patient“

Nachrichen können nur ausgetauscht werden, wenn eine Beziehung besteht

Beziehungen können sich während der lebenszeit eines Objekts verändern

Es gibt in der Regel Objekte, die sich bezüglich der Attribute, Methoden und

Beziehungen ähnlich sind. Daher bieten es sich an, diese Objekt zu einer Klasse

zusammenzufassen. Die Klasse beinhaltet dann auch Angaben darüber, wie Objekte

dieser Klasse verwaltet (z.B. erzeugt oder gelöscht) werden können.

-

Klassendefinitionen sind eng verwandt mit abstrakten Datentypen. Sie legen Attribute und

Methoden der zugehörigen Objekte fest

Objekte dieser Klasse nennt man auch Instanzen dieser Klasse

17

Algorithmen und Datenstrukturen

-

Beziehungen (Assoziationen) zwischen Objekten werden auf Klassenebene beschrieben

Ein Konstruktor ist eine Methode zur Erzeugung von Objekten 8.

-

Es gibt Attribute von Klassen, die nicht an konkrete Instanzen gebunden sind. Diese heißen

Klassenvariable oder statische Vartiable.

Klassenvariable existieren für die gesamte Lebensdauer einer Klasse genau einmal –

unabhängig davon, wie viele Objekte erzeugt wurden

Neben Klassenvariablen gibt es auch Klassenmethoden, d.h. Methoden, deren Existenz

nicht an konkrete Objekte gebunden ist. Klassenmethoden werden auch statische Methoden

genannt.

Zu ähnlichen Klassen versucht man eine gemeinsame Oberklasse (Basisklasse) zu

finden, die die Ähnlichkeiten aufnimmt. Unterklassen (Subklassen) werden nur um

individuelle Eigenschaften ergänzt, denn eine Unterklasse erbt die Attribute und

Methoden der Oberklasse.

Eine Veraible vom Typ einer Basisklasse kann während ihrer Lebensdauer sowohl

Objekte ihres eigenen Typs als auch soche von abgeleiteten Klassen aufnehmen.

Dieses wird als Polymorphismus 9 bezeichner.

-

-

-

Eine Unterklasse erbt von ihrere Oberklasse alle Attribute und Methoden und kann diese um

weitere Methoden ergänzen

Erben heißt: Die Attribute und Methoden können in der Unterklasse verwendet werden, als

wären sie in der Klasse selbst definiert.

Vererbungen können mehrstufig sein. Es entstehen Vererbungshierarchien.

Eine Unterklasse kann eine Variable deklarieren, die denselben Namen trägt, wie eine der

Oberklasse. Hierdurch wird eine weiter oben liegende Variable verdeckt. Dies wird häufig

dazu benutzt, um den Typ einert Variablen der Oberklasse zu überschreiben. In manchen

Programmiersprachen gibt es Konstrukte, die den Zugriff auf verdeckte Variable ermöglichen

Metoden, die aus der Basisklasse geerbt wurden, dürfen in der abgeleiteten Klasse

überlagert, d.h. neu definiert werden.

Da eine Variable einer Basisklasse Werte von verschiedenen Typen annehmen kann,

entscheidet sichj bei überlagerten Mathoden erst zur Laufzeit, welche Methode zu verwenden

ist: Dynamische Methodensuche

Wird eine Methode in einer abgeleiteten Klasse überlagert, wird die ursprüngliche Methode

verdeckt. Aufrufe der Methode beziehen sich auf die überlagerte Variante

In amnchen Programmiersprachen gibt esw Konstrukte, die den Zugriff auf überlagerte

Methoden ermöglichen 10.

Mit Hilfe von Modifikatoren 11 können Sichtbarkeit und Eigenschaften von Klassen,

Variablen und Methoden beeinflusst werden.

-

Die Sichbarkeit bestimmt, ob eine Klasse, Variable oder Methode in anderen Klassen genutzt

werden kann.

Eigenschaften, die über Modifikatoren gesteuert werden können, sind z.B. die Lebensdauer

und die Veränderbarkeit

Abstrakte Methoden: Eine Methode heißt abstrakt, wenn ihre Deklaration nur die

Schnittstelle, nicht aber die Implementierung enthält. Im Gegensatz dazu stehen die

konkreten Methoden, deren Deklaration auch Implementierungen besitzen 12.

Abstrakte Methoden können nicht aufgerufen werden, sie definieren nur eine

8

Vgl. Skriptum zur Vorlesung im WS 2005 / 2006: Programmieren in Java, 1.4.1.1.3

Vgl. Skriptum zur Vorlesung im WS 2005 / 2006: Programmieren in Java, 1.4.1.8

10 in Java: Verwendung des Präfixes: super

11 Bsp. für Modifikatoren in Java sind: public, private, static, final, …

12 Java: Die Deklaration einer abstrakten Methode erfolgt durch den Modifikator abstract.

9

18

Algorithmen und Datenstrukturen

Schnittstelle. Erst durch Überlagerung in einer abgeleiteten Klasse und durch

Angabe der fehlenden Implementierung wird eine abstrakte Klasse konkret.

Abstraklte Klassen: Eine Klasse, die nicht instanziiert werden kann, heißt abstrakte

Klasse. Klassen, von denen Objekte erzeugt werden können, sind konkrete Klassen.

Jede Klasse, die mindestens eine abstrakte Methode besitzt, ist abstrakt 13.

Schnittstellen: Eine Schnittstelle (interface) ist in Java eine Klasse, die

ausschließlich Konstanten und abstrakte Methoden enthält. Zur Definition einer

Schnittstelle wird das Schlüsselwort class durch das Schlüsselwort interface

ersetzt.

Generizität: Unter Generizität versteht man die Parametrisierung von Klassen,

Datentypen, Prozeduren, Moduln, Funktionen, etc. Als Parameter werden in der

Regeln Datentypen (manchmal auch Algorithmen in Form von Prozeduren)

verwendet.

1.2.4.4 Paradigmen und Programmiersprachen

Zu den Paradigmen korrespondieren jeweils Programmiersprachen, die diesen

Ansatz realisieren. Moderne Programmiersprachen vereinen oft Ansätze mehrerer

Paradigmen. So ist bspw. Java objektorientiert 14, umfasst aber auch imperative und

applikative Elemente.

1.2.5 Beschreibung von Algorithmen

Verbreitetes Grundschema von Algorithmen

Name des Algorithmus und Parameterliste

Spezifikation des Ein- und Ausgabeverhaltes

1. Schritt

Einführung von Hilfsgrößen

Vorbereitung

Initialisierungen

2. Schritt

Prüfe, ob ein einfacher Fall vorliegt

Trivialfall

Falls ja: Ergebnis ausgeben und enden

3. Schritt

Reduziere Problemstellung A auf einfachere Form B

Problemreduktion, (z.B. Aufteilen in Teilprobleme)

Ergebnisaufbau

4. Schritt

entweder Rekursion:

oder Iteration:

Rekursion bzw.

Rufe Algorithmus mit

Fahre mit B anstelle a bei

Iteration

reduziertem B auf

Schritt 2 fort

Verbale Umschreibung von Algorithmen

Eine derartige Handlungsanweisung könnte bspw. die „Berechnung des größten

gemeinsamen Teilers von a und b“ in folgender Weise sein:

1. Weise x den Wert von a zu

2. Weise y den Wert von b zu

3. Falls x gleich y ist: gehe zu 9

13

Java: Es ist erforderlich, abstrakte Klassen abzuleiten und in der abgeleiteten Klasse eine oder mehrere

abstrakte Methoden zu implementieren. Die Konkretisierung kann über mehrere Stufen erfolgen.

14 Vgl. Skriptum zur Vorlesung im WS 2005 / 2006: Programmieren in Java, 1.

19

Algorithmen und Datenstrukturen

4. Falls x kleiner als y ist: gehe zu 7

5. Weise x den Wert von (x-y) zu

6. Gehe zu 3

7. Weise y den Wert von (y-x) zu

8. gehe zu 3

9. Weise ggTden Wert von x zu

Pseudo-Code

- Abstrakte Beschreibung eines Algorithmus

- Strukturierter als Beschreibung mit normalen Sprachvokabular

- weniger detailliert als ein Programm

- Bevorzugete Notation zur Beschreibung eines Algorithmus

- versteckt Programmimplementierungsprobleme

Bsp.: Finden des größten Elements in einem Array

Algorithmus arrayMax(a,n)

Input array a mit n Ganzzahlen

Output größtes Element von a

currentMax = a[0]

for i= 1 to n-1 do

if (a[i] > curentMax then currentMax = a[i]

return currentMax

Pseudocode-Details:

- Kontrollfluss

-- if … then … [else …]

-- while … do …

-- repeat … until …

-- for … do

- Einrücken ersetzt Klammern

- Deklaration von Methoden

Algorithmus methode(arg [,arg …])

Input …

Output …

- Rückgabewert

return Ausdruck

- Ausdrücke

=

Zuweisung

==

Gleiheitstest

2

Subscripts und andere mathematische Formulierungen sind erlaubt

n

Pseudo-Code Elemente:

Sequenz

Verzeigung

{

Anweisung_1

Anweisung_2

…

Anweisung_n

}

if Bedingung

{

Anweisung_1

Anweisung_2

…

Anweissung_n

}

else

{

Anweisung_m

…

Anweisung_k

}

20

Algorithmen und Datenstrukturen

Iteration

While Bedingung

{

Anweisung_1

Anweisung_2

…

Anweisung_n

}

Graphische Darstellung von Flußdiagrammen

Normierte Methode (DIN 66001) zur Darstellung von Programmen

Kontrollstrukturen und Struktogramme

Strukturblock

Anweisung_1

Anweisung_2

….

Java-Struktur 15

Kommentar

Block in geschweiften

Klammern

{

Anweisung_1;

Anweisung_2;

…..

Eine Folge von Anweisungen,

die alle der Reihe nach

abgearbeitet werden,

bezeichnet man als Sequenz.

Anweisung_n;

}

Anweisung_n

Sequenz

if-Anweisung

if (Bedingung)

{

anweisung1;

}

else {

Anweisung2;

}

Fallunterscheidung

(bedingte Anweisung)

1

2

3

A1

A2

A3

Fall

….

Mehrfachauswahl

sonst

An

Mit einer Anweisung der Form

Wenn Bedingung erfüllt

dann führe Anweisung1 aus

sonst führe Anweisung 2 aus

führt man eine

Fallunterscheidung durch

switch-Anweisung

Mehrfachauswahl

switch (Ausdruck) {

case Wert1 :

Anweisung1;

break;

case Wert2 :

Anweisung2;

break;

default:

Anweisungn

}

Der Ausdruck muß ganzzahlig

sein. Das Programm wird an

der case-Anweisung

fortgesetzt., deren Wert dem

Ausdruck entspricht. Falls

Ausdruck keinem der Werte

entspricht, geht es mit der

default-Anweisung weiter

for-Schleife

Eine Anweisung der Form

for (int i=1;i <=n; i++)

{

Für Zähler = Anfang bis Ende

Anweisung

für i=1 bis n

Anweisung

15

Vgl. Skriptum zur Vorlesung im WS 2005 / 2006: Programmieren in Java, 2.4

21

Algorithmen und Datenstrukturen

Gezählte Schleife

for-Schleife

Anweisung;

}

heißt gezählte Schleife.

Gezählte Schleifen werden

dann benutzt, wenn man weiß,

wie oft eine Schleife

durchlaufen werden muß

while-Schleife

Eine Anweisung der Form

while (Bedingung)

{

Anweisung;

}

Solange bedingung erfüllt

führe Anweisung aus

do-while-(repeat)Schleife

Eine Anweisung der Form

solange Bedingung

Anweisung

while-Schleife

Anweisung

bis Bedingung

repeat-Schleife

do

{

Anweisung;

} while (Bedingung);

Prozeduraufruf

Prozedurname(Arg1,

Arg2, … , Argn);

heißt Schleife mit Eingangsbedingung. Trifft die

Bedingung anfangs nicht zu,

so wird die Wiederholungsanweisung nicht ausgeführt

Wiedrhole Anweisung

Solange Bedingung erfüllt

heißt Schleife mit Ausgangsbedingung. Im Unterschied

zur while-Schleife wird die zu

wiederholende Anweisung

mindestens einmal ausgeführt.

Prozeduren werden über ihren

Namen aufgerufen. In

Klammern kann man

Argumente übergeben.

Prozeduraufruf

1.2.6 Formale Eigenschaften von Algorithmen

1.2.6.1 Korrektheit und Terminierung

Die wichtigste formale Eigenschaft eines Algorithmus ist die Korrektheit. Dazu muß

gezeigt werden, daß der Algorithmus die jeweils gestellte Aufgabe richtig löst. Man

kann die Korrektheit eines Algorithmus im Allg. nicht durch Testen an ausgewählten

Beispielen nachweisen 16:

Durch Testen kann lediglich nachgewiesen werden, dass sich ein Programm für endlich viele

Eingaben korrekt verhält.

Durch eine Verifikation kann nachgewiesen werden, dass sich das Programm für alle Eingaben

korrekt verhält.

Bei der Zusicherungsmethode sind zwischen den Statements sogenannte Zusicherungen eingesetzt,

die eine Aussage darstellen über die momentane Beziehung zwischen den Variablen. Typischerweise

gibt man Zusicherungen als Kommentare vor.

/* P */

16

E. Dijkstra formulierte das so: Man kann durch Testen die Anwesenheit von Fehlern, aber nicht die

Abwesenheit von Fehlern nachweisen.

22

Algorithmen und Datenstrukturen

while (b)

{

/* P && b */

…

/* P */

}

/* P && !b */

Zusicherungen enthalten boolsche Ausdrücke, von denen der Programmierer annimmt, dass sie an

entsprechender Stelle gelten.

Beginnend mit der ersten, offensichtlich richtigen Zusicherung lässt sich als letzte

Zusicherung eine Aussage über das berechnete Ergebnis durch Anwendung der

Korrektheitsformel 17 ableiten:

{ P } A { Q }

-

P und Q sind Zusicherungen

P ist die pre-condition (Vorbedingung), beschreibt die Bedingungen (constraints).

Q ist die post-condition (Nachbedingung), beschreibt den Zustand nach Ausführung der

Methode

Die Korrektheitsformel bedeutet: Jede Ausführung von A, bei der zu Beginn P erfüllt

ist, terminiert in einem Zustand, in dem Q erfüllt ist.

Die Korrektheitsformel bestimmt partielle Korrektheit : "Wenn P beim Start von A

erfüllt ist, und A terminiert, dann wird am Ende Q gelten".

Für die Terminierung gilt folgende Formel: { P} A. Sie bedeutet: "Wenn P beim

Start von A erfüllt ist, wird A terminieren.

Partielle Korrektheit und Terminierung führen zur totale Korrektheit. Totale

Korrektheit ist eine stärkere Anforderung an das Programm.

Da das Halteproblem bekanntlich unentscheidbar ist, kann im allgemeinen die totale

Korrektheit nicht entschieden werden.

1.2.6.2 Effizienz

Die zweite wichtige Eigenschaft eines Algorithmus ist seine Effizienz. Die wichtigsten

Maße für die Effizienz sind der zur Ausführung des Algorithmus benötigte

Speicherplatz und die benötigte Rechenzeit (Laufzeit):

1. Man kann die Laufzeit durch Implementierung des Algorithmus in einer

Programmiersprache (z.B. C++) auf einem konkreten Rechner für eine Menge

repräsentativer Eingaben messen.

Bsp.: Implementierung eines einfachen Sortieralgorithmus in C++ mit Messen der

CPU-Zeit 18.

#include <time.h>

// …

clock_t start, finish;

start = clock();

sort(…);

17

Robert Floyd hatte 1967 die Idee den Kanten von Flussdiagrammen Prädikate zuzuordnen, um

Korrektheitsbeweise zu führen. C.A.R. Hoare entwickelte die Idee weiter, indem er Programme mit

"Zusicherungen" anreicherte. Er entwickelte das nach ihm benannte "Hoare Tripel"

18 In Java steht zur Zeitmessung die Methode Methode currentTimeMillis() aus System zur Verfügung.

currentTimeMillis bestimmt die Anzahl der Millisekunden, die seit Mitternacht des 1.1.1970 vergangen sind.

23

Algorithmen und Datenstrukturen

finish = clock();

cout << "sort hat " << double (finish – start) / CLOCKS_PER_SEC

<< " Sek. benoetigt\n";

// …

Solche experimentell ermittelten Meßergebnisse lassen sich nicht oder nur schwer

auf andere Implementierungen und andere Rechner übertragen.

2. Aus dieser Schwierigkeit bieten sich 2 Auswege an:

1. Man benutzt einen idealiserenden Modellrechner als Referenzmaschine und mißt die auf diesem

Rechner zur Ausführung des Algorithmus benötigte Zeit und benötigten Speicherplatz. Ein in der

Literatur 19 zu diesem Zweck häufig benutztes Maschinenmodell ist das der RAM (Random-AccessMaschine). Eine solche Maschine verfügt über einige Register und eine (abzählbar unendliche)

Menge einzeln addressierbarer Speicherzellen. Register und Speicherzellen können je eine (im

Prinzip) unbeschränkt große (ganze oder reelle) Zahl aufnehmen. Das Befehlsrepertoire für eine RAM

ähnelt einer einfachen, herkömmlichen Assemblersprache. Die Kostenmaße Speicherplatz und

Laufzeit enthalten dann folgende Bedeutung: Der von einem Algorithmus benötigte Speicherplatz ist

die Anzahl der zur Ausführung benötigten RAM-Speicherzellen. Die benötigte Zeit ist die Zahl der

ausgeführten RAM-Befehle.

2. Bestimmung einiger für die Effizienz des Algorithmus besonders charakteristischer Parameter 20.

Laufzeit und Speicherbedarf eines Algorithmus hängen in der Regel von der Größe der Eingabe ab 21.

Man unterscheidet zwischen dem Verhalten im besten Fall, dem Verhalten im Mittel (average case)

und dem Verhalten im schlechtesten Fall (worst case). In den meisten Fällen führt man eine worstcase Analyse für die Ausführung eines Algorithmus der Problengröße N durch. Dabei kommt es auf

den Speicherplatz nicht an, lediglich die Größenordnung der Laufzeit- und Speicherplatzfunktionen in

Abhängigkeit von der Größe der Eingabe N wird bestimmt. Zum Ausdruch dieser Größenordnung hat

sich eine besondere Notation eingebürgert: die O-Notation bzw. Big-O-Notation.

Laufzeit T(N): Die Laufzeit gibt exakt an, wieviel Schritte ein Algorithmus bei einer

Eingabelänge N benötigt. T(N) kann man im Rahmen sog. assymptotischer

Kostenmaße abschätzen. Für diese Abschätzung existieren die sog. Big-O-Notation

(bzw. Ω - und Θ -Notation):

Big-O-Notation: Ein Funktion f (N ) heißt von der Ordnung O ( g ( N )) , wenn 2 Konstante c0 und n0

existieren, so dass f ( N ) ≤ c o ⋅ g ( N ) für alle N > n0 .

Die Big-O-Notation liefert eine Obergrenze für die Wachstumsrate von Funktionen: f ∈ O (g ) , wenn f

höchstens so schnell wie g wächst. Man sagt dann: die Laufzeit eines Algorithmus "T(N) ist O(N)"

oder "T(N) ist ein O(N)".

Big- Ω -Notation: Ein Funktion f (N ) heißt von der Ordnung Ω( g ( N )) , wenn 2 Konstante c0 und n0

existieren, so dass f ( N ) ≥ c o ⋅ g ( N ) für alle N > n0 .

Die Big- Ω -Notation liefert eine Untergrenze für die Wachstumsrate von Funktionen: f ∈ Ω(g ) ,

wenn f mindestens so schnell wie g wächst.

θ -Notation: Das Laufzeitverhalten eines Algorithmus ist θ (N ) , falls O( N ) = Ω( N ) . Über θ (N )

kann das Laufzeitverhalten exakt beschrieben werden.

19

Vgl. Aho, Hopcroft, Ullman: The Design and Analysis of Computer Algorithms, Addison-Wesley Publishing

Company

20 So ist es bspw. üblich, die Laufzeit eines Verfahrens zum Sortieren einer Folge von Schlüsseln durch die

Anzahl der dabei ausgeführten Vergleichsoperationen zwischen Schlüsseln und die Anzahl der ausgeführten

Bewegungen von den jeweiligen betroffenen Datensätzen zu messen.

21 die im Einheitskostenmaß oder im logarithmischen Kostenmaß gemessen wird

24

Algorithmen und Datenstrukturen

T (N ) 22 aus dem

Bereich der positiven reellen Zahlen: Ein Algorithmus hat die Komplexität O (g ) , wenn T ( N ) ∈ O ( g )

Damit lässt sich der Zeitbedarf eines Algorithmus darstellen als eine Zeitfunktion

gilt.

Meistens erfolgt die Abschätzung hinsichtlich der oberen Schranken (Worst Case):

Groß-O-Notation.

T (N )

c1 g (n)

f ∈ Θ(g )

c 2 g ( n)

n0

N

Abb. 1.2-71: Assymptotische Kostenmaße

Zeitbedarf eines Algorithmus: Ist N die Problemgröße, A ein Algorithmus, dann hat

ein Algorithmus die Komplexität O(g ) , wenn für den Zeitbedarf von A T A (n) ∈ O( g )

gilt. Wenn nicht explizit anders beschrieben, ist T A (n) maximale Laufzeit für die

gegebene Faustregel in der O-Notation

Rechenregeln zur O-Notation.

⎧O( f ), falls g ∈ O( f )

Addition: f + g ∈ O(max( f , g )) = ⎨

⎩O( g ), falls f ∈ O( g )

Die Additionsregel dient zur Bestimmung der Komplexität bei Hintereinanderausführung der Programme

Multiplikation: f ⋅ g ∈ O( f ⋅ g )

Die Multiplikationsregel dient zur Bestimmung der Komplexität von ineinandergeschachtelten Schleifen

Linearität: f (n) = a ⋅ g (n) + b ∧ Ω(1) ⇒ f ∈ O( g )

1.2.7 Komplexität

Für die algorithmische Lösung eines gegebenen Problems ist es unerläßlich, daß der

gefundene Algorithmus das Problem korrekt löst. Darüber hinaus ist es natürlich

wünschenswert, daß er dies mit möglichst geringem Aufwand tut. Die Theorie der

22

falls nicht explizit anders beschrieben, ist T (N ) die maximale Laufzeit für die gegebene Problemgröße

N

25

Algorithmen und Datenstrukturen

Komplexität von Algorithmen beschäftigt sich damit, gegebene Algorithmen

hinsichtlich ihres Aufwands abzuschätzen und – darüber hinaus – für gegebene

Problemklassen anzugeben, mit welchem Mindestaufwand Probleme dieser Klasse

gelöst werden können.

Meistens geht es bei der Ananlyse der Komplexität von Algorithmen (bzw.

Problemklassen) darum, als Maß für den Aufwand eine Funktion anzugeben, wobei

f ( Ν) = a bedeutet: „ Bei einem Problem der Größe N ist der Aufwand a“. Die

Problemgröße „N“ bezeichnet dabei in der Regel ein grobes Maß für den Umfang

einer Eingabe, z.B. die Anzahl der Elemente in der Eingabeliste oder die Größe eines

bestimmten Eingabewertes. Der Aufwand „a“ ist in der Regel ein grobes Maß für die

Rechenzeit. Die Rechenzeit wird häufig dadurch abgeschätzt, daß man zählt, wie

häufig eine bestimmte Operation ausgeführt wird, z.B. Speicherzugriffe,

Multiplikationen, Additionen, Vergleiche, etc.

Bsp.: Wie oft wird die Wertzuweisung „x = x + 1“ in folgenden Anweisungen

ausgeführt?

1. x = x + 1; ............

..1-mal

2. for (i=1; i <= n; i++) x = x + 1;..

..n-mal

3. for (i=1; i <= n; i++)

for (j = 1; j <= n; j++)

x = x + 1;................................... ......... n2-mal

Die Aufwandfunktion läßt sich in den wenigsten Fällen exakt bestimmen.

Vorherrschende Analysemethoden sind:

- Abschätzungen des Aufwands im schlechtesten Fall

- Abschätzungen des Aufwands im Mittel

Selbst hierfür lassen sich im Allg. keine exakten Angaben machen. Man beschränkt

sich dann auf „ungefähres Rechnen in Größenordnungen“.

Bsp.: Gegeben: n ≥ 0 a1 , a 2 , a3 ,..., a n ∈ Z

Gesucht: Der Index i der (ersten) größten Zahl unter den ai (i=1,...,n)

Lösung:

max = 1;

for (i=2;i<=n;i++)

if (amax < ai) max = i

Wie oft wird die Anweisung „max = i“ im Mittel ausgeführt (abhängig von n)?

Die gesuchte mittlere Anzahl sei Tn. Offenbar gilt: 1 ≤ Tn ≤ n . „max = i“ wird genau dann

ausgeführt, wenn ai das größte der Elemente a1 , a 2 , a3 ,..., ai ist.

Angenommen wird Gleichverteilung: Für jedes i = 1, ... , n hat jedes der Elemente a1 , a 2 , a3 ,..., a n die

gleiche Chance das größte zu sein, d.h.: Bei N Durchläufen wird N/n-mal die Anweisung „max = i“

ausgeführt.

Daraus folgt für N ⋅ Tn (Aufwendungen bei N Durchläufen vom „max = i“):

N ⋅ Tn = N +

N N

N

1 1

1

+ + ... + = N (1 + + + ... + )

2 3

n

2 3

n

Dies ist Hn, die n-te harmonische Zahl. Für Hn ist keine geschlossene Formel bekannt, jedoch eine

ungefähre Abschätzung: Tn = H n ≈ ln n + γ 23. Interessant ist nur, daß Tn logarithmisch von n

abhängt. Man schreibt Tn ist „von der Ordnung logn“, die multiplikative und additive Konstante sowie

die Basis des Logarithmus bleiben unspezifiziert.

23

Eulersche Konstante

γ = 0.57721566

26

Algorithmen und Datenstrukturen

Diese sog. (Landau'sche) Big-O-Notation läßt sich mathematisch exakt definieren:

f ( n)

f (n) = O( g (n)) :⇔ ∃c, n0 ∀n ≥ n0 : f (n) ≤ c ⋅ g (n) , d.h.

ist für genügend große n

g ( n)

durch eine Konstante c beschränkt. „f“ wächst nicht stärker als „g“.

Diese Begriffsbildung wendet man bei der Analyse von Algorithmen an, um

Aufwandsfunktionen

durch

Eingabe

einer

einfachen

Vergleichsfunktion

abzuschätzen, so daß f (n) = O( g (n)) gilt, also das Wachstum von f durch das von g

beschränkt ist.

Gebräuchliche Vergleichsfunktionen sind:

O-Notation

O(1)

Aufwand

Konstanter Aufwand

O(log n)

Logarithmischer Aufwand

O(n)

Linearer Aufwand

Problemklasse

Einige Suchverfahren für Tabellen

(„Hashing“)

Allgemeine Suchverfahren für Tabellen

(Binäre Suche)

Sequentielle Suche, Suche in Texten,

syntaktische Analyse in Programmen

„schlaues Sortieren“, z.B. Quicksort

O(n ⋅ log n)

O(n 2 )

Quadratischer Aufwand

Einige dynamische Optimierungsverfahren,

z.B. optimale Suchbäume); „dummes

Sortieren“, z.B. Bubble-Sort

Multiplikationen Matrix mal Vektor

Exponentieller Aufwand

Viele Optimierungsprobleme, automatisches

Beweisen (im Prädikatenkalkül 1. Stufe)

Alle Permutationen

O(n k ) für k ≥ 0

O(2 n )

O(n!)

Zur Veranschaulichung des Wachstums konnen die folgende Tabellen betrachtet

werden:

f(N)

ldN

N

N ⋅ ldN

N2

N3

2N

N=2

1

2

2

4

8

4

24=16

4

16

64

256

4096

65536

25=256

8

256

1808

65536

16777200

≈ 1077

210

10

1024

10240

1048576

≈ 109

≈ 10308

220

20

1048576

20971520

≈ 1012

≈ 1018

≈ 10315653

Unter der Annahme „1 Schritt dauert 1 μs = 10 −6 s folgt für

N=

N

N2

N3

2N

3N

N!

10

10 μs

100 μs

1 ms

1 ms

59 ms

3,62 s

20

20 μs

400 μs

8 ms

1s

58 min

771 Jahre

30

30 μs

900 μs

27 ms

18 min

6.5 Jahre

1016 Jahre

Abb. 1.2-2: Polynomial- und Exponentialzeit

27

40

40 μs

1.6 ms

64 ms

13 Tage

3855 Jahre

1032 Jahre

50

50 μs

2.5 ms

125 ms

36 Jahre

108 Jahre

1049 Jahre

60

60 μs

3.6 ms

216 ms

366 Jahre

1013 Jahre

1066 Jahre

Algorithmen und Datenstrukturen

1.2.7.1 Laufzeitberechnungen („Big-O“-)

N

Ein einfaches Beispiel: Gegeben ist die folgende Funktion zur Berechnung von

∑i

3

i =1

public static int sum(int n)

{

/* 1 */ int teilSumme;

/* 2 */ teilSumme = 0;

/* 3 */ for (int i = 1; i <= n; i++)

/* 4 */

teilSumme += i * i * i;

/* 5 */ returm teilSumme;

}

Analyse zur Effizienz:

Zeile 1 und Zeile 2 zählen je einmal.

Zeile 4 zählt viermal (2 Multiplikationen, Zuweisung und 1. Additition) und

wird N-mal ausgeführt. Das ergibt 4N.

Zeile 3 zeigt die Deklaration und Initialisierung von i (zählt zweimal), den

Test i <= N und das Inkrementieren i++ (zählt jeweils N-mal).

Insgesamt führt das zu 2N + 2. Ignoriert man Aufruf und

Rückkehranweisung der Funktion erhält man 6N + 4. Man sagt dazu: Die

Funktion besitzt ein Leistungsverhalten von O(N).

Einiges kann bei der Abschätzung offensichtlich beschleunigt werden. In Zeile 3 steht

bspw. eine O(1)-Anweisung. Es ist egal (für die Abschätzung der

Laufzeitberechnung), ob bei der Ausführung diese Anweisung 2fach oder 3fach

gezählt wird. Auch bzgl. der Schleife ist der Faktor 2 und die Addition von 2

unerheblich.

Das führt zu folgenden Regeln zur Abschätzung des Leistungsverhaltens nach der

„Big-O“-Notation:

1. Regel (für Schleifen): Die Laufzeit einer Schleife ist im wesentlichen bestimmt

durch die Anzahl der Anweisungen innerhalb des Schleifenkörpers multipliziert mit

der Anzahl der Iterationen.

2. Regel (für verschachtelte Schleifen): Die Laufzeit einer Anweisung innerhalb einer

Gruppe verschachtelter Schleifen ist bestimmt durch die Laufzeit der Anweisung

multipliziert mit dem Produkt aller Schleifengrößen.

Bsp.:

for (i=1; i <= n; i++)

for (j = 1; j <= n; j++)

k++;

ist einzuordnen unter O(N2).

3. Regel (aufeinanderfolgende Anweisungen): Der größte Wert zählt für das

Leistungsverhalten.

Bsp.:

for (int i=1; i <= n; i++)

a[i] = 0;

// O(N)

for (int i=1; i <= n; i++)

for (int j=1; j <= n; j++)

a[i] += i + j;

// O(N2)

Insgesamt ergibt sich das Leistungsverhalten O(N2).

4. Regel: Die Laufzeit einer „if“-Anweisung ist niemals größer als die Laufzeit des

Tests plus der größeren Laufzeit vom „ja“- bzw. „nein“-Zweig.

28

Algorithmen und Datenstrukturen

Rekursionen können häufig auf einfache Schleifen mit dem Leistungsverhalten O(N)

zurückgeführt werden, z.B.:

public static long fakultaet(int n)

{

if (n <= 1) return 1;

else return n * fakultaet(n-1);

Liegen in einer Funktion mehrere rekursive Aufrufe vor, dann ist die Umsetzung in

eine einfache Schleifenstruktur nicht so einfach.

Bsp.:

public static long fib(int n)

{

/* 1 */ if (n <= 1)

/* 2 */ return 1;

else

/* 3 */ returm fib(n-1) + fib(n-2);

}

Die Analyse ergibt unter der Annahme, daß T(N) die Laufzeit nach einem Aufruf von

fib(n) ist: Für N = 0, N = 1 ist T(0) = T(1) = 1 (irgendein konstanter Wert. In

Zeile 3 wird fib(N-1) aufgerufen, was eine Laufzeit von T(N-1) bewirkt.

Anschließend wird fib(N-2) aufgerufen, was eine Laufzeit von T(N-2) bewirkt.

Zusammengezählt ergibt das: T(N) = T(N-1) + T(N-2) + 2. Da fib(N) =

fib(N-1) + fib(N-2) ist, kann leicht gezeigt werden, daß T(N) >= fib(N) ist.

5

Man kann zeigen: fib( N ) < ( ) N . Das bedeutet: Die Laufzeit dieses Programms

3

wächst exponentiell (schlechter geht es nicht mehr).

Man kann häufig dasselbe Problem mit verschieden Algorithmen lösen. Das Ziel ist

natürlich, den für das Problem besten Algorithmus zu finden bzw. zu implementieren:

Bsp.: Das Maximum-Subarray-Problem

Gegeben ist eine Folge X von N ganzen Zahlen in einem Array. Gesucht ist die maximale Summe

aller zusammenhängenden Teilfolgen. Sie wird als maximale Teilsumme bezeichnet.

So ist für die Eingabefolge

X[0]

31

X[1]

-41

X[2]

59

X[3]

26

X[4]

-53

X[5]

58

X[6]

97

X[7]

-93

X[8]

-23

X[9]

84

die Summe der Teilfolgen X[2] + X[3] + X[4] + X[5] + X[6] mit dem Wert (59 + 26 – 53 + 58 + 97) = 187

die Lösung des Problems. Lösungen zu diesem Problem können auf verschiedene Weise erreicht

werden:

1. Lösung

public

{

/* 1

/* 2

/* 3

/*

/*

/*

/*

/*

4

5

6

7

8

/* 9

static int

maxSubsum1(int a[])

*/ int maxSumme = 0;

*/ for (int i = 0; i < a.length;i++)

*/ for (int j = i; j < a.length; j++)

{

*/

int summe = 0;

*/

for (int k = i; k <= j; k++)

*/

summe += a[k];

*/

if (summe > maxSumme)

*/

maxSumme = summe;

}

*/ return maxSumme;

29

Algorithmen und Datenstrukturen

}

N

Die Analyse des Leistungsverhaltens wird bestimmt durch

N

j

∑∑∑1 = O( N

3

) . Diese Summe

i =1 j =i k =i

berechnet, wieviele Male Zeile 6 ausgeführt wird.

2. Lösung

public static int maxSubsum2(int a[])

{

/* 1 */ int maxSumme = 0;

/* 2 */ for (int i = 0; i < a.length;i++)

{

/* 3 */ int summe = 0;

/* 4 */ for (int j = i; j < a.length; j++)

{

/* 5 */

summe += a[j];

/* 6 */

if (summe > maxSumme)

/* 7 */

maxSumme = summe;

}

}

/* 8 */ return maxSumme;

}

2

In dieser Lösung ist das Leistungsverhalten auf O(N ) reduziert.

3. Lösung

Diese Lösung folgt der „Divide-and-Conquer“-Strategie, die ein sehr allgemeines und mächtiges

Prinzip zur algorithmischen Lösung von Problemen darstellt. Das zugehörige Problemlösungsschema

kann allg. so formuliert werden:

1. Divide: Teile das Problem der Größe N in (wenigstens) 2 annähernd gleich große Teilprobleme,

wenn N > 1 ist, sonst löse das Problem der Größe 1 direkt.

2. Conquer: Löse die Teilprobleme auf dieselbe Art.

3. Merge: Füge die Teillösungen zur Gesamtlösung zusammen.

Abb.: Divide and Conquer-Verfahren zur Lösung eines Problems der Größe N

Bei der Anwendung dieses Algorithmus auf das vorliegende Problem bewirkt das Teilen der Folge in

Teilfolgen evtl. das Trennen der Teilfolge mit der größten Teilsumme, z.B.: Bei der Vorgabe

a[0]

4

a[1]

-3

a[2]

5

1. Häfte

a[3]

-2

a[4]

-1

a[5]

2

a[6]

6

2. Hälfte

a[7]

-2

ist die größte Teilsumme in der ersten Teilhälfte 6 (a[0] + a[1] + a[2]), die größte Teilsumme in der

zweiten Teilhälfte ist 8 (a[5] + a[6]). Die maximale Summe in der 1. Hälfte, die das letzte Element in

der 1. Hälfte mit einschließt (a[0] + a[1] + a[2] + a[3]) ist 4. Die maximale Summe in der 2. Hälfte, die

das erste Element in der 2. Hälfte einschließt ist 7. Die maximale Summe, die beide Hälften

überspannt ist 4 + 7 = 11. Der Algorithmus muß demnach Teilsummenbildungen über die jeweilige

Teilhälften berücksichtigen.

private static int maxSubsum(int

{