7.5 Erwartungswert, Varianz

Werbung

7.5

Erwartungswert, Varianz

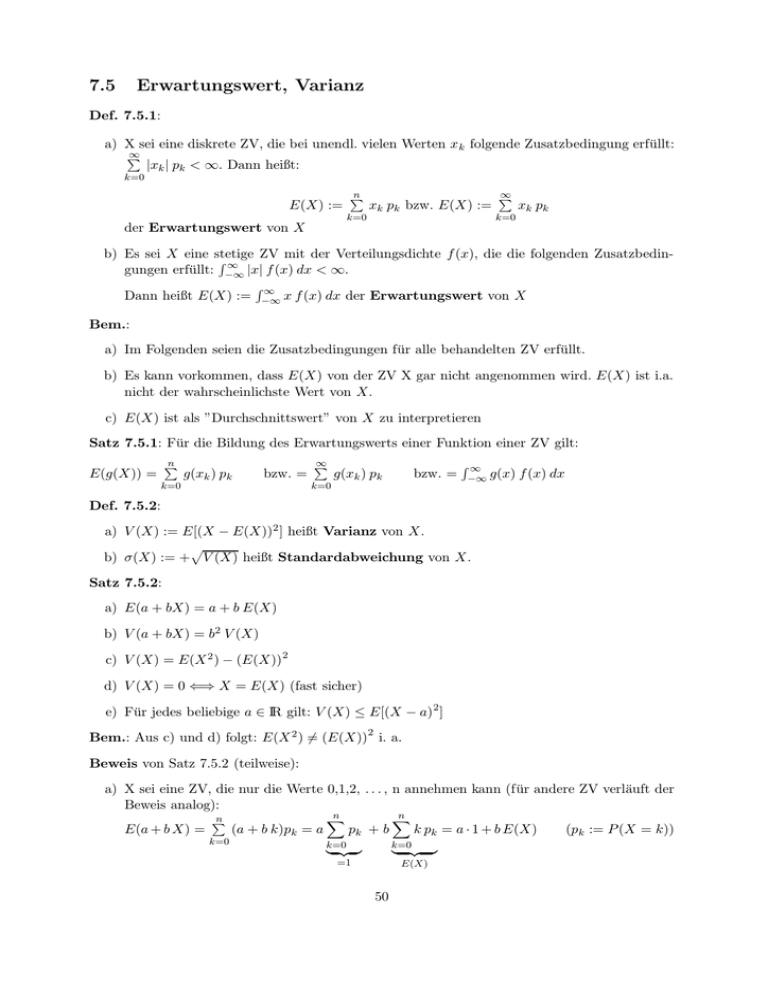

Def. 7.5.1:

a) X sei eine diskrete ZV, die bei unendl. vielen Werten x k folgende Zusatzbedingung erfüllt:

∞

P

k=0

|xk | pk < ∞. Dann heißt:

E(X) :=

n

P

xk pk bzw. E(X) :=

k=0

der Erwartungswert von X

∞

P

xk pk

k=0

b) Es sei X eine stetige

ZV mit der Verteilungsdichte f (x), die die folgenden ZusatzbedinR∞

gungen erfüllt: −∞ |x| f (x) dx < ∞.

Dann heißt E(X) :=

Bem.:

R∞

−∞ x

f (x) dx der Erwartungswert von X

a) Im Folgenden seien die Zusatzbedingungen für alle behandelten ZV erfüllt.

b) Es kann vorkommen, dass E(X) von der ZV X gar nicht angenommen wird. E(X) ist i.a.

nicht der wahrscheinlichste Wert von X.

c) E(X) ist als ”Durchschnittswert” von X zu interpretieren

Satz 7.5.1: Für die Bildung des Erwartungswerts einer Funktion einer ZV gilt:

E(g(X)) =

n

P

g(xk ) pk

bzw. =

k=0

Def. 7.5.2:

∞

P

g(xk ) pk

bzw. =

k=0

R∞

−∞ g(x)

f (x) dx

a) V (X) := E[(X − E(X))2 ] heißt Varianz von X.

p

b) σ(X) := + V (X) heißt Standardabweichung von X.

Satz 7.5.2:

a) E(a + bX) = a + b E(X)

b) V (a + bX) = b2 V (X)

c) V (X) = E(X 2 ) − (E(X)) 2

d) V (X) = 0 ⇐⇒ X = E(X) (fast sicher)

e) Für jedes beliebige a ∈ IR gilt: V (X) ≤ E[(X − a) 2 ]

Bem.: Aus c) und d) folgt: E(X 2 ) 6= (E(X)) 2 i. a.

Beweis von Satz 7.5.2 (teilweise):

a) X sei eine ZV, die nur die Werte 0,1,2, . . . , n annehmen kann (für andere ZV verläuft der

Beweis analog):

E(a + b X) =

n

P

k=0

(a + b k)pk = a

n

X

pk + b

n

X

k pk = a · 1 + b E(X)

k=0

k=0

| {z }

| {z }

=1

E(X)

50

(pk := P (X = k))

a)

b) V (a + b X) = E[(a + b X − E(a + b X)) 2 ] = E[(a + b X − a − b E(X)) 2 ]

a)

= E[b2 (X − E(X))2 ] = b2 E[(X − E(X)) 2 ] = b2 V (X)

c) V (X) := E[(X − E(X)) 2 ] = E[X 2 − 2X · E(X) + (E(X)) 2 ]

a)

= E(X 2 ) − 2 E(X) E(X) + (E(X)) 2 = E(X 2 ) − (E(X)) 2

h

i

h

e) E (X − a)2 = E (X − E(X) + E(X) − a)2

h

i

= E (X − E(X)) 2 − 2(X − E(X)) (E(X) − a) + (E(X) − a)2

a)

= V (X) − 2(E(X) − a) E(X − E(X)) + (E(X) − a)2 ≥ V (X)

|

7.6

7.6.1

{z

=0

}

|

{z

≥0

i

}

Spezielle Verteilungen

Binomialverteilung

Def. 7.6.1: Ein Zufallsexperiment habe nur zwei mögliche Ergebnisse, die wir mit ”Erfolg” oder

”Fehlschlag” bezeichnen.

Die Wahrsch. für einen Erfolg sei p und für einen Fehlschlag sei q = 1 − p. Wird dieses Zufallsexperiment unter den gleichen Bedingungen n-mal wiederholt, so nennt man das ganze BernoulliExperiment.

Satz 7.6.1: X sei die ZV, die die Anzahl von Erfolg bei einem Bernoulli-Experiment beschreibt.

Dann besitzt X eine Binomialverteilung mit den Parametern p und n, d.h.

(7.6.1)

P (X = k) =

n k n−k

k p q

(k = 0, 1, . . .)

(⇒ P (X = k) = 0 für k ≥ n + 1)

Satz 7.6.2: Für eine binomialverteilte ZV X mit den Parametern n und p gilt:

a) E(X) = n · p

b) V (X) = n · p · q

(⇒ σ(X) =

√

n · p · q)

Anwendungsbeispiel: Lieferung von N Stück, M davon defekt (N, M keine ZV), n Ziehungen

eines Stücks mit Zurücklegen.

Bernoulli-Experiment: Jede Ziehung ist ein Zufallsexperiment mit der Wahrscheinlichkeit p =

M/N für einen ”Erfolg”(= Ziehung eines defekten Stückes) und q := 1−p für einen ”Fehlschlag”

(= Ziehung eines nicht defekten Stückes). Durch ”m. Z.” werden nach jeder Ziehung die alten

Bedingungen wiederhergestellt. Die ZV ”Anzahl der Ziehungen von defekten Stücken” ist also

binomialverteilt mit p = M/N und n = Anzahl der Ziehungen insgesamt.

7.6.2

Poisson-Verteilung

Def. 7.6.2: Eine diskrete ZV X heißt Poisson-verteilt mit dem Parameter λ > 0, wenn gilt:

k

P (X = k) = e−λ λk! ,

k = 0, 1, 2, . . .

Satz 7.6.3: Für eine Poisson-verteilte ZV mit dem Parameter λ gilt:

a) E(X) = λ

b) V (X) = λ

(⇒ σ(X) =

√

λ)

51

Satz 7.6.4: Es sei X eine binomialverteilte ZV mit den Parametern p, n. Dann gilt:

k

P (X = k) ≈ e−λ λk!

λ = np

Dabei sollten folgende Bedingungen erfüllt sein: n ≥ 50 und λ = n p ≤ 5

Bem.: Bei der Binomialverteilung sollte der Versuchsausgang mit “ Erfolg” bezeichnet werden,

der die deutlich kleinere Wahrscheinlichkeit hat, insbesondere dann, wenn die Poisson–Näherung

angewendet werden soll. Sind die Wahrscheinlichkeiten für beide Versuchsausgänge nahe bei 1/2,

können die Bezeichnungen “Erfolg” oder “Fehlschlag” beliebig vergeben werden.

7.6.3

Normalverteilung oder Gauß-Verteilung

Def. 7.6.3:

a) Eine ZV heißt normalverteilt mit dem Mittelwert µ und der Varianz σ 2 (Abk. N (µ, σ)verteilt), wenn sie folgende Verteilungsdichte besitzt (exp x := e x ):

f (x) :=

√1

2 πσ

2

exp (− 12 ( x−µ

σ ) ),

b) Eine ZV X mit der Verteilungsdichte ϕ(x) :=

standard-normalverteilt oder N (0, 1)-verteilt.

Φ(x) :=

Rx

−∞ ϕ(u)

√1

2π

x ∈ IR

exp (− 12 x2 ) bezeichnet man als

du ist die zugehörige Verteilungsfunktion.

Bem.: Φ(x) ist eine höhere transzendente Fkt.. Daher sind Tabellen nötig.

Skizzen:

6

1

6

1

Φ(x)

ϕ(x)

-

Vert.dichte zur N(1.5,2)-Vert.:

x

1

- x

Vert.dichte zur N(3,0.5)-Vert.:

61

1

6

f(x)

f(x)

- x

1.5

Satz 7.6.5: Für eine N (µ, σ) - verteilte ZV X gilt:

a) E(X) = µ

b) V (X) = σ 2

(⇒ σ(X) = σ)

52

3

- x

Satz 7.6.6:

a) Für jede N (0, 1) - vert. ZV Z gilt: (−Z) ist auch N (0, 1) - vert.

b) Φ(−x) = 1 − Φ(x) (Anwendung: Berechnung von Φ(x) für x < 0)

c) Für eine N (µ, σ) - vert. ZV X gilt (F (x): Verteilungsfkt, f (x): Vert.dichte):

i)

X−µ

σ

ist

x−µ

1

σ ϕ( σ )

a−µ

P (a ≤ X ≤ b) = Φ( b−µ

σ ) − Φ( σ )

P (X < a) = P (X ≤ a) = Φ( a−µ

σ ),

ii) F (x) =

iii)

iv)

N (0, 1) - verteilt

Φ( x−µ

σ ),

f (x) =

P (X > a) = P (X ≥ a) = 1 − Φ( a−µ

σ )

v) P (|X − µ| ≤ t · σ) = Φ(t) − Φ(−t) = 2 Φ(t) − 1

insbesondere = 0.683 für t = 1,

(t ≥ 0)

= 0.995 für t = 2,

= 0.997 für t = 3

Beweis: Es wird ohne Beweis verwendet, dass mit X auch die ZV α X + β,

normalverteilt ist.

a) P (−Z ≤ x) = P (Z ≥ −x) =

R∞

−x ϕ(u)du

u = −z

=

−

R −∞

x

P (Z ≤ x)

ϕ(−z)

= ϕ(z)(geradeF kt.)

a)

c)

dz =

| {z }

b) Φ(−x) = P (Z ≤ −x) = P (−Z ≥ x) = P (Z ≥ x) = 1 − P (Z < x)

1 − Φ(x)

Satz 7.5.2 a) b) 1

=

σ (E(X) − µ) = 0 (nach Satz 7.6.5)

X−µ Satz 6.5.2 a) b) 1

V( σ )

=

V (X) = 1 (nach Satz 7.6.5)

σ2

Damit ist aufgrund der o. g. allgemeinen Eigenschaft X−µ

σ

α 6= 0, β ∈ IR,

Z stet.ZV

=

Rx

−∞ ϕ(z)d z

=

1 − P (Z ≤ x) =

i) E( X−µ

σ )

ii) F (x) = P (X ≤ x) = P (

X −µ

σ }

| {z

≤

x−µ

σ )

N (0, 1)-vert.

= Φ( x−µ

σ )

N (0,1)−vert. nach i)

x−µ

1

f (x) = F 0 (x) = σ1 Φ0 ( x−µ

σ ) = σ ϕ( σ )

iii) P (a ≤ X ≤ b)

X stet.ZV

=

ii)

ii)

ii)

a−µ

P (a < X ≤ b) = F (b) − F (a) = Φ( b−µ

σ ) − Φ( σ )

iv) P (X ≤ a) = F (a) = Φ( a−µ

σ ),

a−µ

1 − Φ( σ )

P (X ≥ a) = 1 − P (X < a)

iii)

X stet. ZV

=

1 − P (X ≤ a) =

b)

v) P (|X − µ| ≤ t σ) = P (µ − t σ ≤ X ≤ µ + t σ) = Φ(t) − Φ(−t) = 2 · Φ(t) − 1

Bem.:

a) Es gilt auch allgemein: E(X) = µ ∧ V (X) = σ 2

X−µ

=⇒ E( X−µ

V ( X−µ

ist eine standardisierte ZV

σ ) = 0,

σ ) = 1;

σ

b) Die Aussage in Satz 7.6.6 c) v) gilt für allgemeine ZV höchstens näherungsweise. Eine

exakte, aber z. T. wesentlich schlechtere Abschätzung liefert Satz 6.9.1

53

Satz 7.6.7: X sei eine binomialvert. ZV mit den Parametern p und n. Dann gilt für

0 ≤ k1 ≤ k2 ≤ n:

P (k1 ≤ X ≤ k2 ) ≈ Φ( k√2n−np qp ) − Φ( k√1n−np qp )

(7.6.2)

(vgl. Satz 7.10.1) oder mit höherer Genauigkeit, wenn k1 und k2 ganze Zahlen sind:

(7.6.3)

p

k1 −0.5−n

p

√

√

P (k1 ≤ X ≤ k2 ) ≈ Φ( k2 +0.5−n

n p q ) − Φ(

npq )

Dabei sollten folgende Bedingungen erfüllt sein:

n ≥ 50 ∧ n p ≥ 5 ∧ n q ≥ 5.

Bem.:

a) Unter den Voraussetzungen von Satz 7.6.7 sind auch die folgenden Wahrscheinlichkeiten

mit Hilfe von (7.6.2) oder (7.6.3) zu bestimmen:

P (X ≥ k0 ) = P (k0 ≤ X ≤ n),

P (X ≤ k0 ) = P (0 ≤ X ≤ k0 )

(k0 = 0, 1, 2 . . . , n)

b) Wird der Bereich der Argumentwerte von Φ in einer Tabelle wie etwa der ausgegebenen

überschritten, so kann man z.B. folgende Eigenschaften benutzen:

Für x ≥ 3.90 gilt 0 < 1 − Φ(x) < 0.5 · 10−4 und damit Φ(x) = 1.0000 auf 4 Stellen nach

dem Dezimalpunkt genau,

für x ≤ −3.90 gilt 0 < Φ(x) < 0.5 · 10−4 und damit Φ(x) = 0.0000 auf 4 Stellen nach dem

Dezimalpunkt genau.

7.6.4

Hypergeometrische Verteilung

Ausgangsproblem: Lieferung von N Stück, M davon defekt (N, M keine ZV); zufällige Auswahl

einer Stichprobe von n Stücken und deren Untersuchung (o. Z. o. B. d. A.); Wahrscheinlichkeit,

das m Stücke in der Stichprobe defekt sind, =?.

Bem.: Dieses Verfahren ist günstiger als das Verfahren in 7.6.1.

Für die ZV ”X := Anzahl der defekten Stücke in der Stichprobe” gilt:

(7.6.4)

P (X = m) =

N −M

( n )( N −n )

(M

m )( n−m )

= m NM −m

N

(n)

(M )

Def. 7.6.4: Die in (7.6.4) beschriebene Verteilung heißt hypergeometrische Verteilung mit

den Parametern N, M, n.

Bedingungen: N, M, n, m ∈ Z, 0 ≤ n ≤ N, 0 ≤ m ≤ M ≤ N, 0 ≤ n−m ≤ N −M

(⇒ m ≤ n)

Herleitung von Formel (7.6.4): Nach Satz 7.2.3 a)

haben alle Kombinationen o. Z. o. B. d.

N

A. von n aus N Stücken die Wahrscheinlichkeit 1/ n . Das Ereignis ”X = m” erfasst dann alle

Kombinationen, bei denen genau m defekte und damit (n − m) nicht defekte Stücke ausgewählt

werden. Die Anzahl der Möglichkeiten, m defekte

Stücke für die Stichprobe aus M defekten

,

da

dabei wie oben nach der Vorschrift ”o. Z.

Stücken der Lieferungen auszuwählen, beträgt M

m

o. B. d. A.” vorgegangen wird. Bei jeder solchen Auswahl muss dann die Stichprobe mit (n − m)

−M

aus den (N − M ) nicht defekten Stücken der Lieferung aufgefüllt werden. Dafür gibt es Nn−m

54

Möglichkeiten,

und zwar bei jeder Auswahl vom m defekten Stücken. Damit gibt es insgesamt

M N −M Möglichkeiten

für die Auswahl (o. Z. o. B. d. A.) von m defekten und (n − m) nicht

m n−m

defekten Stücken. Dies ist also die Anzahl der Kombinationen o. Z. o. B. d. A.,

die von dem

für

jede dieser

Ergebnis ”X = m” erfasst werden, die dann nur mit der Wahrscheinlichkeit 1/ N

n

Kombinationen multipliziert zu werden braucht.

Bem.: Eine ähnlich Herleitung für der Bin.-Vert. ist nicht möglich (vgl. Satz 7.2.3 b))

Satz 7.6.8: Es sei X eine hypergeometrisch vert. ZV mit den Parametern N, M, n und Y eine

binomialverteilte ZV mit den Parametern p = M

N und n. Dann gilt:

P (X = m) ≈ P (Y = m) =

n m

m p (1

− p)n−m

n

Dabei sollten folgende Bedingungen erfüllt sein: N ≥ 1000 ∧ N

≤ 0.1.

Zur Näherung der Binominalverteilung vgl. die Sätze 7.6.4/7

Satz 7.6.9 Für die ZV X aus Satz 7.6.8 gilt:

E(X) = n M

N,

7.7

N −M N −n

V (X) = n M

N N N −1

Gemeinsame Verteilung mehrerer Zufallvariabler

Def. 7.7.1: Es seien X1 , X2 , . . . , Xn beliebige ZV. Dann heißt:

F (x1 , x2 , . . . , xn ) := P (X1 ≤ x1 ∧ X2 ≤ x2 ∧ . . . ∧ Xn ≤ xn )

die gemeinsame Verteilungsfunktion der ZV X 1 , X2 , . . . , Xn .

Sie ist eine mögliche Beschreibung der gemeinsamen Verteilung der ZV.

Def. 7.7.2: X sei eine diskrete ZV, die die Werte x 0 < x1 < . . . , < xn annehmen kann und

Y eine diskrete ZV, die die Werte y0 < y1 < . . . < ym annehmen kann. Dann beschreiben die

Wahrscheinlichkeiten pi,j := P (X = xi ∧ Y = yi ) ebenfalls die gemeinsame Verteilung von X

und Y .

Satz 7.7.1: Für die Werte pi,j aus Def. 7.7.2 gilt:

a) 0 ≤ pi,j ≤ 1 für i = 0, 1, . . . , n; j = 0, 1, . . . , m

b) P (X = xi ) =

m

P

pi,j =: pi,∗ , P (y = yj ) =

n

P

i=0

j=0

pi,j =: p∗,j

Diese Größen beschreiben die Randverteilungen. Für diese Randverteilungen gilt:

n

P

pi,∗ = 1

i=0

∧

Schema:

n

P

j=0

p∗,j = 1

↓ X| Y →

x0

x1

..

.

y0

p0,0

p1,0

..

.

y1

p0,1

p1,1

..

.

y2

p0,2

p1,2

..

.

...

...

...

ym

p0,m

p1,m

..

.

xn

pn,0

p∗,0

pn,1

p∗,1

pn,2

p∗,2

...

...

pn,m

p∗,m

p0,∗

p1,∗

..

.

pn,∗

1

Def. 7.7.3: F (x1 , x2 , . . . , xn ) sei die gemeinsame Verteilungsfunktion der ZV X 1 , X2 , . . . , Xn

und Fi (xi ) seien die Verteilungsfunktionen der einzelnen ZV X i . Dann heißen X1 , X2 , . . . , Xn

55

(stochastisch) unabhängig, wenn für alle x1 , x2 , . . . , xn ∈ IR gilt:

(7.7.1)

F (x1 , x2 , . . . , xn ) = F (x1 ) · F (x2 ) · · · F (xn )

Bem.: Diese Def. ist konsistent mit der Def. 7.3.4 b) (Unabhängigkeit von n Ereignissen)

Satz 7.7.2: Zwei diskrete ZV X, Y (aus Def. 7.7.2) sind genau dann unabhängig, wenn für alle

i = 0, 1, . . . , n und j = 0, 1, . . . , m gilt:

P (X = xi ∧ Y = yj ) = P (X = xi ) · P (Y = yj )

d.h.

pi,j = pi,∗ · p∗,j

7.8

Kovarianz und Korrelation

(7.8.1)

(Def. vgl. Satz 7.7.1)

E(X + Y ) = E(X) + E(Y )

Satz 7.8.1: V (X + Y ) = V (X) + V (Y ) + 2 Cov(X, Y )

Cov(X, Y ) := E(X · Y ) − E(X) · E(Y ) heißt die Kovarianz von X und Y .

Satz 7.8.2: Für X, Y aus Def. 7.7.2 gilt:

E(X · Y ) =

Satz 7.8.3: X, Y unabhängig

⇒

6

⇐

n P

m

P

(

xi yi pi,j )

i=0 j=0

Cov(X, Y ) = 0

ZV X, Y mit Cov(X, Y )=0 heißen unkorreliert

Satz 7.8.4: Die ZV X1 , X2 , . . . , Xn sollen alle den gleichen Erwartungswert µ und die gleiche

Varianz σ 2 besitzen. Dann gilt:

a) E(X1 + X2 + . . . + Xn ) = n · µ

b) Im Fall der Unabhängigkeit der ZV: V (X1 + X2 + . . . + Xn ) = n · σ 2

Def. 7.8.1: Es seien X und Y zwei beliebige ZV mit V (X), V (Y ) > 0. Dann heißt

√ )

%(X, Y ) := √ Cov(X,Y

V (X)

V (Y )

der Korrelationskoeffizient von X und Y .

Satz 7.8.5: X, Y seien ZV aus Def. 7.8.1. Dann gilt:

a) |%(X, Y )| ≤ 1, dabei nennt man X und Y

unkorreliert,

positiv korreliert,

negativ korreliert,

falls %(X, Y ) = 0 ist, (vgl. o.)

falls %(X, Y ) > 0 ist,

falls %(X, Y ) < 0 ist

b) %(X, Y ) = +1 (bzw. -1) ⇐⇒ Y = a + bX (fast sicher) für geeignete Konstante a ∈ IR und

b > 0 (bzw. b < 0)

Fasst man die Messwertpaare (x1 , y1 ), (x2 , y2 ), . . . , (xn , yn ) als Realisation von einem Paar (X, Y )

von ZV auf, so ist (vergl. (6.1.6))

b1 · b 2 =

(xy − x · y)2

,

(x2 − x2 )(y 2 − y 2 )

56

wobei b1 (b2 ) die Steigung der ersten (zweiten) Regressionsgerade ist, ein Schätzwert für (%(X, Y ))2 .

Damit wäre folgender Ausdruck ein Schätzwert für %(X, Y ):

%̂ = √

(7.8.2)

xy−x·y

√

x2 −x2

y 2 −y 2

Es gilt also: Beide Regressionsgeraden sind gleich ⇔ b 2 = 1/b1 ⇔ |%̂| = 1.

Außerdem gilt analog zu Satz 7.8.5b) nach (6.1.6):

(7.8.3) |%̂| = 1 ⇔ b1 · b2 = 1 ⇔ Alle Punkte (xi , yi ) liegen (exakt) auf einer Geraden.

Allgemein gilt:

(7.8.4)

|%̂| ≤ 1.

Zur Bedeutung von %:

q

x2 − x2

xy − x · y

q

=

%̂ = q

·

= b1 ·

q

x2 − x 2

y2 − y2

x2 − x 2 y 2 − y 2

xy − x · y

Ist also

s

V ar(xi )

V ar(yi )

Cov(X, Y )

%(X, Y ) :=

> 0 (< 0),

σ(X) · σ(Y )

so sind bei größeren Meßergebnissen xi bei der Meßgröße X entsprechend größere (kleinere)

Meßergebnisse yi bei der Meßgröße Y zu erwarten, und zwar umso stärker, je größer |%| ist.

7.9

Gesetz der großen Zahl

Def. 7.9.1: Eine unendliche Folge von ZV X 1 , X2 , . . . , heißen eine Folge unabhängiger ZV,

wenn je endlich viele der ZV unabhängig sind.

Satz 7.9.1 (Tschebyscheff-Ungleichung):

P (|X − E(X)| ≥ t σ(X)) ≤

1

t2

Satz 7.9.2 (Folgerung): Unter den Voraussetzungen von Satz 7.8.4 b) gilt:

P (| X1 +X2n+...+Xn − µ| ≥ α) ≤

σ2

α2 n

(n ∈ IN,

α > 0)

Satz 7.9.3 (Starkes Gesetz der großen Zahl):

a) Es sei X1 , X2 , . . . eine Folge unabhängiger ZV, die alle die gleiche Verteilung, den gleichen

Erwartungswert µ und die gleiche Varianz σ 2 besitzen. Dann gilt:

X1 +X2 +...+Xn

n

→ µ für n → ∞ (fast sicher)

b) A ⊂ Ω sei ein Ereignis bei einem Zufallsexperiment, das beliebig oft wiederholt wird, und

P (A) sei eine Wahrscheinlichkeit. Dann gilt für die rel. Häufigkeiten (vgl. Def. 7.2.6)

hn (A) → P (A) für n → ∞ (fast sicher)

7.10

Zentraler Grenzwertsatz

Satz 7.10.1: Unter den Voraussetzungen von Satz 7.9.3 a) gilt:

P (a ≤

X1 + X 2 + . . . + X n − n · µ

√

≤ b) → Φ(b) − Φ(a) für n → ∞, d.h.

nσ

57

≈

Φ(b) − Φ(a) für ”große” n

Bem. : Häufige Anwendung von Satz 7.10.1: Annahme, dass eine unbekannte Verteilung durch

eine Normalverteilung angenähert werden kann. Diese Anmahme ist nicht immer gerechtfertigt.

58