Künstliche Neuronale Netze

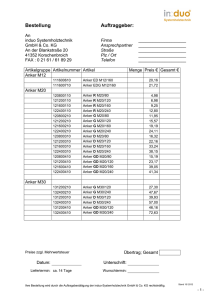

Werbung

Künstliche Neuronale Netze als Möglichkeit, einer Maschine das Lesen beizubringen Anja Bachmann 18.12.2008 Gliederung 1. Motivation 2. Grundlagen 2.1 Biologischer Hintergrund 2.2 Künstliche neuronale Netze 3. Anwendung 3.1 Schrifterkennung 4. Wie eine Maschine das Lesen lernt 4.1 netTrainer 4.2 wxOCR 5. Fazit 6. Quellen Vortrag KNN | 18.12.2008 | Anja Bachmann 1 1. Motivation • Probleme, menschliche Prozesse maschinell umzusetzen • Frage, ob Maschinen denken können wie Menschen • Rechner können schon viel, aber nicht ohne Weiteres komplexe Lernprozesse (u. a. Lesen) → hier setzen künstliche neuronale Netze (KNN) an • Einsatzgebiet von KNN ist u.a. die Schrifterkennung • Studentenprogramme, die mittels KNN Texte verarbeiten Vortrag KNN | 18.12.2008 | Anja Bachmann 2 2. Grundlagen • bisher Einscannen, um Bilder auf PC zu transferieren oder Abtippen • KNN als Möglichkeit, sie einlesen zu lassen Vortrag KNN | 18.12.2008 | Anja Bachmann 3 2.1 Biologischer Hintergrund 1/2 • Grundlage der KNN sind die neuronalen Netze • menschliches Gehirn ist solch ein Netz aus Millionen kleiner Nervenzellen (Neuronen) Æ winzige Berechnungseinheiten oder elementare MiniProzessoren Vortrag KNN | 18.12.2008 | Anja Bachmann 4 2.1 Biologischer Hintergrund 1/2 • Biologischer Aufbau: Neuron besteht aus Zelle, Dendriten, Axonen und Synapsen • Festgelegte Fließrichtung des Signals Vortrag KNN | 18.12.2008 | Anja Bachmann 5 2.2 Künstliche neuronale Netze 1/3 • KNN = i.A. ein massiv paralleler Verbund von Neuronen zu Netzwerken • KNN = mögliches System, an Probleme heranzugehen, welche zu ihrer Lösung eine Anpassung bestimmter Faktoren benötigen • drei Phasen: Aufbauphase (Topologie), der Trainingsphase (das Lernen) und der Arbeitsphase (Propagation) • KNN = ein Graph mit Knoten und (gewichteten) Kanten Vortrag KNN | 18.12.2008 | Anja Bachmann 6 2.2 Künstliche neuronale Netze 2/3 • Parallelen zum biologischen Neuron → Topologie eines KNN • Dendriten = Eingabe, Zelle = Verarbeitung, Axon = Ausgang • Informationsverar beitung in einem KNN verläuft mathematisch Vortrag KNN | 18.12.2008 | Anja Bachmann 7 2.2 Künstliche neuronale Netze 3/3 • Knoten x1 bis xn senden Signal zum Knoten xj • Übergangungsfunktion Σ summiert die Eingangswerte w1j bis wnj auf. • Aktivierungsfunktion φ (z.B. stückweise linear, sigmoid) ermittelt Aktivierungswert • Schwellwert θj → wenn überschritten, dann sendet Neuron Signale, sonst nicht • Signale auf Richtigkeit prüfen Vortrag KNN | 18.12.2008 | Anja Bachmann 8 3. Anwendung von KNN • Anwendung in: – Medizin (Modellierung und Simulation biologischer neuronaler Netze) – Informatik und Maschinenbau (Prozesssteuerung, Robotersteuerung, Sprach- oder Schrifterkennung) – Wirtschaft (Risikomanagement) – Mathematik (Funktionsapproximation) • früher eher Forschung, heutzutage auch privat (auf Desktoprechnern bzw. KNN-Software) Vortrag KNN | 18.12.2008 | Anja Bachmann 9 3.1 Texterkennung • OCR (optical character recognition) Æ Zeichenerkennung • ICR (intelligent character recognition) Æ Kontext noch mit betrachtet • IWR (intelligent word recognition) Æ Weiterentwicklung von OCR/ICR Æ teilweise Fließhandschrift • Anwendung in der Wirtschaft: Absender anhand des Firmenlogos erkennen, Formalitätsgrad bestimmten • privat: Texte vom Computer einlesen lassen, Captchas entschlüsseln Vortrag KNN | 18.12.2008 | Anja Bachmann 10 4. Wie eine Maschine das Lesen lernt • nicht gänzlich ohne menschliche Hilfe möglich → Eingabe- und dazugehörige Ausgabemuster erzeugen • Training durch: – – – – – Entwicklung neuer Verbindungen Löschen bestehender Verbindungen Anpassen der Schwellwerte der Neuronen Hinzufügen oder Löschen von Neuronen Veränderung der Aktivierungsfunktion der Neuronen oder der Lernrate des Netzes – Modifikation der Gewichte der Neuronen • Anwendung in vielen Programmen Vortrag KNN | 18.12.2008 | Anja Bachmann 11 4.1 netTrainer • Qualität des Trainings entscheidend für die korrekte Arbeitsweise eines Netzes • je öfter das Netz mit einem Symbol konfrontiert wird, desto besser erkennt es dieses auch → „überwachtes Lernen“ → Vergleich von Istund Sollwerten • gut trainiertes KNN soll auch für ähnliche, verzerrte, verrauschte oder unvollständige Inputs den richtigen Soll-Output liefern Vortrag KNN | 18.12.2008 | Anja Bachmann 12 4.2 wxOCR 1/2 • Urbild in das Programm einlesen • Symbols von verschiedenen Punkten aus analysieren • Netz vergleicht diese Ergebnisse dann mit seinen eigenen Erfahrungen Vortrag KNN | 18.12.2008 | Anja Bachmann 13 4.2 wxOCR 2/2 • das Programm wxOCR beim korrekten und fehlerhaften Einlesen • wenn fehlerhaft, dann erneutes Training Vortrag KNN | 18.12.2008 | Anja Bachmann 14 5. Fazit 1/2 • großes Einsatzgebiet • Texterkennung → Alltag erleichtern, Einsparungen in Firmen, Gehirnprozesse simulieren • Nachteile: Wissenserwerb nur durch Lernen möglich (langsam, abhängig von Trainingsdaten und Netz- und Lernparametern) • viele ungeklärte Rätsel und alltägliche Probleme → Hilfe durch Einsatz von KNN • z.B. Verbesserung von Sicherheitsmaßnahmen vor allem in der Banken-Branche Vortrag KNN | 18.12.2008 | Anja Bachmann 15 5. Fazit 2/2 Durch KNN [...] „erhalten wir das Tor zu bisher ungeahnter Rechnerleistung [...]. In Zukunft wird die Datenverarbeitung auf anderem Niveau stattfinden.“ (User Jokin in einem Forum) • KNN werden uns noch oft begegnen und neue Anwendungsmöglichkeiten (von Maschinen) schaffen Vortrag KNN | 18.12.2008 | Anja Bachmann 16 6. Quellen • Links: [1] http://www.linux-related.de/index.html?/knn_ki/knn_einf.htm [2] http://www.linux-related.de/index.html?/src/wxgraphics_main.htm [3] www.dkfz-heidelberg.de/tbi/people/koenig/teaching/Lifescience/14_10_02 /Neur_Netze_Kai_141002.ppt [4] http://www.sandro.de/downloads/seminararbeit_ki.pdf [5] http://de.wikipedia.org/wiki/Texterkennung [6] http://de.wikipedia.org/wiki/Künstliches_neuronales_Netz [7] http://www-home.fh-konstanz.de/~bittel/nnfl/NeuroNetze_1.pdf [8] http://www.lpgforum.de/stammtisch/3486-die-zukunft-des-auto.html • Bücher: [9] „Künstliche neuronale Netze – Grundprinzipien, Hintergründe, Anwendungen“, Patrick Hamilton. VDE-Verlag GmbH Berlin und Offenbach, Berlin, 1993. Vortrag KNN | 18.12.2008 | Anja Bachmann 17 Vielen Dank für eure Aufmerksamkeit! Fragen?