Material zur Vorlesung “Funktionale Programmierung”

Werbung

Material zur Vorlesung “Funktionale

Programmierung”

Priv.-Doz. Dr. Frank Huch

Dr. Sebastian Fischer

Björn Peemöller

Wintersemester 2011/2012

Inhaltsverzeichnis

1 Input / Output

1.1 do-Notation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.2 Lazy IO . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.3 Programmieren mit IO . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2

3

5

6

2 Typkonstruktor-Klassen

8

3 Abschließende Bemerkungen zur MonadPlus Typklasse

11

3.1 Ein Kommentar zu den MonadPlus-Gesetzen . . . . . . . . . . . . . . . . 12

4 Zustandsmonaden

13

5 Ausgewählte Programmiertechniken

20

5.1 Differenzlisten . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

5.2 Continuations . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 24

5.3 Continuation-basierte Listen . . . . . . . . . . . . . . . . . . . . . . . . . . 32

6 Parserkombinatoren

6.1 Verwendung . . . . . .

6.2 Implementierung . . .

6.3 Monadische Parser . .

6.4 Applikative Funktoren

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

7 Automatisiertes Testen

7.1 Eigenschaftsbasiertes Testen .

7.2 Klassifikation der Testeingabe

7.3 Eingabe-Generatoren . . . . .

7.4 Implementierung . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

1

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

37

37

44

51

53

.

.

.

.

55

55

59

61

63

7.5

Quelltextüberdeckung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 67

8 Debugging

8.1 Debuggen mit Observationen (Hood) . . . . . .

8.2 Implementierung von Observationen für Daten

8.3 Observieren von Funktionen . . . . . . . . . . .

8.4 Andere Ansätze . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

69

71

72

75

77

9 Funktionale Datenstrukturen

9.1 Queues . . . . . . . . . .

9.2 Arrays . . . . . . . . . .

9.3 Array-Listen . . . . . .

9.4 Tries . . . . . . . . . . .

9.5 Verallgemeinerte Tries .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

79

80

84

87

100

107

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

10 Graphen

113

11 Generische Programmierung

117

1 Input / Output

Hello World in Haskell:

main :: IO ()

main = putStrLn "Hello World!"

Dieses Programm kann man mit runhaskell ausführen. Die main Funktion muss den

Typ IO () haben (dieser kann aber inferiert werden). Sie dient als Startpunkt zur

Ausführung des Programms.

bash# runhaskell helloworld.hs

Hello World!

putStrLn erzeugt eine IO-Aktion:

ghci> :t putStrLn

putStrLn :: String -> IO ()

Der Ergebnistyp IO () steht für eine IO-Aktion, die ein Ergebnis vom Typ () liefert,

wenn sie ausgeführt wird. IO-Aktionen werden ausgeführt, wenn sie Teil des Hauptprogramms (definiert durch main) sind (oder wenn sie in GHCi eingegeben werden).

getLine liest eine Zeile von der Standardeingabe:

2

ghci> :t getLine

getLine :: IO String

IO-Aktion, die einen String liefert, wenn sie ausgeführt wird.

1.1 do-Notation

Mehrere IO-Aktionen können mit do-Notation kombiniert werden.

main = do

putStrLn "Wie heißt Du?"

name <- getLine

putStrLn ("Hello " ++ name ++ "!")

Ausführen:

bash# runhaskell hello.hs

Wie heißt Du?

World

Hello World!

Der Linkspfeil holt das Ergebnis aus einer IO-Aktion heraus und bindet es an eine

Variable. name hat den Typ String und kann in reinen Funktionen (d.h. solchen ohne

IO Typ) verwendet werden.

Was ist das Ergebnis von getLine ++ getLine?

In einem do-Block können Variablen auch mit einer let-Anweisung gebunden werden.

Im Gegensatz zum let-Ausdruck hat die Anweisung kein in sondern die Bindungen sind

in den folgenden Anweisungen sichtbar:

main = do

let name = "World"

putStrLn ("Hello " ++ name ++ "!")

Man bindet Variablen in do-Blöcken mit let an Ergebnisse von reinen Funktionen und

mit dem Linkspfeil an Ergebnisse von IO-Aktionen. Wenn man eine Variable mit let an

eine IO-Aktion bindet, ist der Wert der Variablen die IO-Aktion selbst:

main = do

let gl = getLine

a <- gl

b <- gl

putStrLn (a ++ b)

3

Die IO-Aktion gl kann mehrfach ausgeführt werden und dabei unterschiedliche Ergebnisse liefern. Sie ist eine Abkürzung für die IO-Aktion getLine selbst, nicht für deren

Ergebnis.

IO-Aktionen können rekursiv definiert werden. Als Beispiel definieren wir unsere eigene

getLine Aktion:

getLine’ :: IO String

getLine’ = do

c <- getChar

if c == ’\n’ then

return ""

else do

cs <- getLine’

return (c:cs)

Die IO-Aktion getChar liefert ein Zeichen von der Standardeingabe. Wir vergleichen dieses Zeichen mit ’\n’ um zu entscheiden, ob wir weiterlesen müssen. In do-Blöcken können

wir if-then-else Ausdrücke verwenden, deren then und else Zweige IO-Aktionen

(vom gleichen Typ) sind.

return :: a -> IO a erzeugt aus einem beliebigen Wert eine IO-Aktion, die diesen

Wert zurück liefert. Wir verwenden return um den leeren String zu liefern, wenn das

’\n’-Zeichen gelesen wurde und um im rekursiven Fall die gesamte Zeile aus erstem

Zeichen c und restlicher Zeile cs zurück zu liefern.

return verhält sich anders als in imperativen Sprachen:

main = do

a <- return "a"

b <- return "b"

putStrLn (a++b)

return "c"

return ()

Es bricht die Ausführung eines do-Blocks nicht ab sondern verpackt das Argument lediglich in einer IO-Aktion ohne Seiteneffekt. Das obige Programm gibt ab aus und könnte

kürzer so geschrieben werden:

main = do

let a = "a"

b = "b"

putStrLn (a++b)

4

Da wir das Ergebnis der beiden ersten mit return erzeugten Aktionen sofort wieder mit

dem Linkspfeil heraus holen, können wir auch let verwenden. Die Ergebnisse der beiden

letzten Aktionen werden nicht verwendet. Wir können die Aktionen also weglassen (da

return keinen Seiteneffekt hat).

IO-Aktionen können auch (potentiell) unendlich lange laufen.

import Data.Char ( toUpper )

main = do

c <- getChar

putChar (toUpper c)

main

Dieses Programm liest immer wieder ein Zeichen von der Standardeingabe und gibt es

groß aus. Bei Eingabe von hello ergibt sich folgende Ausgabe:

bash# runhaskell echo-char.hs

hHeElLlLoO

1.2 Lazy IO

Man kann die Standardeingabe in Haskell auch lazy einlesen, d.h. erst wenn sie gebraucht

wird. Die IO-Aktion getContents :: IO String liefert die Standardeingabe als lazy

String.

main = do

s <- getContents

putStr (map toUpper s)

Dieses Programm liest genau wie das obige die Eingabe zeichenweise ein und gibt sie

groß wieder aus:

ghci> main

hHeElLlLoO

Obwohl mit map toUpper konzeptuell die gesamte Eingabe auf einmal verarbeitet wird,

verarbeitet das Programm die Eingabe zeichenweise: jedes Zeichen wird erst eingelesen,

wenn der entsprechende Großbuchstabe ausgegeben werden soll.

Die Pufferung der Eingabe wird davon beeinflusst, wie man das Programm ausführt. Im

GHCi ist die Pufferung standardmäßig zeichenweise, bei der Ausführung mit runhaskell

zeilenweise:

5

bash# runhaskell lazy-echo-char.hs

hello

HELLO

world

WORLD

Die Art der Pufferung kann man mit Funktionen aus dem System.IO Modul beeinflussen.

Das obige Programm verhält sich, als würde es in einer Schleife Zeilen einlesen, ist aber

im Gegensatz zum vorher gezeigten Programm nicht rekursiv definiert. Lazy IO wird

häufig für Programme verwendet, die die Benutzereingabe zeilenweise verarbeiten, da es

erlaubt solche Programme ohne Rekursion zu definieren.

Auch der Inhalt von Dateien wird in Haskell lazy eingelesen. Die Funktion readFile ::

String -> IO String erwartet als Parameter einen Dateinamen und liefert eine IOAktion, die den Dateiinhalt zurück gibt. Wie bei getContents wird die Datei erst gelesen, wenn der Inhalt von der Berechnung gebraucht wird. Die Funktion writeFile ::

String -> String -> IO () nimmt einen Dateinamen und einen String und liefert

eine IO-Aktion, die die angegebene Datei mit dem gegebenen String überschreibt. Zum

Anhängen eines Strings an eine bestehende Datei, kann man die Funktion appendFile

:: String -> String -> IO () verwenden.

Variante der Uppercase-Konvertierung mit Dateien:

main = do

s <- readFile "input.txt"

writeFile "output.txt" (map toUpper s)

Der Inhalt von input.txt wird erst beim Schreiben in output.txt gelesen. Obwohl

die map Funktion konzeptuell die komplette Eingabe konvertiert, ist weder die Eingabe

noch die Ausgabe jemals komplett im Speicher. Laziness ermöglicht die Verwendung von

Zwischenergebnissen, ohne dass diese komplett erzeugt werden.

1.3 Programmieren mit IO

Statt Haskell-Programme mit runhaskell auszuführen, kann man sie auch kompilieren.

Zum Beispiel können wir mit dem Kommando

bash# ghc --make helloworld

aus der Datei helloworld.hs die Datei helloworld erzeugen und diese dann ausführen.

bash# ./helloworld

Hello World!

6

Als etwas komplizierteres Beispiel schreiben wir ein Programm, das eine Zahl n vom

Benutzer einliest und die ersten n Fakultäten ausgibt:

import System ( getArgs )

main = do

a:_ <- getArgs

printFactorials (read a)

return ()

printFactorials :: Int -> IO Int

printFactorials 1 = do

print 1

return 1

printFactorials n = do

facNm1 <- printFactorials (n-1)

let facN = n * facNm1

print facN

return facN

Die IO-Aktion getArgs :: IO [String] liefert die Liste aller KommandozeilenParameter, deren erstes Element wir mit einem Pattern an die Variable a binden.

printFactorials berechnet die Fakultätsfunktion und gibt gleichzeitig alle Zwischenergebnisse aus.

Ein Nachteil dieser Implementierung ist die Verzahnung der Berechnung von Fakultäten

und deren Ausgabe. Besser ist es die Berechnung und die Ausgabe im Programm voneinander zu trennen:

main = do

a:_ <- getArgs

sequence $ map (print.factorial) [1..read a]

return ()

factorial :: Int -> Int

factorial n = product [1..n]

Dieses Programm berechnet die auszugebenden Fakultäten mit der Funktion factorial

ohne Seiteneffekte und gibt diese dann mit der print Funktion aus.

Die Funktion sequence :: [IO a] -> IO [a] nimmt eine Liste von IO-Aktionen als

Argument, die wir mit der map Funktion erzeugen. Das Ergebnis von sequence ist eine

IO-Aktion, die die gegebenen Aktionen der Reihe nach ausführt und die Ergebnisse der

7

Ausführungen in einer Liste zurück gibt. Wir ignorieren diese Ergebnisse und liefern

stattdessen () als Ergebnis von main.

Haskell-Programme sollten in der Regel dem Muster des zweiten Programms folgen und

• als erstes die Eingabe einlesen,

• dann mit einem rein funktionalen Programm ein Ergebnis berechnen und

• dieses dann ausgeben oder in eine Datei schreiben.

Dadurch wird der imperative Anteil eines Programms auf die Ein- und Ausgabe

beschränkt. Das eigentliche Programm bleibt seiteneffektfrei und dadurch einfacher

verständlich und besser wartbar.

Anders als in imperativen Programmiersprachen sind seiteneffektbehaftete Berechnungen in Haskell sogenannte Bürger erster Klasse. IO-Aktionen können, wie oben gesehen,

Argumente und Ergebnisse von Funktionen sein und in Datenstrukturen, zum Beispiel

in Listen, stecken ohne ausgeführt zu werden.

2 Typkonstruktor-Klassen

Bisher haben wir Klassen eingesetzt um Funktionen für unterschiedliche Typen zu

überladen. Diese Idee lässt sich auf Typkonstruktoren fortsetzen. Wir haben zum

Beispiel zwei map-Funktionen kennen gelernt. Eine für Listen:

map :: (a -> b) -> [a] -> [b]

map _ []

= []

map f (x:xs) = f x : map f xs

und eine für Bäume:

data Tree a = Empty | Node (Tree a) a (Tree a)

mapTree :: (a -> b) -> Tree a -> Tree b

mapTree _ Empty = Empty

mapTree f (Node l x r) =

Node (mapTree f l) (f x) (mapTree f r)

Einstellige Typkonstruktoren, für die man eine solche map-Funktion definieren kann,

heißen Funktoren:

class Functor f where

fmap :: (a -> b) -> f a -> f b

8

Die Variable f ist hier eine Typkonstruktor-Variable, d.h. sie abstrahiert von einstelligen

Typkonstruktoren.

Wir können nun folgende Functor-Instanzen angeben:

instance Functor [] where

fmap = map

instance Functor Tree where

fmap = mapTree

Auch für Maybe können wir eine Instanz angeben:

instance Functor Maybe where

fmap _ Nothing = Nothing

fmap f (Just x) = Just (f x)

Die Instanz für den Typkonstruktor Maybe wendet die gegebene Funktion auf den optionalen Wert an, wenn einer vorhanden ist.

Die Klasse Functor erlaubt es Funktionen wie die folgende zu schreiben, die man sowohl

auf Listen als auch auf Bäumen oder Maybe-Werten oder beliebigen anderen FunctorInstanzen anwenden kann:

inc :: Functor f => f Int -> f Int

inc = fmap (+1)

Auch IO ist ein einstelliger Typkonstruktor. Können wir für ihn auch eine FunctorInstanz angeben? Ja:

instance Functor IO where

fmap f a = do x <- a

return (f x)

Die Functor-Klasse und die gezeigten Instanzen (bis auf die für Tree) sind in Haskell

vordefiniert, Sie können sie also verwenden, ohne sie selbst zu definieren.

Mit der Functor-Instanz für IO können wir das folgende Programm schreiben:

main = do x <- fmap length getLine

print x

Wenn wir es ausführen, müssen wir eine Zeile eingeben und bekommen dann deren Länge

angezeigt:

9

ghci> main

abc

3

Hier ein weiteres Beispiel, das zeigt, wie man den ersten Kommandozeilen-Parameter

ausgeben kann:

main = do x <- fmap head getArgs

print x

Speichert man dieses Programm in der Datei print-first-arg.hs, kann man es wie

folgt ausführen:

bash# runhaskell print-first-arg.hs 42 43 44

42

Instanzen der Klasse Functor müssen die folgenden sogenannten Funktor-Gesetze

erfüllen:

fmap id

= id

fmap (f . g) = fmap f . fmap g

Das heißt, fmap ist ein Homomorphismus. Wir überprüfen die Gesetze beispielhaft für

die Maybe-Instanz:

fmap id Nothing = Nothing

= id Nothing

fmap id (Just x) = Just (id x) = id (Just x)

fmap (f . g) Nothing

= Nothing

= fmap f (fmap g Nothing)

= (fmap f . fmap g) Nothing

fmap (f . g) (Just x)

= Just ((f . g) x)

= Just (f (g x))

= fmap f (fmap g (Just x))

= (fmap f . fmap g) (Just x)

Für Listen und Bäume zeigt man die Gesetze per struktureller Induktion. Um zu zeigen, dass die IO-Instanz die Funktor-Gesetze erfüllt, benötigt man Gesetze für die doNotation, die wir bisher noch nicht kennen.

10

3 Abschließende Bemerkungen zur MonadPlus Typklasse

Die Funktion guard wird häufig zur Einschränkung des Suchraums verwendet. Für Listen

könnte man sie so definieren:

guard :: Bool -> [()]

guard False = []

guard True = [()]

Diese Definition erscheint zunächst wenig sinnvoll, ist es aber in Kombination mit dem

bind Operator. Das folgende Beispiel zeigt dies. Der Ausdruck

return False >>= guard >> return 42

wird zu

guard False >> return 42

= [] >> return 42

= []

ausgewertet, der Ausdruck

return True >>= guard >> return 42

aber zu

guard True >> return 42

= [()] >> return 42

= return 42

= [42]

Mit guard kann man also Ergebnisse anhand eines Prädikats verwerfen. Das erinnert

nicht zufallig an die filter-Funktion, die man mit guard definieren kann:

filter :: (a -> Bool) -> [a] -> [a]

filter p xs = do x <- xs

guard (p x)

return x

Üblicherweise verwendet man guard um zulässige Ergebnisse aus einem größeren Suchraum auszuwählen. Zum Beispiel könnten wir das Programm zur Berechnung Pythagoräischer Tripel aus einer früheren Vorlesung auch so schreiben:

11

pytriples :: Int -> [(Int,Int,Int)]

pytriples max = do a <- [1..max]

b <- [a..max]

c <- [b..max]

guard (a*a + b*b == c*c)

return (a,b,c)

Der Aufruf pytriples 10 ergibt dann [(3,4,5),(6,8,10)]. Tatsächlich kann man beliebige List-Comprehensions in do-Notation übersetzen (siehe Übung).

Die guard-Funktion ist für beliebige Instanzen der Klasse MonadPlus wie folgt vordefiniert:

guard :: MonadPlus m => Bool -> m ()

guard False = mzero

guard True = return ()

Man könnte also eine (leicht angepasste) Version der pytriples-Funktion auch in anderen MonadPlus-Instanzen ausführen.

3.1 Ein Kommentar zu den MonadPlus-Gesetzen

Neben der Forderung, dass mzero und mplus ein Monoid formen, ist noch eine weitere

Eigeschaft von MonadPlus-Instanzen wünschenswert. Für jede Funktion f sollte (>>=

f) verknüpfungstreu bezüglich mzero und mplus (also gewissermaßen ein MonadPlusHomomorphismus) sein:

mzero >>= f

(a ‘mplus‘ b) >>= f

=

=

mzero

(a >>= f) ‘mplus‘ (b >>= f)

Diese Gesetze stellen sicher, dass während einer Berechnung keine Ergebnisse verloren

gehen, sind aber nicht für jede vordefinierte MonadPlus-Instanz erfüllt. Zum Beispiel

erfüllt die Instanz für Maybe das zweite, sogenannte Distributivgesetz für MonadPlus,

nicht, denn es gilt für a = return False, b = return True und f = guard:

=

=

=

=

(return False ‘mplus‘ return True) >>= guard

(Just False ‘mplus‘ Just True) >>= guard

Just False >>= guard

guard False

Nothing

aber

12

(return False >>= guard) ‘mplus‘ (return True >>= guard)

= guard False ‘mplus‘ guard True

= Nothing ‘mplus‘ Just ()

= Just ()

Die Maybe-Monade ist daher nur bedingt zum Lösen von Suchproblemen geeignet, da

Ergebnisse verloren gehen können. Wenn man zum Beispiel, wie oben beschrieben, Pythagoräische Tripel in der Maybe-Monade berechnen möchte, erhält man als Ergebnis

Nothing statt Just (3,4,5).

4 Zustandsmonaden

Wir betrachten noch einmal den Datentyp für beschriftete Binärbäume

data Tree a = Empty | Node (Tree a) a (Tree a)

und wollen eine Funktion definieren, die die Knoten so eines Baums von links nach rechts

durchnummeriert.

numberTree :: Tree a -> Tree (Int,a)

Beispiel (verkürzt):

ghci> numberTree (N (N E ’a’ E) ’b’ (N E ’c’ E))

N (N E (1,’a’) E) (2,’b’) (N E (3,’c’) E)

Zur rekursiven Definition dieser Funktion über die Struktur von Binärbäumen benötigen

wir einen zusätzlichen Parameter, der angibt, welche die nächste verfügbare Nummer ist.

Wir könnten daher versuchen, die Funktion wie folgt zu definieren

numberTree t = numberTreeWithNum t 1

wobei numberTreeWithNum den Typ Tree a -> Int -> Tree (Int,a) hat. Beim Versuch, den rekursiven Fall von numberTreeWithNum zu definieren, bekommen wir aber das

Problem, dass wir die Größe des linken Teilbaums kennen müssen um die nächste freie

Nummer für den rechten zu berechnen. Statt den linken Teilbaum zweimal zu durchlaufen (einmal zur Nummerierung und einmal zur Berechnung der Größe) ist es besser,

wenn unsere Hilfsfunktion nicht nur den nummerierten Baum sondern auch die nächste

freie Nummer zurückgibt. Die nächste freie Nummer wird dadurch zu einer Art Zustand,

der durch die Berechnung durchgereicht wird.

13

numberTreeWithState

:: Tree a -> Int -> (Tree (Int,a), Int)

Mit dieser Funktion können wir numberTree definieren und müssen nur das erste Element

des Ergebnisses selektieren, also die letzte freie Nummer ignorieren.

numberTree t = fst (numberTreeWithState t 1)

Unsere Hilfsfunktion definieren wir wie folgt. Einen leeren Baum braucht man nicht zu

nummerieren und die nächste freie Nummer bleibt unverändert:

numberTreeWithState Empty n = (Empty,n)

Bei einem inneren Knoten nummerieren wir erst den linken Teilbaum, ergänzen die

Beschriftung durch die dann nächste freie Nummer und nummerieren dann den rechten

Teilbaum mit einer um 1 größeren Nummer.

numberTreeWithState (Node l x r) n =

let (l’,n1) = numberTreeWithState l n

(r’,n2) = numberTreeWithState r (n1+1)

in (Node l’ (n1,x) r’, n2)

Definitionen wie diese sind fehleranfällig, da man Variablen wie n1 und n2 leicht verwechseln kann. Das manuelle Auspacken und Weiterreichen des Zustands wird bei größeren

Programmen schnell unübersichtlich.

Die sequentielle Struktur dieses Programms (erst den linken Teilbaum nummerieren,

dann den rechten), wirft die Frage auf, ob wir es nicht eleganter mit do-Notation implementieren können. Es folgt eine wünschenswerte monadische Variante unserer Hilfsfunktion, die einen Zustand mit Hilfe von Funktionen get und put manipuliert.

numberTreeState Empty = return Empty

numberTreeState (Node l x r) =

do l’ <- numberTreeState l

n <- get

put (n+1)

r’ <- numberTreeState r

return (Node l’ n r’)

Können wir eine Monade definieren, die diese Definition erlaubt? Angenommen

numberTreeState soll denselben Typ haben wie numberTreeWithState, dann müsste

die return-Funktion den Typ a -> Int -> (a,Int) haben. Den Typkonstruktor

IntState für die zugehörige Monade müssten wir dann so definieren:

14

type IntState a = Int -> (a,Int)

Der bind Operator hätte den Typ IntState a -> (a -> IntState b) -> IntState

b. Außerdem haben wir Funktionen get und put verwendet, die in dem Fall folgende

Typen haben müssten:

get :: IntState Int

put :: Int -> IntState ()

Zur Implementierung dieser und der monadischen Funktionen ist der konkrete Typ des

Zustands (hier Int) unerheblich, wir können von diesem also abstrahieren. Außerdem

definieren wir statt eines Typsynonyms einen neuen Typ mit newtype um Berechnungen in Zustandsmonaden von anderen Funktionen zu unterscheiden, die zufällig einen

passenden Typ haben.

newtype State s a = State (s -> (a,s))

Zu diesem Typ definieren wir eine Funktion

runState :: State s a -> s -> (a,s)

runState (State f) = f

mit der man Berechnungen in Zustandsmonaden ausführen kann. Es gilt offensichtlich

runState (State f) = f und für alle a :: State s a auch State (runState a) =

a.

Wir geben nun eine Monad-Instanz für den Typkonstruktor State s an. Die returnFunktion lässt den Zustand unverändert und der bind-Operator reicht ihn durch sein

erstes Argument in die Berechnung des zweiten.

instance Monad (State s) where

return x = State (\s -> (x,s))

a >>= f = State (\s -> let (x,s’) = runState a s

in runState (f x) s’)

Wir müssen nun zeigen, dass diese Implementierung die Monadengesetze erfüllt. return

ist eine Links-Identität für bind:

return x >>= f

= State (\s ->

let (x’,s’) = runState (return x) s

15

=

=

=

=

=

=

in

State

let

in

State

let

in

State

let

in

State

State

f x

runState (f x’) s’)

(\s ->

(x’,s’) = runState (State (\s -> (x,s))) s

runState (f x’) s’)

(\s ->

(x’,s’) = (\s -> (x,s)) s

runState (f x’) s’)

(\s ->

(x’,s’) = (x,s)

runState (f x’) s’)

(\s -> runState (f x) s)

(runState (f x))

return ist auch eine Rechts-Identität für bind:

a >>= return

= State (\s -> let (x,s’) = runState a

in runState (return x)

= State (\s -> let (x,s’) = runState a

in runState (State (\s

= State (\s -> let (x,s’) = runState a

in (\s -> (x,s)) s’)

= State (\s -> let (x,s’) = runState a

= State (\s -> runState a s)

= State (runState a)

= a

s

s’)

s

-> (x,s))) s’)

s

s in (x,s’))

Schließlich zeigen wir noch das Assoziativgesetz für den bind Operator.

(a >>= f) >>= g

= State (\s -> let (x,s’) = runState (a >>= f) s

in runState (g x) s’)

= State (\s ->

let (x,s’) = runState (State (\t ->

let (y,t’) = runState a t

in runState (f y) t’)) s

in runState (g x) s’)

= State (\s ->

let (x,s’) = (\t -> let (y,t’) = runState a t

in runState (f y) t’) s

in runState (g x) s’)

= State (\s ->

16

=

=

=

=

=

=

let (x,s’) = let (y,t’) = runState a s

in runState (f y) t’

in runState (g x) s’)

State (\s ->

let (y,t’) = runState a s

(x,s’) = runState (f y) t’

in runState (g x) s’)

State (\s ->

let (y,t’) = runState a s

in let (x,s’) = runState (f y) t’

in runState (g x) s’)

State (\s ->

let (y,t’) = runState a s

in (\t -> let (x,s’) = runState (f y) t

in runState (g x) s’) t’)

State (\s ->

let (y,t’) = runState a s

in runState (State (\t ->

let (x,s’) = runState (f y) t

in runState (g x) s’)) t’)

State (\s -> let (y,t’) = runState a s

in runState (f y >>= g) t’)

a >>= \x -> f x >>= g

Es fehlen noch die Definitionen für get und put. Die get-Funktion lässt den Zustand

unverändert und gibt ihn zusätzlich als erstes Argument des Ergebnispaares zurück.

get :: State s s

get = State (\s -> (s,s))

Die put-Funktion ignoriert den durchgereichten Zustand und ersetzt ihn durch den

übergebenen.

put :: s -> State s ()

put s = State (\_ -> ((),s))

Mit diesen Definitionen können wir die Funktion numberTree nun unter Verwendung

der monadischen Hilfsfunktion numberTreeState definieren:

numberTree :: Tree a -> Tree (Int,a)

numberTree t = fst (runState (numberTreeState t) 1)

17

Es stellt sich die Frage, ob die gezeigte Implementierung die einzig mögliche einer Zustandsmonade ist. Analog zur Verallgemeinerung der Listenmonade durch die MonadPlus

Typklasse können wir die State s-Monade zu beliebigen Zustandsmonaden abstrahieren, indem wir die Schnittstelle in einer Typklasse spezifizieren.

Zustandsmonaden stellen neben den monadischen Operationen zwei Funktionen get und

put zur Verfügung, die wir wie folgt in einer Typklasse abstrahieren können:

class Monad m => MonadState s m where

get :: m s

put :: s -> m ()

MonadState ist eine sogenannte Multi-Parameter-Typklasse, denn sowohl der Zustandstyp als auch der Monaden-Typkonstruktor sind Parameter von MonadState.

Multi-Parameter-Klassen gehören nicht zum Haskell’98 Standard, können aber im GHC

oder GHCi durch die Spracherweiterung MultiParamTypeClasses aktiviert werden.

Um entsprechende Instanzen deklarieren zu können ist zusätzlich noch die Erweiterung

FlexibleInstances notwendig.

Wir können den Typkonstruktor State s zu einer Instanz der Klasse MonadState s

machen, indem wir die vorherigen Defnitionen von get und put in die Instanzdeklaration

schreiben.

instance MonadState s (State s) where

get

= State (\s -> (s,s))

put s = State (\_ -> ((),s))

Wie bei MonadPlus können wir uns auch bei MonadState fragen, welche Gesetze für

Zustandsmonaden erfüllt sein sollen. Zwei sinnvolle Gesetze sind zum Beispiel das Gesetz

get >>= put

=

return ()

welches besagt, dass das Setzen des Zustands auf den aktuellen Zustand keinen Effekt

hat und das Gesetz

put s >> get

=

put s >> return s

welches besagt, dass get den zuvor gesetzten Zustand liefert und diesen nicht verändert.

Das folgende zeigt, dass unsere Implementierung diese Gesetze erfüllt.

18

=

=

=

=

=

=

=

get >>= put

State (\s ->

let (x,s’) = runState get s

in runState (put x) s’

State (\s ->

let (x,s’) = runState (State (\s -> (s,s))) s

in runState (put x) s’)

State (\s ->

let (x,s’) = (s,s)

in runState (put x) s’)

State (\s -> runState (put s) s)

State (\s -> runState (State (\_ -> ((),s))) s)

State (\s -> ((),s))

return ()

Auch das zweite Gesetz gilt:

put s

= State

let

in

= State

let

in

= State

let

in

= State

= State

= State

let

in

= State

let

in

= put s

>> get

(\t ->

(x,t’) = runState (put s) t

runState get t’)

(\t ->

(x,t’) = runState (State (\_ -> ((),s))) t

runState get t’)

(\t ->

(x,t’) = ((),s)

runState (State (\s -> (s,s))) t’)

(\t -> (s,s))

(\t -> let (x,t’) = ((),s) in (s,t’))

(\t ->

(x,t’) = runState (State (\_ -> ((),s))) t

runState (State (\s’ -> (s,s’))) t’

(\t ->

(x,t’) = runState (put s) t

runState (return s) t’

>> return s

Durch die MonadState-Klasse kann die numberTreeState-Funktion in beliebigen Zustandsmonaden ausgeführt werden, denn sie hat den Typ

numberTreeState

:: MonadState Int m => Tree a -> m (Tree (Int,a))

19

Bisher kennen wir keine anderen Zustandsmonaden, wir werden aber später alternative

Implementierungen kennen lernen.

5 Ausgewählte Programmiertechniken

Dieses Kapitel behandelt funktionale Programmiertechniken, die häufig eingesetzt werden, um Programme effizienter zu machen.

5.1 Differenzlisten

In der Übung (erste Aufgabe auf dem zweiten Übungszettel) haben wir unterschiedliche

Implementierungen der reverse-Funktion kennen gelernt. Eine naive Implementierung

mit quadratischer Laufzeit:

reverse :: [a] -> [a]

reverse []

= []

reverse (x:xs) = reverse xs ++ [x]

und eine Implementierung mit linearer Laufzeit, die die Akkumulatortechnik verwendet:

reverse :: [a] ->

reverse l = rev l

where

rev []

ys =

rev (x:xs) ys =

[a]

[]

ys

rev xs (x:ys)

Hierbei ist rev :: [a] -> [a] -> [a].

Wir wollen nun versuchen, die Klarheit der ersten Implementierung mit der Effizienz

der zweiten zu vereinen. Die erste Implementierung ist schneller verständlich als die

zweite, da sie einem einfacheren Rekursions-Schema folgt. Die zweite Implementierung

ist komplizierter, da sich hier zwei Argumente der rekursiven Funktion im rekursiven

Aufruf auf trickreiche Weise ändern.

Dank Currying ist rev auch eine einstellige Funktion, nämlich vom Typ [a] -> ([a]

-> [a]). Wir schreiben sie nun so um, dass dies auch in ihrer Implementierung sichtbar

wird.

reverse :: [a] -> [a]

reverse l = rev l []

where

rev []

= id

rev (x:xs) = rev xs . (x:)

20

Die rev-Funktion hat nun dieselbe rekursive Struktur wie die naive Implementierung von

reverse. id spielt dabei die Rolle der leeren Liste, (.) die Rolle der Konkatenation mit

(++) und (x:) repräsentiert die einelementige Liste [x]. Wir haben also nur das ListenMonoid durch das Funktions-Monoid ersetzt und dadurch die Effizienz der reverseFunktion verbessert.

Wir können diese Idee in einem abstrakten Datentyp sogenannter Differenzlisten1 ausdrücken.

import Data.Monoid

newtype DList a = DList ([a] -> [a])

instance Monoid (DList a) where

mempty

= DList id

DList xs ‘mappend‘ DList ys = DList (xs . ys)

Die Implementierung von mappend ist nicht rekursiv und hat daher konstante Laufzeit,

was im Kern der Grund für die Laufzeitverbesserung ist.

Wie in der letzten Implementierung von reverse können wir eine Differenzliste in eine

normale Liste umwandeln, indem wir sie auf die leere Liste anwenden.

fromDList :: DList a -> [a]

fromDList (DList xs) = xs []

Intuitiv ist eine Differenzliste eine Funktion, die die in ihr enthaltenen Elemente vorne

an ihr Argument anhängt. Eine normale Liste kann also wie folgt in eine Diffrenzliste

konvertiert werden.

toDList :: [a] -> DList a

toDList xs = DList (xs ++)

Wir können die Implementierung der reverse-Funktion umschreiben, um deutlich zu

machen, dass wir Differenzlisten verwenden.

reverse :: [a] -> [a]

reverse l = fromDList (rev l)

where

rev []

= mempty

rev (x:xs) = rev xs ‘mappend‘ toDList [x]

1

Der Name Differenzliste kommt aus der Logikprogrammierung - eine Analogie, auf die wir hier nicht

weiter eingehen.

21

Diese Implementierung verwendet die (++)-Funktion nur durch toDList und nur mit

einelementigen Listen als erstes Argument. Sie hat daher wie die Implementierung mit

Akkumulatortechnik lineare Laufzeit.

Differenzlisten werden typischerweise bei Baumdurchläufen verwendet, die eine Liste

erzeugen. In der ersten Übung haben wir Funktionen auf Binärbäumen implementiert,

die die Knotenbeschriftungen in Prefix-, Infix- und Postfix-Ordnung auflisten. Alle diese

Implementierungen verwendeten einen rekursiven Aufruf als linkes Argument von (++)

und habe daher im schlechtesten (unbalancierten) Fall quadratische Laufzeit.

Mit Differenzlisten können wir die Beschriftungen in Linearzeit auflisten, wie hier am

Beispiel der Infix-Ordnung:

data Tree a = Empty

| Branch (Tree a) a (Tree a)

deriving Eq

infixLabels :: Tree a -> [a]

infixLabels = fromDList . labels

where

labels Empty

= mempty

labels (Branch l x r) =

labels l ‘mappend‘ toDList [x]

‘mappend‘ labels r

Die Funktionen toDList und fromDList sind zueinander inverse Monoid-Isomorphismen

(einfacher Induktionsbeweis). Man kann daher jedes Programm über Listen, das nur die

Monoid-Operationen verwendet, in eines über Differenzlisten umschreiben, ohne dessen

Verhalten zu ändern.

Nicht jede Funktion, die man auf Listen schreiben kann, kann man auch direkt auf Differenzlisten implementieren. Zum Beispiel können wir nicht testen, ob eine Differenzliste

leer ist, ohne sie in eine normale Liste zu konvertieren:

nullDL :: DList a -> Bool

nullDL (DList dl) = null (dl [])

Das einzige, was wir mit der Funktion dl machen können, ist sie anzuwenden. Anders

können wir nicht sehen, wie viele Elemente sie vor ihr Argument hängt. Dieses Problem

könnte man noch umgehen, indem man zusätzlich eine Zahl für die Länge der Liste

speichert (welche es gleichzeitig erlauben würde, eine length-Funktion zu definieren).

Dieser Trick hat aber seine Grenzen. Auch er erlaubt nicht, zum Beispiel die map- oder

die concat-Funktion auf Differenzlisten zu implementieren.

Wir könnten wie folgt versuchen, eine map-Funktion für Differenzlisten zu implementieren:

22

mapDL :: (a -> b) -> DList a -> DList b

mapDL f (DList dl) = DList (\l -> ???)

Wir können die Funktion f jedoch nicht auf die Elemente von dl anwenden, ohne dl in

eine normale Liste zu konvertieren. Ähnliche Probleme haben wir bei der Implementierung einer concat-Funktion.

Wir werden später einer andere Implementierung von Listen als Funktionen kennen

lernen, die die Definition von map und concat erlaubt.

Ein anderes typisches Beispiel für Baumdurchläufe, die Listen erzeugen, sind showFunktionen. Die Show-Klasse enthält folgende Funktionen2 :

class Show a where

show :: a -> String

show x = shows x ""

showsPrec :: Int -> a -> ShowS

Der ShowS-Typ und die shows-Funktion sind dabei wie folgt definiert:

type ShowS = String -> String

shows :: Show a => a -> ShowS

shows = showsPrec 0

Der ShowS-Typ repräsentiert also Strings als Differenzlisten und shows ist wie die

show-Funktion, erzeugt aber solche Differenzlisten. Die Funktion showsPrec bekommt

einen zusätzlichen Parameter, den man verwenden kann, um unter Berücksichtigung

von Präzedenzen Klammern zu sparen. Wir werden ihn im Folgenden aber ignorieren.

Mit Hilfe des ShowS-Typen können wir Bäume in Linearzeit in Strings umwandeln.

instance Show a => Show (Tree a) where

showsPrec _ Empty =

showString "Empty"

showsPrec _ (Branch l x r) =

showString "Branch " .

showParen (l/=Empty) (shows l) .

showChar ’ ’ . shows x . showChar ’ ’ .

showParen (r/=Empty) (shows r)

2

Zusätzlich zu den gezeigten Funktionen enthält die Show-Klasse auch die Funktion showList :: Show

a => [a] -> String mit deren Hilfe man die Darstellung von Listen eines Typs anpassen kann.

Diese wird zum Beispiel von der Char Instanz überschrieben, um Strings nicht als Liste von Zeichen

darzustellen.

23

Analog zum DList-Typ verwenden wir Funktionskomposition statt Listenkonkatenation

um lineare Laufzeit zu erreichen.

Die Funktion showString entspricht der Funktion toDList und erzeugt aus einem

String einen ShowS-Wert.

showString :: String -> ShowS

showString = (++)

showChar tut das selbe für ein einzelnes Zeichen:

showChar :: Char -> ShowS

showChar = (:)

showParen erzeugt Klammern um einen ShowS-Wert, falls das übergebene Flag True ist.

showParen :: Bool -> ShowS -> ShowS

showParen True s = showChar ’(’ . s . showChar ’)’

showParen False s = s

All diese Funktionen sind in der Prelude definiert.

5.2 Continuations

Als Beispiel für die Maybe-Monade haben wir einen Datentyp

data Expr = Num Float

| Expr :+: Expr

| Expr :/: Expr

und eine Funktion

eval :: Expr -> Maybe Float

definiert, wobei die eval-Funktion Nothing liefert, wenn bei der Auswertung eine Division durch Null auftritt.

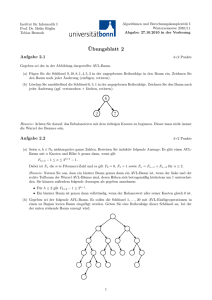

Das folgende Bild stellt den Baumdurchlauf für die Auswertung des Ausdrucks

Num 4 :/: (Num 1 :+: Num (-1)) :+: Num 4

24

grafisch dar.

Bild von einem Baumdurchlauf

Sobald der Wert Nothing auftritt, wird der Baumdurchlauf abgebrochen. Zum Beispiel

wird das rechte Argument des obersten :+:-Knotens nicht mehr ausgewertet, da die

Auswertung des linken Arguments fehlschlägt.

Der Wert Nothing wird von der Stelle im Baum, an der er zuerst auftritt, bis zur

Wurzel des Ausdrucks hoch gereicht. Die eval-Funktion testet dazu, ob die Ergebnisse

von rekursiven Aufrufen Nothing sind und gibt in diesem Fall selbst Nothing zurück.

Wenn ein Nothing-Wert sehr tief im Baum auftritt, ist dieses Hochreichen ineffizient.

Können wir die Abarbeitung nicht stoppen, ohne den Fehler durch den Baum zu reichen?

Um dies zu erreichen, schreiben wir die eval-Funktion in Continuation Passing Style (CPS). Eine Funktion in CPS nimmt als zusätzliches Argument eine Funktion, die

sogenannte Continuation. In CPS hat die eval-Funktion den folgenden Typ:

evalCPS :: Expr

-> (Float -> Maybe Float)

-> Maybe Float

Der Continuation übergeben wir das Ergebnis, das wir im Erfolgsfall zurück liefern

würden. Die Regel für Konstanten sieht deshalb so aus:

evalCPS (Num x) k = k x

Um mehrere Ausdrücke hintereinander auszuwerten, schachteln wir die zweite Auswertung in der Continuation der ersten:

evalCPS (e1 :+: e2) k =

evalCPS e1 (\v1 -> evalCPS e2 (\v2 -> k (v1 + v2)))

Die übergebene Continuation wird ganz innen benutzt. Im Fehlerfall geben wir als Ergebnis der Continuation Nothing zurück statt die übergebene Continuation aufzurufen:

evalCPS (e1 :/: e2) k =

evalCPS e1 (\v1 ->

evalCPS e2 (\v2 ->

if v2 == 0 then Nothing else k (v1 / v2)))

25

In diesem Program gibt es kein Pattern-Matching auf Nothing mehr! Im Fehlerfall gibt

evalCPS direkt Nothing zurück, ohne es durch den Berechnungsbaum hindurch zu reichen.

Eine alternative Implementierung der letzten Regel berechnet den Divisor zuerst und

spart die Berechnung des Dividenden, wenn der Divisor Null ist:

evalCPS (e1 :/: e2) k =

evalCPS e2 (\v2 ->

if v2 == 0 then Nothing

else evalCPS e1 (\v1 -> k (v1 / v2)))

Rufen wir evalCPS mit dem obigen Ausdruck auf, können wir Just als Continuation

übergeben um ein Ergebnis vom Typ Maybe Float zu erhalten.

ghci> let zero = Num 1 :+: Num (-1)

ghci> let expr = (Num 4 :/: zero) :+: Num 4

ghci> evalCPS expr Just

Nothing

Wir werten diesen Aufruf schrittweise aus:

=

=

=

=

=

=

evalCPS expr Just

evalCPS ((Num 4 :/: zero) :+: Num 4) Just

evalCPS (Num 4 :/: zero) (\x ->

evalCPS (Num 4) (\y -> Just (x+y)))

evalCPS zero (\b ->

if b==0 then Nothing

else evalCPS (Num 4) (\a ->

evalCPS (Num 4) (\y -> Just ((a/b)+y))))

evalCPS (Num 1 :+: Num (-1)) (\b ->

if b==0 then Nothing

else evalCPS (Num 4) (\a ->

evalCPS (Num 4) (\y -> Just ((a/b)+y))))

evalCPS (Num 1) (\c ->

evalCPS (Num (-1)) (\d ->

if (c+d)==0 then Nothing

else evalCPS (Num 4) (\a ->

evalCPS (Num 4) (\y ->

Just ((a/(c+d))+y)))))

evalCPS (Num (-1)) (\d ->

if (1+d)==0 then Nothing

else evalCPS (Num 4) (\a ->

26

evalCPS (Num 4) (\y ->

Just ((a/(1+d))+y))))

= if (1+(-1))==0 then Nothing

else evalCPS (Num 4) (\a ->

evalCPS (Num 4) (\y ->

Just ((a/(1+d))+y)))

= Nothing

Der Wert Nothing wird also sofort zurück gegeben, wenn er auftritt und nicht mehr

durch den Aufrufbaum gereicht.

Die hier gezeigte Funktion evalCPS ist zwar effizienter als die Funktion eval in der

Maybe-Monade aber auch weniger gut lesbar. Wir werden nun sehen, dass die neue

Implementierung auch monadisch ist, nämlich bezüglich einer Continuation-basierten

Variante der Maybe-Monade.

Inspiriert vom Typ von evalCPS definieren wir den folgenden Datentyp:

newtype CMaybe r a =

CMaybe ((a -> Maybe r) -> Maybe r)

Dieser Typ entspricht dem Ergebnistyp von evalCPS, wobei Float durch die Typparameter r und a ersetzt wurde. Werte vom CMaybe kann man in normale Maybe-Werte

konvertieren, indem man Just als Continuation übergibt:

fromCMaybe :: CMaybe a a -> Maybe a

fromCMaybe (CMaybe ca) = ca Just

Beim Konvertieren eines CMaybe-Wertes werden die Typparameter r und a unifiziert.

Vor der Konvertierung bleibt r in der Regel polymorph.

Wir definieren nun eine Monad-Instanz für CMaybe r mit deren Hilfe man CMaybe-Werte

definieren kann.

instance Monad (CMaybe r) where

return x = CMaybe (\k -> k x)

CMaybe ca >>= f = CMaybe (\k ->

ca (\x -> let CMaybe cb = f x in cb k))

Die Implementierung von return übergibt das Argument an die Continuation und die

Implementierung von >>= schachtelt die Berechnung des zweiten Arguments in der

Continuation des ersten. Dadurch ist das Ergebnis der Continuation vom Typ Maybe b

27

das Argument aber vom Typ a. Anders als bei der Maybe-Monade ist >>= ohne PatternMatching definiert.

Die Monadengesetze zeigen wir unabhängig vom Ergebnistyp der Continuation. Wir

ignorieren dabei der Übersichtlichkeit wegen die newtype-Konstruktoren:

=

=

=

=

=

return x >>= f

(\k -> k x) >>= f

(\k’ -> (\k -> k x) (\x’ -> f x’ k’))

(\k’ -> (\x’ -> f x’ k’) x)

(\k’ -> f x k’)

f x

=

=

=

=

=

ca >>=

(\k ->

(\k ->

(\k ->

(\k ->

ca

return

ca (\x -> return x k))

ca (\x -> (\k’ -> k’ x) k))

ca (\x -> k x))

ca k)

(ca >>= f) >>= g

= (\k -> ca (\x -> f x k)) >>= g

= \k’ -> (\k -> ca (\x -> f x k))

(\y -> g y k’)

= \k’ -> ca (\x -> f x (\y -> g y k’))

= \k’ -> ca (\x -> (\k ->

f x (\y -> g y k)) k’)

= \k’ -> ca (\x -> (f x >>= g) k’)

= ca >>= \x -> f x >>= g

Sowohl die Implementierung der Monadenoperationen als auch die Beweise für die Monadengesetze sind unabhängig vom Ergebnistyp Maybe r der Continuation. Wir werden

später weitere Continuation-Monaden kennen lernen, für die die Definition der Monadenoperationen (also auch die Beweise der Gesetze) mit den oben gezeigten übereinstimmen.

Wir geben nun eine MonadPlus-Instanz für CMaybe an, die die entsprechenden Operationen des Maybe-Typs liftet.

instance MonadPlus (CMaybe r) where

mzero = CMaybe (\_ -> mzero)

CMaybe ca ‘mplus‘ CMaybe cb =

CMaybe (\cont -> ca cont ‘mplus‘ cb cont)

28

Auch für diese Instanz zeigen wir die Gesetze unter Vernachlässigung der newtypeKonstruktoren.

mzero >>= f

= (\_ -> mzero) >>= f

\k -> (\_ -> mzero) (\x -> f x k)

= \k -> mzero

= mzero

=

=

=

=

=

=

(ca ‘mplus‘ cb) >>= f

\k -> (ca ‘mplus‘ cb) (\x -> f x k)

\k -> (\k’ -> ca k’ ‘mplus‘ cb k’)

(\x -> f x k)

\k -> ca (\x -> f x k)

‘mplus‘ cb (\x -> f x k)

\k -> (\k’ -> ca (\x -> f x k’)) k

‘mplus‘ (\d -> cb (\x -> f x k’)) k

(\k’ -> ca (\x -> f x k’))

‘mplus‘ (\k’ -> cb (\x -> f x k’))

(ca >>= f) ‘mplus‘ (cb >>= f)

Die CMaybe-Monade erfüllt also, anders als die Maybe-Monade, das Distributivgesetz zwischen >>= und mplus und kann daher zur Implementierung von Backtracking verwendet

werden.

ghci> let a = return False ‘mplus‘ return True

ghci> let b = a >>= guard

ghci> b :: Maybe ()

Nothing

ghci> fromCMaybe b

Just ()

Wir können nun die monadische Implementierung der eval-Funktion

eval

eval

eval

do

:: MonadPlus m => Expr -> m Float

(Num x) = return x

(a :+: b) =

x <- eval a

y <- eval b

return (x+y)

eval (a :/: b) =

do y <- eval b

guard (y/=0)

29

x <- eval a

return (x/y)

in der CMaybe-Monade ausführen, was einer Ausführung mit der evalCPS-Funktion entspricht.

Die Maybe-Monade ist nicht die einzige, die man mit Continuations kombinieren kann.

Wenn wir im CMaybe-Typ Maybe durch DList ersetzen, erhalten wir eine Continuationbasierte Listenmonade.

Wir haben gesehen, dass die obige Implementung von mplus der CMaybe-Monade das

Gesetz

(a‘mplus‘b) >>= f

=

(a>>=f) ‘mplus‘ (b>>=f)

erfüllt, obwohl die mplus-Funktion der Maybe-Monade es nicht erfüllt. Diese erfüllt stattdessen das Gesetz

return x ‘mplus‘ a

=

return x

das an ein Gesetz für catch in Fehlermonaden erinnert: Nur wenn das linke Argument

fehlschlägt wird das rechte Argument ausgeführt.

Können wir eine Funktion orElse für die CMaybe-Monade definieren, die das Gesetz

return x ‘orElse‘ a

=

return x

erfüllt? Das können wir:

orElse :: CMaybe a a -> CMaybe a a -> CMaybe r a

CMaybe ca ‘orElse‘ CMaybe cb =

CMaybe (\k -> (ca Just ‘mplus‘ cb Just) >>= k)

Diese Implementierung übergibt Just als Continuation an beide Alternativen, ruft auf

den Ergebnissen die mplus-Funktion der Maybe-Monade auf und übergibt das Ergebnis

dieses Aufruf mit dem bind-Operator der Maybe-Monade an die Continuation k. Im Typ

von orElse ist der Typ-Parameter r der Argumente gleich a, da wir wie in fromCMaybe

die Continuation Just :: a -> Maybe a übergeben.

Wenn wir die mplus-Funktion der Maybe-Monade auf diese Weise in den CMaybe-Typ

heben, überträgt sich die obige Eigenschaft:

30

return x ‘orElse‘ a

= (\k -> ((return x) Just ‘mplus‘ a Just)

>>= k)

= (\k -> ((\k’ -> k’ x) Just ‘mplus‘ a Just)

>>= k)

= (\k -> (Just x ‘mplus‘ a Just) >>= k)

= (\k -> Just x >>= k)

= (\k -> k x)

= return x

orElse verhält sich also genauso wie mplus in der Maybe-Monade:

ghci> let a = return False ‘orElse‘ return True

ghci> fromCMaybe (a >>= guard)

Nothing

Diese Methode, einen Wert aus der unterliegenden Maybe-Monade mit dem bindOperator an die Continuation zu übergeben, kann man anwenden um beliebige Werte

vom Maybe-Typ in den CMaybe-Typ zu heben:

toCMaybe :: Maybe a -> CMaybe r a

toCMaybe a = CMaybe (\k -> a >>= k)

Die Funktion toCMaybe ist dabei ein Monaden-Homomorphismus, das heißt es gilt:

toCMaybe (return x)

toCMaybe (a >>= f)

=

=

return x

toCMaybe a >>= toCMaybe . f

Hier die Beweise:

toCMaybe (return x)

= \k -> return x >>= k

= \k -> k x

= return x

toCMaybe (a >>= f)

\k -> (a >>= f) >>= k

\k -> a >>= (\w -> f w >>= k)

\k -> (\k3 -> a (\u -> (f u >>= k) k3))

\k -> (\k3 -> a (\u -> (\k5 ->

f u (\v -> k v k5)) k3))

= \k -> (\k3 -> a (\u -> f u (\v -> k v k3)))

=

=

=

=

31

= \k -> (\k1 -> (\k3 -> a (\u -> k1 u k3)))

(\y -> (\k4 -> f y (\v -> k v k4)))

= \k -> (\k1 -> (\k3 -> a (\u -> k1 u k3)))

(\y -> (\k2 -> \k4 ->

f y (\v -> k2 v k4)) k)

= (\k1 -> (\k3 -> a (\u -> k1 u k3)))

>>= \z -> \k2 -> \k4 -> f z (\v -> k2 v k4)

= (\k1 -> a >>= k1) >>= \z -> \k2 -> f z >>= k2

= toCMaybe a >>= toCMaybe . f

In den Beweisen verwenden wir die Links-Identität sowie das Assoziativgesetz der unterliegenden Maybe-Monade.

5.3 Continuation-basierte Listen

Bei den Instanzen für den CMaybe-Typ haben wir (im Gegensatz zur Definition von

orElse) nicht ausgenutzt, dass Maybe eine Monade ist. Die Monad-Instanz verwendet gar

keine Operationen des unterliegenden Typs, die MonadPlus-Instanz nur die Monoid(artigen) Operationen mzero und mplus.

Wir können also die selbe Konstruktion für andere Monoide durchführen und wählen als

Beispiel Differenzlisten:

newtype CList r a =

CList ((a -> DList r) -> DList r)

Solche Continuation-Listen können wir in normale Listen konvertieren, indem wir zuerst

(:) als Continuation übergeben und dann der Differenzliste die leere Liste übergeben:

fromCList :: CList a a -> [a]

fromCList (CList ca) =

fromDList (ca (DList . (:)))

Analog zur MonadPlus-Instanz für CMaybe r können wir eine Monoid-Instanz für CList

r a definieren:

instance Monoid (CList r a) where

mempty = CList (\_ -> mempty)

CList ca ‘mappend‘ CList cb =

CList (\k -> ca k ‘mappend‘ cb k)

Die Monad-Instanz für CList r definieren wir genau wie die für CMaybe r:

32

instance Monad (CList r) where

return x = CList ($x)

CList ca >>= f =

CList (\k -> ca (\x -> let CList cb = f x

in cb k))

Die Monaden-Gesetze brauchen wir nicht zu beweisen, da die Beweise für CMaybe r vom

Ergebnistyp der Continuation unabhängig sind und daher auch für CList gelten.

Da DList keine Monade ist können wir Differenzlisten nicht analog zu Maybe-Werten

in den CList-Typ heben (dazu bräuchten wir >>=). Stattdessen können wir ausnutzen, dass sowohl Listen als auch Continuation-Listen Monoide sind und einen MonoidIsomorphismus definieren:

toCList :: [a] -> CList r a

toCList = foldr mappend mempty . map return

Continuation-Listen können mehr als Differenzlisten, da sie Instanz der Monad-Klasse

sind. Das können wir ausnutzen, um zum Beipsiel eine map- und eine concat-Funktion

zu definieren:

mapCL :: (a -> b) -> CList r a -> CList r b

mapCL f cl = cl >>= return . f

concatCL :: CList r (CList r a) -> CList r a

concatCL cl = cl >>= id

Allerdings ist es noch immer nicht möglich einen Leerheitstest oder eine length-Funktion

zu definieren, ohne eine Continuation-Liste in eine normale Liste zu konvertieren.

Um dieses Manko auszumerzen, definieren wir eine weitere Variante des ContinuationTyps, die kein spezielles Monoid mehr verwendet.

newtype C m a = C ((a -> m) -> m)

Der Ergebnistyp ist jetzt polymorph vom Typ m. Um eine Monoid-Instanz zu definieren,

fordern wir nun, dass m ein Monoid ist.

instance Monoid m => Monoid (C m a) where

mempty

= C (\_ -> mempty)

C ca ‘mappend‘ C cb = C (\k -> ca k ‘mappend‘ cb k)

Die Monad-Instanz sieht aus wie immer.

33

instance Monad (C m) where

return x

= C ($x)

C ca >>= f = C (\k -> ca (\x -> let C cb = f x in cb k))

Um einen Wert vom Typ C m a nach m zu konvertieren übergeben wir eine Continuation

vom Typ (a -> m).

fromC :: Monoid m => (a -> m) -> C m a -> m

fromC f (C ca) = ca f

Als Konvertierung in die andere Richtung definieren wir wieder einen MonoidHomomorphismus von Listen in C m a:

toC :: Monoid m => [a] -> C m a

toC = foldr mappend mempty . map return

Nun können wir einen Leerheitstest als Monoid-Homomorphismus von C m a in

(Bool,&&,True) definieren, das heißt als Funktion nullC mit den Eigenschaften:

nullC mempty

nullC (a ‘mappend‘ b)

=

=

True

nullC a && nullC b

Dieses Boole’sche Monoid ist in Haskell in Data.Monoid wie folgt vordefiniert:

newtype All = All { getAll :: Bool }

instance Monoid All where

mempty = All True

x ‘mappend‘ y = All (getAll x && getAll y)

Analog dazu gibt es einen newtype Any, der das Monoid (Bool,||,False) repräsentiert.

Monoid-Homomorphismen von C m a in m definiert man, indem man als Continuation

eine Funktion f :: a -> m übergibt. Das jede sich so ergebende Funktion ein Homomorphismus ist, folgt direkt aus der Definition der Monoid-Instanz für C m a:

fromC f mempty

= fromC f (\_ -> mempty)

= (\_ -> mempty) f

= mempty

34

fromC f (a ‘mappend‘ b)

= fromC f (\k -> a k ‘mappend‘ b k)

= a f ‘mappend‘ b f

= fromC f a ‘mappend‘ fromC f b

Zusätzlich zu den Homomorphie-Gesetzen erfüllen solche Funktionen die Eigenschaft:

fromC f (return x)

=

f x

Denn:

fromC f (return x)

= return x f

= (\k -> k x) f

= f x

Die Funktion nullC definieren wir also als Homomorphismus, der jedem Listenelement

den Wert False zuordnet.

nullC :: C All a -> Bool

nullC l = getAll (fromC (\_ -> All False) l)

Analog dazu können wir eine lengthC-Funktion als Homomorphismus in (Int,+,0) definieren:

lengthC :: C (Sum Int) a -> Int

lengthC l = getSum (fromC (\_ -> Sum 1) l)

Hierbei ist Sum Int ein newtype um Int, der das Monoid (Int,+,0) darstellt. Analog

dazu gibt es Prod für das Monoid (Int,*,1).

Wir können nun die Länge einer Continuation-Liste mit Hilfe der Gesetze wie folgt

berechnen:

lengthC (return 1 ‘mappend‘ return 2)

= lengthC (return 1) + lengthC (return 2)

= 1 + 1

= 2

Als Kontrolle berechnen wir es auch einmal anhand der Definitionen der beteiligten

Funktionen.

35

=

=

=

=

=

=

=

lengthC (return 1 ‘mappend‘ return 2)

fromC (\_ -> 1) (return 1 ‘mappend‘ return 2)

(return 1 ‘mappend‘ return 2) (\_ -> 1)

(\k -> return 1 k + return 2 k) (\_ -> 1)

return 1 (\_ -> 1) + return 2 (\_ -> 1)

(\k -> k 1) (\_ -> 1) + (\k -> k 2) (\_ -> 1)

1 + 1

2

Unsere Implementierung hat noch einen entscheidenden Nachteil: Der Ergebnistyp m der

Continuation, ist nach außen sichtbar und kann deshalb nicht gleichzeitig mit unterschiedlichen Typen instanziiert werden. Zum Beispiel können wir keine Funktion schreiben, die gleichzeitig testet ob eine Liste leer ist und ihre Länge berechnet. Die folgende

Definition führt zu einem Typfehler.

nullLength l = (nullC l, lengthC l)

Hier müsste der Parameter m sowohl mit All als auch mit Sum Int belegt werden:

Couldn’t match expected type ‘Sum Int’

against inferred type ‘All’

Alle durch die Monoid oder Monaden-Instanzen erzeugten Listen haben einen polymorphen Typ m, das sieht man der Definition des Typs aber nicht an.

Mit einer Typsystem-Erweiterung, sogenannten Polymorphen Typen höheren Rangs,

können wir der obige Funktion aber einen korrekten Typ geben. Mit der Spracherweiterung RankNTypes können wir die Typen der beteiligten Funktionen wie folgt anpassen:

nullC

:: (forall m . Monoid m => C m a) -> Bool

lengthC

:: (forall m . Monoid m => C m a) -> Int

nullLength :: (forall m . Monoid m => C m a) -> (Bool, Int)

Die Definitionen der Funktionen bleiben unverändert.

Solche Typen können nicht inferiert werden und explizit polymorphe Argumente kann

man auch nicht per Currying weglassen. Hätten wir das Argument l bei einer der drei

Funktionen nicht explizit hingeschrieben oder eine Typsignatur weggelassen, hätte der

GHC einen Typfehler ausgegeben.

Solche Typsignaturen sind sehr umständlich. Besser ist es, die Typvariable m gar nicht

erst nach außen sichtbar zu machen, indem man sie schon bei der Typ-Deklaration als

polymorph deklariert:

36

newtype List a = List (forall m . Monoid m => (a -> m) -> m)

Alle Definitionen für C m lassen sich auf List übertragen. Die Typsignaturen werden

dabei dadurch vereinfacht, dass List nur noch einen Typ-Parameter a hat.

6 Parserkombinatoren

Ein Programm, das für ein gegebenes Wort w entscheidet, ob es von einer gegebenen kontextfreien Grammatik G beschrieben wird, heißt Parser für G. Dabei ist es

wünschenswert, dass der Parser zusätzlich zur Entscheidung, ob das Eingabewort erkannt

wird, Zusatzinformationen über die Eingabe als Ausgabe liefern kann. Solche Zusatzinformationen könnten zum Beispiel eine Linksableitung oder ein abstrakter Syntaxbaum

sein.

Es gibt unterschiedliche Ansätze, Parser zu implementieren:

• Parsergeneratoren wie YACC (für C) oder Happy (für Haskell) erzeugen aus

einer textuellen Beschreibung einer kontextfreien Grammatik einen Parser für diese

Grammatik.

• Rekursive Abstiegsparser sind durch gegenseitig rekursive Funktionen - eine

für jedes Nichtterminalsymbol der Grammatik - definiert.

• Parserkombinatoren erlauben die Definition von rekursiven Abstiegsparsern in

einer Grammatik-ähnlichen Notation. Mit Parserkombinatoren definierte Grammatiken sind also direkt als Parser ausführbar.

Im Folgenden behandeln wir die Verwendung und Implementierung solcher Parserkombinatoren.

6.1 Verwendung

Ein Kombinator-Parser ist ein Wert vom Typ Parser a und kann mit der parseFunktion auf ein Wort angewendet werden.

parse :: Parser a -> String -> Maybe a

Der Typ a beschreibt Zusatzinformation, die bei einem erfolgreichen Parser-Lauf

zurückgegeben wird. Parser, die nur entscheiden, ob das gegebene Wort erkannt wird,

liefern in der Regel () als Ergebnis. Zum Beispiel konstruiert der Kombinator

char :: Char -> Parser ()

37

einen Parser, der genau das gegebene Zeichen erkennt:

ghci> parse (char ’a’) "a"

Just ()

Bei anderen Eingaben liefert dieser Aufruf Nothing.

ghci> parse (char ’a’) ""

Nothing

ghci> parse (char ’a’) "b"

Nothing

ghci> parse (char ’a’) "ab"

Nothing

Einfache Parser können zu komplexeren kombiniert werden. Dazu gibt es zum Beispiel

den Kombinator

(*>) :: Parser a -> Parser b -> Parser b

der zwei Parser hintereinander ausführt und das Ergebnis des zweiten Parsers liefert.

Damit kann man zum Beispiel einen Parser definieren, der eine öffnende Klammer gefolgt

von einer schließenden erkennt:

parens = char ’(’ *> char ’)’

Die zu diesem Parser gehörige Grammatik sieht in Backus-Naur Form (BNF) so aus:

Parens ::= ’(’ ’)’

Es gibt auch eine Variante des obigen Kombinators, die es erlaubt, das Ergebnis des

ersten Arguments zu liefern:

(<*) :: Parser a -> Parser b -> Parser a

Bei beiden Kombinatoren wird das linke Argument vor dem rechten angewendet. Es gilt

also nicht (<*) = flip (*>).

Als Ergebnis eines erfolgreichen Parser-Laufs des Klammern-Parsers erhalten wir den

Wert ().

ghci> parse parens "()"

Just ()

38

Wir erweitern nun diesen Parser so, dass er korrekt geschachtelte Klammer-Ausdrücke

erkennt. Die zugehörige BNF sieht so aus:

Nested ::= ’(’ Nested ’)’ Nested

|

Hierbei ist die zweite Alternative das leere Wort und das definierte Nichtterminalsymbol

Nested wird auf der rechten Seite der Definition rekursiv verwendet.

In Haskell können wir diesen Parser ebenso rekursiv definieren:

nested

= char ’(’ *> nested *> char ’)’ *> nested

<|> empty

Hierbei verwenden wir den Kombinator

(<|>) :: Parser a -> Parser a -> Parser a

zur Deklaration der Alternativen und den Parser

empty :: Parser ()

zur Erkennung des leeren Wortes. Wir testen auch diesen Parser wieder mit der parseFunktion:

ghci> parse nested "(()(()()))"

Just ()

ghci> parse nested "(()()"

Nothing

Die bisher vorgestellten Kombinatoren erfüllen die folgenden Gleichungen. empty erkennt

nur das leere Wort und ist deshalb neutral bezüglich (*>) und (<*):

empty *> p

p <* empty

=

=

p

p

Außerdem gelten Distributivgesetze für die Sequenz-Kombinatoren und den <|>Kombinator, wie zum Beispiel:

(p <|> q) *> r

p *> (q <|> r)

=

=

(p *> r) <|> (q *> r)

(p *> q) <|> (p *> r)

39

Alle binären Kombinatoren sind assoziativ, zum Beispiel gilt

(p <|> q) <|> r

=

p <|> (q <|> r)

und es gibt auch ein neutrales Element

failure :: Parser a

für den <|>-Kombinator. failure ist ein Parser, der auf kein Wort passt, also die leere

Sprache repräsentiert.

Auf die gezeigte Weise kann man jede kontextfreie Grammatik mit Parserkombinatoren

ausdrücken. Ein Problem stellen dabei aber linksrekursive Grammatiken dar. Übersetzt

man die folgende Grammatik für die Sprache a*

AStar ::= AStar ’a’

|

in Parserkombinatoren

aStar = aStar *> char ’a’

<|> empty

dann terminiert der entsprechende Aufruf der parse-Funktion nicht (bzw. nur mit einem

Laufzeitfehler):

ghci> parse aStar "aaa"

*** Exception: stack overflow

Man muss Linksrekursion also eliminieren. Das Beispiel kann man so transformieren:

aStar = char ’a’ *> aStar

<|> empty

Dann terminiert die parse-Funktion.

ghci> parse aStar "aaa"

Just ()

40

Im Allgemeinen kann die Elimination von Linksrekursion komplizierter sein (siehe Vorlesung: Übersetzerbau). Die Klasse der kontextfreien Grammatiken, die man mit Parserkombinatoren ausdrücken kann, ist genau die Vereinigung der LL(k)-Grammatiken

für alle natürlichen Zahlen k. Parserkombinatoren erlauben also eine beliebig große Vorausschau. Wir werden später sehen, dass man mit Parserkombinatoren sogar Sprachen

erkennen kann, die nicht kontextfrei sind.

Wir lernen nun weitere Kombinatoren kennen, die es erlauben, Parser mit Zusatzinformation als Ausgabe zu definieren. Der einfachste dieser Parser wird durch

yield :: a -> Parser a

konstruiert. yield x ist ein Parser, der das leere Wort erkennt und in dem Fall x liefert.

Als komplizierteres Beispiel erweitern wir den Parser für korrekt geschachtelte KlammerAusdrücke um ein Ergebnis:

nesting :: Parser Int

nesting

= (\m n -> max (m+1) n)

<$> (char ’(’ *> nesting <* char ’)’)

<*> nesting

<|> yield 0

Der Parser nesting erkennt die selbe Sprache wie nested gibt aber zusätzlich die maximale Schachtelungstiefe aus:

ghci> parse nesting "(()(()()))"

Just 3

ghci> parse nesting ""

Just 0

ghci> parse nesting "(()()"

Nothing

Wir haben zur Definition von nesting zwei neue Kombinatoren verwendet. Der erste

(<$>) :: (a -> b) -> Parser a -> Parser b

wendet eine Funktion auf das Ergebnis eines Parsers an. Das Ergebnis von <$> ist ein

Parser, der die selbe Sprache erkennt wie das zweite Argument aber ein durch das erste

Argument verändertes Ergebnis liefert. Der Typ von <$> erinnert an die map-Funktion.

Tatsächlich können wir den Typkonstruktor Parser zu einer Instanz der Klasse Functor

machen,

41

instance Functor Parser where

fmap = (<$>)

denn es gilt

id <$> p

f <$> (g <$> p)

=

=

p

(f . g) <$> p

Sowohl <$> als auch <*> sind linksassoziativ. Im Beispiel wird also eine Funktion vom

Typ

Int -> Int -> Int

auf den Parser

(char ’(’ *> nesting <* char ’)’)

vom Typ Parser Int angewendet. Das Ergebnis ist ein Parser vom Typ

Parser (Int -> Int)

der eine Funktion liefert! Dieser wird dann mit dem Kombinator <*> mit dem Parser

nesting vom Typ Parser Int zu einem Parser vom Typ Parser Int kombiniert. Der

Kombinator <*> hat den folgenden Typ:

(<*>) :: Parser (a -> b) -> Parser a -> Parser b

Dieser Typ ähnelt dem des <$>-Kombinators, nur dass die Funktion nicht direkt

übergeben sondern von einem Parser geliefert wird. Tatsächlich können wir jede

Verwendung von <$> auch mit <*> ausdrücken, denn es gilt:

f <$> p

=

yield f <*> p

<*> konstruiert also einen Parser, der die gegebenen Parser hintereinander ausführt und

die Funktion, die der erste Parser liefert, auf das Ergebnis des zweiten Parsers anwendet.

Die beiden anderen Sequenz-Kombinatoren könnten wir mit Hilfe von <$> und <*>

definieren, denn es gilt:

p <* q

p *> q

=

=

(\x _ -> x) <$> p <*> q

(\_ y -> y) <$> p <*> q

42

Neben den gezeigten Gleichungen gelten auch die folgenden:

f <$> yield x

p <*> yield y

p <*> (q <*> r)

=

=

=

yield (f x)

($y) <$> p

(.) <$> p <*> q <*> r

In der ersten Gleichung wird eine Funktion auf das Ergebnis eines Parsers angewendet,

der das leere Wort erkennt und x liefert. Die zweite Gleichung zeigt, auf welche Weise

man die Funktion, die ein Parser liefert, auf einen Wert anwenden kann und die dritte behandelt die Hintereinanderausführung von Funktionen, die von Parsern geliefert

werden.

Wir betrachten ein weiteres Beispiel für Parser mit Ergebnis und verwenden dabei

zusätzlich die folgenden Kombinatoren.

anyChar :: Parser Char

check

:: (a -> Bool) -> Parser a -> Parser a

Der Parser anyChar c liest ein einzelnes Zeichen und gibt es zurück und check verändert

einen Parser so, dass er fehlschlägt, wenn sein Ergebnis das gegebene Prädikat nicht

erfüllt. Wir könnten zum Beispiel den Kombinator char mit Hilfe vom anyChar und

check definieren:

char :: Char -> Parser ()

char c = check (c==) anyChar *> empty

Das abschließende *> empty ist hier nur dazu da, den Ergebnistyp des Parsers von a

nach () zu ändern.

Ein Vorteil von Parserkombinatoren ist, dass man sich aufbauend auf existierenden Kombinatoren neue Kombinatoren definieren kann, um sie später zur Definition von Parsern

zu verwenden. Als Beispiel definieren wir den Kombinator many, der einen Parser beliebig

oft hintereinander ausführt.

many :: Parser a -> Parser [a]

many p = (:) <$> p <*> many p

<|> yield []

Die Ergebnisse des gegebenen Parsers p werden gesammelt und als Liste von many p

zurückgeliefert. Wir können die neuen Kombinatoren verwenden, um einen Parser für

Palindrome zu definieren.

43

palindrom

= check (\ (u,v) -> u == reverse v)

$ (,)

<$> many anyChar

<*> many anyChar

Dieser Parser erkennt zunächst zwei beliebige Worte u und v und testet dann, ob u die

Umkehrung von v ist.

ghci> parse palindrom "anna"

Just ("an","na")

ghci> parse palindrom "otto"

Just ("ot","to")

Dieses Beispiel zeigt, dass die Sprachklasse, die man mit Parserkombinatoren erkennen

kann, auch nicht-kontextfreie Sprachen enthält.

6.2 Implementierung

Wir werden nun sehen, wie man den Parser-Typ in Haskell implementieren kann.

Da die parse-Funktion die einzige ist, die auf Parsern aufgerufen wird und dabei keinen

neuen Parser erzeugt, könnten wir versuchen, den Parser-Typ als ebendiese Funktion

zu definieren:

type Parser a = String -> Maybe a

parse :: Parser a -> String -> Maybe a

parse p = p

Diese Darstellung stößt jedoch schnell an ihre Grenzen. Zum Beispiel bei der Definition

des *>-Kombinators:

(*>) :: Parser a -> Parser b -> Parser b

p *> q = \s -> p s ??? q s

Wir können keine sinnvolle Definition für *> angeben, weil der zweite Parser q nicht auf

der kompletten Eingabe aufgerufen werden soll sondern auf dem Rest der Eingabe, die

nach dem Parsen von p noch übrig ist.

Wir könnten den Parser-Typ daher wie folgt ändern:

type Parser a = String -> Maybe (a,String)

44

Zusätzlich zum Ergebnis, liefert jeder Parser nun den Teil der Eingabe zurück, den er

nicht verbraucht hat. Die parse-Funktion müssten wir dann wie folgt umschreiben:

parse :: Parser a -> String -> Maybe a

parse p s = case p s of

Just (x,"") -> Just x

_

-> Nothing

parse liefert genau dann ein Ergebnis, wenn der Parser eines liefert und die restliche

Eingabe leer ist.

Mit dieser Definition können wir *> sinnvoll implementieren:

(*>) :: Parser a -> Parser b -> Parser b

p *> q = \s -> case p s of

Just (_,s’) -> q s’

Nothing

-> Nothing

Wir ignorieren das Ergebnis des ersten Parsers p und geben nur die verbleibende Eingabe

an den Parser q weiter.

Wir versuchen nun weitere Kombinatoren zu definieren. empty liefert das Ergebnis ()

und die Eingabe unverändert zurück.

empty :: Parser ()

empty = \s -> Just ((),s)

Die char-Funktion liefert einen Parser, der () liefert, wenn das erste Zeichen der Eingabe

das gegebene Zeichen ist:

char :: Char -> Parser ()

char x (c:cs) | x == c

= Just (c,cs)

| otherwise = Nothing

Bei der Definition von <|> zur Deklaration von Alternativen, parsen wir erst mit dem

ersten Parser und, wenn dieser fehlschlägt, mit dem zweiten:

(<|>) :: Parser a -> Parser a -> Parser a

p <|> q = \s -> case p s of

Just xs -> Just xs

Nothing -> q s

45

Diese Implementierung erfüllt jedoch nicht das Distributivgesetz, wie das folgende Beispiel zeigt:

test1

test2

=

(empty <|> char ’a’) *> char ’b’

= (empty *> char ’b’)

<|> (char ’a’ *> char ’b’)

Der erste Parser erkennt das Wort äb" nicht, der zweite hingegen schon.

ghci> parser test1 "ab"

Nothing

ghci> parser test2 "ab"

Just ()

Wir definieren schließlich den Parser-Typ unter Verwendung von Listen statt MaybeWerten, um die Distributivgesetze zu erfüllen:

type Parser a = String -> [(a,String)]

Ein Parser kann also mehrere Ergebnisse liefern und zu jedem Ergebnis kann auch ein

unterschiedlicher Anteil der Eingabe übrig bleiben.

Die parse-Funktion testet, ob es unter den Ergebnissen eines mit leerer Resteingabe gibt

und gibt dieses dann zurück.

parse :: Parser a -> String -> Maybe a

parse p s = case filter (null.snd) $ p s of

(x,_):_ -> Just x

_

-> Nothing

Falls es mehrere Ergebnisse mit leerer Resteingabe gibt, wird einfach das erste zurück

gegeben.

Wir passen nun die bisher definierten Kombinatoren an Listen an. Das leere Wort kann

man auf genau eine Art parsen. Der Parser für empty liefert also eine einelementige Liste:

empty :: Parser ()

empty = \s -> [((),s)]

Der Parser für ein Zeichen liefert entweder eine einelementige oder eine leere Liste:

46

char :: Char -> Parser ()

char x (c:cs) | x == c = [((),cs)]

char x _

= []

Der folgende Aufuf zeigt, wie sich ein mit char erzeugter Parser verhält:

ghci> char ’a’ "abc"

[((),"bc")]

Das erste Zeichen ist weggelesen, neben dem einzigen Ergebnis () bleibt als "bc" als

Resteingabe. Wenn das erste Zeichen nicht das gesuchte ist, wird gar kein Ergebnis

geliefert:

ghci> char ’a’ "bc"

[]

Alternativ zur eben gezeigten Definition können wir char auch mit check und anyChar

definieren:

anyChar :: Parser Char

anyChar []

= []

anyChar (c:cs) = [(c,cs)]

check :: (a->Bool) -> Parser a -> Parser a

check ok p = filter (ok . fst) . p

char :: Char -> Parser ()

char c = check (c==) anyChar *> empty

anyChar liefert, auf die leere Eingabe angewendet, kein Ergebnis und ansonsten das erste

Zeichen der Eingabe als Ergebnis und die restlichen Zeichen als verbleibende Eingabe.

check ok p filtert aus den Ergebnissen von p die Ergebnisse heraus, die das Prädikat

ok erfüllen.

Den Sequenz-Operator *> definieren wir auf Listen wie folgt:

(*>) :: Parser a -> Parser b -> Parser b

p *> q =

\s -> [ xs | (_,s’) <- p s, xs <- q s’ ]

Wie bei der Maybe-Variante ignorieren wir das Ergebnis des ersten Parsers p, reichen

aber die verbleibende Eingabe s’ an den zweiten Parser q weiter und liefern dessen

Ergebnisse zurück.

Wir können zwei beliebige Zeichen hintereinander lesen, indem wir zwei anyChar-Parser

mit *> kombinieren:

47

ghci> (anyChar *> anyChar) "abc"

[(’b’,"c")]

Da das Gesamtergebnis, das Ergebnis des zweiten Parsers ist, erhalten wir als Ergebnis

das Zeichen ’b’. Als Resteingabe verbleibt "c".

Der Kombinator <*> verallgemeinert *>, da er das Ergebnis des ersten Parsers nicht

ignoriert sondern auf das Ergebnis des zweiten anwendet:

(<*>) :: Parser (a->b) -> Parser a -> Parser b

p <*> q =

\s -> [ (f x,s2) | (f,s1) <- p s,

(x,s2) <- q s1 ]

Mit Hilfe von <*> können wir die anderen Sequenz-Kombinatoren definieren. Da wir

<* noch nicht definiert haben, holen wir das hiermit nach: