Hans Walser, [20150119] Verallgemeinerung des Vektorprodukts

Werbung

![Hans Walser, [20150119] Verallgemeinerung des Vektorprodukts](http://s1.studylibde.com/store/data/018987267_1-a4af0bc04121252d778bd64d23370b71-768x994.png)

Hans Walser, [20150119]

Verallgemeinerung des Vektorprodukts

Anregung: G. G., B.

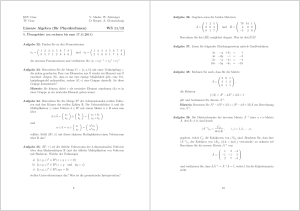

1 Worum geht es?

In der Schule lernt man, dass das Vektorprodukt nur für Raumvektoren funktioniert.

Das ist eine falsche Sicht.

2 Formale Determinanten

2.1 Im Raum

Wir konstruieren zu zwei Raumvektoren

⎡ a1

! ⎢

a = ⎢ a2

⎢ a

⎣ 3

⎤

⎡ b ⎤

! ⎢ 1 ⎥

⎥

⎥ und b = ⎢ b2 ⎥

⎥

⎢ b ⎥

⎦

⎣ 3 ⎦

die formale Matrix A:

⎡ a1 b1 e!1 ⎤

⎢

! ⎥

A = ⎢ a2 b2 e2 ⎥

⎢ a b e! ⎥

3 ⎦

⎣ 3 3

!

Die Einträge

in den ersten beiden Spalten von A sind die Komponenten der Vektoren a

!

und b , die Einträge in der dritten Spalte sind keine Zahlen, sondern die drei Einheitsvektoren eines räumlichen kartesischen Koordinatensystems.

Für die formale Determinante erhalten wir mit der Entwicklung nach Laplace nach der

dritten Spalte:

⎛ ⎡ a b e! ⎤⎞

1

1

1

⎜⎢

! ⎥⎟

det ( A ) = det ⎜ ⎢ a2 b2 e2 ⎥⎟ =

⎜ ⎢ a b e! ⎥⎟

3 ⎦⎠

⎝⎣ 3 3

⎛ ⎡ a b ⎤⎞ !

⎛⎡ a b

!

2

2

1

1

⎥⎟ − e2 det ⎜ ⎢

= e1 det ⎜ ⎢

⎜⎝ ⎢ a3 b3 ⎥⎟⎠

⎜⎝ ⎢ a3 b3

⎣

⎦

⎣

⎛⎡ a

⎤⎞ !

1

⎥⎟ + e 3 det ⎜ ⎢

⎜⎝ ⎢ a2

⎥⎦⎟⎠

⎣

b1 ⎤⎞

⎥⎟ =

b2 ⎥⎟⎠

⎦

⎛ a2b3 − a3b2 ⎞

⎜

⎟ ! !

= ⎜ a3b1 − a1b3 ⎟ = a × b

⎜ a1b2 − a2b1 ⎟

⎝

⎠

Diese formale Determinante

ist ein Vektor, und zwar das Vektorprodukt der beiden

!

!

Vektoren a und b .

2.2 In der Ebene

In der Ebene konstruieren wir analog zu einem Vektor

2/4

Hans Walser: Verallgemeinerung des Vektorprodukts

! ⎡ a1

a=⎢

⎢⎣ a2

⎤

⎥

⎥⎦

die formale Matrix A:

⎡ a1 e!1 ⎤

A=⎢

! ⎥

⎢⎣ a2 e2 ⎥⎦

!

Die Einträge in der ersten Spalte von A sind die Komponenten des Vektors a , die Einträge in der zweiten Spalte sind keine Zahlen, sondern die beiden Einheitsvektoren eines

ebenen kartesischen Koordinatensystems. Nun berechnen wir formal die Determinante

dieser Matrix A:

⎛ ⎡ a e! ⎤⎞

!

! ⎡ −a2 ⎤ ! ⊥

1

1

⎥

⎥=a

det ( A ) = det ⎜ ⎢

=

a

e

−

a

e

⎟

!

1 2

2 1=⎢

⎜⎝ ⎢ a2 e2 ⎥⎟⎠

a1 ⎥

⎢

⎣

⎦

⎣

⎦

!

Diese Determinante ist ein Vektor, und zwar der um +90° gedrehte Vektor a .

3 Allgemein

Wir verallgemeinern in beliebige Dimensionen n. Zu n − 1 Vektoren

⎡ a1,1 ⎤

⎡ a1,k

⎥

⎢

! ⎢

!

a1 = ⎢ " ⎥ , ... , ak = ⎢ "

⎢ an,1 ⎥

⎢ an,k

⎣

⎦

⎣

bilden wir die formale Matrix A:

⎡ a1,1 !

⎢

A=⎢ #

⎢ an,1 !

⎣

Nun berechnen wir formal die Determinante:

!

!

× ( a1,..., an−1 )

⎤

⎡ a1,n−1

⎥

⎢

!

"

⎥ , ... , an−1 = ⎢

⎥

⎢ an,n−1

⎦

⎣

⎤

⎥

⎥

⎥

⎦

"

e1 ⎤

⎥

#

# ⎥

"

an,n−1 en ⎥

⎦

a1,n−1

! ⎤⎞

⎛⎡ a

1,1 # a1,n−1 e1

⎥⎟

⎜⎢

" det ⎜ ⎢ $

$

$ ⎥⎟

!

⎜ ⎢ an,1 # an,n−1 en ⎥⎟

⎝⎣

⎦⎠

!

!

Die Schreibweise × ( a1,..., an−1 ) , gesprochen „cross(...)“, ist an die Schreibweise des

Vektorproduktes angelehnt.

!

!

Die Determinante × ( a1,..., an−1 ) ist ein Vektor mit folgenden Eigenschaften:

!

!

• Er ist orthogonal zu jedem der n − 1 Inputvektoren a1, ... , an−1 .

• Seine Länge hat bis auf das

dimensionale Volumen des durch

Vorzeichen dieselbe Maßzahl wie das n − 1 !

!

a1, ... , an−1 aufgespannten Spates.

3/4

Hans Walser: Verallgemeinerung des Vektorprodukts

!

!

• Die Zuordnung × ( a1,..., an−1 ) ist antikommutativ. Vertauschen zweier Inputvektoren

stellt die Richtung um.

4 Beweise

Für die Beweise verwenden wir die Bezeichnung:

!

!

!

v = × ( a1,..., an−1 )

Zu einer quadratischen Matrix B bezeichnen wir mit B! i, j die Determinante der Untermatrix, die sich aus B durch Streichen der i-ten Zeile und der j-ten Spalte ergibt.

Auf Grund der Berechnung einer Determinante nach der Entwicklung der letzten Spalte

ist daher:

⎡

⎤

n−1+1 "

A1,n ⎥

⎢ ( −1)

⎢

⎥

#

⎢

⎥

!

!

!

v = × ( a1,..., an−1 ) = ⎢ ( −1)n−1+ j A" j,n ⎥

⎢

⎥

#

⎢

⎥

⎢ ( −1)n−1+n A"

⎥

n,n ⎥⎦

⎢⎣

4.1 Orthogonalität

Wir ersetzen in der Matrix A die letzte Spalte, also die Spalte mit den Einheitsvektoren,

!

durch die Komponenten eines Vektors ak , k ∈{1, …, n − 1} :

⎡ a1,1 ! a1,n−1 a1,k

⎢

= ⎢ "

"

"

⎢ an,1 ! an,n−1 an,k

⎣

⎤

⎥

⎥

⎥

⎦

( )

!

Weil der Spaltenvektor ak nun doppelt vorkommt, ist det  = 0 . Andererseits liefert

die Entwicklung nach der letzten Spalte:

( )

n

0 = det  = ∑ a j,k ( −1)

n−1+ j

" "

A! j,n = ak ⋅ v

j=1

!

!

!

!

Der Vektor v = × ( a1,..., an−1 ) ist also orthogonal zu jedem der n − 1 Inputvektoren ak .

4.2 Länge

!

Für die Länge des Vektors v gilt zunächst (die Vorzeichen verschwinden durch das

Quadrieren):

n

!2

v = ∑ A" 2j,n

j=1

Nun ersetzen wir in der Matrix A die letzte Spalte, also die Spalte mit den Einheitsvek!

toren, durch die Komponenten eines Vektors v :

4/4

Hans Walser: Verallgemeinerung des Vektorprodukts

⎡

⎤

n−1+1 #

A1,n ⎥

⎢ a1,1 " a1,n−1 ( −1)

⎢ $

⎥

$

$

⎥

⌣ ⎢

A = ⎢ a j,1 " a j,n−1 ( −1)n−1+ j A# j,n ⎥

⎢

⎥

$

$

⎢ $

⎥

n−1+n #

⎢ a

An,n ⎥⎥

⎢⎣ n,1 " an,n−1 ( −1)

⎦

⌣

Die Determinante der Matrix A ist also das n-dimensionale Volumen des durch die n

!

!

!

Vektoren a1,…, an−1, v aufgespannten Spates. Wegen der im vorangehenden Abschnitt

festgestellten Orthogonalität ist dieser Spat aber ein gerades Prisma mit dem durch die

!

!

n − 1 Vektoren a1,…, an−1 aufgespannten n − 1 -dimensionalen Spat als Grundfigur.

Das n − 1 -dimensionale Volumen dieses Spates bezeichnen wir mit G, in Anlehnung an

die Grundfläche im räumlichen Fall. Es gilt also unter Berücksichtigung allfälliger Vorzeichen:

⌣

"

det A = ±G v

( )

Andererseits ist (Entwicklung nach der letzten Spalte):

n

n

⌣

#2

n−1+ j "

n−1+ j "

det A = ∑ ( −1)

A j,n ( −1)

A j,n = ∑ A" 2j,n = v

( )

!

Somit ist v = ±G .

j=1

j=1

4.3 Antikommutativität

Die Antikommutativität ist eine Folge der Vorzeichenänderung beim Vertauschen zweier Spalten in einer Determinantenberechnung.