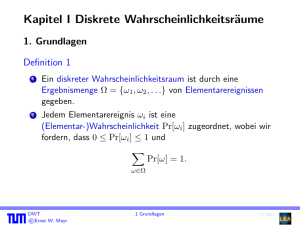

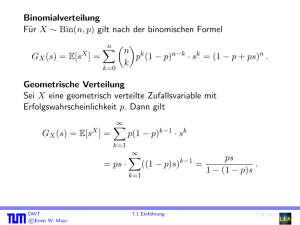

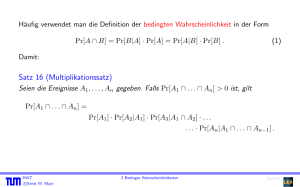

Diskrete Wahrscheinlichkeitstheorie

Werbung