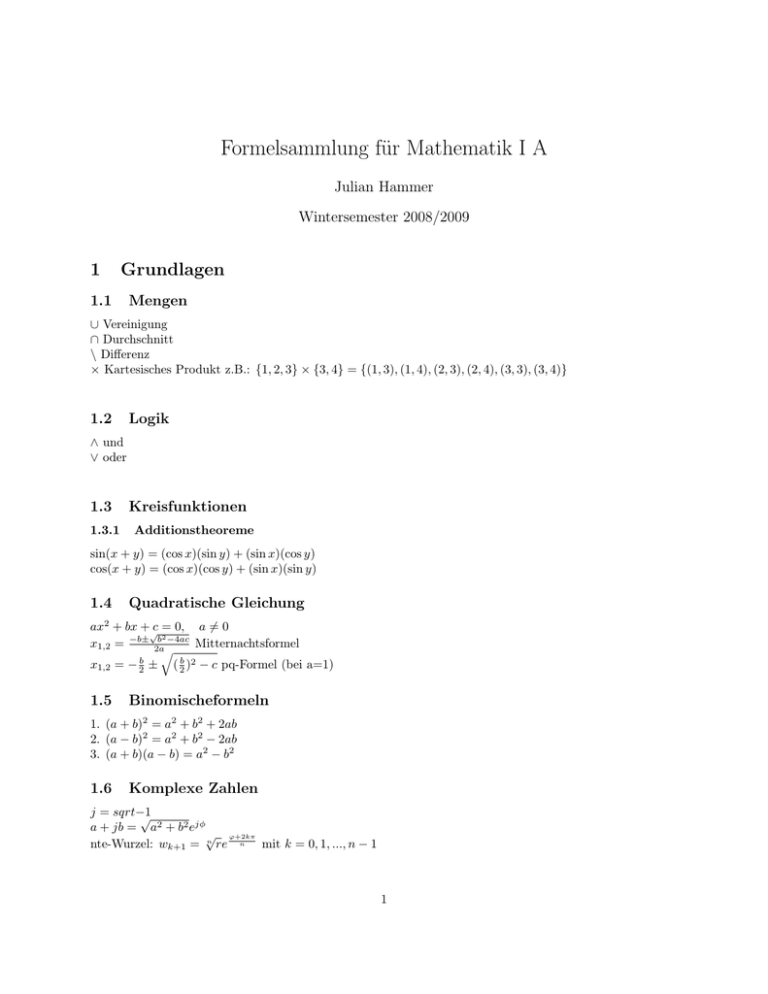

Formelsammlung für Mathematik I A

Werbung

Formelsammlung für Mathematik I A

Julian Hammer

Wintersemester 2008/2009

1

Grundlagen

1.1

Mengen

∪ Vereinigung

∩ Durchschnitt

\ Differenz

× Kartesisches Produkt z.B.: {1, 2, 3} × {3, 4} = {(1, 3), (1, 4), (2, 3), (2, 4), (3, 3), (3, 4)}

1.2

Logik

∧ und

∨ oder

1.3

1.3.1

Kreisfunktionen

Additionstheoreme

sin(x + y) = (cos x)(sin y) + (sin x)(cos y)

cos(x + y) = (cos x)(cos y) + (sin x)(sin y)

1.4

Quadratische Gleichung

2

ax + bx +√c = 0, a 6= 0

b2 −4ac

x1,2 = −b± 2a

Mitternachtsformel

q

b

b 2

x1,2 = − 2 ± ( 2 ) − c pq-Formel (bei a=1)

1.5

Binomischeformeln

1. (a + b)2 = a2 + b2 + 2ab

2. (a − b)2 = a2 + b2 − 2ab

3. (a + b)(a − b) = a2 − b2

1.6

Komplexe Zahlen

j = sqrt−1

√

a + jb = a2 + b2 ejφ

√ ϕ+2kπ

nte-Wurzel: wk+1 = n re n mit k = 0, 1, ..., n − 1

1

2

2.1

Linearealgebra

Untervektorräume

(i) ~u, ~v ∈ U ⇒ ~u + ~v ∈ U

(ii) ~u ∈ U, λ ∈ R ⇒ λ~u ∈ U

2.2

Beträge

k~xk1 = |x

p1 | + |x2 | + ... + |xn | p

k~xk2 = x21 + x22 + ... + x2n = hx, xi

k~xk∞ = max(|x1 | + |x2 | + ... + |xn |)

2.3

Skalarprodukt

h~a, ~bi = a1 b1 + a2 b2 + ... + an bn

h~a, ~bi = a1 b1 + a2 b2 + ... + an bn Im Komplexen!

~

cos(~a, ~b) = h~a,bi

k~

ak2 k~bk2

h~a, ~bi = 0 Orthogsonalität

2.4

Determinante

Nur bei quadratischen Matrizen (n × n)!

det(αA) = αn det(A)

1

det(A−1 ) = det(A)

det(AB) = det A det B

2.5

Bild & Kern

Kern(Φ): Φ(~x) = 0

Bild(Φ): Linearunabhänige Vektoren von Φ

2.6

LR

LR = A

A~x = ~b ⇒ LR~x = ~b ⇒ L(R~x) = ~b

2.7

Eigenwerte & -vektoren

1

Eigenwert(A−1 ) = Eigenwert(A)

Eigenwert(An ) = Eigenwert(A)n

Eigenwert(A) = Eigenwert(A> )

Eigenwert(nA) = nEigenwert(A)

Eigenwert(A + 2A) = Eigenwert(A) + Eigenwert(2A)

2.8

Diagonalisierbarkeit

Sicher Diagonalisierbar, wenn: Keine doppelten Eigenwerte, Symetrisch oder Hermiteisch

Bei doppelten Eigenwerten, muss für jeden Eigenwert ein anderer Eigenvektor existieren.

2

2.9

Ausgleichsrechnung

Ax = b ⇒ A> Ax = A> b

2.10

h~

x,~

yi

h~

x,~

xi

Orthogonalprojektion

· ~y , von ~x in ~y

2.11

Matrixeigenschaften

Regulär: det(A) 6= 0

Orthogonal Matrix: A · A> = E

Symmetrische Matrix: A> = A, Eigenvektoren sind Orthogonal

Hermitesche Matrix: A = A>∗ , Eigenvektoren sind Orthogonal, diagonalisierbar

Positiv definite Matrix: Eig(A) > 0

2.12

Rechenregelen für Matrizen

(A · B) · C = A · (B · C)

(A + B) · C = A · C + B · C

(A + B)> = A> + B >

(c · A)> = c · A>

(A> )> = A

(A · B)> = B > · A>

(A−1 )> = (A> )−1

3