Formelsammlung Statistik 1 Deskriptive Statistik

Werbung

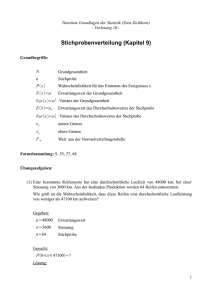

Fachbereich Grundlagenwissenschaften

Prof. Dr. Viola Weiÿ

Formelsammlung Statistik

1

Deskriptive Statistik

1.1 Eindimensionale Häugkeitsverteilungen

Merkmal:

X

Datenmenge (Stichprobe) vom Umfang

x(1) , x(2) , ..., x(n)

geordnete Stichprobe:

Ausprägungen von

X

n ∈ N: x1 , x2 , ..., xn

(falls

X

mit

x(1) ≤ x(2) ≤ ... ≤ x(n)

nicht stetiges Merkmal):

a1 , a2 , ..., am

mit

m∈N

1.1.1 Häugkeiten

Absolute Häugkeit:

H(ai )

i = 1, ..., m

für

Anzahl des Vorkommens der Ausprägung ai vom Merkmal X in der Stichprobe.

0 ≤ H(ai ) ≤ n

Es gilt:

für alle Ausprägungen

H(a1 ) + H(a2 ) + ... + H(am ) = n

Relative Häugkeit:

h(ai ) =

1

n

H(ai )

ai

.

für

i = 1, ..., m

Anteil des Vorkommens der Ausprägung ai vom Merkmal X in der Stichprobe.

0 ≤ h(ai ) ≤ 1

Es gilt:

für alle Ausprägungen

h(a1 ) + h(a2 ) + ... + h(am ) = 1

ai

.

1.1.2 Summenhäugkeiten (kumulative Häugkeiten)

Voraussetzung: Die Ausprägungen vom Merkmal

... < am

X

lassen sich der Gröÿe nach ordnen, d.h.

a1 < a2 <

.

Absolute Summenhäugkeit:

S(ai ) = H(a1 ) + H(a2 ) + ... + H(ai )

i

X

X

=

H(ak ) =

H(ak )

für

i = 1, ..., m.

ak ≤ai

k=1

Anzahl des Vorkommens aller Ausprägungen vom Merkmal X in der Stichprobe, die kleiner oder gleich

sind.

ai

Es gilt:

0 ≤ S(a1 ) ≤ S(a2 ) ≤ ... ≤ S(am ) = n.

Relative Summenhäugkeit:

s(ai ) = n1 S(ai ) = h(a1 ) + h(a2 ) + ... + h(ai )

=

i

X

h(ak ) =

X

h(ak )

für

i = 1, ..., m.

ak ≤ai

k=1

Anteil des Vorkommens aller Ausprägungen vom Merkmal X in der Stichprobe, die kleiner oder gleich

sind.

ai

Es gilt:

0 ≤ s(a1 ) ≤ s(a2 ) ≤ ... ≤ s(am ) = 1.

1

1.1.3 Empirische Verteilungsfunktion

F : R −→ [0, 1]

F (x) =

X

mit

h(ai ) =

ai ≤x

0

x < a1

s(a1 )

a1 ≤ x < a2

s(a2 )

a2 ≤ x < a3

:

:

s(am−1 ) am−1 ≤ x < am

1

am ≤ x

Eigenschaften der empirischen Verteilungsfunktion:

•

•

•

•

•

Treppenfunktion

monoton wachsend

a1 , ..., am

h(ai ), i = 1, ..., m

Sprungstellen (Unstetigkeitsstellen): Merkmalsausprägungen

Sprunghöhe an Sprungstelle

ai :

relative Häugkeit

rechtsseitig stetig

1.1.4 Mittelwerte

1.

Modalwert: xD

Ausprägung vom Merkmal X mit gröÿter vorkommender Häugkeit in der Stichprobe.

(xD muÿ nicht eindeutig bestimmt sein.)

2.

Median (Zentralwert): xZ

Wert in der Mitte der geordneten Stichprobe, d.h.

(

xZ =

x( n+1 )

1

2

n ungerade

2

x( n2 ) + x( n2 +1)

n gerade

(xZ muÿ nicht mit einem Wert der Stichprobe übereinstimmen.)

3.

arithmetisches Mittel:

x

n

x =

1

1X

(x1 + x2 + ... + xn ) =

xi

n

n

i=1

=

m

m

X

1X

H(ai ) · ai =

h(ai ) · ai

n

i=1

4.

geometrisches Mittel:

xG =

falls alle

x1 · ... · xn =

q

n

H(a )

H(a )

h(a )

m)

a1 1 · ... · am m = a1 1 · ... · ah(a

,

m

lg xG = n1 (lg x1 + ... + lg xn )

harmonisches Mittel:

xH =

Es gilt:

xG

xi , ai > 0.

Äquivalente Formel:

5.

√

n

i=1

1

x1

xH

n

+ ... +

1

xn

=

n

H(a1 )

a1

+ ... +

xH ≤ xG ≤ x .

2

H(am )

am

=

1

h(a1 )

a1

+ ... +

h(am )

am

1.1.5 Quantile

α

α ∈ (0, 1): xα

- Quantil für

Aufteilung der geordneten Stichprobe bezüglich α·100%, d.h. mindestens α·100% der Daten sind kleiner

oder gleich xα und mindestens (1 − α) · 100%

der Daten sindgröÿer oder gleich xα .

(

Berechnungsvorschrift für

[αn]

xα :

1

2

xα =

bedeutet ganzzahliger Anteil von

x(αn) + x(αn+1)

αn ganzzahling

x([αn]+1)

αn,

z.B.

αn nicht ganzzahlig

[5, 61] = 5.

x0.5 = xZ .

x0.25 , x0.5 , x0.75 heiÿen Quartile.

x0.75 − x0.25 heiÿt Quartilsabstand.

Es gilt:

1.1.6 Streuungsmaÿe

1.

Spannweite:

2.

mittlere absolute Abweichung von einem Mittelwert:

w = max{x1 , ..., xn } − min{x1 , ..., xn } = x(n) − x(1)

n

1X

|xi − x|

n

i=1

n

1X

=

|xi − xZ |

n

dx =

dxZ

mittlere absolute Abweichung vom arithmetischen Mittel

mittlere absolute Abweichung vom Zentralwert

i=1

analoge Formeln mit absoluten oder relativen Häugkeiten, z.B.:

dxZ

3.

m

m

i=1

i=1

X

1X

=

|ai − xZ | · H(ai ) =

|ai − xZ | · h(ai )

n

Varianz und Standardabweichung:

s2 mittlere quadratische Abweichung vom arithmetischen Mittel:

n

m

m

1 X

1 X

n X

s2 =

(xi − x)2 =

(ai − x)2 · H(ai ) =

(ai − x)2 · h(ai )

n−1

n−1

n−1

i=1

i=1

i=1

v

u

n

X

√

u 1

Standardabweichung: s =

s2 = t

(xi − x)2

n−1

Varianz

i=1

andere Berechnungsvorschrift für

4.

Variationskoezient:

v=

s

x

s2 :

falls

1

s2 =

n−1

n

X

!

x2i

2

− n(x)

i=1

x 6= 0.

1.1.7 Klassierte Daten

n) in disjunkte Klassen K1 , ..., Km mit Klassenmitten

∗

∗

x1 , ..., xm und absoluten bzw. relativen Klassenhäugkeiten der i-ten Klasse H(Ki ), h(Ki ), i = 1, ..., m.

m

m

X

1X ∗

Dann gilt: x =

xi · H(Ki ) =

x∗i · h(Ki )

n

i=1

i=1

Klasseneinteilung der Daten (Stichprobenumfang

m

s2 =

m

1 X ∗

n X ∗

(xi − x)2 · H(Ki ) =

(xi − x)2 · h(Ki )

n−1

n−1

i=1

i=1

∗

Andere Formeln analog mit xi als Repräsentant für die i-te Klasse

3

Ki , i = 1, ..., m.

1.2 Zweidimensionale Häugkeitsverteilungen

a1 , ..., ap , p ∈ N

Merkmal

mit Ausprägungen b1 , ..., bq , q ∈ N

Datenmenge (x1 , y1 ), ..., (xn , yn ), n ∈ N

Merkmal

X

Y

mit Ausprägungen

1.2.1 Häugkeiten, bedingte Häugkeiten, Unabhängigkeit

Häugkeiten:

Absolute Häugkeit:

H(ai , bj )

Anzahl

i = 1, ..., p, j = 1, ..., q

des Vorkommens von (ai , bj )

für

h(ai , bj ) =

Relative Häugkeit:

Absolute Randhäugkeit für

Relative Randhäugkeit für

Absolute Randhäugkeit für

Relative Randhäugkeit für

1

n H(ai , bj ) für

in der Stichprobe.

i = 1, ..., p, j = 1, ..., q

X : H(ai ) = H(ai , b1 ) + ... + H(ai , bq )

X:

h(ai ) =

1

n H(ai )

Y:

h(bj ) =

Randverteilung von

X : H(a1 ), ..., H(ap )

Randverteilung von

Y : H(b1 ), ..., H(bq )

bzw.

bzw.

i = 1, ..., p

= h(ai , b1 ) + ... + h(ai , bq )

Y : H(bj ) = H(a1 , bj ) + ... + H(ap , bj )

1

n H(bj )

für

für

für

i = 1, ..., p

j = 1, ..., q

= h(a1 , bj ) + ... + h(ap , bj )

für

j = 1, ..., q

h(a1 ), ..., h(ap )

h(b1 ), ..., h(bq )

Darstellung: Kontingenztabelle

b1

...

bq

Zeilensumme

a1

a2

H(a1 , b1 )

H(a2 , b1 )

...

H(a1 , bq )

H(a2 , bq )

H(a1 )

H(a2 )

.

.

.

.

.

.

.

.

.

.

.

.

ap

H(ap , b1 )

H(b1 )

H(ap , bq )

H(bq )

H(ap )

n

Y

X

Spaltensumme

...

...

...

Bedingte Häugkeiten:

h(ai | bj ) =

H(ai , bj )

h(ai , bj )

=

H(bj )

h(bj )

i = 1, ..., p, j = 1, ..., q

und

H(bj ) 6= 0

Relative Häugkeit für das Auftreten der Ausprägung ai unter der Bedingung, daÿ Y die Ausprägung

bj annimmt.

h(bj | ai ) =

H(ai , bj )

h(ai , bj )

=

H(ai )

h(ai )

i = 1, ..., p, j = 1, ..., q

und

H(ai ) 6= 0

Relative Häugkeit für das Auftreten der Ausprägung bj unter der Bedingung, daÿ X die Ausprägung

ai annimmt.

Empirische Unabhängigkeit von zwei Merkmalen:

alle i = 1, ..., p und j = 1, ..., q

1

H(ai , bj ) = H(ai ) · H(bj ) bzw. h(ai , bj ) = h(ai ) · h(bj ) .

n

Zwei Merkmale heiÿen empirisch unabhängig, wenn für

4

gilt:

1.2.2 Zusammenhangsmaÿe

1.

Kontingenzkoezient nach Pearson (für nominale Merkmale X

s

C=

2

χ =

χ2

+n

Y ):

mit

χ2

p X

q

X

(H(ai , bj ) − Ĥ(ai , bj ))2

Ĥ(ai , bj ) = n1 H(ai ) · H(bj ) .

und

Ĥ(ai , bj )

i=1 j=1

und

Es gilt:

• X ,Y

•

empirisch unabhängig

Je stärker die Abhängigkeit von

s

• 0≤C≤

•

X

Ckorr

und

Y

.

ist, desto gröÿer ist

C.

min(p, q) − 1

<1

min(p, q)

Korrigierter Kontingenzkoezient:

Für

2.

⇐⇒ χ2 = 0 ⇐⇒ C = 0

gilt

Ckorr

C

=

Cmax

s

mit

Cmax =

min(p, q) − 1

min(p, q)

.

0 ≤ Ckorr ≤ 1.

Korrelationskoezient nach Pearson (für metrische Merkmale X

Maÿzahl für die Stärke des linearen Zusammenhangs von X und Y :

und

Y ):

n

P

rXY

(xi − x)(yi − y)

Cov(X, Y )

i=1

s

=

=s

sX · sY

n

n

P

P

(xi − x)2 ·

(yi − y)2

i=1

i=1

n

1

1 X

(xi − x)(yi − y) =

Cov(X, Y ) =

n−1

n−1

n

X

i=1

X

empirische Kovarianz der Merkmale

sX

,

sY

Standardabweichung von

mit

X

und

Y

bzw.

Y

!

xi yi − nx y

i=1

und

Es gilt:

• −1 ≤ rXY ≤ 1

• X ,Y

•

empirisch unabhängig

Umkehrung gilt nicht, d.h.

• rXY > 0:

Je gröÿer

rXY ,

=⇒ Cov(X, Y ) = 0 =⇒ rXY = 0

rXY = 0 6=⇒ X, Y

.

empirisch unabhängig.

desto stärker ist der lineare Zusammenhang zwischen

lineare Zusammenhang hat positiven Anstieg, wachsende Werte für

wachsende Werte für

(Analog für

3.

X

dann hat der lineare Zusammenhang negativen Anstieg.)

Rangkorrelationskoezient nach Spearman (für ordinale Merkmale X

6

rSP = 1 −

Ri

Ri0

n

P

und

(Ri − Ri0 )2

i=1

(n − 1)n(n + 1)

Positionsnummer von

Positionsnummer von

mit

xi in der geordneten Stichprobe x(1) ≤ ... ≤ x(n)

yi in der geordneten Stichprobe y(1) ≤ ... ≤ y(n)

5

Der

bedeuten ebenfalls

Y.

rXY < 0,

X, Y .

und

Y ):

Es gilt:

• −1 ≤ rSP ≤ 1

• rSP > 0:

rSP , desto stärker ist der Zusammenhang zwischen X, Y , wobei zu

Ri von X auch wachsende Rangzahlen Ri0 von Y gehören.

< 0, dann gehören zu wachsenden Rangzahlen Ri von X fallende Rang-

Je gröÿer

wachsenden Rangzahlen

rSP

0

zahlen Ri von Y .)

(Analog für

1.2.3 Regressionsanalyse

Hinweis: Das

P

- Zeichen steht in allen Formeln für

n

P

.

i=1

1.

Gerade (y-x Regression):

P

a =

b =

2.

n

P

P

P

P

P

y x2i − x (xi yi )

x2i · yi − xi · (xi yi )

P 2

P 2

=

n xi − ( xi )

(n − 1)s2X

P

P

P

(xi yi ) − xi · yi

Cov(X, Y )

P 2

P 2

=

n xi − ( xi )

s2X

Gerade (x-y Regression):

a0

b0

P

=

=

n

P

P

P

(xi yi ) − xi · yi

Cov(X, Y )

P 2

P 2

=

n yi − ( yi )

s2Y

y -x

Verwendete Formeln:

Parabel:

a, b

P

4.

und

c

yi

P

x i yi

P

x2i yi

b =

und

Regressionsfunktionen schneiden sich im Punkt

P

xi und y = n1

yi

P

1 P

1

(xi − x)2 und s2Y = n−1

(yi − y)2

s2X = n−1

1 P

Cov(X, Y ) = n−1

(xi − x)(yi − y)

x=

1

n

x-y

P

ŷ = a + bx + cx2

sind Lösung des linearen Gleichungssystems:

P

P

= a·n

+ b · xi + c · x2i

P

P

P

= a · xi + b · x2i + c · x3i

P

P

P

= a · x2i + b · x3i + c · x4i

Potenzfunktion:

log a =

x̂ = a0 + b0 y

P

P

P

P

P

x yi2 − y (xi yi )

yi2 · xi − yi · (xi yi )

P

P

=

n yi2 − ( yi )2

(n − 1)s2Y

Es gilt: Die linearen

3.

ŷ = a + bx

ŷ = a · xb

P

P

P

P

(log xi )2 · log yi − log xi · (log xi · log yi )

P

P

n (log xi )2 − ( log xi )2

n

P

P

P

(log xi · log yi ) − log xi · log yi

P

P

n (log xi )2 − ( log xi )2

6

(x, y).

5.

Exponentialfunktion:

P

log a =

n

log b =

6.

x2i ·

P

a =

b =

n

,

b>0

P

P

log yi − xi · (xi · log yi )

P

P

n x2i − ( xi )2

P

P

P

(xi · log yi ) − xi · log yi

P

P

n x2i − ( xi )2

Logistische Funktion:

P

ŷ = a · bx

x2i ·

P

ŷ =

k

1 + ea+bx

b<0

,

mit bekannter Sättigungsgrenze

k

P

P

ln( yki − 1) − xi · (xi · ln( yki − 1))

P

P

n x2i − ( xi )2

P

P

P

(xi · ln( yki − 1)) − xi · ln( yki − 1)

P

P

n x2i − ( xi )2

Bestimmtheitsmaÿ:

n

P

B=

(ŷi − y)2

i=1

n

P

mit

ŷi = f (xi )

für die Regressionsfunktion

f.

(yi − y)2

i=1

Bei dieser Denition von

B

muÿ die Regressionsfunktion

f

von einem der oben genannten Funktions-

typen sein (linear in den Regressionsparametern).

Es gilt:

• 0≤B≤1

• B

beschreibt den Anteil der Varianz der Stichprobe, der durch die gewählte Regressionsfunkti-

on erklärt wird. D.h. je gröÿer

B

ist, umso besser ist der gewählte Funktionstyp geeignet zur

Beschreibung des Zusammenhangs von

•

Bei linearer Regression gilt

X

und

Y.

2 .

B = rXY

1.3 Zeitreihen

X , Beobachtungszeitpunkte t1 , ..., tn

Stichprobe (t1 , x1 ), ..., (tn , xn )

Komponenten einer Zeitreihe:

Trend T

Metrisches Merkmal

konjunkturelle Komponente

Saisonkomponente

Restkomponente

vereinfachte Modelle:

K

S

R

additives Modell

multiplikatives Modell

X =T +S

X =T ·S

7

1.3.1 Methoden der Trendermittlung

1.

Regression

Formeln siehe Regressionsanalyse bei zweidimensionalen Häugkeitsverteilungen, z.B.

Gerade:

x̂ = a + bt

P

P

P

t2i · xi − ti · (ti xi )

P

P

n t2i − ( ti )2

P

P

P

n (ti xi ) − ti · xi

P

P

n t2i − ( ti )2

P

a =

b =

Hinweise: Auf Transformation der Zeitpunkte achten!

Das

P

- Zeichen steht in allen Formeln für

n

P

.

i=1

2.

Glättung durch gleitende Durchschnitte

Ordnung: Anzahl benachbarter Werte der Zeitreihe, aus denen das arithmetische

Mittel gebildet wird.

•

ungerade Ordnung, d.h. j = 3, 5, 7, ...:

1

j (x1

1

j (x2

+ ... + xj )

+ ... + xj+1 )

.

.

.

1

j (xn−j+1

+ ... + xn )

n Werten der

n − j + 1 Werte.

Aus

•

j

noch

j

noch

gerade Ordnung, d.h. j = 2, 4, 6, ...:

1 1

j ( 2 x1

1 1

j ( 2 x2

+ x2 + ... + xj + 21 xj+1 )

+ x3 + ... + xj+1 + 12 xj+2 )

.

.

.

1 1

j ( 2 xn−j

+ xn−j+1 + ... + xn−1 + 12 xn )

n Werten

n − j Werte.

Aus

3.

Zeitreihe ergeben sich nach dem Glätten mit ungerader Ordnung

der Zeitreihe ergeben sich nach dem Glätten mit gerader Ordnung

Exponentielles Glätten

Exponentielles Glätten 1. Ordnung mit Startwert

x̃t = αxt−1 + (1 − α)x̃t−1

und Glättungsfaktor

t = 2, ..., n

x̃1 = x1 .

Auswirkung des Glättungsfaktors α:

α dicht bei 1 =⇒ starke Brücksichtigung jüngerer Werte der Zeitreihe,

α dicht bei 0 =⇒ starke Brücksichtigung älterer Werte der Zeitreihe.

∗

Erstellung kurzfristiger Prognosen: x = x̃n+1 = αxn + (1 − α)x̃n

Wahl des Startwertes

x̃1

für

x̃1

z.B.

8

α ∈ (0, 1):

1.3.2 Ermittlung der Saisonkomponente

Ausgangspunkt:

Zeitreihe mit periodischen saisonalen Einüssen

Gegeben:

Beobachtungswerte von

Bezeichnungen:

X

P

für

Perioden mit je

k

Unterzeiträumen

z.B.

P

xp,j

j -ten Unterzeitraum in der p-ten Periode,

j = 1, ..., k

Trendwert für den j -ten Unterzeitraum in der p-ten Periode,

p = 1, ..., P , j = 1, ..., k (ermittelt z.B. durch Regression)

Jahre mit je 12 Monaten oder je 4 Quartalen

Beobachtungswert für den

p = 1, ..., P

x̂p,j

Saisonkomponente sp,j

für den

,

j -ten

Unterzeitraum in der

für additives Modell:

sp,j = xp,j − x̂p,j

für multiplikatives Modell:

sp,j =

mittlere Saisonkomponente sj

sj =

Prognosewert x∗P +1,j

1

P (s1,j

für den

xp,j

x̂p,j

für den

p-ten

Periode,

p = 1, ..., P

,

.

j -ten

Unterzeitraum,

j = 1, ..., k :

+ ... + sP,j )

j -ten

Unterzeitraum in Periode

für additives Modell:

x∗P +1,j = x̂P +1,j + sj

für multiplikatives Modell:

x∗P +1,j = x̂P +1,j · sj

9

,

.

P + 1, j = 1, ..., k :

,

j = 1, ..., k :

1.4 Indexzahlen

Hinweis: Das

P

- Zeichen steht in allen Formeln für

n

P

. Dabei bezeichnet

n die Anzahl der betrachteten

i=1

Güter.

Index nach

Preisindex

P

ILA;t

0 ,t

LASPEYRES

P

ILO;t

0 ,t

LOWE

IFP;t0 ,t =

FISHER

(0)

qi

(t)

qi

(0)

pi

(t)

pi

=P

(t) (0)

pi qi

M

ILA;t

0 ,t

(0) (0)

pi qi

P (t) (t)

pi qi

IPPA;t0 ,t = P (0)

(t)

pi qi

PAASCHE

Dabei bedeuten für

P

Mengenindex

P

=P

P

=P

(t) (0)

qi pi

(0) (0)

qi p i

P (t) (t)

qi pi

IPMA;t0 ,t = P (0)

(t)

qi pi

(t)

p i qi

M

ILO;t

0 ,t

(0)

p i qi

q

P

ILA;t

· IPPA;t0 ,t

0 ,t

IFM;t0 ,t =

P

=P

(t)

qi p i

(0)

qi p i

q

M

ILA;t

· IPMA;t0 ,t

0 ,t

i = 1, ..., n

:

Menge des Gutes

i

in der Basisperiode

:

Menge des Gutes

i

in der Berichtsperiode

:

Preis des Gutes

i

in der Basisperiode

:

Preis des Gutes

i

in der Berichtsperiode

Hinweis zu den Gröÿen

qi

und

pi

t0 ,

t,

t0 ,

t.

in den Formeln von LOWE,

i = 1, ..., n:

t

qi =

1 X (k)

qi

t+1

(arithmetisches Mittel der Werte der Perioden 0 bis t),

k=0

t

pi =

1 X (k)

pi

t+1

(arithmetisches Mittel der Werte der Perioden 0 bis t).

k=0

10

2

Wahrscheinlichkeitsrechnung

2.1 Zufällige Ereignisse und Wahrscheinlichkeiten

Zufallsexperiment: Experiment, dessen mögliche Versuchsausgänge bekannt sind, dessen konkretes Ergebnis aber nicht vorhersagbar ist.

Grundraum

Ω:

Menge aller möglichen Versuchsausgänge eines Zufallsexperiments.

A:

Zufälliges Ereignis

Teilmenge vom Grundraum, d.h.

A

Das zufällige Ereignis

suchsausgang

ω

A

zu

sicheres Ereignis:

gehört, d.h.

{ω},

Elementarereignis:

Ω,

A ⊆ Ω.

tritt ein bei Durchführung des Zufallsexperimentes, wenn der konkrete Ver-

ω ∈ A.

einelementige Teilmenge von

Ω, {ω} ⊆ Ω,

tritt immer ein bei Durchführung des Zufallsexperimentes,

unmögliches Ereignis:

∅,

Ω ⊆ Ω,

tritt nie ein bei Durchführung des Zufallsexperimentes,

∅ ⊆ Ω.

Zufällige Ereignisse sind Mengen!

Übertragung von Operationen für Mengen auf zufällige Ereignisse:

A⊆B

A

zieht B nach sich, d.h.,

A

wenn

C =A∪B

eintritt, dann tritt auch

C

C = A1 ∪ ... ∪ An

D = A1 ∩ ... ∩ An

Dierenz der Ereignisse, d.h.

E

tritt genau dann ein, wenn

eingetreten sind.

A

B nicht eintritt.

A \ B 6= B \ A.

eintritt und

komplementäres Ereignis (Gegenereignis), d.h.

A

tritt genau dann ein, wenn

A∪A=Ω

A∩A=∅

,

A∪B =A∩B

,

A\B =A∩B

,

,

Zwei Ereignisse

A

und

B

A∩B =A∪B

heiÿen

A

(A) = A

(A ∪ B) ∩ C = (A ∩ C) ∪ (B ∩ C)

d.h.

A, B

.

Die Dierenz ist nicht kommutativ, d.h.

Es gilt:

eintritt.

.

tritt genau dann ein, wenn beide Ereignisse

Analog für

A=Ω\A

A, B

Produkt der Ereignisse A und B , d.h.

D

E =A\B

ein.

tritt genau dann ein, wenn mindestens eins der Ereignisse

Analog für

D =A∩B

B

Summe der Ereignisse A und B , d.h.

,

nicht eintritt.

,

,

(A ∩ B) ∪ C = (A ∪ C) ∩ (B ∪ C)

.

disjunkt (unvereinbar), wenn sie nicht gleichzeitig eintreten können,

A ∩ B = ∅.

Das Mengensystem

1.

Ω∈F

F

heiÿt

Ereignisfeld zum Grundraum Ω, wenn gilt:

.

2. Wenn

A ∈ F =⇒ A ∈ F

3. Wenn

A, B ∈ F =⇒ A ∪ B ∈ F

.

. (Wenn

A1 , A2 , ... ∈ F =⇒

∞

S

Ai ∈ F)

.

i=1

1.

Klassische Denition der Wahrscheinlichkeit (Laplace):

Voraussetzungen Laplace-Prinzip:

•

•

Endlicher Grundraum Ω = {ω1 , ..., ωn } bestehend aus n möglichen Versuchsausgängen und

alle Versuchsausgänge sind gleichberechtigt hinsichtlich der Chance ihres Eintretens bei

Durchführung des Zufallsexperimentes.

Dann gilt für

k≤n

und

A = {ωi1 , ..., ωik } ⊆ Ω

11

P (A) =

k

=

n

Anzahl günstiger Fälle für das Eintreten von

A

Anzahl aller möglichen Fälle

P ({ω1 }) = ... = P ({ωn }) =

Damit gilt für die Elementarereignisse:

.

1

n .

Anwendung: Urnenmodell

N

Aus einer Urne mit

Kugeln

k

Kugeln, wobei

M

der Kugeln weiÿ und

ohne Zurücklegen gezogen, M ≤ N , n ≤ N . Es sei Ak

weiÿe Kugeln gezogen werden,

k≤n

und

P (Ak ) =

2.

M

k

schwarz sind, werden

n

Dann gilt:

N −M

·

n−k

N

n

.

Statistische Denition der Wahrscheinlichkeit (von Mises):

n

m

hn (A) =

m

n

Anzahl der Durchführungen eines Zufallsexperimentes,

Anzahl des Eintretens eines zufälligen Ereignisses

relative Häugkeit für das Eintreten von

Statistische Wahrscheinlichkeit für

3.

k ≤ M.

N −M

das zufällige Ereignis, daÿ genau

A:

A, m ≤ n ,

A.

P (A) = lim hn (A)

n→∞

.

Axiomatische Denition der Wahrscheinlichkeit (Kolmogorov):

Für einen Grundraum

eine reelle Zahl

P (A)

Ω mit Ereignisfeld F

zuordnet,

heiÿt die Funktion

Wahrscheinlichkeit (Wahrscheinlichkeitsmaÿ), wenn gilt:

Axiom 1:

0 ≤ P (A) ≤ 1

Axiom 2:

P (Ω) = 1

Axiom 3:

Für A, B ∈ F mit A ∩ B = ∅ gilt

P (A ∪ B) = P (A) + P (B) (Additivität).

Axiom 3a:

Für

Das Tripel

P : F −→ [0, 1], die jedem A ∈ F

für alle

A∈F

.

.

A1 , A2 , ... ∈ F mit Ai ∩ Aj = ∅ für alle i 6= j gilt

P (A1 ∪ A2 ∪ ...) = P (A1 ) + P (A2 ) + ... (σ -Additivität).

[Ω, F, P ]

heiÿt

Wahrscheinlichkeitsraum.

Aus den Axiomen werden weitere Eigenschaften von

P

abgeleitet:

1.

P (∅) = 0

2.

P (A) = 1 − P (A)

für alle

3.

P (A) ≤ P (B)

A, B ∈ F

4.

P (B \ A) = P (B) − P (A ∩ B) für alle A, B ∈ F und

P (B \ A) = P (B) − P (A) für A, B ∈ F mit A ⊆ B ,

5.

P (A ∪ B) = P (A) + P (B) − P (A ∩ B)

6.

P (A) = P ({ωi1 }) + ... + P ({ωik })

,

für

A∈F

mit

,

A⊆B

für

,

für alle

A∈F

mit

A, B ∈ F

,

A = {ωi1 , ..., ωik }

Bedingte Wahrscheinlichkeit:

Es sei

[Ω, F, P ]

ein Wahrscheinlichkeitsraum und

A, B ∈ F

seien zwei zufällige Ereignisse mit

0.

Dann ist die bedingte Wahrscheinlichkeit des Eintretens von

12

A

unter der Bedingung

B

P (B) >

P (A|B) =

gegeben durch

P (A ∩ B)

P (B)

.

Multiplikationssatz:

Für zwei Ereignisse

A, B

gilt:

P (A ∩ B) = P (A|B) · P (B) = P (B|A) · P (A)

Für

n

Ereignisse

A1 , ..., An

.

gilt:

P (A1 ∩ ... ∩ An ) = P (A1 ) · P (A2 |A1 ) · P (A3 |A1 ∩ A2 ) · ... · P (An |A1 ∩ ...An−1 )

.

Unabhängigkeit von zufälligen Ereignissen:

Zwei Ereignisse

A, B

heiÿen stochastisch unabhängig, wenn gilt

P (A ∩ B) = P (A) · P (B)

.

A1 , ..., An heiÿen vollständig unabhängig,

Ai1 , ...Aik , 2 ≤ k ≤ n, i1 , ..., ik ∈ {1, ..., n} gilt

Die Ereignisse

Ereignissen

P (Ai1 ∩ ... ∩ Aik ) = P (Ai1 ) · ... · P (Aik )

wenn für jede Teilmenge bestehend aus

.

Formel der totalen Wahrscheinlichkeit:

A1 , ..., An ein vollständiges

A1 ∪ ... ∪ An = Ω,

Es sei

Ai ∩ Aj = ∅

P (Ai ) > 0

für alle

für alle

System zufälliger Ereignisse, d.h.

i, j ∈ {1, ..., n}

mit

i 6= j

und

i = 1, ..., n.

Dann gilt für das Ereignis

B∈F

P (B) = P (B|A1 ) · P (A1 ) + ... + P (B|An ) · P (An )

.

Formel von Bayes:

Unter obigen Voraussetzungen gilt für

P (Ai |B) =

B∈F

mit

P (B) > 0

und für

P (B|Ai ) · P (Ai )

P (B|Ai ) · P (Ai )

= Pn

P (B)

k=1 P (B|Ak ) · P (Ak )

i = 1, ..., n

.

2.2 Zufallsgröÿen und ihre Verteilungen

X : Ω −→ R ist eine Funktion, die jedem

ω ∈ Ω eine reelle Zahl X(ω) zuordnet.

−1 ((−∞, t]) ∈ F .)

für alle t ∈ R gelten X

Zufallsgröÿe: Eine Zufallsgröÿe

Versuchsausgang

(Auÿerdem muÿ

Verteilungsfunktion: Für eine Zufallsgröÿe

FX (x) = P (X ≤ x)

X

heiÿt die Funktion

FX : R −→ [0, 1]

Verteilungsfunktion der Zufallsgröÿe

13

mit

X.

k

Die Verteilungsfunktion

•

FX

lim FX (x) = 0 ,

lim FX (x) = 1 .

x→∞

x→−∞

• FX

• FX

hat folgende Eigenschaften:

ist monoton wachsend.

ist rechtsseitig stetig.

Umgekehrt ist jede Funktion mit diesen Eigenschaften Verteilungsfunktion einer Zufallsgröÿe.

2.2.1 Diskrete Zufallsgröÿen

X

Eine Zufallsgröÿe

heiÿt

diskret,

endlich viele Realisierungen

wenn

x1 , x2 , ...

X

endlich viele Realisierungen

x1 , ..., xn

oder abzählbar un-

hat.

Verteilung von X :

P (X = x1 ) = p1 , ... , P (X = xn ) = pn mit p1 + ... + pn = 1 bzw.

P (X = x1 ) = p1 , P (X = x2 ) = p2 , .... mit p1 + p2 + ... = 1

Verteilungsfunktion von X :

FX (x) = P (X ≤ x) =

X

pk

k:xk ≤x

Die Verteilungsfunktion einer diskreten Zufallsgröÿe ist eine Treppenfunktion mit Sprungstellen

und Sprunghöhe

pk

an Sprungstelle

Erwartungswert EX

EX =

n

X

von

xk

für

k = 1, ..., n

bzw.

k = 1, 2, ...

X:

xk · P (X = xk ) =

k=1

n

X

xk · pk

EX =

bzw.

k=1

(EX existiert, wenn

∞

X

|xk | · pk < ∞.)

∞

X

xk · P (X = xk ) =

k=1

∞

X

xk · p k

k=1

Varianz (Streuung) Var(X ) von X :

k=1

Var(X) = E(X − EX)2 =

n

n

X

X

(xk − EX)2 · P (X = xk ) =

(xk − EX)2 · pk

k=1

Andere Berechnungsvorschrift:

Var(X) =

k=1

n

X

x2k · pk − (EX)2 .

k=1

Analoge Formeln, wenn

Standardabweichung:

X

abzählbar unendlich viele Werte annehmen kann.

p

Var(X)

2.2.2 Stetige Zufallsgröÿen

Eine Zufallsgröÿe

X

heiÿt

stetig, falls sich die Verteilungsfunktion FX

Zx

FX (x) =

fX (t)dt

−∞

wobei

fX

eine reellwertige nichtnegative Funktion ist.

Man nennt dann

fX

Dichte der Zufallsgröÿe X .

14

,

schreiben läÿt als:

x1 , x2 , ...

Die Dichte

fX

hat folgende Eigenschaften:

Z∞

•

fX (t)dt = 1

−∞

• FX0 (x) = fX (x) für

• Für x1 < x2 gilt:

x

alle Stetigkeitsstellen

von

FX .

Zx2

P (x1 < X ≤ x2 ) = P (X ≤ x2 ) − P (X ≤ x1 ) = FX (x2 ) − FX (x1 ) =

Erwartungswert EX

x1

Z∞

von

x · fX (x)dx

EX =

X:

fX (t)dt

−∞

Z∞

Varianz Var(X ) von X:

Var(X) =

(x − EX)2 · fX (x)dx

−∞

Z∞

|x| · fX (x)dx < ∞.)

(Erwartungswert und Varianz existieren, falls

−∞

Standardabweichung:

Quantile xq

von

p

Var(X)

X:

Für eine stetige Zufallsgröÿe

heiÿt die reelle Zahl

xq

X

mit Verteilungsfunktion

FX

und Dichte

Quantil der Ordnung q (q-Quantil), wenn gilt:

fX

und für

q

Zxq

FX (xq ) = P (X ≤ xq ) =

fX (t)dt = q

.

−∞

Für

q = 0.5

heiÿt das 0.5-Quantil

x0.5

Median von X .

Eigenschaften von Erwartungswert und Varianz diskreter und stetiger Zufallsgröÿen:

Für zwei Zufallsgröÿen

X, Y

E(aX + b) = aEX + b

Var(aX + b) =

und reelle Zahlen

a, b ∈ R

gilt:

,

a2 Var(X)

,

E(X + Y ) = EX + EY .

Für zwei unabhängige Zufallsgröÿen

X, Y

gilt auÿerdem:

E(X · Y ) = EX · EY ,

Var(X + Y ) = Var(X) + Var(Y ) .

2.2.3 Spezielle diskrete Zufallsgröÿen

1.

Diskrete Gleichverteilung auf x1 , ..., xn

P (X = x1 ) = ... = P (X = xn ) =

Erwartungswert:

Varianz:

1

n

EX = n1 (x1 + ... + xn )

Var(X) = n1 (x21 + ... + x2n ) −

15

1

(x1

n2

+ ... + xn )2

mit

0<q<1

2.

Hypergeometrische Verteilung

Parameter

M, N, n ∈ N

M ≤ N und n ≤ N

M

N −M

·

k

n−k

P (X = k) =

N

n

mit

EX = n ·

Varianz:

Var(X) = n · M

N · (1 −

X ∼ H(N ; M ; n)

Modell: Aus einer Urne mit

nach dem Laplace-Prinzip

mit

k = 0, 1, ..., n

k ≤ M und k ≥ n + M − N

M

N

Erwartungswert:

Schreibweise:

für

N

M

N)

· (1 −

Kugeln, von denen

n−1

N −1 )

M

weiÿ und

N −M

schwarz sind, werden

n Kugeln entnommen (ohne Zurücklegen). Die Zufallsgröÿe X , die die

Anzahl entnommener weiÿer Kugeln zählt, ist hypergeometrisch verteilt.

3.

Binomialverteilung

Parameter

n∈N

und

p ∈ [0, 1]

P (X = k) =

Erwartungswert:

n

k

pk (1 − p)n−k

für

k = 0, 1, ..., n

EX = n · p

Varianz:

Var(X) = n · p · (1 − p)

Schreibweise:

X ∼ B(n; p)

Modell: Ein zufälliges Ereignis

A

tritt mit Wahrscheinlichkeit

experiments ein. Dieses Experiment wird

gungen durchgeführt. Die Zufallsgröÿe

X,

n

p

bei Durchführung eines Zufalls-

mal unabhängig voneinander unter gleichen Bedin-

die zählt, wie oft das Ereignis

A

eintritt, ist binomial-

verteilt.

Dieses Modell entspricht dem Urnenmodell und Ziehen von Kugeln

mit Zurücklegen.

Zusammenhang Binomialverteilung - hypergeometrische Verteilung:

Für

n≤

M

10 und

n≤

N −M

kann man die Binomialverteilung mit

10

p=

M

N als Näherung für die

hypergeometrische Verteilung verwenden.

4.

Poisson-Verteilung

Parameter

λ>0

P (X = k) =

Erwartungswert:

λk −λ

·e

k!

für

k = 0, 1, ...

EX = λ

Varianz:

Var(X) = λ

Schreibweise:

X ∼ Π(λ)

Anwendung: Man betrachtet Ereignisse, die unabhängig voneinander eintreten, z.B Telefonanrufe

in einer Zentrale, zerfallende Atomkerne einer radioaktiven Substanz, Verkehrsunfälle an einer

X,

die

n und kleines p (Faustregel: n ≥ 100, n · p ≤ 9) kann man die Poisson-Verteilung

λ = n · p als Näherung für die Binomialverteilung verwenden.

mit

Kreuzung. Im Mittel treten

λ

solcher Ereignisse in einem Zeitraum ein. Die Zufallsgröÿe

die Anzahl eintretender Ereignisse zählt, ist poisson-verteilt.

Zusammenhang Binomialverteilung - Poissonverteilung:

Für groÿes

Parameter

16

5.

Geometrische Verteilung

Parameter

p ∈ (0, 1)

P (X = k) = (1 − p)k−1 · p

EX =

Erwartungswert:

k = 1, 2, ...

1

p

Var(X) =

Varianz:

für

Modell: Ein zufälliges Ereignis

1−p

p2

A

tritt mit Wahrscheinlichkeit

experiments ein. Die Zufallsgröÿe

X,

p

bei Durchführung eines Zufalls-

die die Versuche bis zum ersten Eintreten von

A

zählt, ist

geometrisch verteilt.

2.2.4 Spezielle stetige Zufallsgröÿen

1.

Stetige Gleichverteilung im Intervall [a, b]

Dichte

fX (x):

fX (x) =

EX =

2.

a≤x<b

0

x−a

FX (x) =

b−a

1

x<a

a≤x<b

b≤x

a+b

2

Var(X) =

Varianz:

x < a oder b ≤ x

0

1

b−a

FX (x):

Verteilungsfunktion

Erwartungswert:

(b−a)2

12

Normalverteilung

Parameter

Dichte

µ∈R

fX (x):

Erwartungswert:

und

σ>0

(x−µ)2

1

fX (x) = √ · e− 2σ2

σ 2π

EX = µ

Var(X) = σ 2

Varianz:

X ∼ N (µ, σ)

Schreibweise:

Standardabweichung:

oder

Die zugehörige Verteilungsfunktion

Wichtiger Spezialfall:

N (0, 1)

heiÿt

µ=0

und

X∼

σ

N (µ, σ 2 )

FX (x) = Φµ,σ2 (x)

kann nicht explizit angegeben werden.

σ 2 = 1.

Standardnormalverteilung.

Die Verteilungsfunktion

Φ0,1

der Standardnormalverteilung ist in tabellarischer Form gegeben

(siehe Kapitel 4).

Es gilt folgender Zusammenhang:

Φµ,σ2 (x) = Φ0,1

Für die Standardnormalverteilung gilt:

x−µ

σ

.

Φ0,1 (−x) = 1 − Φ0,1 (x)

17

für alle

x∈R

.

Berechnung von Wahrscheinlichkeiten für

X ∼ N (µ, σ 2 ):

• P (X ≤ x) = Φµ,σ2 (x) = Φ0,1 ( x−µ

σ )

µ−x

• P (X ≥ x) = 1 − P (X ≤ x) = 1 − Φµ,σ2 (x) = 1 − Φ0,1 ( x−µ

σ ) = Φ0,1 ( σ )

• P (a ≤ X ≤ b) = P (X ≤ b) − P (X ≤ a) =

a−µ

= Φµ,σ2 (b) − Φµ,σ2 (a) = Φ0,1 ( b−µ

σ ) − Φ0,1 ( σ )

Anwendung: Eine Zufallsgröÿe

X,

die z.B. zufällige Meÿ- und Beobachtungsfehler oder zufällige

Gröÿen-, Längen-, Gewichtsangaben oder zufällige Abweichungen von einem Sollwert beschreibt,

ist normalverteilt.

3.

Exponentialverteilung

Parameter

a>0

Dichte

fX (x):

fX (x) =

0

ae−ax

x≤0

x>0

Verteilungsfunktion

Erwartungswert:

FX (x):

EX =

FX (x) =

0

1 − e−ax

x≤0

x>0

1

a

1

a2

Varianz:

Var(X) =

Schreibweise:

X ∼ exp(a)

Anwendung: Eine Zufallsgröÿe

X , die z.B. die Lebensdauer von Bauelementen oder die Bedienzeit

von Kunden oder Reparaturzeiten oder Zerfallszeiten radioaktiver Substanzen beschreibt, ist

exponentialverteilt.

18

3

Induktive Statistik

3.1 Parameterschätzungen

Mathematische Stichprobe:

(X1 , ...Xn )

unabhängig identisch verteilte Zufallsgröÿen

Konkrete Stichprobe:

(x1 , ..., xn ) ∈ Rn

Realisierungen der Zufallsgröÿen

Schätzfunktion:

T (X1 , ..., Xn )

(T (X1 , ..., Xn ) ist eine neue Zufallsgröÿe mit Wert

T (x1 , ..., xn ) bei konkreter Stichprobe (x1 , ..., xn ).)

(oder Stichprobenfunktion)

3.1.1 Punktschätzungen

Ziel: Schätzung eines unbekannten Parameters ϑ der Verteilung von X1 , ..., Xn

Stichprobenfunktion

T (X1 , ..., Xn ),

durch eine geeignete

die gewissen Gütekriterien (siehe Vorlesung, Literatur) genügt.

Spezielle Punktschätzer:

• Schätzung für den Erwartungswert der X1 , ..., Xn :

n

1X

X=

Xi

n

i=1

•

Schätzung für die

n

1 X

S =

(Xi − X)2

n−1

Varianz der X1 , ..., Xn :

2

i=1

•

Für

Xi 0-1-verteilt,

Schätzung für die

d.h.

P (Xi = 1) = p

Wahrscheinlichkeit

P (Xi = 0) = 1 − p für i = 1, ..., n

n

1X

P̂ =

p von Xi :

Xi

n

und

i=1

x, s2 , p̂ durch

2

Schätzfunktion X , S , P̂ .

Berechnung des konkreten Schätzwertes

Stichprobe in die jeweilige

Einsetzen der Werte

x1 , ..., xn

der konkreten

3.1.2 Intervallschätzungen

Ziel:

Bestimmen von Zufallsgröÿen

Parameter

ϑ

Gu (X1 , ..., Xn )

und

Go (X1 , ..., Xn ),

so daÿ für den unbekannten

gilt:

P (Gu (X1 , ..., Xn ) ≤ ϑ ≤ Go (X1 , ..., Xn )) = 1 − α , 0 < α < 1 .

Dann heiÿt:

[Gu ; Go ]

zweiseitiges Kondenzintervall

1−α

Kondenzniveau

α

Irrtumswahrscheinlichkeit

Mit einer Wahrscheinlichkeit von

Parameter

1−α

überdeckt das Kondenzintervall

[Gu ; Go ]

den unbekannten

ϑ.

Einseitige Kondenzintervalle:

(−∞ ; Go )

(Gu ; ∞)

mit

mit

P (ϑ ≤ Go (X1 , ..., Xn )) = 1 − α

P (ϑ ≥ Gu (X1 , ..., Xn )) = 1 − α

19

bzw.

Spezielle zweiseitige Kondenzintervalle:

für Stichprobenumfang

•

n

und Kondenzniveau

Kondenzintervall für den

σ2:

Erwartungswert µ einer Normalverteilung bei bekannter Varianz

X −z

Dabei ist

1

n

•

n

P

z1− α2

das

1−α

(1 − α2 )-Quantil

1− α

2

σ

σ

· √ ; X + z1− α2 · √

n

n

der Standardnormalverteilung (siehe Kapitel 4) und

Xi .

Kondenzintervall für den

σ2:

Erwartungswert µ einer Normalverteilung bei unbekannter Vari-

X − tn−1,1− α2

S

S

· √ ; X + tn−1,1− α2 · √

n

n

tn−1,1− α2 das (1 − α2 )-Quantil der t-Verteilung

n

n

P

1 P

X = n1

Xi und S 2 = n−1

(Xi − X)2 .

Dabei ist

4) und

i=1

mit

n−1

Freiheitsgraden (siehe Kapitel

p

einer

0-1-Verteilung

P (X = 1) = p, P (X = 0) = 1 − p):

s

P̂ − z1− α ·

2

Voraussetzung:

Dabei ist

n

P

i=1

Asymptotisches Kondenzintervall für die Wahrscheinlichkeit

(d.h.

1

n

X =

i=1

anz

•

z1− α2

np̂(1 − p̂) > 9

α

das (1 −

2 )-Quantil

P̂ (1 − P̂ )

; P̂ + z1− α2 ·

n

s

P̂ (1 − P̂ )

n

der Standardnormalverteilung (siehe Kapitel 4) und

P̂ =

Xi .

i=1

3.2 Parametertests

3.2.1 Schritte zur Durchführung eines Parametertests für einen unbekannten Parameter

ϑ

1. Aufstellen der

Nullhypothese H0 mit ϑ0 ∈ R

Zweiseitiger Test:

H0

ϑ = ϑ0

:

Alternativhypothese

Einseitiger Test:

H0

:

ϑ ≤ ϑ0

bzw.

Alternativhypothese

2. Wählen des

:

ϑ 6= ϑ0

H0

:

ϑ ≥ ϑ0

H1

:

ϑ > ϑ0

bzw.

ϑ < ϑ0

Signikanzniveaus 1 − α (α ∈ (0, 1) Irrtumswahrscheinlichkeit, Wahrscheinlich-

keit für das Ablehnen der Nullhypothese

3. Auswahl einer geeigneten

Parameter

H1

ϑ,

H0 ,

obwohl

H0

wahr ist)

Testgröÿe T (X1 , ..., Xn ) (Stichprobenfunktion) für den unbekannten

deren Verteilung unter

H0

bekannt ist.

20

4. Bestimmen von

cu , co

(in Abhängigkeit von

α)

mit

P (cu ≤ T ≤ co )H0 = 1 − α (zweiseitiger Test)

und damit Festlegung vom

Einseitiger Test:

c

mit

und kritischer Bereich

kritischen Bereich

P (T ≤ c)H0 = 1 − α

K = (c, ∞)

bzw.

5. Berechnung des Wertes der Testgröÿe

Testentscheidung:

t̂ ∈ K =⇒

H0

t̂ 6∈ K =⇒

gegen

K = (−∞, cu ) ∪ (co , ∞)

bzw.

P (T ≥ c)H0 = 1 − α

K = (−∞, c)

T (x1 , ..., xn ) = t̂ ∈ R

aus der konkreten Stichprobe.

wird abgelehnt.

H0

ist auf Grund dieser Stichprobe nichts einzuwenden.

Fehlerquellen:

Fehler 1. Art - Nullhypothese H0 wird abgelehnt, obwohl sie wahr ist.

Fehler 2. Art - Nullhypothese H0 wird nicht abgelehnt, obwohl sie falsch ist.

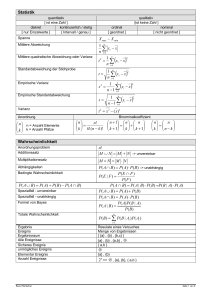

3.2.2 Spezielle Parametertests:

•

Erwartungswert µ einer normalverteilten Zufallsgröÿe bei bekannter Varianz σ2 (Gauÿ-Test)

Test für den unbekannten

Nullhypothese

Alternativ-

Testgröÿe

Kritischer Bereich

hypothese

H0 : µ = µ0

H1 : µ 6= µ0

T =

H0 : µ ≥ µ0

H1 : µ < µ0

T =

H0 : µ ≤ µ0

H1 : µ > µ0

T =

√

√

√

n·

X−µ0

σ

K = (−∞; −z1− α2 ) ∪ (z1− α2 ; ∞)

n·

X−µ0

σ

K = (−∞; −z1−α )

n·

X−µ0

σ

K = (z1−α ; ∞)

21

•

Erwartungswert

kannter Varianz σ2 (einfacher t-Test)

µ

Test für den unbekannten

Nullhypothese

Alternativ-

Testgröÿe

einer normalverteilten Zufallsgröÿe bei

Kritischer Bereich

hypothese

H0 : µ = µ0

H1 : µ 6= µ0

T =

H0 : µ ≥ µ0

H1 : µ < µ0

T =

H0 : µ ≤ µ0

H1 : µ > µ0

T =

•

√

√

√

n·

X−µ0

s

K = (−∞; −tn−1,1− α2 ) ∪ (tn−1,1− α2 ; ∞)

n·

X−µ0

s

K = (−∞; −tn−1,1−α )

n·

X−µ0

s

K = (tn−1,1−α ; ∞)

Test für die unbekannte Wahrscheinlichkeit

(Voraussetzung :

Nullhypothese

p

einer

0-1-Verteilung

np0 (1 − p0 ) > 9)

Alternativ-

Testgröÿe

Kritischer Bereich

hypothese

H0 : p = p0

H1 : p 6= p0

T =

q

n

p0 (1−p0 )

· (P̂ − p0 )

K = (−∞; −z1− α2 ) ∪ (z1− α2 ; ∞)

H0 : p ≥ p0

H1 : p < p0

T =

q

n

p0 (1−p0 )

· (P̂ − p0 )

K = (−∞; −z1−α )

H0 : p ≤ p0

H1 : p > p0

T =

q

n

p0 (1−p0 )

· (P̂ − p0 )

K = (z1−α ; ∞)

22

unbe-

4

Tabellen

4.1 Verteilungsfunktion der Standardnormalverteilung

1

Φ0,1 (x) = P (X ≤ x) = √

2π

Hinweise: Für

Für

x<0

ist

x > 3, 9

Zx

t2

e− 2 dt

−∞

Φ0,1 (x) = 1 − Φ0,1 (−x)

ist

Φ0,1 (x) = 1

zu verwenden.

zu setzen.

x

0,00

0,01

0,02

0,03

0,04

0,05

0,06

0,07

0,08

0,09

0,0

0,50000

0,50399

0,50798

0,51197

0,51595

0,51994

0,52392

0,52790

0,53188

0,53586

0,1

0,53983

0,54380

0,54776

0,55172

0,55567

0,55962

0,56356

0,56749

0,57142

0,57535

0,2

0,57926

0,58317

0,58706

0,59095

0,59483

0,59871

0,60257

0,60642

0,61026

0,61409

0,3

0,61791

0,62172

0,62552

0,62930

0,63307

0,63683

0,64058

0,64431

0,64803

0,65173

0,4

0,65542

0,65910

0,66276

0,66640

0,67003

0,67364

0,67724

0,68082

0,68439

0,68793

0,5

0,69146

0,69497

0,69847

0,70194

0,70540

0,70884

0,71226

0,71566

0,71904

0,72240

0,6

0,72575

0,72907

0,73237

0,73565

0,73891

0,74215

0,74537

0,74857

0,75175

0,75490

0,7

0,75804

0,76115

0,76424

0,76730

0,77035

0,77337

0,77637

0,77935

0,78230

0,78524

0,8

0,78814

0,79103

0,79389

0,79673

0,79955

0,80234

0,80511

0,80785

0,81057

0,81327

0,9

0,81594

0,81859

0,82121

0,82381

0,82639

0,82894

0,83147

0,83398

0,83646

0,83891

1,0

0,84134

0,84375

0,84614

0,84849

0,85083

0,85314

0,85543

0,85769

0,85993

0,86214

1,1

0,86433

0,86650

0,86864

0,87076

0,87286

0,87493

0,87698

0,87900

0,88100

0,88298

1,2

0,88493

0,88686

0,88877

0,89065

0,89251

0,89435

0,89617

0,89796

0,89973

0,90147

1,3

0,90320

0,90490

0,90658

0,90824

0,90988

0,91149

0,91308

0,91466

0,91621

0,91774

1,4

0,91924

0,92073

0,92220

0,92364

0,92507

0,92647

0,92785

0,92922

0,93056

0,93189

1,5

0,93319

0,93448

0,93574

0,93699

0,93822

0,93943

0,94062

0,94179

0,94295

0,94408

1,6

0,94520

0,94630

0,94738

0,94845

0,94950

0,95053

0,95154

0,95254

0,95352

0,95449

1,7

0,95543

0,95637

0,95728

0,95818

0,95907

0,95994

0,96080

0,96164

0,96246

0,96327

1,8

0,96407

0,96485

0,96562

0,96638

0,96712

0,96784

0,96856

0,96926

0,96995

0,97062

1,9

0,97128

0,97193

0,97257

0,97320

0,97381

0,97441

0,97500

0,97558

0,97615

0,97670

2,0

0,97725

0,97778

0,97831

0,97882

0,97932

0,97982

0,98030

0,98077

0,98124

0,98169

2,1

0,98214

0,98257

0,98300

0,98341

0,98382

0,98422

0,98461

0,98500

0,98537

0,98574

2,2

0,98610

0,98645

0,98679

0,98713

0,98745

0,98778

0,98809

0,98840

0,98870

0,98899

2,3

0,98928

0,98956

0,98983

0,99010

0,99036

0,99061

0,99086

0,99111

0,99134

0,99158

2,4

0,99180

0,99202

0,99224

0,99245

0,99266

0,99286

0,99305

0,99324

0,99343

0,99361

2,5

0,99379

0,99396

0,99413

0,99430

0,99446

0,99461

0,99477

0,99492

0,99506

0,99520

2,6

0,99534

0,99547

0,99560

0,99573

0,99585

0,99598

0,99609

0,99621

0,99632

0,99643

2,7

0,99653

0,99664

0,99674

0,99683

0,99693

0,99702

0,99711

0,99720

0,99728

0,99736

2,8

0,99744

0,99752

0,99760

0,99767

0,99774

0,99781

0,99788

0,99795

0,99801

0,99807

2,9

0,99813

0,99819

0,99825

0,99831

0,99836

0,99841

0,99846

0,99851

0,99856

0,99861

3,0

3,1

3,2

3,3

3,4

3,5

3,6

3,7

3,8

3,9

0,99865

0,99903

0,99931

0,99952

0,99966

0,99977

0,99984

0,99989

0,99993

0,99995

23

4.2 Quantile zq der Standardnormalverteilung

Hinweis: Für

q < 0, 5

ist

zq = −z1−q

zu verwenden.

q

zq

q

zq

q

zq

1,959964

0,5

0

0,91

1,340755

0,975

0,55

0,125661

0,92

1,405072

0,98

2,053749

0,6

0,253347

0,93

1,475791

0,985

2,170090

0,65

0,385320

0,94

1,554774

0,99

2,326348

0,7

0,524401

0,95

1,644854

0,995

2,575829

0,75

0,674490

0,955

1,695398

0,999

3,090232

0,8

0,841621

0,96

1,750686

0,9995

3,290527

0,85

1,036433

0,965

1,811911

0,9999

3,719016

0,9

1,281552

0,97

1,880794

4.3 Quantile tn,q der t-Verteilung (n - Zahl der Freiheitsgrade)

n

q = 0, 9

q = 0, 95

q = 0, 975

q = 0, 99

q = 0, 995

q = 0, 999

q = 0, 9995

1

3,08

6,31

12,71

31,82

63,66

318,31

636,62

2

1,89

2,92

4,30

6,96

9,92

22,33

31,60

3

1,64

2,35

3,18

4,54

5,84

10,21

12,92

4

1,53

2,13

2,78

3,75

4,60

7,17

8,61

5

1,48

2,02

2,57

3,36

4,03

5,89

6,87

6

1,44

1,94

2,45

3,14

3,71

5,21

5,96

7

1,41

1,89

2,36

3,00

3,50

4,79

5,41

8

1,40

1,86

2,31

2,90

3,36

4,50

5,04

9

1,38

1,83

2,26

2,82

3,25

4,30

4,78

10

1,37

1,81

2,23

2,76

3,17

4,14

4,59

11

1,36

1,80

2,20

2,72

3,11

4,02

4,44

12

1,36

1,78

2,18

2,68

3,05

3,93

4,32

13

1,35

1,77

2,16

2,65

3,01

3,85

4,22

14

1,35

1,76

2,14

2,62

2,98

3,79

4,14

15

1,34

1,75

2,13

2,60

2,95

3,73

4,07

16

1,34

1,75

2,12

2,58

2,92

3,69

4,01

17

1,33

1,74

2,11

2,57

2,90

3,65

3,97

18

1,33

1,73

2,10

2,55

2,88

3,61

3,92

19

1,33

1,73

2,09

2,54

2,86

3,58

3,88

20

1,33

1,72

2,09

2,53

2,85

3,55

3,85

21

1,32

1,72

2,08

2,52

2,83

3,53

3,82

22

1,32

1,72

2,07

2,51

2,82

3,50

3,79

23

1,32

1,71

2,07

2,50

2,81

3,48

3,77

24

1,32

1,71

2,06

2,49

2,80

3,47

3,75

25

1,32

1,71

2,06

2,49

2,79

3,45

3,73

26

1,31

1,71

2,06

2,48

2,78

3,43

3,71

27

1,31

1,70

2,05

2,47

2,77

3,42

3,69

28

1,31

1,70

2,05

2,47

2,76

3,41

3,67

29

1,31

1,70

2,05

2,46

2,76

3,40

3,66

30

1,31

1,70

2,04

2,46

2,75

3,39

3,65

40

1,30

1,68

2,02

2,42

2,70

3,31

3,55

50

1,30

1,68

2,01

2,40

2,68

3,26

3,50

100

1,29

1,66

1,98

2,36

2,63

3,17

3,39

500

1,28

1,65

1,96

2,33

2,59

3,11

3,31

1000

1,28

1,65

1,96

2,33

2,58

3,10

3,30

10000

1,28

1,65

1,96

2,33

2,58

3,09

3,29

24