Statistik - todesbahn.de

Werbung

Statistik

Dr. rer. nat. Jürgen Vogel

13. Februar 2005

Diese Seite bleibt für gewöhnlich weiß

Inhaltsverzeichnis

I

Deskriptive Statistik

7

1 Grundbegriffe

1.1 GrundgesamtheitGrundgesamtheit und Merkmale . . . . . . . . .

1.2 Ermittlung von Beobachtungswerten . . . . . . . . . . . . . . . .

1.3 Quellen wirtschaftsstatistischer Daten . . . . . . . . . . . . . . .

9

9

10

10

2 Häufigkeitsverteilungen

2.1 Prim. Häufigkeitstabelle . . . . . . . . . . . . .

2.2 Sekundäre Häufigkeitstabelle (Klassenbildung)

2.3 Grafische Darstellung von Häufigkeiten . . . . .

2.3.1 Für metrische Daten . . . . . . . . . . .

2.3.2 Für ordinale Daten . . . . . . . . . . . .

2.3.3 Für nominale Daten . . . . . . . . . . .

.

.

.

.

.

.

11

11

13

14

14

16

16

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

3 Statistische Maßzahlen

3.1 Lageparameter . . . . . . . . . . . . . . . . .

3.1.1 Arithmetisches Mittel . . . . . . . . .

3.1.2 Der empirische Median (Zentralwert) .

3.1.3 Modalwert (Modus) . . . . . . . . . .

3.1.4 Gewogenes arithmetisches Mittel . . .

3.1.5 Geometrisches Mittel . . . . . . . . . .

3.2 Streuungsmaße . . . . . . . . . . . . . . . . .

3.2.1 Empirische Varianz . . . . . . . . . . .

3.2.2 Quartilsabstand . . . . . . . . . . . .

3.3 Box-Whisker-Plot . . . . . . . . . . . . . . . .

3.4 Empirische Momente . . . . . . . . . . . . . .

3.4.1 Interpretation von Exzess und Schiefe

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

17

17

17

18

18

19

19

19

19

20

21

22

23

4 Indexzahlen

4.1 Empirische Indizes . . . . . . . .

4.2 Zusammengesetzte Indizes . . . .

4.2.1 Indexformeln . . . . . . .

4.3 Einige Indizes aus der Wirtschaft

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

27

27

27

28

29

. .

. .

. .

der

. . . .

. . . .

. . . .

BRD

.

.

.

.

5 Zusammenhänge zwischen Merkmalen

31

5.1 Der empirische Korrelationskoeffizient . . . . . . . . . . . . . . . 31

5.2 Der Rangkorrelationskoeffizient . . . . . . . . . . . . . . . . . . . 32

5.3 Kontingenzkoeffizient . . . . . . . . . . . . . . . . . . . . . . . . . 33

3

4

6 Lineare Regression

37

6.1 Einfache Lineare Regression . . . . . . . . . . . . . . . . . . . . . 37

6.2 Curvilineare Regression . . . . . . . . . . . . . . . . . . . . . . . 39

6.2.1 Weitere Beispiele für linear transformierbare Ansätze . . . 40

7 Wahrscheinlichkeitsrechnung

7.1 Zufällige Ereignisse . . . . . . . . . . . . . . . . . . . . . . .

7.1.1 Beziehungen zwischen Ereignissen und Operationen

Ereignissen . . . . . . . . . . . . . . . . . . . . . . .

7.2 Wahrscheinlichkeit . . . . . . . . . . . . . . . . . . . . . . .

7.2.1 Eigenschaften von Wahrscheinlichkeiten . . . . . . .

7.3 Wahrscheinlichkeitsverteilungen . . . . . . . . . . . . . . . .

7.4 Diskrete Verteilungen . . . . . . . . . . . . . . . . . . . . .

7.5 Stetige Verteilungen . . . . . . . . . . . . . . . . . . . . . .

7.6 Parameter von Verteilungen . . . . . . . . . . . . . . . . . .

7.6.1 Weitere Parameter . . . . . . . . . . . . . . . . . . .

7.7 Spezielle diskrete Verteilungen . . . . . . . . . . . . . . . .

7.7.1 Binomialverteilung . . . . . . . . . . . . . . . . . . .

7.7.2 Hypergeometrische Verteilung . . . . . . . . . . . . .

7.7.3 Poissonverteilung . . . . . . . . . . . . . . . . . . . .

7.8 Spezielle stetige Verteilungen . . . . . . . . . . . . . . . . .

7.8.1 Rechteckverteilung . . . . . . . . . . . . . . . . . . .

7.8.2 Normalverteilung . . . . . . . . . . . . . . . . . . . .

7.9 Grenzwertsätze . . . . . . . . . . . . . . . . . . . . . . . . .

7.9.1 Zentraler Grenzwertsatz . . . . . . . . . . . . . . . .

II

. . .

mit

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

Schliessende Statistik

8 Grundbegriffe der schl. Stat.

41

41

42

44

45

45

46

47

49

49

50

50

50

51

51

51

52

53

53

55

57

9 Wichtige Stichprobenfunktionen

59

9.1 Das Stichprobenmittel . . . . . . . . . . . . . . . . . . . . . . . . 59

9.2 Die Stichprobenvarianz . . . . . . . . . . . . . . . . . . . . . . . . 59

9.3 Die Verteilungen von X̄ und S 2 für normalverteiltes Merkmal . . 60

10 Punktschätzungen

63

10.1 Definition und Beispiele . . . . . . . . . . . . . . . . . . . . . . . 63

10.2 Wünschenswerte Eigenschaften . . . . . . . . . . . . . . . . . . . 63

11 Bereichsschätzungen

11.1 Definitionen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

11.2 Quantile von Prüfverteilungen . . . . . . . . . . . . . . . . . . . .

11.2.1 Standardnormalverteilung . . . . . . . . . . . . . . . . . .

11.2.2 t-Verteilung . . . . . . . . . . . . . . . . . . . . . . . . . .

11.2.3 χ2 -Verteilung . . . . . . . . . . . . . . . . . . . . . . . . .

11.3 Konfidenzintervalle für die Parameter eines normalverteilten Merkmals . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

11.3.1 Konfidenzintervall für µ . . . . . . . . . . . . . . . . . . .

11.3.2 Konfidenzintervall für σ 2 = D2 X . . . . . . . . . . . . . .

TU-Ilmenau: Statistik

67

67

68

68

69

70

71

71

72

5

11.3.3 Konfidenzintervall für σ = DX . . . . . . . . . . . . . . .

11.4 Konfidenzintervall für eine Wahrscheinlichkeit p . . . . . . . . . .

72

72

12 Signifikanztests

12.1 Grundbegriffe der Testtheorie . . . . . . . .

12.2 Paramtertests für normalverteiltes Merkmal

12.2.1 Herleitung des einfachen t-Tests . . .

12.2.2 Der χ2 -Streuungstest . . . . . . . . .

12.3 Test auf Wahrscheinlichkeit . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

75

75

76

76

77

78

13 Statistische Qualitätskontrolle

13.1 Kontrollkarten . . . . . . . . .

13.1.1 Die x̄-Karte . . . . . .

13.1.2 Die x̄/s Karte . . . . . .

13.1.3 Die p-Karte . . . . . . .

13.2 Stichprobenpläne . . . . . . . .

13.3 Kennwerte für OC-Funktionen

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

79

79

79

81

82

83

84

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

14 Anpassungstests

87

14.1 Der χ2 -Anpassungstest . . . . . . . . . . . . . . . . . . . . . . . . 87

14.2 Test auf Normalverteilung mittels Schiefe und Exzess . . . . . . . 88

15 Unabhängigkeit von Merkmalen

15.1 Zweidimensionale Verteilungen . . . . . .

15.2 Unabhängigkeit von Zufallsgrößen . . . .

15.3 Unkorreliertheit von Zufallsgrößen . . . .

15.4 Test auf Unabhängigkeit/Unkorreliertheit

15.5 χ2 -Unabhängigkeitstest . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

16 Stichprobenvergleiche

16.1 Der doppelte t-Test (Mittelwerttest)

16.2 Die F-Verteilung (R.A. Fisher) . . .

16.3 Der F-Test . . . . . . . . . . . . . .

16.4 Varianzanalyse . . . . . . . . . . . .

16.5 Der Vorzeichen-Test . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

97

. 97

. 98

. 99

. 100

. 102

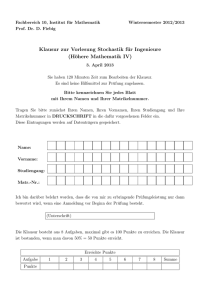

A Klausuraufgaben

A.1 Klausur Statistik 1

A.1.1 Aufgabe 1 .

A.1.2 Aufgabe 2 .

A.1.3 Aufgabe 3 .

A.1.4 Aufgabe 4 .

A.1.5 Aufgabe 5 .

A.2 Klausur Statistik 2

A.2.1 Aufgabe 1 .

A.2.2 Aufgabe 2 .

A.2.3 Aufgabe 3 .

A.2.4 Aufgabe 4 .

A.2.5 Aufgabe 5 .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

TU-Ilmenau: Statistik

91

91

92

93

93

94

105

105

105

106

107

107

108

109

109

109

110

111

111

Teil I

Deskriptive Statistik

7

Kapitel 1

Grundbegriffe

1.1

GrundgesamtheitGrundgesamtheit und Merkmale

Menge gleichartiger Objekte, an denen mindestens eine Eigenschaft untersucht

werden soll.

Merkmal: Diese Eigenschaft [Maßeinheit]

Ausprägungen: Werte, die das Merkmal annehmen kann

Die Elemente der Grundgesamtheit nennt man Untersuchungseinheiten oder

statistisches Element. Sie tragen die Information. Grundgesamtheit muss klar

definiert sein, also abgrenzen: sachlich, zeitlich, örtlich.

Beispiele

Studienwunsch von Abiturienten. Grundgesamtheit: Alle Schüler von 12.

Klassen in Thüringen im April 2004. Untersuchungseinheit: Schüler. Merkmal: 1. Studienwunsch. Ausprägungen: WI, WIW, Medizin, Jura, . . .

Altersstruktur der deutschen Bevölkerung. Grundgesamtheit: Deutsche

Bevölkerung am 31.12.2003 . Untersuchungseinheit: Einwohner Deutschlands. Merkmal: Lebensalter [Jahre]. Ausprägungen: 0,1,2, . . . , 120

Volkswirtschaftliche Daten der Länder. Grundgesamtheit: Alle Staaten,

die am 31.12.2003 der EU angehörten. Untersuchungseinheit: Staat. Merkmale:

– BIP [Mrd. ¿ ]. Ausprägungen: 23,1 . . . 2129,2

– Arbeitslosenquote [%]. Ausprägungen: 3,7 . . . 11,3

– Inflationsrate [%]. Ausprägungen: 1,0 . . . 4,0

Statistische Untersuchungen verlangen viele Untersuchungseinheiten, weil

statistische Gesätzmäßigkeiten erst bei Beteiligung vieler offenbar werden. Ursache: Gesetz der großen Zahlen.

9

10

Beispiel: Wurf einer Münze Grundgesamtheit: Alle Münzwürfe am 07.04.2004

in HS2. Untersuchungseinheit: Münzwurf. Merkmal: Oben liegende Seite. Ausprägungen: Zahl, Wappen.

Anzahl der Würfe

3

300

1000

10000

24000

davon Wappen

2

148

478

4984

12012

rel. Häufigkeit

0,6667

0,4933

0,4780

0,4984

0,5005

Gesetzmäßigkeit: Die Wahrscheinlichkeit, dass beim Wurf mit einer Münze

“Wappen” oben liegt beträgt 0,5. Die tatsächlich gemessenen oder beobachteten

Merkmalswerte nennt man Beobachtungswerte. Die 1. Auflistung solcher Werte

nennt man Urliste.

1.2

Ermittlung von Beobachtungswerten

Befragung (mündlich, schriftlich)

Beobachtung (z.B. Verkehrszählung)

Experiment (z.B. Intelligenztest)

Automatische Erfassung (z.B. Computer, Zählwerk)

Sekundärerhebung (z.B. Veröffentlichung, statistisches Jahrbuch)

Datenerfassung kann erfolgen als:

Vollerhebung (Grundgesamtheit prüfen) (z.B. Volkszählung)

Teilerhebung (z.B. Mikro-Zensus)

Die Teilerhebung ist die Voraussetzung für die schließende Statistik. Hier:

Beobachtungswerte = Stichprobe.

1.3

Quellen wirtschaftsstatistischer Daten

Amtliche Statistiken

– Statistische Jahrbücher (UN, EU, Bund, Länder, Städte)

– Zeitschrift “Wirtschaft & Statistik”

– Ressortstatistiken der Ministerien (z.B. Arbeitslosenstatistik von der

Bundesagentur für Arbeit)

Nicht amtliche Statistiken

– Betriebsstatistiken

– Statistiken von Wirtschaftsverbänden, Forschungsinstituten, Meinungsforschungsinstituten

TU-Ilmenau: Statistik

Kapitel 2

Häufigkeitsverteilungen

Bezeichnungen :

Merkmale:

X, Y, Z

Beobachtungswerte:

x1 , x2 , x3 , . . . , xn

y1 , y2 , y3 , . . . , ym

Beobachtungsumfang = Stichprobenumfang:

n

Anliegen :

Urliste meist unübersichtlich, Verteilung der Beobachtungswerte sichtbar machen.

Vorbereitender Schritt :

Eventuell: Ordnen der Beobachtungswerte der größe nach (ordinal Skala). Zurest

hat man die Urliste, nach der Ordnung eine Variationsreihe:

x(1) , x(2) , . . . , x(n)

mit

x(1) ≤ x(2) ≤ . . . ≤ x(n)

2.1

Prim. Häufigkeitstabelle

Sinvoll, wenn die meisten Ausprägungen in der Urliste mehrfach vorkommen.

Es seien:

X

ein Merkmal,

a1 , a2 , . . . , ak

die Ausprägungen von X,

x1 .x2 , . . . , xn

11

12

die Beobachtungswerte zu X, wobei gilt,

n>k

Beispiel 1 :

Abweichungen vom Sollmaß: (eine bestimmte Länge von Teilen aus der laufenden Produktion) [µm]

Urliste: 3, 2, −1, −2, 0, 1, 2, −1, 1, 0, 0, 0, 0, −4, 3, 1, −2, −1, −3, 4

n=20

Ausprägungen:

-4 -3 -2 -1

0

1

2

3

4

a1 a2 a3 a4 a5 a6 a7 a8 a9

Absolute Häufigkeit :

der Ausprägung aj (j = 1, 2, . . . , k).

hj = h(aj )

(2.1)

“Anzahl des Auftretens von aj in der Urliste”

Relative Häufigkeit :

der Ausprägung aj (j = 1, 2, . . . , k)

fj = f (aj ) =

h(aj )

n

(2.2)

Es gilt:

k

X

j=1

hj = n

;

k

X

fj = 1

(2.3)

j=1

Die Summe über alle Absoluten Häufigkeiten ist gleich dem Stichprobenumfang

und die Summe über alle Relativen Häufigkeiten ist 1.

Zum Beispiel 1 :

Häufigkeitstabelle in Minimalform

j aj hj Strichliste

fj

Summenhäufigkeit Hj

1 -4

1

1

0,05

1

2 -3

1

1

0,05

2

3 -2

2

2

0,10

4

4 -1

3

3

0,15

7

5 0

5

5

0,25

12

6 1

3

3

0,15

15

7 2

2

2

0,10

17

8 3

2

2

0,10

19

9 4

1

1

0,05

20

Kummulative Häufigkeit (Summenhäufigkeit) :

Absolut:

j

X

Hj =

hi

i=1

TU-Ilmenau: Statistik

Summenhäufigkeit Fj

0,05

0,10

0,20

0,35

0,60

0,75

0,85

0,95

1,0

(2.4)

13

Relativ:

Fj =

j

X

fj

(2.5)

i=1

In einer primären Häufigkeitstabelle ist die gesamte Information der Urliste noch

enthalten.

2.2

Sekundäre Häufigkeitstabelle (Klassenbildung)

Ziel: Informationsgehalt verdichten, um Gesetzmäßigkeiten besser sichtbar zu

machen.

Methode: Benachbarte oder ähnliche Ausprägungen werden zu Klassen zusammengefasst.

ae2 Mitte der 2.ten Klasse

aej Mitte der j.ten Klasse

hi absolute Häufigkeit der i.ten Klasse

fi relative Häufigkeit der i.ten Klasse

Sekundäre Häufigkeitstabelle :

Klasse

Mitte abs. Hfgk. rel. Hfgk.

(-4,5;-2,5)

-3,5

2

0,10

[-2,5;-0,5)

-1,5

5

0,25

[-0,5;1,5)

0,5

8

0,40

[1,5;4,5)

3,0

5

0,25

P

20

1,00

Regeln für das erstellen von sekundären Häufigkeits-Tabellen: Eigentlich nie weniger als 5 Klassen bilden. Eindeutige Klassenbezeichnungen wählen (genau in

die Mitte von 2 Werten gehen). Mitte in der Mitte lassen (Intervall). Möglichst

äquidistante Klasseneinteilungen wählen, da die Anzeige sonst verfälscht wird

(äquidistant bedeutet gleichbreite Klassen). In unserem Beispiel sind die Klassen 2 bzw. 3 µm breit. Offene Flügelklassen vermeiden. Die Anzahl der Klassen

hängt vom Stichprobenumfang ab. Anzahl m der Klassen:

n

m

50 . . . 200

5 . . . 12

200 . . . 1000

12

1000 . . .

10 . . . 20

Faustformel:

m = 1 + 1, 44 ∗ ln n

aej

-3,5

-1,5

0,5

3,0

hj

2

5

8

5

TU-Ilmenau: Statistik

(2.6)

14

2.3

Grafische Darstellung von Häufigkeiten

2.3.1

Für metrische Daten

1. Histogramm

Abweichungen vom Sollmaß

Beachte:

(a) Abzisse metrisch skalieren, nicht Klassen-Namen sondern die Abweichungen.

(b) Ordinate: absolute oder relative Häufigkeiten, Fußpunkt der Säulen

soll 0 sein, keine Lücken zwischen die Säulen, es sei denn, man möchte

die Häufigkeit 0 darstellen.

(c) Histogramm ermöglicht auch die Darstellung nicht äquidistanter Klassen. Dabei gilt:

i. Flächeninhalt ∼ Häufigkeit.

ii. Ordinate bedeutungslos.

iii. Da am Flächeninhalt ausgerichtet, mußman breitere oder kürzere

Klassen beachten und darf die Höhe nicht einfach blind eintragen

(Klasse 4 hat nur eine Höhe von 3,33)

TU-Ilmenau: Statistik

15

2. Häufigkeitspolygon

nur für äquidistante Klassen oder primäre Häufigkeitstabellen.

(a) Punkt ist über der Klassenmitte bzw. Ausprägung.

(b) Ordinate: Nullpunkt = Fußpunkt.

(c) Beide zusätzlichen Flügelklassen mit einzeichnen.

TU-Ilmenau: Statistik

16

2.3.2

Für ordinale Daten

1. Balkendiagramm

Die Balkenhöhe sollte der Häufigkeit entsprechen, Lücken müssen zwischen den Balken gezeichnet werden, sonst Verwechslung mit Histogramm

möglich.

Mitgliederzahlen in einem Verband:

2.3.3

Für nominale Daten

1. Balkendiagramm

2. Kreisdiagramm

(a) Winkel ∼ Häufigkeit

(b) ϕi =

hi

n

= 360◦

TU-Ilmenau: Statistik

Kapitel 3

Statistische Maßzahlen

3.1

3.1.1

Lageparameter

Arithmetisches Mittel

Für metrische Daten:

n

x̄ =

1X

xi

n i=1

(3.1)

Für gehäufte Daten:

k

x̄ =

1X

a j hj

n j=1

(3.2)

Für gruppierte Daten (sekundäres Häufigkeitsdiagramm):

m

x̄ =

Beispiel 1

1X

aej hj

n j=1

(3.3)

Abweichungen vom Sollmaß:

x̄ =

1

1

(3 + 2 − 1 − 2 − 0 + . . . + 4) =

∗ 3 = 0, 15µm

20

20

Die Abweichungen vom Sollmaß betragen im Mittel 0, 15µm. Oder: Die Teile

werden mit einem systematischen Fehler von 0, 15µm produziert. Zum Vergleich

x̄ aus der Klasseneinteilung.

x̄ =

1

1

(−3, 5 ∗ 2 − 1, 5 ∗ 5 + 0, 5 ∗ 3 + 3, 0 ∗ 5) =

∗ 4, 5 = 0, 225

20

20

Minimaleigenschaft des arithmetischen Mittels: Die mittlere quadratische Abweichung der Beobachtungswerte xi von einer reellen Zahl a:

n

X

1

=

(x − i − a)2

n

i=1

wird genau dann minimal, wenn a = x̄

17

(3.4)

18

3.1.2

Der empirische Median (Zentralwert)

x?1 , x?2 , . . . , x?n geordnete Stichprobe für ordinale Daten.

(

M ed =

x?n+1

2

falls n ungerade

1

?

2 (x n

2

?

+ x n +1 ) falls n gerade

(3.5)

2

Vereinfacht: Die Hälfte aller Beobachtungswerte ist kleiner als der Median, die

andere Hälfte ist größer.

Beispiel 2 7 zufällig ausgewählte Schüler

Merkmal X = Mathe-Note; Stichprobe: 2, 1, 2, 5, 3, 4, 3

Variationsreihe: 1 = x?1 , 2 = x?2 , 2 = x?3 , 3 = x?4 , 3 = x?5 , 4 = x?6 , 5 = x?7 ; n=7, also

ungerade

M ed = x?7+1 = x?4

2

Beispiel 1 Abweichungen vom Sollmaß

n=20, also gerade.

x? + x?11

0+0

M ed = 10

=

2

2

Minimaleigenschaft des Medians: Die mittlere absolute Abweichung der Beobachtungswerte von einer reellen Zahl a,

n

1X

| xi − a |

n i=1

wird minimal, wenn a der Median ist.

3.1.3

Modalwert (Modus)

Für nominale Daten. Der Modalwert befindet sich dort, wo das Histogramm

seinen Höhepunkt hat. Definition:

M od = aj mit hj ≥ hi für alle i = 1, 2, . . . , k

Wenn es nur einen Modalwert gibt, dann nennt man das Unimodal. Modalwert

ist die Ausprägung mit der größten Häufigkeit (entsprechend: modale Klasse).

Beispiel 1

Abweichungen vom Sollmaß

M od = 0

Beispiel 2

Mathe Noten

M od = 2 ∧ M od = 3

Modalwerte: 2 und 3.

TU-Ilmenau: Statistik

19

3.1.4

Gewogenes arithmetisches Mittel

Für metrische Daten. Beobachtungswerte sollen mit unterschiedlichen Gewichten in die Mittelwertbildung eingehen:

Pn

xi gi

x̄gew = Pi=1

(3.6)

n

i=1 gi

Beispiel :

3 Arbeiter am Fließband schaffen 450, 430 bzw. 500 Stück pro Stunde. Letzterer arbeitet 4h täglich, die beiden anderen jeweils 8h. welche durchschnittliche

Arbeitsleistung erbringen die 3 Arbeiter zusammen?

450 ∗ 8 + 430 ∗ 8 + 500 ∗ 4

= 452[Stueck/Stunde]

20

Wenn man nicht gewichtet hätte so ergäbe sich x̄ = 460.

x̄gew =

3.1.5

Geometrisches Mittel

Für metrische, positive Daten. Einleitendes Beispiel: Der Wert eines Warenkorbes wächst jährlich mit den Faktoren c1 , c2 , . . . , cn und erreicht nach n-Jahren

den Wert

r

√

Wn

Wn = W0 ∗c∗c∗c∗. . .∗c =⇒ cn = c1 ∗c2 ∗c3 ∗. . .∗cn =⇒ c = n c1 ∗ c2 ∗ . . . ∗ cn = n

W0

√

x̄geo = n x1 ∗ x2 ∗ . . . ∗ xn

(3.7)

xn > 0

Wachstumsrate im i.ten Jahr

ri := (ci − 1) ∗ 100%

r̄ = (c̄geo − 1) ∗ 100%

Es gilt: x̄geo ≤ x̄

Beispiel: Familie Müller verbraucht im 1. Jahr 6200 KWh Heizenergie, im 6.

Jahr 5055 KWh. Wie groß ist die mittlere Jährliche Wachstumsrate bei dieser

Heizenergie?

r

5 5055

c̄geo =

≈ 0, 96 ⇒ r̄ = (0, 96 − 1) ∗ 100 = −4%

6200

3.2

3.2.1

Streuungsmaße

Empirische Varianz

Für metrische Daten.

n

1 X

1

s =

(xi − x̄)2 =

n − 1 i=1

n−1

2

"Ã n

X

!

x2i

#

2

− n ∗ x̄

(3.8)

i=1

Für gruppierte metrische Daten:

s2 ≈

¢

1 X¡ 2

xi ∗ hi − x̄

n

TU-Ilmenau: Statistik

(3.9)

20

Mittlere Quadratische Abweichung der Beobachtungswerte vom arithmetischen Mittel . Bei gruppierten Daten:

m

1 X

f2

s ≈

(aej ∗ hj ) − n ∗ x

n − 1 j=1

2

(3.10)

Wobei aej die klassenmitte bezeichnet, und x

e die Näherung für x̄ aus der sekundären Häufigkeitstabelle.

Empirische Standardabweichung:

s=

√

s2

Variationskoeffizient (normierte Standardabweichung, sie dient zum Vergleich

von Streuungen auf verschiedenen Skalen):

v=

Beispiel 1

s

∗ 100%

x̄

Abweichungen vom Sollmaß

s2 =

¤

1 £

(3 − 0, 15)2 + . . . + (4 − 0, 15)2 ≈ 4, 24[µm]

19

p

s = 4, 24 ≈ 2, 06[µm]

Die Abweichungen vom Sollmaß schwanken mit der empirischen Varianz 4, 24µm2

um den Mittelwert. Aus der Klasseneinteilung ergibt sich:

s2 = 4, 30; s = 2, 07

3.2.2

Quartilsabstand

Für ordinale Daten. Man braucht hierzu die Variationsreihe x?1 , x?2 , . . . , x?n mit

x?1 ≤ x?2 ≤ . . . ≤ x?n . dxe bedeutet, x soll auf die nächste ganz Zahl aufgerundet

werden.

Unteres Quartil:

½1

x0,25 :=

?

2 (x n

4

n

xd 4 e

+ x?n +1 )

1

?

2 (x 3n

4

+ x?3n +1 ) falls n durch 4 teilbar

4

sonst

4

falls n durch 4 teilbar

sonst

(3.11)

Oberes Quartil:

(

x0,75 :=

xd 34 ne

(3.12)

Quartilsabstand:

= x0,75 − x0,25

d 75

25

TU-Ilmenau: Statistik

(3.13)

21

Beispiel 1 Abweichungen vom Sollmaß

Variationsreihe: (n = 20)

−4, −3, −2, −2, −1, −1, −1, 0, 0, 0, 0, 0, 1, 1, 1, 2, 2, 3, 3, 4

x0,25 =

1 ?

1

(x + x?6 ); x0,75 = (x?15 + x?16 )

2 5

2

x0,25 = −1; x0,75 = 1, 5

d = 1, 5 − (−1) = 2, 5

Beispiel 2 Mathe Noten

Variationsreihe: (n = 7)

1, 2, 2, 3, 3, 4, 5

x0,25 = x?2 = 2

x0,75 = x?6 = 4

d 75

=2

25

3.3

Box-Whisker-Plot

Für ordinale Daten. Grafische Darstellung von 5 Meßdaten: xmin , unteres Quartil, Median, oberes Quartil, xmax

Beispiel 1

Abweichungen vom Sollmaß

Bemerkungen:

Zum Box-Plot gehört eine Skala

Box-Plots sind besonders sinnvoll zum Vergleich mehrerer Häufigkeitsverteilungen

TU-Ilmenau: Statistik

22

Die Spannweite R = xmax − xmin = D wurde früher als Streungsmaß

benutzt

3.4

Empirische Momente

Für metrische Daten.

Anfangsmoment:

n

MA;k =

Zentralmoment:

1X k

x

n i=1 i

(3.14)

n

MZ;k =

1X

(xi − x̄)k

n i=1

(3.15)

k-ter Ordnung (k = 1, 2, 3, . . .). Schon benutzt: MA;1 = x̄ ; MZ;1 = 0 ; MZ;2 =

n−1 2

n s

Noch interessant: MZ;3 ; MZ;4

Empirische Schiefe:

Sch =

MZ;3

3

(MZ;2 ) 2

(3.16)

(−∞ < Sch < ∞)

Exzess (Wölbung):

Exz =

MZ;4

−3

(MZ;2 )2

(−3 < Exz < ∞)

TU-Ilmenau: Statistik

(3.17)

23

3.4.1

Interpretation von Exzess und Schiefe

Symmetrisch (Schiefe = 0):

Rechtsschief (Schiefe > 0) (linkssteil):

TU-Ilmenau: Statistik

24

Linksschief (Schiefe < 0) (rechtssteil):

Normal gewölbt

tisch):

(Exzess = 0) (Wölbung der Gaußschen Glocke) (mesokur-

TU-Ilmenau: Statistik

25

Spitz gewölbt (Exzess > 0) (leptokurtisch)

Flach gewölbt (Exzess < 0) (platykurtisch)

Schiefe und Exzess werden benötigt, um zu beurteilen, ob ein Merkmal normalverteilt sein kann.

TU-Ilmenau: Statistik

26

Beispiel 1

Abweichungen vom Sollmaß

20

MZ;2 =

1 X

(xi − x̄)2 = 4, 0275[µm]2

20 i=1

MZ;3 =

1 X

(xi − x̄)3 = −0, 466[µm]4

20 i=1

MZ;4 =

1 X

(xi − x̄)4 = 40, 985[µm]4

20 i=1

20

20

Sch =

Exz =

−0, 466

3

(4, 0275) 2

≈ −0, 06

40, 985

− 3 ≈ −0, 47

4, 02752

Die Häufigkeitsverteilung ist symmetrisch und leicht flach gewölbt.

TU-Ilmenau: Statistik

Kapitel 4

Indexzahlen

Index ist der Quotient zweier gleichartiger Maßzahlen, wobei der Nenner die

Basis repräsentiert.

4.1

Empirische Indizes

Gegeben sei eine Reihe von Beobachtungswerten xo , x1 , x2 , . . .

Wahl eines Basiszeitpunktes z.B. t = 0

I0T :=

xk

∗ 100%

x0

(4.1)

Liefert für t = 0, 1, 2, . . . eine folge einfacher Indizes I00 , I01 , . . ..

Beispiel Anzahl der Studierenden an deutschen Hochschulen im Wintersemester [Tsd.]

t Jahr Anzahl

Index I0t

Index I5t

0 1960

247

100 %

13,7 %

1 1970

422

170,9 %

23,5 %

2 1980

1036

419,4 %

57,6 %

3 1990

1719

696,0 %

95,6 %

4 1995

1858

752,2 %

103,3 %

5 2000

1799

728,3 %

100 %

Basis 1960 Basis 2000

Umbasieren von t = 0 auf t = k:

Ikt =

4.2

I0t

I0k

(4.2)

Zusammengesetzte Indizes

Beobachtungswerte werden zunächst gewichtet, bevor man sie ins Verhältnis

setzt. Wichtung kann fiktiv sein, z.B. Sterbeziffer der Stadt A, wenn sie die

Altersstruktur der Stadt B hätte. Für die Wirtschaft:

Preisindex

27

28

Mengenindex

Umsatzindex

Im Nenner: Basiszeitpunkt (-zeitraum): “BaZ”

Im Zähler: Berichtszeitpunkt (-zeitraum): “BeZ”

Beispiel Durchschnittlicher Verbrauch an Fleisch der privaten Haushalte und

die Fleischpreise einer Gemeinde in einem Monat:

Fleischsorte

Preis BaZ Preis BeZ Menge BaZ Menge BeZ

Rindfleisch (kochen)

3,8

3,5

1,45

1,41

Rindfleisch (braten)

6,0

6,2

1,31

1,04

Schweinefleisch

4,5

4,3

4,74

4,43

Preisindex:

P3

M engeBaZ ∗ P reisBeZ

I p = P3i=1

M

engeBaZ ∗ P reisBaZ

i=1

=

3, 5 ∗ 1, 45 + 6, 2 ∗ 1, 31 + 4, 3 ∗ 4, 74

≈ 96, 77%

3, 8 ∗ 1, 45 + 6, 0 ∗ 1, 31 + 4, 5 ∗ 4, 74

Der Fleischpreis ist im Mittel um 3,2 % gefallen.

Der Preisindex setzt die Preise von BeZ und BaZ ins Verhältnis. Die Verbrauchsmengen fungieren als Gewichte. Im Zähler und Nenner wird einheitlich gewichtet. Zum Baz: Laspeyres-Index, zum BeZ: Paasche-Index. Allgemein:

Von k Gütern seien für BaZ und BeZ die Mengen und die Preise bekannt.

Gut Preis BaZ Preis BeZ Menge BaZ Menge BeZ

1

p01

p11

q01

q11

2

p02

p12

q02

q12

..

..

..

..

..

.

.

.

.

.

k

p0k

p1k

q0k

q1k

4.2.1

Indexformeln

Umsatzindex:

Laspeyres :

Preisindex:

Mengenindex:

P

p1i ∗ q1i

I (u) = P

p0i ∗ q0i

(4.3)

P

p1i ∗ q0i

(p)

IL = P

p0i ∗ q0i

(4.4)

P

p0i ∗ q1i

(q)

IL = P

p0i ∗ q0i

(4.5)

TU-Ilmenau: Statistik

29

Paasche :

Preisindex:

(p)

IP

P

p1i ∗ q1i

=P

p0i ∗ q1i

(4.6)

(q)

IP

P

p1i ∗ q1i

=P

p1i ∗ q0i

(4.7)

Mengenindex:

Beispiel Fleischverbrauch

(p)

IL ≈ 96, 77%

(q)

IL ≈ 90, 87%

(p)

IP ≈ 96, 51%

(q)

IP ≈ 90, 63%

I (u) ≈ 87, 70%

4.3

Einige Indizes aus der Wirtschaft der BRD

Werden alle nach Laspeyres berechnet

1. Preisindex für die Lebenserhaltung. Es gibt 4 Stück:

Alle Private Haushalte

4 Personen (Arbeitnehmer) mit mittlerem Einkommen

4 Personen (Beamte) mit höherem Einkommen

2 Personen (Rentner / Sozialhilfeempfänger)

Warenkorb aus 750 Waren und Dienstleistungen, 400000 Preisreihen aus

100 Gemeinden, einfacher bis mittlerer Qualität.

2. Index der Einzelhandelspreise:

Verkaufspreise inkl. MwSt. des Einzelhandels, 600 Waren, auch Maschinen,

LKW, Büroeinrichtungen, keine Dienstleistungen.

3. Index der Großhandelsverkaufspreise

Verkaufspreise exkl. MwSt., 800 Waren, 7000 Preisreihen.

4. Produktionsindex für das produzierende Gewerbe

Index der kurzfristigen Wirtschaftsentwicklung, Mengenindex! Nettoproduktionsleistungen einzelner Wirtschaftszweige. → Gesamtindex mittels

Wichtung nach Bruttowertschöpfung.

5. Lohnindizes

Nominallohnindizes

– Index der tariflichen Stundenlöhne

– Index der Monatsgehälter

(Preisindizes)

TU-Ilmenau: Statistik

30

Reallohnindex= N ominallohnindex

P reisindex

6. Der Deutsche Aktienindex

Preisindex der 30 wichtigsten deutschen Aktien (blue-chips). Basis: 31.12.1987.

Aktienkapital alle 15 s berechnet durch die Deutsche Börse AG. Basis =

1000.

TU-Ilmenau: Statistik

Kapitel 5

Zusammenhänge zwischen

Merkmalen

X, Y seien zwei untereinander verbundene Merkmale. An jeder Untersuchungseinheit werden beide Merkmale beobachtet. Stichprobe (x1 , y1 ), (x2 , y2 ), . . . , (xn , yn )

(Beobachtungspaare)

Beispiel Nettosozialprodukt und Staatsverschuldung

Grundgesamtheit: Alle Staaten der Erde am 31.12.2003.

X Nettosozialprodukt im zurückliegenden Jahr.

Y Staatsverschuldung am 31.12.2003.

Gesucht wird eine Maßzahl für den Zusammenhang zwischen X und Y .

5.1

Der empirische Korrelationskoeffizient

X und Y sind metrisch skaliert. x̄, ȳ, sx , sy seien die empirischen Mittelwerte

und Standardabweichungen der x- bzw. y-Werte. Empirischer Korrelationskoeffizient von X und Y (Bravais/Pearson):

Pn

1

i=1 (xi − x̄) ∗ (yi − ȳ)

rxy = n−1

(5.1)

sx ∗ sy

oder:

rxy =

1

n−1

Pn

( i=1 (xi ∗ yi )) − n ∗ x̄ ∗ ȳ

sx ∗ sy

(5.2)

Eigenschaften des Korrelationskoeffizienten :

1. Es gilt −1 ≤ rxy ≤ 1

2. rxy = ryx

3. rxy misst den linearen Zusammenhang zwischen X und Y . rxy = 0 → kein

linearer Zusammenhang zwischen X und Y . rxy = ±1 → Alle Beobachtungspaare liegen auf einer Geraden. Somit bestünde direkter Zusammenhang.

31

32

2

4. rxy

gibt an, zu wieviel Prozent sich die Beziehung durch lineare Abhängigkeit erklären lassen.

Beispiel Niederschlag und Kornertrag

Jahr

xi

yi

x2i

yi2

xi ∗ yi

1981 30 403,6

900

162892,96 12108,0

1982 51 339,5 2601 115260,25 17314,5

1983 112 395,5 12544 156420,25

44296

1984 61 435,1 3721 189312,01 26541,1

1985 23 428,8

529

183869,44 9862,4

1986 113 396,9 12769 157529,61 44849,7

1987 64 444,5 4096 197580,25

28448

1988 15 406,1

225

164917,21 6091,5

1989 16 346,0

256

119716

5536

1990 33 335,9 1089 112828,81 11084,7

Das ergibt:

x̄ = 51, 8

ȳ = 393, 19

sx = 36, 35871

rxy =

=

sy = 39, 92080

Pn

i=1 xi ∗ yi − n ∗ x̄ ∗ ȳ

1

n−1

sx ∗ sy

1

9 [206131, 9

− 10 ∗ 51, 8 ∗ 393, 19]

≈ 0, 188

36, 36 ∗ 39, 92

Es besteht kein linearer Zusammenhang zwischen Regenmenge und Hektarertrag

(−1 und 1 würden Abhängigkeit bedeuten).

5.2

Der Rangkorrelationskoeffizient

Von Spearman für Ordinal skalierte Daten. Stichprobe mit Wertepaaren

Rangzahlen:

Rg(xi ) Position von xi in der geordneten x-Reihe.

Rg(yi ) Position von yi in der geordneten y-Reihe.

Der kleinste xi -Wert hat den Rang Rg(xi ) = 1, der größte xi Wert den Rang

n. Berechnet man den emp. Korrelationskoeffizienten mit den Rangzahlen statt

der Originalwerte (Rg(xi ) statt xi ) erhält man den Spearmanschen Rangkorrelationskoeffizienten.

Pn

n∗(n+1)2

i=1 Rg(xi ) ∗ Rg(yi ) −

4

ϕ̂ = q P

(5.3)

Pn

2

n

n(n+1)2

2

2 − n(n+1) )

( i=1 Rg(xi ) −

)

∗

(

Rg(y

)

i

i=1

4

4

TU-Ilmenau: Statistik

33

Beispiel Abhängigkeit vom Sitzplatz im Hörsaal zu der Klausurnote

X Entfernung zum Pult [m]

Y Punkte in der Statistik Arbeit

i

xi

yi

Rg(xi ) Rg(yi )

1

3,6

7,5

1,5

1

2

3,6

21

1,5

13

3

4,3

26

3,5

15

4

4,3

13

3,5

4

5

5,0 16,5

5,5

5,5

6

5,0 17,5

5,5

9,5

7

6,0

17

7

7,5

8

6,9

8

8

2

9 7,75 25,5

9,5

14

10 7,75

28

9,5

17

11 8,5 26,5

11

16

12 9,3

20

12,5

11,5

13 9,3

11

12,5

3

14 11,0 16,5

16,5

5,5

15 11,0

17

16,5

7,5

16 10,0

20

14,5

11,5

17 10,0 17,5

14,5

9,5

ϕ̂ = 0, 080(r = 0, 12)

Es besteht kein Zusammenhang zwischen Sitzplatz und Note.

Hinweise:

1. Kommen gleiche Ausprägungen mehrmals vor, so gibt man beiden den

gleichen Rang, und zwar den Mittelwert aus den in der Reihenfolge zu

vergebenden Rängen (Rang 12 und 13 haben die gleiche zugrunde liegende Ausprägung, so bekommen beide die 12,5; Rang 12, 13, 14 mit der

gleichen zugrunde liegenden Ausprägung würde bedeuten, alle bekommen

den Rang 13).

2. Sind keine mittleren Rangzahlen vergeben worden, vereinfacht sich die

Formel zu:

Pn

6 i=1 d2i

ϕ̂ = 1 −

n ∗ (n2 − 1)

wobei di = Rg(xi ) − Rg(yi ). Im Beispiel:

1−

6 ∗ 746

≈ 0, 086 ≈ ϕ̂

17 ∗ (172 − 1)

Ergebnis falsch, wir haben mittlere Rangzahlen.

5.3

Kontingenzkoeffizient

Für nominale Daten oder Klasseneinteilung.

TU-Ilmenau: Statistik

34

Beispiel Epidemie Untersuchung mit 120 Patienten

X Heilungserfolg

Y Behandlungsmethode

Kontingenztafel (2-dimensionale Häufigkeitsverteilung), Frage: git es einen

Zusammenhang?

X\Y

rein symptomatisch übliche Dosis doppelte Dosis

schnell geheilt

14

22

32

langsam geheilt

14

10

4

gestorben

16

8

0

Allgemein:

Merkmal X mit Ausprägungen: a1 , a2 , a3 , . . . , an

Merkmal Y mit Ausprägungen: b1 , b2 , b3 , . . . , bn

Stichprobe vom Umfang n (x1 , y1 ), (x2 , y2 ), . . .

hij : absolute Häufigkeiten der Ausprägung (ai bj ) in der Stichprobe.

Kontingenztafel:

X\Y

a1

a2

..

.

b1

h11

h21

..

.

b2

h12

h22

..

.

...

...

...

..

.

bl

h1l

h2l

..

.

ak

hk1

h·1

hk2

h·2

. . . hkl

. . . h·l

h1·

h2·

..

.

hk·

h·· = n

mit den Randhäufigkeiten:

h·j =

k

X

hij

i=1

hi· =

l

X

hij

j=1

h ∗h

Es bezeichnen eij := ·jn i· die Erwartungshäufigkeiten. Würde man alle hij

durch eij ersetzen erhält man eine Kontingenztafel mit den selben Randsummen die den Fall “X und Y sind unabhängig” repräsentiert. Große Unterschiede

zwischen hij und eij bedeuten Abhängigkeit zwischen X und Y . Um eine Kontingenztafel zu konstruieren, die völlige Unabhängigkeit der Merkmale zeigen

soll, kann man folgenden Ansatz verwenden:

hij = eij =

hi· ∗ h·j

n

Die Stichproben Funktion :

Pearsonsches Chi-Quadrat:

k X

l

k X

l

2

2

X

X

h

(h

−

e

)

ij

ij

ij

= n

− 1

χ2 =

e

h

∗

h

ij

i·

·j

i=1 j=1

i=1 j=1

TU-Ilmenau: Statistik

(5.4)

35

Kontingenzkoeffizient:

s

C=

χ2

+n

χ2

(5.5)

Normierter Kontingenzkoeffizient:

s

CN orm = C ∗

min(k, l)

min(k, l) − 1

Es gilt:

0 ≤ CN orm ≤ 1

CN orm ≈ 0 ⇒ X und Y unabhängig

CN orm ≈ 1 ⇒ X und Y abhängig, stark

TU-Ilmenau: Statistik

(5.6)

Kapitel 6

Lineare Regression

Für metrische Daten. Begriff Regression von Galton. Universales Gesetz der

Regression.

6.1

Einfache Lineare Regression

X,Y : zwei verbundene Merkmale.

Frage: Welche Gerade, y = a + bx ist am besten geeignet, den Zusammenhang

zu beschreiben? Die Regressionsgerade mit y = â + b̂ ∗ x

Beispiel 11 private Haushalte werden nach ihrem monatlichen Nettoeinkommen [¿ ] und ihren monatlichen Konsumausgaben [¿ ] befragt:

Haushalt i Nettoeinkommen xi Konsum yi

1

1780

1600

2

1480

1480

3

1540

1500

4

2070

1750

5

3390

2300

6

1900

1750

7

4220

2750

8

2800

2050

9

2700

1850

10

3990

2500

11

4600

3000

Die Regressionskoeffizienten â undb̂ werden nach der Methode der kleinsten Quadrate (MKQ) bestimmt.

a, b :

n

X

(yi − a − b ∗ xi ) → M in

i=1

Also muss hier nun die Ableitung gebildet werden. 1. Ableitung:

X

δ X

(yi − a − bxi )2 = 2

(yi − a − bxi )

δa

37

38

X

δ X

(yi − a − bxi )2 = −2

(yi − a − bxi ) ∗ xi

δb

Null setzen:

(1)

(2)

X

X

(yi − a − bxi ) =

X

(xi ∗ gi − a ∗ xi − b ∗ x2i ) =

yi − n + a − b ∗

X

xi ∗ yi − a

X

X

xi = 0

xi − b

X

x2i = 0

Die Lösung der Gleichung liefert extremwertverdächtige Punkte. Mit n1 multiplizieren:

1X

1X

(1)

yi − a − b

xi = ȳ − a − b ∗ x̄

n

n

1X

1X

1X 2

1X

1X 2

(2)

xi ∗ yi − a

xi − b

xi =

xi ∗ yi − a ∗ x̄ − b ∗

xi = 0

n

n

n

n

n

(1) in (2) nach a umgeformt einsetzen:

1X

1X 2

xi ∗ yi − (ȳ − b ∗ x̄ − b ∗

xi = 0

n

n

1X

1X 2

xi yi − x̄ ∗ ȳ = b ∗ (

xi − x̄2 )

n

n

P

P

1

xi ∗ yi − x̄ ∗ ȳ

x ∗ y − n ∗ x̄ ∗ ȳ

n

P 2i

P 2

b=

=

1

2

xi − n ∗ x̄2

xi − x̄

n

Optimale Regressionskoeffizienten:

P

1

xi ∗ yi − n ∗ x̄ ∗ ȳ]

n−1 [

P 2

=

b̂ =

1

[

xi − n ∗ x̄2 ]

n−1

b̂ = rxy ∗

1

n−1

P

(xi − x̄) ∗ (yi − ȳ)

P

1

(xi − x̄)2

n−1

sy

sx

â = ȳ − b̂ ∗ x̄

TU-Ilmenau: Statistik

(6.1)

39

In unserem Beispiel:

x̄ = 2770, 00 ; sx = 1128, 450 ; r = 0, 988 ; ȳ = 2048, 18 ; sy = 520, 323

b̂ = 0.988 ∗

520, 323

≈ 0, 456

1128, 45

â = 2048, 18 − 0, 456 ∗ 2770 ≈ 786, 3

Als Regressionsgerade ergibt sich somit:

y = 0, 456 ∗ x + 786, 3

Interpretation: Bei Erhöhung der Nettoeinkünfte um ¿ 100 werden im Mittel

¿ 45,60 mehr für Konsum ausgegeben. Vorsicht bei Interpretationen außerhalb

des Wertebereichs: Bei ¿ 0 Einkunft sind im Mittel ¿ 786,3 für Konsum ausgegeben worden???

6.2

Curvilineare Regression

Wortbedeutung: Nichtlineare Regressionsansätze, die sich mittels Transformation auf lineare Ansätze zurückfhren lassen.

Beispiel Ein Thüringer Getränkehändler verändert alle 3 Wochen systematisch den Preis von Köstritzer Schwarzbier, um die Auswirkungen auf den Absatz zu ergründen.

xi Preis [¿ /Stück] yi Absatz [Stück]

ln xi

ln yi

0,57

2140

-0,562 7,669

0,54

2400

-0,616 7,783

0,47

4120

-0,755 8,324

0,59

1980

-0,528 7,591

0,49

3060

-0,713 8,026

Zur Anpassung soll eine Absatzfunktion mit konstanter Preiselastizität benutzt

werden.

x: Preis ; y: Absatz

ε=

dy

y

dx

x

=

dy

dx

y

x

= const = b

x

y

y

y0 = b ∗

x

b = y0 ∗

Diese Differenzialgleichung hat die Lösung: y = a ∗ xb . Welche Parameter a und

b passen die Funktion optimal an und welcher 3 Wochen Absatz ist bei einem

Preis von ¿ 0,52/Flasche zu erwarten ?

TU-Ilmenau: Statistik

40

Der Ansatz y = a ∗ xb ist nicht linear in a und b. Durch Logarithmieren ergibt sich: ln y = ln a + b ∗ ln x. Die lineare Regression für die Punkte (ln xi ; ln yi )

liefert:

b̂ = −2, 999;lnˆa = 5, 975 ⇒ â = e5,975 = 393, 4 Daraus folgt für die Regressionsfunktion: y = 393, 4 ∗ x2,999 Optimale Werte wären: b̂ = −3, 144; â = 3292,

diese erreichen wir auf diese Weise nicht, da wir nur nähern. Das Verfahren ist

damit nach MKQ nicht optimal.

2796 Flaschen Absatz sind zu erwarten.

6.2.1

Weitere Beispiele für linear transformierbare Ansätze

Exponentialfunktion: y = a ∗ ebx → ln y = ln a + b ∗ x

x

Törnquist-Funktion (Sättigungsfunktion): y = a+b∗x

→ y1 = a ∗ x1 + b

1

1

−x

Logistische Funktion: y = a+b∗e

−x → y = a + b ∗ e

Zur Beurteilung der Güte der Anpassung kann man die Stichprobenreststreuung benutzen.

1 X

σ̂ 2 =

(yi − ŷi )2

n−2

Dabei ist ŷi der Wert der Regressionsfunktion an der Stelle xi . Je kleiner σ̂ 2

desto besser die Anpassung.

TU-Ilmenau: Statistik

Kapitel 7

Wahrscheinlichkeitsrechnung

7.1

Zufällige Ereignisse

Zufälliger Versuch: Versuch (in einem sehr weiten Sinne), der unter gleichen

äußeren Bedingungen beliebig oft wiederholbar ist (zumindest gedanklich), und

dessen Ausgang im Rahmen verschiedener Möglichkeiten ungewiss ist.

Beispiele:

1. Werfen einer Münze

2. Messen einer Länge [cm]

3. Bestimmung der Anzahl der Patienten in einem Wartezimmer

4. Zufällige Auswahl einer Person und Befragung nach ihrem Alter [Jahre]

Ergebnismenge: Menge aller möglichen, sich gegenseitig ausschließenden Ausgänge

eines zufälligen Versuches. Bezeichnung: Ω.

1. Ω = { Zahl, Wappen}

2. Ω = (0, ∞)

3. Ω = { 0, 1, 2, . . . , 17}

4. Ω = { 2, 3, . . . , 111}

Die Elemente von Ω heißen Ergebnisse. Die Teilmengen von Ω heißen zufällige

Ereignisse. Die einelementige Teilmengen {ω} von Ω nennt man Elementarereignisse.

1. A={W appen} ist das Ereignis mit der Münze Wappen zu werfen.

2. B = [12, ∞) ist das zufällige Ereigniss, Längen von über 12 [Maßeinheit]

zu messen.

3. C = {0, 1, 2, 3} ist das zufällige Ereignis, dass sich im Wartezimmer nicht

mehr als 3 Patienten befinden.

4. D = {20} ist das Ereignis das die ausgewählte Person 20 Jahre alt ist.

41

42

Gegeben seien zufällige Ereignisse A, B, C ⊂ Ω. Die Darstellung erfolgt in

Venn Diagrammen. Wenn das Elementarereignis ω1 realisiert wird, dann tritt

A ein. Wennn das Elementarereignis ω2 realisietr wird, tritt A nicht ein. Einen

zufälligen Versuch durchzuführen heißt ein Ergebnis ω ∈ Ω zufällig auszuwählen

(zu realisieren).

7.1.1

Beziehungen zwischen Ereignissen und Operationen

mit Ereignissen

C := A ∪ B “oder”

TU-Ilmenau: Statistik

43

C := A ∩ B “und”

Ω heißt sicheres Ereignis, ∅ heißt unmögliches Ereignis.

Ā = Ω\A “nicht A”

TU-Ilmenau: Statistik

44

A ⊂ B “A zieht B nach sich”

A ∩ B = ∅ “miteinander unvereinbar”

7.2

Wahrscheinlichkeit

Definition (Kolmogorov, 1933): Eine Funktion P, die jedem Ereignis eine reelle Zahl zuordnet heißt Wahrscheinlichkeitsmaß, wenn sie folgenden Axiomen

genügt:

(A1 ): P (A) ≥ 0 für alle A ⊂ Ω

(A2 ): P (Ω) = 1

P

(A3 ): P (∪Ai ) =

P (Ai ), wenn Ai ∩ Aj = ∅ für i 6= j (wenigstens eins

der Ereignisse tritt ein.

Sprechweise: P (A) nennt man Wahrscheinlichkeit von A.

TU-Ilmenau: Statistik

45

7.2.1

Eigenschaften von Wahrscheinlichkeiten

(1)

A ∩ B = ∅ ⇒ P (A ∪ B) = P (A) + P (B)

(2)

P (Ā) = 1 − P (A)

(3)

P (∅) = 0

(4) A ⊂ B ⇒ P (A) ≤ P (B)

(5) 0 ≤ P (A) ≤ 1∀A ⊂ Ω

(6) P (A ∪ B) = P (A) + P (B) − P (A ∩ B)

(7)

P (A ∪ B) ≤ P (A) + P (B)

Spezialfall: klassische Wahrscheinlichkeit (LaPlace, 1812)

Ω bestehe aus n Elementen die alle gleich wahrscheinlich sind. P ({ω}) =

Anz.ElementeA

alle ω ∈ Ω. Dann gilt: P (A) = n1 + n1 + . . . + n1 = m

n = Anz.ElementeΩ .

1

n

für

Beispiel :

Wie groß ist die Wahrscheinlichkeit bei 3 Würfeln mit einem Würfel mindestens

Sechs zu würfeln (Start bei Mensch ärgere dich nicht). A . . . mindestens eine

Sechs. Ā . . . keine Sechs. Ω = {(e1 , e2 , e3 )|ei ∈ {1, 2, 3, 4, 5, 6}}. ei . . . Ergebnis

des i-ten Wurfes.

Ω hat 63 Elemente.

Ā hat 53 Elemente.

3

⇒ P (A) = 1 − P (Ā) = 1 − 653 ≈ 0, 42

7.3

Wahrscheinlichkeitsverteilungen

Zufallsgröße: Funktion Ω → R

Modellvorstellung: Im Rahmen einens zufälligen Versuches wird “durch Zufall”

ein sogenanntes Ergebnis aus Ω gewählt. Die Realisierung x = X(ω) von X ist

als Versuchsergebnis beobachtbar.

Beispiel :

Ω sei zerlegbar in B und B̄. Ω = B ∪ B̄, B ∩ B̄ = ∅

ω ∈ B . . . “gut”

ω ∈ B̄ . . . “schlecht”

Zufallsgröße

½

1 , wenn ω ∈ B

X(ω) :=

0 , wenn ω ∈ B̄

Zweipunkt-Verteilung: P (x = 1) := P (B), P (x = 0) := 1 − P (B)

TU-Ilmenau: Statistik

46

diskrete Zufallsgröße :

Der Werteberiech von X ist eine

endliche oder abzählbar unendliche Menge (meist ganze Zahlen).

Beispiele: Anzahl der Fadenbrüche in einer Webmaschiene,

Anzahl der Kunden, Länge einer

Warteschlange [in Personen].

Die Wahrscheinlichkeitsverteilung einer Zufallsgröße

X ist bekannt wenn man:

Zu jedem Wert, den X annehmen kann, die Wahrscheinlichkeit kennt, mit der er angenommen wird. pi = P (X = xi ).

7.4

stetige Zufallsgröße :

Der Wertebereich von X ist die

Menge der reellen Zahlen oder

ein Intervall.

Beispiele: Füllmenge

einer

Milchflasche, Wartezeit bei . . .,

Länge eines Werkstücks.

Die Wahrscheinlichkeitsverteilung einer Zufallsgröße X

ist bekannt wenn man: Von

jedem Intervall weiß, wie groß

die Wahrscheinlichkeit ist, dass

X Werte in diesem Intervall annnimmt. P (X ∈ I)

Diskrete Verteilungen

x1 , x2 , . . . Werte, die die Zufalssgröße X annehmen kann.

p1 , p2 , . . . Wahrscheinlichkeit,

P mit denen X den Wert xi annimmt.

Es muß gelten: 0 ≤ pi ≤ 1; pi = 1

Beschreibungsmöglichkeiten :

Tabelle, z.B.:

xi

pi

0

1

2

3

1

3

Formel, z.B.: P (X = k) = (1 − p) ∗ pk

(k = 0, 1, 2) für ein p ∈ (0, 1) (“geometrische Verteilung”)

Diagramm z.B.:

TU-Ilmenau: Statistik

47

7.5

Stetige Verteilungen

Für jeden Einzelwert x gilt P (X = x) = 0. Angabe der Verteilungen

durch eine

R∞

Verteilungsdichte f |R → R+ Es muss gelten: f (x) ≥ 0 und −∞ f (x)dx = 1

Bestimmung von Wahrscheinlichkeiten :

x1 : Untergrenze des Intervalls dessen Wahrscheinlichkeit bestimmt werden soll.

x2 : Obergrenze des Intervalls dessen Wahrscheinlichkeit bestimmt werden soll.

Z x2

P (x1 ≤ X ≤ x2 ) = P (x1 < X < x2 ) =

f (x)dx

x1

Z

x

P (X < x) =

f (s)ds = F (x)

−∞

F (x): Verteilungsfunktion. Es gilt: f (x) =

d

dx F (x)

TU-Ilmenau: Statistik

48

Beispiel

: Exponentialverteilung mit Parameter λ > 0

½

−λx

für x > 0

f (x) = λe

0

für x < 0

TU-Ilmenau: Statistik

49

7.6

Parameter von Verteilungen

X sei eine Zufallsgröße, die stetig verteilt ist.

Mit der Dichte f . Der Erwartungswert ist:

Z ∞

EX =

x ∗ f (x)dx

X sei eine Zufallsgröße, die diskret verteilt ist.

Auf dem Punkte x1 , x2 , . . . mit

den Einzelwerten P (X = xi ) =

pi . Der Erwartungswert ist:

X

EX =

xi ∗ pi

−∞

Interpretation:

Mittelpunkt,

Schwerpunkt.

Varianz=Streuung:

X

D2 X =

((xi − EX)2 ∗ pi )

Interpretation:

Mittelpunkt,

Schwerpunkt.

Varainz=Streuung:

Z ∞

2

(x − EX)2 ∗ f (x)dx

D X=

Interpretation: Mittlere Quadratische Abweichung vom Erwartungswert.

Standardabweichung:

√

DX = D2 X

Interpretation: Mittlere Quadratische Abweichung vom Erwartungswert.

Standardabweichung:

√

DX = D2 X

Wurzel aus der Standardabweichung.

Bemerkungen

Wurzel aus der Standardabweichung.

−∞

1. EX und D2 X müssen nicht existieren.

2. Es sei g|R → R eine stetige Funktion. Dann ist g(x) eine Zufallsgröße, und

es gilt:

P

diskret: Eg (x) =

g(xi ) ∗ pi

R∞

stetig: Eg (x) = −∞ g(x) ∗ f (x)dx

R∞

3. Es gilt: D2 X = E(x − EX)2 = E(X 2 ) − (EX)2 mit E = −∞ x2 ∗ f (x)dx

4. Es gilt: E(x1 + x2 + . . . + xn ) = Ex1 + Ex2 + . . . + Exn

5. Es gilt: D2 (x1 + x2 + . . . + xn ) = D2 x1 + D2 x2 + . . . + D2 xn Wenn die

Zufallsgrößen x1 , x2 , . . . , xn voneinander unabhängig sind.

7.6.1

Weitere Parameter

Schiefe: (wenn symmetrisch, dann S = 0)

S=

Exzess:

W =

E(x − EX)3

(DX)3

E(x − EX)4

−3

(DX)4

(−3 < W < ∞)

TU-Ilmenau: Statistik

50

7.7

7.7.1

Spezielle diskrete Verteilungen

Binomialverteilung

Mit den Parametern n und p. (n ∈ N, 0 < p < 1)

µ ¶

n

P (X = k) =

∗ pk ∗ (1 − p)n−k

k

EX = n ∗ p;

X

(k = 0, 1, . . . , n)

(7.1)

D2 X = n ∗ p ∗ (1 − p)

P (X = k) = 1

Entstehung: Bernoulli-Schema

In einem Versuch kann ein Ereignis A mit der Wahrscheinlichkeit p = P (A)

eintreten. Der Versuch wird insgesamt n-mal unabhängig voneinander durchgeführt. X bezeichne die Anzahl des Eintretens von A in den n Versuchen. Man

kann zeigen, dass X binomialverteilt mit den Parametern n und p ist.

Beispiel :

10 Hühnereier liegen im Brutkasten. Wie groß ist die Wahrscheinlichkeit dass

mindestens 3 Hähnchen das Licht der Welt erblicken?

X . . . Anzahl der Hähnchen unter den 10 Kücken.

X . . . ist binomial verteilt mit n = 10 und p = 0, 5.

Gesucht wird P (X ≥ 3)

P (X ≥ 3) = P (X = 3) + P (X = 4) + . . . + P (X = 10)

= 1 − P (X < 3) = 1 − P (X = 0) − P (X = 1) − P (X = 2)

µ ¶

µ ¶

µ ¶

10

10

10

0

10

1

9

=1−

∗ 0, 5 ∗ 0, 5 −

∗ 0, 5 ∗ 0, 5 −

∗ 0, 52 ∗ 0, 58

0

1

2

µµ ¶ µ ¶ µ ¶¶

10

10

10

1 + 10 + 45

56

10

= 1 − 0, 5

+

+

=1−

=1−

≈ 0, 945

0

1

2

1024

1024

7.7.2

Hypergeometrische Verteilung

Mit den Parametern N ,M , und m.Entspricht dem Ziehen aus einer Urne ohne

zurücklegen. (n, N, M ∈ N ; n ≤ N ; M ≤ N ) .

¡M ¢ ¡N −M ¢

∗

P (X = k) = k ¡N ¢n−k

(7.2)

n

(max(0, n + M − N ) ≤ k ≤ min(N, n))

EX = n ∗

M

N

;

D2 X = n ∗

M

M

N −n

∗ (1 −

)∗(

)

N

N

N −1

Entstehung: In einer Kiste sin N Teile, davon M defekte. Aus der Kiste werden n Teile zufällig entnommen (ohne zurücklegen). X bezeichne die zufällig

Anzahl defekter Teile in der Stichprobe (unter n). Man kann zeigen, daß X

hypergeometrisch verteilt ist.

TU-Ilmenau: Statistik

51

Beispiel :

Wie groß ist die Wahrscheinlichkeit, im Lotto “6 aus 49” mit einem Tipp mindestens einen Fünfer zu gewinnen?

N = 49; n = 6 Gewinnzahlen durch ziehen; M = 6 angekreuzte Zahlen.

X . . . Anzahl der angekreuzten Gewinnzahlen, hypergeometrisch verteilt.

P (X ≥ 5) = P (X = 5) + P (X = 6)

¡6¢ ¡49−6¢ ¡6¢ ¡49−6¢

∗

∗

6 ∗ 43 + 1 ∗ 1

≈ 0, 00001852

= 5 ¡49¢6−5 + 6 ¡49¢6−6 =

13983816

6

6

7.7.3

Poissonverteilung

Mit dem Parameter λ > 0

λk

; (k = 0, 1, 2, . . .)

k!

EX = λ ; D2 X = λ

P (X = k) = e−λ ∗

(7.3)

Die Poissonverteilung ist die “Verteilung der kleinen Zahlen”. Sie kommt im

Grenzfalle des Bernoulli-Schemas vor: n → ∞ ; n ∗ p → λ.

7.8

7.8.1

Spezielle stetige Verteilungen

Rechteckverteilung

Gleichmäßige, stetige Verteilung auf dem Intervall [a, b]

½

1

f (x) = b−a für a ≤ x ≤ b

0

sonst

a+b

(b − a)2

; D2 X =

2

12

S = 0 ; W = −1, 2

EX =

TU-Ilmenau: Statistik

(7.4)

52

Beispiel :

Nagelfabrik produziert 80er Nägel, abgeschnitten wird von einer ca. 400m langen

Drahtrolle. 85mm lange Stücke. Wie groß ist die Wahrscheinlichkeit, dass ein

Stück übrig bleibt, dass länger als 54mm ist?

X . . . Länge des Restes, gleichmäßig verteilt auf dem Intervall [0, 85]

Z

Z

85

85

f (x)dx =

P (X > 54) =

54

54

1

85 − 54

dx =

≈ 0, 365

85

85

Pseudo Zufallszahlen von Computerprogrammen sind meist stetig verteilt auf

dem Intervall [0; 1)

7.8.2

Normalverteilung

Mit den Parametern µ und σ 2 (−∞ < µ < ∞

f (x) = √

1

2∗π∗

σ2

∗e

;

σ 2 > 0).

−(x−µ)

2∗σ 2

Bezeichnung: X ∼ N (µ, σ 2 )

Es gilt:

EX = µ

;

D2 X = σ2

;

S=0

;

W =0

µ ist die x-Koordinate des Maximums, σ die Strecke ∆x vom Maximum bis zum

Wendepunkt. Vertafelt ist die Verteilungsfunktion,

Z

x

ϕ(t)dt

Φ(x) =

−∞

(F (x) = P (X ≤ x))

der standardisierten Normalverteilung

(N (0; 1)) : ϕ(t) = √

t2

1

∗ e− 2

2∗π

da die Stammfunktion der Normalverteilung nicht eindeutig bestimmbar ist,

daher muss man dei Spezialfälle auf den allgemeinen zurückführen.

TU-Ilmenau: Statistik

53

7.9

Grenzwertsätze

X1 , X2 , X3 . . . sei eine Folge unabhängiger Zufallsgrößen, die alle dieselbe Verteilung besitzen. µ = EXi ; σ 2 = D2 Xi

Gesetz der großen Zahlen: Es gilt mit Wahrscheinlichkeit 1:

lim

n→∞

X1 + X2 + . . . + Xn

=µ

n

Beispiel : Münzwurf

½

1 , wenn im i-ten Wurf Zahl oben ist

xi =

0 , wenn im i-ten Wurf Wappen oben ist

1

1

+ 0 ∗ = 0, 5

2

2

X1 + X2 + . . . + Xn

AnzahlW appen −→

h(A) =

=

0, 5

n

AnzahlW uerf e n → ∞

EXi = 1 ∗

7.9.1

Zentraler Grenzwertsatz

Die Verteilung von:

X1 + X2 + . . . + Xn − n ∗ µ

√

n

konvergiert gegen die N (0, σ 2 )-Verteilung. Der ZGWS ist die theoretische Begründung für das häufige Auftreten von Normalverteilung.

TU-Ilmenau: Statistik

Teil II

Schliessende Statistik

55

Kapitel 8

Grundbegriffe der schl.

Stat.

Schluß von der Stichprobe auf die Grundgesamtheit. Einbettung der Statistik

in die Wahrscheinlichkeitsrechnung:

Wahrscheinlichkeitstheoretoscher Begriff Statistischer Begriff

Ergebnismenge Ω

Grundgesamtheit

Definition:

Zufallsgröße X | Ω → <

Merkmal X

Zufallsgrößen X1 , X2 , . . . , Xn

Stichprobe

Unter einer mathematischen Stichprobe zu dem Merkmal X versteht man n unabhängige identisch wie X verteilte Zufallsgrößen X1 , X2 , . . . , Xn . Jede Realisierung x1 , x2 , . . . , xn der mathematischen Stichprobe ist eine konkrete Stichprobe

ω∈Ω

Xi (ω) = xi

Mathematische Stichprobe

X1 , X2 , . . . , Xn

Theorie

Konkrete Stichprobe

x1 , x2 , . . . , xn

praktische Durchführung

Aufgabe der Statistik Die Verteilung P x des Merkmals X sei ganz oder

teilweise unbekannt. Es gilt, aus der Stichprobe Kenntnisse über P x zu gewinnen.

2 Hauptmethoden

Schätzen von unbekannten Parametern, Wahrscheinlichkeiten, Dichtefunktionen

Testen von Hypothesen über die unbekannte Verteilung

Beispiel In einem Wald wurde stichprobenartig ermittelt, das 39,4% aller

Bäume geschädigt sind. Kann es sein, dass der Anteil geschädigter Bäume

in Wirklichkeit bei 42% liegt? Drei Jahre vorher hatte eine Stichprobe einen

Schädigungsgrad von 37,7% ergeben. Ist der jetzt erkennbare Zuwachs signifikant?

57

Kapitel 9

Wichtige

Stichprobenfunktionen

Es seien X ein Merkmal mit Erwartungswert µ und Varianz σ 2 und

X1 , X2 , X3 , . . . , Xn ⇒ EX1 = EX2 = EX3 = . . . = EXn

E(X1 + . . . + Xn ) = EX1 + . . . EXn = n ∗ µ

D 2 X1 = D 2 X2 = . . . = D 2 Xn = n ∗ σ 2

9.1

Das Stichprobenmittel

n

X̄ =

1X

Xi

n i=1

(9.1)

X̄ ist eine Zufallsgröße. Es gilt:

E X̄ =

1

1

E(X1 + . . . + Xn ) = ∗ n ∗ µ

n

n

1 2

1

σ 2 −−−−→

D (X1 + . . . + Xn ) = 2 ∗ n ∗ σ 2 =

n → ∞0

2

n

n

n

−−∞µ

→ Anwendung: Falls der

Wegen dem Gesetz der großen Zahlen: X̄ −

n−→

Pn

Mittelwert des Merkmals X nicht bekannt ist, kann er durch x̄ = n1 i=1 xi

geschätzt werden. Diese Schätzung ist umso besser, je größer der Stichprobenumfang ist.

D2 X̄ =

9.2

Die Stichprobenvarianz

n

S2 =

1 X

(Xi − X̄)2

n − 1 i=1

S 2 ist zufällig. Es gilt:

ES 2 = σ 2 , D2 (S 2 ) → 0, S 2 → σ 2 (n → ∞)

59

(9.2)

60

Anwendung:

n

1 X

S =

(xi − x̄)2

n − 1 i=1

2

ist gut als Schätzung für σ 2 geeignet, wenn σ 2 und µ unbekannt sind.

9.3

Die Verteilungen von X̄ und S 2 für normalverteiltes Merkmal

2 neue Verteilungen die zu den sogenannten Prüfverteilungen gehören.

Definition:

1. Eine stetige Verteilung mit der Dichte

g(x) = c1 ∗ (1 +

X 2 − t+1

) 2

f

(−∞ < X < ∞)

nennt man t-Verteilung mit f Freiheitsgraden f = 1, 2, . . .

2. Eine stetige Verteilung mit der Dichte

½

f

x

2 −1 ∗ e− 2

g(x) = c2 ∗ x

0

für x > 0

für x ≤ 0

heißt χ2 -Verteilung mit f Freiheitsgraden (f = 1, 2, . . .). Die Konstanten

c1 und c2 hängen von f ab.

Bemerkungen zur t-Verteilung: Die t-Verteilung ist symmetrisch bezüglich

der Null. Mit f → ∞ nähert sich die t-Verteilung der N (0, 1) Verteilung. Es

f

gilt: ETf = 0 für f ≥ 2 und D2 Tf = f −2

für f ≥ 3

2

2

Bemerkungen zur χ -Verteilung: EXf = f ; D2 χ2f = 2 + f ; M ed(χf ) = f − 2

für f ≥ 3

n

1X

X̄ =

Xi

n i=1

S2 =

Satz

1 X

n(Xi − X̄)2

n − 1 i=1

Es sei X ∼ N (µ; σ 2 ). Dann gilt:

1. Z =

X̄−µ

σ

2. T =

X̄−µ √

n

S

3. χ2 =

ist N (0; 1) verteilt.

ist t-verteilt mit n − 1 Freiheitsgraden.

(n−1)∗S 2

σ2

ist χ2 -verteilt.

TU-Ilmenau: Statistik

61

X

i=1

2

n(

Xi − µ 2

)

σ

2

ist χ -verteilt mit Xi ∼ N (µ; σ ) und n Freiheitsgraden.

χ2 =

n

X

X1 − X̄ 2

(

)

σ

i=1

ist χ2 -verteil mit n − 1 Freiheitsgraden.

TU-Ilmenau: Statistik

Kapitel 10

Punktschätzungen

Merkmal X. Verteilung P x von X hänge ab von einem Parameter ϑ ∈ Θ, dessen

wahrer Wert unbekannt ist (Θ = nicht leere Parametermenge)

10.1

Definition und Beispiele

cn = Tn (X1 , X2 , . . . , Xn )

Eine Punktschätzung für ϑ ist eine Stichprobenfunktion ϑ

mit Werten in Θ

Bemerkung Für die Parametermenge Θ gilt häufig:

Θ ⊂ R → ein unbekannter Parameter ϑ ∈ R

Θ ∈ Rk → k unbekannte Parameter.

ϑ1

ϑ = ...

ϑk

Beispiele für Punktschätzungen

µ̂ = X̄ ist eine Punktschätzung für µ = EX

S 2 ist eine Punktschätzung für σ 2 = D2 X

Θ=R

Θ = [0, ∞)

Das Merkmal X sei rechtecksverteilt im Intervall [0; b] wobei die obere

Grenze b ∈ (0, ∞) unbekannt ist. Dann ist b̂ = max(X1 , X2 , . . . , Xn ) eine

Punktschätzung für b.

Pn

Das empirische Zentralmoment l-ter Ordnung: MZen;l = n1 i=1 (Xi − X)l

ist eine Punktschätzung für das l-te Zentralmoment von X.

µZen,l = E(X − EX)l l = 2, 3, 4.

10.2

Wünschenswerte Eigenschaften

cn = ϑ∀n (im Mittel schätzt ϑ

cn richtig)

Erwartungstreue: E ϑ

63

64

−−∞ϑ

→ (schätzt im Mittel asymcn −

Asymptotische Erwartungstreue: E ϑ

n−→

ptotisch richtig)

−−∞ϑ

→ (ϑ

cn −

cn nähert sich mit wachsendem Stichproben Um Konsistenz: ϑ

n−→

fang n dem wahren Wert)

cn hat von allen Erwartungstreuen Punktschätzungen für ϑ die

Effizienz: ϑ

cn ist der beste Schätzer für ϑ

kleinste Varianz. ϑ

Bemerkung

cn → 0

ist Dl ϑ

Hinreichend für die Konsistenz einer erwartungstreuen Punktschätzung

Beispiele

E X̄ = µ

;

b ist erwartungstreu und konsistent für µ

X̄ → µ ⇒ µ

b=X

c2 = S 2 ist eine erwartungstreue und konsi ES 2 = σ 2 ; S 2 → σ 2 ⇒ σ

√

2

stente Punktschätzung für σ . Bemerkung: S 2 ist im allgemeinen nicht

erwartungstreu für σ

X sei gleichmäßig stetig verteilt auf [0; b]. Der Schätzer bb = max(X1 , X2 , . . . , Xn )

n

hat den Erwartungswert Ebb = n+1

∗ b. b ist nicht erwartungstreu. bb ist

asymptotisch erwartungstreu und konsistent

Pn

Das empirische Zentralmoment n1 i=1 (Xi − X̄)l ist nur asymptotisch

Erwartungstreu

, Speziell l = 2

P für MZen,l

2

MZen,2 = n1 (X

−

X̄)

ist

nicht Erwartungstreu für MZen,2 = σ 2

i

P

1

2

2

aber S = n−1 (Xi − X̄) ist Erwartungstreu für σ 2

Bemerkung Ob empirische Momente effektive Schätzer sind für die entsprechenden Momente hängt vom Verteilungstyp des Merkmals ab. So

lässt sich zeigen, daß bei normalverteilten Merkmal X das empirische Mittel X̄ effizient für µ ist

hn (A) sei die relative Häufigkeit eines Ereignisses A in n Versuchen.

½

1, wenn A im i-ten Versuch eintritt

Xi =

0, wenn A im i-ten Versuch nicht eintritt

Die Versuche werden unabhängig voneinander unter gleichen äußeren Bedingungen wiederholt.

hn (A) =

Ehn (A) =

D2 hn (A) =

Anz. des Eintretens

X1 + X2 + . . . + Xn

=

n

Anz. aller V ersuche

1

1

E(X1 + X2 + . . . + Xn ) = ∗ n ∗ p = p = P (A)

n

n

1 2

1

p(1 − p)

D (X1 +X2 +. . .+Xn ) = 2 ∗n∗p∗(1−p) =

→0

p2

n

n

Wobei (X1 + X2 + . . . + Xn ) binomial verteilt mit p = P (A) und n.

TU-Ilmenau: Statistik

65

Also: Die relative Häufigkeit von A ist eine Erwartungstreue und konsistente Punktschätzung für die Wahrscheinlichkeit von A. Man kann zeigen:

hn (A) ist auch effizient für P (A).

TU-Ilmenau: Statistik

Kapitel 11

Bereichsschätzungen

(Konfidenzintervall, Vertrauensbereich)

11.1

Definitionen

Die Verteilung des Merkmals X hängt von einem Parameter ϑ ab, dessen wahrer

Wert unbekannt ist.

Beispiel: Abweichugen vom Sollmaß (in µm) bei Werkstücken.

X ∼ N (µ, σ 2 ) wird vorausgesetzt. Stichprobe vom Umfang n = 20 aus der laufenden Produktion:

3 2 -1 -2 0 1 2 -1 0 0 0 0 -4 3 1 -2 -1 -3 4

Punktschätzungen:

P20

1

für µ: x̄ = 20

x = 0, 15

q 1 Pi

n

1

für σ: s = n−1 i=1 (xi − x̄)3 = 2, 06

Die Teile werden mit einem systematischen Fehler von 0, 15µm produziert und

die Abweichungen vom Sollmaß streuen mit einer empirischen Standardabweichung von 2, 06µm um den Mittelwert 0, 15µm. Der tatsächliche Mittelwert

µ = EX des Merkmals X bleibt unbekannt. Kann man Grenzen angeben, innerhalb derer der wahre Wert von µ liegt? Ja → Konfidenzintervall. Aber: Das

Konfidenzintervall kann falsch sein. Die Wahrscheinlichkeit α für diesen Irrtum

kann man (klein) vorgeben: 1 − α =Konfidenzeniveau=Statistische Sicherheit.

Definition: Ein Intervall KIϑ = (Gu, Go), dessen Grenzen Gu(X1 , X2 , . . . , Xn )

und Go(X1 , X2 , . . . , Xn ) Stichprobenfunktionen sind, heißt Konfidenzintervall

für ϑ zum Konfidenzniveau 1 − α, wenn P (Gu < ϑ < Go) = 1 − α für den

wahren Wert von ϑ und P (Gu < ϑ0 < Go) ≤ 1 − α für jeden anderen Wert ϑ0 .

Mit anderen Worten: Der wahre Wert wird mit einer Wahrscheinlichkeit

von 1 − α überdeckt, ein falscher mit einer Wahrscheinlichkeit, die nicht größer

ist als 1 − α

α = 0, 05

normale Sicherheit

hohe Sicherheit

Für α benutzt man Standardwerte: α = 0, 01

α = 0, 001 sehr hohe Sicherheit

67

1

68

11.2

Quantile von Prüfverteilungen

Prüfverteilungen: Wahrscheinlichkeitsverteilungen zur Durchführung von Hypothesenprüfungen oder zur Berechnung vom Konfidenzintervall.

11.2.1

Standardnormalverteilung

Normalverteilung mit µ = EX = 0 und D2 X = σ 2 = 1. N (0, 1)-Dichte.

x2

1

ϕ(x) = √ e− 2

2π

(−∞ < x < ∞)

Zα = P (Z ≤ Zα ) = α

Z0,5 =Median

Z0,25 , Z0,75 =Quartile

α

0, 95

Die Quantile sind vertafelt: 0, 975

0, 99

0, 995

Zα

1, 645

1, 96 Es gilt:

2, 326

2, 576

Z1−α = −Zα

TU-Ilmenau: Statistik

69

11.2.2

t-Verteilung

Es gilt:

tf ;1−α = −tf ;α

tf ;α Quantile der t-Verteilung mit f Freiheitsgraden der Ordnung α. Die Quantile sind vertafelt, fehlende Freiheitsgrade sind linear zu interpolieren. Es gilt:

lim tf = Zα

f →∞

TU-Ilmenau: Statistik

70

11.2.3

χ2 -Verteilung

Quantile der χ2 -Verteilung mit f Freiheitsgraden. Die Quantile sind bis f = 30

vertafelt. Für f > 30 gibt es eine gute Näherungsformel:

µ

χ2f ;α ≈ f

1−

2

+ Zα

9f

r

2

9f

TU-Ilmenau: Statistik

¶3

(11.1)

71

11.3

Konfidenzintervalle für die Parameter eines normalverteilten Merkmals

Es sei X ∼ N (µ; σ 2 ) wobei µ = EX und σ 2 = D2 X unbekannt sein sollen.

11.3.1

Konfidenzintervall für µ

µ

¶

S

S

α

α

KIµ = X̄ − √ ∗ tn−1;1− 2 ; X̄ + √ ∗ tn−1;1− 2

n

n

Herleitung:

T =

X̄ − µ √

n

S

ist t-verteilt mit n − 1 Freiheitsgraden (vgl. Satz aus Kapitel 2.3)

P

µ

¶

X̄ − µ √

−tn−1; α2 <

n < tn−1;1− α2 = 1 − α

S

¶

µ

S

S

α

α

P − √ tn−1;1− 2 < X̄ − µ < √ tn−1;1− 2 =

n

n

¶

µ

S

S

P −X̄ − √ tn−1;1− α2 < −µ < −X̄ + √ tn−1;1− α2 =

n

n

P

µ

¶

S

S

X̄ − √ tn−1;1− α2 < µ < X̄ + √ tn−1;1− α2 = 1 − α

n

n

TU-Ilmenau: Statistik

(11.2)

72

Bemerkungen