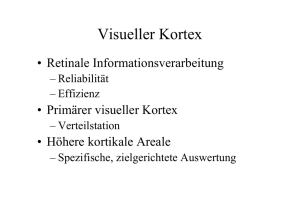

Legasthenie und reine Worttaubheit als neurologisch basale St

Werbung