Mathematische und statistische Methoden II

Werbung

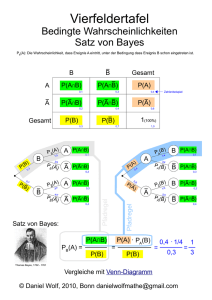

Methodenlehre & Statistik Sprechstunde jederzeit nach Vereinbarung und nach der Vorlesung Mathematische und statistische Methoden II Wallstr. 3, 6. Stock, Raum 06-206 Dr. Malte Persike [email protected] lordsofthebortz.de lordsofthebortz.de/g+ facebook.com/methodenlehre twitter.com/methodenlehre youtube.com/methodenlehre SoSe 2012 Folie 1 Psychologisches Institut Johannes Gutenberg Universität Mainz Methodenlehre & Statistik Inhalte dieser Sitzung Herumgedrückt: Die Wahrscheinlichkeitsdefinition von Kolmogoroff Wie misst man Wahrscheinlichkeiten – das Gesetz der großen Zahl Bedingte Wahrscheinlichkeiten: Wie wahrscheinlich sind blaue Streifen bei Schwangerschaft – und wie wahrscheinlich ist Schwangerschaft bei blauen Streifen? Der Satz von Bayes Folie 2 Methodenlehre & Statistik Laplace Kolmogoroff Die axiomatische WkDefinition von Kolmogoroff Probleme der Laplace‘schen Definition Die Definition von p() ist zirkulär, da „Gleichmöglichkeit“ nur ein Synonym für Gleichwahrscheinlichkeit ist. Die Klasse der enthaltenen Zufallsprozesse ist durch das Konzept der Gleichmöglichkeit von Elementarereignissen stark eingeschränkt. Beispiel: Kopf, Zahl und Seite Folie 3 Methodenlehre & Statistik VennDiagramme Definition Laplace Kolmogoroff Exkurs: Venn-Diagramme Illustration von Ereignissen & Wahrscheinlichkeiten Jedes Ereignis ist durch einen Kreis repräsentiert Die Fläche des Kreises repräsentiert die Wahrscheinlichkeit des Ereignisses Folgerungen Das umgebende Quadrat ist der Stichprobenraum Poisson A B Folie 4 A und B haben eine Schnittmenge, sind aber ungleich A B A ist ein Teilereignis von B Methodenlehre & Statistik Laplace Kolmogoroff VennDiagramme Die axiomatische WkDefinition von Kolmogoroff Definition Die auf der σ–Algebra definierte Funktion p(E) besitzt folgende Eigenschaften: Folgerungen 1. Für jedes Ereignis E der σ–Algebra gilt: p(E) 0 Poisson 2. Für das sichere Ereignis gilt: p() = 1 3. Lässt sich das Ereignis E in die disjunkten Teilereignisse A und B zerlegen, gilt: (E, A, B σ; A B = ) 4. p(E) = p(A +B) = p(A) + p(B) Additionssatz der Wahrscheinlichkeiten Folie 5 Methodenlehre & Statistik VennDiagramme Definition Folgerungen Poisson Laplace Kolmogoroff Folgerungen aus den Axiomen Der Erweiterte Additionssatz Der Additionssatz kann beliebig weit verschachtelt werden, wenn die Teilereignisse selbst wieder in disjunkte Teilereignisse zerlegbar sind. Konsequenz: Ist ein Ereignis E in k disjunkte Teilereignisse e1 … ek zerlegbar, so folgt durch vollständige Induktion: p(E) = p(e1) + p(e2) + … + p(en) Erweiterter Additionssatz Folie 6 Methodenlehre & Statistik VennDiagramme Definition Laplace Kolmogoroff Folgerungen aus den Axiomen Die Wahrscheinlichkeit des unmöglichen Ereignisses p 0 Folgerungen Wahrscheinlichkeit des unmöglichen Ereignisses ist 0. Poisson Es gilt ja für den Stichprobenraum : Und mit Axiom 3 (Additionssatz): p () p p Und mit Axiom 2 nun: 1 1 p() Durch Umformen folgt der Satz. Folie 7 Methodenlehre & Statistik VennDiagramme Definition Laplace Kolmogoroff Folgerungen aus den Axiomen Die Wahrscheinlichkeit des Gegenereignisses p( E ) 1 p E E E Folgerungen Wahrscheinlichkeit des Komplements ist 1 minus die WK des Ereignisses Poisson Es gilt ja für den Stichprobenraum : EE Und mit Axiom 2 folglich: 1 pE E Und mit Axiom 3 (Additionssatz) dann: 1 pE pE Woraus der Satz folgt. Folie 8 Methodenlehre & Statistik VennDiagramme Definition Folgerungen Poisson Laplace Kolmogoroff Folgerungen aus den Axiomen Verbundwahrscheinlichkeiten Merke: Wenn zwei Ereignisse aus einer -Algebra eine Schnittmenge haben, so ist diese Schnittmenge wieder ein Ereignis in . A Die Wahrscheinlichkeit p(A dieser Schnittmenge ist immer gleich oder größer 0 A AB B Man bezeichnet p(A auch als Verbundwahrscheinlichkeit von A und B Folie 9 Methodenlehre & Statistik VennDiagramme Definition Folgerungen Laplace Kolmogoroff Folgerungen aus den Axiomen Der Allgemeine Additionssatz Problem: Wenn zwei Ereignisse nicht disjunkt sind, ist der Additionssatz nicht unmittelbar anwendbar: A AB B p(A B) ≠ p(A) + p(B) wenn p(A B) > 0 Poisson Die Wahrscheinlichkeit der Schnittmenge, also die Verbundwahrscheinlichkeit, geht dann doppelt ein. Die Verbundwahrscheinlichkeit muss also einmal subtrahiert werden. p(A B) = p(A) + p(B) – p(A B) Allgemeiner Additionssatz Folie 10 Methodenlehre & Statistik VennDiagramme Definition Folgerungen Poisson Laplace Kolmogoroff Wahrscheinlichkeitsfunktionen Notation für Wahrscheinlichkeiten Genau wie bei Laplace kann nun auf den Elementarereignissen des Stichprobenraums und den Ereignissen der -Algebra eine Wahrscheinlichkeitsfunktion definiert werden. Dies geschieht einfach über die Zuweisung reeller Zahlen, die die Kolmogoroff Axiome erfüllen Die Zahlen können dann als Wahrscheinlichkeiten für die Ereignisse E aufgefasst werden. Jede auf oder definierte Zufallsvariable „erbt“ wieder die Wahrscheinlichkeitsfunktion. Folie 11 Methodenlehre & Statistik VennDiagramme Laplace Wahrscheinlichkeitsfunktionen Notation für Wahrscheinlichkeiten Definition Folgerungen Poisson Folie 12 Kolmogoroff Die Definition der Wahrscheinlichkeitsfunktion p(x) entspricht der Definition der Zufallsvariablen K , Z , S p( ="K"): 0.49999 p p( ="Z"): 0.49999 p( ="S"): 0.00002 Methodenlehre & Statistik VennDiagramme Laplace Wahrscheinlichkeitsfunktionen Notation für Wahrscheinlichkeiten Definition Folgerungen Kolmogoroff Die Definition der Wahrscheinlichkeitsfunktion p(x) entspricht der Definition der Zufallsvariablen K , Z , S x1: 0, wenn "K" X x 2 : 1, wenn "Z" x : 2, wenn "S" 3 Poisson p(X=x1 ): 0.49999 p x p(X=x 2 ): 0.49999 p(X=x ): 0.00002 2 Folie 13 Frage: Woher kennen wir die Wahrscheinlichkeiten p? Methodenlehre & Statistik VennDiagramme Definition Laplace Wahrscheinlichkeitsfunktionen Häufigkeit und Wahrscheinlichkeit Wenn ein Zufallsexperiment mehrmals wiederholt wird, so wird die Anzahl der Trials oft mit n bezeichnet. Man kann dann die Häufigkeiten zählen, mit denen jede der möglichen Realisationen xi aufgetreten ist. Diese werden als h(X=xi) oder h(xi) oder hi geschrieben h(X=xi) wird auch als absolute Häufigkeit bezeichnet Die relative Häufigkeit berechnet man nun als Folgerungen Poisson Kolmogoroff f X xi Folie 14 h X xi n Methodenlehre & Statistik VennDiagramme Laplace Wahrscheinlichkeitsfunktionen Häufigkeit und Wahrscheinlichkeit Problem: Häufigkeiten sind keine Wahrscheinlichkeiten Die Wahrscheinlichkeitsfunktion einer Zufallsvariablen bestimmt lediglich, was bei einer realen Durchführung des Zufallsexperimentes für die beobachteten Häufigkeiten zu erwarten ist Definition Folgerungen Poisson Kolmogoroff p(x1) = 0.2 p(x2) = 0.4 f(x1) ≈ 0.18 f(x2) ≈ 0.33 Folie 15 p(x3) = 0.1 … Theorie f(x3) ≈ 0.15 … Empirie Frage: Woher kennen wir die Wahrscheinlichkeiten p? Methodenlehre & Statistik VennDiagramme Laplace Wahrscheinlichkeiten Empirische Definition der Wahrscheinlichkeit (Poisson, 1835) – The Law of Large Numbers Definition h( xi ) p X xi : lim n n Folgerungen h( xi ) : Häufigkeit des Ereignisses n : Gesamtzahl aller Versuche Poisson Folie 16 Kolmogoroff Beispiel: Relative Häufigkeit für das Würfeln einer „6“ in Abhängigkeit von der Anzahl der Würfelversuche: Bei unabhängigen Wiederholungen eines Zufallsexperiments strebt die relative Häufigkeit für das Auftreten eines Ereignisses xi gegen die Wahrscheinlichkeit p(X=xi). Methodenlehre & Statistik Definition Bedingte Wk Satz von Bayes Bedingte Wahrscheinlichkeit Einführendes Beispiel Theoreme Wk-Bäume Unabhängigkeit Bei den Bundesjugendspielen interessiert sich ein Sportpsychologe für den Zusammenhang zwischen unterirdischem Abschneiden in verschiedenen Disziplinen. Er erhebt dazu ● Verfehlen (A) oder Erreichen (nicht A) des Zeitkriteriums beim 100m Lauf ● Negative (B) bzw. positive (nicht B) Weite beim Ballwurf. Der Sportpsychologe beobachtet an n=100 Kindern ● p(A) = 0.12 ● p(B) = 0.05 ● p(A B) = 0.04 Folie 17 Methodenlehre & Statistik Definition Bedingte Wk Bedingte Wahrscheinlichkeit p( A B) p ( B | A) p ( A) Theoreme Wk-Bäume Unabhängigkeit Satz von Bayes Bedingte Wahrscheinlichkeit Grundwahrscheinlichkeit Ist die Wahrscheinlichkeit für das Ereignis B, gegeben dass das Ereignis A bereits eingetreten ist (lies: „B gegeben A“). Im Venn Diagramm kann p(B | A) als Anteil der Fläche A B an der Fläche A interpretiert werden (und nicht mehr am gesamten Stichprobenraum ). Folie 18 (Unbedingte) Verbundwahrscheinlichkeit A AB B Methodenlehre & Statistik Definition Bedingte Wk Satz von Bayes Bedingte Wahrscheinlichkeit Im Laplace Ansatz Theoreme Es seien n die Menge aller Elementarereignisse in . Wk-Bäume a die für das Ereignis A günstigen Elementarereignisse b die für das Ereignis B günstigen Elementarereignisse c die für das Ereignis A B günstigen Elementarereign. Unabhängigkeit 100m Verfehler negative Weite a p ( A) n b p( B) n a c b n c c p( A B) und p ( B | A) n a Folie 19 c und p ( A | B ) b Methodenlehre & Statistik Definition Bedingte Wk Satz von Bayes Bedingte Wahrscheinlichkeit Im Laplace Ansatz Theoreme Es seien n die Menge aller Elementarereignisse in . Wk-Bäume a die für das Ereignis A günstigen Elementarereignisse b die für das Ereignis B günstigen Elementarereignisse c die für das Ereignis A B günstigen Elementarereign. Unabhängigkeit Es ist also zunächst p(A) = a / n p(B) = b / n p(AB) = c / n Aus dem Venn Diagramm sah man auch: p(B | A) = c / a Umformen und Kürzen ergibt Folie 20 p ( B | A) c p( A B) a p ( A) Methodenlehre & Statistik Definition Bedingte Wk Satz von Bayes Bedingte Wahrscheinlichkeit Im Kolmogoroff Ansatz Theoreme Wk-Bäume Unabhängigkeit In der axiomatischen Definition der Wahrscheinlichkeit kann die Berechnungsvorschrift für bedingte Wahrscheinlichkeiten nicht bewiesen werden. Deshalb muss die bedingte Wahrscheinlichkeit hier definiert werden: ! p( A B) p ( B | A) p ( A) Folie 21 Methodenlehre & Statistik Definition Bedingte Wk Satz von Bayes Bedingte Wahrscheinlichkeit Der Multiplikationssatz Theoreme Man sieht sofort dass gilt: p(A B) = p(B A) Wk-Bäume Damit erhalten wir durch Umformen Unabhängigkeit p ( B | A) p( A B) p ( A) p ( A B ) p( B | A) p( A) p( A | B) p( A B) p( A | B) p( B) Multiplikationssatz Folie 22 p( A B) p( B) Methodenlehre & Statistik Definition Theoreme Wk-Bäume Bedingte Wk Satz von Bayes Satz der totalen Wahrscheinlichkeit Wenn die Ereignisse B1, B2, … Bk paarweise disjunkt sind und das Ereignis A immer mit einem der Bi auftritt, gilt A = (AB1) + (AB2) + … + (ABk) Mit dem Additionsthorem erhalten wir Unabhängigkeit p ( A) p ( A B1 ) p ( A Bk ) Bk … B1 B2 … … … … A Und mit dem Multiplikationssatz wird daraus p ( A) p ( B1 ) p ( A | B1 ) p ( B2 ) p ( A | B2 ) p ( Bk ) p ( A | Bk ) Folie 23 Satz der totalen Wahrscheinlichkeit Methodenlehre & Statistik Bedingte Wk Satz von Bayes Definition Wahrscheinlichkeitsbäume Theoreme Additions- und Multiplikationssatz für bedingte Wahrscheinlichkeiten lassen sich gut an einem Wahrscheinlichkeitsbaum veranschaulichen. Wk-Bäume Ereignis B, gegeben A Ereignis A p(B1|A1) A1 p(B2|A1) Unabhängigkeit p(A1) p(B1|A2) S p(A2) A2 B1 B2 B1 p(B1|A1)p(A1) p(B2|A1)p(A1) p(B1|A2)p(A2) B2 p(B |A )p(A ) 2 2 2 p(A3) A3 B1 p(B1|A3)p(A3) p(B2|A3) B2 Folie 24 Man sieht auch: p(A1B1+A2B1 +A3B1)= p(B2|A2) p(B1|A3) Multiplikationssatz für Wahrsch.keiten p(B2|A3)p(A3) p(B1|A1)p(A1)+ p(B1|A2)p(A2)+ p(B1|A3)p(A3) Satz der totalen Wahrscheinlichkeit Methodenlehre & Statistik Definition Bedingte Wk Satz von Bayes Stochastische Unabhängigkeit Wenn gilt: Theoreme Wk-Bäume Unabhängigkeit p(B) = p(B | A) werden die Ereignisse A und B stochastisch unabhängig genannt, weil die Wahrscheinlichkeit des Auftretens des Ereignisses B nicht vom Auftreten von A abhängt. Setzen wir die rechte Seite der Gleichung in den Multiplikationssatz ein, erhalten wir: p(A B) = p(B | A) p(A) = p(A)·p(B) Kurz: Folie 25 p(A B) = p(A)·p(B) Multiplikationssatz für stoch. unabh. Ereignisse Methodenlehre & Statistik Definition Bedingte Wk Satz von Bayes Stochastische Unabhängigkeit Verallgemeinerung des Multiplikationssatzes Theoreme Wk-Bäume Unabhängigkeit Wenn die Ereignisse A1, A2, … Ak insgesamt unabhängig sind, so gilt p(A1A2… Ak) = p(A1)·p(A2)·… ·p(Ak) Achtung: Die Disjunktheit von Ereignissen hat mit der stochastischen Unabhängigkeit nichts zu tun. A und B sind disjunkt (A B = {}). Wenn aber A eingetreten ist, reduziert sich p(B|A) auf Null. Folie 26 A B Methodenlehre & Statistik Definition Bedingte Wk Satz von Bayes Stochastische Unabhängigkeit Wechselseitigkeit Theoreme Wk-Bäume Für stochastisch unabhängige Ereignisse kann man aus den Kolmogoroff Axiomen allgemeine Regeln herleiten: 1. Ist A von B unabhängig, so ist es auch B von A Unabhängigkeit 2. Sind A und B unabhängig, so sind es auch ihre Gegenereignisse 3. Sind A und B unabhängig so sind es auch alle Kombination von A und B mit ihren Gegenereignissen Folie 27 Methodenlehre & Statistik Beispiel Bedingte Wk Satz von Bayes Satz von Bayes Beispiel Definition Ein Statistikdozent in der Psychologie fragt sich, ob das Bestehen seiner Fachprüfung überhaupt etwas über die Eignung eines bereits immatrikulierten Psychologiestudierenden für das Studium aussagt. Er erhebt dazu in zwei Semestern mehrere Wahrscheinlichkeiten: ● p(Klausurverfehler) = 0.05 ● p(Studiumsgeeignete) = 0.95 ● p(Klausurverfehler Studiumsgeeignete) = 0.045 in Semester I oder ● p(Klausurverfehler Studiumsgeeignete) = 0.005 in Semester II Folie 28 Methodenlehre & Statistik Beispiel Bedingte Wk Satz von Bayes Satz von Bayes Beispiel Definition Studiumsgeeignete Folie 29 Studiumsgeeignete Klausurverfehler Klausurverfehler Methodenlehre & Statistik Beispiel Bedingte Wk Satz von Bayes Satz von Bayes Beispiel Definition Studiumsgeeignete Folie 30 Studiumsgeeignete Klausurverfehler Klausurverfehler Methodenlehre & Statistik Beispiel Definition Bedingte Wk Satz von Bayes Satz von Bayes Wir sehen anhand des Multiplikationssatzes, dass p(B | A) p(A) = p(A | B) p(B) Damit gilt p ( B | A) p( A | B) p( B) p ( A) bzw. p( A | B) p ( B | A) p ( A) p( B) Die bedingte Wahrscheinlichkeit eines Ereignisses A gegeben B ist zu berechnen aus der Wahrscheinlichkeit für B gegeben A und den Grundwahrscheinlichkeiten von A und B. Diese Beziehung ist der Satz von Bayes. Folie 31 Methodenlehre & Statistik Beispiel Bedingte Wk Satz von Bayes Satz von Bayes Verallgemeinerung Definition Hat man mehrere Ereignisse B1, B2, …, Bk gilt beim Satz von Bayes p ( A | Bi ) p( Bi ) p ( Bi | A) p ( A) vorausgesetzt, dass die Grundwahrscheinlichkeit für A bekannt ist. Häufig kennt man aber nur alle p(A|Bi). Mit dem Satz der totalen Wahrscheinlichkeit erhält man aus dem Satz von Bayes diese allgemeine Bayes-Formel: p ( Bi | A) Folie 32 p ( A | Bi ) p ( Bi ) p ( A | B1 ) p ( B1 ) p ( A | B2 ) p ( B2 ) p ( A | Bk ) p ( Bk ) Methodenlehre & Statistik Relevante Excel Funktionen Wahrscheinlichkeitsrechnung • Zufallszahl(), Zufallsbereich() Folie 33