Wichtige Verteilungen der Biostatistik Klassifizierung der

Werbung

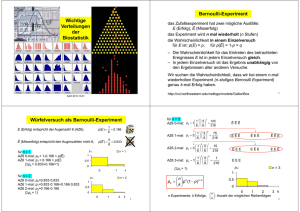

Wiederholung Wichtige Verteilungen der Biostatistik Klassifizierung der Verteilungen diskrete Verteilungen diskrete Gleichverteilung Binomialverteilung Poisson Verteilung ... kontinuierliche Verteilungen kontinuierliche Gleichverteilung Normalverteilung Chi-Quadrat Verteilung t-Verteilung ... diskrete Zufallsgröße kontinuierliche Zufallsgröße zB: Anzahl der Kranken, Augenzahl des Würfels zB: Blutdruck, Körperhöhe,... 2 KAD 2011.10.06 Wiederholung Diskrete Gleichverteilung p(k) 1 p( k ) = , 6 Bernoulli-Experiment Kontinuierliche Gleichverteilung das Zufallsexperiment hat zwei mögliche Ausfälle: E (Erfolg), Ē (Misserfolg) das Experiment wird n mal wiederholt (n Stufen) die Wahrscheinlichkeit in einem Einzelversuch für E ist: p(E) = p, für p(Ē) = 1-p = q ⎧ 1 , für a ≤ x ≤ b ⎪ b−a f (x) = ⎨ ⎪ sonst ⎩ 0, k = 1, 2, ..., 6 1/6 1 2 3 4 5 k 6 – Die Wahrscheinlichkeit für das Eintreten des betrachteten Ereignisses E ist in jedem Einzelversuch gleich. – In jedem Einzelversuch ist das Ergebnis unabhängig von den Ergebnissen aller anderen Versuche. f(x) 0.2 p(k) 1 b−a 0.1 a k 0 1 2 3 4 5 6 x b 3 Wir suchen die Wahrscheinlichkeit, dass wir bei einem n-mal wiederholten Experiment (n-stufiges Bernoulli Experiment) genau k-mal Erfolg haben. 4 für n = 3 0 3 125 ⎛ 1⎞ ⎛5⎞ AZ6 0-mal: p0 = 1 ⎜ ⎟ ⎜ ⎟ = Würfelversuch als Bernoulli-Experiment 1 = 0.166 6 E (Erfolg) entspricht der Augenzahl 6 (AZ6), p(E ) = Ē (Misserfolg) entspricht den Augenzahlen nicht 6, 5 p(E ) = = 0.833 6 pk für n = 1 AZ6 0-mal: p0 = 1-0.166 = p(Ē) AZ6 1-mal: p1 = 0.166 = p(E) (Σpk = 0.833+0.166=1) ⎝6⎠ ⎝6⎠ 1 2 0 k 0.5 0 1 k 2 5 k 1 0.8 0.6 0.4 1 ⎛ 7 ⎞⎛ 1 ⎞ p1 = ⎜⎜ ⎟⎟⎜ ⎟ ⎝ 1 ⎠⎝ 6 ⎠ 2 6 ⎛5⎞ ⎜ ⎟ = 0.391 ⎝6⎠ 5 ⎛ 7 ⎞⎛ 1 ⎞ ⎛ 5 ⎞ p2 = ⎜⎜ ⎟⎟⎜ ⎟ ⎜ ⎟ = 0.234 ⎝ 2 ⎠⎝ 6 ⎠ ⎝ 6 ⎠ 3 5 ⎛ 7 ⎞⎛ 1 ⎞ ⎛ 5 ⎞ p3 = ⎜⎜ ⎟⎟⎜ ⎟ ⎜ ⎟ = 0.078 ⎝ 3 ⎠⎝ 6 ⎠ ⎝ 6 ⎠ ... n=7 k 0.2 2 3 4 5 0 0 2 1 2 3 4 5 6 0.5 7 0.4 0.3 0.4 0.2 0.2 0.1 0 0 0 1 0 0.7 0.6 0.5 0.4 0.3 0.2 0.1 0 3 1 2 3 4 5 6 0.4 7 8 0.3 0.2 0.1 0 0 1 2 3 0.6 0.5 0.4 0.3 0.2 0.1 0 0 4 1 2 3 4 5 6 7 0.4 8 9 0.3 0.2 0.1 0 1 2 3 4 5 0.4 0.3 0.2 7 0.3 1 0.5 6 7 6 0.4 0.1 0 0 0 1 0.5 0.2 0.8 pk n=3 6 0 0.45 0.4 0.35 0.3 0.25 0.2 0.15 0.1 0.05 0 pk 1 ⎝ ⎠ Binomialverteilung 7 EEE 0 0.6 0 EEĒ 0 1 2 3 k ⎛n⎞ n Experimente, k Erfolge, ⎜⎜ ⎟⎟ : Anzahl der möglichen Reihenfolgen k 1 p(E ) = 6 7 −k ⎛ 7 ⎞⎛ 1 ⎞ ⎛ 5 ⎞ p0 = ⎜⎜ ⎟⎟⎜ ⎟ ⎜ ⎟ = 0.279 ⎝ 0 ⎠⎝ 6 ⎠ ⎝ 6 ⎠ EĒE 0.5 1 für n = 7 ⎛ 7 ⎞⎛ 1 ⎞ ⎛ 5 ⎞ pk = ⎜⎜ ⎟⎟⎜ ⎟ ⎜ ⎟ ⎝ k ⎠⎝ 6 ⎠ ⎝ 6 ⎠ ĒEE 0 ⎛n⎞ pk = ⎜⎜ ⎟⎟ p k (1 − p )n − k ⎝k ⎠ n=2 1 0 ĒĒE 1 3 pk ĒEĒ 1 ⎛ 1⎞ ⎛5⎞ AZ6 3-mal: p3 = 1 ⎜ ⎟ ⎜ ⎟ = 216 ⎝6⎠ ⎝6⎠ (Σpk = 1) 0.5 1 EĒĒ 15 ⎛ 1⎞ ⎛5⎞ AZ6 2-mal: p2 = 3 ⎜ ⎟ ⎜ ⎟ = ⎝ 6 ⎠ ⎝ 6 ⎠ 216 1 für n = 2 AZ6 0-mal: p0=0.833·0.833 AZ6 1-mal: p1=0.833·0.166+0.166·0.833 AZ6 2-mal: p2=0.166·0.166 (Σpk = 1) 2 75 ⎛ 1⎞ ⎛ 5⎞ AZ6 1-mal: p1 = 3 ⎜ ⎟ ⎜ ⎟ = 216 ⎝6⎠ ⎝6⎠ n=1 0 ĒĒĒ 216 0.1 0 0 1 2 3 4 5 0 1 2 3 4 5 6 7 8 0.35 0.3 0.25 0.2 0.15 0.1 0.05 0 9 10 8 0 1 2 3 4 5 6 7 8 9 Bernoulli-Experiment Binomialverteilung Kombinatorik: Sollen k Objekte in beliebiger Reihenfolge aus n Objekten ausgewählt werden, ergeben sich: pk ist die Wahrscheinlichkeit, dass wir bei einem n-stufigen Bernoulli-Experiment genau k-mal Erfolg haben ⎛n⎞ n ⋅ ( n − 1) ⋅ ... ⋅ ( n − k + 1) n! = = ⎜⎜ ⎟⎟ 1 ⋅ 2 ⋅ ... ⋅ k k! ( n − k )! ⎝ k ⎠ die Wahrscheinlichkeit dass die ersten k Versuche Erfolg haben und die anderen misserfolglich sind: p(E, E,...E, E , E ,...E ) = p(E ) ⋅ p(E ) ⋅ ...p(E ) ⋅ p(E ) ⋅ p(E ) ⋅ ...p(E ) = p k (1 − p )n −k Möglichkeiten, wobei n! = 1·2·... ·(n-1)·n. (Kombination aus n Elementen zur Klasse k ohne Wiederholung) zB: n = 3, k = 2 n-k k k n-k Jede andere Reihenfolge der k Ergebnisse und n-k Gegenergebnisse haben die selbe pk(1-p)n-k Wahrscheinlichkeit. Wieviele mögliche Reihenfolgen gibt es? EEĒ ⎛3⎞ 3! 1⋅ 2 ⋅ 3 ⎜⎜ ⎟⎟ = = =3 ⎝ 2 ⎠ 2!⋅1! 1⋅ 2 ⋅ 1 EĒE ĒEE 9 Münzenversuch als Bernoulli-Experiment 10 p(E ) = zwei Münzenversuche: E (Erfolg) entspricht Zahl n=2 0.5 ⎛ n ⎞⎛ 1 ⎞ für p=1/2 vereinfacht sich: pk = ⎜⎜ ⎟⎟⎜ ⎟ ⎝ k ⎠⎝ 2 ⎠ 0.4 0.3 0.2 2 1 ⎛ 1⎞ p0 = 1 ⎜ ⎟ = 4 ⎝2⎠ 0.1 1 0 2 0.6 0.5 0.4 0.3 0.2 0.1 0 2 0 3 0.3 0.2 0.1 0 2 0 1 2 k 2 p0+p1+p2=1 11 0 1 2 3 5 0 1 2 3 4 5 4 5 2 3 4 5 6 6 7 8 1 2 3 4 5 6 7 0.3 0.25 0.2 0.15 0.1 0.05 0 4 0.35 0.3 0.25 0.2 0.15 0.1 0.05 0 1 0 4 0.3 3 0.3 0.25 0.2 0.15 0.1 0.05 0 3 0.4 2 7 0 0.4 1 1 0.3 0.25 0.2 0.15 0.1 0.05 0 1 0 6 0 0.1 0 0.35 0.3 0.25 0.2 0.15 0.1 0.05 0 1 0.2 2 1 ⎛ 1⎞ p1 = 2 ⎜ ⎟ = = 4 2 ⎝2⎠ 1 ⎛ 1⎞ p2 = 1 ⎜ ⎟ = 4 ⎝2⎠ Binomialverteilung pk n 0.6 0.5 0.4 0.3 0.2 0.1 0 0 p=1/2, 1- p =1/2, n=2 ⎛n⎞ pk = ⎜⎜ ⎟⎟ p k (1 − p )n −k ⎝k ⎠ 1 2 8 9 0 1 2 3 4 5 6 7 0.3 0.25 0.2 0.15 0.1 0.05 0 8 9 10 12 0 1 2 3 4 5 6 7 8 9 n: Anzahl der Kinder, k: Anzahl der Kinder mit BG0 Blutgruppenversuch als Bernoulli-Experiment Genotyp IA IA IA i iIA 1 4 1 4 1 4 Wahrscheinlichkeit ii 1 4 A 0 Wahrscheinlichkeit 3 4 1 4 IAi ? IAi Nennen wir als „Erfolg” (E), wenn das Kind eine Blutgruppe 0 hat und „Misserfolg” (Ē), wenn seine Blutgruppe nicht 0 ist. p(E)=1/4=0.25 p(Ē)=3/4=0.75 p(E)+p(Ē)=1 Die Familie hat n Kinder. Wie hoch ist die Wahrscheinlichkeit, dass k Kinder eine Blutgruppe 0 haben? 13 0.8 1 0.6 6 0.3 0.2 0.2 0.1 1 0.6 0.5 0.4 0.3 0.2 0.1 0 0 2 0 3 0.3 0.2 0.1 0 1 2 0.3 0.2 0.1 0 0 1 2 3 5 0.4 0.3 0.2 0.1 0 0 1 2 3 4 5 4 5 2 3 4 5 0 2 3 4 5 6 1 2 3 4 5 6 7 7 0.3 0.25 0.2 0.15 0.1 0.05 0 ⎛ 4⎞ 2 2 p2 = ⎜⎜ ⎟⎟(0.6 ) (0.4 ) = 0.3456 ⎝ 2⎠ 8 ⎛ 4⎞ 3 1 p3 = ⎜⎜ ⎟⎟(0.6 ) (0.4 ) = 0.3456 ⎝3⎠ 9 15 1 2 3 4 5 6 7 8 9 1 k pk 0.6 0.4 0.2 0 n=2 0 p(Ē)=1-p=q 1 k 2 n Experimente, k Erfolge ⎛n⎞ k n −k pk = ⎜⎜ ⎟⎟ p (1 − p ) ⎛n⎞ ⎜⎜ ⎟⎟ : Anzahl der möglichen Reihenfolgen ⎝k ⎠ ⎝k ⎠ 14 8 10 0 Sei: p(E)=p ⎛ 4⎞ 1 3 p1 = ⎜⎜ ⎟⎟(0.6 ) (0.4 ) = 0.1536 ⎝ 1⎠ 9 0 allgemein: ⎛ 4⎞ 0 4 p0 = ⎜⎜ ⎟⎟(0.6 ) (0.4 ) = 0.0256 ⎝0⎠ 7 8 1 für n = 2 (BG0 0-mal:) p0=0,75·0,75 =0,5625 (BG0 1-mal:) p1=0,75·0,25+0,25·0,75=0,375 (BG0 2-mal:) p2=0,25·0,25 = 0,0625 (Σpk = 0,5625+0,375+0,0625=1) zB: 60% der Patienten haben Grippe. Heute kommen 4 Patienten. p=0,6 n=4 6 6 0.35 0.3 0.25 0.2 0.15 0.1 0.05 0 4 0.5 1 0 4 0.4 3 0.35 0.3 0.25 0.2 0.15 0.1 0.05 0 3 0.5 2 7 0 0.4 0 1 0.35 0.3 0.25 0.2 0.15 0.1 0.05 0 1 0.5 n=1 0.5 Bernoulli-Experiment, Binomialverteilung 0 0 Binomialverteilung 0.4 0.4 0 1 0 Fenotyp 1 p(E ) = 4 pk für n = 1 (BG0 0-mal:) p0=0,75=p(Ē) (BG0 1-mal:) p1=0,25=p(E) (Σpk = 0,75+0,25=1) ⎛ 4⎞ 4 0 p4 = ⎜⎜ ⎟⎟(0.6 ) (0.4 ) = 0.1296 ⎝ 4⎠ ⎛ 4⎞ k 4−k pk = ⎜⎜ ⎟⎟(0.6 ) (0.4 ) ⎝k ⎠ 0.4 pk n=4 0.35 0.3 0.25 0.2 0.15 0.1 0.05 0 0 1 2 3 4 k 16 Binomialverteilung Erwartungswert und Streuung der Binomialverteilung p = 0.25 < 0.5 p = 0.5 p = 0.75 > 0.5 rechtsschief symmetrisch linksschief 0.4 Erwartungs wert( x i ) = 1⋅ p + 0 ⋅ (1 − p ) = p pk pk pk 0.4 Tritt ein bestimmtes Ergebnis mit Wahrscheinlichkeit p ein, so haben wir bei n-maliger Wiederholung etwa np solche Ereignisse zu „erwarten”. μ = np Erwartungswert: Erwartungs wert( X ) = ∑ E ( x i ) = np 0.4 i (identische Einzelprozesse) 0.3 0.3 0.3 0.2 0.2 0.2 theoretische Streuung: 0.1 0.1 0.1 Varianz( x i ) = E ( x i ) − (E ( x i ))2 = 12 p + 0 2 (1 − p ) − p 2 = p − p 2 = p(1 − p ) 0 0 0 1 2 3 4 5 6 7 8 k 2 Varianz( X ) = ∑ Varianz( x i ) = np(1 − p ) 0 0 1 2 3 4 5 6 7 8 σ = np(1 − p ) i 0 1 2 3 4 5 6 7 8 k k Die Funktion wird generell für wachsendes n immer „symmetrischer”. 17 in Excel: BINOMDIST(n,k,p,kumuliert?), BINOMVERT(...) zB: 12 Würfelexperimente: Wie oft tritt „6” auf? n = 12, p = 1/6, μ = 2 σ= 60 ≈ 1.29 6 18 Poisson: Verteilung der seltenen Ereignisse ⎛n⎞ pk = ⎜⎜ ⎟⎟ p k q n −k ⎝k ⎠ n→∞ p→0 pk = np=λ λk −λ e k! Es ist eine gute Näherung für große n und kleine p Werte Schätzung der seltener Ereignisse Beispiel: Die Wahrscheinlichkeit, dass man eine Krankheit bekommt, ist p=0.001. Wie groß ist die Wahrscheinlichkeit, dass es in einer Stadt mit n = 2000 Einwohner k = 0,1,2… Kranken gibt? 19 20 pk Poisson Verteilung: Beispiel Die Wahrscheinlichkeit, dass man eine Krankheit bekommt, ist p=0.001. Wie groß ist die Wahrscheinlichkeit, dass es in einer Stadt mit n = 2000 Einwohner k = 0,1,2… Kranken gibt? λk 2k − 2 pk = e −λ = e k! k! λ=np=2 pk 0.3 p0 = 20 − 2 e = e −2 = 0,135 0! p1 = 21 −2 e = 2e −2 = 0,271 1! 0.25 22 −2 p2 = e = 2e −2 = 0,271 2! 0.2 0.15 0.1 p3 = 0.05 0 0 1 2 3 4 5 6 7 8 9 10 k 0.4 Varianz: Theoretische Streuung: λ 0.35 1 2 3 4 5 6 7 8 9 10 0.3 0.25 0.2 0.15 0.1 3 2 −2 8 −2 e = e = 0,181 3! 6 0.05 k 0 ... 0 21 5 10 15 20 22 Die ausgezeichnete kontinuierliche Verteilung: Normalverteilung Erwartungswert und Streuung der Poisson-Verteilung Erwartungswert: Poisson Verteilung μ=λ − 1 f (x) = e σ 2π Verteilungsdichtefunktion: Varianz(x)=λ Parameter der Normalverteilung: σ= λ f(x) σ Eine Verteilung, wo der Erwartungswert und die Streuung voneinander nicht unabhängig sind! 23 σ μ ( x − μ )2 2σ 2 Erwartungswert: μ Streuung: σ Wendepunkte (die Krümmung der Kurve ändert sich) x 24 Normalverteilung (Gauss-Verteilung) für die dargestellte Funktion: Position des Maximums und die Breite der Kurve e−x μ = 3, σ = 1 Glockenkurve 2 e −( x − μ ) 2 ≈1 ≈1 ≈1 ≈1 x 0 − 1 e σ 2π ( x − μ )2 0 die Breite der Kurve: ~2σ ( x − μ )2 2σ 2 σ σ 25 e − σ σ μ x μ 0 die Fläche unter der Kurve ist 1 2σ 2 Position des Maximums bei μ x 0 μ x 26 Standard - Normalverteilung Normalverteilung f (x) = 1 e 2π − x2 2 0.5 = N (0,1) μ=0 σ=1 0 -4 -3 -2 -1 0 1 2 3 0 1 2 3 4 0.5 0 27 -4 -3 -2 -1 28 4 t-Verteilungsfamilie Verteilung der Summe von Zufallsvariablen Beispiel Wir werfen mit ein/zwei Würfeln. Welche Verteilung hat die Summe der Augenzahlen? mit einem Würfel – Gleichverteilung mit zwei Würfeln? – keine Gleichverteilung! „Glockenkurven” p(Augenzahl) p(Augenzahl) 1/ 6 1/ 6 Je größer ist der Freiheitsgrad, desto schmaler ist die Kurve. 1 2 3 4 5 6 Augenzahl p(Augenzahl) 1/ 36 1/ 6 t ∞ ≡ N (0, 1) 1 2 3 4 5 6 7 8 9 10 11 12 Σ Augenzahl 1 2 3 4 5 6 Augenzahl 29 30 Pr.Buch Anhang S.27.2 Stabile und nicht stabile Verteilungen Verteilung der Summe von Zufallsvariablen Der Verteilungstyp ist stabil, wenn die Summe von zwei unabhängigen indentisch verteilten Zufallsvariablen auch denselben Verteilungstyp besitzt. x1 und x2 sind unabhängige Zufallsvariablen. Beide folgen dergleichen Verteilung mit Erwartungswerten μ1 bzw. μ2 und Streuungen σ1 bzw. σ2. Welcher Verteilung folgt die Summe: x = x1 + x2 ? f(x2) f( x1) nicht stabile Verteilungen: Gleich- Beispiel: x1 und x2 sind unabhängige Zufallsgrößen. Beide folgen einer Normalverteilung mit Erwartungswerten μ1 bzw. μ2 und Streuungen σ1 bzw. σ2. x1 + x 2 ? Welcher Verteilung folgt der Durchschnitt x = f( x ) σ σ2 σ1 stabile Verteilungen: Normal-, Binomial-, Poisson- 2 μ1 x1 μ2 x2 μ x x hat eine Verteilung mit Erwartungswert μ=μ1+μ2 und Varianz σ 2 = σ 12 + σ 22 die additive Größe ist die Varianz, nicht die Streuung! x hat eine Normalverteilung mit Erwartungswert und Varianz 31 σ2 = 2 σ1 + σ 2 22 2 μ= μ1 + μ 2 2 2 2 ⎞ ⎛ ⎜ σ = (σ 1 + σ 2 ) ⎟ ⎜ ⎟ 2 ⎝ ⎠ 32 Die Summe der Verteilungsfunktionen konvergiert gegen eine Normalverteilung auch wenn die einzelnen Zufallsgrößen keine Normalverteilung haben. eine sogenannte χ2 –Verteilung mit n Freiheitsgraden 0.005 Biologische Bedeutung: Wenn ein Parameter (zB. Körpergröße, Blutzuckerkonzentration) durch viele (n →∞) anderen Faktoren (Zufallsgrößen) beeinflusst wird, folgt dieser Parameter einer Normalverteilung. μ =n 0 χ n2 = x12 + x 22 + ... + x n2 0.02 i =1 2 σ 2 = 2n 33 6 2 4 6 8 der Modalwert der Verteilungen mit Freiheitsgrad n > 2: (n-2) 10 34 Freiheitsgrad 0.4 x ( x + x + ... + x ) n 2 n 20 10 4 0.2 Die t-Verteilung ist breiter als die Normalverteilung. folgt einer t-Verteilung mit Freiheitsgrad n. Die t-Verteilung ist symmetrisch, μn=0 (n ≥ 2), die Streuung ist: (n ≥ 3) n σ= n−2 200 f(t) Die Verteilungskurve der t-Verteilung ähnelt einer Glockenkurve (wenn n→∞). x, x1, x2 ,... xn sind unabhängige, standardnormalverteilte Zufallsgrößen. Dann die Größe 2 2 5 0 t-Verteilung (Student-Verteilung) 2 1 4 Die Kurven der t-Verteilungen Wichtige Verteilungen der analytischen Statistik tn = 3 0.015 Wenn x1, x2,….xn unabhängige standardnormalverteilte Zufallsgrößen sind, dann hat die Zufallsgröße 1 0.01 Khi-Quadrat (χ2) Verteilung Es seien x1, x2,….xn unabhängige Zufallsgrößen, die alle derselben Verteilung haben. Die Verteilung der Summe n nähert sich einer Normalverteilung, wenn n→∞ . Sn = ∑ x i 0.025 Wichtige Verteilungen der analytischen Statsitik Zentraler Grenzwertsatz 2 t 0 35 -5 -3 -1 1 3 365 Überblickstabelle Überblickstabelle Lagemaße Variabilitätsmaße i i x= ∑ xi s = 2 i ∑ (x x = ∑ x i h( x i ) s2 = μ= 2 n ∑x 2 i i n i kont. Verteilung − x) i ⎛ ∑ xi ⎜ −⎜ i ⎜ n ⎝ ⎞ ⎟ ⎟ ⎟ ⎠ σ = ∫ ( x − μ ) f ( x )dx ∫ xf ( x )dx 2 2 37 Kontinuierliche Verteilungen x ( x + x + ... + x n2 ) n 2 1 x12 + x 22 + ... + x n2 1 − ( x − μ )2 , 1 2 e 2σ f (x ) b − a σ 2 π a≤x≤b Standardnormal1 e 2π −x2 2 1 n ⎛n⎞ k ⎜⎜ ⎟⎟ p (1 − p )n −k ⎝k ⎠ μ n +1 2 np λ σ2 n2 − 1 12 np(1 − p ) λ λk k! e −λ 38 Überblickstabelle Normal- pk Poisson- −∞ −∞ kontinuir. Gleich- Binomial- 2 +∞ +∞ diskrete Gleich- i n empirische Werte Diskrete Verteilungen σ 2 = ∑ ( x i − μ )2 p( x i ) μ = ∑ x i p( x i ) diskrete Verteilung KhiQuadratn 1 ⎛n ⎞ ⎜ − 1⎟!2 ⎝2 ⎠ n 2 2 2 t−1 − x2 e x 2 t= x −μ s/ n f (t ) = K ⎛ t2 ⎞ ⎜⎜1 + ⎟⎟ f ⎠ ⎝ μ a+b 2 μ 0 n 0 n≥2 σ2 ( b − a )2 12 σ2 1 2n n n−2 n≥3 39 f +1 2