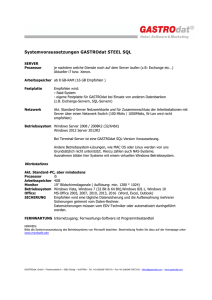

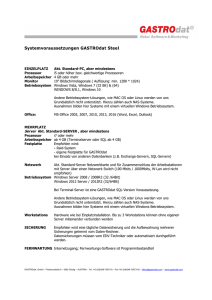

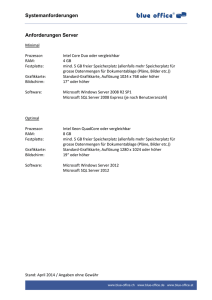

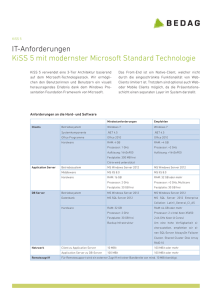

Hardware (PC)

Werbung