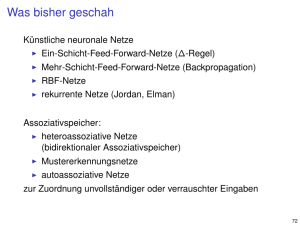

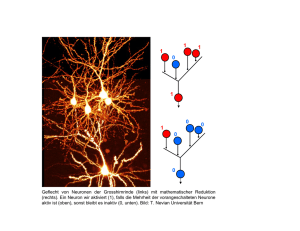

Untersuchungen zur Kartenbildung richtungsselektiver Neuronen

Werbung