Öffnen - MPG.PuRe

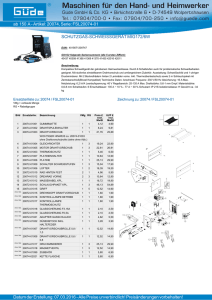

Werbung