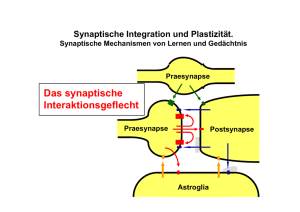

Synaptische Verschaltung

Werbung

Synaptische Verschaltung 16.1.2006 http://www.uni-oldenburg.de/sinnesphysiologie/ 15246.html Vorläufiges Vorlesungsprogramm 17.10.05 24.10.05 31.10.05 07.11.05 14.11.05 21.11.05 28.11.05 05.12.05 12.12.05 08.01.06 16.01.06 23.01.06 30.01.06 06.02.06 Motivation Passive Eigenschaften von Neuronen Räumliche Struktur von Neuronen Aktive Eigenschaften von Neuronen Das Hodgkin-Huxley Modell Kodierung sensorischer Reize + Modellsimulation Analysemethoden und Kodierungsprinzipien Variabilität neuronaler Antworten Stimulusschätzung und Informationstheorie Zwei Modelle retinaler Verarbeitung Synaptische Verschaltung Entstehung rezeptiver Felder Künstliche Neuronale Netze Lernen in natürlichen und künstlichen Netzwerken Programm Wiederholung: Synaptische Übertragung Modell synaptischer Übertragung Synaptische Integration Grundlegende Verschaltunsarten in neuronalen Netzen Elektrische Synapsen Direkter Ionenfluss durch gemeinsam gebildete Membranporen Modellierbar durch einen Widerstand Chemische Synapsen Umkodierung von elektrischen in chemische und zurück in elektrische Signale Die Wirkung chemischer Synapsen hängt vom Rezeptor ab Chemische Synapsen arbeiten stochastisch Informationsübertragung chemischer Synapsen ist eine Abfolge stochastischer Prozesse z.B. Transmitteraussüttung entspricht Binominalverteilung: Wahrscheinlichkeit, dass eine Synapse k Quanten Transmitter abgibt, wenn sie n Bindungsstellen hat, die jeweils mit Wahrscheinlichkeit p ein Vesikel abgeben: z.B. für n=3 Bindungsstellen mit p=1/3 : p(3,0)=8/27, p(3,1)=12/27, p(3,2)=6/27, p(3,3)=1/27 Postsynaptische Potentiale (PSP) sind variabel Einzelne EPSPs: Typischerweise wird nur bei 10-90% der präsynaptischen APs überhaupt ein postsynaptisches Potential ausgelöst Die Amplitude der PSPs hängt linear von der Anzahl ausgeschütteter Transmitterqanten ab und ist entsprechend variabel Gemitteltes EPSP: Gängige, stark vereinfachte Annahme: Modellierung des mittleren postsynaptischen Potentials Aber: Das ignoriert stochastische Prozesse und Änderungen der synaptischen Stärke! Postsynaptischer Strom (PSC) Esyn Esyn ≈ Voltage Clamp: Maximalwert des EPSCs hängt linear von der Membranspannung ab. Das PSC wird durch einen kurzzeitigen Anstieg der Membranleitfähigkeit gsyn bewirkt. Isyn(t) = gsyn(t)(U(t)-Esyn) Differentialgleichung Ersatzschaltbild Strominjektion Differentialgleichung Differentialgleichung Differentialgleichung Differentialgleichung Differentialgleichung passive Membran in passive Membran für passive Membran fürfür passive Membran innen; U i Ui nen; Uinnen; i ie ie ie nach Kirchhoffscher Regel: ie =ieic=+iciier+=iric + ir ir i c+ir+iinj=0 i r ir i = C • dU(t)/dt c m i = C • dU(t)/dt R m U(t) i = C • dU(t)/dt c m c m Rm U U(t) Rm U(t) i inj (t) m Um(t) Um(t) Cm i = U(t)/R r m E ir =mm⋅(dU(t)/dt) U(t)/R i c =C R i = U(t)/R m E r ER R i r=(U(t)-E R)/Rm Zusätzlich: i Zusätzlich Zusätzlich: ie e ie außen; U außen; Spikeßen; U e e Ue SpikeSpikeSchwelle! Schwelle! Schwelle! => dU(t)/dt = -(1/τ)⋅(U(t)-ER)-iinj(t)/Cm ic mit τ=Rm⋅Cm Ersatzschaltbild synaptischer Differentialgleichung Differentialgleichung Differentialgleichung Differentialgleichung Differentialgleichung Differentialgleichung Eingang in passiver Membran für passive Membran für passive Membran für passive Membran innen; U i Ui nen; Uinnen; i ie ie ie nach Kirchhoffscher Regel: i c+ir+isyn=0 ie =ieic=+iciier+=iric + ir i Formel für PSC: iirsyn i r r i = C • dU(t)/dt c m i = C • dU(t)/dt R m U(t) i = C • dU(t)/dt c m c m Rm U U(t) Rm U(t) R syn i syn(t) = gsyn(t)(U(t)-Esyn) (t) m U (t) Um(t) m Cm i = U(t)/R r m E E syn ir =m also: U(t)/R R i = U(t)/R m ER r ER g syn(t)(U(t)-E syn) = Zusätzlich: i Zusätzlich Zusätzlich: ie e ie C m⋅(dU(t)/dt) + außen; U außen; Spikeßen; U e e Ue SpikeSpike(U(t)-ER)/Rm Schwelle! Schwelle! Schwelle! => dU(t)/dt = -(1/τ)⋅(U(t)-ER)-(gsyn(t)/Cm)⋅(U(t)-Esyn) ic mit τ=Rm⋅Cm Kombination mehrerer synaptischer Inputs Wenn N Synapsen integriert werden: dU(t)/dt = -(1/τ)⋅(U(t)-ER)-∑(gsyn,i(t)/Cm)⋅(U(t)-Esyn,i) i Stimulation eines präsynaptischen Neurons bewirkt im Cortex häufig ein schnelles EPSP ein schnelles IPSP (durch GABAA erhöhte CL--Leitfähigkeit) ein langsames IPSP (durch GABAB erhöhte K+-Leitfähigkeit) α-Funktion als Modell für synaptischen Input isyn(t) = gsyn(t)(U(t)-Esyn) dU(t)/dt = -(1/τ)⋅(U(t)-ER)-(gsyn(t)/Cm)⋅(U(t)-Esyn) Esyn<ER Esyn>ER Modell für gsyn: -t/tpeak gsyn(t)=const⋅te 3 Fälle: Esyn>ER Esyn<ER Esyn>ER EPSP Esyn<ER IPSP Esyn≈ER shunting inhibition Kombination von Excitation und Shunting Inhibition Wenn N Synapsen integriert werden: dU(t)/dt = -(1/τ)⋅(U(t)-ER)-∑(gsyn,i(t)/Cm)⋅(U(t)-Esyn,i) i Neuron mit einer excitatorischen und einer shunting inhibition Synapse, die gleichzeitig lange Zeit aktiv sind: dU(t)/dt = -(1/τ)⋅(U(t)-ER) -(ge/Cm)⋅(U(t)-Ee) -(gi/Cm)⋅(U(t)-ER) Shunting Inhibition bewirkt kleinere, schnellere EPSPs Die Idee künstlicher neuronaler Netze Künstliche neuronale Netze sind an synaptisch miteinander verkoppelte Neurone angelehnt Es wird ein gekoppeltes Gleichungssystem aufgestellt, bei dem für jedes Neuron die Feuerrate berechnet wird dUi(t)/dt = -(1/τ)⋅Ui(t)+iinj/Cm+∑wij⋅fj(t)/Cm j wij = synaptisches Gewicht von Neuron j zu Neuron i fj(t)=g(Ui(t)) = Feuerrate von Neuron j, ermittelt mit stationärer Nichtlinearität g Noch weitere Vereinfachung für zeitlich diskret bestimmte Aktivität von Neuron i: fi(t)=g(∑w ij⋅fj(t-1)) j Bedeutung der Parameter künstlicher neuronaler Netze fi(t)=g(∑wij⋅fj(t-1)) j Die Funktion g setzt die gewichtete, summierte Aktivität der präsynaptischen Neurone in eine Feuerrate um. Normalerweise ist g nichtlinear, z.B. eine Sigmoidfunktion. Das synaptische Gewicht wij fasst zusammen: Die Anzahl Vesikelbindungsstellen Die Wahrscheinlichkeit der Transmitterfreisetzung Den postsynaptischen Effekt eines Transmitterquantum Excitation: wij>0, Inhibition: wij<0 Ziel der meisten Studien: Finden optimaler wij bei festem g Grundlegende Verschaltungen: 1:1-Verschaltung präsynaptisch postsynaptisch + - + - Bedeutung: 1. Prä- und postsynaptische Zelle haben gleiche rezeptive Felder 2. Topologie-erhaltende Abbildung des Reizortes Die Aktivität eines präsynaptischen Neurons wird gewichtet an ein postsynaptisches Neuron übertragen Dabei kann durch Inhibition eine Vorzeichenumkehr stattfinden Grundlegende Verschaltungen: Konvergenz präsynaptisch postsynaptisch +- +- Bedeutung: 1. Räumliche Vergrößerung des rezeptiven Feldes 2. Komplexe Struktur des rezeptiven Feldes 3. Zeitlicher Vergleich der Inputs möglich 4. Erhöhte Zuverlässigkeit bei redundanten Inputs Die Aktivität mehrerer präsynaptischer Neuronen wird durch ein postsynaptisches Neuron integriert Die synaptischen Verbindungen können unterschiedlich stark sein Excitation und Inhibition (auch shunting inhibition) können gemischt auftreten Das postsynaptische Neuron nimmt eine “Mittelung” der gewichteten präsynaptischen Aktivitäten vor In biologischen neuronalen Netzen ist die Interaktion nichtlinear Konvergenz: Integration vs Koinzidenzdetektion präsynaptisch postsynaptisch +- +- z.B. Ermittlung von Reizintensität durch zeitliche Integration im visuellen Cortex z.B. Vergleich zwischen Ohren bei Richtungshören im auditorischen Cortex Zusätzlich zur räumlichen hat Konvergenz auch eine zeitliche Komponente Wichtiger Parameter: Zeitskala der Konvergenz lange Integrationszeiten bedeuten zeitliche Integration => Ratencode kurze Integrationszeiten ermöglichen Koinzidenzdetektion => Zeitcode Grundlegende Verschaltungen: Divergenz präsynaptisch postsynaptisch + - + - Bedeutung: 1. Mehrere präsynaptische Neurone mit gleichem rezeptiven Feld 2. Erhöhte Zuverlässigkeit der Populationsantwort bei unzuverlässigen Synapsen Die Aktivität eines präsynaptischen Neurons wird an mehrere postsynaptische Neurone weitergegeben Die synaptischen Verbindungen können unterschiedlich stark sein In künstlichen neuronalen Netzen kann ein Neuron normalerweise sowohl erregende als auch hemmende Synapsen bilden Bei biologischen Neuronen ist nur für manche Transmitter Excitation und Inhibition möglich Grundlegende Verschaltungen: Vorzeichenumkehr präsynaptisch + postsynaptisch - + Bedeutung: 1. Möglichkeit, Excitation und Inhibition zu kombinieren 2. Hemmung eines “Gegenspielers” bewirkt indirekte Verstärkung Die Aktivität eines präsynaptischen Neurons wird sowohl direkt an postsynaptische Neurone, als auch an postynaptische Interneurone weitergegeben, die bei der weiteren Verschaltung das Vorzeichen umkehren Grundlegende Verschaltungen: komplette Vernetzung präsynaptisch Alle präsynaptischen Neuron sind mit allen postsynaptischen verbunden postsynaptisch Synaptische Gewichte können unterschiedlich und Excitation und Inhibition gemischt sein (soweit Transmitterausstattung biologischer Neurone das zulässt) Bedeutung: 1. Postsynaptische Zellen können komplexe rezeptive Felder haben 2. Vorteile von Konvergenz und Divergenz werden kombiniert Normalfall für künstliche neuronale Netze, die häufig mit zufällig gewählten Gewichten einer kompletten Vernetzung initialisiert werden Grundlegende Verschaltungen: Reziproke Vernetzung (Feedback) Selbsterregung Selbsterregung Selbsthemmung + + - + - Bedeutung: 1. Aktivität hängt nicht nur von sensorischen Inputs ab 2. Es können sich typische Aktivitätsmuster entwickeln 3. Besonders wichtig bei Taktgeber-Netzwerken Zwei Neurone sind wechselseitig miteinander verschaltet Information fließt im Kreis, Neurone sind also gleichzeitig präund postsynaptisch zu sich selbst z.B. Stomatogastrisches Ganglion: Grundlegende Verschaltungen: Rekurrente Vernetzung (Feedback) Allgemeiner Fall des Feedbacks Mehrere Neurone sind im Kreis miteinander verbunden Es gibt also keine eindeutig geschichtete Struktur Bedeutung: 1. Netzwerk-intrinsische Aktivität überlagert stimulus-getriebene 2. Definition von rezeptiven Feldern wird schwierig (oder unmöglich) Alle Kombinationen aus Erregung und Hemmung sind möglich Neurone können an mehreren Feedback-Schleifen beteiligt sein Normalfall kortikaler Verarbeitung Bei künstlichen neuronalen Netzen sehr mächtig, aber schwer analysierbar Der Normalfall: Kombination vieler Möglichkeiten Hausaufgabe Durch welche Verschaltungsmuster können rezeptive Felder mit Zentrum-Umfeld Organisation entstehen? Programm (revisited) Wiederholung: Synaptische Übertragung Chemische Synapsen übertragen Information durch eine Abfolge stochastischer Prozesse Modell synaptischer Übertragung Integration der durch chemische Synapsen bewirkten Leitfähigkeitsänderung in das Ersatzschaltbild Synaptische Integration Die Leitfähigkeitsänderungen mehrerer chemischer Synapsen können nichtlinear interagieren Grundlegende Verschaltunsarten in neuronalen Netzen Durch Kombination aus Konvergenz, Divergenz und Rekurrenz ergeben sich komplexe Antworteigenschaften