B - Uni Mainz

Werbung

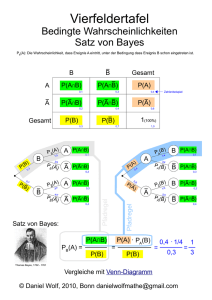

Methoden der Psychologie Prof. Dr. G. Meinhardt 2. Stock, Nordflügel R. 02-429 (Persike) R. 02-431 (Meinhardt) Forschungsstatistik I Sprechstunde jederzeit nach Vereinbarung Dr. Malte Persike } [email protected] WS 2008/2009 Fachbereich Sozialwissenschaften Psychologisches Institut Johannes Gutenberg Universität Mainz Methoden der Psychologie Probleme der Laplace-Wk Wk Definition Kolmogoroff Kolmogoroff-Wk Bedingte Wk Bedingte Wahrscheinlichkeit P( A ∩ B) P ( B | A) = P ( A) Ist die Wahrscheinlichkeit für das Ereignis B, gegeben dass das Ereignis A bereits eingetreten ist (lies: „B gegeben A“). Bedingte Wk Satz von Bayes Die Wahrscheinlichkeit P(A) wird als Grundwahrscheinlichkeit bezeichnet. P(B | A) wird bedingte Wahrscheinlichkeit genannt. A A∩B B Im Venn Diagramm kann P(B | A) als Anteil der Fläche A ∩ B nicht mehr am gesamten Stichprobenraum S, sondern nur noch an der Fläche A interpretiert werden. S Methoden der Psychologie Probleme der Laplace-Wk Kolmogoroff-Wk Bedingte Wk Bedingte Wahrscheinlichkeit Im Laplace Ansatz Es seien Wk Definition Kolmogoroff a die für das Ereignis A günstigen Elementarereignisse b die für das Ereignis B günstigen Elementarereignisse c die für das Ereignis AB (bzw. A ∩ B) günstigen El.e. Bedingte Wk n die Menge aller Elementarereignisse. Dann ist zunächst Satz von Bayes P(A) = a / n P(B) = b / n P(AB) = c / n Aus dem Venn Diagramm sieht man auch: P(B | A) = c / a Durch n/n teilen ergibt c P( A ∩ B) n P ( B | A) = = a P ( A) n Methoden der Psychologie Probleme der Laplace-Wk Kolmogoroff-Wk Bedingte Wk Bedingte Wahrscheinlichkeit Im Kolmogoroff Ansatz Wk Definition Kolmogoroff In der axiomatischen Definition der Wahrscheinlichkeit kann die Berechnungsvorschrift für bedingte Wahrscheinlichkeiten nicht bewiesen werden. Bedingte Wk Deshalb muss die bedingte Wahrscheinlichkeit hier definiert werden: Satz von Bayes ! P( A ∩ B) P ( B | A) = P ( A) Methoden der Psychologie Probleme der Laplace-Wk Kolmogoroff-Wk Bedingte Wk Bedingte Wahrscheinlichkeit Das Multiplikationstheorem Man sieht sofort dass gilt: Wk Definition Kolmogoroff Bedingte Wk P(A ∩ B) = P(B ∩ A) Damit erhalten wir durch Umformen P ( B | A) = Satz von Bayes P( A ∩ B) P ( A) ⇔ P ( A ∩ B ) = P( B | A) ⋅ P( A) P( A | B) = P( A ∩ B) P( B) ⇔ P( A ∩ B) = P( A | B) ⋅ P( B) Multiplikationstheorem Methoden der Psychologie Kolmogoroff-Wk Wahrscheinlichkeitsbäume Probleme der Laplace-Wk Additions- und Multiplikationstheorem für bedingte Wahrscheinlichkeiten lassen sich gut an einem Wahrscheinlichkeitsbaum veranschaulichen. Wk Definition Kolmogoroff Ereignis B, gegeben A Ereignis A P(B1|A1) Bedingte Wk A1 P(B2|A1) P(A1) Satz von Bayes Bedingte Wk P(B1|A2) S P(A1) A2 B1 B2 B1 P(B1|A1)P(A1) P(B2|A1)P(A1) P(B1|A2)P(A2) B2 P(B |A )P(A ) 2 2 2 P(A1) A3 Man sieht auch: P(A1B1∪A2B1 ∪A3B1)= P(B2|A2) P(B1|A3) Multiplikationstheorem für Wk‘ten B1 P(B1|A3)P(A3) P(B2|A3) B2 P(B2|A3)P(A3) P(B1|A1)P(A1)+ P(B1|A2)P(A2)+ P(B1|A3)P(A3) Methoden der Psychologie Probleme der Laplace-Wk Wk Definition Kolmogoroff Bedingte Wk Kolmogoroff-Wk Bedingte Wk Satz der totalen Wahrscheinlichkeit Wenn die Ereignisse B1, B2, … Bk paarweise disjunkt sind und das Ereignis A immer mit einem der Bi auftritt, gilt A = AB1 ∪ AB2 ∪ … ∪ ABk Mit dem Additionsthorem erhalten wir k Satz von Bayes P ( A) = ∑ P( ABi ) i =1 Bk … S B1 B2 … … … … A Und mit dem Multiplikationssatz wird daraus k P ( A) = ∑ P( Bi ) P( A | Bi ) i =1 Satz der totalen Wahrscheinlichkeit Methoden der Psychologie Probleme der Laplace-Wk Kolmogoroff-Wk Bedingte Wk Satz von Bayes Wir sehen anhand des Multiplikationstheorems, dass P(B | A) P(A) = P(A | B) P(B) Wk Definition Kolmogoroff Damit gilt Bedingte Wk Satz von Bayes P( B | A) = P( A | B) P( B) P ( A) bzw. P( A | B) = P( B | A) P( A) P( B) Die bedingte Wahrscheinlichkeit eines Ereignisses A gegeben B ist zu berechnen aus der Wahrscheinlichkeit für B gegeben A und den Grundwahrscheinlichkeiten von A und B. Diese Beziehung ist der Satz von Bayes. Methoden der Psychologie Probleme der Laplace-Wk Wk Definition Kolmogoroff Kolmogoroff-Wk Bedingte Wk Satz von Bayes Verallgemeinerung Hat man mehrere Ereignisse B1, B2, …, Bk wird beim Satz von Bayes P( A | Bi ) P( Bi ) P ( Bi | A) = P ( A) Bedingte Wk vorausgesetzt, dass die Grundwahrscheinlichkeit für A bekannt ist. Häufig kennt man aber nur die P(A|Bi). Satz von Bayes Mit dem Satz der totalen Wahrscheinlichkeit erhält man aus dem Satz von Bayes diese allgemeine Bayes-Formel: P( A | Bi ) P( Bi ) P ( Bi | A) = ∑ P( A | Bi ) P( Bi ) i