Einführung und Grundlagen

Werbung

Kapitel 1

Einführung und Grundlagen

Generelle Notation:

( Ω , A , P ) sei ein W-Raum im Hintergrund (nie weiter spezifiziert).

Die betrachteten Zufallsvariablen seien auf Ω definiert, z.B. X : (Ω, A) −→ (M, A) , wobei (M, A)

ein Messraum ist.

Bisweilen ist es bequem, eine “störende” P-Nullmenge aus Ω zu entfernen, oder anders gesagt: Wenn

e ∈ A mit P(Ω)

e = 1 , dann macht es keinen wesentlichen Unterschied, statt ( Ω , A , P ) den reduzierten

Ω

¯

e , A e , P¯ ) zu nehmen (und alle Zufallsvariablen auf Ω

e zu restringieren). Wir schreiben

W-Raum ( Ω

Ω

A

e

Ω

dann aber wiederum ( Ω , A , P ) für den reduzierten W-Raum.

Definition 1.1 (Stochastischer Prozess)

Eine Familie von Zufallsvariablen (Xt )t∈T auf Ω mit Werten in einer Menge M , d.h.

Xt : (Ω, A) −→ (M, A)

für alle t ∈ T ,

wobei T irgendeine Indexmenge ist, heißt ein stochastischer Prozess mit Indexmenge T und Zustandsraum M . Für jedes ω ∈ Ω heißt die Funktion t −→ Xt (ω) (eine Funktion auf T mit Werten in M ) ein

Pfad oder eine Trajektorie des stochastischen Prozesses.

Die interessanten Eigenschaften (spezieller) stochastischer Prozesse betreffen:

(a) Die endlich-dimensionalen Randverteilungen

P(Xt1 ,...,Xtn ) ,

für n ∈ N und paarweise verschiedene t1 , . . . , tn ∈ T .

(b) Die Pfade t −→ Xt (ω) für ω ∈ Ω.

Z.B., im Fall M = R : Prozess mit stetigen Pfaden oder Prozess mit isotonen Pfaden.

Bemerkung: Verteilung eines stochastischen Prozesses

Die Verteilung des stochastischen Prozesses (Xt )t∈T mit Zustandsraum M ist die Verteilung der Zufallsvariablen

¡

¢

X : Ω −→ M T , X(ω) = Xt (ω) t∈T ,

wobei M T die Menge aller Funktionen von T in M bezeichnet. Diese Sichtweise führt allerdings zu neuen Maßund w-theoretischen Problemen, die wir nicht verfolgen wollen. Z.B. ist hier ein erstes maßtheoretisches Problem

die Festlegung einer geeigneten Sigma-Algebra AT im Funktionenraum M T , so dass X : (Ω, A) −→ (M T , AT ).

Als für uns wichtiges Resultat ergibt sich dabei:

Die Verteilung PX des stochastischen Prozesses ist eindeutig bestimmt durch das System aller endlich-dimensionalen

Randverteilungen in Punkt (a) oben.

1

Norbert Gaffke: Vorlesung “Stochastische Prozesse”, Sommersemester 2011

Kapitel 1: Einführung und Grundlagen

1.1

2

Bedingte Verteilungen von Zufallsvariablen

Definition 1.2 (Bedingte Verteilung von X unter Y )

Seien X : (Ω, A) −→ (M, A) und Y : (Ω, A) −→ (N, B) zwei Zufallsvariablen auf Ω, wobei

(M, A) und

¡ (N, B)¢ zwei Messräume sind. Eine bedingte Verteilung von X unter Y ist eine Familie

PX|Y = PX | Y =y y∈N von W-Verteilungen auf A mit den folgenden Eigenschaften:

(i) Für jedes A ∈ A ist die Funktion y 7−→ PX | Y =y (A) messbar (bezgl. der Sigma-Algebra B in N

und der Borel’schen Sigma-Algebra B1 in R).

Z

¡

¢

(ii)

PX | Y =y (A) dPY (y) = P X −1 (A) ∩ Y −1 (B)

∀ A ∈ A , ∀ B ∈ B.

B

Bemerkungen

1. Massenpunkte der Verteilung von Y

¡

¢

Wenn PX|Y = PX | Y =y y∈N eine bedingte Verteilung von X unter Y ist, dann gilt für jeden Punkt

y0 ∈ N mit {y0 } ∈ B und P(Y = y0 ) > 0 :

PX | Y =y0 = PX | {Y =y0 } ,

wobei PX | {Y =y0 } die elementare bedingte Verteilung von X unter dem Ereignis {Y = y0 } ist, definiert

durch

¡

¢

PX | {Y =y0 } (A) = P X −1 (A) | {Y = y0 } ∀ A ∈ A .

2. Verallgemeinerte Fubini-Formel

¡

¢

Wenn PX|Y = PX | Y =y y∈N eine bedingte Verteilung von X unter Y ist, dann gilt für eine Funktion

g : (M × N, A ⊗ B) −→ (R, B1 ) mit g ◦ (X, Y ) ≥ 0 oder g ◦ (X, Y ) P-integrierbar:

Z Z

¡

¢

E g ◦ (X, Y ) =

g(x, y) dPX | Y =y (x) dPY (y) .

N

M

Theorem 1.3 (Eindeutigkeit und Existenz der bedingten Verteilung)

Seien X : (Ω, A) −→ (M, A) und Y : (Ω, A) −→ (N, B) .

(a) Die Sigma-Algebra A in M sei abzählbar erzeugt, d.h. es existiert ein abzählbares Teilsystem

E ⊆ A mit σ(E) = A. Dann ist die bedingte Verteilung von X unter Y PY -f.s. eindeutig

e y )y∈N zwei bedingte Verteilungen von X unter Y sind,

bestimmt, d.h.: Wenn (Qy )y∈N and (Q

dann gilt

³©

ª´

ey

PY

y ∈ N : Qy = Q

= 1.

d , dann existiert

(b) Wenn M eine offene oder eine abgeschlossene Teilmenge von Rd ist und A = BM

eine bedingte Verteilung von X unter Y und ist PY -f.s. eindeutig bestimmt.

Norbert Gaffke: Vorlesung “Stochastische Prozesse”, Sommersemester 2011

Kapitel 1: Einführung und Grundlagen

3

Theorem 1.4 (Bedingte Verteilung mit Hilfe von Dichten)

Seien X : (Ω, A) −→ (M, A) und Y : (Ω, A) −→ (N, B) , und die gemeinsame Verteilung P(X,Y )

besitze die µ ⊗ ν-Dichte f , wobei µ ein sigma-endliches Maß auf A und ν ein sigma-endliches Maß auf

B sind. Sei noch fY eine ν-Dichte von PY . Dann gilt:

Z

n

o

e) = 1 ,

e := y ∈ N : 0 < fY (y) =

Für N

f (x, y) dµ(x) < ∞

ist PY (N

M

und eine bedingte Verteilung von X unter Y ist gegeben durch

PX | Y =y :=

f (· , y)

e , und PX | Y =y := PX , falls y ∈ N \ N

e.

· µ , falls y ∈ N

fY (y)

Dabei steht f (· , y) für die Funktion M 3 x 7−→ f (x, t) .

Beispiel: X und Y gemeinsam normalverteilt

Seien X : (Ω, A) −→ (Rn1 , Bn1 ) und Y : (Ω, A) −→ (Rn2 , Bn2 ) , und X, Y seien gemeinsam

normalverteilt:

µ

¶

X

∼ N(β, V ) mit β ∈ Rn1 +n2 und V ∈ PD(n1 + n2 ) .

Y

Wir partitionieren β und V entsprechend der Teil-Dimensionen n1 und n2 :

µ

¶

·

¸

β1

V 1 V 12

β =

und V =

.

β2

V t12 V 2

Mit Hilfe von Theorem 1.4 erhält man die bedingte Verteilung PX | Y :

³

´

−1 t

PX | Y =y = N β 1 + V 12 V −1

(y

−

β

)

,

V

−

V

V

V

,

1

12

2

12

2

2

1.2

y ∈ Rn2 .

Singuläre Normalverteilungen

n-dimensionale Normalverteilungen wurden durch Lebesgue-Dichten definiert, was positiv definite Kovarianzmatrizen erforderte. Bisweilen jedoch, z.B. für allgemeine Gauß-Prozesse (s. Abschnitt 1.3), ist

es nützlich, die Definition von Normalverteilungen etwas zu erweitern auf positiv semi-definite Kovarianzmatrizen (die also auch singulär sein können). W-Verteilungen auf Bn mit singulärer Kovarianzmatrix

können keine Lebesgue-Dichte besitzen.

Definition 1.5 (Singuläre Normalverteilung)

Seien β ∈ Rn and V eine positiv semi-definite n × n Matrix, die singulär sei.

Die Normalverteilung N(β, V ) ist wie folgt definiert.

Wähle eine Zerlegung V = U U t , mit einer (reellen) n × n Matrix U ; dann:

N(β, V ) :=

¡

N(0, I n )

¢LU ,β

,

wobei LU ,β : Rn −→ Rn ,

LU ,β (x) = U x + β .

Bemerkung: Wohldefiniertheit

Im Allgemeinen gibt es viele n × n Matrizen U mit U U t = V (für eine gegebene positiv semi-definite

n × n Matrix V ). Daher muss nachgewiesen werden, dass N(β, V ) aus Definition 1.5 nicht von der

speziellen Wahl von U abhängt. Das lässt sich zeigen mit Hilfe eines kleinen Matrizen-Resultats:

e zwei n × n Matrizen mit U U t = U

eU

e t , dann existiert eine orthogonale n × n Matrix

Wenn U and U

e = UQ .

Q , so dass U

Norbert Gaffke: Vorlesung “Stochastische Prozesse”, Sommersemester 2011

Kapitel 1: Einführung und Grundlagen

4

Die lineare Transformationseigenschaft von Normalverteilungen setzt sich auf die so erweiterte Klasse

der Normalverteilungen fort:

Theorem 1.6 (Lineare Transformationseigenschaft von Normalverteilungen)

Seien β ∈ Rn , V eine positiv semi-definite n × n Matrix, A eine m × n Matrix and c ∈ Rm .

Bezeichne:

LA,c : Rn −→ Rm ,

¡

1.3

LA,c (x) = Ax + c .

N(β, V )

¢LA,c

Dann gilt:

= N(Aβ + c , AV At ) .

Einige Klassen stochastischer Prozesse

Definition 1.7 (1-dim. Wiener Prozess ohne Drift)

Wir betrachten einen stochastischen Prozess mit Indexmenge T = [ 0 , ∞ ) und Zustandsraum

M = R, also

Xt : (Ω, A) −→ (R, B1 ) für alle t ∈ [ 0 , ∞).

Der Prozess (Xt )t∈[0,∞) heißt ein Wiener Prozess oder eine Brown’sche Bewegung, wenn gilt:

(o) X0 ≡ 0 ;

(i) der Prozess hat stochastisch unabhängige Zuwächse:

Für alle n ∈ N and alle 0 ≤ t0 < t1 < . . . < tn sind die Zufallsvariablen (Zuwächse)

Xti − Xti−1 (i = 1, . . . , n) stochastisch unabhängig.

¡

¢

(ii) Für alle s, t ≥ 0, s < t gilt: Xt − Xs ∼ N 0 , σ 2 · (t − s) ;

dabei ist σ > 0 eine gegebene Konstante;

(iii) die Pfade t −→ Xt (ω), t ∈ [ 0 , ∞) , sind stetig.

Definition 1.8 (1-dim. Gauß-Prozess)

Die Indexmenge T sei beliebig, und der Zustandsraum sei M = R, also

Xt : (Ω, A) −→ (R, B 1 ) für alle t ∈ T .

Der Prozess (Xt )t∈T heißt ein Gauß-Prozess, wenn für alle n ∈ N and alle paarweise verschiedenen t1 , . . . , tn ∈ T die gemeinsame Verteilung der Zufallsvariablen Xt1 , . . . , Xtn eine n-dimensionale

Normalverteilung ist (die auch singulär sein mag). Wir bezeichnen dann:

m(t)

=

E(Xt ) ,

t∈T,

K(s, t)

=

Cov(Xs , Xt ),

(Mittelwert-Funktion);

s, t ∈ T ,

(Kovarianz-Funktion).

Bemerkungen

1. Die Verteilung eines Gauß-Prozesses ist vollständig durch seine Mittelwert-Funktion und seine

Kovarianz-Funktion bestimmt. Denn für jedes n ∈ N and alle paarweise verschiedenen t1 , . . . , tn ∈ T

gilt:

³¡

´

¢t ¡

¢

(Xt1 , . . . , Xtn )t ∼ N m(t1 ), . . . , m(tn ) , K(ti , tj ) i,j=1,...,n .

Norbert Gaffke: Vorlesung “Stochastische Prozesse”, Sommersemester 2011

Kapitel 1: Einführung und Grundlagen

5

2. Ein Wiener-Prozess ist ein Gauß-Prozess mit Mittelwert-Funktion m ≡ 0 und Kovarianz-Funktion

K(s, t) = σ 2 · min{s, t} ,

s, t ∈ [ 0 , ∞).

Definition 1.9 (Homogener Poisson-Prozess)

Sei (Nt )t∈[0,∞) ein stochastischer Prozess mit Zustandsraum M = N0 (und Indexmenge T = [ 0 , ∞)),

¡

¢

Nt : (Ω, A) −→ N0 , P(N0 )

für alle t ∈ [ 0 , ∞) .

Der Prozess (Nt )t∈[0,∞) heißt ein homogener Poisson-Zählprozess, wenn gilt:

(o) N0 ≡ 0 ;

(i) der Prozess hat stochastisch unabhängige Zuwächse:

Für jedes n ∈ N and alle 0 ≤ t0 < t1 < . . . < tn sind die Zufallsvariablen (Zuwächse)

Nti − Nti−1 (i = 1, . . . , n) stochastisch unabhängig;

¡

¢

(ii) für alle s, t ≥ 0, s < t, gilt Nt − Ns ∼ Poi λ · (t − s) ;

dabei ist λ > 0 eine gegebene Konstante;

(iii) die Pfade t −→ Nt (ω), t ∈ [ 0 , ∞), sind isoton, rechtsseitig stetig, mit Sprungweiten 1 an den

Unstetigkeitsstellen (d.h. Nt (ω) − lims→t,s<t Ns (ω) ∈ {0, 1} ∀ t > 0), sowie

lim Nt (ω) = ∞

t→∞

(∀ ω ∈ Ω).

Definition 1.10 (Markov-Kette)

Die Indexmenge sei T = N0 , und der Zustandsraum M sei abzählbar (endlich oder abzählbar-unendlich).

Ein stochastischer Prozess (Xn )n∈N0 , wobei also

¡

¢

Xn : (Ω, A) −→ M, P(M )

für alle n ∈ N0 ,

(M abzählbar)

heißt eine Markov-Kette, wenn gilt:

Für jedes n ≥ 2, and alle x0 , x1 , . . . , xn ∈ M mit P(X0 = x0 , X1 = x1 , . . . , Xn−1 = xn−1 ) > 0 :

¯

¯

¡

¢

¡

¢

P Xn = xn ¯ X0 = x0 , X1 = x1 , . . . , Xn−1 = xn−1 = P Xn = xn ¯ Xn−1 = xn−1 .

Die Markov-Kette heißt homogen, wenn für alle m, n ∈ N and alle x, y ∈ M mit P(Xm−1 = x) > 0

und P(Xn−1 = x) > 0 :

¯

¯

¡

¢

¡

¢

P Xm = y ¯ Xm−1 = x = P Xn = y ¯ Xn−1 = x .

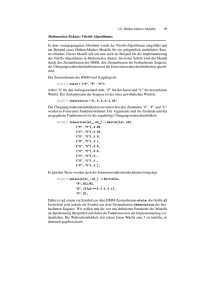

Beispiel: Ehrenfest’sches Diffusionsmodell

Eine homogene Markov-Kette (Xn )n∈N0 mit Zustandsraum M = {1, . . . , k} , (k ∈ N gegeben),

und Übergangswahrscheinlichkeiten

2x(k − x)/k 2 , falls y = x

¯

¡

¢

x2 /k 2

, falls y = x − 1

,

P Xn = y ¯ Xn−1 = x =

2

2

(k − x) /k

, falls y = x + 1

0

, sonst

(für alle x, y ∈ {1, . . . , k} und n ∈ N mit P(Xn−1 = x) > 0).

Norbert Gaffke: Vorlesung “Stochastische Prozesse”, Sommersemester 2011

Kapitel 1: Einführung und Grundlagen

6

Definition 1.11 (Stationärer Prozess)

Die Indexmenge T sei eine der Mengen R, [ 0 , ∞), Z oder N0 , der Zustandsraum (M, A) sei beliebig.

Ein stochastischer Prozess (Xt )t∈T heißt stationär, wenn für alle n ∈ N, alle t1 < t2 < . . . < tn in T

und alle h ∈ T die gemeinsame Verteilung von Xt1 , . . . , Xtn gleich der gemeinsamen Verteilung von

Xt1 +h , . . . , Xtn +h ist:

P(Xt1 ,...,Xtn ) = P(Xt1 +h ,...,Xtn +h )

∀ n , ∀ t1 < . . . < tn , ∀ h.

Definition 1.12 (Prozess mit stationären Zuwächsen)

Die Indexmenge T sei eine der Mengen R, [ 0 , ∞), Z oder N0 , der Zustandsraum M sei eine Bod . Ein stochastischer Prorel’sche Teilmenge von Rd mit der Borel’schen Spur-Sigma-Algebra A = BM

zess (Xt )t∈T heißt ein Prozess mit stationären Zuwächsen, wenn für alle n ∈ N, alle t0 < t1 < . . . < tn

in T und alle h ∈ T die gemeinsame Verteilung von Xti − Xti−1 (i = 1, . . . , n) gleich der gemeinsamen

Verteilung von Xti +h − Xti−1 +h (i = 1, . . . , n) ist:

¢

¡

¡

¢

Xt1 +h −Xt0 +h ,...,Xtn +h −Xtn−1 +h

Xt1 −Xt0 ,...,Xtn −Xtn−1

∀ n , ∀ t1 < . . . < tn , ∀ h.

P

= P

Definition 1.13 (Prozess mit unabhängigen Zuwächsen)

Die Indexmenge T sei entweder [ 0 , ∞) oder N0 , der Zustandsraum M sei eine Borel’sche Teilmenge

d . Ein stochastischer Prozess (X )

von Rd mit der Borel’schen Spur-Sigma-Algebra A = BM

t t∈T heißt

ein Prozess mit unabhängigen Zuwächsen, wenn für alle n ∈ N und alle t0 < t1 < . . . < tn in T die

Zufallsvariablen

X0 , Xt1 − Xt0 , Xt2 − Xt1 , . . . , Xtn − Xtn−1

stochastisch unabhängig sind.

Anmerkung: Im Fall X0 ≡ const kann die (konstante) Zufallsvariable X0 aus obiger Bedingung entfernt

werden.

Bemerkung:

Wenn (Xt )t∈T ein Prozess mit unabhängigen Zuwächsen ist, dann ist die Bedingung stationärer

Zuwächse äquivalent mit:

PXt −Xs = PXt+h −Xs+h

für alle s, t ∈ T , s < t, und alle h ∈ T .

Wiener-Prozesse und homogene Poisson-Zählprozesse sind also Prozesse mit unabhängigen und stationären Zuwächsen.

Norbert Gaffke: Vorlesung “Stochastische Prozesse”, Sommersemester 2011

Kapitel 1: Einführung und Grundlagen

7

Definition 1.14 (Markov Prozess)

Die Indexmenge T sei eine Teilmenge von R, der Zustandsraum (M, A) sei beliebig. Ein stochastischer

Prozess (Xt )t∈T heißt ein Markov-Prozess, wenn gilt:

Zu jedem Paar s, t ∈ T mit s < t existiert eine bedingte Verteilung von Xt unter Xs ,

¡

¢

PXt |Xs = PXt |Xs =x x∈M ,

mit der Eigenschaft, dass für alle n ∈ N und alle s1 < . . . < sn < s in T die Familie

¡ X |X =x ¢

P t s

eine bedingte Verteilung von Xt unter (Xs1 , . . . , Xsn , Xs ) ist;

(x1 ,...,xn ,x)∈M n+1

kurz (aber lax) formuliert:

¯

P

Xt ¯ Xs1 =x1 , ... , Xsn =xn , Xs =x

= PXt | Xs =x

∀ s1 < . . . < sn < s < t in T , ∀ x1 , . . . , xn , x ∈ M , ∀ n ∈ N .

Die Verteilungen

PXt | Xs =x

für s, t ∈ T , s < t, und x ∈ M

heißen dann Übergangsverteilungen des Markov-Prozesses (Xt )t∈T .

Bemerkung: Markov-Prozess mit diskretem Zustandsraum

Wenn M abzählbar ist (und A = P(M )), dann lässt sich ein Markov-Prozess (Xt )t∈T elementarer

charakterisieren durch die folgende Bedingung:

Für

¡ alle n ∈ N, alle s1 < . . . < sn <

¢ s < t in T , and alle x1 , . . . , xn , x, y ∈ M mit

P Xs1 = x1 , . . . , Xsn = xn , Xs = x > 0 gilt

¯

¯

¡

¢

¡

¢

P Xt = y ¯ Xs = x1 , . . . , Xsn = xn , Xs = x = P Xt = y ¯ Xs = x .

1

Die bedingten Wahrscheinlichkeiten

¯

¡

¢

Ts,t (x, y) = P Xt = y ¯ Xs = x ,

für s, t ∈ T , s < t, und x, y ∈ M mit P(Xs = x) > 0,

heißen dann Übergangswahrscheinlichkeiten des Markov-Prozesses (Xt )t∈T .

Wenn außerdem T = N0 , dann ist die obige Markov-Eigenschaft äquivalent mit der in Definition 1.10

formulierten Bedingung:

Für jedes n ∈ N, n ≥ 2, and alle x0 , x1 , . . . , xn ∈ M mit P(X0 = x0 , X1 = x1 , . . . , Xn−1 = xn−1 ) > 0

gilt

¯

¯

¡

¢

¡

¢

P Xn = xn ¯ X0 = x0 , X1 = x1 , . . . , Xn−1 = xn−1 = P Xn = xn ¯ Xn−1 = xn−1 .

Wir sehen: Ein Markov-Prozess mit abzählbarem Zustandsraum und Indexmenge N0 ist dasselbe wie

eine Markov-Kette gemäß Definition 1.10.

Theorem 1.15 (Unabhängige Zuwächse =⇒ Markov)

Die Indexmenge T sei entweder [0 , ∞) oder N0 , und der Zustandsraum M sei eine Borel’sche Teilmenge

d .

von Rd mit der Sigma-Algebra A = BM

Wenn (Xt )t∈T ein Prozess mit unabhängigen Zuwächsen ist, dann ist (Xt )t∈T ein Markov-Prozess mit

Übergangsverteilungen

PXt | Xs =x = PXt −Xs +x

für alle s, t ∈ T , s < t, und alle x ∈ M .

Anmerkung: Streng genommen ist nur für PXs -fast alle x ∈ M die Verteilung von Xt −Xs +x eine W-Verteilung

d

auf BM

. Für die übrigen x ∈ M (die eine PXs -Nullmenge bilden), definiere man z.B. PXt | Xs =x = PXt−s .

Norbert Gaffke: Vorlesung “Stochastische Prozesse”, Sommersemester 2011

Kapitel 1: Einführung und Grundlagen

8

Theorem 1.16 (Chapman-Kolmogorov-Gleichung für Markov-Prozesse)

Sei (Xt )t∈T , wobei T ⊆ R, ein Markov-Prozess mit Zustandsraum (M, A), und die Sigma-Algebra A

sei abzählbar erzeugt.

Für je drei Punkte s < t < u in T gilt:

Z

Xu | Xs =x

P

(A) =

PXu | Xt =y (A) dPXt | Xs =x (y)

∀A∈A,

für PXs -fast alle x ∈ M .

M

Bemerkungen

1. Diskreter Zustandsraum

Wenn M abzählbar (und A = P(M )), dann lässt sich die Chapman-Kolmogorov-Gleichung für einen

Markov-Prozess elementarer mit den Übergangswahrscheinlichkeiten formulieren:

X

Ts,u (x, z) =

Ts,t (x, y) · Tt,u (y, z) ∀ x, z ∈ M mit P(Xs = x) > 0 ,

y∈M

wobei s < t < u in T . (Streng genommen erfolgt die Summation nur über die y ∈ M mit P(Xt = y) > 0).

2. Übergangsverteilungen mit Lebesgue-Dichten

d . Sei (X )

Der Zustandsraum M sei eine Borel’sche Teilmenge von Rd und A = BM

t t∈T ein MarkovProzess, dessen Übergangverteilungen Lebesgue-Dichten besitzen:

PXt | Xs =x = fs,t (x, · ) · λλd |A

∀ s < t in T , ∀ x ∈ M .

Dann schreibt sich die Chapman-Kolmogorov-Gleichung als:

Z

fs,u (x, z) =

fs,t (x, y) ft,u (y, z) d λλd (y) für PXs -fast alle x ∈ M und λλd -fast alle z ∈ M .

M

wobei s < t < u in T .

Definition 1.17 (Homogener Markov-Prozess)

Die Indexmenge T sei eine der Mengen R, [ 0 , ∞), Z oder N0 ; der Zustandsraum (M, A) sei beliebig.

Ein Markov-Prozess (Xt )t∈T heißt homogen, wenn sich die Übergangsverteilungen in Definition 1.14

so wählen lassen, dass gilt:

PXt | Xs =x = PXt+h | Xs+h =x

∀ s < t in T , ∀ h ∈ T , ∀ x ∈ M.

Korollar 1.18

Die Indexmenge T sei entweder [ 0 , ∞) or N0 ; der Zustandsraum M sei eine Borel’sche Teilmenge

d ).

von Rd (und A = BM

Wenn (Xt )t∈ ein Prozess mit stationären und unabhängigen Zuwächsen ist, dann ist (Xt )t∈T ein

homogener Markov-Prozess mit Übergangsverteilungen

PXt | Xs =x = PXt−s −X0 +x ,

(s < t, x ∈ M ).