Automatisiert - Wissenschaftsmanagement Online

Werbung

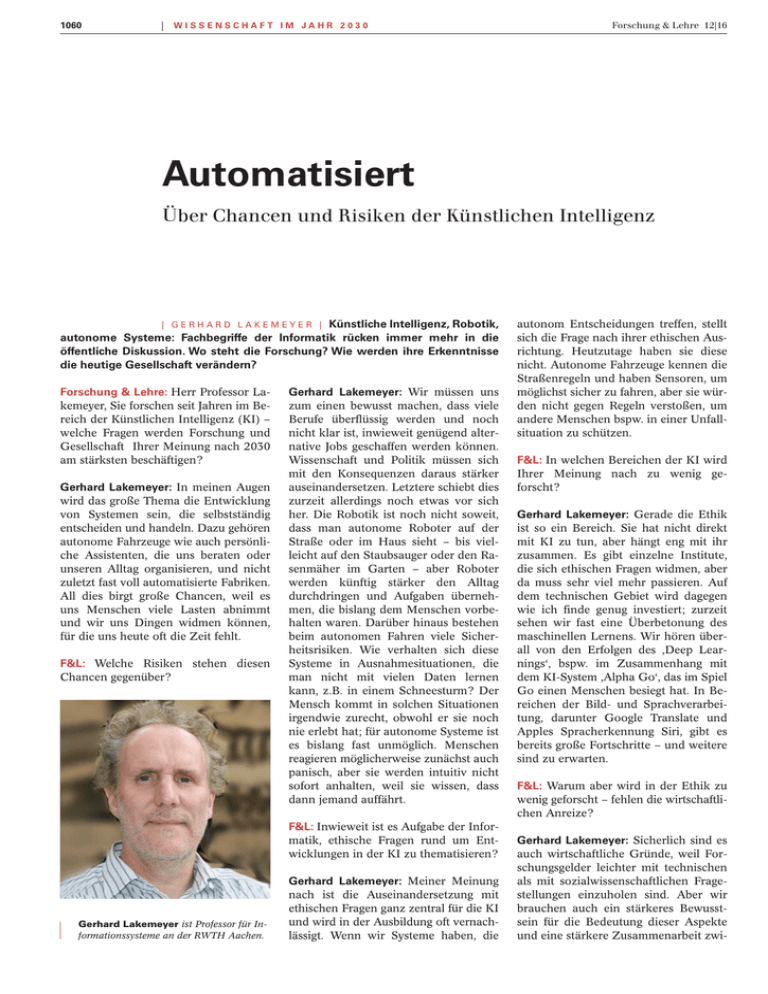

1060 WISSENSCHAFT IM JAHR 2030 Forschung & Lehre 12|16 Automatisiert Über Chancen und Risiken der Künstlichen Intelligenz | G E R H A R D L A K E M E Y E R | Künstliche Intelligenz, Robotik, autonome Systeme: Fachbegriffe der Informatik rücken immer mehr in die öffentliche Diskussion. Wo steht die Forschung? Wie werden ihre Erkenntnisse die heutige Gesellschaft verändern? Forschung & Lehre: Herr Professor Lakemeyer, Sie forschen seit Jahren im Bereich der Künstlichen Intelligenz (KI) – welche Fragen werden Forschung und Gesellschaft Ihrer Meinung nach 2030 am stärksten beschäftigen? Gerhard Lakemeyer: In meinen Augen wird das große Thema die Entwicklung von Systemen sein, die selbstständig entscheiden und handeln. Dazu gehören autonome Fahrzeuge wie auch persönliche Assistenten, die uns beraten oder unseren Alltag organisieren, und nicht zuletzt fast voll automatisierte Fabriken. All dies birgt große Chancen, weil es uns Menschen viele Lasten abnimmt und wir uns Dingen widmen können, für die uns heute oft die Zeit fehlt. F&L: Welche Risiken stehen diesen Chancen gegenüber? Gerhard Lakemeyer: Wir müssen uns zum einen bewusst machen, dass viele Berufe überflüssig werden und noch nicht klar ist, inwieweit genügend alternative Jobs geschaffen werden können. Wissenschaft und Politik müssen sich mit den Konsequenzen daraus stärker auseinandersetzen. Letztere schiebt dies zurzeit allerdings noch etwas vor sich her. Die Robotik ist noch nicht soweit, dass man autonome Roboter auf der Straße oder im Haus sieht – bis vielleicht auf den Staubsauger oder den Rasenmäher im Garten – aber Roboter werden künftig stärker den Alltag durchdringen und Aufgaben übernehmen, die bislang dem Menschen vorbehalten waren. Darüber hinaus bestehen beim autonomen Fahren viele Sicherheitsrisiken. Wie verhalten sich diese Systeme in Ausnahmesituationen, die man nicht mit vielen Daten lernen kann, z.B. in einem Schneesturm? Der Mensch kommt in solchen Situationen irgendwie zurecht, obwohl er sie noch nie erlebt hat; für autonome Systeme ist es bislang fast unmöglich. Menschen reagieren möglicherweise zunächst auch panisch, aber sie werden intuitiv nicht sofort anhalten, weil sie wissen, dass dann jemand auffährt. F&L: Inwieweit ist es Aufgabe der Informatik, ethische Fragen rund um Entwicklungen in der KI zu thematisieren? Gerhard Lakemeyer ist Professor für Informationssysteme an der RWTH Aachen. Gerhard Lakemeyer: Meiner Meinung nach ist die Auseinandersetzung mit ethischen Fragen ganz zentral für die KI und wird in der Ausbildung oft vernachlässigt. Wenn wir Systeme haben, die autonom Entscheidungen treffen, stellt sich die Frage nach ihrer ethischen Ausrichtung. Heutzutage haben sie diese nicht. Autonome Fahrzeuge kennen die Straßenregeln und haben Sensoren, um möglichst sicher zu fahren, aber sie würden nicht gegen Regeln verstoßen, um andere Menschen bspw. in einer Unfallsituation zu schützen. F&L: In welchen Bereichen der KI wird Ihrer Meinung nach zu wenig geforscht? Gerhard Lakemeyer: Gerade die Ethik ist so ein Bereich. Sie hat nicht direkt mit KI zu tun, aber hängt eng mit ihr zusammen. Es gibt einzelne Institute, die sich ethischen Fragen widmen, aber da muss sehr viel mehr passieren. Auf dem technischen Gebiet wird dagegen wie ich finde genug investiert; zurzeit sehen wir fast eine Überbetonung des maschinellen Lernens. Wir hören überall von den Erfolgen des ,Deep Learnings‘, bspw. im Zusammenhang mit dem KI-System ,Alpha Go‘, das im Spiel Go einen Menschen besiegt hat. In Bereichen der Bild- und Sprachverarbeitung, darunter Google Translate und Apples Spracherkennung Siri, gibt es bereits große Fortschritte – und weitere sind zu erwarten. F&L: Warum aber wird in der Ethik zu wenig geforscht – fehlen die wirtschaftlichen Anreize? Gerhard Lakemeyer: Sicherlich sind es auch wirtschaftliche Gründe, weil Forschungsgelder leichter mit technischen als mit sozialwissenschaftlichen Fragestellungen einzuholen sind. Aber wir brauchen auch ein stärkeres Bewusstsein für die Bedeutung dieser Aspekte und eine stärkere Zusammenarbeit zwi- WISSENSCHAFT IM JAHR 2030 12|16 Forschung & Lehre 1061 schen Sozialwissenschaften und Informatik, sowie mit Juristen und Psychologen. Es ist schwierig, Interdisziplinarität zu realisieren, aber sie ist wichtig. F&L: Forschung, Wirtschaft oder Gesellschaft – wer ist die maßgebliche Antriebskraft für Fortschritte in der KI? F&L: Was charakterisiert die Fortschrittszyklen der KI? Gerhard Lakemeyer: Es gibt immer Momente, in denen es einen Riesenschub gibt, dann gibt es wieder ein Plateau, einen Zeitraum, in dem Entwicklungen ohne größeren Fortschritt verfeinert werden. Zum autonomen Fahren gab es bspw. bereits in den 80er Jahren erste Ideen, die aber nicht richtig funktioniert haben. Der Durchbruch kam erst mit der Entwicklung statistischer Verfahren zum Bau von Umgebungskarten und der Selbstlokalisierung ab Mitte der 90er Jahre. Seitdem ging es bis zuletzt rasant voran. Jetzt ist wieder ein Punkt erreicht, an dem es schwierig ist, den nächsten Durchbruch zu erzielen, z.B., dass autonome Autos die Flexibilität menschlicher Fahrweise nachahmen. F&L: Die Bedeutung des Computers für den privaten Gebrauch wurde unterschätzt. 1977 sagte etwa der US-Ameri- Foto: picture-alliance Gerhard Lakemeyer: Im Moment ist es in Bereichen wie autonomes Fahren vor allem die Industrie, die sich des Themas angenommen hat. Bis vor zehn Jahren war es dagegen noch ein reines Forschungsthema. Das zeigt sich daran, dass es den Begriff der KI seit 1956 gibt, er jedoch erst vor einiger Zeit als aktuelles Thema in das Bewusstsein der Öffentlichkeit gerückt ist. John McCarthy, einer der Väter der KI, hatte den Namen vorgeschlagen. Schon damals hat man – natürlich stark vereinfacht – Computerschachprogramme entwickelt. Menschen sind von sich aus nicht unbedingt an den eher technischen Entwicklungen in der KI interessiert. Ihnen wird ,der Floh ins Ohr gesetzt‘, dass es eine tolle Sache ist oder eine Bedrohung, nicht zuletzt durch Science-Fiction Filme. Wie sie reagieren, hängt auch von kulturellen Faktoren ab. In Deutschland fahren die Menschen tendenziell gerne Auto und legen daher keinen großen Wert auf das autonome Fahren; in den USA ist dies anders, dort geht es darum, von A nach B zu kommen. kaner Ken Olsen, damaliger Präsident der Computerfirma Digital Equipment Corporation (DEC): „There is no reason anyone would want a computer in their home“. Gibt es Bereiche, in denen Sie eine solche Täuschung hinsichtlich heute als weniger bedeutend eingeschätzter Entwicklungen in der KI mit Blick auf die Zukunft erwarten? Gerhard Lakemeyer: Wenn ich das wüsste, würde ich wohl sehr berühmt. So etwas vorauszusehen ist schwierig. Eine Entwicklung, die von vielen auf jeden Fall noch unterschätzt wird, ist der 3D-Druck. Dies ist eine Technologie, die unsere heutige Produktion revolutionieren wird. Auf einfache Art und Weise kann jeder im eigenen Wohnzimmer Produkte erstellen, für die er oder sie die Pläne im Netz runtergeladen hat. Eine negative Entwicklung mit unberechenbaren Folgen sind autonome Waffensysteme. KI und Politik müssen sich dringend intensiver mit dem Thema auseinandersetzen. Forscher wie Stephen Hawking betonen, wie gefährlich die KI in dem Sinne ist, dass sie den Menschen verdrängen wird. Dieses Problem sehe ich gar nicht. Es wird aber in absehbarer Zeit möglich sein, mit billigen Methoden Systeme zu schaffen, die Menschen einen riesigen Schaden zufügen können. Wenn bspw. autonome bewaffnete Drohnen in falsche Hände geraten, dann gute Nacht. Darüber müsssen wir uns ernsthaft Gedanken machen.