SignalVerarbeitungKa..

Werbung

4. Signalverarbeitungsmodell der Kamera

4 Signalverarbeitungsmodell der Kamera

4.1 Objektiv

Ein Linsensystem, welches eine Abbildung von einem total inkohärent leuchtenden Objekt erzeugt, kann mit den Methoden der linearen verschiebungsinvarianten Systemtheorie beschrieben werden. Die Linearität und Verschiebungsinvarianz stellt eine hinreichende und notwendige Bedingung für die Existenz des Faltungssatzes

y (r ) =

zz

x (r ') h(r − r ') da '

(4-1)

A'

dar. Im k -Vektorraum wird die Faltung über das Produkt der Fourier-Transformierten

Y (k ) = H (k ) X (V k )

(4-2)

beschrieben. Hierbei ist = b / g der Abbildungsmaßstab, k = n 2π / λ , worin n den Ortsvektor des betrachteten Raumpunktes im Fourier-Raum und λ die Wellenlänge der elektromagnetischen Welle definiert.

Die Übertragungsfunktion H (k ) ≡ MÜF (k ) heißt Modulationsübertragungsfunktion MÜF

oder optische Übertragungsfunktion. Sie wird bevorzugt verwendet, um die Qualität einer

Linse, eines Linsensystems oder die eines Objektives zu charakterisieren.

Linsenfehler, die nur die MÜF und nicht die geometrischen Eigenschaften beeinflussen,

lassen sich den Datenblättern der Objektivhersteller von hochwertigen Objektiven entnehmen.

Für Standardobjektive stehen diese Informationen zumeist nicht zur Verfügung, weshalb die

qualitativen Aspekte von besonderem Interesse sind: Das Auflösungsvermögen eines

Objektives nimmt meist von der Bildmitte zum Rand hin leicht ab. Dieser ortsabhängige Einfluss ist bei dem kleinen Bildfeld eines CCD/CMOS-Sensors in der Regel vernachlässigbar.

Weiterhin wird das Auflösungsvermögen durch die Ortsintegration des CCD/CMOS-Sensors

begrenzt (siehe auch Kap. 4.2). Erst bei Auflösungen von ca. 180 Linienpaaren/mm (Lp/mm)

auf der Sensorebene kommt die Tiefpasswirkung des Objektivs zum Tragen. Die Ortsfrequenz einer zweidimensionalen Fourier-Transformierten wird in der Technik häufig in

Linienpaaren pro Längeneinheit angegeben, weil die Spektrallinie dieser Ortsfrequenz im

Originalbereich zwei Extrema pro Längeneinheit, ein Minimum und Maximum, aufweist, die

optisch als Linienpaar pro Längeneinheit auftreten.

Gesamtübertragungsverhalten

Im Fourier-Raum kann die Gesamtübertragungsfunktion eines Objektivs unter Vernachlässigung von Unschärfeeffekten des Linsensystems aus dem Produkt

MÜFG = MÜFB MÜFF

(4-3)

einzelner Übertragungsfunktionen berechnet werden. Dabei sind zwei Abbildungsmechanismen zu berücksichtigen:

• das Übertragungsverhalten MÜFB der Blende und

• das Übertragungsverhalten MÜFF bei Defokussierung.

-1-

4. Signalverarbeitungsmodell der Kamera

Übertragungsverhalten der Blende

Das Übertragungsverhalten sowie das Auflösungsvermögen von guten Objektiven wird bei

kleinem Blendendurchmesser durch den Beugungseffekt der Blende bestimmt. Die MÜF ist

proportional zur Autokorrelationsfunktion der Amplitudenübertragungsfunktion des optischen

Systems [85]. Aufgrund des Wiener-Khinchin-Theorems sind Autokorrelationsfunktion und

Leistungsdichtespektrum wechselseitige Fourier-Transformierte. Das Leistungsdichtespektrum wiederum ist gleich dem Betragsquadrat der Fourier-Transformierten. Infolgedessen

lässt sich die MÜF über die Fourier-Transformierte der Blendenfunktion berechnen. Die

Blendenfunktion typischer kreisförmiger Blenden, deren Fourier-Transformierte über Besselfunktionen zu beschreiben sind, lässt sich vereinfachend als quadratische Blendenfunktion annähern. Die Blenden-MÜF hat daher in dieser Näherung in der Notation nach Lenz [48]

Dreiecksform in der Art:

MÜFB (u, v , λ , BL) = MÜFB (u, λ , BL) MÜFB (v , λ , BL) ,

(4-4.1)

für u < 1 / ( λ BL)

,

sonst

(4-4.2)

RS1 − u λ BL

T 0

R1 − v λ BL

MÜF (v , λ , BL) = S

T 0

MÜFB (u, λ , BL) =

B

mit BL = f / d ,

UV

W

für v < 1 / (λ BL) U

VW ,

sonst

(4-4.3)

(4-4.4)

worin λ = λ = 600 nm die mittlere Wellenlänge des Lichtes, f die Brennweite des Objektivs

und d den Durchmesser der Blende bedeuten.

Die Dreiecksform rührt daher, dass bei der Autokorrelationsfunktion zwei quadratische

Flächen übereinander geschoben werden, deren gemeinsame Fläche zu berechnen ist. Das

Übertragungsverhalten der Blende wird durch einen Tiefpass mit der höchsten Ortsfrequenz

uMax = 1 / ( λ BL) bzw. vMax = 1/ ( λ BL) und einem Maximum bei null charakterisiert. In

Blendenstellung BL = 22 bei einer Zellengröße von dx = 11 µm erhält man eine Auflösung

von ca. 76 Lp/mm, was ca. 1,5 Linien/CCD-Zelle entspricht. Bei einer kreisförmigen Blende

ergibt sich eine rotationssymmetrische MÜF, die wie ein Zeltdach durchhängt [85].

Übertragungsverhalten bei Defokussierung

Das Modell der idealisierten Lochkamera bildet unabhängig von seiner Entfernung zur

Kamera jeden Bildpunkt scharf ab. Für die reale optische Abbildung eines Objektives ist dies

aus zwei Gründen nicht gegeben:

•

Die Auflösung einer Abbildung ist aufgrund der Wellennatur des Lichtes begrenzt.

•

Ein Objektiv bildet nur auf einer Gegenstandsebene liegende monochromatische

elektromagnetische Lichtwellen scharf ab.

Die Fokussierung liegt vor, wenn die wellenlängenabhängige Brennweite f, die Gegenstandsweite g und die Bildweite b der optischen Abbildung der Gleichung

1 1 1

= +

f

g b

(4-5)

genügen. In allen anderen Aufnahmesituationen spricht man von einer Defokussierung. Je

weiter die Objektebene gegenüber der Fokusebene verschoben wird, um so mehr wird der

Punkt als intensitätsärmere und größer werdende Kreisscheibe auf der Sensorebene abgebildet. Dies hat bei einer kreisförmigen Apertur eine Faltung des Bildes mit einer

gleichbelegten Kreisscheibe entsprechend Gleichung (4-1) zur Folge. Um, analog zur MÜF

der Blende, auf die Beschreibung durch die Besselfunktionen verzichten zu können, lässt sich

-2-

4. Signalverarbeitungsmodell der Kamera

zur Näherung eine rechteckförmige Blendenöffnung, die am CCD/CMOS-Sensorelementraster ausgerichtet ist, verwenden. Aufgrund der dann vorliegenden Separabilität des Kerns

der Fourier-Transformation lässt sich die MÜF über das Produkt der Fourier-Transformierten

der beiden Achsrichtungen beschreiben. Die angenommene Spaltblende hat als FourierTransformierte die in der Optik und Nachrichtentechnik bedeutsame Spaltfunktion:

si( x ) = sin x / x .

Damit erhält man als Fokus-MÜF:

MÜFF (u, v , ∆ x , ∆ y ) = MÜFF (u, ∆ x ) MÜFF (v , ∆ y ) ,

mit MÜFF (u, ∆ x ) = si(π ∆ x u) , MÜFF (v , ∆ y ) = si(π ∆ y v ) ,

∆x=

∆z

g

⋅ d Bx und ∆ y =

∆z

g

⋅ d By ,

(4-6.1)

(4-6.2-3)

(4-6.4-5)

worin ∆ z den z-Abstand von der Fokusebene und dBx und dBy die Öffnungsmaße der Rechteckblende definieren. Auch hier ist das Übertragungsverhalten wieder durch ein Tiefpassverhalten im Ortsfrequenzbereich charakterisiert. Die erste Nullstelle der Spaltfunktion kann zur

groben Beschreibung der Bandbreite des Tiefpasses herangezogen werden. Damit liegt eine

Bandbreite der Ortsfrequenzen von Bu ≡ u01 = 1/ ∆ x bzw. Bv ≡ v01 = 1/ ∆ y vor.

Die klassische geometrische Analyse des Tiefenschärfeverhaltens zeigt, dass die auf die Auflösung δ in der Sensorebene normierte Schärfentiefe ∆ g in z-Richtung direkt proportional zur

Blendenzahl BL ≡ O ist. Die Blendenzahl gibt dabei das Verhältnis aus Brennweite f und

Blendendurchmesser d an. Mit Hilfe des klassischen Ansatzes lassen sich die drei Aufnahmebereiche mit ihren jeweiligen unterschiedlichen Schärfentiefe-Gesetzmäßigkeiten angeben

(Auflösung auf der Sensorebene: δ = 11 µm):

•

Fernaufnahmen ( g >> f , b ≈ f )

∆g

g2

≈2O 2

δ

f

(4-7)

normaler Aufnahmebereich mit einer brennweitenabhängigen Schärfentiefe im cm- bis

m-Bereich

•

Makroaufnahmen (Größenverhältnis ca. 1:1, g ≈ b )

∆g

≈2O

δ

(4-8)

geringe brennweitenunabhängige Schärfentiefe im 100 µm-Bereich

( ∆ g / δ = 2 BL , bei Blende 22 erhält man eine Schärfentiefe von ≈ 0,48 mm)

•

Mikroaufnahmen (starke Vergrößerung, g ≈ f , b >> f )

∆g

g

≈O

δ

b

(4-9)

extrem geringe Schärfentiefe im 0,1 µm-Bereich

Aufgrund dieses Verhaltens lassen sich zwei Aufnahmesituationen unterscheiden. Bei entfernten Szenen im m-Bereich kann eine dreidimensionale Szene in der Regel vollständig

scharf abgebildet werden. In der Makro- und Mikrofotographie lassen sich nur relativ dünne

Gegenstandsebenen scharf abbilden, die sich unterhalb des Bild- oder Brennweitenbereiches

befinden.

-3-

4. Signalverarbeitungsmodell der Kamera

Die typischen Aufnahmesituationen in der Robotik liegen im Übergangsbereich zwischen der

normalen und Makrofotographie. Die Analyse typischer Aufnahmesituationen von Lenz [48]

zeigt, dass oberhalb einer Gegenstandsweite von 1 bis 2 m, auch bei einer relativ großen Objekttiefe im 1 m-Bereich, eine gute Ortsauflösung vorliegt. Dies ist aus den kleinen

CCD/CMOS-Sensorabmessungen und den damit verbundenen relativ großen Abbildungsmaßstäben zu erklären. Für die industrielle Anwendung ist diese Tatsache von Vorteil, weil

durch den zur Verfügung stehenden, relativ großen Schärfentiefebereich der Zwang zur

Fokusregelung entfällt.

4.2 CCD-Sensor

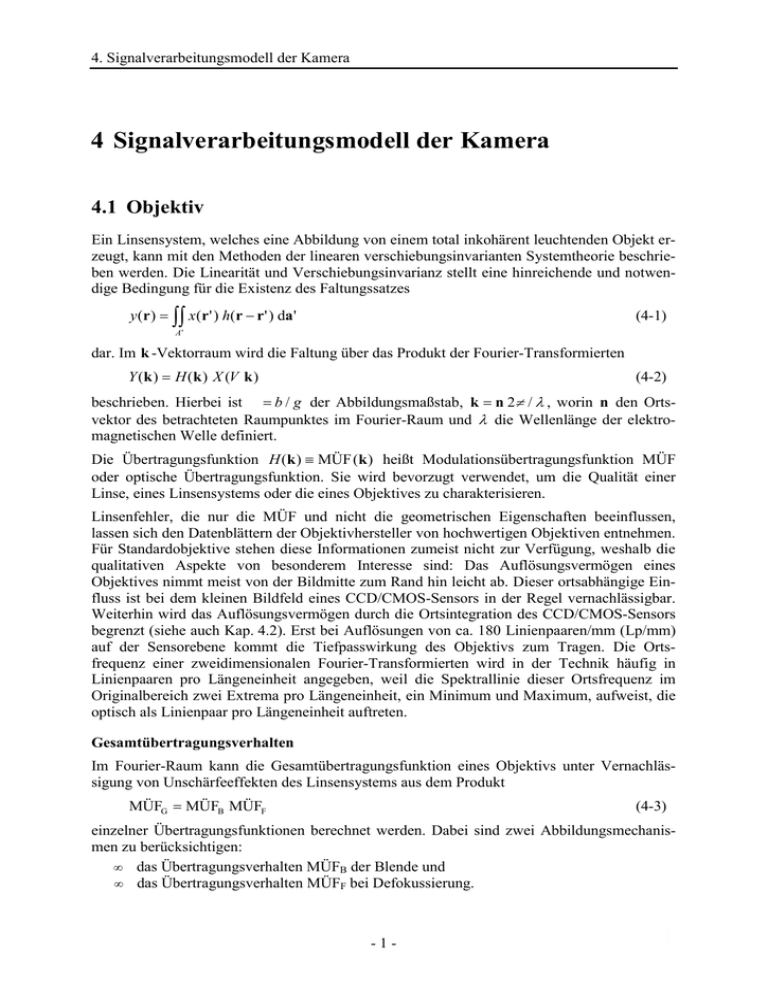

Zur Beschreibung des Signalverarbeitungsprozesses, welcher die Signalgewinnung durch den

CCD-Sensor umfasst, ist es sinnvoll, von einem Leuchtdichtesignal auf der Sensorebene auszugehen. Dieses Signal steht in einer

y

proportionalen Beziehung zur im

CCD-Chip für die LadungsgeneraQmn:= Ladungsmenge

Q1 0

tion verantwortlichen Photonenzahl.

dy

Die vorhandene Wellenlängenabhänh(x,y)

gigkeit des Leuchtdichtesignals soll

nicht Gegenstand der Betrachtung

CCD-Zelle

sein, weshalb man die im Urbild um

Q0 0

Q0 1

eine Dimension reduzierte Abbildung

x

des Leuchtdichtesignals

ax / 2

(r , t ) t ∈3 l ≡ l (r , t ) ∈ (4-10)

d

-ay / 2

x

betrachten kann. Der SignalverarbeiAbb. 4-1: Räumlicher Signalverarbeitungsprozeß des CCDtungsprozess der einzelnen CCD-ZelSensors

len wird durch eine örtliche und zeitliche Integration der generierten Ladungsträger mit einer örtlichen und zeitlichen Begrenzung

sowie einer anschließenden örtlichen und zeitlichen Abtastung charakterisiert. Eine Veranschaulichung dieses Prozesses kann nur in einem zeitlichen oder räumlichen Schnittbild entsprechend der Abb. 4-1 erfolgen, die den räumlichen Signalverarbeitungsprozess darstellt.

In erster Näherung lässt sich die Verschiebungsinvarianz dieser Operationen annehmen, da

die einzelnen CCD-Zellen die gleiche Struktur besitzen sowie äquivalenten physikalischen

Bedingungen unterliegen. Infolgedessen lässt sich das Systemverhalten über den mehrdimensionalen Faltungssatz

y ( t) =

z

x ( τ ) h( t − τ ) dτ , t, τ ∈n

(4-11)

n

bzw. über die komplexe Multiplikation im mehrdimensionalen Fourier-Raum

Y ( f ) = H (f ) X ( f ) ,

X (f ) = ℑ{x ( t)}(f ) , t, f ∈n

(4-12)

beschreiben. Aufgrund des vorliegenden räumlichen und zeitlichen Aufnahmeprozesses lässt

sich mit den Variablen t = (t1 t 2 t 3 ) t ≡ (r t t ) t ∈3 der Signalverarbeitungsvorgang im dreidimensionalen Fourier-Raum beschreiben. Unter Vernachlässigung der zeitlichen Verschiebung der Integration der CCD-Ladungen von ungeraden und geraden Zeilen lässt sich

der Signalverarbeitungsprozess des Luminanzsignals l ≡ x in (4-10) durch eine Integration

und eine Fensterung mit Abtastung charakterisieren.

-4-

4. Signalverarbeitungsmodell der Kamera

Aufgrund der Separabilität der Operationen kann die dreidimensionale Fourier-Transformierte

über

RS∏ x(t )UV(f ) = ∏ ℑlx(t )q( f )

T

W

ℑ

n

n

i

i =1

i

(4-13)

i

i =1

berechnet werden.

• Cross-Talk

Bei der Generation von Ladungen in den CCD-Zellen kann es zu einem Cross-Talk (Übersprechen) zwischen den CCD-Zellen kommen. Dies liegt darin begründet, dass beim

Transport der durch die einfallenden Photonen generierten Ladungsträger in die dem

Bildelement zugeordnete Ladungsspeicherzone Ladungsträger in unmittelbar benachbarte

Speicherzellen gelangen können. Dieser physikalische Effekt ist von der Geometrie der CCDZellen, der Leuchtdichte und der Wellenlänge des Lichtes abhängig. In ungünstigen Fällen

kann das Übersprechen in benachbarte Zellen bis zu 20% betragen [2]. Als Maß für die

Kopplung lässt sich eine Konstante cCT x;y angeben, die das Verhältnis des Ausgangssignals

eines nicht beleuchteten Pixel zu einem beleuchteten Pixel angibt. Im allgemeinen überwiegt

die Kopplung in Zeilen- gegenüber der in Spaltenrichtung [2]. Eine diagonale Kopplung kann

dabei in der Regel vernachlässigt werden [47], so dass sich das Übersprechen im analogen

Signal mit der Cross-Talk-Funktion

lCT ( x , y ) = l ( x , y ) + cCT x l ( x + dx , y ) ( rect a x ( x − d x ) + rect a x ( x + d x ))

+cCT y l ( x , y + dy ) ( rect a y ( y − d y ) + rect a y ( y + d y )) ,

mit

dx := CCD-Zellenabstand in x-Richtung,

dy := CCD-Zellenabstand in y-Richtung,

ax := Länge der CCD-Zelle in x-Richtung,

ay := Länge der CCD-Zelle in y-Richtung und

a x ; y = q x; y d x; y , 0 ≤ q x; y ≤ 1

(4-14)

beschreiben lässt. In Anwendung des Superpositions- und Verschiebungssatzes der FourierTransformation erhält man im Fourier-Raum die nicht separable Übertragungsfunktion der

Cross-Talk-Funktion zu:

MÜFCT (f ) = 1 + 2 cCT x a x si (a x π f x ) cos(2π f x d x )

+ 2 cCT y a y si (a yπ f y ) cos(2π f y d y ) .

(4-15)

Die letzten beiden Terme der Übertragungsfunktion wirken als Tiefpassfunktion, weshalb das

Übersprechen bei Helligkeitssprüngen zur einer „Verschleifung“ der Signale führen kann.

-5-

4. Signalverarbeitungsmodell der Kamera

• Integration und Abtastung

Der Prozess der Integration und Abtastung kann zur Verallgemeinerung der Betrachtungen

durch den Ansatz

x z Π ( t)

= xz Πδ ( t m ) =

t= tm

xz Π ( t) =

z

z z z

( m1 +1/ 2 ) a1 ( m2 +1/ 2 ) a2 ( m3 +1/ 2 ) a 3

x ( t) dt ,

mit

( m1 −1/ 2 ) a1 ( m2 −1/ 2 ) a2 ( m3 −1/ 2 ) a 3

x ( t − τ ) rect (τ 1 / a1 ) rect (τ 2 / a2 ) rect (τ 3 / a3 ) dτ

und

ℜ3

∀m ⊂ N 3 t m = (m1 T01 , m2 T02 , m3 T03 ) t := Abtastvektor,

T03 = T

:= maximale Integrationsdauer,

a3 = d t

:= Länge der zeitlichen Integration,

T01 = d x , T02 = d y ,

a1 = a x , a2 = a y ,

mit d t = qI ⋅ T , 0 ≤ qI ≤ 1

(4-16)

voneinander getrennt werden. Infolgedessen lässt sich der Aufnahmeprozess im dreidimensionalen Fourier-Raum über die Integration mit Fensterung

X z Π (f ) = a1 a2 a3 si(a1π f 1 ) si(a2π f 2 ) si(a3π f 3 )

X (f )

(4-17)

und die Abtastung

X z Πδ (f ) =

∞

∞

∞

∑ ∑ ∑ XzΠ ( f

1

− n1 f 01 , f 2 − n2 f 02 , f 3 − n3 f 03 ) ,

n1 =−∞ n2 =−∞ n3 =−∞

mit f 0i = 1 / T0i , i ∈{1,2,3}

(4-18)

beschreiben.

Die Gleichung (4-17) definiert den Einfluss der mehrdimensionalen Integration mit Fensterung. Diese Filterung führt zu einer Dämpfung hoher Frequenzen. Zur Angabe der

Bandbreite des Filters, wird zumeist die erste Nullstelle f Bi = 1/ ai der Spaltfunktion herangezogen.

In Gleichung (4-18) wird der mehrdimensionale Abtaster beschrieben. Die Apertur

ai f 0i = ai / T0i , i ∈{1,2,3}

(4-19)

des Abtasters bestimmt die Dämpfung des integrierten, periodisch verschobenen abgetasteten

Spektrums X z Πδ (f ) . Dabei kann es zu einem Aliasing der verschobenen Spektren mit dem

Spektrum der Ordnung (n1 , n2 , n3 ) t = (0,0,0) t kommen. Geht man analog zum eindimensionalen von einem mehrdimensionalen bandbegrenzten Spektrum

X B (f ) =

RS X (f ) für ∧

T 0 sonst

n

i =1

f i < f Bi = f 0i / 2

(4-20)

aus, so erhält man das mehrdimensionale Shannonsche Abtasttheorem zu:

∀ i ∈{1,2,..., n} f 0i ≥ 2 f Bi

.

(4-21)

Für mehrdimensionale bandbegrenzte Signale nach Gleichung (20) lässt sich das nach dem

Shannonschen Theorem (4-21) mehrdimensionale abgetastete Spektrum durch Filterung mit

einem idealen mehrdimensionalen Tiefpass, welcher nur das Spektrum der Ordnung

(n1 , n2 , n3 ) t = (0,0,0) t in Gleichung (4-18) passieren lässt, exakt rekonstruieren. Analog zum

eindimensionalen ist dann ein mehrdimensionales, bandbegrenztes und abgetastetes Signal

-6-

4. Signalverarbeitungsmodell der Kamera

eindeutig durch die diskreten Werte bestimmt. Die ideale mehrdimensionale Tiefpaßfilterung

lässt sich analog zum eindimensionalen im Originalbereich, unter geeigneter Verwendung der

Spaltfunktion, durch eine mehrdimensionale Interpolation

∑ x (m , m , m ) r (t

xR (t1 , t 2 , t 3 ) =

1

2

3

1

− m1 / T01 , t 2 − m2 / T02 , t 3 − m3 / T03 ) ,

( m1 ,m2 ,m3 )

mit r (t1 , t 2 , t 3 ) =

2 π f B1 2 π f B 2 2 π f B 3

π3

si(2 π f B1 t1 ) si(2 π f B 2 t 2 ) si(2 π f B 3 t 3 )

(4-22)

beschreiben.

• Spalten-Cross-Talk nach Abtastung und Integration

Geht man von einem Cross-Talk hauptsächlich in Zeilenrichtung aus, so lässt sich das Übersprechen auch nach Abtastung und Integration der Signale beschreiben und man erhält eine

im Kopplungsterm von ax freie Modulationsübertragungsfunktion:

MÜFCT x (f ) = 1 + 2 cCT x si (a x π f x ) cos(2π f x d x ) .

(4-23)

4.3 Sprungantwort einer idealen Kante

Im folgenden sei das Systemverhalten eines idealen optischen Tiefpasssystems

HTP = rect ( f x / f x Max ) rect ( f y / f y Max )

(4-24)

mit der Bandbreite f x ; y Max im Hinblick auf die Abbildung einer idealen Kante

s( x , y ) = s( x ) s( y )

(4-25)

dargestellt. Aufgrund der Separabilität der Fourier-Transformation und der Gleichungen (424) und (4-25) lassen sich die Betrachtung auf den eindimensionalen Fall reduzieren. Bei inkohärenter Beleuchtung erhält man nach

Stößel [85] als Sprungantwort:

hTPs(x) / hTPs Max(x)

1

hTPs ( x ) =

0,8

fx Max= 4 fMax

fx Max= fMax

fx Max= fMax / 4

0,6

z

x

0,4

mit SI ( x ) = si ( x ) dx .

x / fMax

-2

0

(4-26)

0

0,2

-4

1 SI(2 π f x Max x )

+

2

π

,

1 cos(2 π f x Max x ) − 1

+

2 π f x Max x

π

2

4

Abb. 4-2: Bild einer idealen Kante eines idealen

optischen Tiefpaßsystems

Bedingt durch das Tiefpassverhalten des Systems wird die Abbildung der Kante „verschliffen“, was sich mit einer Verringerung

der Bandbreite entsprechend verstärkt (siehe

Abb. 4-2).

Die Koordinate des Kantenorts, die zugleich

den Wendepunkt der Sprungantwort charakterisiert, ist invariant gegenüber der Bandbreite

des abbildenden optischen Systems. Lediglich die Kantensteilheit wird durch die Bandbreite

beeinflusst, was für ein Positionsmesssystem von Vorteil ist.

-7-

4. Signalverarbeitungsmodell der Kamera

4.4 Übertragungsverhalten unter Berücksichtigung von

Ortsintegration, Abtastung und Cross-Talk

Für die Konzeption des Positionsmesssystems und die Gestaltung der Aufnahmebedingungen,

gilt es einen Kompromiss zwischen den verschiedenen konkurrierenden Einflussgrößen zu

finden, da eine möglichst hohe Ortsauflösung im Widerspruch zum Aliasingproblem der Ortsdiskretisierung des CCD-Sensors und zum Erreichen einer möglichst großen Schärfentiefe

steht. Für die Optimierung des Übertragungsverhaltens des CCD-Kamerasystems wird von

den Aufnahmebedingungen der Tab. 4-1 für makroskopische Aufnahmen (4-8) ausgegangen.

Größen

horizontal

ai f 0i

Aperturen

vertikal

Rechenwert

94,5 %

96,8 %

95 %

11,64 µm

11,35 µm

11,0 µm

CCD-Zellenabstand

dx;y

Tiefenschärfebereich

∆z

-------------

-------------

0,5 mm

Mittlere Wellenlänge

λ

-------------

-------------

600 nm

Bildweite

b

wie horizontal

29 mm

12 - 75 mm

V-1 = g / b

Abbildungsmaßstab

-------------

-------------

3,4 - 4

Tab. 4-1: Aufnahmebedingungen für Makroaufnahmen

Die Apertur ist eine vom CCD-Sensor abhängige Größe und kann für eine Optimierung nicht

herangezogen werden. Die Abb. 4-3 zeigt die Spektren eines Dreiecksspektrums der Bandbreite 0,7 f 0i / 2 , die nach Ortsintegration (4-17) und -abtastung (4-18) mit verschiedenen

|MÜF| / |MÜF| Max / %

100

75

50

25

0

-2

-1

0

1

fx dx

100

80

60

40

20

0

-2

-1

0

1

100

66,6

33,4

12

2 2

1

-1

0 f d

y y

-2

0

-2

-1

0

Apertur 10%

1

0

-1

100

75

50

25

0

-2

Apertur 80%

-2

-1

0

1

1

2 2

2 2

1

0

-1

-2

Apertur 40%

1

0

-1

-2

Apertur 99%

Abb. 4-3: Spektren eines Dreiecks-Spektrums bei Ortsintegration und -abtastung mit verschiedenen Aperturen

-8-

4. Signalverarbeitungsmodell der Kamera

Aperturen (4-19) entstehen.

Hieran wird deutlich, dass bei wachsenden Aperturen die durch die Diskretisierung entstehenden verschobenen Spektren zunehmend stärker gedämpft werden. Ein möglichwerweise vorhandenes Aliasing lässt sich hierdurch in seiner Wirkung nicht reduzieren. Die Einhaltung des

Abtasttheorems kann deshalb nur durch die optische Tiefpasswirkung der Blende sichergestellt werden, weshalb für die Blendeneinstellung bei einem Zellenabstand von 11,0 µm

dann folgende Ungleichung zu beachten wäre:

BL ≥

2 ⋅ d x; y

|MÜF|

λ

= 36,7 .

Cross-Talk

1,25;2,5;5;10;20 [%]

1,6

1,4

1,2

1

(4-27)

Die Blendenzahlen handelsüblicher Objektive

liegen zwischen 16 und 22, womit sich ein

Aliasingeffekt selbst bei größter Blendenzahl

nicht grundsätzlich ausschließen lässt. Infolgedessen wäre bei ausreichender Leuchtdichte eine

minimale Blendenöffnung, die zugleich die maximale Tiefenschärfe ermöglicht, die optimale

Blendeneinstellung.

Beschränkt man sich jedoch auf relativ großflächige Strukturen mit kontrastreichen Hellig0

fx dx keitssprüngen, bei denen die auszuwertende Infor0,4

0,2

mation in den Konturen der Bilddaten steckt, so

Abb. 4-4: Cross-Talk-Modulationsübertragungs- ist die aliasingfreie Abtastung zu Gunsten einer

funktion

möglichst steilflankigen Sprungantwort und damit

breitbandigen Signalübertragung entsprechend

CCDKap. 4.3 vorzuziehen. Die breitbandige SignalIntegration

11 µm

übertragung hat den Vorteil, dass die Sprungant|MÜF|

Defokussierung

wort und damit die Bildkonturen möglichst verzerrungsarm übertragen werden. Infolgedessen

0,8

Blendengilt es, das Optimum aus Tiefenschärfe und Band0,4

beugung

breite zu bestimmen. Betrachtet man den Betrag

der MÜF aus der Blenden- und Fokus-MÜF (4-4)

0

50

und (4-6) mit CCD-Integration in Abb. 4-5, so

5

100

10

wird deutlich, dass die Tiefpasswirkung der CCD150

15

Lp/mm

BL

20 200

Integration bei Blendenzahlen oberhalb von 10

bestimmend ist. Eine optimale Blendenzahl von

(ohne und mit Integration 11µm)

ca. 10, von der in der Optik gewöhnlich gespro|MÜF|

chen wird, lässt sich in der vorliegenden Auf0,8

nahmesituation bei den heute üblichen CCD-Sensoren nicht verwenden. Aufgrund der Integra0,6

tionswirkung verschiebt sich die optimale Blendenzahl zu größeren Werten. Das Plateau ist aller0,4

12,5 und 25 Lp/mm

dings relativ flach, so dass die Wahl einer hiervon

BlendenOrtsfrequenz

zahlenbereich

abweichenden Blendenstellung in diesem Zusam0,2

typischer

menhang als unkritisch betrachtet werden kann.

Objektive

BL

Die Tiefpaßwirkung der Cross-Talk-Funktion in

0

40

10

20

30

Abb. 4-4 wird erst bedeutsam, wenn der KoppAbb. 4-5: Übertragungsverhalten der abbildenden lungsfaktor größer als 5% ausfällt, was unter norOptik unter Berücksichtigung der CCD-Integra- malen Aufnahmebedingungen nicht der Fall ist.

tion (11 µm)

Selbst bei einem 10%-igen Cross-Talk wird ein

0,8

ax = dx

-9-

4. Signalverarbeitungsmodell der Kamera

idealer Helligkeitsübergang zwischen den Weiß- und Schwarzwerten nur auf ungefähr eine

Pixelbreite ausgedehnt.

Zusammenfassend lässt sich sagen, dass für makroskopische CCD-Kameraaufnahmen mit

einer Tiefenschärfe unterhalb von 500 µm eine Blendenzahl oberhalb von 10 gewählt werden

muss. Bei zunehmenden Anforderungen an die Tiefenschärfe, ist die maximale Blendenzahl

des Objektivs zu wählen.

4.5 Zusammenfassung

In diesem Abschnitt wurden das Bildsignalverarbeitungsmodell des videometrischen Messsystems mit systemtheoretischen Methoden untersucht.

Die Steilheit der Systemantwort einer idealen Kante wird von verschiedenen konkurrierenden

Systemeigenschaften, die ein Tiefpaßverhalten aufweisen, bestimmt. Hierbei handelt es sich

um das Übersprechen (Cross-Talk) zwischen den CCD-Zellen, die Ortsintegration der Ladungen in den CCD-Zellen, der Defokussierung und Blendenbeugung, wobei in der Regel das

Übersprechen gegenüber den verbleibenden Einflussgrößen vernachlässigt werden kann.

- 10 -

4. Signalverarbeitungsmodell der Kamera

- 11 -

4. Signalverarbeitungsmodell der Kamera

Inhaltsverzeichnis

4

Signalverarbeitungsmodell der Kamera...................................................................1

4.1

Objektiv....................................................................................................................1

4.2

CCD-Sensor .............................................................................................................4

4.3

Sprungantwort einer idealen Kante..........................................................................7

4.4

Übertragungsverhalten unter Berücksichtigung von Ortsintegration,

Abtastung und Cross-Talk .......................................................................................8

4.5

Zusammenfassung..................................................................................................10

- 12 -