Skript GK - Ihre Homepage bei Arcor

Werbung

I Laplaceexperimente

Der berühmte Mathematiker Blaise Pascal (1623 – 62) erkannte, dass man zwar den Ausgang eines

Zufallsexperiments nicht voraussagen kann, dafür aber oft die Wahrscheinlichkeit aller möglichen

Ausgänge. Durch .Alltagserfahrungen ist uns der Wahrscheinlichkeitsbegriff schon etwas vertraut.

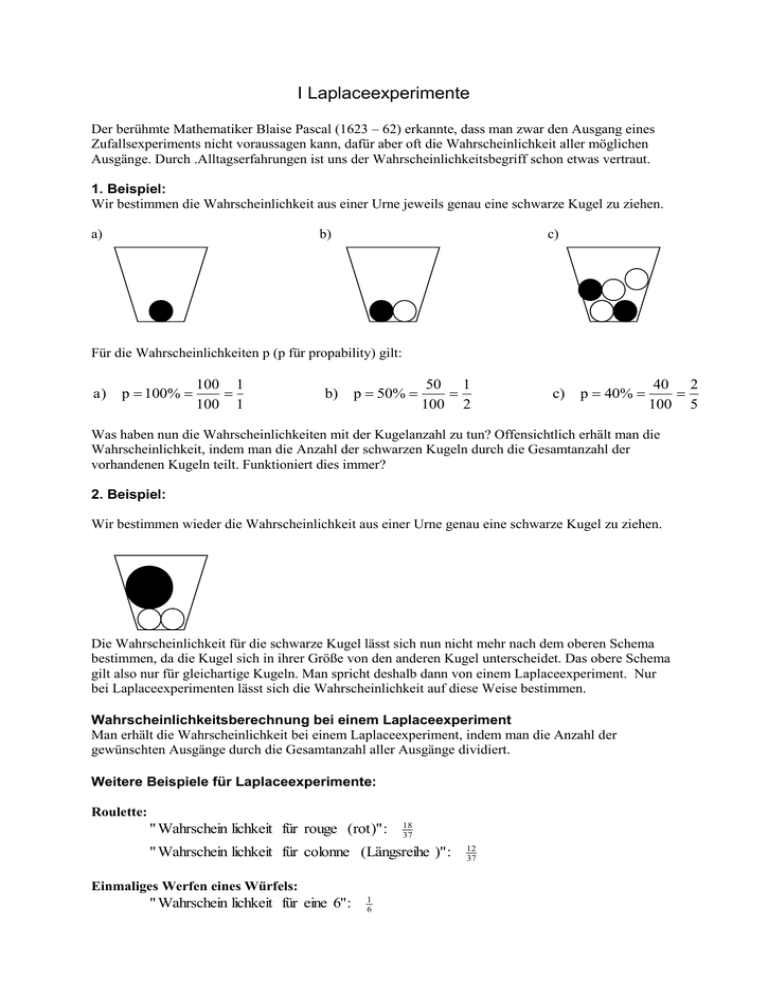

1. Beispiel:

Wir bestimmen die Wahrscheinlichkeit aus einer Urne jeweils genau eine schwarze Kugel zu ziehen.

a)

b)

c)

Für die Wahrscheinlichkeiten p (p für propability) gilt:

a)

p 100%

100 1

100 1

b)

p 50%

50 1

100 2

c)

p 40%

40 2

100 5

Was haben nun die Wahrscheinlichkeiten mit der Kugelanzahl zu tun? Offensichtlich erhält man die

Wahrscheinlichkeit, indem man die Anzahl der schwarzen Kugeln durch die Gesamtanzahl der

vorhandenen Kugeln teilt. Funktioniert dies immer?

2. Beispiel:

Wir bestimmen wieder die Wahrscheinlichkeit aus einer Urne genau eine schwarze Kugel zu ziehen.

Die Wahrscheinlichkeit für die schwarze Kugel lässt sich nun nicht mehr nach dem oberen Schema

bestimmen, da die Kugel sich in ihrer Größe von den anderen Kugel unterscheidet. Das obere Schema

gilt also nur für gleichartige Kugeln. Man spricht deshalb dann von einem Laplaceexperiment. Nur

bei Laplaceexperimenten lässt sich die Wahrscheinlichkeit auf diese Weise bestimmen.

Wahrscheinlichkeitsberechnung bei einem Laplaceexperiment

Man erhält die Wahrscheinlichkeit bei einem Laplaceexperiment, indem man die Anzahl der

gewünschten Ausgänge durch die Gesamtanzahl aller Ausgänge dividiert.

Weitere Beispiele für Laplaceexperimente:

Roulette:

" Wahrschein lichkeit für rouge (rot )" :

18

37

" Wahrschein lichkeit für colonne (Längsreihe )" :

Einmaliges Werfen eines Würfels:

" Wahrschein lichkeit für eine 6":

1

6

12

37

II Zufallsexperimente, Ereignis und Ergebnisraum

Man erhält also die Wahrscheinlichkeit bei einem Laplaceexperiment, indem man die Anzahl der

gewünschten Ausgänge durch die Gesamtanzahl aller Ausgänge dividiert. Zur Vereinfachung führt

man nun neue Begriffe ein. Die gewünschten Ausgänge bezeichnet man als Ereignis, alle Ereignisse

zusammen bilden den Ergebnisraum. Wir beschäftigen uns dabei stets mit Zufallsexperimenten.

Definition Zufallsexperiment:

Ein Zufallsexperiment ist ein Vorgang, den man unter gleichen Bedingungen beliebig oft wiederholen

kann und der bei mehreren Versuchen zu unterschiedlichen Ergebnissen führen kann.

Beispiele:

Einige der bekanntesten Zufallsexperimente sind Lotto, Roulette, Werfen einer Münze, Werfen eines

Würfels, Ziehen einer Kugel aus einer Urne.

Definition Ergebnisraum:

Jeden Ausgang eines Zufallsexperiments bezeichnet man als Ergebnis. Die Menge aller verschiedenen

Ergebnisse eines Zufallsexperiments nennt man Ergebnisraum Ω.

Beispiele:

a)

Lotto (Ziehen der ersten Kugel)

b)

Roulette

c)

Werfen eines Würfels:

d)

Werfen einer Münze:

1,2,3, ... ,47,48,49

0,1,2, ... ,34,35,36

1 1,2,3,4,5,6

2 "6" , " Nicht 6"

3 " Gerade Zahl " , " Ungerade Zahl "

" Kopf " , " Zahl"

Dabei kann es sich bei einem Zufallsexperiment auch mehrere Ergebnisräume geben siehe Beispiel c),

je nachdem wofür man sich bei einem Experiment interessiert. Im Beispiel c) nennt man 2 eine

Vergröberung von 1 und umgekehrt 1 eine Verfeinerung von 2 oder 3 .

In der Regel interessiert man sich bei einem Zufallsexperiment nicht für den ganzen Ergebnisraum,

sondern nur für ein Ergebnis oder einen Teil des Ergebnisraums. So setzt man beim Roulette-Spiel

z.B. auf alle schwarzen Felder, alle geraden Zahlen, auf eine Reihe oder z.B. auf mehrere verschiedene

Zahlen. Solche Mengen nennt man Ereignisse.

Definition Ereignis:

Jede Teilmenge A von heißt Ereignis aus dem Ergebisraum .

Beispiele für ein Ereignis:

Roulette

= {0,1,2, ... , 34,35,36}, A = {2,3,5,7}

Man sagt, das Ereignis A sei eingetreten, wenn beim einmaligen Wurf der Kugel das Ergebnis 2,3,5

oder 7 ist.

Besondere Ereignisse:

a)

Ereignisse mit nur einem Element heißen Elementarereignisse.

b)

Das Ereignis heißt sicheres Ereignis, da es stets eintritt.

c)

Das Ereignis {} („leere Menge“) heißt unmögliches Ereignis, da es nie eintreten kann.

III Relative Häufigkeit

Wie groß ist nun die Wahrscheinlichkeit aus der gegebenen Urne genau eine schwarze Kugel zu

ziehen?

Diese Frage lässt sich nicht genau beantworten, da die Kugeln nicht gleichartig sind. Es bleibt nur die

Möglichkeit, den Vorgang sehr häufig zu wiederholen und mit den Ergebnissen auf die

Wahrscheinlichkeit dieses Ereignisses zu schließen.

Man erhält dann die sogenannte relative Häufigkeit hn (A) des Ereignisses.

Definition der relativen Häufigkeit:

Tritt ein Ereignis A bei n Versuchen k-mal ein, so heißt hn ( A)

k

die relative Häufigkeit des

n

Ereignisses A.

Um so größer die Anzahl der Versuche ist, umso mehr wird sich in der Regel die relative Häufigkeit

eines Ereignisses um einen festen Wert nämlich der exakten Wahrscheinlichkeit stabilisieren.

Diese Besonderheit der relativen Häufigkeit bezeichnet man als das Gesetz der großen Zahlen.

Beispiel:

Ein Würfel wird sehr häufig geworfen und die Augenzahl nach jedem Wurf notiert. Dabei ergab sich

folgende Verteilung

a) nach 150 Würfen

Augenzahl:

Absolute Häufigkeit:

1

26

2

27

3

25

4

15

5

34

6

23

b) nach 1200 Würfen

Augenzahl:

Absolute Häufigkeit:

1

187

2

244

3

204

4

155

5

210

6

200

Aus den absoluten Häufigkeiten und der Gesamtzahl der Würfe (150 bzw.1200) lassen sich nun die

relativen Häufigkeiten für die einzelnen Augenzahlen bestimmen:

a) nach 150 Würfen

Augenzahl:

Relative Häufigkeit:

a) nach 1200 Würfen

Augenzahl:

Relative Häufigkeit:

1

26/150

17,3%

2

27/150

18,0%

3

4

5

6

25/150 15/150 34/150 23/150

16,7% 10,0% 22,7% 15,3%

1

2

3

4

5

6

187/1200 244/1200 204/1200 155/1200 210/1200 200/1200

15,6%

20,3% 17,0% 12,9%

17,5% 16,7%

Merke:

Da man die Wahrscheinlichkeit bei vielen Vorgängen nicht exakt bestimmen kann, verwendet man

häufig die relative Häufigkeit als Wahrscheinlichkeit, obwohl dies mathematisch natürlich nicht ganz

exakt ist. Um die exakte Wahrscheinlichkeit in so einem Fall zu erhalten, müsste man ja das

Experiment unendlich oft durchführen!

Anwendung: Benford-Gesetz

IV Zusammengesetzte Zufallsexperimente

1. Das Baumdiagramm

Die Bestimmung von Wahrscheinlichkeiten ist nicht mehr ganz so einfach wie in unserem

ersten Schema, wenn ein Experiment mehrmals (z.B. dreimaliges Werfen eines Würfels)

oder verschiedene Zufallsexperimente nacheinander durchgeführt werden. Man spricht

dann von zusammengesetzten Zufallsexperimenten.

Beispiel: Die Würfel des Efron

Würfel 1

Würfel 2

3

0

3 3

3

Würfel 3

4 0

4

3

3

1 1

5

4

4

Würfel 4

1

6 2

2

5

5

6

2

2

Wir sehen hier jeweils das Netz eines Würfels. Es werden zwei Würfel ausgewählt und mit

beiden einmal gewürfelt. Sieger ist derjenige, der die höhere Augenzahl geworfen hat. Wie

man mit etwas Überlegung erkennen kann, gewinnt mit einer höheren Wahrscheinlichkeit

Würfel 2 gegen 1, 3 gegen 2, 4 gegen 3 und erstaunlicherweise 1 gegen 4.

Wie endet aber das Duell 2 gegen 4? Dies lässt sich nicht ganz so einfach herausfinden.

Hierfür benötigen wir ein Baumdiagramm.

P()

2

02

1

3

23

2

9

6

06

1

3

13

1

9

2

42

2

3

23

4

9

6

46

2

3

13

2

9

2

3

0

1

3

1

3

2

3

2

3

4

1

3

Es wird zuerst Würfel 2 geworfen, dann Würfel 4. An den Pfaden steht jeweils die zugehörige

Wahrscheinlichkeit. Um die Gesamtwahrscheinlichkeit für ein Ereignis zu bestimmen,

müssen die entsprechenden Pfadwahrscheinlichkeiten miteinander multipliziert werden.

Würfel 2 gewinnt nur dann, wenn das Ereignis 42 eintritt (d.h. wenn Würfel 2 die Zahl 4 und

Würfel 4 die Zahl 2 wirft). Durch Multiplizieren der Pfadwahrscheinlichkeiten erhält man als

Ergebnis P(42) 23 23 94 .

In den anderen drei Fällen also bei den Ereignisse 02, 06 oder 46 gewinnt Würfel 4.

Multipliziert man hier die Pfadwahrscheinlichkeiten erhält man als Wahrscheinlichkeit

P(02,06,46) 13 23 13 13 23 13 92 19 92 95 .

Würfel 4 besitzt damit eine höhere Gewinnwahrscheinlichkeit als Würfel 2.

2. Die Vierfeldertafel

Betrachtet man genau zwei verschiedene Ereignisse, so verwendet man zur Berechnung von

Wahrscheinlichkeiten oft auch eine Vierfeldertafel.

Beispiel:

An einem Gymnasium sind von 1000 Schülern 400 männlich, davon sind 15 Linkshänder. 5%

aller Schüler an der Schule sind Linkshänder. Wie groß ist die Wahrscheinlichkeit, dass ein

willkürlich ausgewähltes Kind weiblich und Rechtshänder ist?

Wir definieren folgende Ereignisse:

M:= Menge aller Jungen, M := Menge aller Mädchen

L:= Menge aller Linkshänder, L := Menge aller Rechtshänder

Wir können die Vierfeldertafel nun mit den Mächtigkeiten der Ereignisse bilden oder mit den

zugehörigen Wahrscheinlichkeiten.

Vierfeldertafel mit Mächtigkeiten

M

M

L

15

35

50

L

385

565

950

400

600

1000

Durch Vervollständigen der Tabelle erhalten wir die Mächtigkeiten für alle vier möglichen

Fälle. Es sind also 565 Kinder sowohl weiblich als auch Rechtshänder. Da nach einer

Wahrscheinlichkeit gefragt ist, müssen wir den Zahlwert noch durch die Gesamtanzahl

In diesem Fall 1000 dividieren. Die Wahrscheinlichkeit beträgt demnach 56,5%

Vierfeldertafel mit Wahrscheinlichkeiten

M

M

L

0,015

0,035

0,050

L

0,385

0,565

0,950

0,400

0,600

1

Die Wahrscheinlichkeiten lassen sich hier einfach bequem aus der Tabelle ablesen.

56,5% aller Kinder sind also sowohl weiblich als auch Rechtshänder.

Hinweis: Paradoxon von Simpson

V Ereignisalgebra

Häufig interessiert man sich nicht nur für ein Ereignis, sondern auch für die Verknüpfung von

Ereignissen. So kann es z.B. interessant sein, wenn zwei Personen A und B Roulette spielen, dass

a) A und B (Schreibweise: A B ) gleichzeitig gewonnen haben oder

b) A oder B (Schreibweise: A B ), d.h. mindestens einer von beiden.

c) Nicht A (Schreibweise: A ), d.h. dass A nicht gewonnen hat, wäre bei diesem Beispiel vor allem

für die „Bank“ interessant.

Für die Darstellung solcher Verknüpfungen verwendet man gerne sogenannte Venn-Diagramme.

a) A B

Beispiel:

= {1,2,3,4,5,6}

b) A B

Beispiel:

= {1,2,3,4,5,6}

c) A

Beispiel:

= {1,2,3,4,5,6}

A = {1,2,3,4}, A = {5,6}

A = {1,2,3,4}, B = {3,4,5} A B = {3,4}

A = {1,2,3,4}, B = {3,4,5} A B = {1,2,3,4,5}

Darüber hinaus gelten folgende zwei wichtige Gesetze:

1)

Gesetz von de Morgan

a) A B A B

b) A B A B

2)

Regel von Sylvester

bzw.

AB A B AB

P(A B) P(A) P(B) P(A B)

VI Kombinatorik

Häufig sind beim Untersuchen von Zufallsexperimenten die einzelnen Elemente eines Ereignisses A

gar nicht so interessant wie deren Mächtigkeit A . So ist es beim Lottospiel z.B. besonders spannend

zu wissen, wie viele verschiedene Möglichkeiten es bei jeder Samstagsziehung für einen „Fünfer“

gibt. Mit solchen Fragen beschäftigt man sich in der Kombinatorik. Von zentraler Bedeutung bei der

Bestimmung der Mächtigkeit von Ereignissen bei zusammengesetzten Zufallsexperimenten ist dabei

das Zählprinzip.

Definition Zählprinzip:

Gibt bei einem aus k Teilen zusammengesetzten Zufallsexperimentes das

im 1.Fall n1 Möglichkeiten

im 2.Fall n 2 Möglichkeiten

.................................................

.................................................

im n.Fall n k Möglichkeiten

so besitzt das Zufallsexperiment insgesamt

n1 n2 ... nk Möglichkeiten

Beispiel:

Wieviele verschiedene dreistelligen Zahlen gibt es, bei denen jede Ziffer nur einmal vorkommen darf?

Für die erste Stelle gibt es 9 Möglichkeiten, da die Ziffer 0 nicht am Anfang stehen darf.

Für die zweite Ziffer gibt es wiederum 9 Möglichkeiten, da die Ziffer, welche für die erste

Stelle gewählt wurde,

nicht mehr verwendet werden darf, dafür kann nun aber auch die 0 stehen.

Für die letze Stelle bleiben noch 8 Ziffern übrig, da von den 10 Ziffern schon zwei vorher

ausgewählt wurden.

Es gibt also 9 9 8 verschiedene dreistellige Zahlen, bei denen jede Ziffer nur einmal

vorkommen darf.

Spezialfälle:

In der Kombinatorik kommen beim Zählprinzip drei Spezialfälle besonders häufig vor.

1. K-Tupel

Urnenmodell: „Ziehen nacheinander mit Zurücklegen“

Beispiel:

Wie viele Möglichkeiten gibt es beim dreimaligen Werfen eines Würfels?

Für diesen Vorgang 6 6 6 216 Möglichkeiten.

Allgemein:

Aus einer Urne mit n Kugeln werden nacheinander k Kugeln mit zurücklegen gezogen. In diesem Fall

gibt es n k Möglichkeiten.

2. k-Permutationen

Urnenmodell: „Ziehen nacheinander ohne Zurücklegen“

Beispiel:

Wie viele Möglichkeiten gibt es 6 Krawatten auf 10 Männer zu verteilen?

Für diesen Vorgang gibt es 10 9 8 7 6 5

10 ! Möglichkeiten

(10 6) !

Allgemein:

Aus einer Urne mit n Kugeln werden nacheinander k Kugeln ohne zurücklegen gezogen. In diesem

Fall gibt es

n!

Möglichkeiten.

(n k )!

3. k-Teilmengen

Urnenmodell: „Gleichzeitiges Ziehen“

Beispiel:

Wieviele Möglichkeiten gibt es beim Lotto „6 aus 49“?

Würde die Reihenfolge eine Rolle spielen, dann wären es nach dem Modell der kPermutationen:

49 !

49 48 47 46 45 44

(49 6) !

Da die Reihenfolge beim Lotto aber keine Rolle spielt und es 6 ! 6 5 4 3 2 1 Möglichkeiten

gibt, jede Ziehung anzuordnen, muss noch durch 6! dividiert werden.

49 !

49 48 47 46 45 44 Möglichkeiten

Es gibt also

(49 6) ! 6!

6 5 4 3 2 1

Allgemein:

Aus einer Urne mit n Kugeln werden gleichzeitig k Kugeln gezogen. In diesem Fall gibt es

49

n!

Möglichkeiten.

(n k )!k!

6

VII Unabhängigkeit

Beispiel:

Peggy Suhlke arbeitet im Statistikbüro Schummel. Sie untersucht den Zusammenhang zwischen

blonder Haarfarbe und Intelligenz bei einer Gruppe von 2000 Personen.

Sie definiert dazu folgende Ereignisse:

I: Person ist überdurchschnittlich intelligent (IQ von über 100)

I : Person ist unterdurchschnittlich intelligent (IQ von unter 100)

B: Person besitzt blonde Haarfarbe

B : Person besitzt keine blonde Haarfarbe

Die Vierfeldertafel gibt die von ihr ermittelten Wahrscheinlichkeiten (Relativen Häufigkeiten) wieder.

I

0,15

0,45

0,60

B

B

I

0,10

0,30

0,40

0,25

0,75

1

P(I B) 0,15

P(I) P(B) 0,6 0,25 0,15

Wegen P(I B) P(I) P(B) sind die beiden Ereignisse voneinander unabhängig.

Die beiden Ereignisse beeinflussen sich deshalb also nicht gegenseitig!

Beweis:

= Anzahl der überdurchschnittlich Intelligenten

I

B

= Anzahl der blonden Menschen

I B = Anzahl der überdurchschnittlich intelligenten blonden Menschen

= Gesamtbevölkerung

Dann gilt

I B

B

I B

I

I

B

B

P( I B) P( I ) P( B)

Definition Unabhängigkeit

Zwei Ereignisse A und B heißen genau dann unabhängig, wenn folgende Produktregel erfüllt ist:

P(A B) P(A) P(B)

Merke:

Um zwei Ereignisse A und B auf stochastische Unabhängigkeit zu untersuchen, genügt es eine

Vierfeldertafel aufzustellen und zu überprüfen, ob gilt: P(A B) P(A) P(B)

Ist die Gleichung nicht erfüllt, so sind die beiden Ereignisse abhängig voneinander.

VIII Die Bernoulli-Kette

1. Das Bernoulli-Experiment

Beispiel:

Gustavo kauft sich ein Überraschungsei. In jedem siebten Ei befindet sich eine „Herr-der-RingeFigur“. Das übliche Spielzeug ist für ihn uninteressant. Er interessiert sich nur für die beiden

Ereignisse Figur ( F ) oder keine Figur ( F ).

Darstellung:

1,0

F, F

1 „Treffer“,

0 „Niete“

Wahrscheinlichkeitsverteilung:

1

7

6

P( F )

7

P( F )

P (1) p

P (0) q 1 p

Definition Bernoulli-Experiment

Ein Zufallsexperiment heißt Bernoulli-Experiment, wenn man sich nur für zwei Ereignisse A und A

interessiert.

2. Die Bernoulli-Kette

Beispiel:

Mit welcher Wahrscheinlichkeit erhält Gustavo beim Kauf von 8 Überraschungseiern genau zwei

„Herr der Ringe Figuren“, wenn sich durchschnittlich in jedem 7.Ei eine solche Figur befindet?

1.Schritt: „Die Figuren befinden sich in den ersten beiden Eiern“

2

P({11000000}) =

1 1 6 6 6 6 6 6

1 6

7 7 7 7 7 7 7 7

7 7

6

2.Schritt: „Verteilung der zwei Eier auf acht Plätze“

8

Für die Verteilung der zwei Eier, in denen sich jeweils eine Figur befindet, gibt es Möglichkeiten.

2

3.Schritt: Zusammenfassung:

8 1

2

6

6

P(„genau zwei Überraschungseier“) =

2 7 7

Definition Bernoulli-Kette

Ein Zufallsexperiment, das aus n gleichen Bernoulli-Experimenten zusammengesetzt ist, heißt

Bernoulli-Kette der Länge n.

Für die Wahrscheinlichkeit , um bei einer Bernoulli-Kette der Länge n genau k Treffer zu erzielen, gilt

n

B(n; p; k ) p k q n k

k

IX Testen von Hypothesen (Signifikanztest)

Beim letzten Urlaub kauften wir täglich zweimal den folgenden Eisbecher

In jedem Becher befand sich eine von 6 verschiedenen Figuren.

Folgende Geschichte lag bei:

Nach 11 Urlaubstagen hatten wir folgende Figuren:

8 mal Prinz „Heroic Prince“

5 mal Drache „Fire Dragon“

4 mal Magier „Magic Man“

3 mal Hexe „Crualina“

2 mal Skelett „Skelly“

aber immer noch keine Prinzessin „Lovely Clara“!!

Da wir in 22 Eisbechern keine Prinzessin vorgefunden hatten, wollten wir die

Hypothese überprüfen, ob die Wahrscheinlichkeit für „Lovely Clara“ wirklich

mindestens 1/6 beträgt.

Definition Hypothese

Eine Aussage über die Wahrscheinlichkeit eines Ereignisses bezeichnet man als Hypothese oder auch

Nullhypothese H 0 . Die Verneinung der Nullhypothese nennt man Gegenhypothese.

Die Hypothese in unserem Fall lautet also H 0 : p

1

1

. Die Gegenhypothese wäre dann p .

6

6

Um die Nullhypothese zu überprüfen, verwenden wir eine Stichprobe von 50 Eisbechern.

Nun ist eine Entscheidungsregel zu definieren, bei der man die Hypothese annimmt bzw. ablehnt.

(In Aufgaben ist sie meist vorgegeben). In unserem Beispiel könnte sie lauten:

Entscheidungsregel:

Annahmebereich der Nullhypothese:

Ablehnungsbereich der Nullhypothese:

{5,6, ... , 48,49,50}

{0,1,2,3,4}

Man nimmt also die Hypothese an, wenn in den nächsten 50 Eisbechern mindestens 5 mal „Lovely

Clara“ enthalten ist. Dabei können zwei Fehler vorkommen.

Fehlerarten:

Fehler 1. Art

Die Nullhypothese wird abgelehnt, obwohl sie in Wirklichkeit wahr ist.

Es könnte sein, dass sich wirklich in durchschnittlich jedem sechsten Eisbecher

Lovely Clara befindet, die Anzahl der Figuren aber im Ablehnungsbereich liegt.

Die Wahrscheinlichkeit dafür bezeichnet man als Signifikanzniveau α

Fehler 2.Art

Die Nullhypothese wird angenommen, obwohl sie in Wirklichkeit falsch ist.

In unserem Beispiel könnte es sein, dass sich in Wirklichkeit wie angenommen zu wenige

Prinzessinnen in den Eisbechern befinden, die Anzahl beim Öffnen aber im

Annahmebereich ist.

Annahmebereich

A = {5,6, ... , 11,12,13}

H 0 stimmt: p

1

6

Gegenhypothese: p

1

6

☺

Ablehnungsbereich

A {0,1,2,3,4}

(Fehler 1.Art)

( Fehler 2.Art)

☺

Die Wahrscheinlichkeit für den Fehler 1.Art ist damit:

4

B(50; 16 ; i) 0,06431 d.h. das Signifikanzniveau α, beträgt damit 6,43%.

i 0

Definitionen:

Testart: Einseitiger Signifikanztest

Besteht der Ablehnungsbereich aus einem einzigen Intervall, spricht man von einem einseitigen Test.

Da der Ablehnungsbereich bei 0 beginnt, spricht man von einem linksseitigen Signifikanztest.

Andernfalls spricht man von einem rechtsseitigen Signifikanztest.

Testgröße:

Als Testgröße T bezeichnet man die Zufallsgröße, die einem Hypothesentest zugrunde liegt

(Hier: Anzahl der „Lovely Claras“ bei 50 gekauften Eisbechern).

X Testen von Hypothesen (Alternativtest)

Bislang wurde nur untersucht ob eine Hypothese wahr ist oder nicht. Manchmal stehen aber auch zwei

Hypothesen zur Auswahl, zwischen denen man sich unterscheiden muss.

Definition Signifikanztest und Alternativtest

Ein Signifikanztest ist ein Entscheidungsverfahren, bei dem untersucht wird ob eine ganz bestimmte

Hypothese H 0 wahr ist oder nicht.

Ein Alternativtest ist dagegen ein Entscheidungsverfahren, bei dem untersucht wird welche von zwei

Hypothesen H 1 und H 2 wahr ist.

Beispiel zum Alternativtest:

Firma Schili stellt LEDs mit zwei Maschinen her. 1% der produzierten Stücke von Maschine 1 und

10% der produzierten Stücke von Maschine 2 sind erfahrungsgemäß defekt. Zwei Elektronikfirmen

haben bei der Firma Schili jeweils eine Kiste LEDs geordert. Die eine Firma ist mit den billigen

Stücken von Maschine 2 zufrieden, die andere benötigt die guten und teueren LEDs von Maschine 1.

Die Lieferfirma hat nun leider vergessen, die einzelnen gelieferten Schachteln zu kennzeichnen. Durch

eine Stichprobe vom Umfang 100 soll nun überprüft werden, ob sich in einer Kiste LEDs von

Maschine 1 oder Maschine 2 befinden.

Die Hypothesen sind nun H1 : p 0,01 und H 2 : p 0,1

Die Entscheidungsregel könnte nun lauten:

Entscheidungsregel:

Annahmebereich der Hypothese H 1 :

{0,1,2,3}

Annahmebereich der Hypothese H 2 :

{4,5,6, ... ,98,99,100}

Fehlermöglichkeiten

Fehler1:

Die Hypothese H 2 wird angenommen, obwohl H 1 wahr ist.

Fehler2:

Die Hypothese H 1 wird angenommen, obwohl H 2 wahr ist.

H 1 wird angenommen

{0,1,2,3}

H 2 wird angenommen

{4,5,6, ... ,98,99,100}

H 1 stimmt: p 0,01

☺

Fehler 1

H 2 stimmt: p 0,1

Fehler 2

☺

Wahrscheinlichkeit für Fehler 1 :

100

3

i 4

i 0

B(100; 0,01; i) 1 B(100; 0,01; i) 1 0,98163 1,84%

3

Wahrscheinlichkeit für Fehler 2 :

B(100; 0,1; i) 0,00784 0,78%

i 0