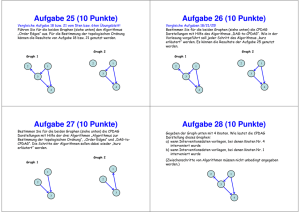

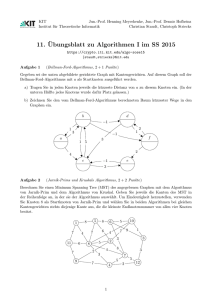

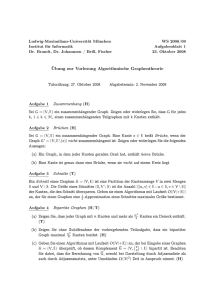

Algorithmen und Datenstrukturen

Werbung