Stochastik f¨ur InformatikerInnen - Institut für Informatik

Werbung

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

Stochastik für InformatikerInnen

Wintersemester 2009/10

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

Wolfgang Kössler

Humboldt-Universität zu Berlin, Institut für Informatik

7. Charakteristika

8. Exponential

10. Februar 2010

9. Normal

10.Transformation

1 / 895

Inhalt (1)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1

1. Grundbegriffe

2

2. Kombinatorik

3

3. Bedingte Wahrscheinlichkeit, Unabhängigkeit

4

4. Klassische Wahrscheinlichkeitsräume

5

5. Zufallsvariablen (allgemein)

1. Grundbegriffe

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

9. Normal

10.Transformation

2 / 895

Inhalt (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

6

6. Diskrete zufällige Variablen

7

7. Charakteristika von Verteilungsfunktionen

8

8. Die Exponentialverteilung

9

9. Die Normalverteilung

10

10. Transformation von Zufallsvariablen

1. Grundbegriffe

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

9. Normal

10.Transformation

3 / 895

Inhalt (3)

Stochastik für

InformatikerInnen

Wolfgang Kössler

11

11. Zufallsvektoren

12

12. Korrelation

13

13. Ungleichungen

14

14. Grenzwertsätze

15

15.Schätzmethoden

1. Grundbegriffe

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

9. Normal

10.Transformation

4 / 895

Inhalt (4)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

16

16. Grundlagen der Simulation

17

17. Markov’sche Ketten

18

18. Zusammenfassung

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

9. Normal

10.Transformation

5 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

1.1 Einleitung, Geschichte

1. Grundbegriffe

1.2 Zufällige Ereignisse

Einleitung

1.3 Ereignisfeld

Ereignisse

Ereignisfeld

1.4 Kolmogorov’sches Axiomensystem

Axiomensystem

Folgerungen

1.5 Folgerungen aus dem Kolmogorov-

Klass. Definition

2. Kombinatorik

Axiomensystem

3. Bedingte Wkt

1.6 Die klassische Definition der

4. Klass. Wkt.

Wahrscheinlichkeit

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

6 / 895

1. Grundbegriffe

Geschichte (1)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

antikes Griechenland

Begriff der Wkt.

Naturgesetze drücken sich durch eine Vielzahl

Ereignisfeld

Axiomensystem

von zufälligen Erscheinungen aus.

Folgerungen

Klass. Definition

2. Kombinatorik

1654, Chevalier de Mere, Pascal

Würfelspiele, Würfe mit 2 Würfeln. Wenn in 25

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

Würfen einmal eine Doppelsechs so hat C.d.M.

gewonnen, sonst sein Gegner.

6. Diskrete ZV

7. Charakteristika

7 / 895

Geschichte (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8 / 895

Geschichte (3)

Pascal, Fermat (Briefwechsel)

Stochastik für

InformatikerInnen

2 Personen-Spiele. Gespielt wird eine Serie von

Wolfgang Kössler

Partien, z.B. Schach (nur 0,1). Gewinnen soll der

1. Grundbegriffe

Spieler, der zuerst S Partien gewonnen hat, d.h.

Einleitung

Ereignisse

dieser Spieler erhält den vollen Einsatz.

Ereignisfeld

Axiomensystem

Abbruch des Spiels (z.B. wegen Zeitmangel)

Folgerungen

Klass. Definition

A hat a Gewinnpartien, a < S

2. Kombinatorik

B hat b Gewinnpartien, b < S

3. Bedingte Wkt

Wie ist der Einsatz gerecht zu verteilen?

4. Klass. Wkt.

Variante: ba , aber S wird nicht berücksichtigt!

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Es wäre also der weitere mögliche Verlauf nach dem

Abbruch zu analysieren.

9 / 895

Geschichte (4)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

1662, Graunt; 1693 Halley

Sterlichkeitstafeln (Überlebenswkt. in

Abhängigkeit vom Lebensalter) →

Einleitung

Ereignisse

Rentenberechnung, Schiffsversicherung

Ereignisfeld

Axiomensystem

1713, Jacob Bernoulli

Folgerungen

Klass. Definition

“Ars conjectandi”: 1. Lehrbuch der Wkt.rechnung

2. Kombinatorik

Bernoulli-Gesetz der Großen Zahlen, p = P(A)

3. Bedingte Wkt

hn (A) = n1 # Auftreten v. A, hn (A) − p →n→∞ 0

4. Klass. Wkt.

1733, Moivre

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Grenzwertsatz von Moivre-Laplace

√ X −µ

n · σ → N (0, 1)

10 / 895

Geschichte (5)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

11 / 895

Geschichte (6)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1812, Laplace

1. Grundbegriffe

klassische Definition der Wkt.

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

P(A) =

#für A günstigen Elem.ereignisse

#möglichen Elementarereignisse

Folgerungen

Klass. Definition

2. Kombinatorik

1800, Laplace, Gauss

Untersuchung von Beobachtungsfehlern

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

Kleinste Quadrat-Schätzung

Ende 19. Jh., Tschebyschev, Markov, Ljapunov

6. Diskrete ZV

7. Charakteristika

12 / 895

Geschichte (7)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

1900, David Hilbert

(2. Intern.Mathematikerkongress Paris)

23 Probleme der Mathematik,

u.a. Axiomatik der Wkt.rechnung.

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

13 / 895

Geschichte (8)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

1919 R.v. Mises

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

statistische Definition der Wkt,

Erfahrung: P(A) := limn→∞ hn (A)

Existiert der Grenzwert?

2. Kombinatorik

1933, A.N. Kolmogorov

3. Bedingte Wkt

Axiomsystem der Wkt.rechnung

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

14 / 895

Stochastik

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Statistik:

Gesamtheit aller Methoden zur Analyse

zufallsbehafteter Datenmengen

Einleitung

Ereignisse

→ Aussagen über die zugrundeliegende

Ereignisfeld

Axiomensystem

Grundgesamtheit treffen.

Folgerungen

Klass. Definition

Wahrscheinlichkeitsrechnung:

2. Kombinatorik

gegebene Grundgesamtheit (Verteilung)

3. Bedingte Wkt

→ Aussagen über Realisierungen einer

4. Klass. Wkt.

Zufallsvariablen treffen.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

———————————————

Stochastik: (grch.) im Rechnen geschickt.

15 / 895

Literatur

Stochastik für

InformatikerInnen

Wolfgang Kössler

Mathar, R. und Pfeiffer, D. (1990) Stochastik für

Informatiker, Stuttgart

1. Grundbegriffe

Einleitung

Pflug, G. (1986). Stochastische Modelle in der Informatik,

Ereignisse

Ereignisfeld

Stuttgart

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

Greiner, M. und Tinhofer, G. (1996) Stochastik für

Studienanfänger der Informatik, München

Rosanov, J.A. (1970). Wahrscheinlichkeitstheorie, Berlin

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Flachsmeyer, J. (1970). Kombinatorik, Berlin

Henze, N. (2004), Stochastik für Einsteiger, Wiesbaden

16 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

1.1 Einleitung, Geschichte

1. Grundbegriffe

1.2 Zufällige Ereignisse

Einleitung

1.3 Ereignisfeld

Ereignisse

Ereignisfeld

1.4 Kolmogorov’sches Axiomensystem

Axiomensystem

Folgerungen

1.5 Folgerungen aus dem Kolmogorov-

Klass. Definition

2. Kombinatorik

Axiomensystem

3. Bedingte Wkt

1.6 Die klassische Definition der

4. Klass. Wkt.

Wahrscheinlichkeit

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

17 / 895

1.2 Zufällige Ereignisse

Stochastik für

InformatikerInnen

Wolfgang Kössler

Def. 1 Ein zufälliger Versuch (Experiment)

ist ein Versuch mit ungewissem Ausgang.

1. Grundbegriffe

Einleitung

Beispiel: Glücksspiele.

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

Wichtig bei solchen Experimenten ist:

die Beschreibung des Experiments

3. Bedingte Wkt

4. Klass. Wkt.

(Kartenspiele, Münzwurf),

5. Zufallsvariablen

die Erfassung der Menge aller möglichen

6. Diskrete ZV

Ausgänge des Experiments.

7. Charakteristika

18 / 895

Zufällige Ereignisse (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Def. 2 (Grundbegriffe)

Elementarereignis: möglicher Versuchsausgang,

Bez.: ω, ω ∈ Ω.

Einleitung

Ereignisse

Ereignis: Menge von El.ereignissen, A ⊂ Ω

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

sicheres Ereignis: Menge aller El.ereignisse: Ω.

unmögiches Ereignis: ∅.

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

Komplementärereignis: A = Ω \ A

Ein Experiment kann diskret sein, d.h. endlich oder

abzählbar viele Ausgänge besitzen, oder es kann

6. Diskrete ZV

7. Charakteristika

überabzählbar viele Ausgänge haben.

19 / 895

Zufällige Ereignisse (3)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Experimente mit einer endlichen

Anzahl von Elementarereignissen

Münzwurf

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

zwei Elementarereignisse: {Zahl (z)},

{Wappen (w)};

Folgerungen

Klass. Definition

2. Kombinatorik

das unmögliche Ereignis ∅ = {z} ∩ {w};

das sichere Ereignis Ω := {z, w}.

3. Bedingte Wkt

4. Klass. Wkt.

Die Menge der auftretenden Ereignisse ist

5. Zufallsvariablen

P(Ω) := {∅, {z}, {w}, Ω},

6. Diskrete ZV

die Potenzmenge von Ω.

7. Charakteristika

20 / 895

Zufällige Ereignisse (4)

Stochastik für

InformatikerInnen

Würfeln (1 mal)

Wolfgang Kössler

1. Grundbegriffe

Elementarereignisse:

Einleitung

Ereignisse

{1}, {2}, {3}, {4}, {5}, {6},

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

d.h. Ω = {1, 2, 3, 4, 5, 6}.

Damit erhalten wir für

2. Kombinatorik

paarweise verschiedene

3. Bedingte Wkt

i, j, k, l, m ∈

4. Klass. Wkt.

{1, 2, 3, 4, 5, 6} die

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

möglichen Ereignisse :

Ereignistyp

Anzahl

∅

1

{i}

6

{i, j}

15

{i, j, k}

20

{i, j, k, l}

15

{i, j, k , l, m}

6

Ω

1

insgesamt 26 = 64

21 / 895

Zufällige Ereignisse (5)

Stochastik für

InformatikerInnen

Experimente mit abzählbar

Wolfgang Kössler

vielen Elementarereignissen

1. Grundbegriffe

1

Einleitung

Ereignisse

Werfen einer Münze, bis zum ersten Mal die

Zahl fällt

Ereignisfeld

Axiomensystem

Folgerungen

Ω = {z, wz, wwz, wwz, wwwz, . . .}.

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

Anzahl der ankommenden Fahrzeuge an einer

4. Klass. Wkt.

Kreuzung in einem bestimmten Zeitbereich

2

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Ω = {0, 1, 2, . . .}.

22 / 895

Zufällige Ereignisse (6)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Experimente mit überabzählbar

vielen Elementarereignissen

Lebensdauer einer Glühbirne

Einleitung

Ereignisse

Ereignisfeld

Ω = [0, ∞[ = R+ .

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

Ereignisse sind bei diesem Experiment

z.B. Intervalle und Punkte.

Es gilt beispielsweise: ∅ = [0, 1] ∩ [3, 5] .

4. Klass. Wkt.

5. Zufallsvariablen

Das Ereignis A = {[0.4, 3.1], {7}} bedeutet, daß

6. Diskrete ZV

die Glühbirne eine Lebensdauer von 7s oder

7. Charakteristika

eine Lebensdauer zwischen 0.4s und 3.1s hat.23 / 895

Zufällige Ereignisse (7)

Stochastik für

InformatikerInnen

Wolfgang Kössler

überabzählbar viele Elementarereignisse

Messung einer physikalischen Konstante

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

y = |{z}

ε .

m + |{z}

|{z}

Meßwert

Konstante

Meßfehler

Axiomensystem

Folgerungen

Die Meßfehler sind die Elementarereignisse.

Klass. Definition

2. Kombinatorik

Ereignisse sind beispielsweise Intervalle.

3. Bedingte Wkt

Experimente, deren Ausgänge Funktionen der

4. Klass. Wkt.

Zeit sind, Ω = Ω0 × T . Ereignisse im Experiment

5. Zufallsvariablen

sind dann bestimmte Funktionsverläufe =⇒

6. Diskrete ZV

7. Charakteristika

stochastische Prozesse.

24 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

1.1 Einleitung, Geschichte

1. Grundbegriffe

1.2 Zufällige Ereignisse

Einleitung

1.3 Ereignisfeld

Ereignisse

Ereignisfeld

1.4 Kolmogorov’sches Axiomensystem

Axiomensystem

Folgerungen

1.5 Folgerungen aus dem Kolmogorov-

Klass. Definition

2. Kombinatorik

Axiomensystem

3. Bedingte Wkt

1.6 Die klassische Definition der

4. Klass. Wkt.

Wahrscheinlichkeit

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

25 / 895

1.3 Ereignisfeld

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

Ein Ereignisfeld E ist (grob) ein System von

Teilmengen der Menge Ω. Es gilt: E ⊆ P(Ω).

Def. 3 (∪, ∩, Komplement)

Es seien A1 ∈ E und A2 ∈ E Ereignisse. Dann

A3 := A1 ∩ A2 = {ω ∈ Ω : ω ∈ A1 und ω ∈ A2 } das

Ereignis, bei dem A1 und A2 eintreten;

3. Bedingte Wkt

A3 := A1 ∪ A2 = {ω ∈ Ω : ω ∈ A1 oder ω ∈ A2 }

4. Klass. Wkt.

das Ereignis, bei dem A1 oder A2 eintreten;

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

A1 = Ω \ A1 = {ω ∈ Ω : ω ∈

/ A1 } das zu A1

komplementäre Ereignis.

26 / 895

Ereignisfeld (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Es gilt offenbar:

Ereignisfeld

Axiomensystem

A ∪ A = Ω (sicheres Ereignis),

Folgerungen

Klass. Definition

A ∩ A = ∅ (unmögliches Ereignis).

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

27 / 895

Ereignisfeld (3)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Satz (Rechenregeln für Ereignisse)

(i) A ∪ B = B ∪ A (Kommutativgesetz)

(ii)

(A ∪ B) ∪ C = A ∪ (B ∪ C)

Einleitung

(Assoziativgesetz)

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

(iii)

A ∩ (B ∪ C) = (A ∩ B) ∪ (A ∩ C)

(iv)

A ∪ (B ∩ C) = (A ∪ B) ∩ (A ∪ C)

2. Kombinatorik

(Distributivgesetze)

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

(v)

(De’Morgansche Regeln)

(A ∪ B) = A ∩ B

(A ∩ B) = A ∪ B

28 / 895

Ereignisfeld (4)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

Def. 4

Seien A1 , . . . , An , . . . Ereignisse. Die Vereinigung

S∞

i=1 Ai ist das Ereignis, das eintritt, wenn

mindestens eines Ereignisse A1 , A2 , A3 , . . . eintritt.

T

Der Durchschnitt ∞

i=1 Ai ist das Ereignis, das eintritt,

wenn alle Ereignisse A1 , A2 , A3 , . . . eintreten.

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

29 / 895

Ereignisfeld (5)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Verallgemeinerungen der Rechenregeln

Seien A, A1 , . . . Ereignisse.

S

S∞

(iii) A ∩ ( ∞

i=1 Ai ) =

i=1 (A ∩ Ai )

T∞

T∞

(iv) A ∪ ( i=1 Ai ) = i=1 (A ∪ Ai )

Axiomensystem

Folgerungen

(v)

Klass. Definition

2. Kombinatorik

∞

[

3. Bedingte Wkt

Ai =

i=1

4. Klass. Wkt.

5. Zufallsvariablen

∞

\

6. Diskrete ZV

i=1

7. Charakteristika

∞

\

Ai

i=1

Ai =

∞

[

Ai

i=1

30 / 895

Ereignisfeld (6)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Def. 5

E ⊆ P(Ω) heißt Ereignisfeld über Ω

1. Grundbegriffe

Einleitung

falls folgendes gilt:

Ereignisse

Ereignisfeld

1

Ω ∈ E;

2

Gilt Ai ∈ E für i ∈ N, dann folgt

Axiomensystem

Folgerungen

Klass. Definition

3

4. Klass. Wkt.

Ai ∈ E;

i=1

2. Kombinatorik

3. Bedingte Wkt

∞

T

A ∈ E =⇒ A ∈ E.

E heißt auch σ–Algebra über Ω.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

31 / 895

Ereignisfeld (7)

Grundlegende Eigenschaften

Stochastik für

Elementarereignisse schließen sich gegenseitig

InformatikerInnen

Wolfgang Kössler

aus.

1. Grundbegriffe

Es tritt immer nur genau ein Elementarereignis

Einleitung

ein.

Ereignisse

Ereignisfeld

Ein Ereignis tritt genau dann ein, wenn eines

Axiomensystem

Folgerungen

seiner Elementarereignisse eintritt.

Klass. Definition

2. Kombinatorik

Folgerung

3. Bedingte Wkt

4. Klass. Wkt.

1

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Ist Ai ∈ E

∀i ∈ N, so folgt:

∞

S

Ai ∈ E.

i=1

2

Für das unmögliche Ereignis gilt: ∅ ∈ E.

32 / 895

Ereignisfeld (8)

Beweis der Folgerung

Stochastik für

InformatikerInnen

1

Wolfgang Kössler

Ai ∈ E, ∀i ∈ N =⇒ Ai ∈ E, ∀i ∈ N (Def. 5.3)

∞

\

=⇒

Ai ∈ E (Def. 5.2)

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

i=1

Axiomensystem

∞

[

Folgerungen

=⇒

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

=⇒

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

i=1

∞

[

Ai ∈ E (de Morgan)

Ai ∈ E (Def. 5.3)

i=1

2

Nach Def. 5.1 gilt: Ω ∈ E. Wegen ∅ = Ω und Def.

5.3 folgt dann: ∅ ∈ E.

33 / 895

Ereignisfeld (9)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Def. 6 Zwei Ereignisse A1 , A2 ∈ E heißen

unvereinbar (disjunkt), falls A1 ∩ A2 = ∅ gilt. Wir

sagen dann auch, diese beiden Ereignisse schließen

Klass. Definition

2. Kombinatorik

einander aus.

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

34 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

1.1 Einleitung, Geschichte

1. Grundbegriffe

1.2 Zufällige Ereignisse

Einleitung

1.3 Ereignisfeld

Ereignisse

Ereignisfeld

1.4 Kolmogorov’sches Axiomensystem

Axiomensystem

Folgerungen

1.5 Folgerungen aus dem Kolmogorov-

Klass. Definition

2. Kombinatorik

Axiomensystem

3. Bedingte Wkt

1.6 Die klassische Definition der

4. Klass. Wkt.

Wahrscheinlichkeit

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

35 / 895

1.4 Kolmogorov- Axiomensystem

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Def. 7 (Wahrscheinlichkeit) Sei E ein Ereignisfeld.

Eine Abbildung P : E −→ R heißt Wahrscheinlichkeit,

falls sie die folgenden Eigenschaften hat:

Einleitung

Ereignisse

1

Für alle A ∈ E gilt: 0 ≤ P(A) ≤ 1;

2

P(Ω) = 1;

3

2. Kombinatorik

Sind die Ereignisse A1 , A2 , . . . paarweise

3. Bedingte Wkt

unvereinbar (d.h. Ai ∩ Aj = ∅ für i 6= j, i, j ∈ N),

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

so gilt die sogenannte σ–Additivitätseigenschaft:

!

∞

∞

[

X

P

Ai =

P(Ai ).

i=1

i=1

36 / 895

Kolmogorov’sches Axiomensystem (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Def. 8 (Wahrscheinlichkeitsraum)

Sei Ω die Menge der Elementarereignisse, E ein

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

Ereignisfeld über Ω (E ⊆ P(Ω)) und P genüge den

KOLMOGOROV–Axiomen, dann heißt das Tripel

(Ω, E, P) Wahrscheinlichkeitsraum.

2. Kombinatorik

3. Bedingte Wkt

Mittels dieses Begriffes ist eine vollständige

4. Klass. Wkt.

Beschreibung eines zufälligen Experimentes

5. Zufallsvariablen

möglich.

6. Diskrete ZV

7. Charakteristika

37 / 895

Kolmogorov’sches Axiomensystem (3)

Stochastik für

InformatikerInnen

Wir betrachten nun A ⊆ P(Ω), ein System von

Wolfgang Kössler

Teilmengen der Menge Ω. Dann können wir die

1. Grundbegriffe

folgende Menge bilden:

Einleitung

Ereignisse

Ereignisfeld

E(A) = {E : A ⊆ E, E ist Ereignisfeld} .

Axiomensystem

Folgerungen

Klass. Definition

Dann ist die Menge

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

EA =

\

E

E∈E(A)

5. Zufallsvariablen

die von A erzeugte σ–Algebra (Ereignisfeld) bzw. die

6. Diskrete ZV

kleinste σ–Algebra über Ω, die A enthält.

7. Charakteristika

38 / 895

Kolmogorov’sches Axiomensystem (4)

Beispiele für Wahrscheinlichkeitsräume (Ω, E, P)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

Klassische Wahrscheinlichkeitsräume

Ω = {ω1 , . . . , ωN }, E = P(Ω).

P(ω) = P({ωi }) =

1

N

∀i = 1, . . . , N. D.h. alle

Elementarereignisse sind gleichwahrscheinlich.

Def. 9(klassische Def. der Wkt.) Sei A ∈ E.

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

P(A) =

#{ω, ω ∈ A}

#für A günstigen El. ereign.

=

N

#möglichen El.ereignisse

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

39 / 895

Kolmogorov’sches Axiomensystem (5)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Borel-Mengen

Es sei Ω = R und

Einleitung

Ereignisse

Ereignisfeld

A = {[a, b[ : − ∞ < a < b < ∞} ⊆ P(Ω).

Axiomensystem

Folgerungen

Klass. Definition

die Menge der halboffenen Intervalle. Dann ist

2. Kombinatorik

B 1 := EA die σ-Algebra der B OREL–Mengen.

3. Bedingte Wkt

(R, B 1 , P) ist dann ein Wahrscheinlichkeitsraum mit

4. Klass. Wkt.

5. Zufallsvariablen

irgendeiner Wahrscheinlichkeit P.

6. Diskrete ZV

7. Charakteristika

40 / 895

Kolmogorov’sches Axiomensystem (6)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Es sei Ω = [0, 1]. Weiterhin betrachten wir:

E = {A : A = B ∩ [0, 1], B ∈ B 1 }.

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

die Menge der Borelmengen auf dem Intervall [0, 1].

R

P : A −→ R mit P(A) := dx.

A

Folgerungen

Klass. Definition

3. Bedingte Wkt

4. Klass. Wkt.

P(Ω) =

P 12 , 34

=

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

1

Z

2. Kombinatorik

P

1 2

dx = 1

0

1

4

1

2

Z

dx = 0

=

1

2

41 / 895

Kolmogorov’sches Axiomensystem (7)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Q : A −→ R mit Q(A) :=

R

A

3

(1

2

− x 2 )dx

1. Grundbegriffe

Einleitung

Z

Ereignisse

Ereignisfeld

Q(Ω) =

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

=

1

3

(1 − x 2 )dx

0 2

1

3

x 3 x−

2

3 0

= 1

(Ω, E, P) und (Ω, E, Q) sind

Wahrscheinlichkeitsräume.

6. Diskrete ZV

7. Charakteristika

42 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

1.1 Einleitung, Geschichte

1. Grundbegriffe

1.2 Zufällige Ereignisse

Einleitung

1.3 Ereignisfeld

Ereignisse

Ereignisfeld

1.4 Kolmogorov’sches Axiomensystem

Axiomensystem

Folgerungen

1.5 Folgerungen aus dem Kolmogorov-

Klass. Definition

2. Kombinatorik

Axiomensystem

3. Bedingte Wkt

1.6 Die klassische Definition der

4. Klass. Wkt.

Wahrscheinlichkeit

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

43 / 895

1.5 Folgerungen aus dem

Kolmogorov- Axiomensystem

Stochastik für

InformatikerInnen

Wolfgang Kössler

Sei (Ω, E, P) W.-raum und A, B, A1 , . . . , An Ereignisse.

1

P(A) = 1 − P(A).

2

P(∅) = 0.

3

Sei A ⊆ B. Dann gilt:

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

1

B \ A ∈ E;

2. Kombinatorik

2

P(B \ A) = P(B) − P(A) (Subtraktivität);

3. Bedingte Wkt

3

P(A) ≤ P(B) (Monotonie der Wkt).

Klass. Definition

4. Klass. Wkt.

5. Zufallsvariablen

4

P(A ∪ B) = P(A) + P(B) − P(A ∩ B),

P(A ∪ B) ≤ P(A) + P(B).

6. Diskrete ZV

7. Charakteristika

Sind A und B unvereinbar, so gilt die Gleichheit.

44 / 895

Folgerungen (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Es sei {An : n ∈ N} eine Folge von Ereignissen

5

1. Grundbegriffe

Einleitung

Ereignisse

Es sei An ⊆ An+1 , ∀n ∈ N. Dann gilt:

P lim An = lim P(An ).

n→∞

Ereignisfeld

n→∞

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

6

Stetigkeit (des Wkts.maßes) von unten“

”

Es sei An ⊇ An+1 , ∀n ∈ N. Dann gilt:

P lim An = lim P(An ).

n→∞

n→∞

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Stetigkeit (des Wkts.maßes) von oben“

”

45 / 895

Beweis Folgerungen 1 und 2

Stochastik für

InformatikerInnen

Wolfgang Kössler

1

Es gilt: Ω = A ∪ (Ω \ A) = A ∪ A, für alle A ∈ E.

Wegen A ∩ A = ∅ folgt:

1. Grundbegriffe

Einleitung

1 = P(Ω) = P(A ∪ A)

Ereignisse

Ereignisfeld

Axiomensystem

= P(A) + P(A)

Folgerungen

Klass. Definition

Wir stellen um und erhalten: P(A) = 1 − P(A).

2. Kombinatorik

3. Bedingte Wkt

2

Wegen ∅ = Ω \ Ω = Ω folgt aus Aussage 1:

4. Klass. Wkt.

5. Zufallsvariablen

P(∅) = 1 − P(Ω) = 0.

6. Diskrete ZV

7. Charakteristika

46 / 895

Beweis Folgerungen 3

Stochastik für

InformatikerInnen

Wolfgang Kössler

3

Es seien A, B ∈ E zwei Ereignisse mit A ⊆ B.

1

Es gilt:

B \ A = B ∩ A.

1. Grundbegriffe

Einleitung

Wegen B ∈ E und A ∈ E folgt nach Def. 5.(2.),

Ereignisse

Ereignisfeld

dass auch die Menge B \ A ∈ E ist.

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

2

Aus B = A ∪ (B \ A) und A ∩ (B \ A) = ∅ folgt:

P(B) = P(A ∪ (B \ A))

= P(A) + P(B \ A)

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Wir stellen um und erhalten:

P(B) − P(A) = P(B \ A).

47 / 895

Beweis Folgerungen 4.-6.

Stochastik für

InformatikerInnen

4

Wenn wir die Subtraktivitätsgleichung etwas

Wolfgang Kössler

umstellen, erhalten wir:

1. Grundbegriffe

Einleitung

P(B) = P(A) + P(B \ A).

Ereignisse

Ereignisfeld

Axiomensystem

Wegen Definition 7.(1.) folgt daraus sofort:

Folgerungen

Klass. Definition

P(A) ≤ P(B).

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5

Es sei nun {An : n ∈ N} eine Folge von

5. Zufallsvariablen

Ereignissen mit An ⊆ An+1 , ∀n ∈ N.

6. Diskrete ZV

Nach Definition der Ereignisfolge (An ) gilt:

7. Charakteristika

48 / 895

Beweis Folgerung 5 (1)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

lim An =

n→∞

∞

[

Ak .

k =1

Wir definieren:

B1 := A1

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

B2 := A2 \ A1

..

.

Bn := An \ An−1

usw.

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Offenbar gilt für alle i, j ∈ N mit i 6= j:

∞

∞

[

[

Bi ∩ Bj = ∅

Ak =

Bk .

k =1

k =1

49 / 895

Beweis Folgerung 5 (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

P

1. Grundbegriffe

lim An

n→∞

= P

Einleitung

Ereignisse

∞

[

=

Ereignisfeld

Ak

3. Bedingte Wkt

4. Klass. Wkt.

k =1

= P(A1 ) +

6. Diskrete ZV

7. Charakteristika

∞

X

P(Ak \ Ak −1 )

= P(A1 ) + lim

n→∞

=

=

Bk

k =1

k =2

5. Zufallsvariablen

!

P(Bk ) (Definition 7.(3.))

Klass. Definition

2. Kombinatorik

=P

∞ k =1

X

Axiomensystem

Folgerungen

∞

[

!

lim

n→∞

n

X

k =2

n

X

P(A1 ) +

lim P(An ).

P(Ak \ Ak −1 )

!

(P(Ak ) − P(Ak −1 ))

k =2

n→∞

50 / 895

Beweis Folgerung 6 (1)

Stochastik für

InformatikerInnen

6

Es sei nun {An : n ∈ N} eine Folge von

Wolfgang Kössler

Ereignissen mit der Eigenschaft An ⊇ An+1 ,

1. Grundbegriffe

∀n ∈ N.

Einleitung

Ereignisse

Dann gilt:

Ereignisfeld

Axiomensystem

Folgerungen

lim An =

n→∞

Unter Anwendung der

3. Bedingte Wkt

Regeln erhalten wir:

DE

4. Klass. Wkt.

5. Zufallsvariablen

lim An =

n→∞

6. Diskrete ZV

7. Charakteristika

Ak .

k =1

Klass. Definition

2. Kombinatorik

∞

\

M ORGAN’schen

∞

[

Ak .

k =1

Außerdem gilt: Ak ⊆ Ak +1 . Dann

51 / 895

Beweis Folgerung 6 (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

P

lim An

n→∞

∞

[

= P

!

Ak

k =1

Einleitung

∞

[

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

= 1−P

!

Ak

(Aussage 1)

k =1

= 1 − P lim An

n→∞

= 1 − lim P(An ) (Aussage 4)

n→∞

4. Klass. Wkt.

= 1 − lim (1 − P(An ))

n→∞

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

=

lim P(An ).

n→∞

52 / 895

Folgerungen (Fortsetz.)

Subadditivität von P

Stochastik für

InformatikerInnen

Seien A1 , A2 , . . . Ereignisse. Dann gilt:

Wolfgang Kössler

P(

1. Grundbegriffe

Ai ) ≤

∞

X

i=1

Einleitung

Ereignisse

∞

[

Beweis:

[

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

B1 := A1

B2 := A2 \ A1

B3 := A3 \ (A1 ∪ A2 )

... [

Bi := Ai \ ( Aj ) ...

j<i

Bi paarw. disjunkt, Bi ⊆ Ai .

P(Ai )

i=1

P(

Bi

=

i≥1

∞

[

[

Ai ⇒

i≥1

Ai ) = P(

i=1

∞

[

Bi )

i=1

=

≤

∞

X

i=1

∞

X

P(Bi ) (3.Ax.)

P(Ai ) (Mon.)

i=1

53 / 895

Folgerungen (8)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Siebformel, Prinzip von Inklusion und Exklusion

Seien A1 , . . . , An Ereignisse. Dann gilt:

1. Grundbegriffe

Einleitung

P(

n

[

\

(−1)|I|−1 P( Ai )

X

Ai ) =

Ereignisse

Ereignisfeld

I⊆{1,...,n},I6=∅

i=1

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

=

n

X

i∈I

P(Ai ) −

i=1

(−1)n+1

X

P(Ai ∩ Aj ) + −...

i<j

X

i1 <i2 <···<in

P(

n

\

Aiν )

ν=1

5. Zufallsvariablen

6. Diskrete ZV

auch: Formel von Poincare-Sylvester

7. Charakteristika

(Montmort: Briefwechsel mit Bernoulli)

54 / 895

Siebformel

Beweis: (Induktion nach n)

Stochastik für

1

InformatikerInnen

Wolfgang Kössler

IA n = 1 trivial, (n = 2 : Subtraktivität)

P(A1 ∪ A2 ) = P(A1 ) + P(A2 ) − P(A1 ∩ A2 )

2

X

X

=

P(Ai ) −

P(Ai ∩ Aj )

1. Grundbegriffe

Einleitung

Ereignisse

i=1

Ereignisfeld

Axiomensystem

=

Folgerungen

Klass. Definition

I={1,2}

X

\

(−1)|I|−1 P( Ai )

I⊆{1,...,n},I6=∅

i∈I

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

2

IS: Aussage der Folgerung gelte für n. Dann

n+1

[

P(

i=1

Ai ) = P(

n

[

Ai ) + P(An+1 ) − P(

i=1

n

[

(Ai ∩ An+1 ))

i=1

wegen Subtraktivität.

55 / 895

Siebformel

Beweis (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Auf den ersten und dritten Summanden wird jeweils

1. Grundbegriffe

die IV angewendet. Der dritte Summand ist gleich

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

− P(

n

[

(Ai ∩ An+1 ))

i=1

=−

\

(−1)|J|−1 P( (Ai ∩ An+1 ))

X

2. Kombinatorik

J⊆{1,...,n},J6=∅

3. Bedingte Wkt

4. Klass. Wkt.

=

i∈J

X

{n+1}⊆J⊆{1,...,n+1},J6={n+1}

\

(−1)|J|−1 P( Ai ).

i∈J

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

56 / 895

Siebformel

Beweis (3)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Untersuchung der Indexmengen:

1. Summe: alle nichtleeren Teilmengen von

{1, . . . , n}

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

3. Summe: alle nicht-1-Element. Teilmengen von

{1, . . . , n + 1}, die das Element n + 1 enthalten

Klass. Definition

2. Kombinatorik

2. Summe: das Element n + 1.

3. Bedingte Wkt

Damit tauchen alle nichtleeren Teilmengen von

4. Klass. Wkt.

{1, . . . , n + 1} in einer der Summanden auf.

5. Zufallsvariablen

Alle Summanden haben die gleiche Form, wie in der

6. Diskrete ZV

Siebformel.

7. Charakteristika

57 / 895

Beispiele zur Siebformel (1)

Stochastik für

InformatikerInnen

Rencontre-Problem

Wolfgang Kössler

n Studenten sollen schriftlich von einer Änderung

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

des Vorlesungstermins benachrichtigt werden. Im

irrtümlichen Glauben, daß jeder der n Briefe den

gleichen Inhalt aufweist, verteilt eine Sekretärin die

Briefe willkürlich in die verschiedenen Umschläge.

Wie groß ist die Wahrscheinlichkeit, daß mindestens

ein Brief in den richtigen Umschlag gelangt?

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Welchen Wert erhält man für n → ∞?

Lösung: Übung.

58 / 895

Beispiele zur Siebformel (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Sortierprobleme

geg.: Feld der Länge n

Daten zufällig angeordnet, gleichverteilt mit Wkt.

Ereignisse

Ereignisfeld

1

.

n!

Wie groß ist die Wahrscheinlichkeit, daß mindestens

Axiomensystem

Folgerungen

Klass. Definition

ein Feldelement schon an der richtigen Stelle liegt.?

Welchen Wert erhält man für n → ∞?

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

das ist dasselbe wie beim Rencontre-Problem.

Wie groß ist die Wkt., daß genau k Elemente bereits

am richtigen Platz stehen? → Übung

6. Diskrete ZV

7. Charakteristika

59 / 895

Folgerungen aus der Siebformel

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Bonferroni-Ungleichungen (1)

Die Ungleichung

Einleitung

Ereignisse

Ereignisfeld

P(A ∪ B) ≤ P(A) + P(B)

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

heißt Bonferroni-Ungleichung.

Weitere (Bonferroni)- Ungleichungen erhält man

durch Abbruch der Siebformel nach Gliedern mit

4. Klass. Wkt.

5. Zufallsvariablen

positivem (≤) bzw. negativem (≥) Vorzeichen.

6. Diskrete ZV

7. Charakteristika

60 / 895

Folgerungen aus der Siebformel

Stochastik für

InformatikerInnen

Bonferroni-Ungleichungen (2)

Wolfgang Kössler

1. Grundbegriffe

P(A ∪ B ∪ C) ≤ P(A) + P(B) + P(C)

(n = 1)

P(A ∪ B ∪ C) ≥ P(A) + P(B) + P(C)

(n = 2)

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

−P(A ∩ B) − P(A ∩ C) − P(B ∩ C)

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

4. Klass. Wkt.

P(A ∪ B ∪ C) ≤ P(A) + P(B) + P(C)

−P(A ∩ B) − P(A ∩ C) − P(B ∩ C)

+P(A ∩ B ∩ C)

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

(n=3, es gilt hier sogar Gleichheit)

61 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

1.1 Einleitung, Geschichte

1. Grundbegriffe

1.2 Zufällige Ereignisse

Einleitung

1.3 Ereignisfeld

Ereignisse

Ereignisfeld

1.4 Kolmogorov’sches Axiomensystem

Axiomensystem

Folgerungen

1.5 Folgerungen aus dem Kolmogorov-

Klass. Definition

2. Kombinatorik

Axiomensystem

3. Bedingte Wkt

1.6 Die klassische Definition der

4. Klass. Wkt.

Wahrscheinlichkeit

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

62 / 895

1.6 Die klassische Definition der

Wahrscheinlichkeit

Stochastik für

InformatikerInnen

Wolfgang Kössler

Wir betrachten für ein zufälliges Experiment die

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Menge der Elementarereignisse Ω = {ω1 , . . . , ωN }.

Sei E = P(Ω) und P({ωi }) =

1

, ∀i

N

= 1, . . . , N).

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

3. Bedingte Wkt

#{ω : ω ∈ A}

= n(A)

N

N

# der für A günstigen Elem.Ereignisse

=

# der möglichen Elementarereignisse

P(A) =

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

63 / 895

D E M ÉR É (1)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Würfeln mit 3 Würfeln

Folgende Ereignisse werden betrachtet:

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

A = Es fallen 11 Augen.

B = Es fallen 12 Augen.

Axiomensystem

Folgerungen

Klass. Definition

2. Kombinatorik

Frage: P(A), P(B)?

Die Menge der Elementarereignisse ist

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Ω = {(i, j, k) : 1 ≤ i, j, k ≤ 6}.

Anzahl der Elementarereignisse N := 63 = 216,

P((i, j, k)) =

1

.

216

64 / 895

D E M ÉR É (2)

Anzahl der Ereignisse

Stochastik für

A (11 Augen)

B (12 Augen)

6-4-1

6

6-5-1

6

6-3-2

6

6-4-2

6

5-5-1

3

6-3-3

3

5-4-2

6

5-5-2

3

2. Kombinatorik

5-3-3

3

5-4-3

6

3. Bedingte Wkt

4-4-3

3

4-4-4

1

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Einleitung

Ereignisse

Ereignisfeld

Axiomensystem

Folgerungen

Klass. Definition

4. Klass. Wkt.

n(A)=27

n(B)=25

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

P(A) =

27

25

>

= P(B).

216

216

65 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

2.1 Klassische kombinatorische Probleme

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

2.2 Beispiele

2.3 Arithmetische Beziehungen zwischen den

Beispiele

Binomialkoeffizienten

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

2.4 Die Stirling Formel

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

66 / 895

2.1 Klassische kombinatorische

Probleme, Aufgabenstellung

Stochastik für

InformatikerInnen

Anzahl der verschiedenen Zusammenstellungen von

Wolfgang Kössler

Objekten. Je nach Art der zusätzlichen Forderungen,

1. Grundbegriffe

ist zu unterscheiden, welche Zusammenstellungen

2. Kombinatorik

als gleich, und welche als verschieden angesehen

Problemstellungen

Beispiele

werden.

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

Permutation (ohne Wiederholung)

Permutation mit Wiederholung

Variation ohne Wiederholung

5. Zufallsvariablen

6. Diskrete ZV

Variation mit Wiederholung

7. Charakteristika

Kombination (ohne Wiederholung)

8. Exponential

Kombination mit Wiederholung

67 / 895

Klassische kombinatorische Probleme

(1)

Wolfgang Kössler

Permutation (ohne Wiederholung)

Jede eineindeutige Abbildung Π der geordenten

1. Grundbegriffe

Menge {1, . . . , n} auf eine n-elementige Menge

2. Kombinatorik

M = {s1 , . . . , sn } heißt Permutation oder Permutation

Stochastik für

InformatikerInnen

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

ohne Wiederholung,

∀i ∈ {1, . . . , n} : Π(i) = si , si ∈ M, si 6= sj (i 6= j)

Anzahl:

N = n!

4. Klass. Wkt.

5. Zufallsvariablen

Wiewiel Möglichkeiten gibt es, die Eisenbahnwagen

6. Diskrete ZV

32,33,34,35,36,37 hintereinander zu hängen?

7. Charakteristika

8. Exponential

N = 6!

68 / 895

Klassische kombinatorische Probleme

(2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

Permutation mit Wiederholung

Sei M = {s1 , . . . , sk }, ki > 0 ∀i = 1, . . . , k mit

Pk

i=1 ki = n. Jedes geordnete n-Tupel von

Elementen aus M, wobei jedes Element si genau ki

Problemstellungen

Beispiele

mal vorkommt, heißt Permutation mit Wiederholung.

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

N=

Anzahl:

n!

k1 !···kk !

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

Wiewiel Möglichkeiten gibt es, die Karten beim

Skatspiel zu vergeben?

N=

32!

10!10!10!2!

69 / 895

Klassische kombinatorische Probleme

(3)

Stochastik für

InformatikerInnen

Variation ohne Wiederholung

Wolfgang Kössler

Sei M = {s1 , . . . , sn }. Jedes geordnete k-Tupel,

1. Grundbegriffe

k ≤ n von verschiedenen Elementen aus M heißt

2. Kombinatorik

Variation ohne Wiederholung.

Problemstellungen

Beispiele

Binomialkoeffizienten

Anzahl:

N = n(n − 1) · · · (n − k + 1)

Stirling-Formel

3. Bedingte Wkt

Aufteilung von k Elementen auf n Fächer.

4. Klass. Wkt.

5. Zufallsvariablen

Wieviele Möglichkeiten für die drei Erstplazierten im

6. Diskrete ZV

100m Endlauf gibt es?

7. Charakteristika

8. Exponential

N = 8 · 7 · 6 = 336.

70 / 895

Klassische kombinatorische Probleme

(4)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Variation mit Wiederholung

Auswahl von k Elementen aus einer Menge

1. Grundbegriffe

M = {s1 , . . . , sn } mit Zurücklegen. Die Frage ist:

2. Kombinatorik

Wieviel verschiedene Möglichkeiten gibt es, k

Problemstellungen

Beispiele

Elemente aus dieser Menge zu entnehmen, wobei

Binomialkoeffizienten

Stirling-Formel

Elemente mehrfach entnommen werden können?

3. Bedingte Wkt

4. Klass. Wkt.

N = nk .

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

Anzahl der 10stelligen Dualzahlen:

N = 210 .

71 / 895

Klassische kombinatorische Probleme

(5)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Kombinationen (ohne Wiederholung)

Jede k-elementige Teilmenge aus einer

n-elementigen Menge M heißt Kombination (ohne

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

Wiederholung) (von k aus n Elementen). Dabei sind

Wiederholungen nicht erlaubt und die Reihenfolge

der k Elemente wird nicht berücksichtigt.

3. Bedingte Wkt

4. Klass. Wkt.

N=

n·(n−1)·...·(n−k +1)

k!

=

n

k

=

n!

.

(n−k )!k!

5. Zufallsvariablen

6. Diskrete ZV

Anzahl der 5er im Lotto: ÜA

7. Charakteristika

8. Exponential

72 / 895

Klassische kombinatorische Probleme

(6)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Kombination (mit Wiederholung)

Faßt man alle Variationen mit Wiederholung (n

1. Grundbegriffe

Elemente, Ordnung k) zu Äquivalenzklassen

2. Kombinatorik

zusammen, so daß sie aus aus den gleichen

Problemstellungen

Beispiele

Elementen der gleichen Anzahl bestehen, so heißt

Binomialkoeffizienten

Stirling-Formel

jede solche Klasse Kombination mit Wiederholung.

3. Bedingte Wkt

4. Klass. Wkt.

N=

n+k−1

k

5. Zufallsvariablen

7. Charakteristika

n = 2, k = 3: 4 Klassen:

{aaa}, {aab, aba, baa}, {abb, bab, bba}, {bbb}

8. Exponential

werden jeweils zu einer Klasse zusammengefaßt.

6. Diskrete ZV

73 / 895

Klassische kombinatorische Probleme

(6a)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

Erläuterung zur Kombination mit Wiederholung:

siehe Beispiele 4, 5 und 6.

(Dieses Problem wird auf den Fall unterscheidbarer

Würfel zurückgeführt.)

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

74 / 895

Klassische kombinatorische Probleme

(7)

Stochastik für

InformatikerInnen

Kombination von Elementen aus mehreren Mengen

Wolfgang Kössler

Wir betrachten beliebige Mengen S1 , . . . , Sk , wobei

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

Si = {si1 , . . . , sini } (i = 1, . . . , k) gilt.

Wieviel verschiedene Kombinationen von je einem

Element der Mengen S1 , . . . , Sk können gebildet

werden?

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

Solche Kombinationen haben die Form

(s1i1 , . . . , skik ), wobei skik ∈ Sk gilt für alle i = 1, . . . , k.

6. Diskrete ZV

7. Charakteristika

8. Exponential

Anzahl:

N = n1 · n2 · . . . · nk .

75 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

2.1 Klassische kombinatorische Probleme

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

2.2 Beispiele

2.3 Arithmetische Beziehungen zwischen den

Beispiele

Binomialkoeffizienten

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

2.4 Die Stirling Formel

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

76 / 895

Beispiele (1)

Stochastik für

InformatikerInnen

Eine Gruppe von r Studenten verreist in einem Zug

Wolfgang Kössler

Die Studenten verteilen sich zufällig auf n ≥ r

1. Grundbegriffe

Abteile. Es sei A das Ereignis, daß alle Studenten in

2. Kombinatorik

verschiedenen Abteilen sitzen.

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

n(A)

.

N

N = nr = #Möglichkeiten für die Verteilung der

P(A) =

r Studenten auf die n Abteile

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

n(A) = n · (n − 1) · . . . · (n − r + 1)

n(A)

n · (n − 1) · . . . · (n − r + 1)

P(A) =

=

.

N

nr

77 / 895

Beispiele (2)

Stochastik für

InformatikerInnen

Ziehen von Kugeln

Wolfgang Kössler

In einer Urne sollen sich n Kugeln befinden. Von

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

diesen seien n1 schwarz, n − n1 dagegen weiß. Nun

werden k Kugeln (zufällig) entnommen, und zwar

Beispiele

Binomialkoeffizienten

ohne Zurücklegen.

Stirling-Formel

3. Bedingte Wkt

A: “von diesen k Kugeln genau k1 schwarz”

4. Klass. Wkt.

P(A) =

5. Zufallsvariablen

n(A)

.

N

6. Diskrete ZV

7. Charakteristika

8. Exponential

N=

n

k

=# Möglichkeiten, k Kugeln aus n Kugeln

auszuwählen.

78 / 895

Beispiele (2a)

Stochastik für

InformatikerInnen

Ziehen von Kugeln (Fortsetzung)

Wolfgang Kössler

n(A)= Anzahl der Möglichkeiten zur Entnahme von k

1. Grundbegriffe

Kugeln, bei denen genau k1 schwarze Kugeln

2. Kombinatorik

ausgewählt werden.

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

In einem solchen Fall sind dann auch genau k − k1

weiße Kugeln entnommen worden. Also

3. Bedingte Wkt

1

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

Die Anzahl der Möglichkeiten, aus n1 schwarzen

Kugeln k1 schwarze auszuwählen (ohne

Wiederholung und ohne Berücksichtigung der

Reihenfolge) ist nk11 .

79 / 895

Beispiele (2b)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Ziehen von Kugeln (Fortsetzung)

1

Die Anzahl der Möglichkeiten, aus n − n1

1. Grundbegriffe

weißen Kugeln k − k1 weiße auszuwählen

2. Kombinatorik

(ebenfalls ohne Wiederholung und ohne

Problemstellungen

Beispiele

Berücksichtigung der Reihenfolge) ist

Binomialkoeffizienten

n−n1

k−k1

.

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

n1

n − n1

#günstige Ereignisse = n(A) =

·

k1

k −k

n−n1 1

n1

· k −k

n(A)

k

P(A) =

= 1 n 1

N

k

7. Charakteristika

8. Exponential

Hypergeometrische Wahrscheinlichkeit.

80 / 895

Beispiele (3)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Lotto 6 aus 49

Wenn wir uns die Zahlen als Kugeln denken, die aus

1. Grundbegriffe

einer Urne entnommen werden, und außerdem

2. Kombinatorik

gezogene Zahlen im nachhinein als schwarze

Problemstellungen

Beispiele

Kugeln ansehen, so kann jeder Tip durch die

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

Entnahme von 6 Kugeln verkörpert werden. A:

Ereignis , daß vier Richtige getippt werden.

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

n = 49,

n1 = 6,

k = 6,

k1 = 4,

49−6

6

·

P(A) = 4 496−4

6

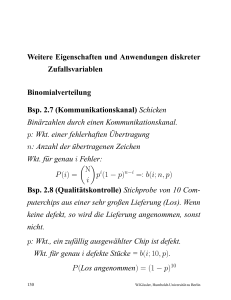

81 / 895

Beispiele (4)

Stochastik für

InformatikerInnen

1. Grundbegriffe

Zwei nicht unterscheidbare Würfel

Wie groß ist die Anzahl der Würfe mit 2 nicht zu

2. Kombinatorik

unterscheidenden Würfeln?

Wolfgang Kössler

Problemstellungen

Beispiele

Seien i, j die Augenzahlen und o.B.d.A. i ≤ j.

Binomialkoeffizienten

Stirling-Formel

Wir vergeben die Tupel (i, j), wenn i 6= j.

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

Wir vergeben die Tupel (i, 7), wenn i = j.

Die gesuchte Anzahl ist die Anzahl der möglichen

Auswahlen aus der Menge {1, . . . , 7}, d.h.

7

2

.

7. Charakteristika

8. Exponential

82 / 895

Beispiele (5)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

Wie groß ist die Anzahl der Würfe mit 3

nicht zu unterscheidenden Würfeln?

Seien i, j, k die Augenzahlen und o.B.d.A. i ≤ j ≤ k.

Wir vergeben die Tripel

(i, j, k), wenn i < j < k.

(i, k, 7), wenn i = j < k.

(i, j, 8), wenn i < j = k.

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

(i, 7, 8), wenn i = j = k.

Die gesuchte Anzahl ist die Anzahl der möglichen

Auswahlen aus der Menge {1, . . . , 8}, d.h.

8

3

.

83 / 895

Beispiele (6)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

Verteilen von n Geldstücken an k Studenten (k ≤ n)

Auf wieviele Weisen ist das möglich?

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

a) jeder Student bekommt mindestens ein Stück.

Geldstücke nebeneinander legen und k − 1

Trennstriche verteilen unter n − 1 möglichen

N = kn−1

−1

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

84 / 895

Beispiele (6a)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

Verteilen von n Geldstücken

b) es wird zugelassen, dass Studenten nichts

erhalten.

Problemstellungen

Beispiele

Trick: Borgen von k Stücken −→ n + k Stück

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

k − 1 Trennstriche verteilen unter den jetzt

n + k − 1 möglichen

N = n+k−1

k −1

Dann gibt jeder Student genau ein Stück zurück.

7. Charakteristika

8. Exponential

85 / 895

Beispiele (6b)

Stochastik für

InformatikerInnen

Wolfgang Kössler

ein weiterer Zugang:

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

Verteilen von n Geldstücken an k Studenten

Wir basteln einen Würfel mit k Flächen und würfeln n

Beispiele

Binomialkoeffizienten

mal.

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

Beim i-ten Wurf bekommt der Student das

Geldstück, dessen Nummer gewürfelt wurde.

−1

N = n+k

k −1

6. Diskrete ZV

7. Charakteristika

8. Exponential

86 / 895

Beispiele (7)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Hashing

Beobachtungen (oder Daten) abspeichern auf einem

1. Grundbegriffe

Feld.

2. Kombinatorik

k: Anzahl der Beobachtungen

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

n: Feldlänge (k ≤ n)

Das Abspeichern geschieht mit Hilfe von

Hashfunktionen (oder Hashtafeln).

zufällige Daten: Kollisionen können auftreten.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

Ak ,n : Ereignis, daß Kollisionen auftreten. ges.:

P(Ak ,n )

87 / 895

Beispiele (7a)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Hashing (Fortsetzung)

k−1

i

n(n − 1) · · · (n − k + 1) Y

=

(1 − )

P(Ak ,n ) =

k

n

n

i=0

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

= exp

k −1

X

i=0

k−1

X

i

)

≤ exp(−

n

i=0

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

i ln(1 − )

n

= exp(−

(k − 1)k

k2

) ≈ exp(− )

2n

2n

ln(1 − x) < −x für x < 1

88 / 895

Beispiele (8)

Stochastik für

InformatikerInnen

Suche von Elementen. Sei n = |Ω|

Wolfgang Kössler

Greifen zufällig eine k -elementige Teilmenge A ⊆ Ω

1. Grundbegriffe

heraus.

2. Kombinatorik

ω1 , ...: Schlüsselelemente (vorgegeben), ω1 , ... ∈ Ω

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

Frage: Mit welcher Wkt. ω1 ∈ A?

n−1

P(A) =

k −1

n

k

=

k

n

Frage: Mit welcher Wkt. ω1 , . . . , ωr ∈ A?

n−r

k(k − 1) · · · (k − r + 1)

k−r

P(A) = n =

n(n − 1) · · · (n − r + 1)

k

89 / 895

Beispiele (8a)

Stochastik für

InformatikerInnen

Suche von Elementen (Fortsetzung)

Wolfgang Kössler

Sei r fest,

1. Grundbegriffe

≈

2. Kombinatorik

P(A) ≥

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

k

n

→ p: P(A) ∼ pr

1

,

2

falls pr ≥

1

2

falls k ≥

Soll also die Wkt., daß alle r Schlüsselelemente in

3. Bedingte Wkt

der Teilmenge enthalten sind, größer als

4. Klass. Wkt.

muß

5. Zufallsvariablen

k≥

6. Diskrete ZV

7. Charakteristika

8. Exponential

n

21/r

1

2

sein, so

n

21/r

gewählt werden.

90 / 895

Kombinatorik

Zusammenfassung

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

n: # Elemente = |Ω|

k: # auszuwählende Elemente

k1 , . . . , km : Häufigkeit der einzelnen Elemente

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

ohne Wiederholung

mit Wiederhol.

n!

n!

k1 !···km !

n(n − 1) · · · (n − k + 1)

nk

n

k

n+k −1

k

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

Permutationen

Variationen

Kombinationen

91 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

2.1 Klassische kombinatorische Probleme

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

2.2 Beispiele

2.3 Arithmetische Beziehungen zwischen den

Beispiele

Binomialkoeffizienten

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

2.4 Die Stirling Formel

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

92 / 895

2.3 Arithmetische Beziehungen

zwischen den Binomialkoeffizienten

Stochastik für

InformatikerInnen

(1)

1.

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

2.

Problemstellungen

Beispiele

n

n

=

k

n−k

n

n−1

n−1

=

+

k

k

k −1

Binomialkoeffizienten

Stirling-Formel

3.

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

n X

n

k=0

4.

n

X

k =0

k

= 2n

n

(−1)

=0

k

k

93 / 895

Arithmetische Beziehungen zwischen

den Binomialkoeffizienten (2)

Stochastik für

InformatikerInnen

Wolfgang Kössler

5.

n 2

X

n

1. Grundbegriffe

2. Kombinatorik

k =0

k

=

2n

n

Problemstellungen

Beispiele

6.

Binomialkoeffizienten

Stirling-Formel

i=0

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

n X

m

n

n+m

=

k −i

k

i

7.

n

X

n

= n · 2n−1

k

k

k =1

7. Charakteristika

8. Exponential

94 / 895

Arithmetische Beziehungen zwischen

den Binomialkoeffizienten (3)

Stochastik für

InformatikerInnen

Wolfgang Kössler

8. Definieren die Folge

b n+1

c

2

1. Grundbegriffe

Sn =

2. Kombinatorik

X

k =0

Problemstellungen

n−k

k

Beispiele

Binomialkoeffizienten

Stirling-Formel

Zeigen Sie: Sn+1 = Sn + Sn−1 .

3. Bedingte Wkt

Beweis:

4. Klass. Wkt.

vollständige Induktion

5. Zufallsvariablen

3 Methoden,

algebraisch

6. Diskrete ZV

7. Charakteristika

8. Exponential

kombinatorisch

teilweise Übungsaufgabe, teilweise Übung

2

95 / 895

Inhalt

Stochastik für

InformatikerInnen

Wolfgang Kössler

2.1 Klassische kombinatorische Probleme

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

2.2 Beispiele

2.3 Arithmetische Beziehungen zwischen den

Beispiele

Binomialkoeffizienten

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

2.4 Die Stirling Formel

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

96 / 895

2.4 Die Stirling Formel

Stochastik für

InformatikerInnen

Satz: Es gilt

Wolfgang Kössler

1. Grundbegriffe

n! ∼

√

n

n

2πn

.

e

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

Beweis: Die Aussage des Satzes ist äquivalent zu

√

1

ln n! ∼ ln 2π + (n + ) ln n − n.

2

Sei

1

dn := ln n! − (n + ) ln n + n.

2

Es genügt zu zeigen,

√

lim dn = ln 2π.

n→∞

8. Exponential

97 / 895

Beweis der Stirling-Formel (2)

Stochastik für

InformatikerInnen

Wir schätzen die Differenz dn − dn+1 ab, dann das

Wolfgang Kössler

Verhalten der Folge {dn } und versuchen den

1. Grundbegriffe

Grenzwert zu bestimmen. Die Differenz dn − dn+1 ist

= ln n! − ln(n + 1)!

1

1

−(n + ) ln n + (n + 1 + ) ln(n + 1) + n − (n + 1)

2

2

n!

= ln (n+1)!

+ (n + 12 )(ln(n + 1) − ln n) + ln(n + 1) − 1

1

n+1

= − ln(n + 1) + (n + ) ln

+ ln(n + 1) − 1

2

n

2n + 1 n + 1

=

ln

−1

2

n

1

1 1 + 2n+1

= (2n + 1) · ln

− 1.

1

2 1 − 2n+1

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

98 / 895

Beweis der Stirling-Formel (3)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Es gilt für −1 < x < 1:

1. Grundbegriffe

2. Kombinatorik

ln(1 + x) =

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

ln(1 − x) =

5. Zufallsvariablen

i=1

∞

X

i=1

3. Bedingte Wkt

4. Klass. Wkt.

∞

X

ln

1+x

1−x

(−1)i+1

xi

i

(−1)i+1

(−x)i

i

= ln(1 + x) − ln(1 − x) = 2

∞

X

x 2i+1

2i + 1

i=0

6. Diskrete ZV

7. Charakteristika

8. Exponential

99 / 895

Beweis der Stirling-Formel (4)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

dn − dn+1

1

2n+1

und erhalten (x 6= 0)

∞

X

1

1 1

2i+1

· ·2 x +

x

−1

=

x 2

2i + 1

Setzen x :=

i=1

2. Kombinatorik

Problemstellungen

Beispiele

=

Binomialkoeffizienten

i=1

Stirling-Formel

3. Bedingte Wkt

<

6. Diskrete ZV

7. Charakteristika

8. Exponential

1

1

2i + 1 (2n + 1)2i

∞

X

1

i=1

4. Klass. Wkt.

5. Zufallsvariablen

∞

X

1

3 (2n + 1)2i

1

1

1

− 1 wobei q =

3 1−q

(2n + 1)2

1

=

3((2n + 1)2 − 1)

=

100 / 895

Beweis der Stirling-Formel (5)

Stochastik für

InformatikerInnen

Wolfgang Kössler

Offenbar gilt auch

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

Beispiele

1

X 1

1

1

=

·

< dn − dn+1 ,

2

3(2n + 1)

2i + 1 (2n + 1)2i

i=1

Binomialkoeffizienten

Stirling-Formel

also

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

1

1

< dn − dn+1 <

.

2

3(2n + 1)

3((2n + 1)2 − 1)

6. Diskrete ZV

7. Charakteristika

8. Exponential

101 / 895

Beweis der Stirling-Formel (6)

Abschätzung der Schranken

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

1

1

1

1

=

=

−

3((2n + 1)2 −1)

12n(n + 1)

12n 12(n + 1)

1

12

1

=

=

3(2n + 1)2

12n(n + 1) + 3

12(12n(n + 1) +

12

=

12 · 12n(n + 1) + 36

12

>

2

12 · 12n + 12 · 12n + 24n + 13

12

=

12 · 12n2 + 12 · 14n + 13

12

=

(12n + 1)(12n + 13)

1

1

=

−

12n + 1 12(n + 1) + 1

102 / 895

Beweis der Stirling-Formel (7)

Stochastik für

InformatikerInnen

Beide Ungleichungen zusammen

Wolfgang Kössler

1. Grundbegriffe

1

1

1

1

−

< dn −dn+1 <

−

12n + 1 12(n + 1) + 1

12n 12(n + 1)

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

(dn −

1

1

) − (dn+1 −

)<0<

12n

12(n + 1)

1

1

) − (dn+1 −

)

(dn −

12n + 1

12(n + 1) + 1

5. Zufallsvariablen

6. Diskrete ZV

Folge {dn −

7. Charakteristika

Folge {dn −

8. Exponential

1

} ist monoton fallend

12n+1

1

} ist monoton wachsend.

12n

103 / 895

Beweis der Stirling-Formel (8)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

6. Diskrete ZV

7. Charakteristika

8. Exponential

Beide Folgen haben denselben Grenzwert

c := lim dn ,

1

1

< c < dn −

12n

12n + 1

1

1

c+

< dn < c +

12n + 1

12n

dn −

Erinnerung:

1

dn = ln n! − (n + ) ln n + n

2

1

n

−n

n− 2

⇒ edn = n!

e

104 / 895

Beweis der Stirling-Formel (9)

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

1

2. Kombinatorik

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

ec+ 12n+1

1

ec e 12n+1

√ n n 1

ec n

e 12n+1

e

1

ec+ 12n

< edn <

−n − 1

1

< n! en

n 2 < ec e 12n

√ n n 1

< n! <

ec n

e 12n

e

Bleibt zu zeigen

ec =

√

2π.

6. Diskrete ZV

7. Charakteristika

8. Exponential

105 / 895

Beweis der Stirling-Formel (10)

Hilfsrechnungen

Stochastik für

InformatikerInnen

Wolfgang Kössler

1. Grundbegriffe

Z

0

Z

In

Problemstellungen

Beispiele

Binomialkoeffizienten

Stirling-Formel

3. Bedingte Wkt

4. Klass. Wkt.

5. Zufallsvariablen

π/2

sinn−1 x · sin x dx

0

π/2

= sinn−1 x · (− cos x)0 −

Z π/2

(n − 1) sinn−2 x cos x · (− cos x) dx

0

Z π/2

= (n − 1)

sinn−2 x(1 − sin2 x) dx

=

0

6. Diskrete ZV

8. Exponential

sinn x dx

In :=

2. Kombinatorik

7. Charakteristika

π/2

In

= (n − 1)(In−2 − In )

n−1

=

In−2

n

106 / 895

Beweis der Stirling-Formel (11)

Hilfsrechnungen (Fortsetzung, 1)

Stochastik für

InformatikerInnen

Wolfgang Kössler

I1 = 1

I2

I3 =