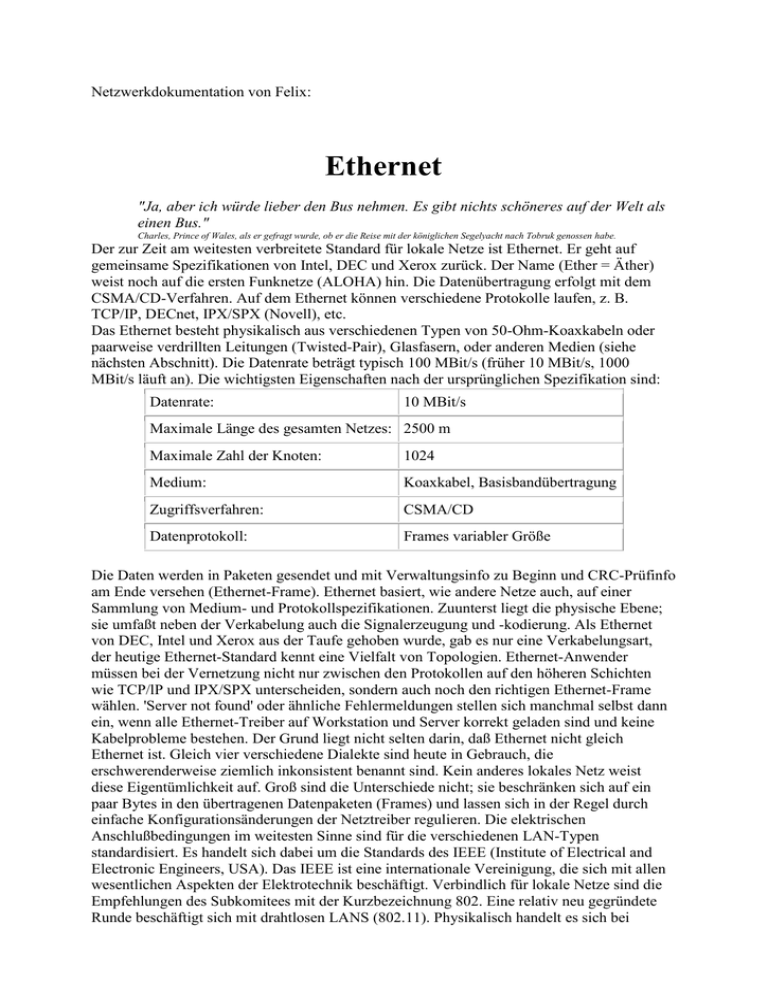

Netzwerkdokumentation von Felix:

Werbung