Hochgeladen von

Khaled Mu

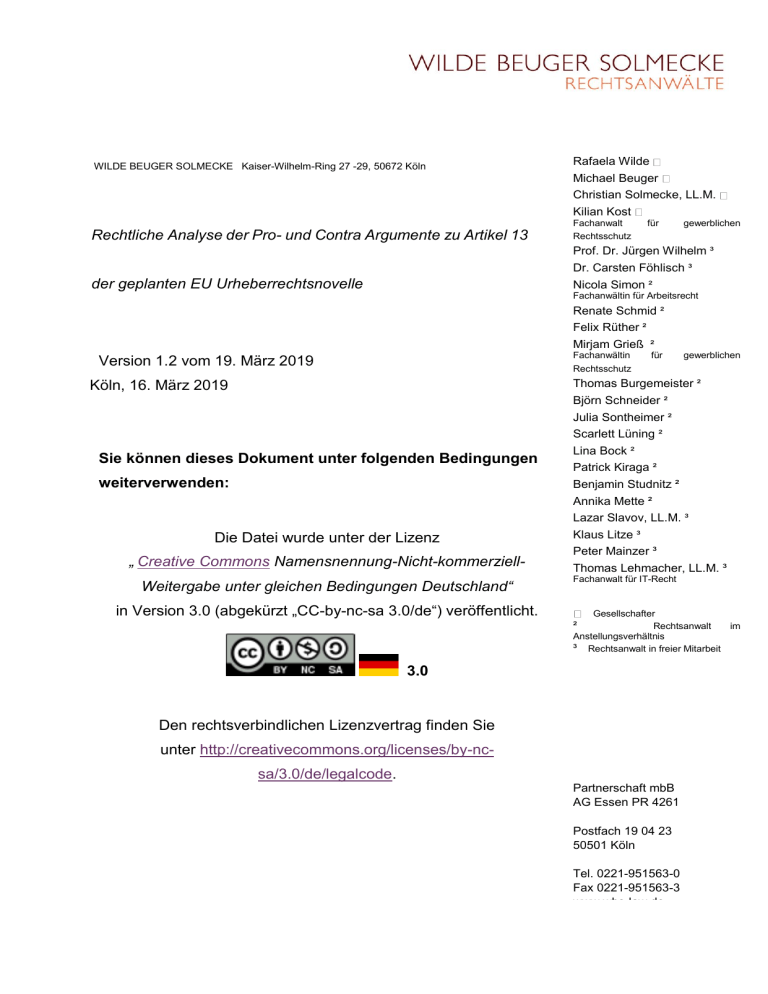

Analyse-Artikel-13-Version-1.2-WILDE-BEUGER-SOLMECKE-Rechtsanwälte

Werbung