PowerPoint-Präsentation

Werbung

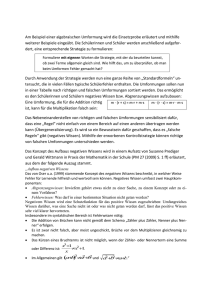

Automatische Akquisition linguistischen Wissens Berechnung von Wortassoziationen, Verallgemeinerung der Berechnung von Redewendungen 1. 2. 3. 4. Was genau sind Assoziationen? Wozu sind sie gut? Einschub: Lexikalische Wortnetze Wie kann man sie erkennen? Wie könnte man ein Programm schreiben, welches sie erkennt? Wie erkennt man, wie viele man schon gefunden hat? 4. Referat: Church 89 und 91, sowie Terra & Clarke 03 5. Referat: Wortnetz basiert: Resnik 99, Budanitsky 99 WS 05/06 Automatische Akquisition linguistischen Wissens 1 1. Definition von Assoziation Aristoteles: • [Der Lauf unserer Erinnerung wird bestimmt] von Ähnlichem oder Gegenteiligem, oder von dem, was nah zusammen ist: durch all das entsteht Erinnerung. Experimentelle Bestimmung und anschließend Kategorisierung: Jung & Ricklins folgendes Experiment: • Versuchsperson bekommt Reizwort und soll so schnell wie möglich das erste ihr dazu einfallende Wort sagen. Anschließend werden gerankte Häufigkeitslisten angefertigt, welches Wort am Häufigsten ist. • Anschließend Kategorisierung in Ursachen WS 05/06 Automatische Akquisition linguistischen Wissens 2 1.1. Beispiel für Assoziationsexperiment Stimulus Antwort VP Anz. VPs Butter Brot 60 weich 40 Milch 32 Margarine 27 Käse 20 Fett(e) 16 gelb 14 Butterbrot 8 Dose 6 essen 6 • Auffällig ist – dass auch hier wieder Zipfverteilung zum tragen kommt – Dass verschiedene Relationen zum Vorschein kommen WS 05/06 Automatische Akquisition linguistischen Wissens 3 1.2. Jung & Ricklins Tabelle der Assoziationen Einordnung I II WS 05/06 Innere Assoziationen •Koordination zwischen Reiz und Antwort –Beiordnung –Unterordnung –Überordnung –Kontrast •Prädikative Beziehung – Substantiv und Adjektiv – Substantiv und Verb – Bestimmung von Ort, Zeit, – Mittel und Zweck, Definitionen oder Erklärungen •Kausale Abhängigkeit Äußere Assoziationen • Koexistenz • Identität • Sprachlich-motorische Formen – eingeübte sprachliche Verbindung – Sprichwörter und Zitate – Wortzusammensetzungen und -veränderungen prozentuale Häufigkeit Beispiel 19.6 Kirsche – Apfel Baum – Buche Katze – Tier süß – sauer 18.7 1.0 16.0 6.3 26.5 Automatische Akquisition linguistischen Wissens Schlange – giftig Harz – klebt Essen – Mittag Türe - Hauptwort Schmerz - Tränen Schüler – Lehrer großartig – prächtig dunkel - hell Glück – Glas Tisch – Bein 4 1.3. Jung & Ricklins Tabelle der Assoziationen II –vorzeitige Reaktion (die Antwort bezieht sich lediglich auf den ersten Teil des Reizwortes) –Interjektionen Dunkelrot – hell Stinken – pfui III Klangreaktionen •Wortergänzung •Klang •Reim IV Restgruppe • Mittelbare Assoziationen (Die Beziehung zw. Reiz und Antwort ist durch ein drittes Wort vermittelt) • Sinnlose Reaktion • Fehlende Reaktion • Wiederholung des Reizwortes V Egozenttrische Reaktion 1.7 Tanzen – mag ich nicht 1.2 VI Perseveration (Die Antwort steht in Beziehung zu einem bereits früher gegebenen Reizwort) (heutzutage unter Priming bekannt) Deckel – Kiste Ratte - Korb VII Wiederholung einer früher gegebenen Antwort 9.1 WS 05/06 1.1 2.2 0.8 Wunderbar – bar rosten – Roastbeef Herz – Schmerz 1.2 weiß - weit 0.3 1.5 0.1 Automatische Akquisition linguistischen Wissens 5 1.4. Kontiguitätsprinzip Früher Mutmaßungen darüber wie Assoziationen funktionieren Hartley 1749, Mill 1869: • Verknüpfung einander ähnelnder Objekte basiert auf dem Kontiguitätsprinzip: Ähnliche Objekte werden häufig gleichzeitig oder in unmittelbarer Folge wahrgenommen W. James 1890 Kontiguitätsprinzip: • Objects once experienced together tend to become associated in the imagination, so that when any one of them is thought of, the others are likely to be thought of also, in the same order of sequence or coexistence as before. This statement we may name the law of mental association by contiguity WS 05/06 Automatische Akquisition linguistischen Wissens 6 1.5. „Widerlegung“ des Kontiguitätsprinzips In heutiger Psychologie allerdings Ansicht, dass Kontiguitätsprinzip allein nicht ausreicht, um Wortassoziationen zu erklären • Angriffspunkt ist Experiment, bei welchem sinnlose Folgen von Silben präsentiert werden und anschließend tatsächlich aufeinander folgende Folgen als solche wieder erkannt werden • Jenkins (1974) kommt zur Ansicht, dass Assozitationstheorie keine brauchbaren Ergebnisse geliefert hat. (uminterpretation des sinnlos-Silbenexperiments – dass dieser Mechanismus in Wirlkichkeit nicht vorkommt) • Clark 1970 findet, dass freie Assoziationen Ergebnis von symbolverarbeitenden Prozessen sind WS 05/06 Automatische Akquisition linguistischen Wissens 7 1.6. Zusammenfassung • Assoziationen und Berechnung von Assoziationen sind eine Verallgemeinerung der Berechnung von Redewendungen. • Es gibt deshalb aber noch weniger klare Definition was Assoziiert sein soll und was nicht. • Ebenfalls unklar, ob es verschiedene Sorten von Assoziationen geben soll oder nicht und ob diese überhaupt automatisch unterscheidbar sein können. WS 05/06 Automatische Akquisition linguistischen Wissens 8 2. Anwendungen • Lexikographen – Welche Umgebung für gegebenes Wort relevant • Design von Grammatiken, bzw. syntaktische Disambiguierungsregeln für Wörter entdecken und nach Wichtigkeit sortieren • Information Retrieval – query expansion, bessere Indexierungen • Shvaneveldts knowledge organization programm http://iv.slis.indiana.edu/sw/pfnet.html • Sprechhilfen • Kontrollfaktor bei Psycholinguistischen Experimenten • Fremdsprachunterricht • Werbung… WS 05/06 Automatische Akquisition linguistischen Wissens 9 2.1. Semantic talk • Ein Tool, welches beim freien Assoziieren im Gespräch behilflich sein kann • … und protokollierend einen „roten Faden“ durch die angeschnittenen Themen zeichnet Afghanistan Georgien Irak WS 05/06 Automatische Akquisition linguistischen Wissens 10 2.2. Zitationsvisualisierung http://www.pages.drexel.edu/~cc345/papers/computer.html WS 05/06 Automatische Akquisition linguistischen Wissens 11 3. Einschub Lexikalische Wortnetze • Wortnetze umfassen den am häufigsten gebrauchten Wortschatz einer Sprache und enthalten grundlegende semantische Beziehungen zwischen Vokabeln: – – – – Synonymie, Antonymie Hyponymie Meronymie … • Ziel ist es dabei, eine nicht nur nach Wortform, sondern auch nach Wortbedeutung navigierbare Ressource zu schaffen. • Weiterhin soll ein Modell geschaffen werden, welches vernünftig mit Polysemie und Synonymie umgehen kann, sowie erweiterbar um andere Relationen ist. WS 05/06 Automatische Akquisition linguistischen Wissens 12 3.1. Anordnung der Wortnetze • Synsets (set of synonyms) sind ausreichend für differenzierende Repräsentation von Bedeutungen – Lexeme mit gleicher Bedeutung sind zu Konzepten zusammengefasst, den sog. Synsets, welche als zentrale Repräsentationseinheiten fungieren – Die Realisierungen (Wortformen) eines gegebenen Konzeptes sind synonym zueinander. – board schon mit plank oder committee disambiguiert (daher unterscheidend) • Zusätzlich Unterscheidung verschiedener Relationstypen: – lexikalische Relationen (Synonymie, Antonymie) gelten zwischen individuellen Realisierungen von Konzepten – konzeptuelle Relationen (Hyponymie, Hyperonymie, Meronymie, kausale Relation) gelten zwischen Konzepten (und somit für alle Realisierungen) WS 05/06 Automatische Akquisition linguistischen Wissens 13 3.2. Relationen in Wortnetzen • Die wichtigsten üblicherweise in Wortnetzen abgebildeten Relationen sind folgende: – Synonyme: Bedeutungsähnlichkeit (Abfall - Müll) – Antonyme: Gegenteiligkeit (hoch - tief) – Hyperonyme: Begriffshierarchie, Über- und Unterbegriffe (Katze – Säugetier – Tier – Lebewesen) – Meronyme: Teil-von Beziehung (Radkappe – Rad – Auto) • Ständige Probleme – Vollständigkeit – Polysemie – Aktualität WS 05/06 Automatische Akquisition linguistischen Wissens 14 3.3. Wortnetze für Deutsch und Englisch • Für Englisch entstand mit Roget’s Thesaurus Anfang des 20sten Jahrhunderts ein erstes Wortnetz, welches in vielen Dingen Pionierarbeit leistete, die Beziehungen aber noch nicht explizit waren • Anfang der 90er Jahre entstand in Princeton University durch George A. Miller ein großes neues und später online frei verfügbares Wortnetz mit explizit annotierten Relationen • Für Deutsch entstand einige Jahre später das auf Lizenz verfügbare GermaNet Wortnetz, welches äquivalent zu WordNet sein sollte, allerdings wurden einige Relationen anders gehandhabt und der Umfang von WordNet wurde mangels Finanzierung nie erreicht. • Andere Projekte wie EuroWordNet erreichten nie annähernd den Umfang dieser zwei Projekte WS 05/06 Automatische Akquisition linguistischen Wissens 15 4. Berechnung von Assoziationen • 2 Mögliche Vorgehen – Benutzen von Ressourcen wie WordNet, um Abstand zweier Wörter zum messen. Hauptproblem hier, Abstand zu definieren (Resnik, Budanitsky) – Wie bei Redewendungen über Kookkurrenzen verschiedener Sorten (Weeds 04, Terra &Clarke 03, Dagan et al. 95, Shvaneveld 89) • Textkorpus zusammenstellen • Lokal für jedes Wort stärkste Assoziationen berechnen – Eher größere Fenster oder Satzgrenzen statt Nachbarschaftskookkurrenzen • Evtl. in die verschiedenen Kategorien einordnen • Verifizieren • Theoretische Frameworks (Lehr, Rieger) • Evaluierungsprobleme: Geringe Übereinstimmung zwischen menschlichen Annotatoren, kaum Gold-standard Daten verfügbar, speziell wenn Gold-standard bereits zur Berechnung verwendet wurde WS 05/06 Automatische Akquisition linguistischen Wissens 16 4.1. Ähnlichkeit durch Abstand • Wiederkehrende Begriffe: – Terminologischer Abstand: Wie gut ein Begriff ein Konzept ausdrückt – Semantischer Abstand wie konzeptueller Abstand, wie Unterschiedlich zwei Konzepte (ausgedrückt durch evtl. mehrere Termini jeweils) sind. • Idee ist, die hierarchische Struktur eines Wortnetzes auszunutzen (Resniks 99) und (Budanitsky 00) – Wenn zwei Wörter Synonyme sind oder einen gemeinsamen Oberbegriff besitzen, sind sie sehr ähnlich – Andere Möglichkeit ist, kürzesten Pfad im Synonymgrafen (oder Allgemein alle Beziehungen als Kanten aufzufassen) zu berechnen und Länge dieses Pfades WS 05/06 Automatische Akquisition linguistischen Wissens 17 4.2. Berechnen über Kookkurrenzen • Idee der Kontiguität praktisch angewandt bedeutet messen, welche Wörter mit welchen auffällig oft auftreten • Wie bei Redewendungen Kookkurrenzen berechnen, allerdings mit größerem Kontextfenster – Übliche Fenstergrößen von 2 oder 5 oder Satzkookkurrenzen • In Statistik gibt es Begriff der „Assoziiertheit“ z.B. des Auftretens zweier Entitäten in einer Stichprobe. Assoziiert bedeutet ebenfalls korreliert. • Allerdings hat dieser Begriff dazu geführt, dass einige Wissenschaftler das gemeinsame Auftreten zweier Wörter mit einem Assoziationsmaß nachgewiesen haben und dadurch WS 05/06 Automatische Akquisition linguistischen Wissens 18 4.2.1. Maße • Nachdem sich Idee mit p(A,B)=p(A)*p(B) und daraus folgenden Mutual Information als schlecht herausstellte, begann Suche nach perfektem Maß • Welche durch Dunning 93 auch mit log-likelihood eigentlich beendet sein sollte • Aber durch weitere Ideen (poisson Approximierung des loglikelihood), Unabhängigkeitstests t-score, dice und jaccard Koeffizient usw. • Es kristallisiert sich jedoch zunehmend heraus, dass optimal loglikelihood oder Poisson Approximationen sind • Subjektiv ist es allerdings oft schwierig zu entscheiden, ob ein Maß besser oder schlechter ist, als ein anderes WS 05/06 Automatische Akquisition linguistischen Wissens 19 4.2.2. Beispiele • Logl gegen dice, baseline (reine Frequenz) und MI – Bei baseline wird die Wichtigkeit von Signifikanz versus reiner Frequenz deutlich Eingabe logl dice baseline MI | | | | | Abfall Abfall Abfall Abfall Abfall | | | | | radioaktiv Tonne entsorgen Endlager werden | | | | | radioaktiv entsorgen Endlager Entsorgung hochradioaktiv | | | | | dund in werden ein | | | | | Abklingzeit Bodenwurzel Chemie-Praktikum Dosenbier-Trinker STAWA | | | | | Zink Zink Zink Zink Zink | | | | | Kupfer Blei und Cadmium Silber | | | | | Blei Kupfer Cadmium Zinn Nickel | | | | | dund %N% ein in | | | | | Verzinken Eisengegenstand Hartlot Bismut stolberger | | | | | Montag Montag Montag Montag Montag | | | | | am %N% Uhr abend in | | | | | am abend Uhr Freitag kommend | | | | | dam %N% in ein | | | | | VHS-Öffnungszeit Focus-Tag Einzelhandlesverband FIS-Sicherheitsexperte Freischützstras WS 05/06 Automatische Akquisition linguistischen Wissens 20 4.4. Theoretische Frameworks • Andrea Lehr : Aus soziologischer Sichtweise betrachtet, welche Phänomäne in Sprache wirklich auftreten und beobtachtbar sind. – So ist z.B. klare Trennung zwischen Alltagssprache und nichtAlltagssprache kaum beobachtbar – Kollokationen und Redewendungen stellen einen wichtigen Bestandteil der Deutschen Gegenwartssprache dar – Experimente mit Probanden, die tatsächlich beobachtbare Unterschiede (auch Sorten von Assoziationen) be- oder widerlegen • Rieger – Stellte Bedeutungsraumtheorie auf, welche zwischen syntagmatischen und paradigmatischen Relationen unterscheidet, aber auch mathematisch berechenbar bleibt – Letzteres durch konsequente Akzepanz der Unschärfe von Bedeutung, d.h. Katze ist nicht einfach Tier, sondern auch in unsere Gehirn z.B. zu 0.8 Tier – Mehrere Strata, Sprache als Struktur, Kognition WS 05/06 Automatische Akquisition linguistischen Wissens 21 4.5. Evaluierungsmöglichkeiten • Experiment, bei welchem Versuchspersonen zu einer Reihe von Wörtern – erstes Wort nennen sollen, welches ihnen einfällt – Eine Liste von passendsten Wörtern anfertigen sollen – Oder von Algorithmus generierte Liste bewerten soll WS 05/06 Stimulus Antwort VP Anz. VPs Kollokation Signifikanz Butter Brot 60 Brot 51 weich 40 Käse 49 Milch 32 Zucker 29 Margarine 27 Milch 23 Käse 20 Margarine 22 Fett(e) 16 Mehl 18 gelb 14 Eier 16 Butterbrot 8 Pfund 14 Dose 6 zerlassener 13 essen 6 Fleisch 13 Automatische Akquisition linguistischen Wissens 22 4.5.1. Evaluieren gegen Gold-Standards • Im Gold-standard in beliebiger Relation zu Eingabewort stehende Wörter als richtig gezählt • Precision: Wieviele der top x (z.B. 50) Wörter, die der Algorithmus berechnet/gerankt hat sind im Gold-standard verlinkt? – lion: sea mountain MGM Durkovitz Singh tamarin Punjabi … animal – lion: cub panther lioness cougar puma catamount – Precision 1/50 • Recall: Wenn y der Wörter der top x Treffer waren, wie viele der direkt mit Eingabewort in Relation stehenden sind das? – Mit lion stehen in Goldstandard 100 in Relation, also bei lion Recall 1/100 • Beispiele: WordNet, GermaNet, Rogets Thesaurus, TOEFL WS 05/06 Automatische Akquisition linguistischen Wissens 23 4.5.2. Indirekte Evaluierungen • Künstliche Synonyme einführen, indem zufällige Hälfte der Vorkommen des zu testenden Wortes durch lion1 und lion2 ersetzt wird, danach messen, ob lion2 durch Algorithmus als ähnlichstes zu lion1 berechnet wurde. – Funktioniert nur mit Synonymen – Ungenaue Messung • Wenn Applikation und Umgebung vorhanden, in welcher derartige Daten genutzt werden, kann mittels Feedbackmechanismen getestet werden, ob Zufriedenheit der Benutzer mit neuen Daten gestiegen ist – Sehr unzuverlässig und Störfaktoren sind schwer aus Statistik eliminierbar – Aufwändig, da Applikation und Testumgebung selten vorhanden WS 05/06 Automatische Akquisition linguistischen Wissens 24 Referat Church 89, 91 und Terra & Clarke 03 • Tagger auf Testkorpus anwenden und Churches Algorithmus nachempfinden • An ein paar Beispielen vorführen, wie Schiff und Boot, stark und mächtig, wie sein Algorithmus genutzt werden kann, um diese Unterschiede zu verdeutlichen WS 05/06 Automatische Akquisition linguistischen Wissens 25 Referat Resnik und Budanitsky WS 05/06 Automatische Akquisition linguistischen Wissens 26 Quellen • Reinhard Rapps Dissertation: http://www.fask.unimainz.de/user/rapp/papers/disshtml/main/main.html WS 05/06 Automatische Akquisition linguistischen Wissens 27