Hilfsmittel aus Mathematik und Statistik $ Materialien zu „Investition

Werbung

Hilfsmittel aus Mathematik und Statistik

- Materialien zu „Investition und Finanzierung”Lehrstuhl für Betriebswirtschaftslehre mit Schwerpunkt Finanzierung

Universität Passau

2006

Inhaltsverzeichnis

1 Statistik

1.1 Statistische Verteilungsparameter und ihre Berechnung: Erwartungswert, Varianz,

Kovarianz . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.2 Wichtige Eigenschaften der Basisparameter

Erwartungswert, Varianz und Kovarianz . . . . . . . . . . . . . . . . . . . . . . .

2 Matrizenrechnung

2.1 Grundsätzliche Konstruktion . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.2 Rechnen mit Vektoren und Matrizen . . . . . . . . . . . . . . . . . . . . . . . .

2.3 Darstellungsmöglichkeiten mittels Matrizenrechnung

(anhand eines Beispiels aus dem Bereich „Portfolio–Selektion”) . . . . . . . . .

2.4 Di¤erentiation von Matrizen und Vektoren . . . . . . . . . . . . . . . . . . . . .

2.5 Di¤erentiation von Matrizen und Vektoren (anhand

eines Beispiels aus dem Bereich „Portfolio–Selektion”) . . . . . . . . . . . . . .

2.6 Abschließ

ende Bemerkungen:

Au‡ösung nach einer Unbekannten, wenn sie in einer Vektorgleichung enthalten

1

2

2

5

.

.

12

12

13

.

.

16

17

.

19

ist 20

Kapitel 1

Statistik

1.1

Statistische Verteilungsparameter und ihre Berechnung:

Erwartungswert, Varianz, Kovarianz

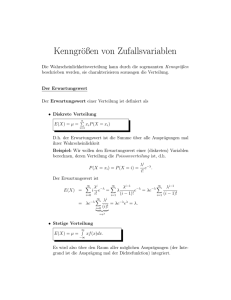

Üblicherweise begegnet man drei Verteilungsparametern: Erwartungswert, Varianz, Kovarianz.

Weitere Kenngröß

en (Höhere Momente, Schiefe, etc.) werden im Weiteren nicht behandelt. Alle

diese Größ

en lassen sich letztlich auf das Konzept des Erwartungswertes zurückführen

– Erwartungswert:

Verbale Beschreibung:

Der Erwartungswert ist die mit den Eintrittswahrscheinlichkeiten gewichtete Summe

der möglichen Realisationen einer Zufallsvariablen. Im einfachsten Fall einer Zufallsgröß

en mit endlich vielen (n) möglichen Werten können diese Werte als Datenreihe

aufgeschrieben werden.

Formale Beschreibung:

Sei hier und im Folgenden X eine reelle Zufallsvariable mit endlich vielen möglichen

Ausprägungen x1 ; : : : ; xn . Für die Eintritts–Wahrscheinlichkeit gelte prob[X = xi ] =

n

X

pi 2 [0; 1], wobei

pi = 1 gilt. Dann berechnet man den Erwartungswert E[X] im

i=1

endlichen Fall wie folgt:

E [X] =

n

X

pi xi

i=1

X:

xi :

pi :

Zufallsvariable

Die i–te Ausprägung der Zufallsvariable n X (i 2 1 : : : n)

Eintritts–Wahrscheinlichkeit der Ausprägung xi (i 2 1 : : : n)

Beispiel:

Eine Zufallsvariable X sei wie folgt gegeben:

X =

x1 = 1

x2 = 3

mit Wahrscheinlichkeit

mit Wahrscheinlichkeit

2

1

2

1

2

Dann gilt für den Erwartungswert von X:

E[X]

2

X

=

pi xi = p1 x1 + p2 x2

i=1

1

2

=

1+

1

2

3=2

Für die De…nition des Erwartungswerts bei Zufallsvariablen mit abzählbar unendlich

vielen möglichen Werten (z. B. Z) oder mit überabzählbar vielen möglichen Werten

(z. B. R oder [0; 1]) sei auf die einschlägige Literatur verwiesen.

– Varianz:

Verbale Beschreibung:

Die Varianz ist die erwartete quadratische Abweichung einer Zufallsvariablen von ihrem Erwartungswert.

Formale Beschreibung:

var[X] =

n

X

pi (xi

i=1

h

2

E[X]) = E (X

2

E[X])

i

Beispiel:

Es sei die Zufallsvariable X von oben gegeben.

var[X]

=

n

X

pi (xi

2

E[X])

i=1

= p1 (x1

=

1

2

(1

2

E[X]) + p2 (x2

2)2 +

1

2

(3

2

E[X])

2)2 = 1

Zusatz:

Die Varianz hat als quadrierte Größ

e auch die ursprüngliche Einheit zum Quadrat, z.B. Geldeinheiten2 . Man rechnet aber lieber mit Geldeinheiten (und nicht

mit ihrem Quadrat).

Die Standardabweichung std[X] =

Im Beispiel gilt: std[X] =

p

X

var[X] =

– Kovarianz:

3

=

p

p

var[X] wird gebildet.

1=1

Verbale Beschreibung:

Die Kovarianz ist ein Maßfür das Zusammenspiel zweier Zufallsvariable n.

Formale Beschreibung:

cov [X; Y ]

=

n

X

pi (xi

E[X]) (yi

E[Y ])

i=1

= E [(X

E[X]) (Y

E[Y ])]

Beispiel:

Es gebe zwei Zustände „Zustand 1”und „Zustand 2”. In Abhängigkeit des Zustands

nehme das Zufallsvariable n–Paar (X; Y ) die Werte der folgenden Tabelle an. Man

spricht von „gemeinsamer Verteilung”. Die Eintritts–Wahrscheinlichkeiten der beiden

Zustände seien wieder jeweils 12 .

X

Y

Zustand 1 mit Wahrscheinlichkeit

1

2

1 = x1

5 = y1

Zustand 2 mit Wahrscheinlichkeit

1

2

3 = x2

2 = y2

Es gilt:

E[Y ]

=

1

2

var[Y ]

=

1

2

cov[X; Y ]

=

5+

2 = 3; 5

3; 5)2 +

(5

2

X

1

2

pi (xi

1

2

(2

3; 5)2 = 2; 25

E[X]) (yi

E[Y ])

i=1

= p1 (x1

=

=

1

2

(1

E[X]) (y1

2) (5

3; 5) +

E[Y ]) + p2 (x2

1

2

(3

2) (2

E[X]) (y2

E[Y ])

3; 5)

1; 5

Zusatz:

Die Zufallsvariablen X und Y heiß

en unkorreliert, falls cov[X ; Y ] = 0. Sind X

und Y stochastisch unabhängig, so sind sie auch unkorreliert; die Umkehrung ist

aber im Allgemeinen falsch.

Es gilt: cov[X; X] = var[X].

4

Die Kovarianz kann beliebige Werte annehmen:

)

Es ist schwierig zu sagen, ob Zufallsvariable n mit hoher Kovarianz

ein stärkeres Zusammenspiel aufweisen als solche mit niedriger Ko–

varianz.

)

Man de…niert den Korrelationskoe¢ zienten

als eine Art normierte

Kovarianz, um Vergleiche zu ermöglichen:

cov[X; Y ]

X E [X] Y E [Y ]

= cov

;

std[X] std[Y ]

std[X]

std[Y ]

1 mit den folgenden Interpretationen:

= corr[X; Y ] =

Es gilt

=

1

1:

=0 :

Zufallsvariable n laufen völlig gegeneinander.

Zufallsvariable n laufen völlig unbeein‡usst nebeneinander, d.h.

sie haben nichts miteinander zu tun.

=1 :

Zufallsvariable n laufen völlig miteinander.

Das „miteinander Laufen”bzw. „gegeneinander Laufen”von Zufallsvariablen bezieht sich dabei auf eine a¢ n lineare Beziehung zwischen den Zufallsvariable n,

denn es gilt: j j = 1 genau dann, wenn a; b 2 R existieren mit prob[Y = a X +b] =

1.

– Bemerkung: Bisher wurde die Wahrscheinlichkeit für einen Zustand si

explizit vorgegeben, z.B. prob(s1 ) = 21 .

(i 2 1 : : : n)

Eine alternative Möglichkeit ist die Vorgabe der Verteilung der Zustände. Daraus erreichnet

man die Eintritts–Wahrscheinlichkeit en, z.B. 3 Zustände mit Gleichverteilung:

prob(s1 ) = prob(s2 ) = prob(s3 ) =

1.2

1

3

Wichtige Eigenschaften der Basisparameter

Erwartungswert, Varianz und Kovarianz

– Basisparameter und sichere Größ

en:

Eine sichere Größ

e liefert in jedem Zustand (genauer: in jedem Zustand mit positiver

Eintritts–Wahrscheinlichkeit) einen identischen Wert. Man spricht auch von einer deterministischen Größ

e oder –im exakten mathematischen Sprachgebrauch –von einer

fast sicheren Größ

e.

5

Erwartungswert einer sicheren Größ

e:

Der Erwartungswert einer sicheren Größ

e ist die sichere Größ

e. Sei etwa Z eine

Zufallsvariable mit prob[Z = r] = 1, dann gilt: E[Z] = 1 r = r.

Beispiel:

Z

Zustand s1 mit Wahrscheinlichkeit

1

2

r

Zustand s2 mit Wahrscheinlichkeit

1

2

r

Dann gilt:

E[Z] =

1

2

r +

1

2

r = r:

Varianz einer sicheren Größ

e:

Die Varianz einer sicheren Größ

e beträgt 0, d.h. eine sichere Größ

e schwankt (de…nitionsgemäß

) nicht. Sei wieder Z eine Zufallsvariable mit prob[Z = r] = 1, dann gilt

E[Z] = r und es folgt

var[Z] =

n

X

i=1

2

pi r E[Z]

| {z }

0

=0

Die Kovarianz einer sicheren mit einer unsicheren Größ

e:

Die Kovarianz einer sicheren mit einer anderen, im Allgemeinen unsicheren Größ

e beträgt 0. Eine sichere und eine unsichere Größ

e laufen also völlig unbeein‡usst nebeneinander. Sie sind unkorreliert. Sei wieder Z eine Zufallsvariable mit prob[Z = r] = 1,

und sei X irgendeine Zufallsvariable. Es folgt:

cov[Z; X] =

n

X

i=1

pi r E[Z]

| {z }

0

xi

E[X] = 0

– Das Vielfache einer Zufallsvariablen und die Summe zweier Zufallsvariablen:

Allgemeines:

Seien X und Z zwei Zufallsvariable n und a eine reelle Zahl. Dann sind W := a X

und U := X + Y zwei (neue) Zufallsvariable n.

6

Beispiel:

X

Y

W := 4 X

U := X + Y

Zustand 1

1

5

4

6

Zustand 2

3

2

12

5

Erwartungswert:

Der Erwartungswert ist linear, d.h.

(i)

und

(ii)

E [a X] = a E [X]

E [X + Y ] = E [X] + E [Y ]

denn es gilt

(i)

E [a X] =

x

P

pi (a xi ) =

i=1

und

(ii)

E [X + Y ] =

x

P

x

P

a (pi xi ) = a

i=1

pi (xi + yi ) =

i=1

x

P

pi xi +

i=1

x

P

i=1

Die Kovarianz ist symmetrisch und bilinear, d.h.

(i)

cov[X ; Y ]

= cov[Y ; X],

(ii)

cov[a X ; Y ]

= a cov[X ; Y ],

cov[X ; b Y ]

= b cov[X ; Y ],

cov[X + Y ; Z]

= cov[X ; Z] + cov[Y ; Z],

cov[X ; Y + Z]

= cov[X ; Y ] + cov[X ; Z],

denn es gilt:

7

pi xi = a E [X]

i=1

Kovarianz

(iii)

x

P

pi yi = E [X] + E [Y ]

(i)

cov[X ; Y ]

=

=

n

X

pi (xi

E[X]) (yi

E[Y ])

i=1

n

X

pi (yi

E[Y ]) (xi

E[X])

n

X

pi (a xi

E[a X]) (yi

E[Y ])

pi (a xi

a E[X]) (yi

E[Y ])

a pi (xi

E[X]) (yi

E[Y ])

E[X]) (yi

E[Y ])

i=1

= cov[Y ; X]

(ii)

cov[a X ; Y ]

=

=

=

i=1

n

X

i=1

n

X

i=1

=a

n

X

pi (xi

i=1

= a cov[X ; Y ]

Die zweite Gleichung folgt aus der Symmetrie, d.h. aus Gleichung (i).

(iii)

cov[X + Y ; Z] =

=

=

=

n

X

i=1

n

X

i=1

n

X

n

X

pi (xi + yi )

E[X + Y ] (zi

E[Z])

i=1

pi (xi + yi )

pi (xi

pi (xi

(E[X] + E[Y ]) (zi

E[X]) + (yi

E[X]) (zi

E[Y ]) (zi

E[Z]) +

i=1

n

X

E[Z])

E[Z])

pi (yi

i=1

= cov[X ; Z] + cov[Y ; Z]

Die zweite Gleichung folgt wieder aus der Symmetrie.

Varianz

Die Varianz ist quadratisch, d.h.

(i)

var[a X] = a2 var[X]

(ii)

var[X + Y ] = var[X] + 2 cov[X ; Y ] + var[Y ]

(zur Struktur: Vgl. Binomische Formel)

denn es gilt:

8

E[Y ])(zi

E[Z])

(i)

var[a X]

(ii)

=

cov[a X ; a X]

=

a a cov[X ; X]

=

a2 var[X]

var[X + Y ] = cov[X + Y ; X + Y ]

= cov[X ; X + Y ] + cov[Y ; X + Y ]

= cov[X ; X] + cov[X ; Y ] + cov[Y ; X] + cov[Y ; Y ]

= var[X] + 2 cov[X ; Y ] + var[Y ]

Anwendungsgebiet des Vielfachen einer Zufallsvariablen bzw. der Summe zweier Zufallsvariablen:

Die Rendite–Preis–Umrechnung: Wir betrachten aus einer Menge von Wertpapieren ein bestimmtes Papier j. Sein Preis im Zeitpunkt t = 0 sei deterministisch Pj .

Seine Zahlung im Zeitpunkt t = 1 sei stochastisch Zj . Seine Rendite Rj ist stochastisch

und ergibt sich aus:

Pj (1 + Rj ) = Zj () Rj =

Zj

Pj

1 () 1 + Rj =

Zj

Pj

Erwartungswert:

)

Zj

Zj

Pj = Pj E

= Pj E[1 + Rj ] = Pj (1 + E[Rj ])

Pj

Pj

d.h. der Erwartungswert einer Zahlung des Papiers j ergibt sich

aus dem Erwartungswert von (1 + Rendite) durch Multiplikation

mit seinem Preis.

Man beachte, dass bei dem letzten Gleichheitszeichen die Linearität

des Erwartungswerts und der Erwartungswert einer sicheren Größ

e

angewendet worden ist.

E[Zj ] = E

E[Zj ]

Pj

d.h. der Erwartungswert von (1 + Rendite) des Papiers j ergibt sich

aus dem erwarteten Zahlungsstrom des Papiers durch Division mit

seinem Preis.

Varianz:

)

E[1 + Rj ] =

9

)

)

Zj Pj

= var[1 + Rj ] Pj2 = 1 var[Rj ] Pj2

Pj

d.h. die Varianz einer Zahlung des Papiers j ergibt sich aus der

Varianz der Rendite durch Multiplikation mit seinem quadrierten

Preis

var[Zj ] =var

var[Zj ]

Pj2

d.h. die Varianz der Rendite des Papiers j ergibt sich aus der

Zahlungsstromvarianz durch Division mit seinem quadrierten Preis.

var[Rj ] =

Kovarianz:

)

)

Zi Pi Zj Pj

;

Pi

Pj

= Pi Pj cov[1 + Ri ; 1 + Rj ]

= 2 Pi Pj cov[Ri ; Rj ]

d.h. die Kovarianz der Zahlungsströme zweier Papiere i und j ergibt

sich aus der Renditekovarianz durch Multiplikation mit den Preisen

beider Wertpapiere.

cov[Zi ; Zj ] = cov

cov[Z ;Z ]

cov[Ri ;Rj ] = Pi Pi j j

d.h. die Kovarianz der Renditen zweier Papiere i und j ergibt sich

aus der Zahlungsstromkovarianz durch Division mit den Preisen

beider Wertpapiere.

– Weitere Eigenschaften der Basiskennzahlen:

Zusammenhang zwischen Korrelationskoe¢ zient und Kovarianz:

cov[X; Y ]

=

) cov[X; Y ] =

std[X] std[Y ]

std[X] std[Y ]

Verschiebungssätze

Es gilt:

1 Der deterministische Summand 1 verschwindet bei der Varianz–Bildung. Wir beweisen diese Eigenschaft

später im Abschnitt „Weitere Eigenschaften der Basis–Kennzahlen“ .

2 Auch

bei der Kovarianz–Bildung verschwinden deterministische Summanden.

10

(i)

(ii)

(iii)

var[X]

= E[X 2 ]

(E[X])2

E[X 2 ]

= var[X] + (E[X])2

cov[X ; Y ]

= E[X Y ]

E[X Y ]

= cov[X ; Y ] + E[X] E[Y ] ,

cov[X ; Y ]

h

= E X(Y

bzw.

,

E[X] E[Y ]

bzw.

i

h

E[Y ]) = E (X

E[X])Y

i

,

denn es gilt:

h

i

(ii) cov[X ; Y ] = E (X E[X])(Y E[Y ])

h

i

= E X Y X E[Y ] E[X]Y + E[X] E[Y ]

(i)

(iii)

= E[X Y ]

E[X] E[Y ]

= E[X Y ]

E[X] E[Y ] .

E[X] E[Y ] + E[X] E[Y ]

Folgt aus (ii), da var[X] = cov[X ; X].

h

E X(Y

i

h

E[Y ]) = E X Y

= E[X Y ]

E[X] E[Y ]

(ii)

=

i

X E[Y ]

cov[X ; Y ] .

Varianz einer Summe

Leicht zu zeigen sind nun folgende Eigenschaften:

(i)

var [Xi + Xj ] = var [Xi ] + var [Xj ] + 2 cov [Xi ; Xj ]

(ii)

var [ai Xi + aj Xj ] = a2i var [Xi ] + a2j var [Xj ] + 2ai ai cov [Xi ; Xj ]

(iii)

var [Xi + Xj + Xk ] =

var [Xi ] + var [Xj ] + var [Xk ] + 2 cov [Xi ; Xj ] + 2 cov [Xi ; Xk ] + 2 cov [Xj ; Xk ]

(iv)

var [1 + X] = var [X]

(v)

cov [1 + X; Y ] = cov [X; Y ]

11

Kapitel 2

Matrizenrechnung

2.1

Grundsätzliche Konstruktion

– Zahl oder Skalar

– Vektor

a

b

a 2 R.

bzw.

(a b)1

2

mit

2 1

a; b 2 R

Die Schreibweise 2

1 bzw. 1

2 bezeichnet die Dimension des Vektors, d.h. wie viele

Zeilen und Spalten er hat. Die erste Zahl beschreibt die Anzahl der Zeilen, die zweite Zahl

die Anzahl der Spalten.

a

b

2

1

(a b)1

2

: 2 Zeilen, 1 Spalte ) Spaltenvektor

: 1 Zeile, 2 Spalten ) Zeilenvektor

Spaltenvektoren sind die Standardform der Darstellung von Vektoren; wenn man von einem

Vektor spricht, meint man automatisch einen Spaltenvektor. Ein (n 1)–Spaltenvektor x

ist ein Element aus Rn , man schreibt x 2 Rn .

– Matrix

Eine (2

abc

def

mit

2

3

a; : : : ; f 2 R

3)–Matrix, die aus 2 Zeilen und 3 Spalten besteht.

– Fazit

Schon der rein optische Vergleich von Vektoren und Matrizen mit Zahlen legt nahe, dass

für Vektoren und Matrizen andere Rechenregeln als für Zahlen benötigt werden.

12

2.2

Rechnen mit Vektoren und Matrizen

– Grundsätzlich gilt, dass nur Vektoren/Matrizen passender Dimension verknüpft werden

können.

) Klärung, was unter „passend“ zu verstehen ist.

– Addition und Subtraktion von Vektoren/Matrizen ist komponentenweise de…niert:

a

b

a

b

c

d

+

2

1

c

d

e

+

2

ab

cd

1

2

2

1

!

:

3

2

Nicht de…niert, da unterschiedliche Dimensionen.

1

ef

gh

+

a+c

b+d

=

a+e b+f

c+g d+h

=

2

2

– Die Transposition als Vektor/Matrix –typische Operation

Die Transposition macht aus Zeilen nun Spalten und aus Spalten nun Zeilen. Beispiel:

x

=

x1

x2

=

xT

=

x1

x2 = 1

A

=

AT

=

3

1

0

3

@1

0

1

5

1

3

: Spaltenvektor

3

: Zeilenvektor

0

2

: (2 3)_Matrix

1

1

5A

2

: (3 2)_Matrix

– Multiplikation

Multiplikation einer Zahl mit einem Vektor/einer Matrix: Die Skalare Multiplikation

Man multipliziert den Skalar mit allen Komponenten des Vektors/der Matrix:

x1

x2

a b

c d

x1

x2

=

( 2 R)

a

c

=

13

b

d

( 2 R)

Multiplikation zweier Matrizen: Das Matrizen–Produkt

Zwei Matrizen A und B können multizipliert werden, wenn die Anzahl der Spalten

der ersten Matrix gleich der Anzahl der Zeilen der zweiten Matrix ist.

Für die Dimensionen gilt dann:

(m

Beispiele:

(1 2) (2

1) = (1

(1

2) (1

2): Nicht de…niert

(1

2)T (1

2) = (2

k) (k

n) = (m

n)

1): Eine Zahl, d.h. ein Skalar

1) (1

2) = (2

2)

Rechenregel:

a b

c d

e

g

f

h

=

a e+b g

c e+d g

a f +b h

c f +d h

Das Element (i,j) der Ergebnis–Matrix ergibt sich aus der i–ten Zeile der ersten Matrix

und der j–ten Spalte der zweiten Matrix. Beachte, dass das Matrizen–Produkt nicht

kommutativ ist.

Beispiel:

3

1

1

5

0

2

0

1

@1

0

1

2

1A =

1

4

4

5

9

Spezialfall des Matrizen–Produkts: Das (Standard–) Skalarprodukt oder das Innere Produkt oder die Vektor–Multiplikation

Seien0x; y12 Rn zwei

der gleichen Dimension (n

0 Vektoren

1

x1

y1

x = @ ... A ; y = @ ... A, dann heiß

t das Produkt

xn

yn

xT y = y T x =

n

X

1), also n–Spaltenvektoren

xi yi

i=1

Inneres Produkt oder (Standard–) Skalarprodukt.

Beispiel:

x=

1

2

; y=

xT y = y T x =

14

1

1

1+2 = 1

– Division

Für Vektoren/Matrizen ist –mit Ausnahme der Inversen–Bildung –keine Division de…niert.

– Inversen–Bildung

Betrachtet man nur quadratische Matrizen der Dimensionen (n

heitsmatrix

0

1

id = E = @0

0

eine Matrix, die für

0

1

0

1

0

0A

1

n), so ist die sog. Ein-

(n = 3)

(A 2 Rn

A id = id A = A

n

)

gilt. Die Einheitsmatrix id ist das „neutrale Element der Multiplikation“.

Bei den reellen Zahlen ist die 1 das neutrale Element der Multiplikation. Für =

6 0 gilt:

1

1

1

=

= 1

= 1. Die Zahl

ist deshalb das „inverse Element“ zu .

Die zur (n

n)–Matrix A inverse Matrix A

A A

1

1

ist derart de…niert, dass

1

= A

A = id

gilt. Man kann zeigen, dass

(i)

(ii)

(iii)

(iv)

die

die

die

die

inverse

inverse

inverse

inverse

Matrix

Matrix

Matrix

Matrix

eindeutig ist, falls sie existiert;

existiert, falls die Spalten der Matrix linear unabhängig sind;

existiert, falls die Zeilen der Matrix linear unabhängig sind;

existiert, falls die Determinante verschieden von null ist.

Konkrete Berechnung für den (2

1

a b

c d

=

2)–Fall:

1

det

d

c

b

a

=

1

ad

d

c

bc

b

a

Beispiel:

1

3

2

4

1

=

1

1 4

4

3

2 3

2

1

=

2

1; 5

1

0; 5

Proben:

1

3

2

4

2

1; 5

1

0; 5

=

1

0

0

1

und

15

2

1; 5

1

0; 5

1

3

2

4

=

1

0

0

1

2.3

Darstellungsmöglichkeiten mittels Matrizenrechnung

(anhand eines Beispiels aus dem Bereich „Portfolio–

Selektion”)

– Skalarprodukt (Vektormultiplikation)

Verbale Darstellung:

Die Einzelvermögen, die in die einzelnen Wertpapiere investiert werden, dürfen das

insgesamt zur Verfügung stehende Budget nicht übersteigen.

(übliche) formale Darstellung:

x1 P1 + x2 P2 + : : : + xn Pn = W (0) ()

Dabei ist

n

X

xi Pi = W (0)

i=1

0

1

x1

B

C

x = @ ... A

xn

der Vektor der Stückzahlen, mit denen die einzelnen Wertpapiere ins Portfolio eingehen

und W (t) der Wert des Vermögens, das im Zeitpunkt t = 0; 1; : : : vorhanden ist

Vektor–Darstellung:

0

1

0 1

x1

P1

Sei x = @ ... A der Stückzahlenvektor und P = @ ... A der Preisvektor, dann:

xn

Pn

x1 x2 : : : xn

0

1

P1

B P2 C

B C

B .. C = W (0)

@ . A

Pn

oder

xT P = W (0)

– Vektor–Matrizen–Multiplikation:

Verbale Darstellung:

Varianz des Endvermögens, wobei sich das Endvermögen W (1) aus den Rückströmen

zweier verschiedener Papiere zusammensetzt, in die jeweils mit den Stückzahlen x1

und x2 investiert wurde: W (1) = x1 Z1 + x2 Z2 .

(übliche) formale Darstellung:

var[x1 Z1 + x2 Z2 ] = x21 var[Z1 ] + x22 var[Z2 ] + 2 x1 x2 cov[Z1 ; Z2 ]

16

oder

var[x1 Z1 + x2 Z2 ] =

2 X

2

X

xj cov[Zi ; Zj ] xi

i=1 j=1

oder Matrix–Darstellung:

var[x1 Z1 + x2 Z2 ] = x1 x2

oder

var[Z1 ]

cov[Z1 Z2 ]

cov[Z1 Z2 ]

var[Z2 ]

{z

}

|

C

x1

x2

var[x1 Z1 + x2 Z2 ] = xT C x

2.4

Di¤erentiation von Matrizen und Vektoren

– Eine lineare Funktion (lineare Abbildung)

Wir betrachten die folgende lineare Funktion g als Funktion des Vektors x:

0 1

0 1

a1

x1

g(x) = aT x mit a = @ ... A 2 Rn fest und x = @ ... A 2 Rn

an

xn

Dann gilt für die Ableitung nach x:

@ aT x

@ xT a

@ g(x)

=

=

= a

@x

@x

@x

Die Ableitung von g ist also der Spaltenvektor a 2 Rn .

Begründung: Zunächst muss man wissen, dass man unter der Ableitung nach dem

Vektor x den Spaltenvektor der partiellen Ableitungen versteht:

0 @

1

@ x1 g(x)

@

..

A

g(x) = @

.

@x

@

@ xn g(x)

Da für i 2 1 : : : n

@

@ xi

g(x) = ai

gilt, folgt die Behauptung.

Man beachte die Analogie zum eindimensionalen Fall:

Sei f eine lineare Funktion der reellen Zahl x:

f (x) = a x mit a 2 R f est und x 2 R

17

Dann gilt bekanntlich:

@

@ ax

f (x) =

= a:

@x

@x

– Eine quadratische Funktion (quadratische Abbildung)

Wir betrachten die folgende quadratische Funktion g als Funktion des Vektors x:

0 1

x1

g(x) = xT A x mit A 2 Rn n symm.fest und x = @ ... A 2 Rn

xn

Dann gilt für die Ableitung nach x:

@ g(x)

@ xT A x

=

= 2Ax

@(x)

@x

Die Ableitung von g ist also der Spaltenvektor 2 A x 2 Rn .

Begründung: Zunächst gilt:

g(x) =

n X

n

X

xj xk ajk

j=1 k=1

Für die Ableitung nach einer Komponente xi (i 2 1 : : : n) gilt:

n

n

X

X

@

aij xj = 2 aTi x

2 aij xj = 2

g(x) = 2 aii xi +

@ xi

j=1

j=1

j6=i

ai : i–te Zeile/Spalte von A.

Für die Ableitung nach dem Vektor x gilt deshalb:

0 @

1

@ x1 g(x)

@

..

A = 2Ax

g(x) = @

.

@x

@

g(x)

@ xn

Man beachte die Analogie zum eindimensionalen Fall:

Sei f eine quadratische Funktion der reellen Zahl x:

f (x) = a x2

mit a 2 R fest und x 2 R

Dann gilt bekanntlich:

@ a x2

@

f (x) =

= 2 ax :

@x

@x

18

2.5

Di¤erentiation von Matrizen und Vektoren (anhand

eines Beispiels aus dem Bereich „Portfolio–Selektion”)

– Verbale Darstellung:

Minimiere die Varianz des Endvermögens unter der Nebenbedingung, dass das Budget eingehalten wird. Die Stückzahlen x1 und x2 stellen dabei die Entscheidungsparameter dar.

– Matrizen–Darstellung und Lagrange–Ansatz:

min xT C x + (W (0)

x

xT P)

Wir leiten gemäßAbschnitt 2.4 nach dem Stückzahlenvektor x ab und setzen gleich null:

0=

@ T

x Cx

@x

@

@x

xT P = 2 C x

P

bzw.

Cx

2

P=0

– Wir machen die Probe und minimieren einzeln bezüglich der Parameter x1 und x2 :

M in x21 var[Z1 ] + x22 var[Z2 ] + 2 x1 x2 cov[Z1 ; Z2 ] + (W (0)

x ;x

1

2

@

= 0 = 2 x1 var[Z1 ] + 2 x2 cov[Z1 ; Z2 ]

@ x1

P1

@

= 0 = 2 x2 var[Z2 ] + 2 x1 cov[Z1 ; Z2 ]

@ x2

P2

x1 P1

x2 P2 )

bzw:

var(Z1 )

cov(Z1 ; Z2 )

cov(Z1 ; Z2 ) var(Z2 )

x1

x2

2

P1

P2

=

0

0

() C x

– Wichtige Regeln beim Di¤erenzieren:

@ xT C x

= 2Cx ;

@x

d.h. Di¤erentiation von quadratischen Formen wie die quadratische Funktion

@ a x2

= 2 a x,

@x

@ PT x

@ xT P

=

= P;

@x

@x

d.h. Di¤erentiation von quadratischen Formen wie die quadratische Funktion

@a x

= a

@x

19

2

P=0

2.6

Abschließ

ende Bemerkungen:

Au‡ösung nach einer Unbekannten, wenn sie in einer

Vektorgleichung enthalten ist

– Ausgangspunkt:

Die Unbekannte

soll aus folgender Vektorgleichung ermittelt werden:

Cx

2

P=0

– Au‡ösen nach :

2Cx =

( )

P

Das System ( ) besteht aus n Gleichungen, die alle simultan zu erfüllen sind. Daher

kann man, die Kenntnis von x vorausgesetzt, prinzipiell aus jeder dieser Gleichungen ermitteln. Man kann aber auch jede dieser Gleichungen mit einer beliebigen Zahl

(also auch xi durchmultiplizieren und anschließ

end alle Gleichungen addieren. D.h.:

Lösungsweg:

Die Vektorgleichung wird durch skalare Multiplikation von links mit dem Vektor x in

eine Gleichung transformiert werden, die nur aus Zahlen (Skalaren) besteht. Dann ist

eine einfache Division möglich.

Konkrete Umsetzung:

Rückgri¤ auf die Budgetbedingung xT P = W (0).

Wir multiziplieren die Gleichung ( ) von links mit xT :

T

2x

C x} =

| {z

(1 1)

T

x

| {zP}

(1 1)

a) die (vormalige) Vektorgleichung besteht nur noch aus Skalaren

b) xT P ist aus der Budgetbedingung bekannt. Es gilt nämlich

c) xT P = W (0) :

Daraus folgt:

2 xT C x =

W (0) ()

20

=

2 xT C x

W (0)