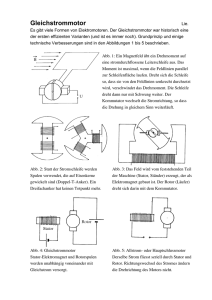

1 Elektrotechnik Grundlagen

Werbung